开源模型 vs 闭源API 选型决策矩阵

·

🤍 前端开发工程师、技术日更博主、已过CET6

🍨 阿珊和她的猫_CSDN博客专家、23年度博客之星前端领域TOP1

🕠 牛客高级专题作者、打造专栏《前端面试必备》 、《2024面试高频手撕题》、《前端求职突破计划》

🍚 蓝桥云课签约作者、上架课程《Vue.js 和 Egg.js 开发企业级健康管理项目》、《带你从入门到实战全面掌握 uni-app》

文章目录

一、核心选型维度总览

| 对比维度 | 闭源大模型 API(GPT-4、Claude、文心一言等) | 开源大模型(LLaMA 2/3、Mistral、Qwen、GLM 等) |

|---|---|---|

| 使用门槛 | 极低,调用即用,无部署成本 | 高,需算力、运维、工程化能力 |

| 数据安全 | 数据出域,不可完全自主可控 | 私有化部署,数据不出内网,完全可控 |

| 能力上限 | 极高,多模态、长文本、推理全面领先 | 接近但略低于头部闭源,部分场景可平替 |

| 定制能力 | 弱,仅支持微调/提示词,无法改模型 | 极强,可全参数微调、PEFT、改架构、二次开发 |

| 成本结构 | 按 Token 计费,长期使用边际成本高 | 一次性算力投入 + 电费,流量越大越划算 |

| 延迟与稳定性 | 高稳定、低延迟,服务商SLA保障 | 不稳定,受硬件、量化、并发影响大 |

| 合规与监管 | 平台负责合规,用户责任较轻 | 使用者全责,需自行做安全对齐与内容过滤 |

| 可控性/可解释 | 黑盒,无法干预内部逻辑 | 白盒,可审计、修改、加固、监控 |

| 生态与工具 | 成熟,插件、函数调用、知识库完善 | 快速发展,本地化工具链丰富但碎片化 |

| 适用场景 | 快速上线、C端产品、轻量级企业应用 | 隐私敏感、私有化、高并发、深度定制场景 |

二、分场景决策结论

1. 优先选择闭源 API 的场景

- 产品需要快速上线、最小化研发成本

- 面向C端用户,对稳定性、体验、响应速度要求极高

- 数据不敏感,允许上传至第三方平台

- 需求以通用对话、文案、摘要、翻译、简单推理为主

- 月调用量中等偏低,不想承担服务器与运维成本

- 无合规审查、等保、涉密要求

2. 优先选择开源模型的场景

- 数据涉密、隐私敏感(金融、政务、医疗、企业内部)

- 必须私有化部署 / 内网隔离 / 断网运行

- 高并发、高频调用,长期 Token 费用过高

- 需要深度定制(修改架构、专项微调、安全对齐、行业适配)

- 有合规/审计要求,必须完全自主可控

- 希望构建技术壁垒,不依赖单一厂商API

三、成本对比(关键决策点)

闭源 API

- 成本随调用量线性增长

- 初期成本极低,上线快

- 规模上去后费用不可控

开源模型

- 一次性投入:GPU 服务器 / 云算力

- 后期成本主要是电费与运维

- 日活/调用量越大,越比 API 便宜

简单判断线:

日 Token 消耗越高,越应该用开源私有化。

四、技术团队匹配度

- 无AI工程团队 → 闭源API

- 有后端/算法工程师 → 开源可落地

- 需要持续迭代安全、行业能力 → 开源更具长期价值

五、综合选型决策公式

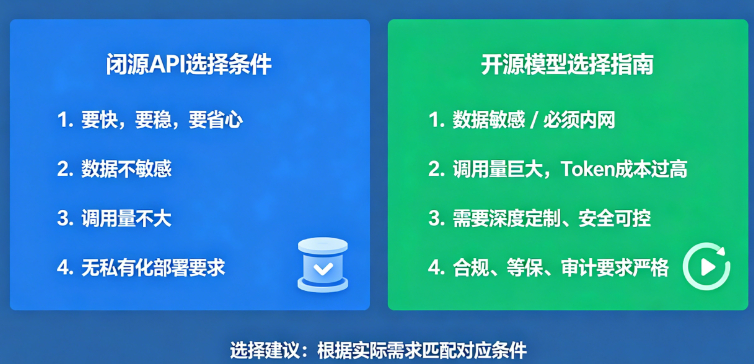

满足以下任意一条,选闭源API:

- 要快,要稳,要省心

- 数据不敏感

- 调用量不大

- 无私有化部署要求

满足以下任意一条,选开源模型:

- 数据敏感 / 必须内网

- 调用量巨大,Token 成本过高

- 需要深度定制、安全可控

- 合规、等保、审计要求严格

六、一句话总结

- 闭源API = 好用、省心、贵、不可控

- 开源模型 = 可控、定制、长期便宜、需要技术能力

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)