基于yolov11的手势检测识别,多模态检测,支持图像、视频和摄像实时检测【pytorch框架、python源码】

更多目标检测、图像分类识别、目标追踪、图像检索、图像分割等其他项目可看我主页其他文章

功能演示(看 shi pin 简介):

基于yolov11的手势检测识别系统,支持图像检测,也支持视频和摄像实时检测【pytorch框架、python源码】_哔哩哔哩_bilibili

(一)简介

本文介绍了一个基于YOLOv11的手势检测识别系统项目。该项目使用PyTorch框架实现,包含完整的代码、数据集、预训练模型权重和GUI界面。系统支持图像检测、视频检测以及实时摄像头检测功能。GUI界面采用PySide6设计,简洁实用。项目提供了详细的环境配置指南和训练流程:从数据集准备、模型训练到验证测试。数据集中包含丰富的手势图像样本,训练结果展示了良好的性能指标。整个项目打包完整,开箱即用,既可直接使用预训练模型,也支持重新训练自定义模型。系统兼容USB摄像头和笔记本内置摄像头,为用户提供了灵活的手势识别解决方案。

基于yolov11的手势检测识别系统是在pytorch框架下实现的,这是一个完整的项目,包括代码,数据集,训练好的模型权重,模型训练记录,GUI界面等。

GUI界面由pyside6设计实现,界面简洁明了,突出功能,并非那些花里胡哨的烂大街界面。

项目可外接USB摄像头或者直接使用笔记本摄像头。

该项目是可在pycharm和anaconda搭建的虚拟环境 或者 vscode和anaconda搭建的虚拟环境中 执行

pycharm和anaconda安装和配置可观看教程:

超详细的pycharm+anaconda搭建python虚拟环境_pycharm配置anaconda虚拟环境-CSDN博客

vscode和anaconda安装和配置可观看教程:

超详细的vscode+anaconda搭建python虚拟环境_vscode anaconda-CSDN博客

(二)项目介绍

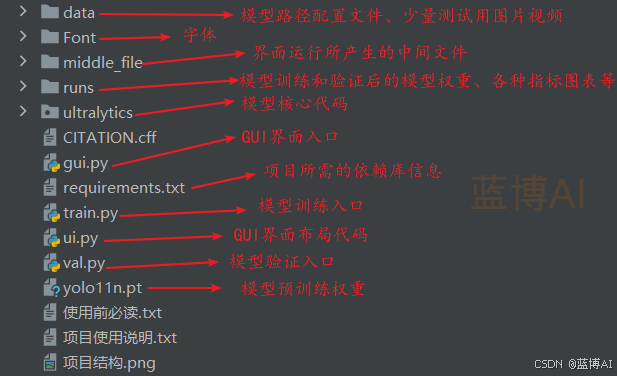

1. 项目结构

该项目可以使用已经训练好的模型权重,也可以自己重新训练,自己训练也比较简单:

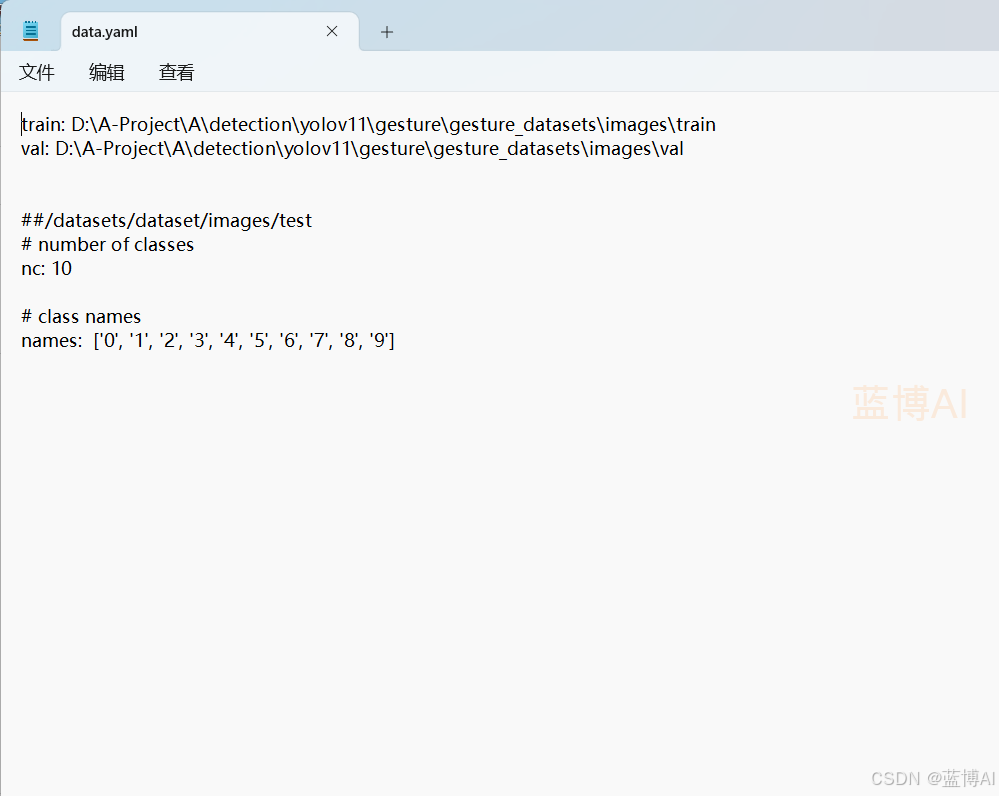

第一步:修改data/data.yaml中的训练集,验证集路径

第二步:模型训练,即运行train.py文件

第三步:模型验证,当模型训练完后,修改val.py中的模型权重路径,运行val.py文件

第四步:使用模型,即运行gui.py文件即可通过GUI界面来展示模型效果

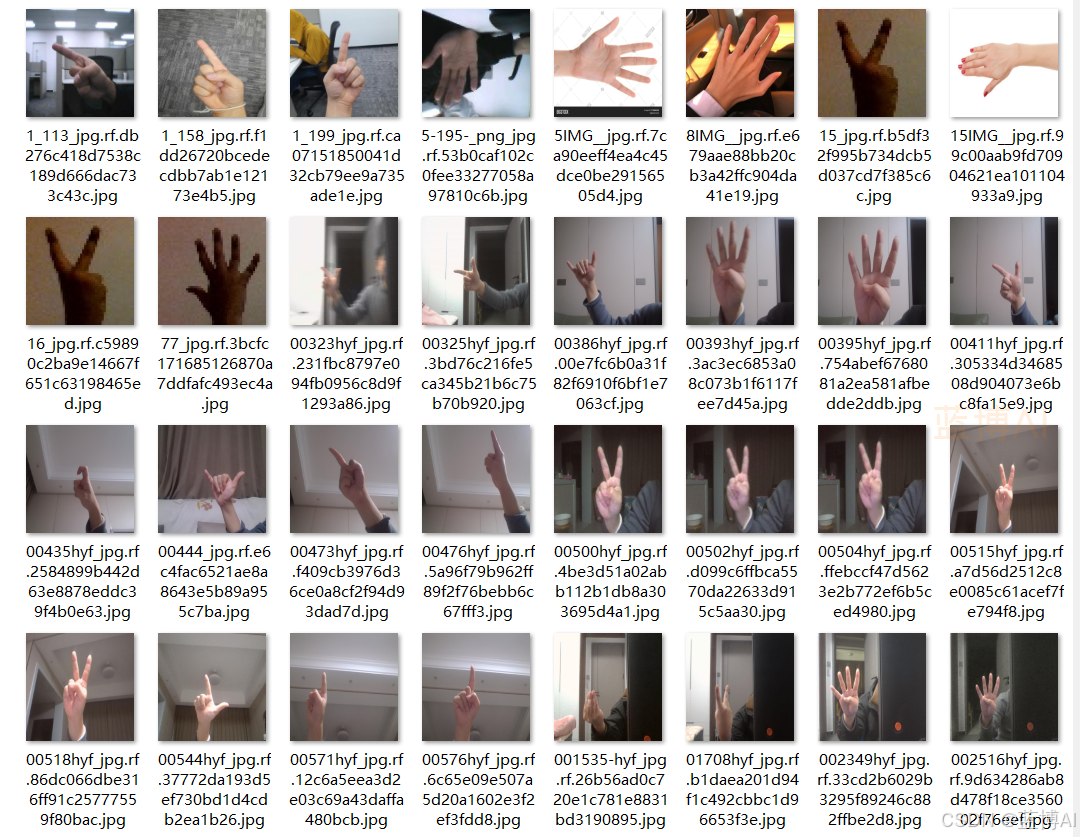

2. 数据集

部分数据展示:

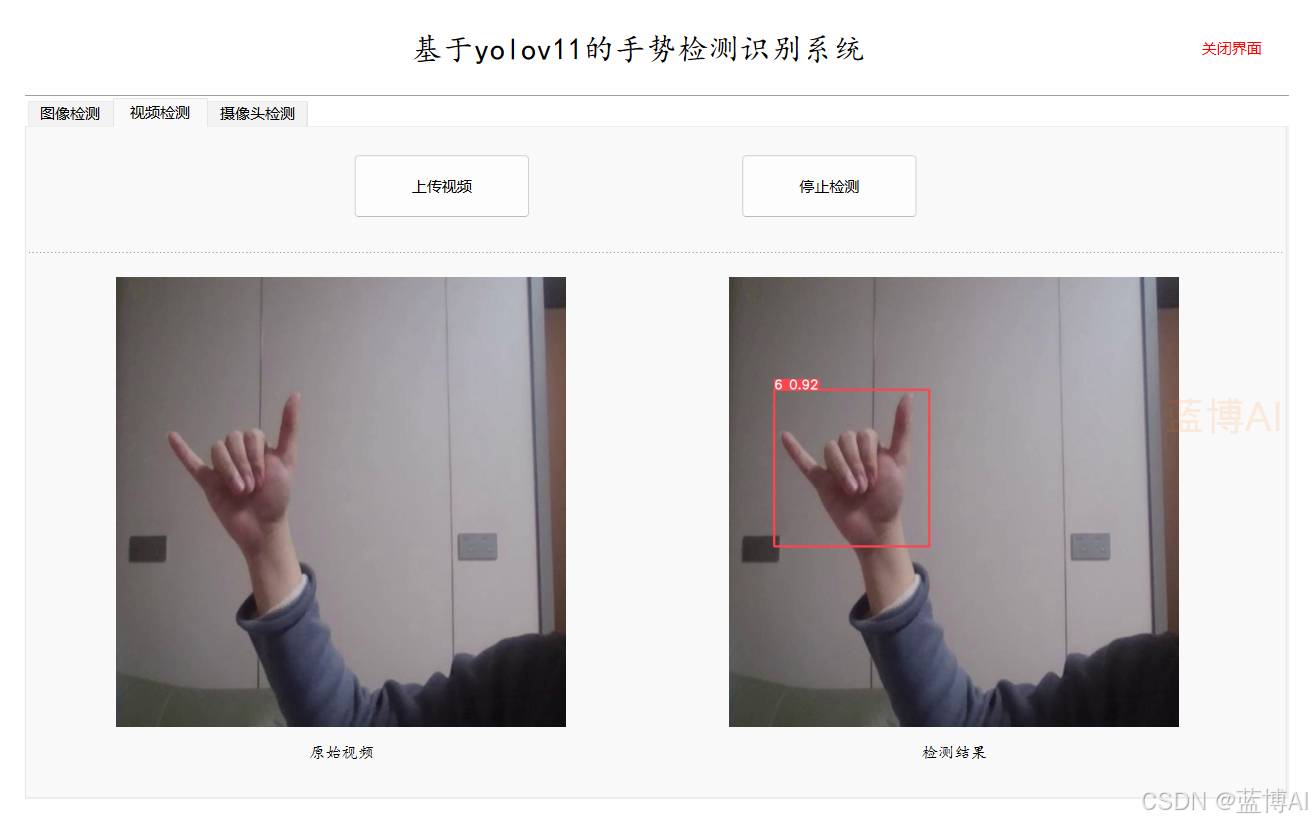

3.GUI界面(技术栈:pyside6+python+opencv)

a.GUI初始界面

b.图像检测界面

c.视频检测界面

d.摄像实时检测界面(可外接USB摄像头或直接用笔记本自带的摄像头)

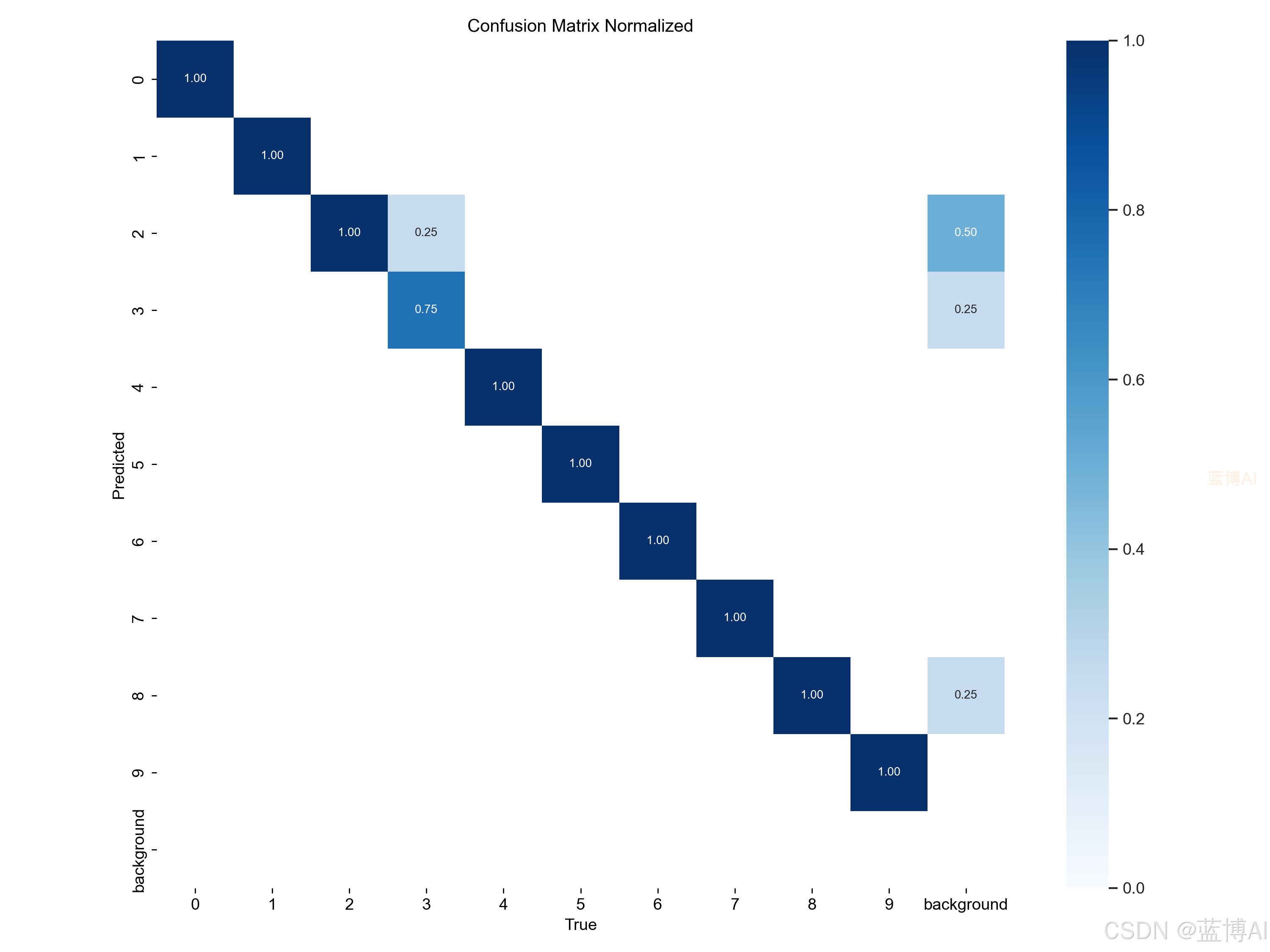

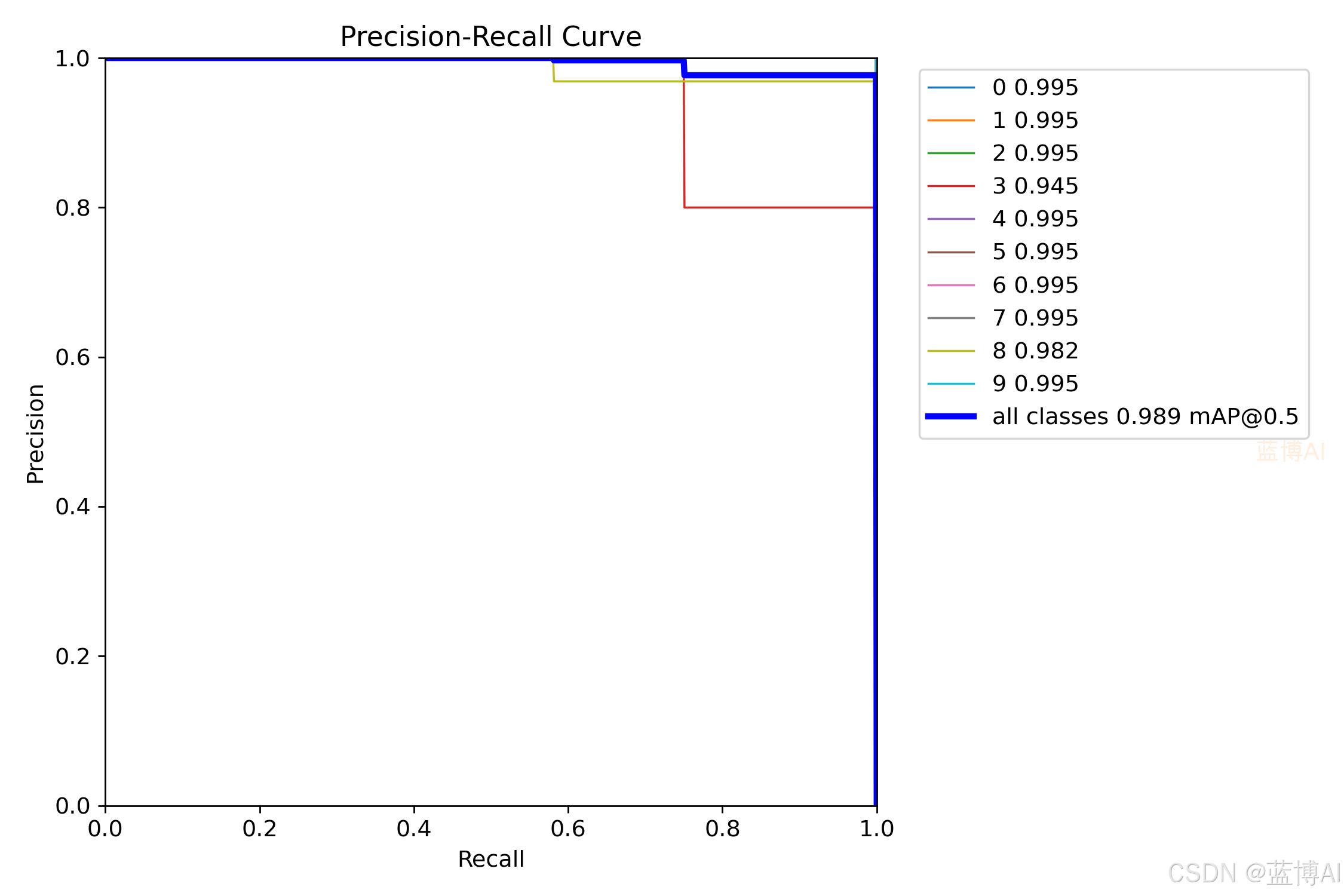

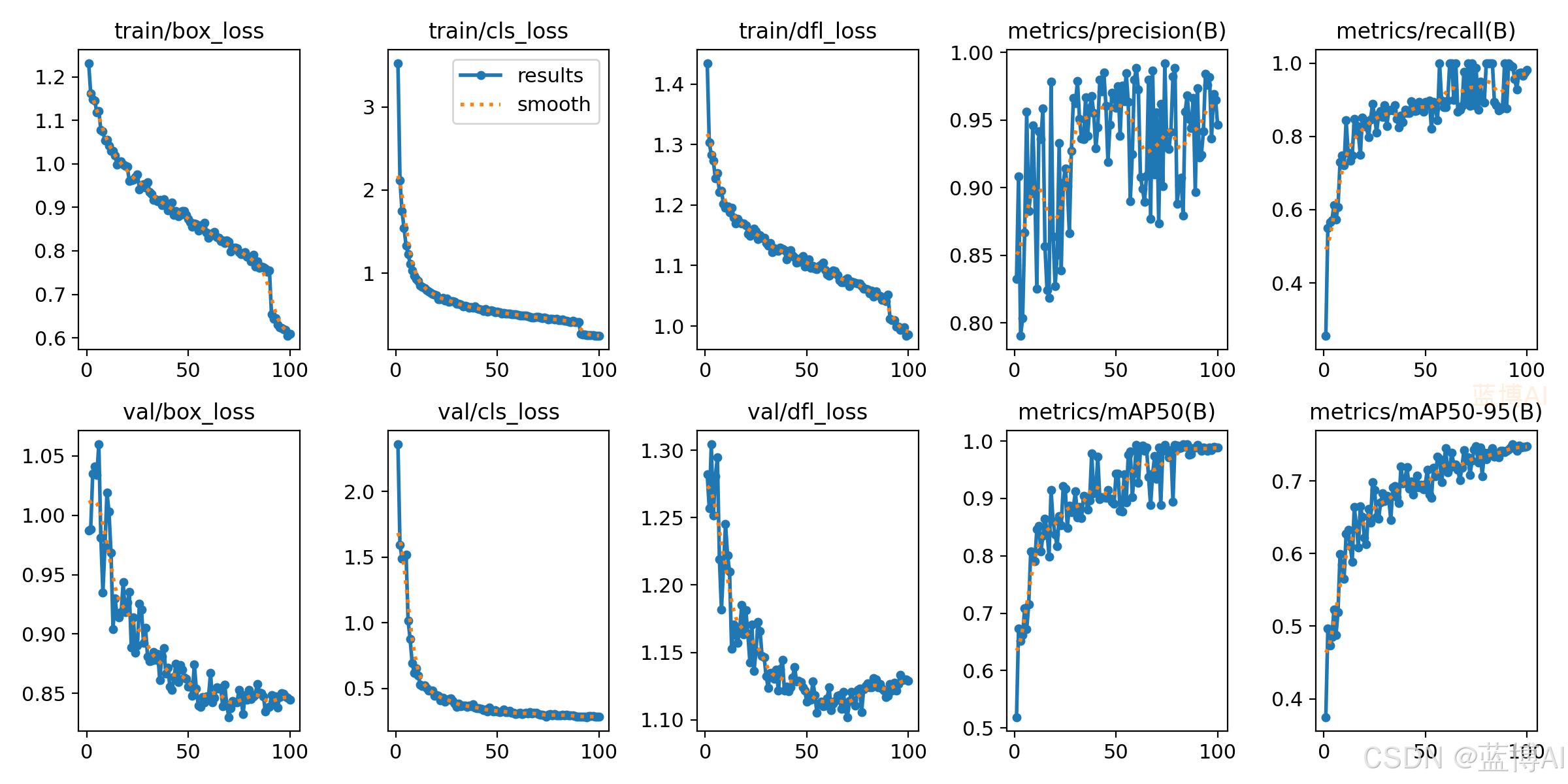

4.模型训练和验证的一些指标及效果

(三)总结

以上即为整个项目的介绍,整个项目主要包括以下内容:完整的程序代码文件、训练好的模型、数据集、GUI界面和各种模型指标图表等。

项目包含整套资料,一步到位,拿来就用,省心省力。

项目运行过程如果出现问题,请及时沟通!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献55条内容

已为社区贡献55条内容

所有评论(0)