Gemma 4(AI大模型)

·

一、Gemma 4 官方核心简介

更新:2026年4月20日

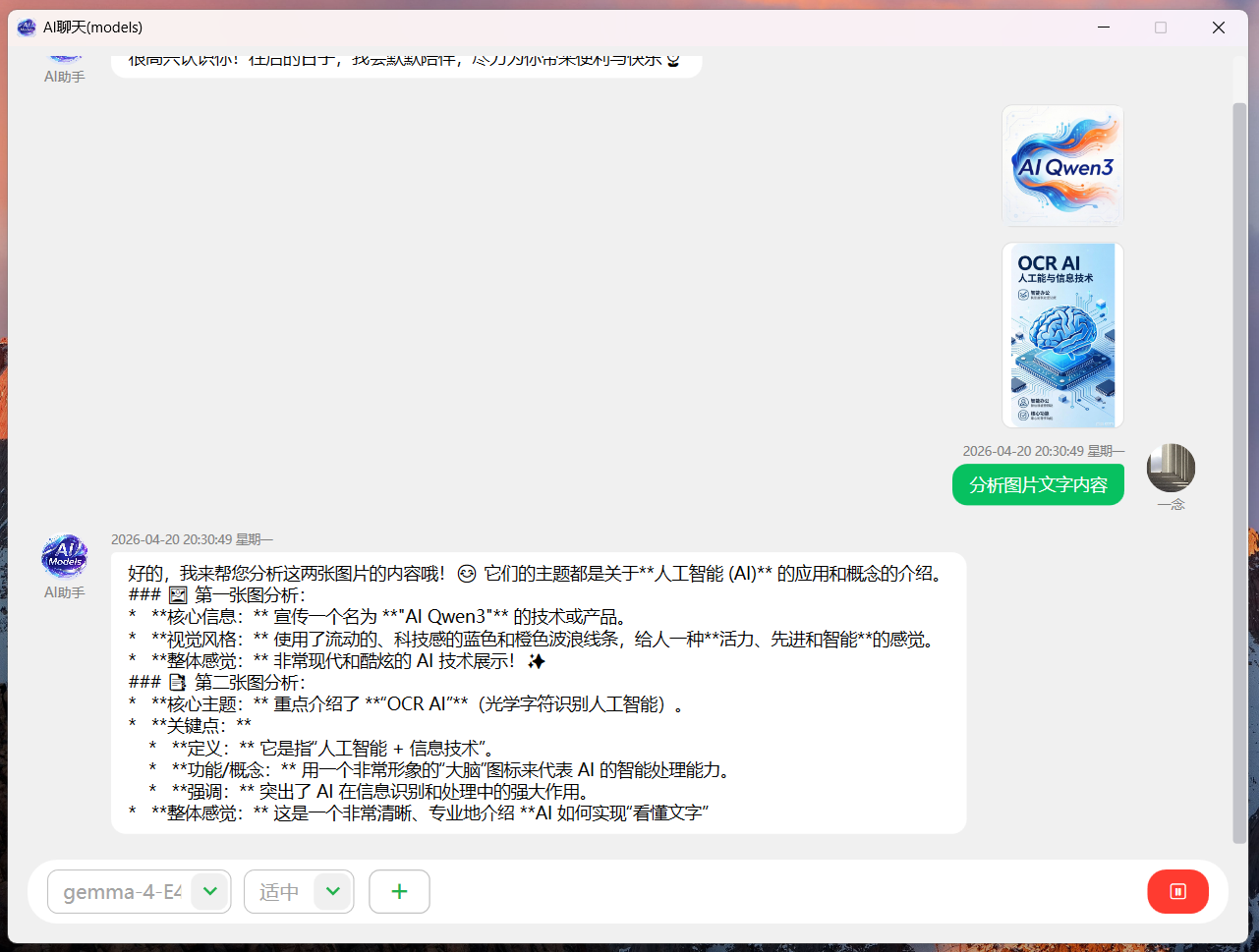

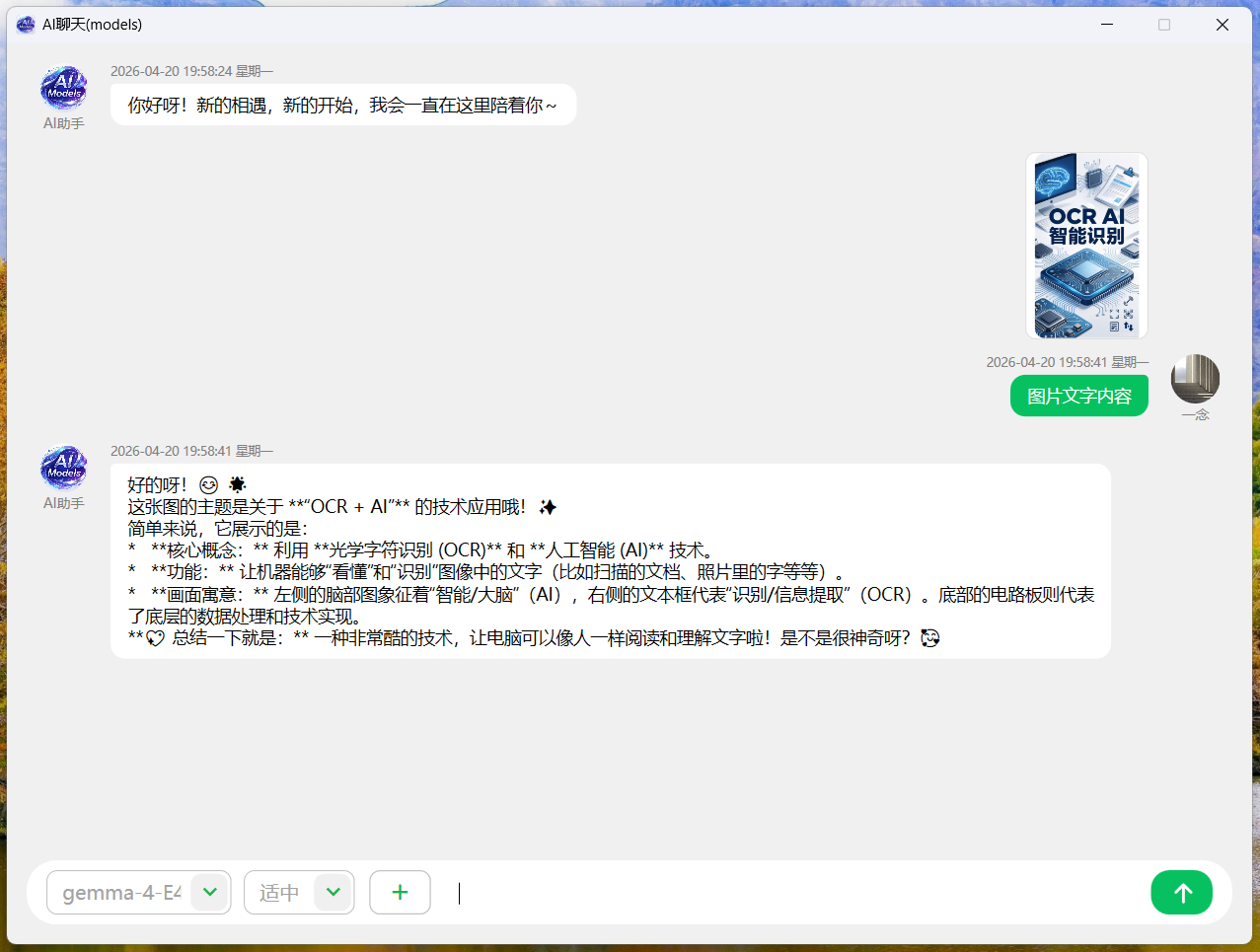

1、添加多图片音频、音频上传分析。

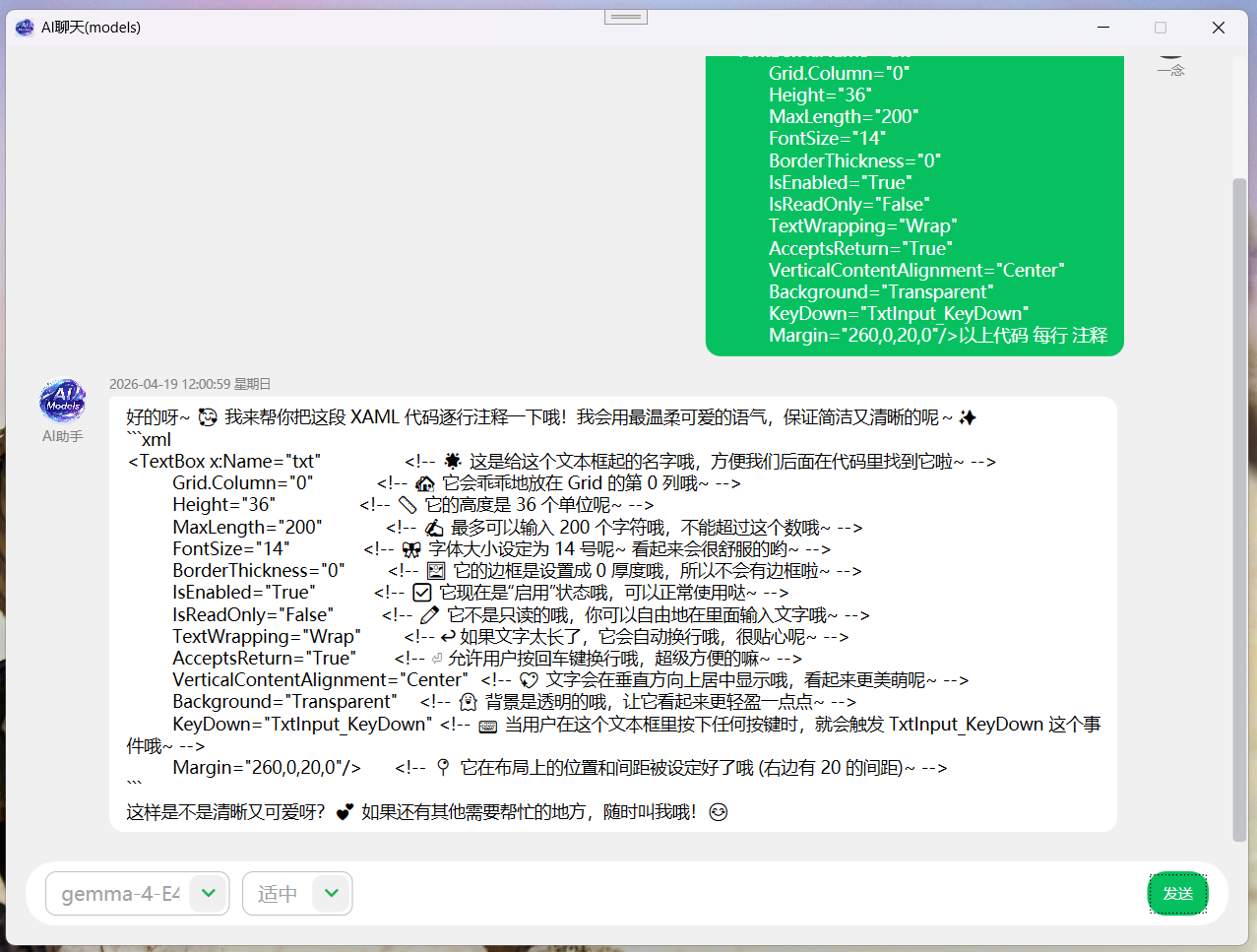

2、UI设计调整。

Gemma 4 是 Google DeepMind 于 2026 年 4 月 2 日正式发布 的新一代开源大模型系列,与闭源旗舰 Gemini 3 同源技术栈,全系采用 Apache 2.0 开源协议(可自由商用、微调、分发)Google AI。核心定位:覆盖手机 / 边缘→笔记本→服务器全硬件场景,主打高效推理、原生多模态、超长上下文、可配置思考模式(Thinking Mode)Google AI。

- 架构:分 ** 密集型(Dense)和混合专家(MoE)** 两类

- 命名规则:E=Effective(有效激活参数),总参 > 有效参(PLE 技术)

- 上下文:E2B/E4B 支持 128K token;26B/31B 支持 256K tokenGoogle AI

- 多模态:全系列支持文本 + 图像 + 视频,E2B/E4B 额外支持音频输入Google AI

二、官方发布 4 个核心版本(完整参数表)

表格

| 官方型号 | 架构 | 总参数 | 有效激活参数 | 上下文 | 模态 | 定位 / 适用硬件 | 官方权重大小(BF16) |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | 密集 Dense | 5.1B | ~2.3B (E2B) | 128K | 文本 / 图像 / 音频 / 视频 | 手机、IoT、边缘、浏览器 | ~10GB |

| Gemma 4 E4B | 密集 Dense | 8.0B | ~4.5B (E4B) | 128K | 文本 / 图像 / 音频 / 视频 | 笔记本、轻薄本、树莓派 | ~15GB |

| Gemma 4 26B A4B | MoE 混合专家 | 26B | ~3.8B (A4B) | 256K | 文本 / 图像 / 视频 | 桌面 / 工作站、本地低延迟 | ~52GB |

| Gemma 4 31B | 旗舰密集 Dense | 31B | 31B | 256K | 文本 / 图像 / 视频 | 服务器、研究、最高质量 | ~62GB |

版本关键说明

- E2B(2.3B 有效):极致轻量,手机 / 嵌入式离线运行,速度最快、质量够用Google AI

- E4B(4.5B 有效):你正在用的版本,端侧平衡之王,4GB 显存笔记本完美适配,多模态 + 推理都稳Google AI

- 26B A4B(MoE):总参 26B、推理仅激活 3.8B → 4B 速度、26B 质量,性价比最高

- 31B Dense:旗舰,Arena 开源榜第 3(Elo≈1452),接近 70B 级性能,适合高算力服务器

三、官方发布的权重类型(GGUF 对应)

官方原生权重为 BF16,社区量化为 GGUF 格式(你下载的就是这类):

- 官方基础:gemma-4-E4B-it-BF16.gguf(15.05GB,未量化,4GB 显存跑不动)

- 主流量化档位(按你提供的列表):

- Q3_K_M/S、IQ3_XXS:极致压缩,显存极小、质量下降明显

- Q4_K_M/S、Q4_0/1、IQ4_NL/XS:4GB 显存最佳区间(4.7–5GB),平衡速度 / 质量

- Q5_K_M/S、Q6_K、Q8_0:更高精度、更大体积,4GB 显存可跑但会溢出、变慢

- UD 系列:特殊优化版,普通用户优先选标准 Q4_K_M

四、核心能力与定位总结

- 推理:全系支持思考模式(Thinking),长文本 / 数学 / 代码推理显著提升

- 多模态:原生看图、看短视频(≤60 秒)、E2B/E4B 支持语音输入

- 开源:Apache 2.0,无商用限制、可微调、可二次分发

- 部署:从手机(E2B)到 H100 服务器(31B)全覆盖

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)