LLM Wiki:传统 RAG 的下一代方案?附 6 个可直接跑的 GitHub 实现

目录

二、LLM Wiki 落地:6 个可直接运行的 GitHub 项目

1. karpathy/gist:LLM Wiki 思想原型

2. nashsu/llm_wiki:极简干净的 LLM Wiki 原生实现

3. SamurAIGPT/llm-wiki-agent:带 Agent 自动化的 LLM Wiki

4. abubakarsiddik31/axiom-wiki:生产级模块化 LLM Wiki

5. skyllwt/OmegaWiki:支持多模型与插件化的增强型 LLM Wiki

6. Rootly-AI-Labs/rootly-graphify-importer:面向运维场景的 LLM Wiki

最近大模型圈有个概念越来越火:LLM Wiki。 很多人一听以为是“用大模型写维基百科”,其实完全不是。它是一套全新的知识管理范式,被很多人看作传统 RAG 的下一代方案。

今天就用最通俗的话讲明白:LLM Wiki 到底是什么,以及目前 GitHub 上有哪些已经能直接跑的落地项目。

一、什么是 LLM Wiki?一句话说透

LLM Wiki = 让大模型自动维护一个结构化、可迭代、互相关联的持久化知识库。

它最早由 Andrej Karpathy 明确提出,核心思路非常简单:

-

传统 RAG:每次提问都去翻原始文档,检索碎片文本,用完就忘;

-

LLM Wiki:先把文档“编译”成一套结构化 Wiki,LLM 自己维护、更新、链接,之后所有问答都基于这个 Wiki 来做。

你可以理解成:RAG 是临时翻书,LLM Wiki 是 AI 帮你整理了一本不断更新的内部百科。

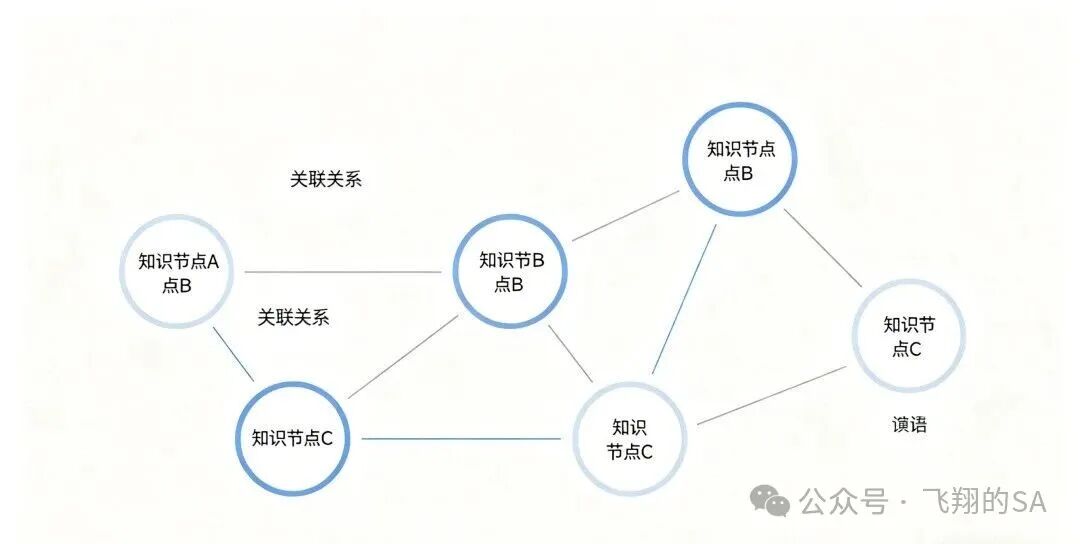

LLM Wiki 的三层经典结构

它比传统 RAG 强在哪?

-

知识可沉淀、可积累,不是每次都从零检索

-

实体关系清晰,复杂推理更强

-

节省 Token,不用反复读长文本

-

可人工审核、可版本控制,更可控、更少幻觉

二、LLM Wiki 落地:6 个可直接运行的 GitHub 项目

光有概念没用,能跑起来才是真落地。下面这几个仓库,基本代表了目前 LLM Wiki 的主流实现方向。

1. karpathy/gist:LLM Wiki 思想原型

地址:https://gist.github.com/karpathy/442a6bf555914893e9891c11519de94f

这是 LLM Wiki 的“思想源头”实现。 代码不长,但完整展示了核心流程:

-

读取原始文本

-

LLM 自动抽取实体、关系

-

构建结构化 Wiki 页面

-

支持增量更新、交叉引用

适合想理解底层逻辑的人看,是所有后续项目的理论蓝本。

2. nashsu/llm_wiki:极简干净的 LLM Wiki 原生实现

地址:https://github.com/nashsu/llm_wiki

这是一个高度贴合 Karpathy 原始思想、轻量干净的 LLM Wiki 实现,没有多余封装,代码结构清晰易懂,非常适合学习和二次开发。

亮点:

-

严格遵循 LLM Wiki 范式:原始文档 → 结构化 Wiki → 增量更新

-

轻量化、无冗余依赖,部署简单

-

自动生成互链接的 Wiki 条目,支持知识关联

-

适合快速搭建个人知识库、笔记系统

一句话总结:想要一个轻量、纯粹、好读懂的 LLM Wiki 原型,选它最合适。

3. SamurAIGPT/llm-wiki-agent:带 Agent 自动化的 LLM Wiki

地址:https://github.com/SamurAIGPT/llm-wiki-agent

这是目前最完整、最工程化的 LLM Wiki 实现之一,直接把理念做成了可用工具。

亮点:

-

多 Agent 协作:调研、写作、编辑分工

-

自动构建双向链接 Wiki,支持 Obsidian 风格

-

支持 PDF、文档批量导入

-

内置 Git 版本控制,防止 LLM 乱改

-

可本地部署,支持多种大模型

一句话总结:想直接搭一个属于自己的 AI 自动维护知识库,选它。

4. abubakarsiddik31/axiom-wiki:生产级模块化 LLM Wiki

地址:https://github.com/abubakarsiddik31/axiom-wiki

面向生产环境设计,架构清晰、模块化程度高,在基础 LLM Wiki 能力之上更强调稳定性与扩展性。

亮点:

-

模块化架构,易于集成与二次开发

-

支持多类型文档导入与自动结构化解析

-

内置检索与问答接口,可直接对接外部系统

-

兼顾轻量化与可靠性,适合个人与小团队部署

一句话总结:想找一个能稳定跑在线上、架构规范的 LLM Wiki 服务,这个项目很合适。

5. skyllwt/OmegaWiki:支持多模型与插件化的增强型 LLM Wiki

地址:https://github.com/skyllwt/OmegaWiki

这是一个功能更全面、扩展性更强的 LLM Wiki 实现,在基础维基能力上增加了多模型适配与插件生态,适合追求灵活度的用户。

亮点:

-

支持多种大模型无缝切换,不绑定单一厂商

-

插件化架构,可按需扩展检索、解析、可视化能力

-

支持文档批量处理、知识自动关联与更新

-

界面友好,便于本地部署与日常使用

一句话总结:想要功能更全、支持多模型、可插件扩展的 LLM Wiki,直接冲这个。

6. Rootly-AI-Labs/rootly-graphify-importer:面向运维场景的 LLM Wiki

地址:https://github.com/Rootly-AI-Labs/rootly-graphify-importer

这是把 LLM Wiki 用到故障运维的典型落地。 它不做通用知识库,而是聚焦:

-

从运维平台拉取故障、告警、服务数据

-

自动构建知识图谱 + 结构化 Wiki

-

可视化服务依赖、故障关联、团队责任

-

输出可交互图谱与分析报告

适合 SRE、运维团队,用来做故障复盘与知识沉淀。

三、LLM Wiki 适合谁用?

-

想搭建个人学术/技术知识库的开发者

-

需要沉淀业务经验、避免重复踩坑的团队

-

运维、安全、研发等故障与经验密集型团队

-

嫌弃传统 RAG 太慢、太碎、幻觉太多的人

四、总结

LLM Wiki 不是一个花哨的概念,它是大模型知识管理从“临时检索”走向“长期记忆”的关键一步。

从 Karpathy 的理论原型,到轻量纯净版、自动化 Agent 版、插件扩展版,再到垂直场景与企业级框架,LLM Wiki 已经从想法变成了可直接落地的工程方案。 如果你还在堆各种 RAG 优化技巧,不妨试试 LLM Wiki 思路,可能会打开新世界。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)