【类增量学习之2024CVPR】EASE 的“分空间记忆术:给每个任务一间小房间

零、学习树

1. Class-Incremental Learning(CIL,类增量学习)

一种持续学习设定。模型按阶段依次接触新的类别,每个阶段只能看到当前新类别的数据,但最终需要在所有已经见过的类别上统一分类。它的核心难点是灾难性遗忘。

2. Pre-Trained Models(PTMs,预训练模型)

- 先在大规模数据集上预先训练好的模型,已经具备较强的通用表征能力。论文里通常指已经训练好的视觉 Transformer 一类骨干网络。

- 它们能为增量学习提供更稳健的初始特征。

3. ExpAndable Subspace Ensemble(EASE,可扩展子空间集成)

本文提出的方法名。

它的核心思想有三层:

- 给每个新任务分配一个独立的轻量模块;

- 让不同任务在不同子空间中学习,减少相互覆盖;

- 最终把多个子空间的信息集成起来做统一预测。

4. adapter module(适配器模块)

- 一种插入到预训练模型中的轻量级可训练模块。

- 主干网络大部分参数保持冻结,只训练这些小模块来适应新任务。

- 这样既能保留原有知识,又比整体微调更省参数、更稳定。

5. task-specific subspaces(任务特定子空间)

- 这里的“子空间”可以理解为:模型为某个任务学到的一块相对独立的特征表示区域。

- “任务特定”意味着每个任务都有自己偏重的特征表达方式,从而减少新任务直接改坏旧任务表示的风险。

6. feature space(特征空间)

- 模型把输入样本映射后的表示空间。

- 样本在这个空间中的位置、方向、距离,会反映它们的语义相似性。分类器通常就是在这个空间里进行区分。

7. classifier(分类器)

- 把特征映射到具体类别预测的模块。

- 文中强调的问题是:当特征空间不断扩展时,旧分类器可能不再适配新的空间结构。

8. semantic-guided prototype complement strategy(语义引导的原型补全策略)

- 这是 EASE 的一个关键机制。

- 由于旧类样本不能保存,作者无法直接重新计算旧类在新子空间中的表示,于是利用类别之间的语义关系/相似性来“补出”旧类别在新空间中的原型表示。

9. prototype(原型)

- 某一类别在特征空间中的代表性向量,通常可理解为该类样本特征的中心或典型表示。

- 原型分类器会比较测试样本与各类别原型的相似度来做分类。

10. benchmark datasets(基准数据集)

- 用于公平评测方法性能的一组标准数据集。

- 论文用七个基准数据集实验,说明它不是只在单一场景有效,而是具有较好的泛化性。

11. state-of-the-art(SOTA,当前最先进水平)

- 表示在给定任务或评测基准上,方法达到当时最好的性能水平。

- 论文这里是在宣称 EASE 的实验结果优于已有代表性方法。

12. catastrophic forgetting(灾难性遗忘)

- 指模型在学习新任务或新类别后,原来已经学会的旧知识被迅速破坏或覆盖的现象。

- 这是持续学习里最核心的问题之一。这里强调的是:新类训练会直接损伤旧类表征

13. prompt

- Prompt 在视觉 Transformer 场景里通常指一组额外引入的可学习向量,它们会和原始输入 token 一起进入模型,从而影响注意力计算过程。

- 它的作用类似于:不改主干结构,只通过少量附加参数来引导模型适应新任务。

14. prompt pool(prompt 池)

- 一个存放多个可学习 prompt 的集合。

- 模型面对不同输入时,会从中选择最合适的 prompt 来参与当前样本的表示学习。

- 问题在于:多个任务往往共享同一个 prompt 池,因此新任务更新 prompt 时,可能会破坏旧任务原本依赖的 prompt。

15. instance-specific prompts(样本级 prompt)

- 指不是对所有样本统一使用同一组 prompt,而是根据当前输入样本的特征,动态选择或生成更适合该样本的 prompt。

- 它提高了适应性,但也让 prompt 参数更频繁地被重写。

16. stability-plasticity dilemma(稳定性—可塑性困境)

持续学习中的经典矛盾:

- 稳定性(stability):模型要尽量保留旧知识;

- 可塑性(plasticity):模型要有能力吸收新知识。

二者往往相互拉扯,太稳定就学不会新东西,太可塑就容易忘旧东西。

17. expandable networks(可扩展网络)

- 一类持续学习方法。

- 它的基本思想是:每来一个新任务,就新增一个独立网络分支或 backbone,而不是在原网络上反复覆盖更新。

- 优点是能减少任务间直接冲突;

- 缺点是模型会越来越大,而且往往依赖旧样本辅助统一分类。

17. backbone(骨干网络)

- 模型中负责提取主要特征表示的核心主体部分。

- 在这篇论文的语境里,通常指预训练好的主干编码器,例如 ViT。

- 很多方法选择冻结 backbone,只训练很少量附加参数。

18. exemplar(样本记忆 / 回放样本)

- 指从旧类别中保存下来的一小部分真实训练样本,用于后续阶段回放训练或校准分类器。

- 很多传统 CIL 方法依赖 exemplar 来缓解遗忘,但本文强调的是 exemplar-free 场景,即不保存旧样本。

19. semantic guidance(语义引导)

- 指利用类别之间的语义关系、相似性或结构信息来辅助学习或补全表示。

- 本文里具体是:借助类间关系去推断旧类别在新子空间中的分类器/原型表示。

20. co-occurrence space(共现空间)

- 这里指一个“旧类和新类都能同时被表示、可用于比较二者关系”的特征空间。

- 作者在这个空间里计算类间相似性,再把这种相似性迁移到新子空间中,用来合成旧类表示。

21. dimensional mismatch(维度不匹配)

- 指旧阶段的分类器是基于旧特征维度建立的,而随着新子空间不断加入,整体特征维度变大,旧分类器就无法直接对应新的特征表示。

- 这是本文提出“补全旧类分类器”的直接原因之一。

22. inference(推理阶段)

- 指模型训练完成后,对测试样本进行预测的阶段。

- 本文强调在 inference 时还会根据特征与原型的匹配关系进行重新加权,而不是直接使用未经调整的输出。

23. ensemble(集成)

- 指将多个模型、多个子空间或多个预测结果综合起来做最终判断。

- 本文中的 ensemble 不是简单平均,而是结合不同子空间的特征、原型以及它们之间的对齐关系来进行更稳健的决策。

24. feature–prototype compatibility(特征—原型兼容性)

- 指某个输入样本的特征表示与某个类别原型之间的匹配程度。

- 匹配越高,说明该样本越可能属于该类别。

- 本文在推理阶段利用这种兼容性对预测进行重加权。

25. data rehearsal-based methods(基于数据回放的方法)

- 这类方法会保存一小部分旧类别样本,在后续学习新任务时把这些旧样本重新拿出来训练。

- 核心思想是:旧类之所以会忘,是因为训练时再也看不到它们;那就把它们再放回来。

26. knowledge distillation(知识蒸馏)

- 一种让新模型模仿旧模型输出的方法。

- 在增量学习中,它通常不是为了压缩模型,而是为了让当前模型在学习新任务时,仍尽量保持和旧模型一致的 logits 或特征表示。

27. logits

- 指分类器输出、经过 softmax 之前的原始分数。

- 在蒸馏方法中,旧模型的 logits 往往被当作“软目标”,帮助新模型继承旧知识。

28. parameter regularization-based methods(基于参数正则化的方法)

- 这类方法认为,并不是所有参数都同等重要,因此在学习新任务时,会重点限制那些对旧任务很重要的参数发生过大变化。

- 本质上是在参数层面保护旧知识。

29. model rectification-based methods(基于模型校正的方法)

- 这类方法主要关注增量学习中的预测偏差问题。

- 模型在持续学习后,往往容易偏向新类或某一部分数据分布,因此需要对分类器或预测结果进行校正。

30. inductive bias(归纳偏置)

- 指模型在学习过程中天然偏好的模式或假设。

- 在增量学习里,模型可能因为训练数据顺序、类别不平衡等原因,对某些类别产生系统性偏向。

31. expandable networks(可扩展网络)

- 指每来一个新任务,就新增一个独立网络分支或 backbone 的方法。

- 它通过“为不同任务分开建表示空间”来减少新旧任务直接冲突,因此对遗忘问题比较有效。

32. feature map / large feature map(大特征表示)

- 这里不是卷积网络中特指的二维特征图,而更广义地表示:

- 把多个 backbone 的输出拼接后形成的更高维特征表示。

- 作者想表达的是:拼接后的整体特征空间更大,包含了多个任务的特征信息。

33. calibrate among all classes(在所有类别之间进行校准)

- 意思是让分类器在旧类和新类之间保持合理的决策边界,而不是只偏向最近学到的新类。

- 这是增量学习里统一分类器必须解决的问题。

34. prompt pool(提示池)

- 一个由多个可学习 prompt 组成的集合。

- 模型会根据输入,从中选择合适的 prompt 来辅助当前样本的表示学习。

35. instance-specific prompt(样本特定 prompt)

- 针对不同输入样本动态选择或生成的 prompt。

- 它不是“一个任务一个固定 prompt”,而是更细粒度地“一个样本用更适合自己的 prompt”。

36. DAP

- 论文里提到的一种 PTM-based CIL 方法。

- 它在普通 prompt selection 的基础上更进一步,通过 prompt generation module 提升 prompt 的适应性。

37. prompt generation module(提示生成模块)

- 一个根据输入或任务信息生成 prompt 的模块。

- 和从固定 prompt 池中检索 prompt 相比,它更强调动态生成能力。

38. LAE

- 一种不完全依赖 prompt tuning 的 PTM-based CIL 方法。

- 它通过 EMA-based model updating 和 online/offline model 协同来维持学习的稳定性。

37. EMA(Exponential Moving Average,指数滑动平均)

- 一种常见的参数平滑策略。

- 在模型训练中,EMA 会用历史参数的平滑平均来构造一个更稳定的模型副本,常用于提升训练稳定性或蒸馏效果。

38. online model / offline model

- online model:直接参与当前训练更新的模型

- offline model:通常更稳定、更新更慢,用来提供参照或约束

在增量学习里,这种双模型结构有助于平衡新知识学习与旧知识保持。

39. SLCA

- 一种通过对旧类别分布建模来校正分类器的 PTM-based CIL 方法。

- 它说明在增量学习中,除了“怎么学特征”,还要考虑“怎么修分类器”。

40. Gaussian modeling(高斯建模)

- 用高斯分布去描述某一类别在特征空间中的分布。

- 如果能较好估计旧类分布,就能在没有旧数据的情况下帮助分类器维持旧类决策边界。

41. ADAM

- 这里指论文中的一个 CIL 方法名,不是优化器 Adam。

- 它的重要结论是:原型分类器在 PTM-based CIL 中是一个非常强的 baseline。

42. prototypical classifier(原型分类器)

- 一种基于类别原型进行分类的方法。

- 每个类别对应一个代表向量,测试样本通过与各类别原型比较相似度来完成分类。

- 这类分类器通常比普通线性分类头更适合增量学习场景。

43. RanPAC

- 一种探索 random projection 在 PTM-based CIL 中应用的方法。

- 它代表了另一条思路:通过对特征进行随机映射,改善增量学习中的分类效果或稳定性。

44. random projection(随机投影)

一种把高维特征映射到另一个空间的简单方法,映射矩阵通常随机生成。

它常被用于降维、特征变换或提高分类鲁棒性。

45. label space(标签空间)

- 某个任务中允许出现的类别集合。

- 例如一个任务只包含“猫、狗、鸟”三类,那么它的标签空间就是这三个类别的集合。

46. linear classifier(线性分类器)

一种最简单的分类器形式,通过一个线性变换把特征映射到类别分数。

这里的 W 就是线性分类器参数。

47. [CLS] token

- Transformer 结构中的特殊标记。

- 在 ViT 中,它通常被用作整张图像的全局表示;

- 因此很多方法直接把最后一层的 [CLS] token 当作图像特征。

48. cross-entropy loss(交叉熵损失)

- 分类任务中最常见的损失函数,用来衡量模型预测分布与真实标签之间的差异。

- 值越小,表示预测越接近真实标签。

- 值越大,则反之

49. image patch embedding(图像块嵌入)

- ViT 中先把图像切成若干 patch,再把每个 patch 映射成向量表示,这个向量就叫 patch embedding。

- Prompt 需要和它同维度,才能一起送入 Transformer。

50. embedding function aggregation(嵌入函数聚合)

- 指把多个特征提取函数的输出组合起来使用。

- 这里具体就是把旧 backbone 和新 backbone 的特征拼接起来,形成更丰富的表示。

51. low-cost subspace expansion(低成本子空间扩展)

- 这是这一节最后引出的核心概念。

- 它指的是:不扩整个大模型,只用更轻量的方式为不同任务构造相对独立的表示子空间。

- 这正是 EASE 后面要做的事。

52. adapter tuning

- 指不是微调整个预训练模型,而是只训练插入模型中的 adapter 模块。

- 它的目的就是:以很小的参数代价实现任务适应。

53. transformer block

Transformer 的基本组成单元,通常包含:

- self-attention

- MLP

- 归一化和残差连接

在 ViT 里,整个模型就是由多个 transformer block 堆叠而成。

54. MLP layer

多层感知机层,在 Transformer block 中通常位于 self-attention 之后,用于对 token 表示做进一步非线性变换。

55. bottleneck module

- 瓶颈模块。

- 意思是先把高维特征压到一个更低维空间,再映射回原维度。这样可以显著减少参数量。adapter 就是这种结构。

56. down-projection / up-projection

- down-projection:把特征从高维压到低维

- up-projection:再从低维映射回高维

这两个步骤构成了 adapter 的核心计算路径

一、摘要

1. 研究背景

这篇文章研究的是预训练模型(PTM)场景下的类增量学习(CIL)。

类增量学习要求模型在训练过程中不断接触新的类别,并且在学习新类别的同时,仍然保留对旧类别的识别能力。也就是说,模型必须同时具备:

- 持续吸收新知识的能力

- 稳定保留旧知识的能力

这正是类增量学习最核心的要求。

2. 核心问题

尽管预训练模型在类增量学习中已经表现出较强能力,但文章指出,一个关键矛盾仍然没有解决:

2.1 学新类会覆盖旧类

当模型学习新类别时,原有旧类别的知识往往会被覆盖,产生遗忘现象。

2.2 稳定性与可塑性的冲突

作者把问题进一步具体化为一个平衡难题:

- 如果对网络改动太大:模型容易遗忘旧知识

- 如果对网络改动太小:模型又无法很好适应新类别

所以真正困难的不只是“更新模型”,而是:

如何在不破坏旧知识的前提下,高效地完成模型更新。

3. 论文的核心思路

针对上述问题,作者提出了一个新方法:

EASE(ExpAndable Subspace Ensemble,可扩展子空间集成)。

它的总体思想可以概括为一句话:

不要让所有任务都去竞争同一块可训练空间,而是给每个新任务分配一个独立的轻量子空间,再把这些子空间集成起来进行统一决策。

4. 方法设计的层次拆解

4.1 为每个新任务分配独立的轻量 adapter

作者不是直接修改整个预训练模型,而是为每个新任务训练一个独立的轻量级 adapter 模块。

这样做有两个直接目的:

- 降低参数更新成本

- 避免新任务直接重写旧任务已经学到的表示

也就是说,旧任务和新任务不再完全共享同一套增量参数,而是各自拥有相对独立的适配模块。

4.2 构建任务特定子空间

每个 adapter 对应一个任务特定子空间。

这意味着:

- 旧任务在旧的子空间中表达

- 新任务在新的子空间中表达

这种设计的本质,是把原本会在同一个参数空间里发生的冲突,分散到不同的子空间中去,从而减少跨任务干扰。

4.3 将多个子空间联合起来做决策

作者并不是让这些子空间彼此独立、各管各的,而是让多个 adapter 共同张成一个更高维的特征空间。

这意味着模型最终分类时,不只是看单一子空间,而是:

- 综合多个任务子空间中的信息

- 在更丰富的表示基础上做联合决策

因此,EASE 的优势不只是“隔离冲突”,还包括“整合多阶段知识”。

5. 方法面临的新问题

文章进一步指出:

当子空间不断扩展后,会产生一个新的困难——

5.1 旧分类器与新空间不兼容

随着新任务加入,整体特征空间发生扩展,原来旧类别对应的分类器可能无法适配新的空间结构。

换句话说:

- 虽然旧任务的 adapter 还在

- 但整个决策空间已经变了

- 原来的旧类表示不再能自然适配新的阶段

所以,模型还必须解决“旧类别如何在新空间中继续被正确表示和分类”的问题。

6. 关键补充机制:语义引导的原型补全

为了解决上面的问题,作者提出了第二个关键设计:

6.1 semantic-guided prototype complement

即语义引导的原型补全策略。

它的作用是:

- 不保存任何旧类别样本

- 不回放旧数据

- 通过类别之间的语义关系

- 为旧类别在新阶段空间中“补出”新的特征表示

6.2 它解决了什么

这个机制本质上解决的是:

旧类没有旧样本参与训练时,如何在不断扩展的新特征空间里继续保有可分类表示。

这也是 EASE 能在 exemplar-free 条件下成立的关键。

7. 整体方法链条

把摘要里的方法逻辑串起来,可以得到一个非常清楚的链条:

第一步:发现问题

PTM 做 CIL 时,学习新类仍会遗忘旧类。

第二步:避免直接冲突

给每个新任务分配独立的轻量 adapter,构建任务特定子空间。

第三步:保留整体判别能力

把多个子空间联合起来,形成高维特征表示,支持统一决策。

第四步:解决旧类在新空间中的缺失

利用语义引导的原型补全策略,在没有旧样本的情况下为旧类补充新空间表示。

第五步:完成最终目标

实现一种高效更新、低冲突、无需旧样本保存的类增量学习方法。

8. 实验结论

摘要最后给出的结论是:

- 作者在 7 个基准数据集 上进行了大量实验

- 结果表明 EASE 达到了 state-of-the-art(当前最先进)性能。

这说明该方法不仅有设计上的合理性,而且在实验上也被验证是有效的。

9.一句话总结

本文聚焦于预训练模型类增量学习中的遗忘问题。作者指出,过度更新网络会破坏旧知识,而更新不足又难以适应新类,核心挑战在于如何实现高效且低冲突的模型更新。为此,论文提出 EASE,通过为每个新任务分配独立的轻量 adapter 来构建任务特定子空间,并将多个子空间集成为高维特征空间进行联合决策。针对子空间扩展后旧类分类器与新空间不兼容的问题,作者进一步提出语义引导的原型补全策略,在不保存旧样本的前提下为旧类合成新空间表示。最终,EASE 在七个基准数据集上取得了领先性能。

二、介绍

1. 研究背景

这段首先说明了研究的大背景:

随着深度学习的发展,深度神经网络已经在现实应用中取得了很强的表现;但真实世界中的数据往往不是一次性全部给出,而是以流式、持续到来的方式出现。于是,模型就需要具备一种能力:不断学习新类别,同时保留旧类别知识,这就是类增量学习(CIL)要解决的问题。

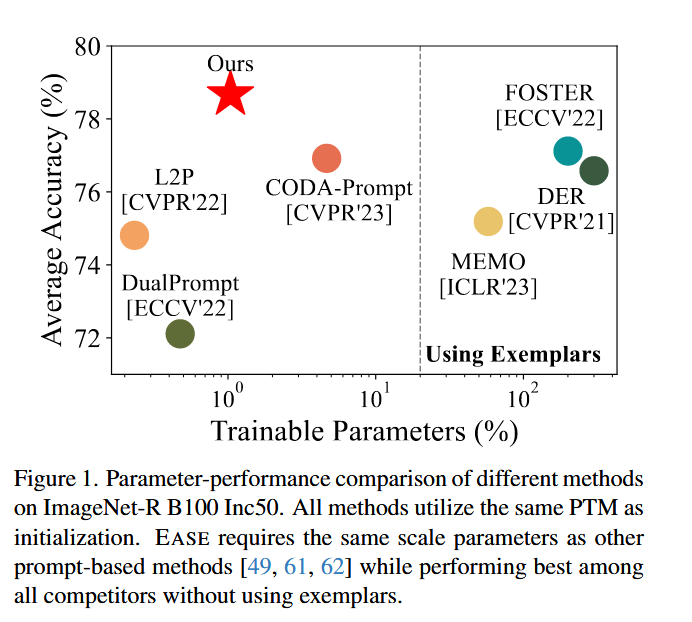

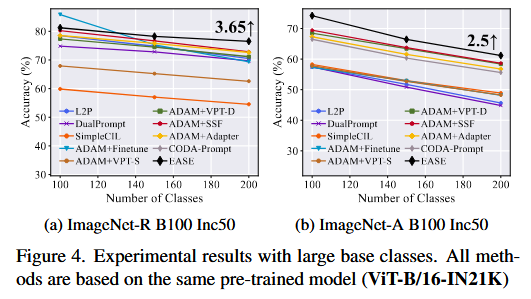

这张图说明:EASE 在几乎不增加训练参数、且不保存旧样本的条件下,取得了所有对比方法中最好的平均准确率,因此它在参数效率和增量性能之间实现了最佳权衡。

虚线作为分割使用不使用旧样本的分割线

2. 核心问题

这一段明确指出,CIL 的核心困难是灾难性遗忘:

- 模型学习新类别时,容易覆盖旧类别知识;

- 学新知识和保留旧知识之间天然存在冲突。

作者进一步把这个问题概括为稳定性—可塑性困境:

- 稳定性:模型不能轻易忘掉旧知识;

- 可塑性:模型又必须有能力适应新知识。

如果模型更新太多,会伤害旧知识;如果更新太少,又学不好新类别。也就是说,真正的问题不是“要不要更新”,而是:

怎样在不破坏旧知识的前提下完成有效更新。

3. 现有方法的发展脉络

这一段其实回顾了两条主要技术路线。

3.1 基于预训练模型的 CIL 路线

随着预训练技术的发展,研究者开始把 PTM 引入 CIL。

因为 PTM 在大规模数据上训练过,天然具有较强的泛化能力,所以用它做增量学习通常比从头学更强。

目前这类方法通常采取的策略是:

- 冻结预训练 backbone;

- 只增加极少量新参数;

- 常见做法是加 prompt 来适应增量任务。

这样做的优点是:

- 保住 PTM 的通用能力;

- 参数开销小;

- 适合增量学习场景。

3.2 这条路线的不足

虽然冻结主干网络能减少遗忘,但 prompt 方法仍然存在问题:

为了适应新任务,模型需要从 prompt pool 中选择并优化样本级 prompt,而这个过程会重写旧任务原本依赖的 prompt,从而引发新旧任务之间的冲突,最终还是会遗忘。

所以作者的判断是:

prompt learning 虽然轻量,但没有真正解决跨任务冲突。

4. 另一类启发:可扩展网络

接着,作者引入另一类方法作为启发,即 expandable networks。

这类方法的思路是:

- 每来一个新任务,就新建一个独立 backbone;

- 不去修改旧 backbone;

- 最后把多个 backbone 的特征拼接起来,再做统一分类。

它的优点很明显:

4.1 能减少跨任务冲突

因为新任务用新 backbone 学,旧任务 backbone 不动,所以新任务训练不会直接破坏旧任务表示。

4.2 能形成更全面的高维表示

多个 backbone 的特征拼接后,模型能在一个更大的高维空间中综合利用不同任务的特征。

但它也有两个明显缺点:

- 要存很多 backbone,资源开销高

- 要依赖 exemplars 来训练统一分类器

5. 作者提出的核心追问

在比较了这两条路线后,作者提出了本文真正想解决的问题:

- prompt learning:便宜、无需 exemplars,但会遗忘旧 prompt;

- expandable networks:能隔离冲突,但太贵,还依赖 exemplars。

于是作者进一步追问:

能不能在不依赖 exemplars 的前提下,以低成本构建任务特定子空间,从而解决跨任务冲突?

这就是整篇论文的方法动机。

6. 为实现这个目标,作者识别出两个关键挑战

6.1 挑战一:如何低成本构建任务特定子空间

由于 PTM 很大,如果像 expandable networks 那样每个任务都存一整个 backbone,代价太高。

所以作者认为,必须找到一种方法,用轻量模块而不是完整 backbone 来承载任务特定表示。

6.2 挑战二:如何让不断扩展的特征空间仍能统一分类

如果特征空间随着任务不断扩展,那么旧阶段的分类器往往无法直接适配新的高维特征。

同时,由于没有旧 exemplar,模型又无法直接重新训练旧类分类器。

因此,作者认为必须利用类别之间的语义关系,去合成旧类别在新空间中的分类器。

7. 作者提出的解决方案:EASE

针对上述问题,作者提出了 EASE。这一段中,EASE 的设计可以拆成三层。

7.1 用轻量 adapter 为每个任务建立独立子空间

作者不再为每个任务扩整个 backbone,而是在冻结 PTM 的基础上,为每个新任务增加一个轻量 adapter。

这样可以以极低的训练与存储成本,构建出任务特定子空间。

7.2 把多个子空间拼接起来做整体决策

EASE 不只是“分开学”,还会把 PTM 与各个 adapter 的特征拼接起来,聚合多个子空间的信息,形成更全面的表示,再据此进行统一决策。

7.3 用类间相似性补全旧类分类器

面对“旧分类器与新空间不匹配”的问题,作者通过共现空间中的类间相似性来引导目标空间中的分类器映射,从而在没有 exemplar 的情况下,合成旧阶段类别的分类器。

8. 推理阶段的进一步设计

这段最后还提到,EASE 在推理时不是简单地直接分类,而是会:

- 根据特征与原型的匹配程度对预测结果进行重加权;

- 综合考虑多个子空间之间的对齐关系;

- 构建更稳健的 ensemble。

这说明 EASE 不仅在训练阶段考虑了多子空间结构,在测试阶段也显式利用了这种结构。

9. 这段的整体逻辑链条

这段引言的逻辑非常清楚,可以概括为:

第一步:提出背景

现实数据是流式的,因此需要类增量学习。

第二步:指出矛盾

CIL 最大问题是灾难性遗忘,本质是稳定性与可塑性的冲突。

第三步:分析现有 PTM 路线

冻结 PTM + prompt 虽然轻量,但 prompt 仍会被新任务覆盖。

第四步:分析 expandable network 路线

它能缓解任务冲突,但代价太高,还依赖 exemplar。

第五步:提出研究问题

是否能用低成本方式构造任务特定子空间,并且不依赖 exemplar。

第六步:给出 EASE

通过轻量 adapter 扩展子空间,通过语义相似性补全旧类分类器,并在推理阶段做多子空间集成。

10、一句话总结

EASE 试图结合两类方法的优点:既保留 expandable networks“任务隔离”的优势,又保持 PTM 参数高效更新的低成本特点;同时通过语义引导的分类器合成解决无 exemplar 条件下的统一分类问题。

三、相关工作

1. 研究背景

这一段的核心任务是梳理类增量学习(CIL)领域已有的方法谱系,并进一步说明基于预训练模型的 CIL 已经成为当前的重要研究方向。作者的目的不是单纯列方法,而是通过对比不同路线,说明本文方法 EASE 的研究位置和动机。

2. 传统 CIL 方法的主要类别

作者先对传统类增量学习方法进行了分类,大致分成五类。

2.1 基于数据回放的方法

这类方法会保存一部分旧类别样本,在学习新类别时重新回放这些旧样本,以恢复旧知识。

它的核心思想是:通过重新看到旧数据,缓解遗忘。

2.2 基于知识蒸馏的方法

这类方法通过蒸馏,让当前模型在更新时仍然对齐旧阶段模型的 logits 或特征表示。

它的核心思想是:即使旧数据不可见,也尽量让新模型保持旧模型的行为。

2.3 基于参数正则化的方法

这类方法关注模型参数本身,通过限制重要参数在增量更新中的变化幅度,来维持旧知识。

它的本质是:不要让承载旧知识的重要参数被新任务大幅改写。

2.4 基于模型校正的方法

这类方法主要修正增量模型在预测时产生的偏置,使模型对各类别的预测更公平、更无偏。

它关注的是:增量学习中的分类偏差问题,而不只是特征遗忘本身。

2.5 可扩展网络方法

这是作者特别强调的一类。

面对新任务时,这类方法会保留旧 backbone,并新建一个 backbone 来专门学习新特征;预测时再把多个 backbone 的特征拼接起来,并通过额外保存的 exemplars 训练统一分类器。

3. 传统可扩展网络的优势与局限

作者之所以单独强调 expandable networks,是因为它和本文的思路最接近。

3.1 优势:能缓解跨任务冲突

因为每个任务都有相对独立的 backbone,所以新任务优化不会直接破坏旧任务特征。

拼接多个 backbone 后,又可以在更大的特征空间里综合利用多任务信息。

3.2 局限:难以直接迁移到 PTM-based CIL

作者指出有两个主要障碍:

- 内存代价太高:如果 backbone 是大型预训练模型,保存多个 backbone 几乎不可接受;

- 依赖 exemplars:统一分类器往往需要旧样本来训练和校准。

这意味着,虽然“模型扩展”思想有效,但它在 PTM 场景下不够实用。

4. 基于预训练模型的 CIL 成为热点

在梳理完传统 CIL 后,作者转向当前更热门的方向:Pre-Trained Model-Based CIL。

随着预训练技术的发展,把 PTM 引入 CIL 已经成为一种自然选择,因为预训练模型通常能提供更强的通用特征表示,从而提升增量学习性能。

5. 当前 PTM-based CIL 的主要路线

这一部分说明了当前基于 PTM 的方法主要集中在哪些方向。

5.1 Prompt-based 路线是主流

大多数方法会学习一个 prompt pool,并从中自适应选择 instance-specific prompt 来适应当前输入和任务。

由于主干 PTM 权重被冻结,新任务信息主要被编码进 prompt 中。

5.2 Prompt 路线的进一步扩展

作者列举了 DAP,它在 prompt selection 基础上进一步引入了 prompt generation module,说明这一方向已经开始从“选择 prompt”走向“生成 prompt”。

5.3 除 prompt 外的其他 PTM-based 路线

作者还提到几类代表方法:

- LAE:采用基于 EMA 的模型更新,并通过 online/offline model 配合学习;

- SLCA:通过 Gaussian modeling 对旧类别建模并校正分类器;

- ADAM:说明原型分类器是一个很强的 baseline;

- RanPAC:探索随机投影在这一场景中的应用。

这说明 PTM-based CIL 已经不只是 prompt tuning 一条线,而是开始在模型更新、分类器设计和特征变换等方面多样化发展。

6. 这段 related work 想说明的核心矛盾

虽然作者没有在这一段里直接展开批判,但逻辑上已经很清楚:

6.1 传统 expandable networks

优点是任务隔离做得好,能减轻跨任务冲突;

但问题是模型太重,而且依赖 exemplar。

6.2 当前 PTM-based 方法

优点是参数高效、适合冻结预训练主干;

但多数方法仍然集中在 prompt 或轻量调优层面,并没有完全解决“不同任务在共享更新空间中相互干扰”的问题。

因此,这一段实际上在铺垫一个核心问题:

能不能既保留 expandable networks 的任务隔离优势,又兼顾 PTM-based 方法的参数高效特性,同时摆脱 exemplar 依赖?

7. 这段对本文方法的铺垫作用

这段 related work 的真正功能,是为 EASE 的提出建立逻辑起点。

第一层铺垫

传统 CIL 已经有多种解决遗忘的方法,但各有局限。

第二层铺垫

模型扩展路线最能缓解跨任务冲突,但在 PTM 场景下代价过高。

第三层铺垫

PTM-based CIL 虽然更轻量,但仍然主要依赖 prompt 或轻量微调,并没有直接继承“任务独立子空间”这一优势。

第四层铺垫

于是,EASE 的研究空间就自然出现了:

用更轻量的方式实现任务级子空间扩展,并在不依赖 exemplar 的情况下完成统一分类。

8、一句话总结

传统类增量学习方法主要包括数据回放、知识蒸馏、参数正则、模型校正和可扩展网络五类,其中可扩展网络通过为新任务分配独立 backbone 来有效缓解任务冲突,但在预训练模型场景下面临高内存开销和 exemplar 依赖问题。与此同时,基于预训练模型的类增量学习已成为热点,大多数方法采用 prompt-based 轻量更新,也有 EMA 更新、Gaussian 校正、原型分类器和随机投影等路线。整体来看,现有方法要么任务隔离强但代价高,要么参数高效但冲突仍在,这正构成了 EASE 方法提出的直接动机。

四、序言

1. 本节的定位

这一节不是正式提出 EASE,而是先把论文后续要用到的问题设定、符号定义、两类代表性基线及其局限交代清楚。它的作用相当于给后面的核心方法搭一个理论和概念框架。

2.第一节:Class-Incremental Learning 的任务设定

2.1 CIL 的基本目标

作者先正式定义了类增量学习:

模型会按阶段不断接触新的类别数据,最终目标不是每个阶段单独分类,而是构建一个面向所有已见类别的统一分类器。

2.2 数据组织方式

整个训练过程由一系列任务组成,记作 ![]() 。

。

其中第 b个任务的数据集 ![]() 只包含当前阶段的新类别样本,而且不同任务之间的类别集合互不重叠。

只包含当前阶段的新类别样本,而且不同任务之间的类别集合互不重叠。

这说明论文处理的是标准的 class-incremental setting,而不是类别会重复出现的其他设定。

2.3 exemplar-free 设定

作者特别强调:本文遵循 exemplar-free 设定,即不保存任何旧类别样本。

因此,在第 b 个增量阶段,训练时只能访问当前任务的数据![]() ,而不能再回看以前任务的数据。

,而不能再回看以前任务的数据。

这一点非常关键,因为它直接决定了:

- 传统 replay 类方法不适用;

- 后面很多“统一分类器如何维护”的问题会变得更难。

2.4 优化目标

作者把 CIL 的目标写成一个期望风险最小化问题:

希望找到一个模型 f(x),使它在当前为止所有已见任务的数据分布上总体分类错误最小。

这一定义其实强调了两个核心要求:

- 模型必须能处理当前新类;

- 模型也必须继续正确识别历史旧类。

2.5 PTM 下的模型形式

在 PTM-based CIL 里,作者把模型分成两部分:

- 特征提取器 / 特征嵌入函数

- 线性分类器 W

也就是说,先提特征,再由线性分类器映射到类别空间。

3. 第一节真正想说明什么

这一小节的本质作用,是把后文问题严格限定为:

3.1 这是一个“不能存旧数据”的 CIL 问题

这意味着模型不能依赖 exemplar replay 来恢复旧知识。

3.2 这是一个“统一分类”的问题

不是每个任务各自做自己的分类,而是所有已见类别都必须放到同一个决策体系里。

3.3 这是一个“预训练模型作为初始 backbone”的问题

所以作者后面的所有设计,都是围绕“如何轻量地更新 PTM 而不破坏旧知识”来展开的。

4. 3.2 节:两类代表性基线方法

这一节作者没有再泛泛罗列 related work,而是把已有方法抽象成两种最关键的技术范式:

- Learning with PTMs

- Learning with expandable backbones

这两类方法分别对应论文想要结合和超越的两条主线。

5. 第一类基线:Learning with PTMs

5.1 基本思路

这类方法的核心思想是:

尽量少改预训练模型,以便保留其通用知识。最常见做法是:

- 冻结预训练权重;

- 只训练少量附加参数,例如 prompt pool。

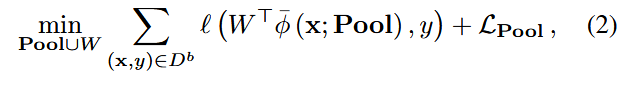

5.2 公式含义

作者用式(2)概括这类方法:

在当前任务数据上,优化 prompt 和分类器,使模型能正确分类当前任务样本,同时把任务信息编码到 prompts 中。

5.3 优点

这条路线的优点很明显:

- 参数高效;

- 训练成本低;

- 能尽量保留 PTM 原有的泛化能力。

5.4 局限

但作者指出它的核心问题在于:

新任务 prompt 的训练会和旧任务 prompt 发生冲突。

也就是说,虽然 backbone 冻结了,但任务冲突并没有真正消失,而是转移到了 prompt 空间里。

6. 第二类基线:Learning with expandable backbones

6.1 基本思路

这类方法的出发点完全不同:

既然新旧任务会在同一表示空间里冲突,那就为新任务新增一个 backbone,而不是在旧 backbone 上继续覆盖更新。

具体做法是:

- 保留并冻结旧 backbone;

- 初始化一个新 backbone 学习当前任务;

- 把旧 backbone 和新 backbone 的特征拼接起来;

- 再训练一个更大的分类器做统一分类。

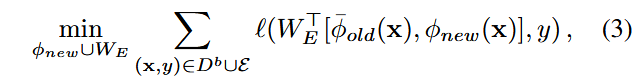

6.2 公式含义

作者用式(3)表示这类方法:

优化新的 embedding 与大分类器 ![]() ,在新任务数据和 exemplar set 上共同训练,使拼接后的特征能统一映射到所有已见类别。

,在新任务数据和 exemplar set 上共同训练,使拼接后的特征能统一映射到所有已见类别。

6.3 优点

这条路线的最大优势是:

- 旧 backbone 不动,旧知识不容易被破坏;

- 新 backbone 专注学习新任务特征;

- 多个 backbone 拼接后,特征表达更丰富。

作者还举了“猫”和“鸟”的例子来解释:

旧 backbone 学“猫”的胡须、条纹,新 backbone 学“鸟”的喙和羽毛,而不是强行在同一个 backbone 里互相覆盖。

6.4 局限

但这条路线在本文设定下有两个致命问题:

- 扩 backbone 太贵:如果 backbone 是大型 PTM,存多个模型代价太高;

- 依赖 exemplars:而本文是 exemplar-free setting,拿不到旧样本去训练统一分类器。

7. 第二节的关键转折:为什么要“expandable subspaces for PTM”

在对比完这两类基线后,作者提出了一个非常关键的中间结论:

7.1 Prompt-based PTM 方法的问题

它轻量,但旧 prompt 和新 prompt 会冲突。

7.2 Expandable backbone 方法的问题

它能减少任务冲突,但太重,而且依赖 exemplar。

于是作者想要的就不是这两条路中的任意一条,而是一个折中目标:

既像 expandable backbones 一样给不同任务分开表示空间,又像 PTM-based 方法一样保持低成本,而且还不能依赖 exemplars。

这就是“Learning expandable subspaces for PTM”这一小段真正想引出的思想。

8. 本节识别出的核心矛盾

这一章虽然还没提出 EASE,但已经把问题压缩成了一个非常清晰的矛盾:

8.1 任务冲突来自共享表示空间

如果新旧任务都在同一个可训练表示空间里竞争,旧知识就容易被新知识覆盖。

8.2 解决冲突的直觉是“分空间”

expandable backbone 的成功说明:

为不同任务构造相对独立的表示空间,是缓解遗忘的有效思路。

8.3 真正困难的是“怎么低成本地分空间”

因为在 PTM 场景下,直接扩整个 backbone 不现实;

同时没有 exemplars 时,统一分类器也很难重新训练。

9. 这一节对后文方法的铺垫作用

这一节其实已经把 EASE 的方法需求写得很明确了,后文只是在逐步填空。

9.1 需求一:轻量构造任务特定子空间

不能扩整个 PTM,只能找更便宜的方式构造子空间。

9.2 需求二:在 exemplar-free 条件下完成统一分类

因为拿不到旧样本,所以不能用传统 expandable networks 的方式直接重训分类器。

9.3 需求三:既要保留旧知识,又要吸收新知识

也就是最终要解决的稳定性—可塑性冲突。

10.一句话总结

第 3 章先正式定义了 exemplar-free 的 PTM-based class-incremental learning 问题:模型在每个阶段只能访问当前任务数据,但最终要对所有已见类别做统一分类。随后作者把现有方法抽象为两类基线:一类是冻结 PTM、通过 prompts 进行轻量更新的方法,它参数高效但仍存在新旧任务冲突;另一类是扩展 backbone、拼接多任务特征的方法,它能缓解冲突但代价高且依赖 exemplars。由此,本章顺势引出了本文真正要解决的问题:能否在不使用 exemplars 的条件下,以低成本方式实现任务级子空间扩展。

五、EASE:可拓展的子空间

1. 本章要解决的核心问题

这一章首先承接前文结论:

作者已经判断出,“为不同任务扩展独立子空间” 是缓解类增量学习中跨任务冲突的一个有效方向;但现实困难在于,本文是在 exemplar-free 条件下做 PTM-based CIL,所以不能像传统 expandable backbone 方法那样:

- 存多个完整 backbone;

- 再用旧样本去统一训练分类器。

因此,这一章真正要解决的是两个问题:

1.1 如何低成本地扩展任务子空间

不能扩整个大模型,只能用很轻量的方式为每个任务建立自己的表示空间。

1.2 如何在没有旧样本的情况下维护统一分类器

随着子空间不断扩展,特征维度也在不断变化,旧类别原来的分类器会和新空间不兼容;但又没有旧 exemplar 可以重新估计旧类表示,所以必须想办法补全旧类在新子空间中的分类表示。

2. 本章的总体思路

作者提出的 EASE,其核心方法链条可以概括成三步:

EASE 不是把所有任务都塞进同一个可训练空间里,而是给每个增量任务分配一个新的 adapter 子空间;然后如果旧类别在新子空间里没有原型,就利用类间语义相似性把它“补出来”。

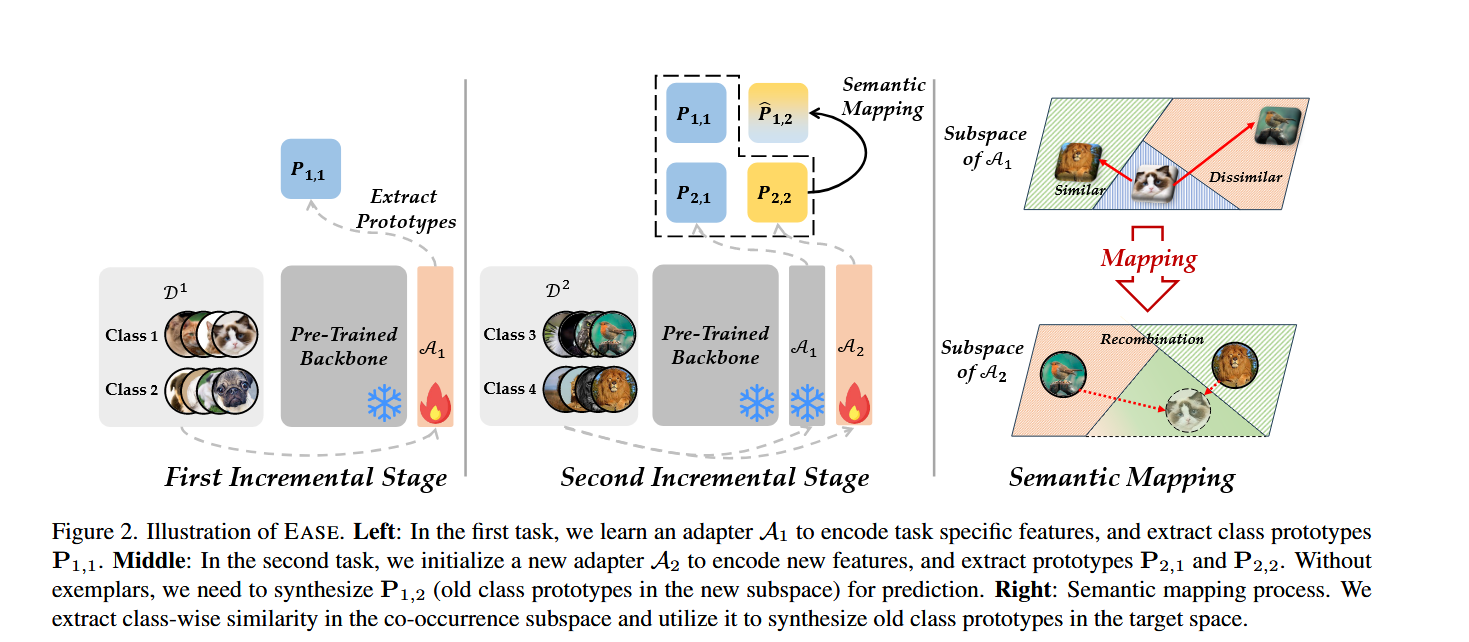

模型架构图详解

图里其实有两条主线:

- 主线一:子空间扩展

新任务来了,就新增一个 adapter,形成一个新的任务子空间。 - 主线二:原型补全

新子空间里没有旧类样本,算不出旧类原型,就靠 semantic mapping 合成。

2.1 用轻量 adapter 为每个任务扩展一个子空间

不是新任务来就新建整个 backbone,而是在冻结 PTM 的基础上,只增加一个轻量 adapter。这样每个任务都有相对独立的特征子空间,同时成本很低。

2.2 用 prototype-based classifier 替代普通线性分类器

模型不依赖一个固定线性分类头,而是把各类在不同子空间中的代表性原型拼起来,作为分类依据。

2.3 用 semantic-guided prototype complement 补全旧类表示

面对“旧类在新子空间中没有样本、因此没有原型”的问题,作者利用类间语义相似性,在不使用旧样本的情况下合成旧类在新子空间中的原型。

最终,再通过对子空间分数进行重加权,完成稳健的多子空间集成预测。

3. 5.1 节:Subspace Expansion with Adapters

这一节的任务,是解决“如何低成本扩展子空间”的问题。

3.1 为什么不用 expandable backbone

前面式(3)的 expandable backbone 方法,虽然能让新旧任务拥有相对独立的表示空间,但需要对整个 backbone 进行完整微调并保存多个 backbone,代价太高,不适合大型 PTM。

3.2 作者的替代方案:expandable adapters

作者的做法是:

在每个 transformer block 的 MLP 旁边挂一个轻量 adapter,把它作为任务特定的附加分支。这样:

- backbone 主体始终冻结;

- 只有 adapter 是任务相关、需要训练的;

- 每来一个新任务,只新增一个新 adapter。

3.3 adapter 的作用机制

adapter 通过一个“降维—非线性—升维”的 bottleneck 分支,在原 MLP 输出上加上一个残差修正项。

这意味着它不是替代原始 PTM 表示,而是在保留原表示的同时,往里面注入当前任务特定信息。

3.4 为什么这种设计有效

作者强调,它有两个重要效果:

- 不会破坏旧知识:因为新任务只训练当前任务对应的 adapter,不会改动旧 adapter;

- 能聚合多任务信息:最终特征是所有 adapter 子空间特征的拼接,因此包含多个任务的表示信息。

3.5 为什么这种设计高效

保存全部 adapter 的参数成本只是

![]()

远小于为每个任务保存一个完整 backbone。也就是说,EASE 把“模型扩展”从扩 backbone变成了扩轻量分支。

4. 5.1 节后半部分:为什么要用原型分类器

在完成子空间扩展后,还需要把不断扩展的整体特征映射到类别上。作者这里没有继续依赖普通线性分类器,而是转向 prototype-based classifier。

4.1 原型是怎么构造的

对于某个类别 i,作者在当前 adapter 子空间里,把该类所有样本特征求平均,得到这个类别在该子空间中的原型。

4.2 最终类别表示是什么

把同一个类别在所有 adapter 子空间中的原型拼接起来,就得到该类别在整体高维空间中的原型表示。

4.3 分类是怎么做的

分类时不再看单独的线性权重,而是比较:

- 输入样本的整体特征

- 各个类别的整体原型Pi

之间的相似度。论文用的是余弦分类器。

4.4 这样做的意义

原型分类器天然适合“类别中心表示”这种结构,而且后面补全旧类在新子空间中的表示时,也更方便直接在原型层面操作。

5. 5.2 节:Semantic Guided Prototype Complement

这一节是 EASE 的关键创新之一,解决的是“旧类在新子空间里没有原型怎么办”的问题。

5.1 问题是怎么出现的

当新任务到来时,模型会新增一个 adapter,也就新增了一个子空间。

此时:

- 新类在新子空间里有样本,因此可以直接计算原型;

- 旧类没有样本,因此无法直接计算旧类在新子空间里的原型。

于是就出现了一个问题:

特征维度在扩展,但旧类原型没有同步扩展,导致原型与特征不匹配。

5.2 作者的核心直觉

作者认为,相关类别通常依赖相似特征来判别,因此类间语义关系可以被复用。

例如,“lion”和“cat”在一个子空间里接近,那么这种相似关系在另一个子空间中也应该大体成立。

5.3 共现空间的作用

为了估计这种关系,作者选取一个旧类和新类都能同时表示的子空间,也就是 co-occurrence space,在这里计算旧类与新类之间的原型相似度。

5.4 原型补全的做法

具体过程分两步:

第一步:算旧类与新类的相似度矩阵

在共现空间中,用旧类原型和新类原型计算余弦相似度,再做 softmax 归一化,得到一个“某旧类相对于各个新类的权重分布”。

第二步:在新子空间中合成旧类原型

用上一步得到的相似度权重,对新类在新子空间中的原型做加权组合,就得到旧类在新子空间中的估计原型。

5.5 这一设计的意义

这个补全过程有三个特点:

- 不需要旧样本;

- 不需要额外训练;

- 能让旧类原型维度和新特征空间重新对齐。

所以,这一节真正解决了 exemplar-free 条件下最棘手的问题:

在没有旧数据的情况下,如何把旧类别“补进”新扩展出来的子空间。

6. 5.3 节:Subspace Ensemble via Subspace Reweight

这一节解决的是“多个子空间如何一起做最终预测”的问题。

6.1 完整分类器是怎么形成的

经过前两步之后,模型已经拥有:

- 各任务对应的 adapter 子空间;

- 所有类别在这些子空间中的原型,包含直接计算的和补全得到的。

于是作者把这些原型组织成一个完整的 prototype matrix,作为最终分类器。

6.2 推理时本质上在做什么

作者指出,推理阶段的 logit,其实等价于:

在多个子空间中分别计算“原型—特征匹配分数”,再把这些分数集成起来。

所以 EASE 的最终预测不是依赖某一个单独子空间,而是一个多子空间 ensemble。

6.3 为什么还要再做 reweight

作者进一步认为,并不是所有子空间对某个任务都同样重要。

对于第 b个任务来说:

- adapter Ab 是专门为这个任务训练的;

- 因此它对应的原型与特征更匹配,更应该在预测时占主要权重;

- 其他子空间可以提供辅助信息,但不应该和主匹配子空间同权。

6.4 reweight 的具体含义

作者在最终 logit 中:

- 给匹配子空间 Ab较大的权重;

- 给其他子空间统一乘上较小系数 α。

6.5 这样做的效果

这样能突出当前任务核心特征在决策中的作用,同时保留其他子空间提供的辅助信息,从而使 ensemble 更稳健。

7. 第五章的完整方法流程

如果把整章方法按执行顺序串起来,就是下面这个流程:

第一步:冻结 PTM 主体

不直接改整个 backbone,保留 PTM 的通用能力。

第二步:每来一个任务就新增一个 adapter

通过轻量 adapter 为当前任务构建新的任务特定子空间。

第三步:拼接所有子空间特征

形成整体高维表示 Φ(x),把多任务信息联合起来。

第四步:提取类别原型

在各个子空间中提取当前类别的原型,作为类别表示基础。

第五步:补全旧类在新子空间中的原型

利用共现空间中的类间相似性,把旧类原型合成出来。

第六步:构建完整原型分类器

把所有类别在所有子空间中的原型整合成一个统一分类器。

第七步:推理时对子空间分数做重加权

强调匹配子空间,辅助利用其他子空间,得到最终预测。

8. 这一章相对于前文基线的突破点

这一章的方法设计,本质上是在同时修补前文两类基线的缺点。

8.1 相对 prompt-based PTM 方法

它不再让所有任务在同一个 prompt 空间里竞争,而是给每个任务独立 adapter 子空间,因此更好地缓解了跨任务冲突。

8.2 相对 expandable backbone 方法

它保留了“任务分空间学习”的优点,但不再扩整个 backbone,而只扩轻量 adapter,因此成本大幅降低。

8.3 相对 exemplar-based 分类器校准

它不依赖旧样本重新训练统一分类器,而是通过 semantic-guided prototype complement 直接补全旧类表示。

9. 本章的核心贡献压缩

如果把第 五 章压缩成最核心的三点,就是:

9.1 提出 expandable adapters

用轻量 adapter 替代 expandable backbones,实现低成本任务子空间扩展。

9.2 提出 semantic-guided prototype complement

在没有 exemplar 的情况下,补全旧类在新子空间中的原型。

9.3 提出 subspace reweight ensemble

在推理时强调匹配子空间,使多子空间集成更稳健、更符合任务结构。

10.一句话总结

第 4 章完整回答了前面提出的核心问题:

如何在 exemplar-free 的 PTM-based CIL 场景下,实现低成本的任务子空间扩展,并维持统一分类能力。 作者的答案是:冻结 PTM、按任务扩展轻量 adapter、用原型分类器表示类别、再借助类间语义关系补全旧类在新子空间中的原型,最后通过对子空间分数进行重加权完成稳健预测。整体来看,EASE 把“任务隔离”“参数高效”“无 exemplar 统一分类”三件事结合到了同一个框架中。

六、实验

这一章的整体目标

这一章的目的不是再讲方法,而是从实验上回答四个问题:

1. EASE 是否真的比现有方法更强

作者在 7 个基准数据集上,把 EASE 和当前代表性的 PTM-based CIL 方法、以及一些传统 CIL 方法进行比较,验证它的增量学习能力。

2. EASE 的优势是不是稳定的

作者不仅看单一设置,还看不同数据划分、不同 backbone 权重、不同基类数量下的结果,检查 EASE 是否具有普适性。

3. EASE 的各个模块是否都真的有用

作者通过消融实验,把方法拆成多个组件,逐个验证 expandable adapters、prototype complement、subspace reweight 的贡献。

4. EASE 的设计是否合理且稳健

作者还做了可视化、超参数鲁棒性分析,以及不同 prototype complement 策略的对比,进一步说明方法背后的机制是成立的。

6.1. Implementation Details:实验怎么做的

这一节主要是在说明实验设置是否公平、完整,以及结果是否可信。

1. 数据集选择

作者使用了 7 个数据集:

- CIFAR100

- CUB200

- ImageNet-R

- ImageNet-A

- ObjectNet

- OmniBenchmark

- VTAB

这些数据既包含典型的 CIL benchmark,也包含和 ImageNet 存在较大 domain gap 的 out-of-distribution 数据集。作者这样设计,是因为 PTM 可能已经在上游任务中见过较多 ImageNet 风格知识,所以如果只测接近 ImageNet 的数据,可能不能真正说明增量学习能力。

2. 数据划分方式

作者沿用了标准 benchmark setting,用 B-m Inc-n 表示类别划分:

- m:第一阶段的类别数

- n:后续每个增量阶段的类别数

并且所有方法都使用相同的随机种子、相同的训练集和测试集,以保证公平比较。

3. 对比方法

作者对比了两大类方法:

(1)当前主流的 PTM-based CIL 方法

包括:

- L2P

- DualPrompt

- CODA-Prompt

- SimpleCIL

- ADAM

(2)传统 CIL 方法

作者还把一些传统方法放到同样的 PTM 框架下比较,包括:

- LwF

- SDC

- iCaRL

- DER

- FOSTER

- MEMO

同时还报告了一个简单基线:Finetune,也就是直接顺序微调整个 PTM。

4. 训练细节

实验在 NVIDIA 4090 上完成,使用 PyTorch 和 Pilot 复现其他方法。预训练模型采用两种代表性 backbone:

- ViT-B/16-IN21K

- ViT-B/16-IN1K

EASE 的训练配置包括:

- SGD 优化器

- batch size = 48

- 20 epochs

- 初始学习率 0.01

- cosine annealing 学习率衰减

- adapter 投影维度 r=16

- 子空间重加权参数 α=0.1

5. 评价指标

作者用 AbA_bAb 表示模型在第 bbb 个阶段结束后的准确率;再用两个指标来总结整体表现:

其中![]() 反映整个增量过程的平均表现,而

反映整个增量过程的平均表现,而 ![]() 更强调模型最终是否还保留了全部历史知识。

更强调模型最终是否还保留了全部历史知识。

三、5.2 Benchmark Comparison:EASE 和现有方法比,结果如何

这一节是实验章最核心的结果展示。

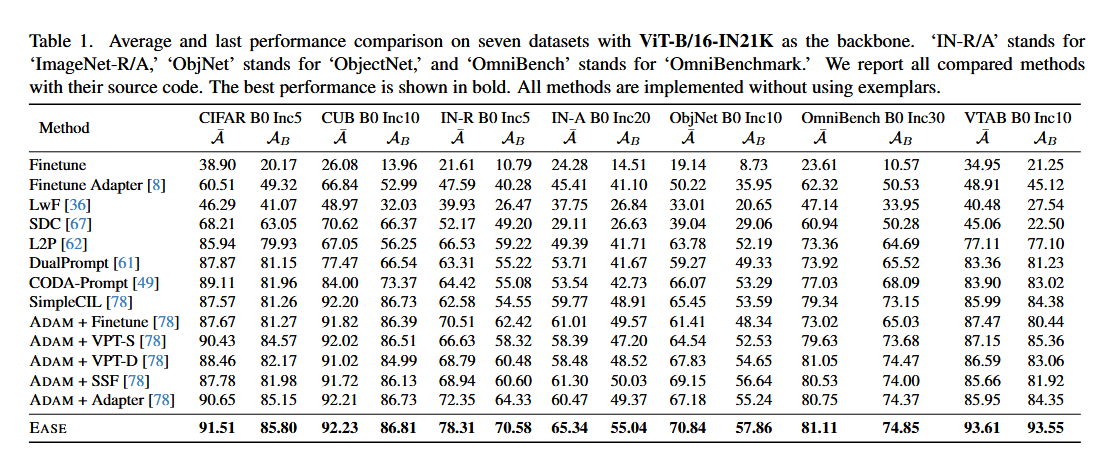

1. 总体结论:EASE 在 7 个 benchmark 上都最优

在 Table 1 中,作者用 ViT-B/16-IN21K 作为 backbone,对比了不同方法在 7 个数据集上的结果。结论是:

EASE 在所有 7 个 benchmark 上都取得了最佳性能。

而且它明显优于当时强势的 PTM-based 方法,例如 CODA-Prompt 和 ADAM。

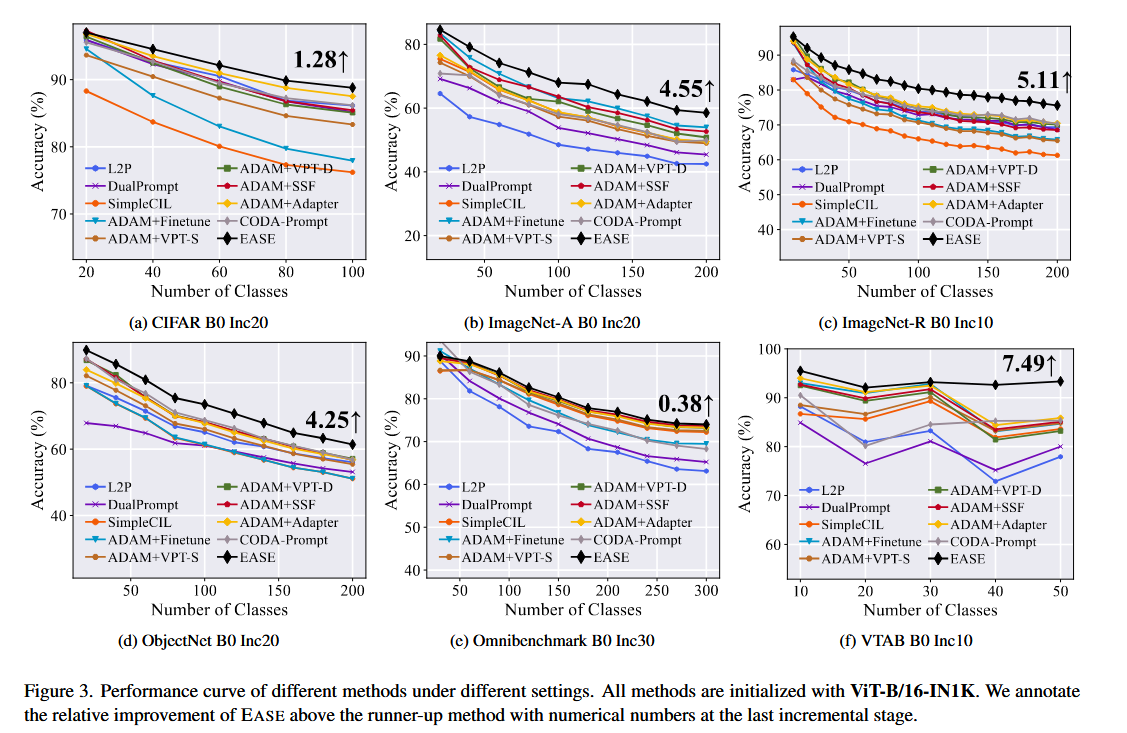

2. 增量过程中的性能趋势也更好

除了静态表格,作者还在 Figure 3 中展示了随着类别数增加,各方法性能如何变化。

结果显示,在 ImageNet-R、ImageNet-A、ObjectNet、VTAB 等数据集上,EASE 在最后阶段比第二名高出大约 4% 到 7.5%。这说明 EASE 的优势不是偶然出现在某一个点上,而是随着增量过程持续保持。

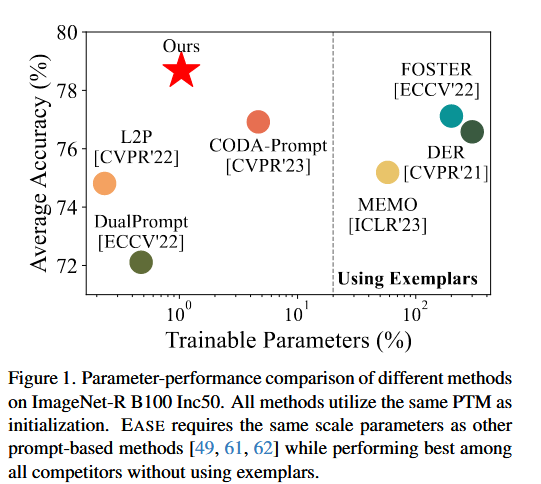

3. 不同类别划分下也有效

作者不仅测试了常见的 B0 设置,还测试了更大的 base classes 设置。

Figure 4 表明,即使第一阶段类别数变大,EASE 仍然保持竞争力,说明它并不依赖某一种特定任务划分。

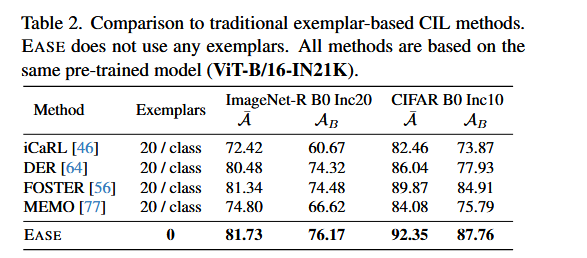

4. 与 exemplar-based 方法相比也很强

Table 2 中,作者还把 EASE 和传统 exemplar-based 方法进行比较。那些传统方法为每类保存 20 个 exemplar,而 EASE 完全不保存旧样本。即便如此,EASE 的表现仍然很有竞争力。

这说明 EASE 的优势并不是靠 replay 得来的,而是其子空间扩展和原型补全机制本身有效。

5. 参数效率也很优

最后,作者用 Figure 1 比较了“可训练参数量—性能”关系。结论是:

- EASE 的参数规模和 L2P、DualPrompt 这类 prompt-based 方法差不多;

- 但性能却更高;

- 同时还不依赖 exemplars。

所以这一节最终想说明的是:

EASE 不只是精度高,而且是在参数开销低、无 exemplar 的条件下达到更好结果。

四、5.3 Ablation Study:EASE 的每个模块都重要吗

这一节的目的是回答:

EASE 的效果是因为整体框架合理,还是只是某个局部 trick 起作用?

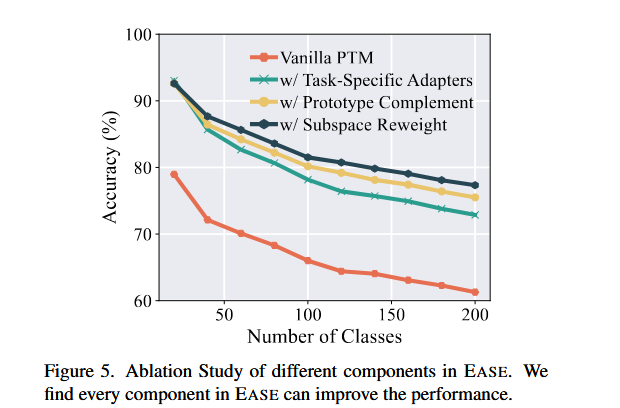

作者在 ImageNet-R B0 Inc20 上比较了四种版本:

1. Vanilla PTM

只用预训练图像编码器加 prototype classifier,作为最基础 baseline。

2. w/ Task-Specific Adapters

在 Vanilla PTM 基础上加入 expandable adapters,但因为没有 exemplar,只使用 Eq. 10 的对角部分。

和 Vanilla PTM 相比,它已经明显提升,说明:

仅靠 PTM 的通用特征还不够,面向下游增量任务学习任务特定特征是必要的。

3. w/ Prototype Complement

在 task-specific adapters 基础上,再加入 semantic mapping,把完整 prototype matrix 补全。

性能进一步提升,说明:

跨任务的语义关系确实能够帮助旧类在新子空间中恢复表示,从而增强推理。

4. w/ Subspace Reweight

最后再加上 Eq. 12 中的子空间重加权,对不同子空间的 logit 赋予不同重要性。

结果又进一步提升,说明:

并不是所有子空间都该同权,强调任务匹配子空间是有益的。

因此,消融实验的结论非常清楚:

EASE 的每个模块都能带来增益,而且这些模块是逐层叠加、相互配合的。

五、5.4 Further Analysis:为什么 EASE 的设计是合理的

这一节更偏“机制验证”。

1. 可视化:不同 adapter 确实学到了不同任务特征

作者用 t-SNE 可视化了两个 adapter 的特征空间:

这正好支持了 EASE 的核心假设:

不同 adapter 真的在学习任务特定特征。

这也解释了为什么 Eq. 12 里要对“匹配子空间”赋予更高权重。

2. 参数鲁棒性:超参数不敏感

作者测试了两个关键超参数:

- adapter 投影维度 r

- 子空间重加权参数 α

实验显示,在一系列取值范围内,性能变化并不剧烈,说明 EASE 对超参数比较稳健。最终作者推荐默认设置:

- r=16

- α=0.1

3. Prototype complement 的策略比较

作者还比较了三种补全方式:

- 相似度映射(本文方法)

- 线性回归(LR)

- 最优传输(OT)

在其他设置不变的情况下,当前提出的 similarity-based complement 效果最好。

这说明作者不是随便选了一个补全策略,而是经过比较后发现“基于类间相似性”的设计最适合这个场景。

六、这一章的整体结论

把第 六 章整体压缩成一句话,就是:

实验部分系统证明了 EASE 在多数据集、多设置下都优于现有方法;其性能优势不仅体现在最终精度上,也体现在参数效率、无 exemplar 条件下的稳定性,以及各模块设计的有效性和鲁棒性上。

更细一点说,这一章证明了三件事:

1. 方法有效

EASE 在 benchmark comparison 中 consistently 最优。

2. 设计合理

Ablation study 表明 expandable adapters、prototype complement、subspace reweight 缺一不可。

3. 机制可信

可视化、参数分析和补全策略比较共同支持了方法背后的核心直觉。

七、结论

这段的核心作用

这段文字承担两个任务:

- 总结整篇论文到底做了什么

- 说明方法目前还有什么限制,以及下一步可以往哪里做

也就是说,它不是再展开技术细节,而是从更高层面回答:

- EASE 的主要贡献是什么

- 为什么它有效

- 它还不够完美的地方在哪里

研究结论

1. 增量学习是现实系统需要的重要能力

作者首先强调,incremental learning 是现实世界学习系统应具备的一种关键能力。

这相当于再次回到论文的起点:真实数据是持续到来的,模型不能只会一次性静态训练,而要能不断吸收新知识。

2. 本文提出了 EASE

作者给出的核心结论是:

本文提出了 EASE,用于预训练模型上的类增量学习。

也就是说,EASE 被定位为一个面向 PTM-based CIL 的解决方案。

3. EASE 的第一个关键设计:用轻量 adapter 构建多样子空间

作者总结说,EASE 通过lightweight adapters 为 PTM 构造了多个diverse subspaces。

这句话其实压缩了第 4 章最核心的思想:

- backbone 主体不反复大改;

- 每个任务有自己的 adapter;

- 每个 adapter 对应一个任务特定子空间。

4. EASE 的第二个关键设计:聚合历史特征,得到整体表示

作者进一步指出,aggregating historical features 能让模型提取出 holistic embeddings,同时又不遗忘旧知识。

这说明 EASE 的目标不只是“把任务隔开”,而是:

- 一方面保留历史任务学到的特征;

- 另一方面把这些特征综合起来,形成更完整的表示空间。

5. EASE 的第三个关键设计:不用 exemplar 也能补全旧类表示

作者最后总结了另一个重要贡献:

EASE 利用semantic information,在没有 exemplars 的情况下,为旧类别在后续子空间中合成 prototypes。

这其实就是本文最有辨识度的地方之一:

- 传统 expandable 方法往往要靠旧样本来校准统一分类器;

- EASE 则通过类间语义关系,直接补出旧类在新子空间中的原型表示。

6. 实验结论

作者最终用一句话概括实验结果:

大量实验验证了 EASE 的有效性。

虽然这段没有重复列数值,但它是在概括第 5 章的整体发现:

EASE 在多个 benchmark 上表现优异,说明方法不仅设计合理,而且实证有效。

局限性

这一段的局限写得很克制,但其实很关键。

1. adapter 虽轻量,但不是“零成本”

作者指出,adapter 虽然只是轻量模块,总参数量大约只占 backbone 的 0.3%,但它们仍然需要被保存。

这意味着:

- 单个 adapter 很小;

- 但随着任务不断增加,adapter 会不断累积;

- 因此模型总大小还是会慢慢变大。

2. 真正的限制是“任务越多,存储越涨”

所以 EASE 虽然已经比“每任务存一个完整 backbone”便宜很多,但它并没有彻底消除模型规模随任务增长的问题。

只是这个增长从“很大”降到了“较小但仍存在”。

未来工作

作者给出的未来方向很明确:

1. 核心方向:压缩 adapters

未来工作包括设计新的算法,对 adapters 进行compress。

这说明作者认为,EASE 的下一步优化重点不是推翻当前框架,而是:

- 保留“子空间扩展”的核心思想;

- 进一步减少 adapter 的长期存储成本。

2. 这背后的研究逻辑

也就是说,作者已经认为 EASE 的主框架是成立的,接下来更重要的是提高它的可部署性和长期可扩展性。

整段的逻辑链条

这段结论其实可以压缩成一个非常清楚的逻辑:

第一步:重申任务意义

现实世界需要增量学习能力。

第二步:概括方法

EASE 通过:

- 轻量 adapter 扩展任务子空间

- 聚合历史特征形成整体表示

- 利用语义信息补全旧类原型

来实现 exemplar-free 的 PTM-based CIL。

第三步:给出实验结论

大量实验表明该方法有效。

第四步:承认局限

adapter 虽小,但随着任务增多,额外存储仍会累积。

第五步:给出未来方向

未来可以研究 adapter 压缩算法。

一句话总结

本文在预训练模型类增量学习场景下提出了 EASE。其核心思想是利用轻量 adapter 为不同任务构建可扩展子空间,并通过聚合历史特征获得整体表示;同时借助类间语义信息,在无需保存旧样本的前提下补全旧类别在后续子空间中的原型表示。实验结果表明,EASE 是一种有效的 exemplar-free 增量学习方法。其主要局限在于,虽然 adapter 参数量较小,但随着任务数增加,额外存储仍会持续增长,因此未来可以围绕 adapter 压缩展开研究

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)