FSS-SAM3封神 !无训练、不调参,靠 “拼图” 搞定小样本分割,负提示词居然是绊脚石?

论文地址:https://arxiv.org/abs/2604.05433

一、先搞懂:小样本语义分割为啥难?

你有没有想过,AI 对图片 进行语义分割时,要是遇到没见过的物体,只给 1-5 张参考图,它能精准分割吗?这就是「小样本语义分割(FSS)」的核心任务 ——用极少标注样本,搞定新类别的像素级分割。

但传统方法有两个大痛点:

-

「训练成本高」:得靠海量 “模拟小样本任务” 训练模型,又费时间又费算力;

-

「泛化能力差」:换个场景、换类物体,性能就断崖式下跌。

直到视觉大模型(比如 SAM 系列)出现,大家才发现:能不能跳过训练,直接用预训练大模型解决?这篇论文就给出了答案 ——用 SAM3,不用调参、不用改结构,就能实现 SOTA 级小样本分割!

二、核心方案:3 步搞定无训练小样本分割

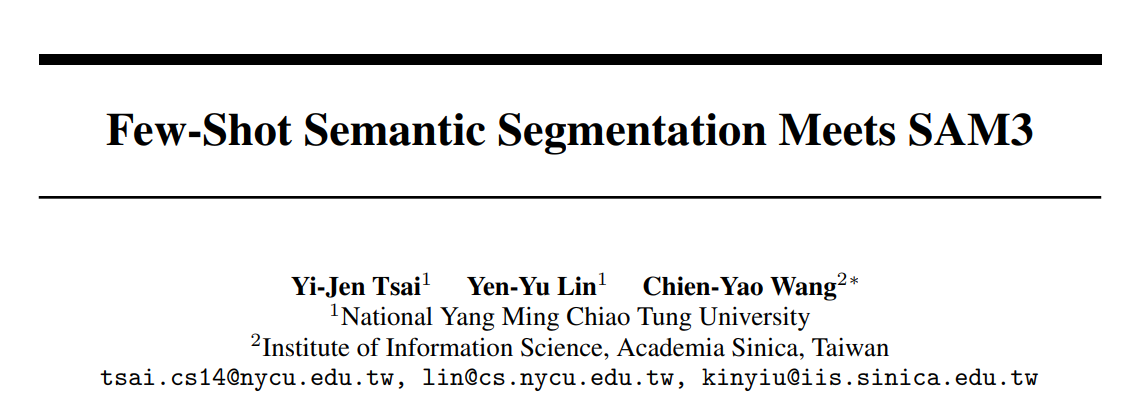

论文的思路超简单,核心就靠 “SAM3 + 空间拼接”,三步就能跑通:

1. 关键前提:SAM3 的 “开挂能力”

SAM3 作为 SAM 家族最新款,多了个「可提示概念分割(PCS)」技能 —— 不用只靠点、框提示,还能通过 “视觉示例 + 文字描述” 理解语义概念。比如给它看一张猫的参考图,再提 “猫” 这个词,它就能分割新图里的猫,天生适合小样本场景。

2. 核心操作:空间拼接 = 让模型 “同时看参考 + 待分割图”

传统方法要专门设计 “参考图 - 待分割图” 匹配模块,而这篇论文的神操作是:

-

把「支持图(带标注的参考样本)」和「查询图(要分割的新图)」,直接拼在同一张画布上(比如上下垂直拼接);

-

让完全冻结的 SAM3 一次性处理这张 “组合图”,模型会通过自身注意力机制,自动找到两张图的语义对应关系 —— 就像让 AI 拿着参考图,当场对比着分割新图!

3. 加分项:视觉 + 文字双提示,泛化更强

光靠参考图还不够,论文还加了「文本提示词」:比如分割 “猫” 时,把 “猫” 这个类别名输入 SAM3 的文本编码器,和视觉特征融合。这样做的好处是:避免模型只学参考图的细节(比如某只猫的姿势、颜色),而是聚焦 “猫” 这个类别本身,分割更灵活。

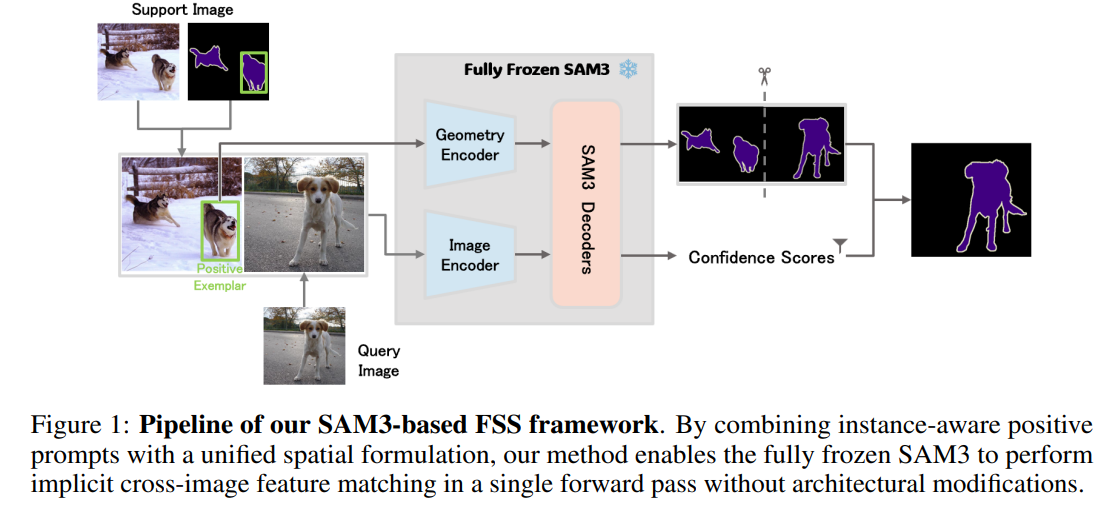

三、颠覆认知:负提示词居然 “帮倒忙”?

这篇论文最意外的发现,颠覆了大家对 “提示词” 的认知:

先科普:啥是负提示词?

比如想分割 “猫”,负提示词就是告诉模型 “不要分割狗、不要分割天空”,本意是帮模型排除干扰。

但实验结果打脸了:

-

加了负提示词后,分割性能直接暴跌!比如 COCO-20ⁱ 1-shot 设置下,加 5 个负提示词,mIoU 从 66.6% 跌到 44.7%,差了 21.9 个百分点;

-

更糟的是,负提示词会导致「预测崩溃」—— 模型把大部分像素都归为背景,根本找不到目标物体。

原因分析:

SAM3 的预训练逻辑是 “优先响应正提示”,面对负提示时,它不会 “精准排除干扰”,反而会 “一刀切” 地抑制所有相似特征,连目标物体的特征也给弱化了。简单说:大模型还没学会 “辩证看待正负提示”,少样本场景下,负提示只会添乱!

四、实验结果:无训练模型,干翻众多训练模型

不用训练、不用调参,性能却超顶!论文在两大权威数据集上的表现:

| 数据集 | 场景 | 核心成绩(mIoU) | 亮点对比 |

|---|---|---|---|

| PASCAL-5ⁱ | 1-shot | 81.2%(+ 文本) | 超越所有传统训练模型 |

| COCO-20ⁱ(更难) | 1-shot | 75.4%(+ 文本) | 超之前最佳结果 13.1 个百分点 |

| COCO-20ⁱ | 5-shot | 74.5%(+ 文本) | 依然碾压多数训练模型 |

关键结论:

-

纯视觉拼接(不加文本)就比很多复杂训练模型强;

-

加了文本提示后,泛化能力暴涨 —— 比如 COCO 里物体种类多、背景复杂,文字能帮模型锁定 “类别本质”;

-

5-shot 比 1-shot 提升有限,说明这方法靠 1 个参考图就够顶,不用多给样本。

五、实用启示:小样本分割的新捷径

这篇论文给我们的核心启发:

-

「大模型是基础」:SAM3 的预训练能力足够强,不用专门训练,只要找对 “任务形式” 就能用;

-

「简单就是高效」:不用设计复杂模块,把问题转化为大模型擅长的 “空间推理”,就能解锁新任务;

-

「提示词要慎用」:小样本场景下,别盲目加负提示词,聚焦正提示(参考图 + 类别名)就够了。

六、未来还有哪些坑要填?

论文也指出了不足,未来可以重点突破:

-

负提示词怎么用?:得设计新方法让模型 “区分正负信号”,既排除干扰又不弱化目标;

-

跨模态对齐:SAM3 的图像和文本编码器没完全对齐,未来可以优化,让文字和图像配合更默契;

-

多样本融合:5-shot 提升有限,说明怎么高效利用多个参考图,还有待探索。

好了,这篇文章就介绍到这里,喜欢的小伙伴感谢给点个赞和关注,更多精彩内容持续更新~~

关于本篇文章大家有任何建议或意见,欢迎在评论区留言交流!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)