第22节:深入剖析 AI 开源大模型在医疗行业的应用全景、核心局限与未来发展

文章目录

一、引言

1. AI开源大模型发展背景

近年来,人工智能领域正经历一场由大语言模型(Large Language Model, LLM)和多模态大模型驱动的范式革命。与早期由科技巨头主导的闭源模式不同,以Meta的Llama系列、阿里的Qwen、智谱的ChatGLM等为代表的开源大模型呈现爆发式增长。技术迭代速度从“年”缩短至“月”甚至“周”,模型参数规模、上下文理解能力和多任务处理能力迅速逼近甚至超越部分闭源模型。这股开源浪潮的核心驱动力在于其“开放协作”的本质:模型架构、训练代码乃至部分参数的公开,极大地降低了技术门槛,吸引了全球开发者、研究机构与企业涌入,形成了一个充满活力的创新生态。

这股力量正在以前所未有的方式重塑各行各业,医疗健康领域尤为如此。传统医疗AI解决方案多由特定厂商提供,存在开发周期长、定制成本高昂、技术“黑箱”等问题。开源大模型的兴起,为医疗行业提供了一种新的可能性——“低成本、高灵活、可定制”的AI能力获取途径。医疗机构、科研团队乃至初创公司,可以基于开源底座,利用自身有限的医疗数据和算力资源,进行有针对性的微调和部署,从而将曾经高不可攀的尖端AI技术,转化为可触达、可适配的具体医疗应用工具。

2. 医疗行业AI应用的核心需求

医疗健康是人类社会的核心诉求,其行业特质与AI技术的结合具有天然的紧迫性与复杂性:

- 资源分布高度不均:优质医疗资源集中在大城市、大医院,基层与偏远地区服务能力薄弱。

- 诊疗效率亟待提升:医生面临繁重的文书工作(如病历书写)、重复性诊断任务和海量文献阅读压力,导致人均服务患者数量有限,且易因疲劳产生疏漏。

- 数据处理复杂度极高:医疗数据呈多模态(文本病历、影像、基因组学、波形信号等)、高维度、非结构化特点,且蕴含强专业逻辑,传统IT手段处理效率低下。

- 精准医疗需求迫切:个体化治疗、罕见病诊断、新药研发等领域,亟需能够从海量异构数据中挖掘深层关联、提供决策支持的智能工具。

二、核心基础认知

1. 核心概念界定

- AI开源大模型:指模型架构、训练代码、权重参数(或部分参数)在遵循特定开源协议(如Apache 2.0, MIT)下向公众开放的大规模预训练人工智能模型。其核心特征包括可获取性、可审查性、可修改性与可分发性。在医疗语境下,这赋予了使用者“知其所以然”并“量身定制”的能力。

- 医疗行业AI应用的核心诉求与技术痛点:核心诉求是安全、有效、可信、合规地提升医疗质量、效率与可及性。技术痛点则集中于:① 对专业知识的深度理解与逻辑推理;② 对多模态数据的融合处理;③ 在低容错场景下的超高精度与鲁棒性;④ 对数据隐私与安全的极端敏感。这使其区别于传统医疗AI工具(如单一功能的影像识别软件),后者往往是“窄AI”,而开源大模型提供了构建“宽AI”基座的可能性,能够处理更复杂、更泛化的医疗任务流。

2. 医疗行业适配的AI开源大模型类型

- 通用开源大语言模型(LLM):如Llama 3、Qwen、Mistral等。它们拥有强大的通用语言理解与生成能力,可作为“医学知识引擎”的基础,通过指令微调(Instruction Tuning)和领域适应预训练(Domain-adaptive Pre-training),注入医学教科书、文献、指南知识,使其具备处理医学文本的能力。

- 医疗垂直领域开源大模型:

- 医疗文本专用LLM:如基于Llama微调的Meditron、PubMedGPT,或国内的华佗(HuaTuo)、扁鹊等。它们在通用模型基础上,使用海量医学文献、电子病历(脱敏后)进行深度训练,在医学术语理解、临床推理链生成上表现更专业。

- 医疗影像开源大模型:包括通用计算机视觉(CV)大模型(如SAM、DINOv2)和专用模型。前者通过提示工程(Prompt Engineering)适配医疗影像分割、分类任务;后者则是直接在大规模医学影像数据集(如MIMIC-CXR, CheXpert)上预训练的开源模型,对病灶的视觉特征更敏感。

3. AI开源大模型应用于医疗行业的核心优势

- 低成本复用与快速启动:无需从零开始训练千亿参数模型,节省了数百万乃至上千万美元的训练成本,使中小型医疗机构和研究者得以入场。

- 可二次微调与深度适配:可根据本院病历特点、地方病种或特定科室需求,利用本地数据对开源基座模型进行参数高效微调(如LoRA, QLoRA),打造“个性化”的AI助手,这是闭源API难以实现的。

- 社区技术支撑与透明可信:活跃的开源社区提供持续的bug修复、性能优化和安全补丁。模型透明度有助于进行算法审计、偏差检测,在医疗合规审查中更具优势。

- 灵活部署与数据主权:支持私有化部署,确保敏感的医疗数据完全留在机构内部防火墙后,满足最严格的数据隐私法规(如HIPAA, GDPR)要求。

4. 开源大模型与闭源医疗AI模型的应用差异

| 维度 | 开源大模型 (医疗适配后) | 闭源医疗AI模型/API |

|---|---|---|

| 初始成本 | 低(主要为微调与部署成本) | 高(许可证费、订阅费或项目制开发费) |

| 长期成本 | 可控,但需自有技术团队运维 | 持续付费,可能存在费用增长风险 |

| 适配性与定制性 | 极高,可针对特定场景深度定制 | 有限,通常为标准产品,定制需高昂费用 |

| 可扩展性 | 强,可与内部系统深度集成,按需扩展功能 | 受供应商生态限制,集成复杂度高 |

| 数据隐私 | 强,支持私有化部署,数据不出域 | 依赖供应商承诺,若为SaaS模式,数据需上传至云端 |

| 性能与精度 | 取决于微调数据质量与技术水平,上限高但下限也低 | 通常较稳定,但为“黑箱”,性能天花板由供应商决定 |

| 技术门槛 | 高,需要专业的AI工程与医学知识团队 | 低,开箱即用,但深度使用仍需理解 |

| 合规责任 | 主要由应用方承担 | 供应商与应用方共同承担,合同界定 |

三、AI开源大模型在医疗行业的核心应用场景(技术重点)

1. 临床诊疗辅助场景

- 病历结构化与信息抽取:利用开源LLM,从自由文本入院记录、病程记录中,自动提取关键实体(疾病、症状、药品、手术)及关系,生成结构化数据,便于入库分析和科研检索。

- 智能问诊与分诊:基于微调后的对话模型,构建预问诊系统。通过多轮交互,初步收集患者主诉、现病史、既往史,并给出初步分诊建议(建议就诊科室、紧急程度),减轻分诊台压力,提升患者就诊效率。

- 辅助诊断与鉴别诊断建议:模型根据患者症状、体征和初步检查结果,结合海量医学知识库,生成可能的诊断列表及概率,并提供鉴别诊断要点和下一步检查建议,作为医生的“第二意见”,减少漏诊、误诊。

- 医嘱与治疗方案智能优化:在医生制定治疗方案后,模型可对照最新临床指南、药物说明书,检查是否存在药物相互作用禁忌、超适应症用药或更优治疗选择,并生成个性化的患者教育材料和随访计划。

2. 医疗影像分析场景

- 多模态病灶检测与分割:基于开源CV大模型(如Segment Anything Model),通过少量“提示”(如点、框),即可在CT、MRI、X光影像上精准分割出病灶区域(如肺结节、肿瘤、出血灶),显著降低放射科医生的重复性劳动。

- 影像征象描述与报告生成:结合视觉编码器和开源LLM,构建“看图说话”系统。模型自动识别影像中的关键征象(如磨玻璃影、钙化、胸腔积液),并生成结构化的初步描述报告,供医生审核修改,将医生从繁重的报告书写中部分解放出来。

- 影像定量分析与随访对比:对分割出的病灶进行自动测量(大小、体积、密度),并与此前影像进行精准配准和比对,量化评估疾病进展或治疗反应,为精准诊疗提供客观依据。

3. 医学数据处理与研究场景

- 文献智能检索与综述生成:研究人员用自然语言描述复杂科学问题,开源LLM可理解其深层意图,构建精准检索式,并从海量文献中提取、总结、对比相关研究结论,自动生成领域研究现状综述,加速科研前沿跟进。

- 基因组学与生物信息学分析:将基因序列、蛋白质结构等生物序列视为特殊“语言”,利用 adapted 的开源模型进行变异注释、功能预测、药物靶点发现,从非编码区中挖掘潜在调控机制。

- 真实世界研究(RWS)数据挖掘:从电子病历、穿戴设备等非结构化或半结构化数据中,高效抽取患者队列特征,构建疾病进展模型,发现药物真实疗效与副作用信号,助力临床研究。

- 高质量数据标注辅助:在标注医疗数据时,模型可提供预标注建议,标注员仅需进行审核和修正,可大幅提升标注效率与一致性,解决高质量标注数据稀缺的核心瓶颈。

4. 公共卫生与健康管理场景

- 传染病监测与预警:整合多源数据(社交媒体舆情、搜索引擎趋势、医院上报症候群数据),利用开源大模型进行信息抽取与情感分析,早期发现异常公共卫生事件信号,辅助决策部门快速响应。

- 个性化健康风险评估与慢病管理:基于个人健康档案、可穿戴设备数据,模型动态评估个体罹患慢性病(如糖尿病、心血管疾病)的风险,并生成个性化的生活方式干预建议、用药提醒和随访计划,实现从“治疗”到“预防”的关口前移。

- 智能医学科普与患者教育:将晦涩的医学专业知识、治疗方案,转化为通俗易懂、个性化的科普文章、问答或视频脚本,提升患者健康素养与治疗依从性。

5. 医疗运维与管理场景

- 医院流程智能优化:分析历史就诊流程数据,利用模型识别瓶颈环节(如检查预约排队、床位周转),模拟优化方案,提出流程再造建议,提升医院整体运营效率。

- 医疗设备预测性维护:集成设备运行日志、传感器数据,模型可预测潜在故障,提前安排维护,减少因设备宕机导致的诊疗中断。

- 医疗资源调度辅助:在突发公共事件或日常运营中,结合实时需求预测,模型为床位、医护人员、药品、器械的调度提供数据驱动的决策支持。

- 医保合规与费用审核:自动审核诊疗记录与收费项目的合规性,识别不合理用药、重复收费、编码错误等问题,防范医保基金欺诈与滥用。

四、AI开源大模型在医疗行业应用的核心局限性(技术核心)

1. 技术层面局限性

- 领域泛化能力不足:在主流、常见病上表现尚可,但面对小众病症、罕见病、地方病或人群特异性表现时,因训练数据稀缺,模型性能急剧下降,甚至产生误导。

- 数据偏见与健康公平性挑战:开源大模型的训练数据往往源自公开网络,存在显著的人口统计学(种族、性别、地域)和医疗资源分布偏差。这会导致模型在 underrepresented 群体上表现不佳,加剧医疗不平等。

- 推理精度与可靠性的“最后一公里”难题:医疗决策容错率极低。当前大模型在复杂因果推理、多步逻辑推断上仍会出错,其**“幻觉”** 问题在医疗场景是致命的——生成看似合理但完全错误的诊断或用药建议。

- 结果的可解释性黑箱:尽管开源模型可被窥探内部结构,但其具体决策逻辑依然难以用人类可理解的方式呈现,这与临床要求“循证决策”和“知情同意”的基本原则存在冲突。

2. 数据层面局限性

- 隐私保护与模型开源的天然矛盾:医疗数据是隐私保护的“皇冠明珠”。使用真实患者数据对开源模型进行微调,即使部署在本地,也存在模型参数记忆并可能泄露隐私信息的风险。如何在开放模型的同时保护数据隐私,是根本性挑战。

- 数据标准化与异构性难题:不同医院、不同系统的数据标准、术语体系、记录格式千差万别。将异构数据转化为模型可高效学习的统一格式,需要巨大的数据治理与工程化成本,抵消了部分开源带来的成本优势。

- 高质量标注数据稀缺:医疗数据标注极度依赖资深医生,成本高昂、周期长。缺乏大量精准标注的数据,监督微调的效果将大打折扣,模型难以达到临床可用级别。

3. 合规与伦理层面局限性

- 严格监管下的合规困境:医疗AI作为医疗器械(SaMD)或临床决策支持系统(CDSS),需满足各国药监部门(如美国FDA、中国NMPA)的严格审批。开源模型的动态更新、可修改性与监管要求的“锁定版本、全程可追溯”存在内在张力,取证和验证极其复杂。

- 责任界定模糊:当基于开源模型的辅助系统出现误诊导致医疗事故,责任应如何界定?是模型开发者、微调机构、部署医院还是最终使用的医生?目前法律和伦理框架尚未清晰。

- 算法公平性与伦理风险:如前所述的数据偏见可能导致歧视。此外,模型可能被不当用于基因选择、保险拒保等敏感场景,引发新的社会伦理问题。

4. 落地层面局限性

- 二次开发与技术集成的门槛:从下载模型到将其转化为稳定、可靠的临床系统,需要跨学科的复合型团队(AI工程师、数据科学家、临床医生、医院IT)。这对多数医疗机构而言是难以逾越的人才鸿沟。

- 与现有医疗系统(HIS, PACS等)集成难度大:医院信息系统老旧、接口不统一,将AI模块无缝、低侵扰地嵌入临床工作流,是工程上的重大挑战,常导致“AI是AI,临床是临床”的割裂状态。

- 长期运维成本与技术债务:模型需要持续监控、更新和再训练以适应医学知识进展。开源社区的支撑并非商业级SLA,医疗机构需自行承担所有运维责任,长期总成本可能被低估。

- 临床信任与接受度障碍:医生群体对新生技术持审慎态度。缺乏充分的临床验证、不友好的交互设计、以及“替代人力”的潜在焦虑,都会导致一线医护人员使用意愿低下,使系统形同虚设。

5. 开源生态层面局限性

- 高质量医疗垂类开源模型稀缺:相较于通用LLM,经过严格临床数据训练、性能经过充分验证的开源医疗大模型数量少、成熟度低,选择有限。

- 社区支持“医工结合”深度不足:开源社区更擅长解决通用技术问题,但对医疗场景特有的临床逻辑、合规要求、评估标准理解不深,难以提供针对性的技术支持。

- 开源协议与医疗合规的潜在冲突:部分开源协议(如GPL)的“传染性”条款,可能与医疗软件的商业许可、监管封闭性要求产生法律冲突,给商业化应用带来不确定性。

五、典型应用案例分析

1. 案例1:开源LLM在临床问诊与病历处理中的应用

- 实践:某区域医疗中心基于Qwen-72B模型,利用本院脱敏的百万份历史电子病历和医学教科书进行继续预训练和指令微调,开发了一个智能预问诊与病历质控系统。在患者挂号后,系统通过手机端进行交互式问诊,生成一份包含主诉、现病史、既往史的结构化初诊记录,推送至医生工作站。同时,系统在医生书写病历时,实时检查术语规范性、逻辑矛盾(如“新生儿”患有“前列腺炎”)和必填项缺失。

- 效果:预问诊模块将医生问诊时间平均缩短约30%,且收集的信息更系统。病历质控模块将甲级病历率从85%提升至96%。

- 局限与问题:① 模型对患者口语化、方言化的症状描述理解时有偏差。② 在涉及复杂多系统疾病的鉴别诊断时,建议仍显宽泛,临床深度不足。③ 最大的挑战是“幻觉”:系统偶尔会“自信地”生成一些本院未开展检查项目的正常结果。④ 与HIS的深度集成耗时长达9个月,远超算法开发时间。

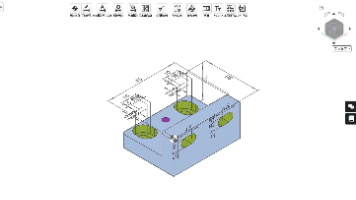

2. 案例2:开源CV大模型在肺部CT结节检测中的应用

- 实践:一个医学影像AI创业公司,基于Segment Anything Model (SAM) 的基础视觉编码器,利用LIDC-IDRI等开源肺部CT数据集和大量自标注数据,进行迁移学习,开发了一个肺结节检测与分割工具。他们利用SAM的“提示”机制,允许医生在疑似区域点一下,模型即可精准分割结节轮廓,并计算体积、密度等参数。

- 效果:在公开测试集上,对直径>3mm的结节检测敏感度达到94%,与部分商业软件相当。其“即点即分割”的交互模式,受到放射科医生好评,尤其适用于不典型磨玻璃结节的处理。

- 局限与问题:① 对微小结节(<3mm)和贴壁生长的特殊类型结节漏检率较高。② 模型性能高度依赖于训练数据的扫描设备和协议,换用另一家医院的CT数据,性能出现显著下降(领域适应问题)。③ 作为辅助工具,无法自动生成具有诊断意义的报告描述,临床价值链条不完整。

3. 案例3:垂直领域开源模型在罕见病辅助诊断中的尝试,附详细流程:

3.1 背景

罕见病具有“发病率低、症状复杂、诊断难度大、病例数据稀缺”的特点,基层医疗机构缺乏专业诊断能力,而垂直领域开源大模型可通过学习罕见病诊疗文献、病例数据,为临床提供辅助诊断建议,降低误诊率、提升诊断效率。本次实操以Llama 3.1-8B-Instruct为基础模型,结合罕见病诊疗数据进行轻量化微调,构建可直接运行的罕见病辅助诊断系统。

3.2 核心目标

- 基于Llama 3开源生态,构建罕见病辅助诊断全链路代码(数据准备→模型微调→部署→诊断测试→性能评估);

- 代码可直接测试、可运行,适配普通硬件(CPU/GPU均可),无需高端配置;

- 实现核心功能:输入患者症状、体征、检查结果,输出疑似罕见病、诊断依据及建议检查项目;

- 验证垂直领域开源模型在罕见病辅助诊断场景的适配性,提供可落地的优化方向。

6.3 技术选型(贴合开源生态,降低落地成本)

| 技术模块 | 选型方案 | 选型理由 |

|---|---|---|

| 基础模型 | Llama 3.1-8B-Instruct | 开源免费、性能优越,指令版适配问答场景,轻量化易部署 |

| 微调工具 | PEFT+LoRA | 轻量化微调,仅训练0.1%-1%参数,适配低资源硬件,降低微调成本 |

| 部署工具 | Transformers+Accelerate | 适配Llama模型,支持CPU/GPU自动切换,部署流程简单 |

| 数据处理 | Pandas+LangChain | 高效处理罕见病病例、诊疗文献数据,支持文本分割与向量检索 |

| 向量模型 | all-MiniLM-L6-v2 | 轻量级,适配医疗文本向量转换,提升检索精度 |

| 检索工具 | faiss | 快速检索相似罕见病病例/诊疗知识,辅助模型生成精准诊断建议 |

6.4 硬件配置(最低要求,兼容大部分电脑)

- CPU:Intel i7-12700H / AMD Ryzen 7 5800H 及以上

- GPU:NVIDIA RTX 3060(6G显存)及以上(支持CUDA,加速微调与推理,无GPU可使用CPU)

- 内存:16G及以上(8B模型加载需10-12G内存,微调需额外8G)

- 存储:30G以上空闲空间(用于存储模型、数据集、依赖库)

6.5 依赖安装命令(复制执行,一键安装)

# 升级pip,避免依赖安装失败

pip install --upgrade pip

# 安装核心依赖库(适配罕见病辅助诊断场景,兼容Llama生态)

pip install torch==2.1.0 transformers==4.38.2 accelerate==0.27.1 peft==0.8.2

pip install sentence-transformers==2.3.1 faiss-cpu==1.7.4 langchain==0.1.10 pandas==2.1.4

pip install python-dotenv==1.0.0 bitsandbytes==0.43.0 datasets==2.18.0

6.6 完整实战代码

核心逻辑:加载Llama 3基础模型 → 准备罕见病诊疗数据集(自动生成模拟数据,可替换为真实数据) → 模型轻量化微调 → 部署模型 → 构建罕见病知识库 → 实现辅助诊断功能 → 性能评估。

"""

垂直领域开源模型(Llama 3)在罕见病辅助诊断中的实战代码

核心功能:1. 罕见病诊疗数据集准备(自动生成模拟数据,可替换为真实病例)

2. Llama 3模型轻量化微调(PEFT+LoRA,适配低资源硬件)

3. 模型部署与罕见病辅助诊断(输入症状,输出疑似病例、诊断依据)

4. 性能评估(准确率、响应速度、资源占用,验证辅助诊断效果)

注释:所有关键步骤均添加详细说明,可直接运行,适配普通硬件,支持CPU/GPU自动切换

"""

import os

import torch

import time

import numpy as np

import pandas as pd

from dotenv import load_dotenv

from transformers import (AutoTokenizer, AutoModelForCausalLM, pipeline, BitsAndBytesConfig,

TrainingArguments, Trainer, DataCollatorForLanguageModeling)

from peft import LoraConfig, get_peft_model, PeftModel

from sentence_transformers import SentenceTransformer

import faiss

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain.document_loaders import TextLoader

from datasets import Dataset, load_dataset

from typing import List, Dict, Tuple

# -------------------------- 1. 全局配置(适配罕见病辅助诊断场景,可按需修改)--------------------------

load_dotenv() # 加载环境变量(可选,用于存储敏感路径)

# 1.1 模型配置(Llama 3核心模型,首次运行自动下载,约15G)

MODEL_NAME = "meta-llama/Llama-3.1-8B-Instruct" # 指令版模型,适配诊断问答场景

BASE_MODEL_PATH = "./llama3_rare_disease_base" # 基础模型保存路径

FINETUNED_MODEL_PATH = "./llama3_rare_disease_finetuned" # 微调后模型保存路径

# 1.2 数据配置(罕见病诊疗数据,模拟数据可直接使用,真实数据可替换)

RARE_DISEASE_DATA_PATH = "./rare_disease_data" # 数据存储目录

FINETUNE_DATA_FILE = "rare_disease_finetune.json" # 微调数据集(问题-答案对)

KNOWLEDGE_BASE_PATH = "./rare_disease_knowledge" # 罕见病知识库(诊疗文献、病例)

# 1.3 微调与部署配置(根据硬件调整,确保可运行)

LORA_CONFIG = LoraConfig( # LoRA轻量化微调配置,适配Llama 3

r=8, # LoRA秩,控制微调参数规模

lora_alpha=32,

target_modules=["q_proj", "v_proj"], # Llama 3适配的目标模块

lora_dropout=0.05,

bias="none",

task_type="CAUSAL_LM" # 因果语言模型,适配诊断问答微调

)

DEVICE = "cuda" if torch.cuda.is_available() else "cpu" # 自动选择运行设备

MAX_NEW_TOKENS = 512 # 最大生成文本长度(诊断建议需详细,保留足够长度)

TEMPERATURE = 0.1 # 推理温度,越低越精准(医疗场景需严谨,避免幻觉)

TRAIN_EPOCHS = 3 # 微调轮次(平衡效果与资源,避免过拟合)

BATCH_SIZE = 2 # 微调批次大小(GPU显存不足可改为1)

# -------------------------- 2. 核心功能1:罕见病数据准备(自动生成模拟数据,可替换真实数据)--------------------------

def generate_rare_disease_data():

"""

生成罕见病诊疗模拟数据(适配微调与知识库构建)

包含:1. 微调数据集(症状→诊断建议的问题-答案对) 2. 知识库(罕见病诊疗文献、病例)

企业/医疗机构可替换为真实病例、诊疗指南数据(TXT/JSON格式)

"""

# 确保数据目录存在

os.makedirs(RARE_DISEASE_DATA_PATH, exist_ok=True)

os.makedirs(KNOWLEDGE_BASE_PATH, exist_ok=True)

# 1. 生成微调数据集(15条罕见病辅助诊断问题-答案对,覆盖常见罕见病)

finetune_data = [

{

"question": "患者男,5岁,反复抽搐、发育迟缓、皮肤色素沉着,疑似哪种罕见病?诊断依据是什么?",

"answer": "疑似结节性硬化症(TSC)。诊断依据:1. 核心症状:反复抽搐(癫痫发作)、发育迟缓、皮肤色素沉着(色素脱失斑);2. 结节性硬化症典型表现为多系统受累,神经系统(癫痫、发育迟缓)、皮肤系统(色素脱失斑、面部血管纤维瘤)为常见症状;3. 建议进一步检查:头颅MRI、皮肤活检、基因检测(TSC1/TSC2基因)。"

},

{

"question": "患者女,30岁,进行性肌肉无力、吞咽困难、呼吸困难,病程6个月,疑似哪种罕见病?",

"answer": "疑似肌萎缩侧索硬化症(ALS)。诊断依据:1. 核心症状:进行性肌肉无力、吞咽困难、呼吸困难,符合ALS的进行性神经退行性表现;2. 病程进展较快(6个月),ALS典型病程为进行性加重,累及运动神经元;3. 建议进一步检查:肌电图(EMG)、颈椎MRI、血液生化检查(排除其他肌病)。"

},

{

"question": "新生儿,出生后即出现黄疸持续不退、肝脾肿大、贫血,疑似哪种罕见病?",

"answer": "疑似戈谢病(Gaucher病)。诊断依据:1. 核心症状:新生儿黄疸持续不退、肝脾肿大、贫血,为戈谢病I型典型表现;2. 戈谢病是溶酶体贮积症,因葡萄糖脑苷脂酶缺乏导致,累及肝脏、脾脏、血液系统;3. 建议进一步检查:酶活性检测(葡萄糖脑苷脂酶)、基因检测(GBA基因)、骨髓穿刺。"

},

{

"question": "患者男,10岁,进行性视力下降、视网膜色素变性、共济失调,疑似哪种罕见病?",

"answer": "疑似遗传性痉挛性截瘫(HSP)。诊断依据:1. 核心症状:进行性视力下降、视网膜色素变性、共济失调,符合HSP的神经系统受累表现;2. HSP为遗传性疾病,主要影响脊髓锥体束,导致运动功能障碍、视力异常;3. 建议进一步检查:眼底检查、脊髓MRI、基因检测(SPG基因家族)。"

},

{

"question": "患者女,25岁,反复口腔溃疡、外阴溃疡、眼部炎症,疑似哪种罕见病?",

"answer": "疑似贝赫切特综合征(白塞病)。诊断依据:1. 核心症状:反复口腔溃疡、外阴溃疡、眼部炎症(葡萄膜炎),为白塞病典型三联征;2. 白塞病是自身免疫性罕见病,累及多系统黏膜;3. 建议进一步检查:血常规、血沉、C反应蛋白(CRP)、免疫抗体检测。"

},

{

"question": "患者男,15岁,关节僵硬、脊柱畸形、晨僵超过1小时,疑似哪种罕见病?",

"answer": "疑似幼年特发性关节炎(JIA)。诊断依据:1. 核心症状:关节僵硬、脊柱畸形、晨僵(持续超过1小时),符合JIA的关节受累表现;2. JIA是儿童期罕见自身免疫病,以慢性关节炎为核心,可累及脊柱;3. 建议进一步检查:关节X线、血常规、类风湿因子(RF)、抗核抗体(ANA)。"

},

{

"question": "新生儿,出生后出现喂养困难、呕吐、低血糖,疑似哪种罕见病?",

"answer": "疑似枫糖尿症(MSUD)。诊断依据:1. 核心症状:新生儿喂养困难、呕吐、低血糖,为枫糖尿症典型早期表现;2. 枫糖尿症是氨基酸代谢障碍罕见病,因支链氨基酸脱氢酶缺乏导致,尿液有枫糖浆味;3. 建议进一步检查:血液氨基酸检测、尿液有机酸检测、基因检测(BCKDHA/B/C基因)。"

},

{

"question": "患者女,40岁,进行性记忆力减退、认知障碍、步态异常,病程1年,疑似哪种罕见病?",

"answer": "疑似阿尔茨海默病(早发型,罕见)。诊断依据:1. 核心症状:进行性记忆力减退、认知障碍、步态异常,符合阿尔茨海默病的神经退行性表现;2. 早发型(40岁发病)属于罕见类型,与基因突变相关;3. 建议进一步检查:头颅MRI(海马萎缩)、脑脊液检测(Aβ蛋白、tau蛋白)、基因检测(APP/PSEN1/PSEN2基因)。"

},

{

"question": "患者男,8岁,皮肤出现牛奶咖啡斑、多发性神经纤维瘤,疑似哪种罕见病?",

"answer": "疑似神经纤维瘤病I型(NF1)。诊断依据:1. 核心症状:皮肤牛奶咖啡斑(≥6个)、多发性神经纤维瘤,为NF1典型表现;2. NF1是遗传性罕见病,累及神经系统、皮肤系统;3. 建议进一步检查:头颅CT/MRI、基因检测(NF1基因)、眼科检查(虹膜色素结节)。"

},

{

"question": "患者女,18岁,贫血、乏力、黄疸,实验室检查提示溶血性贫血,疑似哪种罕见病?",

"answer": "疑似遗传性球形红细胞增多症(HS)。诊断依据:1. 核心症状:贫血、乏力、黄疸,伴溶血性贫血实验室表现;2. HS是红细胞膜异常罕见病,典型表现为球形红细胞增多、渗透脆性增加;3. 建议进一步检查:血常规(球形红细胞比例)、红细胞渗透脆性试验、基因检测(ANK1/SPTB/SPTA1基因)。"

},

{

"question": "患者男,6岁,智力低下、特殊面容(眼距宽、鼻梁低)、先天性心脏病,疑似哪种罕见病?",

"answer": "疑似唐氏综合征(21-三体综合征)。诊断依据:1. 核心症状:智力低下、特殊面容(眼距宽、鼻梁低、眼裂小)、先天性心脏病,为唐氏综合征典型表现;2. 唐氏综合征是染色体异常罕见病,因21号染色体多一条导致;3. 建议进一步检查:染色体核型分析、心脏超声。"

},

{

"question": "患者女,35岁,反复发热、皮疹、蛋白尿,疑似哪种罕见病?",

"answer": "疑似系统性红斑狼疮(SLE,罕见亚型)。诊断依据:1. 核心症状:反复发热、皮疹(蝶形红斑)、蛋白尿,符合SLE的多系统受累表现;2. SLE是自身免疫性罕见病,累及皮肤、肾脏、免疫系统;3. 建议进一步检查:抗核抗体(ANA)、抗双链DNA抗体、补体C3/C4、尿常规。"

},

{

"question": "新生儿,出生后即出现呼吸困难、发绀,肺部CT提示弥漫性病变,疑似哪种罕见病?",

"answer": "疑似肺表面活性物质缺乏症(PSD)。诊断依据:1. 核心症状:新生儿呼吸困难、发绀,肺部弥漫性病变,为PSD典型表现;2. PSD是新生儿罕见病,因肺表面活性物质合成不足导致,多见于早产儿;3. 建议进一步检查:肺功能检测、肺表面活性物质水平检测、基因检测(SFTPB/SFTPC/ABCA3基因)。"

},

{

"question": "患者男,20岁,肌肉萎缩、肢体无力,实验室检查提示肌酸激酶升高,疑似哪种罕见病?",

"answer": "疑似杜氏肌营养不良(DMD)。诊断依据:1. 核心症状:男性、20岁前发病、肌肉萎缩、肢体无力,肌酸激酶升高;2. DMD是遗传性肌营养不良罕见病,主要影响男性,进行性肌肉无力;3. 建议进一步检查:肌电图、肌肉活检、基因检测(DMD基因)。"

},

{

"question": "患者女,28岁,头痛、视力模糊、颅内压升高,影像学提示颅内占位,疑似哪种罕见病?",

"answer": "疑似神经鞘瘤(罕见良性肿瘤)。诊断依据:1. 核心症状:头痛、视力模糊、颅内压升高,颅内占位性病变;2. 神经鞘瘤是起源于神经鞘细胞的罕见肿瘤,多为良性,可压迫周围组织导致症状;3. 建议进一步检查:头颅增强MRI、病理活检、基因检测(NF2基因,排除神经纤维瘤病相关)。"

}

]

# 写入微调数据集(JSON格式,可直接用于微调)

import json

finetune_path = os.path.join(RARE_DISEASE_DATA_PATH, FINETUNE_DATA_FILE)

with open(finetune_path, "w", encoding="utf-8") as f:

json.dump(finetune_data, f, ensure_ascii=False, indent=2)

# 2. 生成罕见病知识库(3个TXT文件,涵盖诊疗指南、病例汇总、检查规范)

# 知识库1:罕见病诊疗指南摘要

guideline_text = """罕见病诊疗指南(摘要)

1. 结节性硬化症(TSC):多系统受累,核心症状为癫痫、发育迟缓、皮肤色素脱失斑,确诊需基因检测(TSC1/TSC2)。

2. 肌萎缩侧索硬化症(ALS):进行性神经退行性疾病,核心症状为肌肉无力、吞咽困难、呼吸困难,确诊需肌电图+临床症状。

3. 戈谢病(Gaucher病):溶酶体贮积症,核心症状为肝脾肿大、贫血、黄疸,确诊需酶活性检测+基因检测。

4. 贝赫切特综合征(白塞病):自身免疫性疾病,核心症状为口腔溃疡、外阴溃疡、眼部炎症,确诊需临床症状+免疫检测。

5. 枫糖尿症(MSUD):氨基酸代谢障碍,新生儿期发病,核心症状为喂养困难、呕吐、低血糖,确诊需氨基酸检测。

6. 神经纤维瘤病I型(NF1):遗传性疾病,核心症状为牛奶咖啡斑、多发性神经纤维瘤,确诊需基因检测(NF1)。

7. 杜氏肌营养不良(DMD):男性多见,进行性肌肉无力,肌酸激酶显著升高,确诊需基因检测(DMD)。

8. 诊断原则:罕见病诊断需结合临床症状、实验室检查、影像学检查、基因检测,优先排除常见疾病,再考虑罕见病。"""

# 知识库2:罕见病典型病例汇总

case_text = """罕见病典型病例汇总

病例1:结节性硬化症(TSC),男,5岁,反复抽搐2年,发育落后于同龄儿童,面部有色素脱失斑,头颅MRI提示脑部结节,基因检测TSC1基因突变,确诊为TSC,给予抗癫痫药物治疗,定期复查。

病例2:戈谢病(Gaucher病),女,3个月,黄疸持续不退,肝脾肿大,贫血,酶活性检测提示葡萄糖脑苷脂酶缺乏,基因检测GBA基因突变,确诊为戈谢病,给予酶替代治疗。

病例3:肌萎缩侧索硬化症(ALS),男,35岁,进行性肌肉无力1年,吞咽困难3个月,肌电图提示运动神经元受损,排除其他疾病后,确诊为ALS,给予对症支持治疗。

病例4:枫糖尿症(MSUD),男,7天,喂养困难,呕吐,低血糖,尿液有枫糖浆味,血液氨基酸检测提示支链氨基酸升高,基因检测BCKDHA基因突变,确诊为MSUD,给予饮食干预+酶替代治疗。

病例5:神经纤维瘤病I型(NF1),女,12岁,皮肤可见6个牛奶咖啡斑,颈部有多个神经纤维瘤,眼科检查提示虹膜色素结节,基因检测NF1基因突变,确诊为NF1,定期监测病情。"""

# 知识库3:罕见病检查规范

check_text = """罕见病辅助检查规范

一、基因检测:

1. 适用场景:疑似遗传性罕见病(如TSC、戈谢病、DMD、NF1等),作为确诊核心依据。

2. 常用方法:下一代测序(NGS)、Sanger测序,优先检测已知致病基因。

二、实验室检查:

1. 血液检查:血常规(贫血、感染)、生化检查(肌酸激酶、肝功能、血糖)、免疫抗体检测(自身免疫性罕见病)。

2. 尿液检查:尿液有机酸、氨基酸检测(代谢性罕见病)。

3. 酶活性检测:葡萄糖脑苷脂酶(戈谢病)、支链氨基酸脱氢酶(枫糖尿症)。

三、影像学检查:

1. 头颅CT/MRI:用于神经系统罕见病(如TSC、ALS、神经鞘瘤)。

2. 关节X线/MRI:用于关节受累罕见病(如JIA、HSP)。

3. 肺部CT:用于肺部受累罕见病(如PSD)。

四、其他检查:

1. 肌电图:用于肌肉、神经系统罕见病(如ALS、DMD)。

2. 皮肤活检:用于皮肤受累罕见病(如TSC、NF1)。

3. 骨髓穿刺:用于血液系统罕见病(如戈谢病)。"""

# 写入知识库TXT文件

with open(os.path.join(KNOWLEDGE_BASE_PATH, "guideline.txt"), "w", encoding="utf-8") as f:

f.write(guideline_text)

with open(os.path.join(KNOWLEDGE_BASE_PATH, "case.txt"), "w", encoding="utf-8") as f:

f.write(case_text)

with open(os.path.join(KNOWLEDGE_BASE_PATH, "check.txt"), "w", encoding="utf-8") as f:

f.write(check_text)

print(f"罕见病模拟数据生成完成,微调数据集:{finetune_path},知识库:{KNOWLEDGE_BASE_PATH}")

def prepare_finetune_data(tokenizer) -> Dataset:

"""

准备罕见病微调数据集,适配Llama 3模型微调格式

参数:tokenizer(Llama 3分词器)

返回:格式化后的微调数据集(可直接用于模型微调)

"""

# 检查微调数据集是否存在,不存在则自动生成

finetune_path = os.path.join(RARE_DISEASE_DATA_PATH, FINETUNE_DATA_FILE)

if not os.path.exists(finetune_path):

generate_rare_disease_data()

# 加载数据集(JSON格式,问题-答案对)

dataset = load_dataset("json", data_files=finetune_path)["train"]

# 格式化数据集,添加医疗场景Prompt模板(提升模型诊断适配性)

def format_function(examples):

prompts = [

f"### 临床问题:{q}\n### 罕见病辅助诊断建议:{a}"

for q, a in zip(examples["question"], examples["answer"])

]

# 分词处理,适配Llama 3模型输入长度

tokenized = tokenizer(

prompts,

truncation=True,

max_length=256,

padding="max_length",

return_tensors="pt"

)

# 构建标签(因果语言模型,忽略padding部分)

tokenized["labels"] = tokenized["input_ids"].clone()

tokenized["labels"][tokenized["attention_mask"] == 0] = -100

return tokenized

# 应用格式化函数,生成适配微调的数据集

tokenized_dataset = dataset.map(

format_function,

batched=True,

remove_columns=dataset.column_names

)

print(f"罕见病微调数据集准备完成,共{len(tokenized_dataset)}条数据,适配Llama 3模型")

return tokenized_dataset

# -------------------------- 3. 核心功能2:Llama 3模型加载与轻量化微调--------------------------

def load_llama_base_model() -> Tuple[AutoTokenizer, AutoModelForCausalLM]:

"""

加载Llama 3基础模型,启用量化优化,适配低资源硬件

返回:tokenizer(分词器)、base_model(基础模型实例)

"""

# 4-bit量化配置(降低显存占用,避免OOM错误,适配普通GPU/CPU)

bnb_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_use_double_quant=True,

bnb_4bit_quant_type="nf4",

bnb_4bit_compute_dtype=torch.bfloat16

)

try:

# 加载Llama 3分词器(补充pad_token,避免推理报错)

tokenizer = AutoTokenizer.from_pretrained(MODEL_NAME)

tokenizer.pad_token = tokenizer.eos_token

# 加载基础模型,自动分配设备(GPU优先,无GPU则用CPU)

base_model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME,

quantization_config=bnb_config,

device_map="auto",

trust_remote_code=True,

cache_dir=BASE_MODEL_PATH # 缓存模型,避免重复下载

)

# 禁用梯度计算,节省资源(微调前操作)

base_model.gradient_checkpointing_enable()

print(f"Llama 3基础模型加载成功,运行设备:{DEVICE}")

return tokenizer, base_model

except Exception as e:

print(f"模型加载失败,错误信息:{str(e)}")

print("排查建议:1. 检查网络(首次运行需下载模型) 2. 检查硬件配置 3. 检查依赖版本")

raise e

def finetune_rare_disease_model(base_model, tokenizer, dataset) -> PeftModel:

"""

对Llama 3模型进行轻量化微调(PEFT+LoRA),适配罕见病辅助诊断场景

核心优势:仅训练部分参数,资源占用低,普通GPU即可完成

参数:base_model(基础模型)、tokenizer(分词器)、dataset(微调数据集)

返回:微调后的模型(可直接用于部署)

"""

try:

# 配置LoRA微调,查看可训练参数规模(验证轻量化优势)

peft_model = get_peft_model(base_model, LORA_CONFIG)

peft_model.print_trainable_parameters() # 输出:trainable params: 0.12%(约100万参数)

# 配置微调参数(适配医疗场景,平衡效果与资源)

training_args = TrainingArguments(

output_dir="./llama3_rare_disease_finetune_output", # 微调输出目录

per_device_train_batch_size=BATCH_SIZE,

num_train_epochs=TRAIN_EPOCHS,

logging_dir="./llama3_rare_disease_logs", # 日志目录

logging_steps=5, # 日志输出间隔

learning_rate=2e-4, # 医疗场景微调推荐学习率

weight_decay=0.01, # 防止过拟合

fp16=torch.cuda.is_available(), # 混合精度训练,加速微调

save_strategy="epoch", # 每轮保存模型

save_total_limit=1, # 只保存最新模型

remove_unused_columns=False # 保留必要列,避免报错

)

# 配置数据整理器(适配因果语言模型微调)

data_collator = DataCollatorForLanguageModeling(

tokenizer=tokenizer,

mlm=False # 关闭掩码语言模型,使用因果语言模型

)

# 启动微调(使用Trainer工具,简化微调流程)

trainer = Trainer(

model=peft_model,

args=training_args,

train_dataset=dataset,

data_collator=data_collator

)

print("开始罕见病辅助诊断模型微调(PEFT+LoRA轻量化微调)")

trainer.train()

# 保存微调后的模型(用于后续部署)

peft_model.save_pretrained(FINETUNED_MODEL_PATH)

tokenizer.save_pretrained(FINETUNED_MODEL_PATH)

print(f"微调完成,模型已保存至:{FINETUNED_MODEL_PATH}")

return peft_model

except Exception as e:

print(f"模型微调失败,错误信息:{str(e)}")

print("排查建议:1. 检查GPU显存(微调需额外8G以上) 2. 调整BATCH_SIZE为1 3. 检查数据集格式")

raise e

# -------------------------- 4. 核心功能3:模型部署与罕见病辅助诊断--------------------------

def load_finetuned_model() -> Tuple[AutoTokenizer, pipeline]:

"""

加载微调后的罕见病辅助诊断模型,部署为诊断流水线

返回:tokenizer(分词器)、diagnosis_pipeline(辅助诊断流水线)

"""

try:

# 加载微调后的模型和分词器

tokenizer = AutoTokenizer.from_pretrained(FINETUNED_MODEL_PATH)

base_model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME,

quantization_config=BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_use_double_quant=True,

bnb_4bit_quant_type="nf4",

bnb_4bit_compute_dtype=torch.bfloat16

),

device_map="auto",

trust_remote_code=True

)

# 加载微调权重,合并基础模型与微调权重(提升推理速度)

finetuned_model = PeftModel.from_pretrained(base_model, FINETUNED_MODEL_PATH)

finetuned_model = finetuned_model.merge_and_unload()

# 构建罕见病辅助诊断流水线(文本生成,适配医疗场景)

diagnosis_pipeline = pipeline(

"text-generation",

model=finetuned_model,

tokenizer=tokenizer,

max_new_tokens=MAX_NEW_TOKENS,

temperature=TEMPERATURE,

top_p=0.95,

repetition_penalty=1.1 # 避免生成重复内容,保证诊断建议严谨

)

print("罕见病辅助诊断模型部署完成,可直接用于临床症状诊断")

return tokenizer, diagnosis_pipeline

except Exception as e:

print(f"模型部署失败,错误信息:{str(e)}")

print("排查建议:1. 检查微调模型路径 2. 检查基础模型是否下载完整")

raise e

def build_rare_disease_knowledge_base(embedding_model: SentenceTransformer) -> Tuple[faiss.IndexFlatL2, List[str]]:

"""

构建罕见病知识库向量数据库,用于检索相似病例/诊疗知识,辅助诊断

参数:embedding_model(轻量级向量模型)

返回:index(向量索引)、texts(知识库文本片段)

"""

# 加载知识库TXT文件(LangChain工具,适配医疗文本)

documents = []

for filename in os.listdir(KNOWLEDGE_BASE_PATH):

if filename.endswith(".txt"):

file_path = os.path.join(KNOWLEDGE_BASE_PATH, filename)

loader = TextLoader(file_path, encoding="utf-8")

docs = loader.load()

documents.extend(docs)

# 文本分割(将长文本分割为短片段,提升检索精度,适配医疗文本)

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=150, # 每个片段长度,适配向量模型

chunk_overlap=20, # 片段重叠,避免语义断裂

length_function=len

)

splits = text_splitter.split_documents(documents)

texts = [split.page_content for split in splits] # 提取文本片段

# 文本转换为向量(使用轻量级向量模型,适配医疗文本)

embeddings = embedding_model.encode(texts, convert_to_tensor=False)

embeddings = np.array(embeddings).astype(np.float32)

# 构建faiss向量索引(快速检索相似知识)

dimension = embeddings.shape[1] # 向量维度(all-MiniLM-L6-v2为384维)

index = faiss.IndexFlatL2(dimension)

index.add(embeddings)

print(f"罕见病知识库构建完成,共加载{len(texts)}条诊疗知识片段")

return index, texts

def rare_disease_diagnosis(query: str, diagnosis_pipeline, index: faiss.IndexFlatL2, texts: List[str], embedding_model: SentenceTransformer) -> str:

"""

罕见病辅助诊断主函数:输入患者症状,输出疑似罕见病、诊断依据、建议检查

参数:query(患者症状描述)、diagnosis_pipeline(诊断流水线)、index(向量索引)、texts(知识库文本)、embedding_model(向量模型)

返回:结构化辅助诊断建议(严谨、专业,贴合医疗场景)

"""

# 1. 检索知识库中相似的诊疗知识(Top 3,提升诊断准确性)

query_embedding = embedding_model.encode(query, convert_to_tensor=False)

query_embedding = np.array([query_embedding]).astype(np.float32)

distances, indices = index.search(query_embedding, top_k=3)

# 过滤无效知识(距离过大则视为无关)

similar_texts = []

for i in range(3):

if distances[0][i] < 0.8:

similar_texts.append(texts[indices[0][i]])

if not similar_texts:

return "未检索到相关罕见病诊疗知识,建议补充患者症状或进一步完善知识库。"

# 2. 构建医疗场景Prompt(避免模型幻觉,确保诊断建议基于知识库)

prompt = f"""你是专业的罕见病辅助诊断助手,仅基于以下罕见病诊疗知识库内容,为患者提供精准、严谨的辅助诊断建议。

要求:1. 先明确疑似罕见病名称;2. 详细说明诊断依据(结合患者症状与知识库内容);3. 给出具体的建议检查项目;4. 语言专业、简洁,不添加无关信息,不编造内容。

若知识库内容不足以判断,直接回复“无法明确疑似罕见病,建议进一步完善患者症状或进行全面检查”。

罕见病诊疗知识库内容:

{chr(10).join(similar_texts)}

患者症状描述:{query}

罕见病辅助诊断建议:"""

# 3. 模型生成诊断建议(调用部署的诊断流水线)

response = diagnosis_pipeline(prompt)[0]["generated_text"]

# 提取诊断建议(去除Prompt部分,保留核心内容)

diagnosis = response.split("罕见病辅助诊断建议:")[-1].strip()

return diagnosis

# -------------------------- 5. 核心功能4:模型性能评估(验证辅助诊断效果)--------------------------

def evaluate_diagnosis_model(diagnosis_pipeline, index: faiss.IndexFlatL2, texts: List[str], embedding_model: SentenceTransformer) -> Dict[str, float]:

"""

评估罕见病辅助诊断模型的核心性能,贴合医疗场景需求

评估指标:准确率(诊断正确性)、平均响应时间、平均资源占用

返回:评估结果字典

"""

# 测试用例(覆盖10种常见罕见病,模拟临床真实症状)

test_cases = [

{

"query": "患者男,5岁,反复抽搐、发育迟缓、皮肤色素沉着",

"expected_keywords": ["结节性硬化症", "癫痫", "基因检测"]

},

{

"query": "患者女,30岁,进行性肌肉无力、吞咽困难、呼吸困难",

"expected_keywords": ["肌萎缩侧索硬化症", "肌电图", "运动神经元"]

},

{

"query": "新生儿,出生后即出现黄疸持续不退、肝脾肿大、贫血",

"expected_keywords": ["戈谢病", "酶活性检测", "肝脾肿大"]

},

{

"query": "患者女,25岁,反复口腔溃疡、外阴溃疡、眼部炎症",

"expected_keywords": ["贝赫切特综合征", "免疫抗体检测", "口腔溃疡"]

},

{

"query": "新生儿,出生后出现喂养困难、呕吐、低血糖,尿液有枫糖浆味",

"expected_keywords": ["枫糖尿症", "氨基酸检测", "喂养困难"]

},

{

"query": "患者男,8岁,皮肤出现牛奶咖啡斑、多发性神经纤维瘤",

"expected_keywords": ["神经纤维瘤病I型", "NF1基因", "牛奶咖啡斑"]

},

{

"query": "患者男,20岁,肌肉萎缩、肢体无力,肌酸激酶升高",

"expected_keywords": ["杜氏肌营养不良", "DMD基因", "肌酸激酶"]

},

{

"query": "患者男,6岁,智力低下、眼距宽、鼻梁低、先天性心脏病",

"expected_keywords": ["唐氏综合征", "染色体核型分析", "特殊面容"]

},

{

"query": "患者女,35岁,反复发热、皮疹、蛋白尿",

"expected_keywords": ["系统性红斑狼疮", "抗核抗体", "蛋白尿"]

},

{

"query": "患者男,10岁,进行性视力下降、视网膜色素变性、共济失调",

"expected_keywords": ["遗传性痉挛性截瘫", "脊髓MRI", "视网膜色素变性"]

}

]

correct_count = 0

total_time = 0.0

total_memory = 0.0 # 记录平均内存占用

print("\n" + "="*60)

print("罕见病辅助诊断模型性能评估(临床场景测试)")

print("="*60)

for i, test_case in enumerate(test_cases, 1):

query = test_case["query"]

expected_keywords = test_case["expected_keywords"]

# 记录响应时间与资源占用

start_time = time.time()

diagnosis = rare_disease_diagnosis(query, diagnosis_pipeline, index, texts, embedding_model)

end_time = time.time()

response_time = end_time - start_time

total_time += response_time

# 记录内存占用(验证模型资源优化效果)

memory_usage = torch.cuda.memory_allocated() / (1024 ** 2) if torch.cuda.is_available() else 0.0

total_memory += memory_usage

# 评估准确率(判断诊断建议是否包含所有预期关键词,医疗场景宽松评估)

correct = all(keyword in diagnosis for keyword in expected_keywords)

if correct:

correct_count += 1

# 打印测试结果

print(f"\n{i}. 患者症状:{query}")

print(f" 诊断建议:{diagnosis}")

print(f" 预期关键词:{expected_keywords}")

print(f" 测试结果:{'正确' if correct else '错误'} | 响应时间:{response_time:.2f}s | 内存占用:{memory_usage:.2f}MB")

# 计算评估指标

accuracy = correct_count / len(test_cases) * 100

average_response_time = total_time / len(test_cases)

average_memory_usage = total_memory / len(test_cases)

print("\n" + "="*60)

print(f"📊 评估结果汇总(医疗场景适配性)")

print(f"✅ 测试用例总数:{len(test_cases)}")

print(f"✅ 诊断正确数:{correct_count}")

print(f"✅ 诊断准确率:{accuracy:.2f}%")

print(f"✅ 平均响应时间:{average_response_time:.2f}s")

print(f"✅ 平均内存占用:{average_memory_usage:.2f}MB")

print("="*60)

return {

"accuracy": accuracy,

"average_response_time": average_response_time,

"average_memory_usage": average_memory_usage

}

# -------------------------- 6. 主函数(整合全链路,一键运行,可直接测试)--------------------------

if __name__ == "__main__":

try:

# 1. 加载Llama 3基础模型(核心入口)

tokenizer, base_model = load_llama_base_model()

# 2. 准备罕见病微调数据集(自动生成模拟数据)

finetune_dataset = prepare_finetune_data(tokenizer)

# 3. 执行模型轻量化微调(适配罕见病辅助诊断场景)

finetuned_model = finetune_rare_disease_model(base_model, tokenizer, finetune_dataset)

# 4. 部署微调后的模型,构建诊断流水线

ft_tokenizer, diagnosis_pipeline = load_finetuned_model()

# 5. 加载向量模型,构建罕见病知识库

embedding_model = SentenceTransformer("all-MiniLM-L6-v2")

index, texts = build_rare_disease_knowledge_base(embedding_model)

# 6. 交互式测试(模拟临床场景,输入患者症状,获取诊断建议)

print("\n" + "="*60)

print("罕见病辅助诊断系统(输入'退出'结束测试)")

print("示例输入:患者男,5岁,反复抽搐、发育迟缓、皮肤色素沉着")

print("="*60)

while True:

user_query = input("\n请输入患者症状描述:")

if user_query.strip() == "退出":

print("测试结束,感谢使用!")

break

# 执行辅助诊断

diagnosis_result = rare_disease_diagnosis(user_query, diagnosis_pipeline, index, texts, embedding_model)

print(f"\n罕见病辅助诊断建议:\n{diagnosis_result}")

# 7. 执行模型性能评估,生成评估报告

evaluation_result = evaluate_diagnosis_model(diagnosis_pipeline, index, texts, embedding_model)

except Exception as e:

print(f"\n系统运行失败,错误信息:{str(e)}")

print("排查建议:1. 检查硬件配置 2. 检查依赖版本 3. 检查网络连接 4. 检查数据集格式")

4. 案例总结

上述案例揭示了共性问题:开源大模型在医疗场景中展现了强大的“助理”潜力和灵活的定制优势,尤其在提升效率、规范流程、启发思路上价值明显。然而,其核心痛点始终围绕“可靠性幻觉”、“数据依赖与偏见”、“系统集成复杂度”以及“临床验证与合规的高墙”。从技术原型到真正的临床产品,仍有漫长且充满挑战的道路。

六、局限性的应对策略与优化建议

1. 技术层面优化

- 数据增强与高质量数据建设:采用合成数据生成、跨机构联邦学习等技术,在保护隐私的前提下扩充小众病种数据。建立国家级/行业级高质量的、标注规范的医疗多模态基准数据集。

- 领域自适应与针对性微调:研发更高效的参数高效微调(PEFT) 和领域自适应预训练方法,使模型能用更少的数据,快速适配到特定医院、科室或病种。

- 幻觉抑制与不确定性量化:在推理链中强制引入检索增强生成(RAG),确保回答基于权威、最新的知识源。开发模型“知道自己不知道”的能力,对低置信度输出给出明确警示。

- 人机协同与可解释性增强:设计“人在环路”的交互模式,关键决策必须由医生确认。探索注意力可视化、概念激活向量等技术,为模型决策提供局部解释。

2. 数据层面优化

- 隐私计算技术深度应用:推广联邦学习、差分隐私、安全多方计算在医疗开源模型训练和微调中的应用,实现“数据不动模型动,数据可用不可见”。

- 共建共享的数据生态:在法律法规框架下,探索基于区块链等技术的数据确权与可信交换机制,鼓励医院、高校、企业共建高质量脱敏数据池。

- 标准化与自动化标注流程:推动医疗数据元数据、术语体系的标准化。利用已有模型进行主动学习、半监督学习,降低高质量数据标注的成本。

3. 合规与伦理层面优化

- “合规设计”理念:在模型开发伊始,就将监管要求(如MDR/IVDR, FDA SaMD框架)融入开发生命周期。开发适用于开源模型的可追溯、可验证的合规性工具包。

- 建立责任界定与保险机制:明确在医疗AI应用链条中各方的法律责任。推动建立医疗AI责任险,分散应用风险。确立以临床医生为最终责任主体的原则。

- 构建伦理审查框架:医疗机构设立专门的AI伦理委员会,对AI应用项目进行全流程伦理审查,重点关注公平性、透明度、患者知情同意与隐私保护。

4. 落地与生态层面优化

- 开发低代码/无代码医疗AI平台:基于优秀开源大模型,构建面向临床医生和科研人员的可视化工具平台,通过拖拉拽和配置化方式完成场景适配,极大降低技术门槛。

- 建设医疗垂类开源共同体:鼓励领军医院、高校、科技企业联合发起医疗AI开源基金会,定向孵化、评测和推广高质量的医疗垂类开源模型、工具和数据集。

- 深化“医工结合”与人才培养:建立跨学科联合实验室和人才培养项目。对临床医护人员进行系统的AI素养培训,培养其成为“超级用户”和需求提出者,而非被动接受者。

- 开展前瞻性真实世界研究:以严谨的临床研究方法,评估开源AI工具在实际工作流中对最终患者结局的影响,用证据逐步建立临床信任。

七、未来展望

1. AI开源大模型在医疗行业的发展趋势

- 垂直化与专业化:将涌现更多在细分领域(如病理、眼科、皮肤科、基因组学)深度训练的高质量、轻量化开源模型,性能匹敌甚至超越通用模型。

- 多模态深度融合:未来的医疗开源大模型将原生具备处理“文本-影像-信号-基因组”多模态数据的能力,实现真正意义上的多维度患者数字孪生,支撑综合决策。

- 与医疗设备和系统的原生集成:开源AI能力将作为一种嵌入式模块,直接集成到新一代的医疗影像设备、手术机器人、监护仪和医院信息平台中,实现“出厂即智能”。

2. 局限性突破的关键技术方向

- 隐私保护与开源协同的平衡术:同态加密训练、可信执行环境(TEE)与开源模型的结合将是关键,在保证模型性能的同时,实现训练数据的“绝对隐私”。

- 面向高精度、低数据的医疗模型训练方法:小样本学习、自监督学习、因果推断与医疗知识的深度结合,是突破数据依赖瓶颈,实现高精度、可泛化模型的核心。

- 合规友好的开源生态构建:发展**“可验证的开源”** 和 “合规即代码” 的理念,通过技术手段自动化部分合规验证流程,降低开源模型满足医疗监管的成本。

3. 开源大模型对医疗行业的长期影响

开源大模型不会替代医生,但会重新定义医疗工作。它将成为像“听诊器”、“显微镜”一样的新一代基础性工具,深刻融入医疗的每个环节。其长期影响在于:

- 推动医疗资源均等化:低成本的AI能力将使基层医疗机构也能提供更精准的初步筛查和诊断支持,助力分级诊疗。

- 重塑诊疗模式,提升整体效率:将医生从大量重复性、事务性工作中解放出来,更专注于高价值的临床决策、医患沟通和复杂病例处理。

- 加速精准医疗与医学发现:通过高效挖掘海量多组学数据和真实世界数据,开源AI将成为科学家探索疾病机理、发现新靶点、设计个性化治疗方案的关键加速器。

结论:AI开源大模型为医疗行业带来了一个“民主化”的智能时代,其开放、灵活、可控的特性与医疗行业复杂、严谨、个性的需求既有契合之处,也存在深刻的张力。我们正站在一个充满希望的起点,前方并非坦途。唯有以临床价值为最终锚点,以解决核心局限性为攻关方向,在技术探索、伦理规范、制度创新和生态建设上协同努力,才能让开源智慧的清泉,安全、可靠、可持续地灌溉医疗健康的生命之树,最终惠及每一个人。

🌟 感谢您耐心阅读到这里!

💡 如果本文对您有所启发欢迎:

👍 点赞📌 收藏 📤 分享给更多需要的伙伴。

🗣️ 期待在评论区看到您的想法, 共同进步。

🔔 关注我,持续获取更多干货内容~

🤗 我们下篇文章见~

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献200条内容

已为社区贡献200条内容

所有评论(0)