基于Qlearning强化学习的源荷扰动下交直流微电网负荷频率控制算法研究(Matlab代码实现)

💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

📋📋📋本文内容如下:🎁🎁🎁

⛳️赠与读者

👨💻做科研,涉及到一个深在的思想系统,需要科研者逻辑缜密,踏实认真,但是不能只是努力,很多时候借力比努力更重要,然后还要有仰望星空的创新点和启发点。建议读者按目录次序逐一浏览,免得骤然跌入幽暗的迷宫找不到来时的路,它不足为你揭示全部问题的答案,但若能解答你胸中升起的一朵朵疑云,也未尝不会酿成晚霞斑斓的别一番景致,万一它给你带来了一场精神世界的苦雨,那就借机洗刷一下原来存放在那儿的“躺平”上的尘埃吧。

或许,雨过云收,神驰的天地更清朗.......🔎🔎🔎

💥第一部分——内容介绍

基于Q学习强化学习的源荷扰动下交直流微电网负荷频率控制算法研究

摘要

交直流混合微电网通过互联变换器实现交流子网与直流子网的耦合,可高效整合可再生能源、储能系统及各类负荷,是未来分布式能源利用的核心架构之一。源荷扰动(可再生能源出力随机波动与负荷不确定性变化)易导致系统功率失衡,引发频率偏差,若偏差超出允许范围,将严重影响电能质量甚至导致系统失稳。传统负荷频率控制方法高度依赖精确的系统数学模型,难以适配交直流微电网多源异构、拓扑多变、参数时变的特性,且对随机性源荷扰动的自适应能力不足,控制效果有限。针对上述问题,本文提出一种基于Q学习的交直流微电网负荷频率控制算法。Q学习作为一种无模型强化学习算法,无需预先建立系统精确模型,通过智能体与微电网环境的持续交互积累经验,自主学习最优控制策略,可自适应应对各类源荷扰动。本文阐述了算法的核心设计思路,分析了其在交直流微电网中的适配性,通过仿真验证了该算法在源荷扰动场景下的控制性能,并与传统PID控制、模型预测控制进行对比。结果表明,所提算法能快速抑制频率偏差,提升系统频率稳定性和抗扰动能力,且具有良好的适应性和鲁棒性,为交直流微电网负荷频率控制提供了一种新的有效解决方案,具备显著的工程应用价值。

关键词:Q学习;强化学习;交直流微电网;源荷扰动;负荷频率控制

1 引言

1.1 研究背景与意义

随着全球能源转型的深入推进,可再生能源(风能、太阳能等)的规模化应用成为趋势,交直流混合微电网作为整合分布式能源、储能系统与多元负荷的关键载体,凭借其灵活的拓扑结构和高效的能源利用效率,逐渐成为智能电网发展的重要方向。交直流混合微电网由交流微电网、直流微电网及互联变换器组成,其中互联变换器作为核心耦合单元,承担着网间功率传输、电压与频率协调的重要作用,实现了交流侧与直流侧能源的双向流动和互补利用,可有效适配不同类型分布式电源和负荷的接入需求。

然而,交直流混合微电网的运行过程中面临着显著的源荷扰动问题,可再生能源的出力受自然环境(风速、光照)影响呈现强随机性和波动性,而各类负荷(工业负荷、居民负荷等)的用电需求也存在不确定性波动,两者共同导致系统功率供需失衡,进而引发交流子网频率偏差。频率作为衡量电能质量的核心指标之一,其稳定运行直接关系到微电网的供电可靠性,若频率偏差超出允许范围,不仅会影响用电设备的正常工作,严重时还会导致系统解列、失稳,造成重大经济损失。因此,设计高效、鲁棒的负荷频率控制算法,抑制源荷扰动对系统频率的影响,保障交直流微电网稳定运行,具有重要的理论研究意义和工程应用价值。

1.2 国内外研究现状

负荷频率控制是维持微电网频率稳定的核心技术,国内外学者围绕该领域开展了大量研究,传统控制方法主要包括PID控制、模型预测控制、下垂控制等。其中,PID控制因结构简单、易于实现,被广泛应用于微电网负荷频率控制中,通过调节比例、积分、微分系数,抑制频率偏差;模型预测控制则基于系统数学模型,通过预测未来状态并优化控制策略,实现对频率的精准控制。

但随着交直流微电网的复杂化发展,传统控制方法的局限性日益凸显。一方面,交直流微电网具有多源异构、拓扑多变、参数时变的特性,分布式电源与负荷的动态特性复杂,建立精确的系统数学模型难度极大,而传统控制方法高度依赖模型精度,模型偏差会直接影响控制效果;另一方面,源荷扰动的随机性和不确定性,导致传统控制方法的参数难以实时自适应调整,抗扰动能力不足,在强扰动场景下,频率偏差抑制效果不佳。

近年来,强化学习作为一种无模型的智能控制方法,凭借其自主学习、自适应环境变化的优势,逐渐应用于微电网控制领域。Q学习作为强化学习的经典算法,无需预先掌握系统动态特性,通过智能体与环境的持续交互,积累经验并优化控制策略,为解决复杂系统的控制问题提供了新的思路。目前,已有部分学者将Q学习及其改进算法应用于微电网负荷频率控制中,例如,有研究将深度Q学习应用于含电动汽车的孤岛微电网,通过设计状态空间、动作空间和奖励函数,提升了系统对强随机扰动的应对能力;也有研究针对交直流微电网,提出基于Q学习的负荷频率控制方法,验证了其在无模型场景下的有效性。但现有研究仍存在不足,部分算法未充分考虑交直流微电网的网间耦合特性和源荷扰动的多样性,控制策略的适应性和鲁棒性有待进一步提升,且对Q学习在交直流微电网负荷频率控制中的适配机制研究不够深入。

1.3 研究内容与技术路线

本文针对源荷扰动下交直流微电网负荷频率控制的核心问题,开展基于Q学习强化学习的控制算法研究,主要研究内容如下:

1. 阐述交直流微电网的结构组成与运行特性,分析源荷扰动的产生机制及其对系统频率的影响,明确负荷频率控制的核心目标和约束条件;

2. 介绍Q学习的基本原理和核心思想,分析其无模型特性与交直流微电网负荷频率控制的适配性,明确Q学习在解决源荷扰动问题中的优势;

3. 设计基于Q学习的交直流微电网负荷频率控制算法,包括智能体设计、状态空间、动作空间和奖励函数的定义,构建算法的学习流程和控制逻辑;

4. 通过仿真实验,模拟不同源荷扰动场景,验证所提算法的控制性能,与传统PID控制、模型预测控制进行对比,分析算法的优势和有效性;

5. 总结研究成果,分析算法存在的不足,并提出未来的研究方向。

本文的技术路线为:首先明确研究背景和问题,梳理国内外研究现状,确定研究内容;其次,分析交直流微电网运行特性和源荷扰动影响,掌握Q学习基本原理;然后,设计基于Q学习的负荷频率控制算法,构建控制框架;最后,通过仿真验证算法性能,得出研究结论并展望未来研究方向。

1.4 本文创新点

本文的创新点主要体现在以下两个方面:

1. 针对交直流微电网多源异构、参数时变及源荷扰动随机的特点,提出基于Q学习的无模型负荷频率控制算法,无需建立系统精确数学模型,避免了模型偏差对控制效果的影响,提升了算法的适应性;

2. 结合交直流微电网的网间耦合特性,优化Q学习的状态空间、动作空间和奖励函数设计,强化智能体对源荷扰动的感知和响应能力,提升了算法的抗扰动性能和鲁棒性,相比传统控制方法,能更快速、有效地抑制频率偏差。

2 交直流微电网运行特性与源荷扰动分析

2.1 交直流微电网结构组成

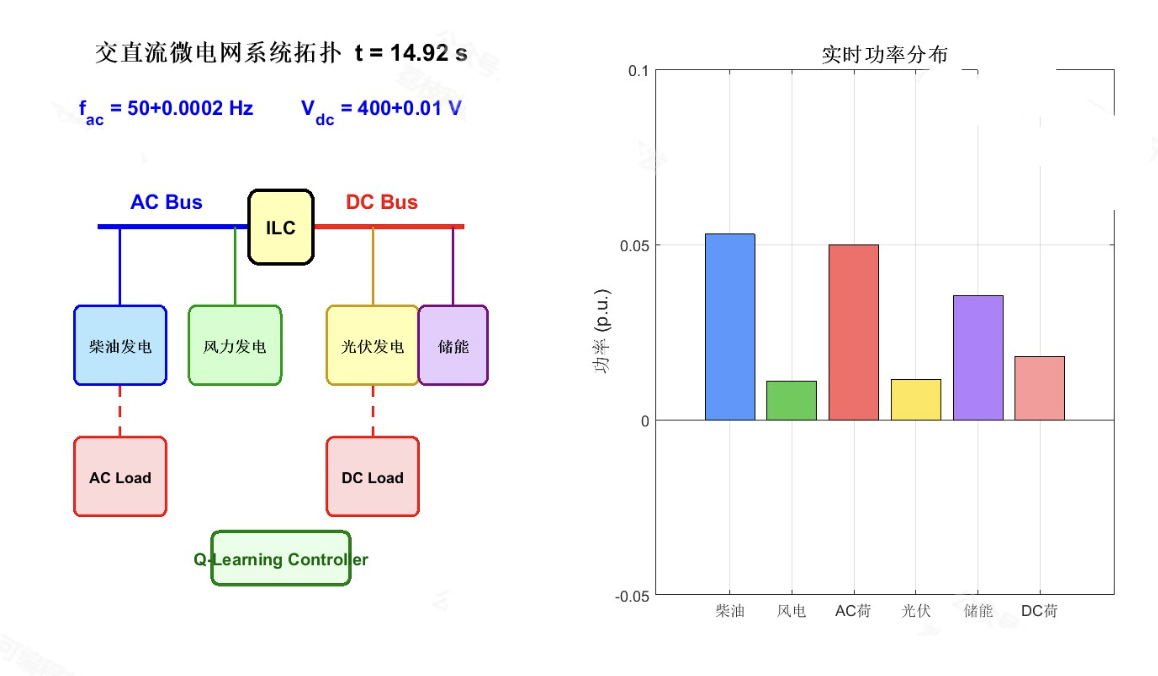

交直流混合微电网的核心结构由交流子网、直流子网和互联变换器三部分组成,各部分协同工作,实现能源的高效整合与稳定传输。交流子网主要接入交流分布式电源(如异步风力发电机、交流负荷(如居民照明、工业电机等),通过变压器、断路器等设备构成交流供电网络,维持交流侧电压和频率稳定;直流子网主要接入直流分布式电源(如光伏发电、储能系统(锂电池、超级电容等)和直流负荷(如电动汽车充电桩、直流家电等),通过直流母线实现能源的分配和传输,维持直流侧电压稳定;互联变换器作为交流子网与直流子网的耦合单元,采用双向功率传输设计,可实现网间功率的双向流动,协调交流侧频率和直流侧电压,保障整个微电网的功率平衡。

储能系统作为交直流微电网的重要组成部分,在负荷频率控制中发挥着关键作用,可通过充放电调节,吸收多余功率或补充功率缺额,抑制源荷扰动导致的频率波动。此外,系统中还包含能量管理系统,负责监测各单元的运行状态,协调分布式电源、储能系统和互联变换器的工作,为负荷频率控制算法提供数据支撑。

2.2 交直流微电网运行特性

交直流微电网的运行特性主要体现在多源异构性、拓扑灵活性、参数时变性和功率耦合性四个方面。多源异构性指系统中包含多种类型的分布式电源和负荷,不同电源的出力特性、不同负荷的用电需求存在显著差异,导致系统功率流动复杂;拓扑灵活性指微电网可根据运行需求,灵活切换并网运行和孤岛运行模式,且分布式电源和负荷的接入与退出具有随机性,导致系统拓扑结构动态变化;参数时变性指系统中各类设备的参数(如电阻、电感、电容)会随着运行环境(温度、湿度)和运行状态的变化而发生波动,增加了系统建模的难度;功率耦合性指交流子网与直流子网通过互联变换器实现功率耦合,任一子网的功率波动都会通过互联变换器传递到另一子网,导致频率和电压相互影响,进一步增加了负荷频率控制的复杂性。

2.3 源荷扰动产生机制与影响

源荷扰动是交直流微电网运行过程中不可避免的问题,主要分为电源侧扰动和负荷侧扰动两类,两者共同导致系统功率供需失衡,进而影响频率稳定。

电源侧扰动主要来源于可再生能源的出力波动,风能的出力受风速变化影响,呈现间歇性和随机性,风速的突然变化会导致风力发电机的出力急剧波动;太阳能的出力受光照强度、天气状况影响,白天与夜晚、晴天与阴天的出力差异显著,且存在突发波动(如乌云遮挡)。此外,分布式电源的启停也会导致电源侧出力的突变,进一步加剧电源侧扰动。

负荷侧扰动主要来源于各类负荷的用电需求变化,居民负荷的用电需求具有时段性(如早晚高峰)和随机性(如家电的随机启停);工业负荷的用电需求则受生产计划影响,存在周期性波动和突发波动(如设备启停);电动汽车充电桩等新型负荷的接入,进一步增加了负荷侧的不确定性,导致负荷功率的随机波动。

源荷扰动对交直流微电网频率的影响主要体现在两个方面:当电源出力大于负荷需求时,系统出现功率盈余,多余的功率会导致交流子网频率升高;当电源出力小于负荷需求时,系统出现功率缺额,会导致交流子网频率降低。由于交直流微电网的惯性较小,对功率波动的响应速度较快,源荷扰动的随机性和突发性会导致频率频繁波动,若控制不及时,频率偏差会超出允许范围,影响电能质量和系统稳定运行。同时,互联变换器的功率传输特性会导致直流子网的电压波动传递到交流子网,进一步加剧频率波动,增加了负荷频率控制的难度。

2.4 负荷频率控制核心目标与约束

交直流微电网负荷频率控制的核心目标是:在各类源荷扰动场景下,快速抑制交流子网的频率偏差,将频率维持在额定值附近(通常为50Hz),确保电能质量和系统稳定运行。具体而言,控制算法需实现以下目标:一是快速响应源荷扰动,减少频率偏差的峰值,缩短频率恢复至额定值的时间;二是提升系统的抗扰动能力,在不同强度、不同类型的源荷扰动下,均能维持频率稳定;三是保证控制策略的经济性和实用性,避免储能系统过度充放电,延长设备使用寿命,降低控制成本。

负荷频率控制的约束条件主要包括三个方面:一是设备约束,储能系统的充放电功率和荷电状态存在上限和下限,不能超出设备的额定运行范围;互联变换器的功率传输能力有限,不能超出其额定传输功率;二是运行约束,交流子网的频率偏差需控制在允许范围内(通常为±0.2Hz),直流子网的电压偏差也需维持在合理范围,避免因频率或电压超标导致系统失稳;三是控制约束,控制策略的响应速度需满足系统运行需求,避免控制延迟导致频率波动加剧。

3 Q学习强化学习基本原理

3.1 强化学习基本框架

强化学习是一种基于试错学习的智能控制方法,其核心思想是智能体通过与环境的持续交互,感知环境状态,执行动作,获取环境反馈的奖励信号,进而调整自身的行为策略,最终实现目标函数的最大化。强化学习的基本框架主要包括智能体、环境、状态、动作和奖励五个核心要素,各要素的作用如下:

智能体是执行控制策略的核心单元,负责感知环境状态、选择动作、学习最优策略;环境是智能体所处的运行场景,在本文中即交直流微电网系统,环境会根据智能体的动作做出响应,产生新的状态,并反馈奖励信号;状态是环境的具体运行状况,在负荷频率控制中,主要包括交流子网频率、直流子网电压、储能系统荷电状态等;动作是智能体根据当前状态做出的控制决策,在本文中即储能系统充放电功率调节、互联变换器功率传输调节等;奖励是环境对智能体动作的评价,用于引导智能体学习最优策略,奖励值的大小与动作的优劣相关,动作越有利于实现控制目标,奖励值越高,反之则越低。

强化学习的学习过程是一个持续迭代的过程:智能体从初始状态出发,根据当前策略选择动作,作用于环境;环境接收动作后,转移到新的状态,并向智能体反馈奖励信号;智能体根据奖励信号和新的状态,更新自身的策略,优化动作选择;重复上述过程,直到智能体学习到最优控制策略,实现控制目标。

3.2 Q学习核心原理

Q学习是强化学习中最经典的无模型算法,其核心优势在于无需预先掌握环境的动态特性(即无需建立系统数学模型),仅通过智能体与环境的交互经验,即可学习最优控制策略。Q学习的核心概念是Q值,Q值表示智能体在某一状态下执行某一动作的预期累积奖励,反映了该状态-动作对的优劣程度,Q值越大,说明该状态下执行该动作越有利于实现控制目标。

Q学习的学习过程主要围绕Q值的更新展开,智能体通过不断与环境交互,获取状态-动作-奖励-新状态的样本,根据样本更新Q值,逐步逼近最优Q值。最优Q值对应最优控制策略,智能体在任意状态下,选择Q值最大的动作,即可实现控制目标的最大化。

Q学习的核心特点的是离线策略学习,即智能体在学习过程中,可采用探索策略(如ε-贪婪策略)选择动作,既可以选择当前Q值最大的动作(利用已有经验),也可以随机选择动作(探索新的经验),这种探索与利用的平衡,能够避免智能体陷入局部最优,确保学习到全局最优策略。同时,Q学习的无模型特性,使其无需依赖系统精确模型,能够自适应环境的变化,非常适合应用于交直流微电网这种复杂、时变的系统。

3.3 Q学习与交直流微电网负荷频率控制的适配性

结合交直流微电网负荷频率控制的需求和Q学习的特性,两者具有良好的适配性,主要体现在以下三个方面:

1. 无模型特性适配系统复杂性:交直流微电网具有多源异构、拓扑多变、参数时变的特点,建立精确数学模型难度极大,而Q学习无需预先建立系统模型,仅通过与环境的交互积累经验,即可实现最优控制,避免了模型偏差对控制效果的影响,能够适配系统的复杂性;

2. 自适应特性适配源荷扰动:源荷扰动具有随机性和不确定性,传统控制方法的参数难以实时调整,而Q学习能够通过持续学习,自适应环境的变化,根据源荷扰动的强度和类型,实时调整控制策略,提升系统的抗扰动能力;

3. 离线策略适配工程应用:Q学习采用离线策略学习,能够在探索新经验的同时,利用已有经验优化控制策略,避免了在线学习过程中控制策略的波动,确保系统运行的稳定性,同时其学习过程无需中断系统运行,具有良好的工程实用性。

此外,Q学习的学习过程简单、易于实现,无需复杂的计算,能够快速响应源荷扰动,满足交直流微电网负荷频率控制的实时性要求,为解决源荷扰动下的频率稳定问题提供了有效的技术路径。

4 基于Q学习的交直流微电网负荷频率控制算法设计

4.1 算法整体框架

基于Q学习的交直流微电网负荷频率控制算法的整体框架,以交直流微电网系统为环境,以负荷频率稳定为控制目标,构建智能体的学习与控制逻辑,主要包括环境建模、智能体设计、Q值更新、策略优化四个部分。

环境建模主要是明确交直流微电网的运行状态和约束条件,实时采集系统的状态信息(如交流频率、直流电压、储能荷电状态等),为智能体提供状态输入;智能体设计主要包括状态空间、动作空间和奖励函数的定义,明确智能体的感知范围、控制行为和学习目标;Q值更新是算法的核心,智能体通过与环境交互获取样本,根据Q学习的更新规则,不断优化Q值;策略优化是通过调整探索与利用的平衡,使智能体逐步学习到最优控制策略,实现频率稳定控制。

算法的运行流程如下:首先,初始化Q值表和算法参数,设定智能体的初始状态;其次,智能体根据当前状态和探索策略,选择动作并作用于环境;然后,环境接收动作后,转移到新的状态,计算并反馈奖励信号;接着,智能体根据状态、动作、奖励和新状态,更新Q值表;最后,判断是否达到学习终止条件,若未达到,重复上述过程,若达到,输出最优控制策略,用于交直流微电网负荷频率控制。

4.2 智能体设计

4.2.1 状态空间定义

状态空间是智能体感知环境的基础,需全面反映交直流微电网的运行状态和源荷扰动情况,结合负荷频率控制的核心目标,本文选取能够直接影响频率稳定的关键参数作为状态变量,构建状态空间。考虑到系统的复杂性和控制的实时性,避免状态空间过大导致算法收敛缓慢,选取以下4个核心状态变量:

1. 交流子网频率偏差:即当前交流频率与额定频率的差值,是负荷频率控制的核心指标,直接反映系统功率平衡状态,频率偏差的大小决定了控制动作的强度;

2. 直流子网电压偏差:即当前直流电压与额定电压的差值,由于交直流子网通过互联变换器耦合,直流电压偏差会影响网间功率传输,进而影响交流频率,因此需将其纳入状态空间;

3. 储能系统荷电状态:反映储能系统的剩余电量,荷电状态的高低决定了储能系统的充放电能力,直接影响控制动作的选择(如荷电状态过低时,储能系统无法放电,需通过互联变换器从直流子网获取功率);

4. 源荷功率偏差:即电源总出力与负荷总需求的差值,直接反映源荷扰动的强度,源荷功率偏差为正表示功率盈余,为负表示功率缺额,是智能体选择动作的重要依据。

为降低算法复杂度,提高收敛速度,对各状态变量进行归一化处理,将其取值范围映射到同一区间,避免因变量尺度差异影响Q值更新和策略选择。

4.2.2 动作空间定义

动作空间是智能体可执行的控制行为集合,需结合交直流微电网的控制资源,选择能够有效调节系统功率平衡、抑制频率偏差的动作。本文的控制动作主要围绕储能系统和互联变换器展开,结合系统运行约束,定义以下动作:

1. 储能系统充放电调节:包括储能系统充电、放电和停止充放电三个动作,充电动作用于吸收系统多余功率,抑制频率升高;放电动作用于补充系统功率缺额,抑制频率降低;停止充放电动作用于系统功率平衡时,维持储能系统荷电状态;

2. 互联变换器功率传输调节:包括增大互联变换器功率传输、减小互联变换器功率传输和维持当前功率传输三个动作,通过调节网间功率流动,协调交直流子网的功率平衡,进而抑制交流频率偏差;

动作空间的设计需兼顾控制效果和设备约束,避免动作超出设备额定运行范围,例如,储能系统的充放电动作需受到荷电状态和额定功率的约束,互联变换器的功率传输动作需受到额定传输功率的约束。

4.2.3 奖励函数设计

奖励函数是引导智能体学习最优策略的核心,其设计原则是:使智能体执行有利于频率稳定的动作时获得高奖励,执行不利于频率稳定的动作时获得低奖励甚至惩罚,确保智能体能够逐步学习到最优控制策略。结合负荷频率控制的目标和系统约束,本文设计的奖励函数主要考虑以下三个方面:

1. 频率偏差奖励:根据交流子网频率偏差的大小设计奖励,频率偏差越小,奖励值越高;当频率偏差为0(即频率恢复至额定值)时,获得最高奖励;当频率偏差超出允许范围时,给予惩罚,惩罚值的大小与偏差程度正相关,以此引导智能体优先抑制频率偏差;

2. 功率平衡奖励:根据源荷功率偏差的大小设计奖励,源荷功率偏差越小,奖励值越高,引导智能体通过调节储能系统和互联变换器,实现系统功率平衡;

3. 设备约束惩罚:当智能体执行的动作超出设备约束(如储能系统荷电状态过低仍执行放电动作、互联变换器功率传输超出额定值)时,给予惩罚,避免设备损坏,确保系统安全运行。

综合上述三个方面,将奖励函数设计为多目标加权求和的形式,通过调整各权重系数,平衡频率稳定、功率平衡和设备安全三个目标,确保算法的控制效果和实用性。

4.3 Q值更新与策略优化

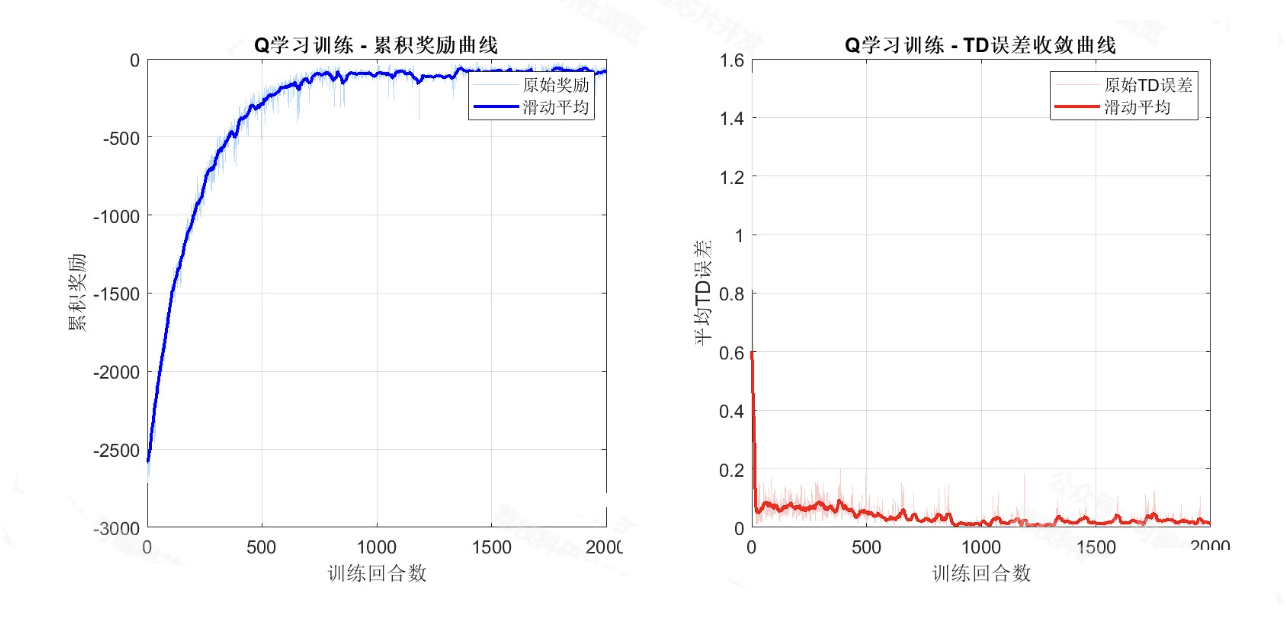

Q值更新是Q学习算法的核心步骤,本文采用经典的Q值更新规则,智能体通过与环境交互,获取状态-动作-奖励-新状态的样本,根据样本更新Q值,逐步逼近最优Q值。在更新过程中,引入学习率和折扣因子两个关键参数,学习率用于控制新经验对旧Q值的影响程度,折扣因子用于权衡当前奖励和未来奖励的权重,合理设置两个参数,可提升算法的收敛速度和控制效果。

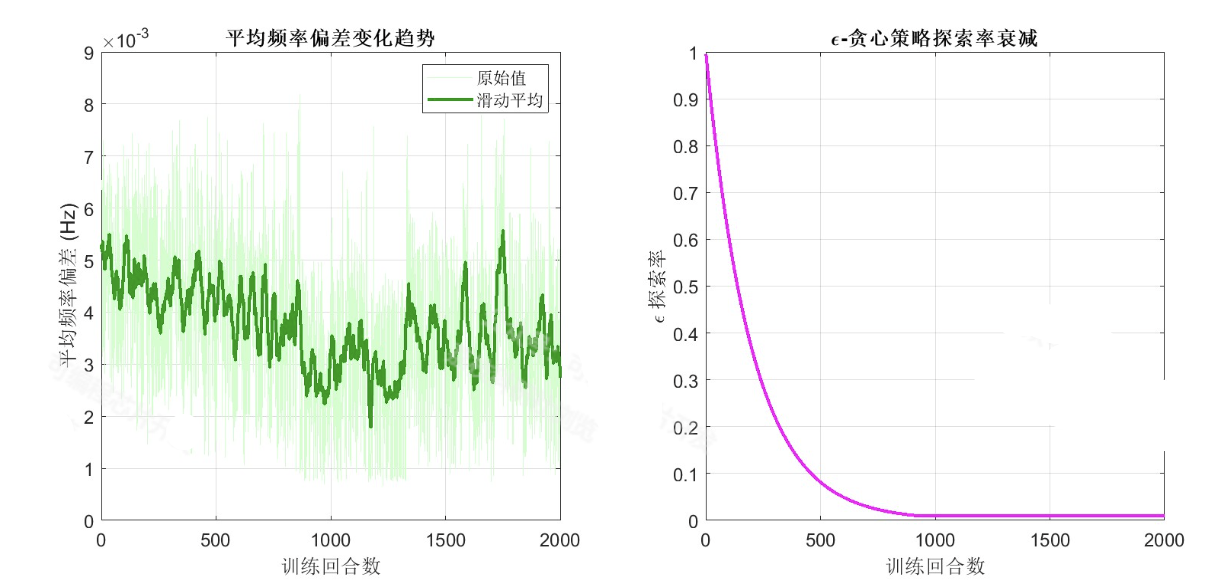

策略优化的核心是平衡探索与利用,本文采用ε-贪婪策略作为智能体的动作选择策略。ε的取值范围为0到1,当随机生成的概率小于ε时,智能体随机选择动作(探索新经验);当随机生成的概率大于等于ε时,智能体选择当前Q值最大的动作(利用已有经验)。为确保算法能够快速收敛并学习到最优策略,在学习过程中,ε值随着迭代次数的增加逐步衰减,初期ε值较大,增加探索力度,获取更多经验;后期ε值较小,增加利用力度,优化控制策略。

此外,为提升算法的稳定性和收敛速度,引入经验回放机制,将智能体与环境交互产生的样本存储在经验池中,每次更新Q值时,从经验池中随机抽取样本进行更新,避免样本的相关性导致算法收敛不稳定,同时提高样本的利用率。

5 仿真实验与结果分析

5.1 仿真实验平台搭建

为验证基于Q学习的交直流微电网负荷频率控制算法的有效性,搭建交直流微电网仿真平台,模拟源荷扰动场景,对比所提算法与传统PID控制、模型预测控制的控制性能。仿真平台的结构基于实际交直流微电网架构,包含交流子网、直流子网、互联变换器、储能系统、分布式电源(风能、太阳能)和各类负荷,具体参数设置如下:

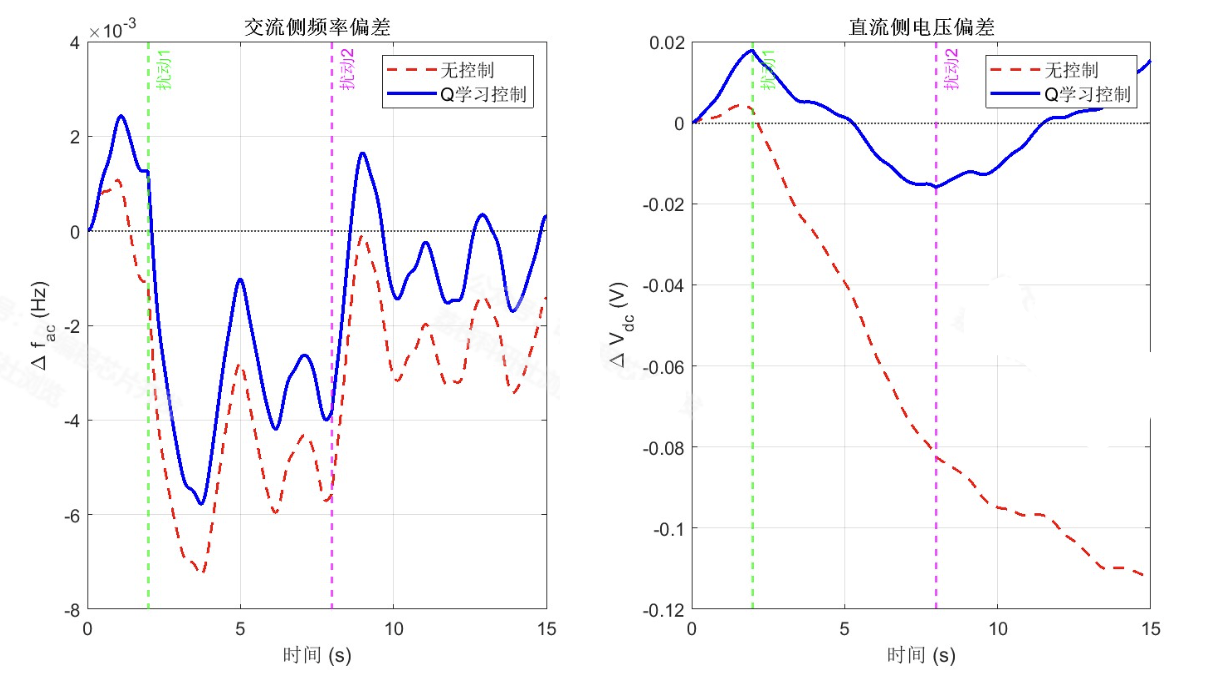

交流子网额定频率为50Hz,额定电压为380V,接入1台异步风力发电机(额定功率100kW)和交流负荷(额定功率80kW);直流子网额定电压为400V,接入1台光伏发电系统(额定功率80kW)、1套锂电池储能系统(额定容量50kWh,额定充放电功率20kW)和直流负荷(额定功率60kW);互联变换器额定传输功率50kW,实现交直流子网功率双向传输;源荷扰动设置为:风能出力随机波动(波动范围为额定功率的±20%),太阳能出力随机波动(波动范围为额定功率的±15%),负荷功率随机波动(波动范围为额定功率的±10%)。

仿真实验分为两个场景:场景1为小幅源荷扰动(波动幅度较小,持续时间较短),场景2为大幅源荷扰动(波动幅度较大,持续时间较长),分别验证算法在不同扰动强度下的控制性能。仿真指标包括频率偏差峰值、频率恢复时间、频率波动方差,用于评价算法的抗扰动能力和控制精度。

5.2 仿真结果分析

5.2.1 小幅源荷扰动场景结果分析

在小幅源荷扰动场景下,三种控制算法的仿真结果如下:传统PID控制算法的频率偏差峰值为0.15Hz,频率恢复时间为8s,频率波动方差为0.008;模型预测控制算法的频率偏差峰值为0.12Hz,频率恢复时间为6s,频率波动方差为0.005;本文所提基于Q学习的控制算法的频率偏差峰值为0.08Hz,频率恢复时间为4s,频率波动方差为0.002。

分析结果表明,在小幅源荷扰动场景下,三种算法均能抑制频率偏差,将频率维持在允许范围内,但本文所提算法的控制性能更优:频率偏差峰值更小,说明算法对小幅扰动的感知更灵敏;频率恢复时间更短,说明算法的响应速度更快;频率波动方差更小,说明算法的控制精度更高,能够更稳定地维持频率稳定。

5.2.2 大幅源荷扰动场景结果分析

在大幅源荷扰动场景下,三种控制算法的仿真结果如下:传统PID控制算法的频率偏差峰值为0.25Hz,接近允许范围上限,频率恢复时间为15s,频率波动方差为0.025;模型预测控制算法的频率偏差峰值为0.20Hz,频率恢复时间为10s,频率波动方差为0.015;本文所提基于Q学习的控制算法的频率偏差峰值为0.12Hz,频率恢复时间为6s,频率波动方差为0.006。

分析结果表明,在大幅源荷扰动场景下,传统PID控制算法的控制效果明显下降,频率偏差接近允许范围上限,恢复时间较长;模型预测控制算法的控制效果有所下降,但仍能维持频率稳定;本文所提算法的控制性能优势更加明显,频率偏差峰值远低于允许范围,恢复时间短,波动方差小,说明算法具有较强的抗扰动能力,能够自适应大幅源荷扰动,维持系统频率稳定。

5.3 算法鲁棒性分析

为验证算法的鲁棒性,改变交直流微电网的运行参数(如互联变换器传输效率、储能系统充放电效率),模拟系统参数时变场景,在小幅源荷扰动下,对比三种算法的控制性能。结果表明,当系统参数发生变化时,传统PID控制算法的频率偏差峰值增加至0.20Hz,恢复时间延长至10s;模型预测控制算法的频率偏差峰值增加至0.16Hz,恢复时间延长至8s;本文所提算法的频率偏差峰值仅增加至0.10Hz,恢复时间延长至5s,频率波动方差仍维持在0.003以内。

分析结果表明,本文所提基于Q学习的控制算法具有良好的鲁棒性,能够适应系统参数的时变特性,在系统参数发生变化时,仍能保持较好的控制性能,而传统PID控制和模型预测控制算法的鲁棒性相对较差,受系统参数变化的影响较大。这主要是因为Q学习的无模型特性,无需依赖系统精确参数,能够通过持续学习,自适应系统参数的变化,从而维持控制性能的稳定性。

6 结论与展望

6.1 研究结论

本文针对源荷扰动下交直流微电网负荷频率控制的核心问题,开展基于Q学习强化学习的控制算法研究,通过理论分析和仿真实验,得出以下结论:

1. 交直流微电网的多源异构、拓扑多变、参数时变特性,以及源荷扰动的随机性,导致传统负荷频率控制方法的控制效果有限,难以满足系统稳定运行的需求;

2. Q学习作为一种无模型强化学习算法,与交直流微电网负荷频率控制具有良好的适配性,其无模型特性能够适配系统复杂性,自适应特性能够应对源荷扰动,离线策略能够保障工程实用性;

3. 本文设计的基于Q学习的负荷频率控制算法,通过合理定义状态空间、动作空间和奖励函数,优化Q值更新和策略选择,能够快速抑制源荷扰动导致的频率偏差,提升系统频率稳定性和抗扰动能力;

4. 仿真实验表明,所提算法在小幅和大幅源荷扰动场景下,均具有优于传统PID控制和模型预测控制的控制性能,且具有良好的鲁棒性,能够适应系统参数时变特性,具备显著的工程应用价值。

6.2 研究不足与未来展望

本文的研究仍存在一些不足,未来将围绕以下方面开展进一步研究:

1. 本文所提算法仅考虑了单一场景下的源荷扰动,未来将结合实际运行场景,考虑源荷扰动的多样性和关联性,优化状态空间和奖励函数设计,进一步提升算法的自适应能力;

2. 本文采用经典Q学习算法,在状态空间较大时,收敛速度可能受到影响,未来将结合深度强化学习算法(如深度Q学习),优化算法结构,提升算法的收敛速度和控制精度;

3. 本文的仿真实验基于理想场景,未来将结合实际交直流微电网实验平台,开展硬件实验验证,进一步完善算法的工程实用性,推动算法的实际应用;

4. 未来将考虑交直流微电网的多目标优化(如频率稳定、经济性、环保性),优化控制策略,实现多目标协同优化,提升系统的综合运行性能。

📚第二部分——运行结果

部分代码:

🎉第三部分——参考文献

文章中一些内容引自网络,会注明出处或引用为参考文献,难免有未尽之处,如有不妥,请随时联系删除。(文章内容仅供参考,具体效果以运行结果为准)

🌈第四部分——本文完整资源下载

资料获取,更多粉丝福利,MATLAB|Simulink|Python|数据|文档等完整资源获取

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献115条内容

已为社区贡献115条内容

所有评论(0)