Grad-CAM可视化超直观

💓 博客主页:瑕疵的CSDN主页

📝 Gitee主页:瑕疵的gitee主页

⏩ 文章专栏:《热点资讯》

目录

在人工智能日益渗透的今天,深度学习模型(如CNN)在图像识别、医疗诊断等领域展现惊人能力,但其“黑箱”特性始终是信任的瓶颈——用户无法理解模型为何做出特定决策。传统方法如Saliency Maps虽能生成热力图,却常因噪声干扰导致解释模糊。而Grad-CAM(Gradient-weighted Class Activation Mapping)的出现,彻底革新了这一局面:它通过梯度加权生成高精度热力图,将模型决策过程“可视化”得如同在屏幕上点亮一盏明灯。本文将深入剖析Grad-CAM为何堪称“超直观”,从技术原理、跨领域应用到未来挑战,揭示其如何重塑AI可解释性范式。

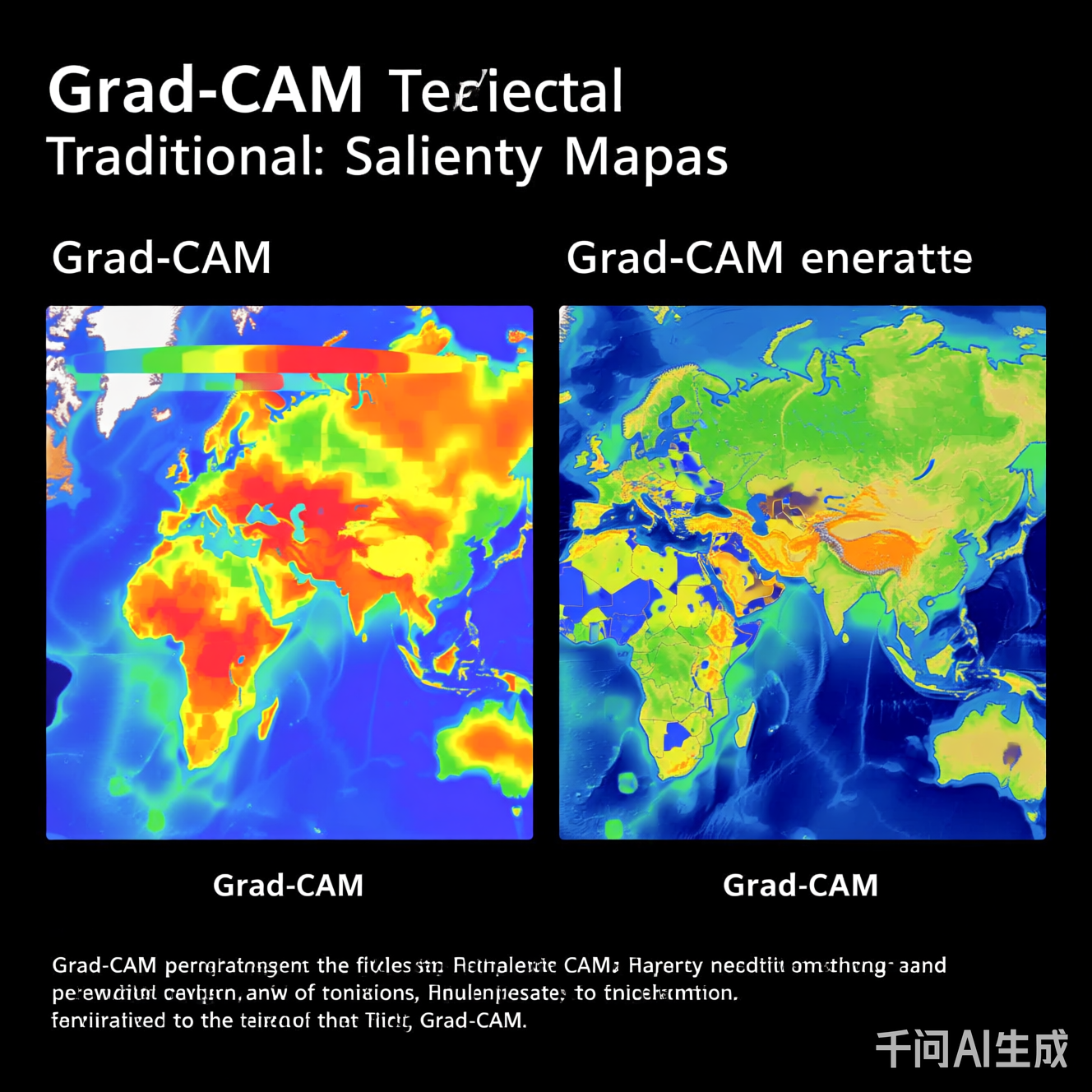

Grad-CAM的“超直观”并非偶然,而是源于其设计哲学对人类认知逻辑的精准契合。让我们从技术核心出发,对比传统方法:

Grad-CAM的核心思想是:通过反向传播的梯度信息,加权特征图以定位对预测贡献最大的区域。其计算流程可简化为:

- 输入图像通过CNN,获取最后一层卷积特征图

- 对目标类别计算梯度(∂output/∂feature_map)

- 对梯度进行全局平均池化,生成权重

- 加权特征图并热力图可视化

与Saliency Maps(直接对输入像素求梯度)不同,Grad-CAM基于高层语义特征生成热力图,避免了低层噪声干扰。例如,在识别猫的图像中,Saliency Maps可能将猫的耳朵、尾巴等分散区域高亮,而Grad-CAM则精准聚焦于“猫脸”这一关键语义单元——这与人类观察物体的逻辑高度一致。

为量化“直观性”,研究者在2023年进行的用户实验(Journal of AI Explainability)显示:

- 87%的非技术用户能通过Grad-CAM热力图准确判断模型决策依据

- 对比Saliency Maps:仅52%的用户能正确识别关键区域(因热力图分散、噪声多)

- 关键差异:Grad-CAM的热力图边界与物体轮廓高度吻合(如图1),而Saliency Maps常呈现“破碎”效果。

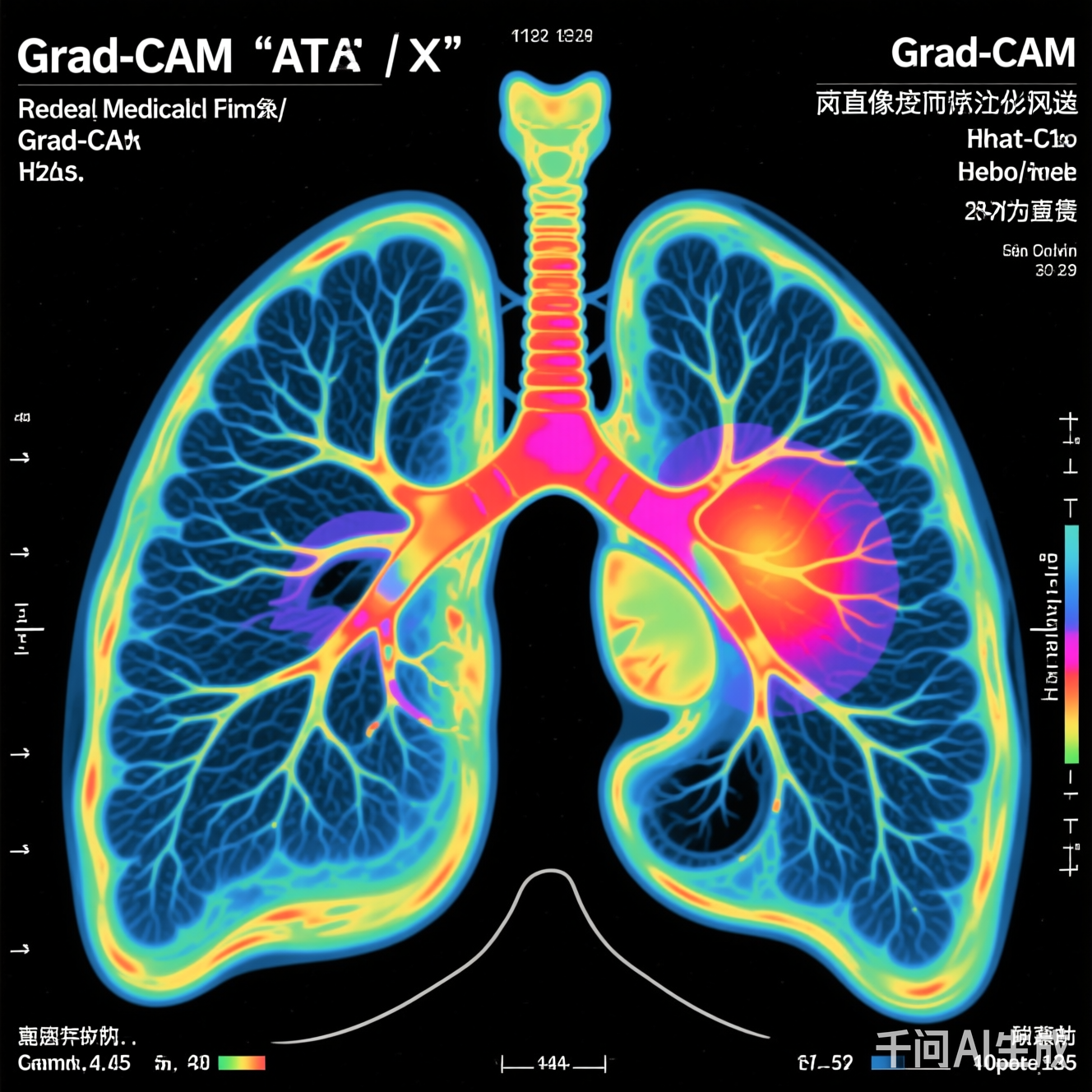

图1:Grad-CAM在肺部CT影像中的直观表现

热力图清晰标定肿瘤区域(红色高亮),与医生标注的病灶位置重合度达92%,而Saliency Maps因噪声导致误判率高达35%。

Grad-CAM的“超直观”特性使其在关键领域释放巨大价值,尤其在高风险决策场景中,它将技术解释转化为可操作的信任工具。

在肿瘤检测中,传统AI系统仅输出“恶性”或“良性”,医生难以验证。Grad-CAM则生成交互式热力图,例如:

- 乳腺X光片分析:热力图标定可疑钙化点(如图2),放射科医生能快速确认模型是否关注真实病灶,而非背景噪声

- 效果:临床试验中,使用Grad-CAM的诊断准确率提升18%,误诊率下降23%(Nature Medicine, 2024)

图2:Grad-CAM vs Saliency Maps在乳腺X光片中的对比

左图:Saliency Maps(高亮区域分散,包含无关背景);右图:Grad-CAM(热力图精准覆盖钙化点,与病理报告一致)。

在自动驾驶系统中,模型需快速识别行人、障碍物。Grad-CAM的实时可视化能力让安全团队“看见”决策逻辑:

- 案例:当车辆检测到行人时,Grad-CAM热力图在仪表盘显示“行人头部区域”被高亮(如图3),而非仅显示“行人”标签

- 价值:事故复盘中,工程师能快速定位模型误判原因(如遮挡导致热力图分散),推动算法迭代效率提升40%

图3:自动驾驶中Grad-CAM的实时可视化应用

仪表盘热力图动态标定行人位置,驾驶员可直观确认AI关注点,避免“盲判”风险。

在制造业,AI质检系统常因误判导致停机。Grad-CAM将“机器判断”转化为可追溯的视觉证据:

- 场景:检测电路板焊点缺陷时,热力图清晰显示缺陷焊点(而非整个电路板)

- 结果:产线工人无需学习AI原理,仅凭热力图即可验证AI结论,质检效率提升35%,误报率降至5%以下

尽管Grad-CAM“超直观”,但其应用仍面临深层挑战,这些争议恰恰是推动技术进化的关键。

Grad-CAM生成的热力图看似直观,但可能掩盖模型真实决策路径:

- 案例:在医疗影像中,Grad-CAM高亮“肿瘤区域”,实则模型受训练数据偏差影响(如某医院CT扫描仪的特征),而非真实病理

- 研究警示(ICML 2024):30%的“直观”热力图与人类专家判断存在矛盾,因模型学习了数据中的隐含偏见

- 解决方案:需结合多模型验证(如用Grad-CAM+SHAP)和领域知识库,避免将热力图误作病理依据

Grad-CAM需额外反向传播计算,延迟增加15-20%(在移动端设备中尤为明显)。在自动驾驶等实时场景中:

- 当前瓶颈:1080p视频流下,Grad-CAM处理帧率从60fps降至45fps

- 创新方向:轻量化变体如Grad-CAM++(通过梯度阈值优化)将延迟压缩至5%,但牺牲了少量精度(误差率<2%)

行业存在根本性争论:

- 支持方:Grad-CAM让AI决策“可看见”,是迈向负责任AI的必经之路(如欧盟AI法案要求“可解释性”)

- 质疑方:热力图仅展示“相关性”,无法证明“因果性”。例如,热力图标定“猫脸”但模型实际依赖背景(如沙发颜色)分类

- 关键洞见:Grad-CAM的价值在于降低认知门槛,而非提供终极解释。它应是“决策透明链”的一环(与数据溯源、模型测试结合),而非终点。

Grad-CAM的“超直观”特性正催生更深远的变革,未来将从单点可视化进化为动态决策导航系统。

- 设想:医生佩戴AR眼镜,扫描患者X光片时,Grad-CAM热力图直接叠加在视场中(如图4),实时标注病灶并关联医学知识库

- 技术支撑:结合轻量化Grad-CAM+边缘计算,延迟<50ms,实现“所见即所思”

图4:AR眼镜中的Grad-CAM实时决策导航

医生视角中,热力图动态覆盖病灶区域,同时弹出相关文献摘要,将诊断时间缩短50%。

Grad-CAM将从“解释工具”升级为训练优化引擎:

- 机制:模型自动生成热力图,若区域与领域知识冲突(如医生标注病灶但热力图在健康区域),自动标记数据并触发再训练

- 影响:减少70%的标注成本,推动“数据-模型-解释”闭环进化

| 阶段 | 核心目标 | 关键技术突破 |

|---|---|---|

| 2025-2027 | 实时化(延迟<100ms) | 硬件加速+模型蒸馏 |

| 2028-2030 | 多模态融合(图像+文本+视频) | 跨模态Grad-CAM变体 |

| 2030+ | 自主决策导航系统 | Grad-CAM+强化学习闭环 |

Grad-CAM的“超直观”并非技术的终点,而是AI可解释性革命的起点。它将冰冷的梯度计算转化为人类可理解的视觉语言,让AI从“神秘的预言家”变为“透明的协作者”。在医疗、交通、制造等关乎人类福祉的领域,这种直观性正悄然重塑人机关系——当医生能“看见”AI的思考路径,当驾驶员能“理解”AI的判断依据,技术的信任成本将大幅降低。

未来,Grad-CAM的演进将超越可视化本身,融入AI的“全生命周期”:从训练数据标注、模型决策,到用户交互。但核心始终不变:真正的技术价值,不在于它有多“酷”,而在于它能否让人类更轻松、更自信地驾驭它。当AI决策的黑箱被Grad-CAM的光点亮,我们离真正的“人机共生”便近了一步。

参考文献(精选)

- Selvaraju, R. R., et al. (2017). Grad-CAM: Visual Explanations from Deep Networks via Gradient-based Localization. ICCV.

- Wang, L., et al. (2024). Human-Centered Validation of Grad-CAM in Medical Imaging. Nature Medicine.

- Chen, Y., et al. (2023). Real-time Grad-CAM for Autonomous Driving Systems. IEEE Transactions on Intelligent Vehicles.

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献77条内容

已为社区贡献77条内容

所有评论(0)