效率飙升33%!UAV-Track VLA:首个无人机具身视觉跟踪VLA模型,零样本泛化城市场景

「面向城市环境的具身视觉跟踪」

目录

二、时空视觉语言编码器:PaliGemma为基底,融合多模态信息

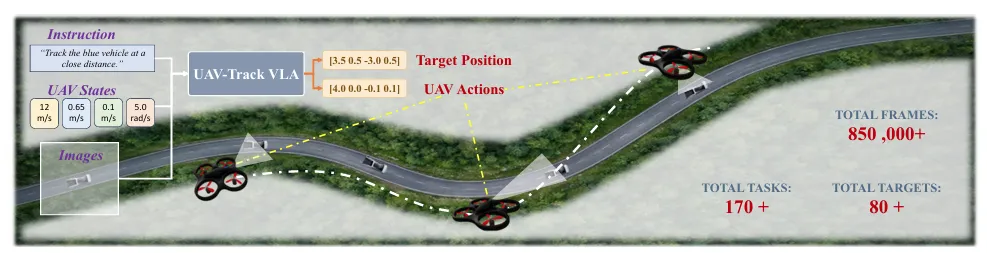

03 UAV-Track Benchmark填补城市场景空白

VLA模型在机器人操控、自动驾驶等领域快速落地,正从固定基座、地面移动平台,向更具机动自由度的空中平台延伸。

但无人机具身视觉跟踪(EVT)一直存在明显断层:

现有方案要么缺少语言语义理解,只能做单一目标跟踪;要么依赖地面机器人的VLA改造,无法适配无人机3D空间机动、高速动态目标的特性;更关键的是,行业内始终缺少面向城市复杂场景的专用数据集与端到端基准,导致语义级跟踪只能停留在仿真或简单场景。

在这样的背景下,北理工、中科院、北邮、北航等团队提出了UAV-Track VLA,给出了一套完整解法。

它没有直接复用现有VLA架构,而是针对无人机连续跟踪、时序冗余、空间几何缺失三大痛点,在π₀.₅基础上重构了时空编码与双分支解码结构,并同步构建了首个城市无人机具身跟踪数据集。

这套方案的价值不在于堆叠模型规模,而在于把VLA真正适配到无人机动态跟踪场景,在零样本泛化与推理效率上取得平衡,为低空语义级自主跟踪提供了可落地的技术路线。

01 无人机主动跟踪的三重现实瓶颈

无人机视觉跟踪已从传统检测跟踪算法,演进到视觉主动跟踪(VAT),但距离真实城市场景的语义化自主作业仍有明显差距。

第一,语义能力缺失。现有VAT系统大多只做视觉到动作的映射,完全丢弃语言模态,无法理解“近距离跟踪蓝色车辆”“远距离跟随行人”这类自然语言指令,难以执行高层语义任务。

第二,平台与场景不匹配。具身视觉跟踪的研究集中在四足、轮式机器人,局限在2D平面运动;而无人机在3D空间机动、目标速度跨度大、城市环境遮挡频繁,现有模型与数据集无法适配。

第三,VLA模型原生缺陷。通用VLA依赖单帧空间特征融合,缺少连续时序建模能力,对高速不规则运动目标特征提取差;同时缺乏空间几何先验,难以把高层语义对齐到无人机连续飞行动作。

这三重瓶颈导致,能听懂指令、自主动态跟踪的无人机,始终无法走出实验室。而UAV-Track VLA的设计初衷,就是针对性解决这三类问题。

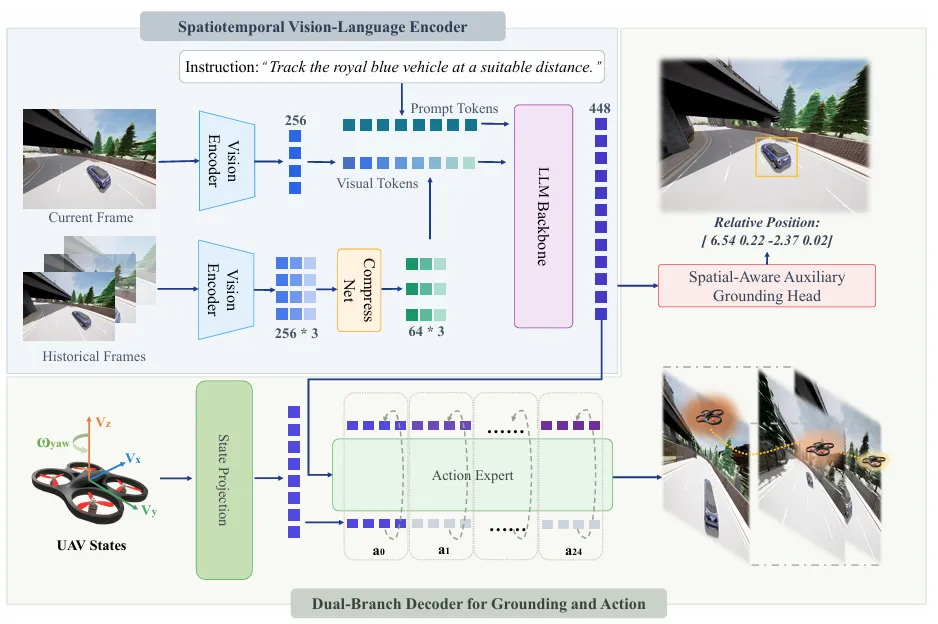

02 时空增强+双分支解码,重构无人机VLA跟踪架构

UAV-Track VLA基于π₀.₅架构改进,核心创新围绕时序压缩、空间引导、解耦解码三个方向,形成适配无人机的端到端跟踪框架。

图| UAV-Track VLA 模型整体架构

一、时序压缩网络:消除多帧冗余,保留动态规律

无人机跟踪需要连续历史帧判断目标运动趋势,但直接堆叠多帧会带来维度爆炸与特征冗余。模型引入轻量时序压缩网络,在视觉特征注入大模型前完成压缩:

- 将单帧256维视觉token压缩至64维;

- 3帧历史特征与当前帧特征拼接,形成448维时序视觉特征;

- 加入可学习位置编码,强化帧间运动依赖捕捉。

这一结构在不损失动态信息的前提下,大幅降低计算量,为后续实时推理打下基础。

二、时空视觉语言编码器:PaliGemma为基底,融合多模态信息

编码器以PaliGemma为核心,分为三部分:

- 视觉编码器:SigLIP提取图像特征,转化为视觉token;

- 语言编码器:对指令进行token化,提供语义引导;

- 时序压缩+大模型融合:压缩后的时序特征与语言token输入Gemma,完成跨模态深度融合。

与通用VLA不同,该编码器优先保留目标运动时序信息,更适合连续跟踪任务。

三、并行双分支解码器:解耦空间定位与动作生成

这是模型最关键的设计。为避免空间定位与连续动作生成的特征冲突,模型采用完全解耦的并行结构:

空间感知辅助定位头

以轻量Transformer构成,预测目标相对无人机的3D位置与偏航角偏差。训练阶段以旁路监督方式,强迫编码器学习精准几何先验,为动作生成提供空间约束。

流匹配动作专家

采用流匹配架构,将离散步预测转化为连续状态空间流场拟合,直接输出25步连续位移序列,完美匹配无人机高频连续控制需求。总损失函数为空间定位损失与动作流匹配损失加权:

其中 为监督空间定位,

为监督连续动作生成,在训练中同时优化跨模态对齐与动作合理性。

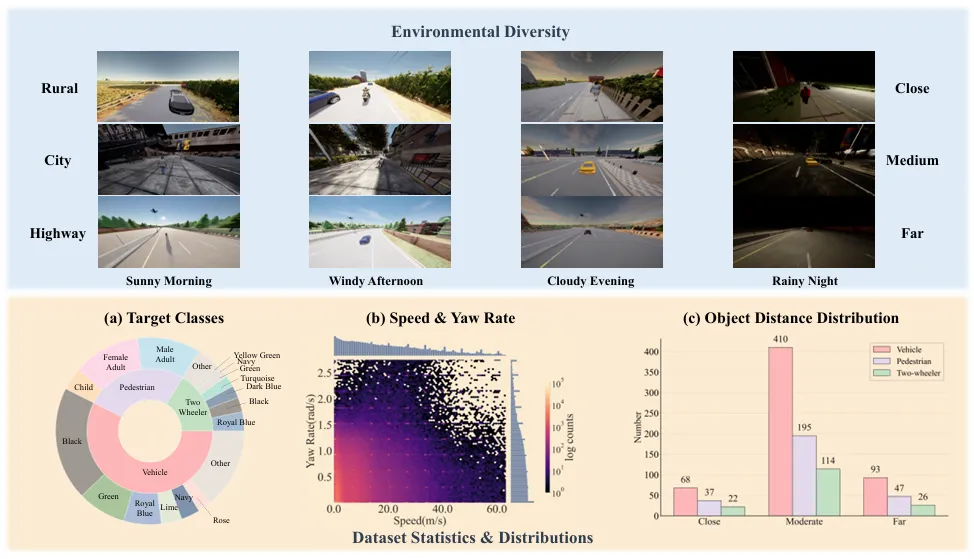

03 UAV-Track Benchmark填补城市场景空白

模型的落地离不开专用数据。团队基于CARLA构建了首个城市环境无人机具身跟踪数据集,填补了行业空白。

图| UAV-Track 数据集多维度多样性概览以及数据集统计分布

数据集规模与多样性

- 总帧数:892,756帧;

- 任务数:176个细粒度跟踪任务;

- 目标种类:85类,涵盖车辆、行人等城市典型目标;

- 场景覆盖:乡村、城市、高速,晴、风、阴、雨、昼夜,近中远三种距离。

数据采集策略

采用专家演示+自动扩增混合策略:

- 专家操控采集高质量轨迹;

- 人工势场法(APF)自动采集并加入随机扰动,提升模型恢复能力与闭环鲁棒性。

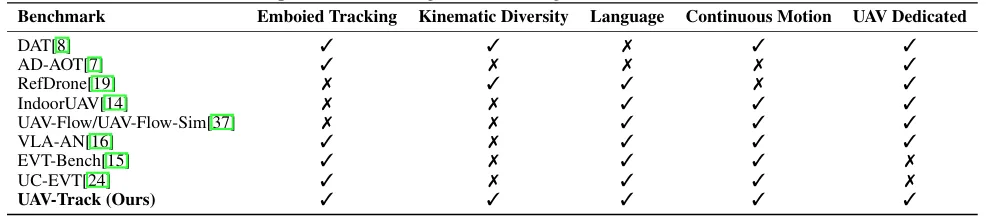

与现有基准对比,它是首个同时支持自然语言指令与4自由度连续运动的专用无人机具身跟踪基准,场景泛化性与任务通用性大幅领先。

图| 现有无人机跟踪与具身 AI 基准对比

04 实验验证:性能、泛化、效率三维度全面领先

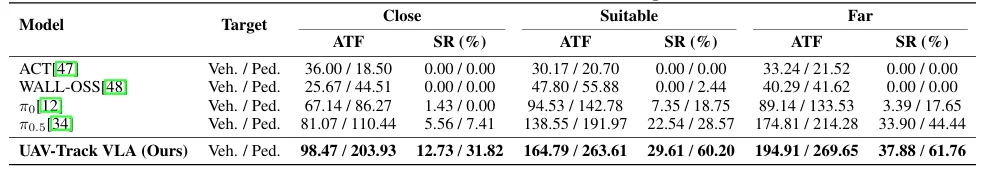

实验在CARLA中完成,以成功率(SR)、平均跟踪帧数(ATF)、推理时延为核心指标,对比ACT、WALL-OSS、π₀、π₀.₅等基线。

已知地图性能

在已训练场景中,UAV-Track VLA全面领先:

图| 已知地图量化结果

- 远距离行人跟踪:SR=61.76%,ATF=269.65帧;

- 远距离车辆跟踪:SR=37.88%,ATF=194.91帧;

在近、中、远三种距离约束下,均大幅超越π₀.₅。

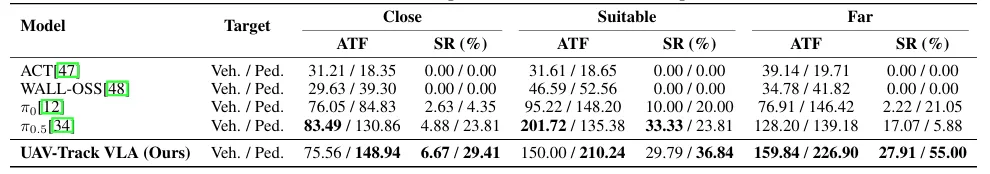

未知地图零样本泛化

在完全未见过的城镇场景中,模型依然保持稳定:

图| 未知地图零样本性能

- 远距离行人跟踪:SR=55.00%,ATF=226.90帧;

- 远距离车辆跟踪:SR=27.91%,ATF=159.84帧;

证明其具备极强的场景迁移能力,可直接部署到陌生城市环境。

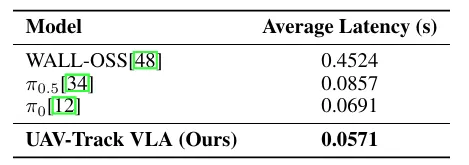

推理效率

图| 推理效率对比

单步推理时延仅0.0571秒,相比π₀.₅的0.0857秒降低33.4%,满足无人机实时控制需求。效率提升主要来自时序压缩网络,在保留时序信息的同时消除冗余。

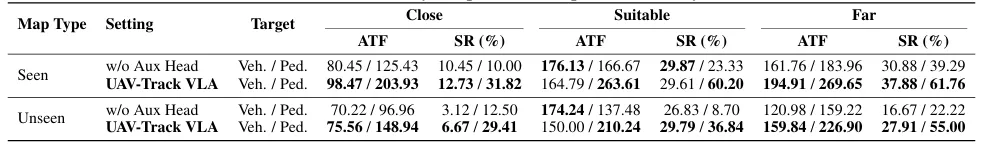

消融实验

图| 空间辅助头消融实验

空间辅助头的作用

移除后,远距离行人跟踪SR从61.76%降至37.88%,ATF从269.65降至183.96,证明空间几何先验对精准跟踪至关重要。

时序压缩的作用

无时序压缩时,特征冗余导致时延上升、精度下降,验证了该模块在精度与效率间的平衡作用。

05 优势、局限与行业价值

核心优势

- 首次实现VLA在无人机具身跟踪的落地,填补城市场景语义跟踪的技术空白;

- 双分支解耦设计,解决空间定位与连续动作的特征冲突,提升跟踪精度;

- 时序压缩+流匹配,在保证精度的同时实现33.4%时延降低,满足实时性;

- 专用基准开放,为后续研究提供统一评测标准。

现存局限

- 仅支持静态初始场景,无法处理突发动态障碍物;

- 未建模目标旋转与复杂姿态,对姿态变化大的目标跟踪稳定性不足;

- 依赖仿真数据,仿真到现实的迁移差距仍需实物验证;

- 反手/遮挡场景性能偏弱,相机视野受限导致部分姿态下跟踪丢失。

行业价值

UAV-Track VLA的意义不止于让无人机听懂指令跟踪目标,更在于建立了一套VLA适配空中机器人的标准化路线:

- 面向低空经济,可直接用于物流无人机目标跟随、安防无人机语义巡逻、交通无人机违章监测;

- 为VLA从地面向空中、从简单操作向动态连续任务延伸提供了可复用范式;

- 开放的数据集与基准,将加速无人机具身AI的学术与工业进展。

06 总结

UAV-Track VLA没有追求花哨的模型架构,而是回归无人机跟踪的本质问题:如何让模型听懂语言、看清时序运动、输出稳定连续动作。通过时序压缩网络、空间感知辅助头、双分支解耦解码三大改进,它让VLA模型真正适配城市动态跟踪场景,并配套构建了行业首个专用基准。

在低空智能化加速的今天,这套方案证明:VLA模型不再只属于地面机器人,只要完成针对性的时空重构与几何引导,就能在高机动、高动态的无人机平台上实现可靠的具身智能。

尽管在动态环境适应、姿态建模、虚实迁移等方面仍有提升空间,但UAV-Track VLA已经为语义级自主无人机提供了清晰的技术路径。未来随着实物部署与主动感知融合,无人机将真正实现“听懂指令、自主跟踪、全域适应”。

Ref

论文标题:UAV-TRACK VLA: EMBODIED AERIAL TRACKING VIA VISION-LANGUAGE-ACTION MODELS

论文地址:https://arxiv.org/abs/2604.02241

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献44条内容

已为社区贡献44条内容

所有评论(0)