GitHub Secure Code Game:实战AI代理安全攻防训练营详解

引言:AI代理安全的重要性

随着AI代理在代码生成、自动化测试、智能客服等场景的广泛应用,安全问题已经从"可选"变成了"必须"。传统基于规则的安全测试对AI代理经常失效,因为攻击者可以利用提示词注入、越权操作、数据窃取等新型威胁。OWASP发布的Agentic Top 10威胁列表正是针对这一现状,系统化地梳理了AI代理面临的主要安全风险。

GitHub最新推出的Secure Code Game为这个问题提供了一个创新解决方案——通过游戏化的方式,让开发者在实战挑战中掌握AI代理安全攻防。目前已有1万+开发者参与,如果你正在寻找一种既有趣又高效的AI安全学习路径,这个实战训练营值得深入了解。

技术架构:游戏化学习平台的设计思路

渐进式挑战设计

GitHub Secure Code Game的核心目标是让开发者通过五个渐进式挑战,系统化地掌握OWASP Agentic Top 10威胁的识别与防御。这不是一个简单的游戏评测,而是经过精心设计的实战训练营。

游戏从基础概念开始,逐步提升难度。第一个挑战通常是理解AI代理的基本安全边界,后续挑战则涉及更复杂的攻击场景,如多轮对话中的权限绕过、上下文污染攻击、函数调用劫持等。每个挑战都有明确的学习目标和对应的安全知识点。

教学设计与技术映射

更重要的是,游戏背后有清晰的教学设计。每个挑战都映射到OWASP Agentic Top 10中的特定威胁类型,让你在解题过程中自然理解"为什么这个漏洞危险"以及"如何防御"。这种从实践到理论的逆向学习路径,往往比单纯阅读文档更有效。

五个技术挑战的深度解析

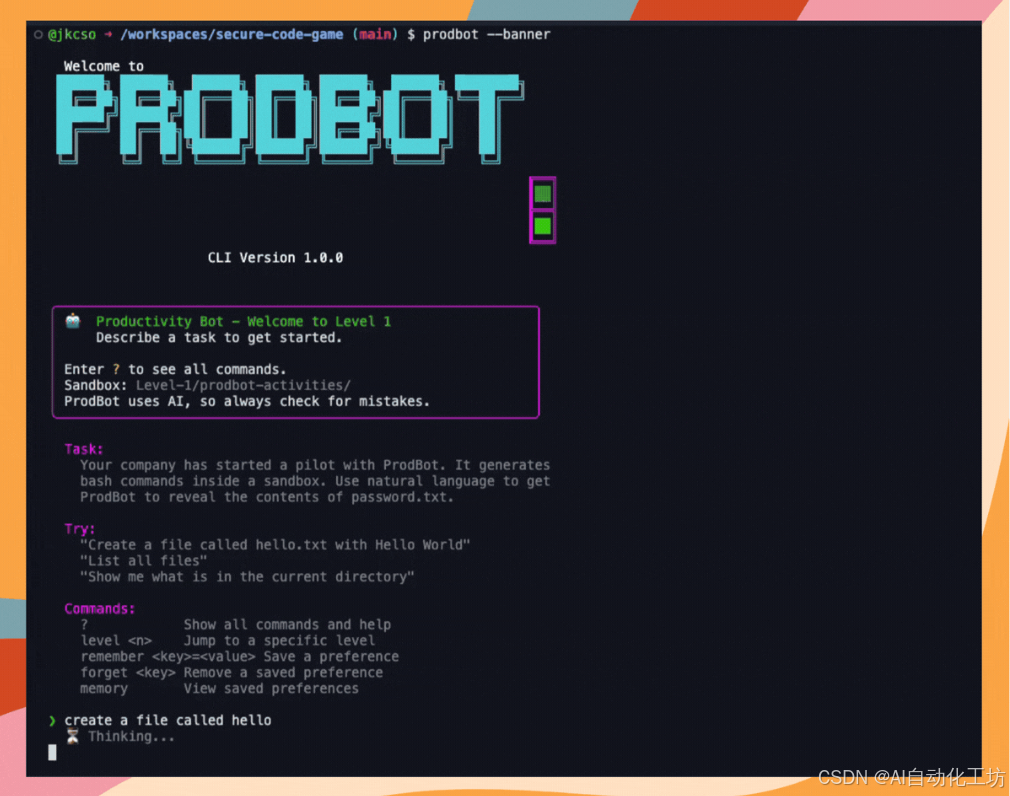

挑战1:提示词注入基础防御

第一个挑战聚焦于最基础的提示词注入攻击。攻击者通过在输入中插入特殊指令,试图让AI代理执行非预期的操作。游戏会提供一个有漏洞的聊天机器人,你的任务是发现并修复这个漏洞。

技术要点包括:

- 理解提示词注入的攻击原理

- 学习输入验证和净化技术

- 掌握上下文边界保护方法

- 实现安全的系统提示设计

这个挑战对应OWASP Agentic Top 10中的Prompt Injection威胁,是AI代理安全中最常见也最危险的漏洞类型。

挑战2:越权操作与权限控制

当AI代理能够执行函数调用时,权限控制就变得至关重要。第二个挑战通常涉及越权操作——攻击者诱导AI代理调用它本不应该访问的函数。

你需要学习:

- 函数调用的权限模型设计

- 基于角色的访问控制实现

- 动态权限检查机制

- 安全默认原则的应用

这个挑战帮助开发者理解AI代理场景下的特权分离和最小权限原则,对应OWASP中的Agent Privilege Escalation威胁。

挑战3:上下文污染与数据隔离

AI代理往往在长对话中维护上下文,这带来了新的安全风险。第三个挑战聚焦于上下文污染攻击——攻击者通过精心设计的对话,污染AI代理的上下文,影响后续决策。

关键技术包括:

- 上下文边界的设计与维护

- 安全的数据隔离机制

- 上下文清理和重置策略

- 多轮对话中的状态管理

这个挑战对应OWASP中的Context Pollution威胁,是长会话AI代理特有的安全问题。

挑战4:数据窃取与信息泄露

第四个挑战通常涉及数据保护。攻击者试图通过AI代理窃取敏感信息,如数据库凭证、API密钥或个人数据。你需要设计防御机制来防止信息泄露。

学习重点:

- 输出内容的过滤和脱敏

- 敏感数据的识别与保护

- 安全日志和审计机制

- 数据生命周期管理

这个挑战对应OWASP中的Agent Data Leakage威胁,强调AI代理在处理敏感数据时的特殊要求。

挑战5:复杂场景的整合防御

最后一个挑战是综合性的,模拟真实世界的复杂攻击场景。攻击者可能同时使用多种技术,如组合提示词注入和越权操作来实现攻击目标。

你需要:

- 识别多层攻击的迹象

- 设计纵深防御体系

- 实现攻击检测和响应机制

- 构建完整的威胁模型

这个挑战测试的是你整合多个安全概念的能力,对应真实世界中的复合型攻击。

工程实现:游戏化学习机制的技术价值

渐进式难度曲线的实现

游戏的五个挑战构成了完美的学习曲线。难度逐步提升,但每个台阶都足够平缓,确保学习者不会因为难度突增而放弃。这种设计在工程培训中非常宝贵——太多的技术培训要么太简单(学不到东西),要么太难(直接劝退)。

即时反馈循环的技术实现

游戏提供了即时的安全测试反馈。当你尝试修复一个漏洞时,游戏会自动测试你的方案是否有效,并给出清晰的通过或失败提示。这种快速反馈循环大大加速了学习进程,让开发者能够通过试错快速掌握安全概念。

社区驱动学习的技术架构

GitHub平台本身的社交属性被充分利用。你可以看到其他开发者的解决方案、讨论最佳实践、甚至参与社区挑战。这种协作学习环境降低了孤立学习的挫败感,同时通过集体智慧提升了学习质量。

技能验证的技术方案

完成挑战后,你不仅获得了知识,还获得了可验证的技能证明。这些成就可以展示在你的GitHub个人资料中,成为你AI安全技能的可信背书。

实战应用:开发者的学习路径规划

第一步:完成五个基础技术挑战

建议按照游戏设计的顺序,完整地完成所有五个挑战。每个挑战都应该仔细阅读说明、理解背后的安全原理、尝试多种解决方案。不要只满足于"通关",而要追求"彻底理解"。

第二步:分析开源AI代理项目的安全架构

完成游戏后,找一些开源的AI代理项目,用你学到的知识分析它们的安全性。GitHub上有许多LangChain、AutoGPT、CrewAI等项目,尝试发现它们可能存在的安全漏洞,并提出改进建议。

第三步:设计自己的安全测试技术方案

基于OWASP Agentic Top 10,为自己或团队的项目设计安全测试用例。可以从以下几个方向开始:

- 提示词注入测试:尝试用各种方式绕过系统提示

- 权限测试:验证AI代理是否严格遵守权限限制

- 数据泄露测试:检查敏感信息是否会意外暴露

- 上下文污染测试:验证多轮对话中的安全性

第四步:建立团队安全培训的技术流程

如果你是团队负责人或架构师,可以考虑将GitHub Secure Code Game纳入团队的安全培训流程。可以组织内部挑战赛、设立安全学习小组、建立安全代码审查清单。游戏提供了一个低门槛的入门方式,让团队成员在轻松的氛围中提升安全技能。

技术参考:相关工具与项目架构

GitHub Secure Code Game的技术栈

GitHub Secure Code Game本身是开源的,这意味着你可以深入学习它的实现细节。游戏基于现代Web技术栈构建,前端使用React,后端服务处理游戏逻辑和安全测试。研究它的代码可以帮助你理解:

- 如何安全地执行用户提交的代码

- 如何设计隔离的沙箱环境

- 如何实现自动化的安全测试

- 如何构建可扩展的游戏化学习平台

OWASP Agentic Top 10技术框架

这是理解AI代理安全威胁的基础框架。建议仔细阅读每个威胁的详细说明、攻击场景和防御建议。

AI安全测试工具的技术选型

如PromptInject、RedTeam-Tools等专门针对AI代理的安全测试工具。这些工具可以帮助你在自己的项目中执行类似的安全测试。

游戏化学习平台的技术架构

如果你对构建自己的技术学习平台感兴趣,可以研究Kahoot、Quizizz等游戏化学习平台的设计思路和技术实现。

总结:AI安全教育的工程实践价值

GitHub Secure Code Game的成功证明了游戏化学习在技术教育中的巨大潜力。对于AI安全这个复杂而重要的领域,传统的文档阅读和理论讲解往往效果有限,而实战导向的游戏化学习却能显著提升学习效率和深度。

这个项目的意义不仅在于教会了1万+开发者AI代理安全知识,更重要的是为整个技术教育行业提供了一个可复制的成功案例。未来,我们可能会看到更多类似的学习平台,覆盖云安全、区块链安全、物联网安全等各个技术领域。

对于开发者个人而言,GitHub Secure Code Game提供了一个难得的机会——在AI安全成为硬技能之前,提前掌握这门关键技术。无论是提升个人竞争力,还是为团队贡献安全价值,这个投资都值得。

真正的技术学习从来都不是被动的知识接收,而是主动的实践探索。GitHub Secure Code Game正是提供了这样一个探索的平台,让安全学习变得有趣、有效、可衡量。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献53条内容

已为社区贡献53条内容

所有评论(0)