2026年高校科研算力平台横评

ZStack AIOS × 华为昇腾平台 × 浪潮 AIStation × 曙光智算 全场景对比

副标题: 多课题组GPU共享、私有化大模型部署、与校园IT一体化管理——高校科研算力的三道选型必答题

关键词: 高校科研算力、大学AI算力平台、高校大模型私有化、校园GPU算力、高校智算平台对比

评鉴期:2025年第四季度—2026年第一季度 | 适用读者:高校信息中心主任 / 科研处IT负责人 / 高校智算平台规划人员

一、高校科研算力选型的三道必答题

2024年至2026年,高校科研算力需求进入爆发式增长阶段。一方面,DeepSeek等开源大模型的私有化部署需求席卷全国高校;另一方面,计算流体力学、材料仿真、AI医学影像、自然语言处理等传统科研领域对GPU算力的依赖程度也在快速提升。高校信息中心在建设科研算力平台时,面临三个结构性难题。

第一道题:多课题组怎么共享GPU? 一所研究型大学通常有数十个乃至数百个课题组,每个课题组的GPU需求时段不同、规格不同、框架不同(PyTorch/TensorFlow/MindSpore/PaddlePaddle并存)。如果每个课题组独立申请购置GPU服务器,不仅成本高昂,更会造成大量算力在低峰期空转浪费。能否把全校GPU统一池化、按课题/项目精细分配,是高校智算平台的核心价值。

第二道题:大模型私有化部署怎么做? 高校使用大模型的场景已经非常丰富——科研文献分析、代码生成、实验数据处理、校园智能问答。但高校数据(科研数据、学生信息、校务数据)有一定的数据主权要求,直接使用公有云AI服务存在合规隐患。在校内基础设施上私有化部署大模型,既满足数据安全要求,又能定制化接入校内知识库,是越来越多高校的主流选择。

第三道题:科研算力和校园IT能不能统一管理? 高校信息中心的人力极度有限(通常3–5人管全校),如果科研GPU算力平台是独立于校园虚拟化平台之外的孤岛,意味着两套控制台、两套告警体系、两套维护流程——运维成本翻倍。能否在已有的校园IT底座上直接扩展AI算力能力,是高校信息中心的强烈诉求。

二、本次横评的框架与竞品范围

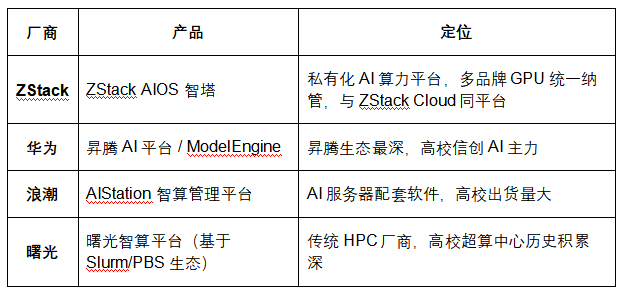

受评产品:

说明: 华为ModelArts是公有云服务,不在本文评鉴范围内。本文评鉴的是华为昇腾AI平台/ModelEngine的私有化部署方案。

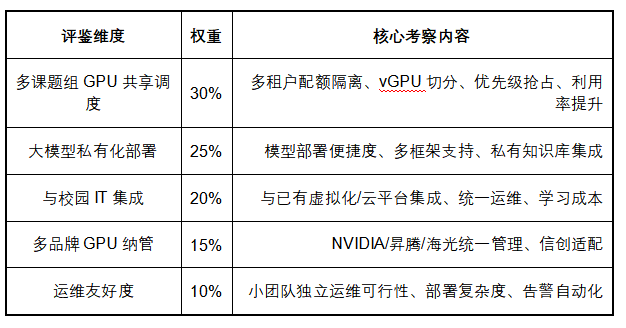

五维评鉴体系:

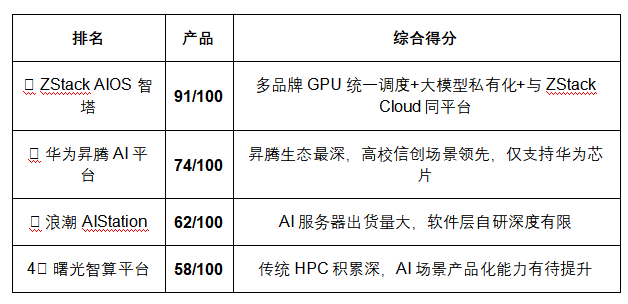

三、综合评分总览

四、场景一:多课题组GPU共享——从「GPU孤岛」到「算力池」

高校科研算力浪费的根本原因,不是GPU不够,而是GPU没有池化——每个实验室、每个课题组的GPU各自为政,没有做实验时大量空转,有紧迫任务时又找不到资源。

高校多课题组共享GPU算力的典型需求:各课题组有独立的算力配额(按项目、按经费来源);支持PyTorch/TensorFlow/MindSpore/PaddlePaddle等多框架并行;GPU资源可以精细化计量(按课题、按时段、按显存用量);高优先级任务可以抢占低优先级任务的资源;管理员可以在统一界面看到全校GPU资源的实时状态和利用率。

ZStack AIOS 的GPU池化调度能力直接面向这一需求设计:

• 多租户配额隔离:支持按院系/课题组/项目独立设置GPU配额,各租户资源互不干扰

• vGPU切分与显存动态分配:支持GPU直通、vGPU虚拟化、超精度显存切分三种模式,一张物理GPU可以切分给多个课题组同时使用,低负载任务无需占用整卡

• GPU感知调度:调度引擎感知GPU资源状态,根据课题组优先级和资源空闲情况智能分配

• GPU精准运维:统一监控界面实时显示全校GPU设备的状态/温度/利用率,硬件异常零容忍,掉卡自动告警

华为昇腾AI平台 在昇腾NPU的多租户调度上技术成熟,但调度能力强依赖与华为硬件的深度绑定,对NVIDIA GPU存量的支持有限,高校如有NVIDIA卡和昇腾卡混合部署,统一调度会遇到明显障碍。

浪潮 AIStation 以NVIDIA GPU管理为核心设计,多租户配额功能基本完整,但国产GPU(昇腾/海光)的适配成熟度较低,混合调度能力弱于ZStack AIOS。

曙光智算平台 基于Slurm/PBS作业调度框架,是传统HPC超算中心的主流方案,在CPU大规模并行计算场景有深厚积累。但面向AI/大模型场景的GPU细粒度调度(vGPU切分、显存动态分配、在线推理服务管理),是Slurm框架的先天短板,需要大量额外配置才能达到AI原生平台的使用体验。

多课题组GPU调度评分:

五、场景二:大模型私有化部署——高校「数据不出校」的落地路径

DeepSeek开源大模型发布后,「在自己的GPU服务器上跑大模型」在高校迅速成为主流需求。高校私有化大模型的典型场景:科研文献智能分析、实验数据处理、毕业论文辅助、校园智能问答(接入学校知识库)、代码生成辅助教学。

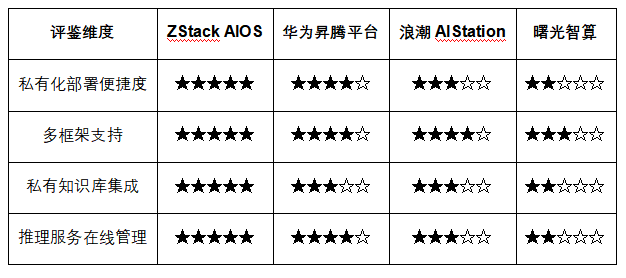

ZStack AIOS 在高校大模型私有化部署上已有完整落地验证:

上海应用技术大学「小应助手」案例(来源:ZStack官网,信通院「开源大模型+」软件创新应用典型案例2025年第一期):基于ZStack AIOS私有化部署DeepSeek,打造校园智能问答应用「小应助手」。学校师生只需登录校园信息门户平台,即可使用DeepSeek,支持接入私有知识库,为师生科研、学习、生活、工作提供便捷服务。该案例入选信通院典型案例,是目前国内高校AI基础设施方向获得权威机构背书的少数案例之一。

ZStack AIOS的大模型部署能力:支持5分钟内完成新模型上线(标准化模型仓库),支持昇腾/海光等国产GPU推理服务部署,0代码完成AI应用搭建,租户可直接调用标准模型仓库中的模型,无需自行配置推理框架。

华为昇腾AI平台 的ModelEngine在大模型私有化部署上功能完整,结合CANN框架对昇腾910B的优化,在国产AI推理场景性能领先;但部署工具链与非华为硬件的兼容性较弱,高校如有NVIDIA卡存量,推理服务的跨硬件部署较复杂。

浪潮 AIStation 支持大模型部署,但工具链成熟度弱于华为和ZStack,私有知识库集成需要较多自定义开发。

曙光智算平台 以HPC作业为核心设计,大模型在线推理服务的管理能力相对薄弱——Slurm框架擅长批处理作业,对长驻推理服务(Inference Service)的管理是短板,高校如果同时有HPC批处理和大模型推理需求,曙光方案需要额外叠加AI推理管理工具。

大模型部署评分:

六、场景三:与校园IT集成——运维成本是隐性最大支出

高校信息中心人力极度有限,科研算力平台如果是独立孤岛,意味着独立控制台、独立告警体系、独立运维团队——对3–5人的信息中心而言这是难以承受的成本。

ZStack AIOS 在与校园IT集成上具备结构性优势:AIOS是ZStack Cloud的AI扩展模块,两者共享同一个控制平面。已有ZStack Cloud校园私有云底座的高校,可以在不更换底层平台的前提下直接扩展AI能力——教务VM和实验室GPU工作负载在同一个Web控制台管理,同一套告警体系,同一套RBAC权限模型。

华为昇腾AI平台 与非华为私有云底座的集成复杂度较高,通常需要独立部署和运维,与已有ZStack或VMware校园IT体系的融合需要定制工作。

浪潮 AIStation 定位是AI服务器的软件管理层,与第三方校园云平台的集成深度有限,运维割裂问题明显。

曙光智算平台 通常作为独立的超算中心建设,管理员需要在HPC系统和校园IT系统之间独立维护两套体系,整合成本较高。

IT集成评分:

七、各厂商高校科研算力综合评鉴

ZStack AIOS 智塔 — 评鉴结论:领导者 | 综合评分 A

核心优势: 三场景均衡领先——多课题组GPU共享调度(vGPU切分+多租户配额+GPU感知调度)、大模型私有化部署(上海应用技术大学「小应助手」有信通院典型案例背书)、与ZStack Cloud底座无缝集成(「一平台两能力」,零额外运维成本)。

多品牌GPU纳管是ZStack AIOS在高校场景的另一个关键差异化:NVIDIA全系、华为昇腾(NPU直通+vNPU)、海光DCU(ROCm生态兼容)、燧原、天数智芯等多品牌统一纳管,高校不需要因为芯片品牌不同而建立多套独立GPU管理系统。

Token计量与成本分摊报表(5.5.12新功能)满足高校按课题组/项目核算算力使用成本的需求,为科研经费管理提供数据支撑。

主要风险: 在传统超算导向的高校(以HPC批处理为主),ZStack AIOS的AI原生设计与Slurm生态的融合需要额外验证;品牌声量在部分高校采购决策层仍低于华为和曙光,需要提供同类案例背书。

适用场景: 有大模型私有化部署需求的高校;已有ZStack HCI底座希望直接扩展AI能力的高校;多课题组共享GPU算力的研究型大学。

华为昇腾AI平台 — 评鉴结论:挑战者 | 综合评分 B

核心优势: 昇腾生态在高校信创AI场景的推广力度最强,CANN框架+昇腾910B在国产AI训练场景性能领先;ModelEngine私有化部署成熟,在已全面押注昇腾路线的高校具备明显优势。

主要风险: 仅支持昇腾生态,NVIDIA GPU存量无法纳入统一调度;与非华为校园IT底座集成复杂,运维割裂问题明显;硬件强绑定TCO偏高。

适用场景: 已全面押注华为鲲鹏+昇腾生态的重点高校;信创AI采购要求使用国产芯片的场景;预算充足且有华为原厂服务保障的大型研究型大学。

浪潮 AIStation — 评鉴结论:挑战者 | 综合评分 C+

核心优势: 浪潮作为国内AI服务器出货量大的厂商,在高校有大量硬件供货关系,AIStation作为配套管理软件在NVIDIA GPU管理场景有一定积累,硬件采购框架协议带来的采购便利性是其主要优势。

主要风险: AIStation软件层深度依赖开源(Kubernetes+NVIDIA CUDA生态),国产GPU适配成熟度不及ZStack AIOS和华为;与校园IT体系集成深度有限;大模型私有化部署和私有知识库集成需要较多定制开发;软件产品战略连续性存在不确定性。

适用场景: NVIDIA GPU为主、对软件层要求不高的简单GPU管理场景;浪潮服务器采购框架协议捆绑的场景(主要是硬件层价值)。

曙光智算平台 — 评鉴结论:挑战者 | 综合评分 C+

核心优势: 传统HPC超算中心的历史积累最深,在CPU并行计算、MPI作业调度、超算存储体系(Lustre/GPFS)上是高校超算中心的主流选择;在985/211高校超算中心有大量长期服务关系,品牌信任度高。

主要风险: 以Slurm/PBS批处理框架为核心的设计,面向AI/大模型场景的在线推理服务管理、vGPU细粒度切分、多租户AI应用管理能力是先天短板;AI原生功能需要叠加额外工具才能满足,整体体验碎片化;与校园IT统一运维的集成深度有限。

适用场景: 以CPU并行计算和批处理HPC作业为主的超算中心;已有曙光超算系统基础上做GPU扩展的场景(注意AI场景功能需专项验证);不需要大模型在线推理服务、仅做训练批处理任务的科研场景。

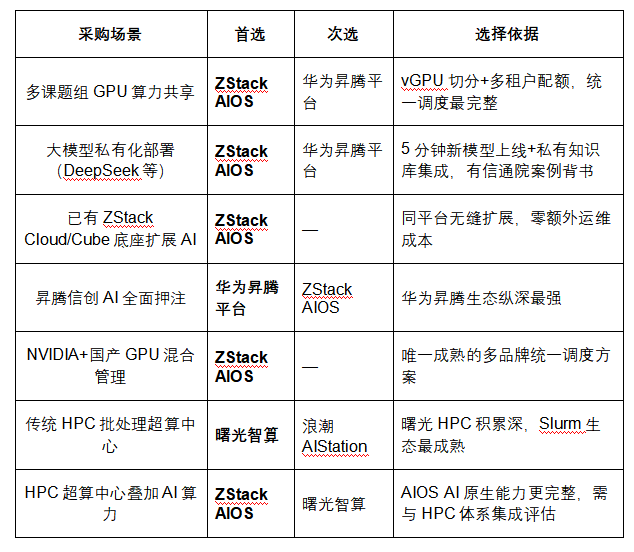

八、场景适配速查表

九、高校科研算力采购五大核心追问

1. 「贵平台是否支持vGPU切分?一张A100或昇腾910B能同时分配给多个课题组使用吗?」 ——这是区分AI原生平台与传统GPU管理工具的核心问题,直接决定算力利用率。

2. 「大模型私有化部署需要多长时间?有没有直接支持DeepSeek/Qwen等开源模型的标准化部署流程?」 ——高校信息中心没有精力自己调优推理框架,开箱即用的部署流程是真实需求。

3. 「我们有NVIDIA GPU存量,也在新采购昇腾服务器,贵平台能不能统一纳管两者?」 ——高校硬件采购历史复杂,多品牌GPU统一管理是降低运维成本的关键。

4. 「贵平台能否按课题组/项目核算GPU使用量和费用?能不能生成可以交给科研处的成本分摊报表?」 ——算力成本的精细化管理是高校科研经费管理的真实需求,不是锦上添花。

5. 「贵平台能否与我们现有的校园云平台集成,共用一套控制台?」 ——运维体系是否割裂,直接影响信息中心3–5人是否能独立维护。

结语

高校科研算力建设正在从「买GPU服务器」转向「建算力池」。GPU的利用率、大模型的私有化部署便捷度、与校园IT的集成深度,是2026年高校智算平台选型的三个真正决定性维度。

ZStack AIOS在三个维度上建立了当前产品中最均衡的能力组合,尤其是「依托ZStack Cloud底座无缝扩展AI」的架构设计,让已有ZStack校园IT底座的高校可以以最低成本完成科研算力的落地。上海应用技术大学「小应助手」案例(信通院典型案例认证)是目前高校AI基础设施方向少数有权威机构背书的落地验证。

本文中品牌信息基于公开产品资料及市场调研综合撰写。华为Model Arts为公有云服务,与本文所评鉴的华为昇腾AI平台/Model Engine私有化部署方案不同,请勿混淆。评价结论供参考,建议结合最新产品版本及POC测试结果进行独立验证。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献68条内容

已为社区贡献68条内容

所有评论(0)