TASK04 | Reasoning Kindom流形假设——高维数据的隐秩序

机器学习的核心假设之一是:相似的样本应该有相似的标签(即 “近邻假设”)。

- 低维空间中,距离近的样本大概率标签相同,因此 kNN、聚类、深度学习等算法可以基于距离进行学习;

- 高维随机空间中,距离失去区分度,“近邻” 不再有意义 —— 算法无法通过距离判断样本的相似性,自然无法从随机数据中学习到任何规律。

只有当数据存在低维流形结构(即高维数据实际分布在一个低维子空间上)时,距离才会重新获得意义 —— 这也是降维算法(PCA、t-SNE、流形学习)和深度学习的核心出发点。

高维空间里面,随机数据是无法被学习的。

高维空间的 “维度灾难”(Curse of Dimensionality) 中关于距离度量的关键特性:在高维空间中,随机数据的任意两点间距离会趋向于相等,导致距离失去区分样本的能力。

一、直观理解:高维空间的 “均匀稀释” 效应

假设我们有一组随机分布的样本(无任何规律,服从均匀分布或正态分布),每个样本有 d 个特征(即 d 维空间)。

1. 低维场景

在 2 维或 3 维空间中,随机样本的分布是 “稀疏且不均匀” 的:有的样本靠得近(距离小),有的样本离得远(距离大)。此时欧氏距离可以有效区分样本的 “近邻关系”,比如我们能轻松找到一个点的最近邻和最远邻。

2. 高维场景

当维度 d 不断增大时,样本的每个特征维度都会为其位置贡献一个独立的 “坐标分量”。对于随机数据,这些分量是相互独立的,导致:

任意两个样本的距离会随着维度增加而单调递增;

不同样本对之间的距离差异会越来越小,最终收敛到一个固定的常数。

你以为数据是随机散布在高维空间的。它不是。它挤在一个薄薄的曲面上。

这不只是"需要更多数据"这么简单。更根本的是:在高维空间里,距离这个概念失去了意义——所有点之间的距离都趋于相等,"近邻"变得无法区分。

这就是为什么很多在低维有效的算法(k-NN、聚类)在高维下效果很差。而流形假设(见下文)恰好提供了一个出路:真实数据不是均匀散布在高维空间里的,它有低维结构。

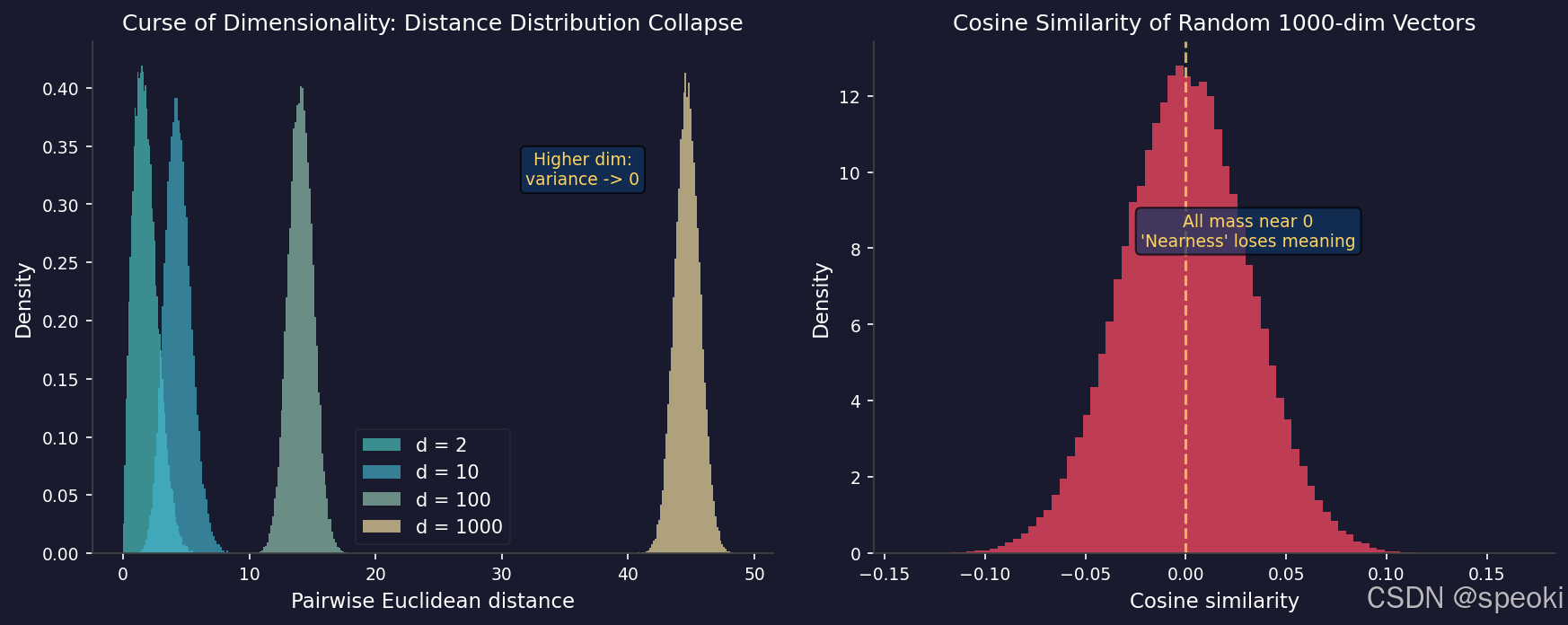

在高维空间里,所有点之间的距离都趋于相等。最近邻和最远邻变得几乎一样远。基于距离的相似性度量——余弦相似度、欧氏距离、k-NN 分类——在高维下全部失效,因为”近”这个概念丧失了辨别力。

如果你随机初始化两个 1000 维向量,它们的余弦相似度几乎一定接近零。不是因为它们语义相反,而是因为在 1000 维里,随机向量几乎一定正交。

正交意味着什么? 两个向量正交,即 u⃗⋅v⃗=0\vec{u} \cdot\vec{v}=0u⋅v=0,在几何上意味着它们彼此垂直、互不相关——一个向量在另一个向量方向上的投影为零。在低维里,正交是一种特殊关系,需要刻意构造。在高维里,正交是默认状态,是随机的必然结果。

回响一:专家系统的概念空间。 第二章里,专家系统用离散符号表示知识——“是哺乳动物”、“有翅膀”、“会飞”,每个符号是一个原子,概念之间的关系必须显式写进规则。从高维几何的角度重新看这件事:每个离散符号,相当于在某个正交基上放了一个维度。"猫"和"狗"在符号系统里没有内在关联,它们是两个独立的 token,正如两个随机单位向量几乎必然正交。专家系统的本质困境——无法自动捕获概念之间的连续相似性——从这个角度看,就是因为它把世界强行嵌入了一个人工正交基里。世界不是正交的,但符号系统假装它是。

高维空间的正交性不是 bug,而是 feature。在极高维度下,随机向量几乎必然正交——这意味着它们天然解耦,彼此独立。这种解耦性正是高维嵌入表示学习能够成功的前提:每个维度可以独立地刻画不同语义 aspect,而不需要像低维空间那样彼此"粘合"。

专家系统的问题恰恰在于它故意制造了这种正交性,但是在一个极其低效的维度上。它把每个概念硬编码为一个正交基向量,创造了有限维度的、人工的、离散的正交表示。这种表示在概念上干净,但在表征效率上极其低下——它无法捕获概念之间的连续相似性,也无法利用高维空间天然的正交性所提供的"免费午餐"。

真正的高维嵌入(如词向量)之所以强大,是因为它们让数据自己决定如何在保持语义连续性的同时,利用高维空间的正交性。训练过程不是强行正交化,而是让统计约束把向量推到流形上——这个流形既不是完全正交的随机沙漠,也不是完全相关的低维泥潭,而是一个精心折叠的、语义丰富的曲面。

低维的语义流形。类比算术有效,是流形结构的功劳,不是算法的智慧。而当类比失败时(医生 - 男人 + 女人 ≈ 护士,而非女医生),原因是训练语料的偏见把流形扭曲了——语义空间在那个区域的曲率,不是”客观概念”的曲率,而是”语料统计偏见”的曲率。

这两个回响指向同一个问题:如果随机高维空间是正交的沙漠,那么”有意义的数据”之所以能被学习,一定是因为数据不是随机的——它被某种约束压缩进了一个低维结构。这就是流形假设要说的事情。

这两个回响指向同一个问题:如果随机高维空间是正交的沙漠,那么”有意义的数据”之所以能被学习,一定是因为数据不是随机的——它被某种约束压缩进了一个低维结构。这就是流形假设要说的事情。

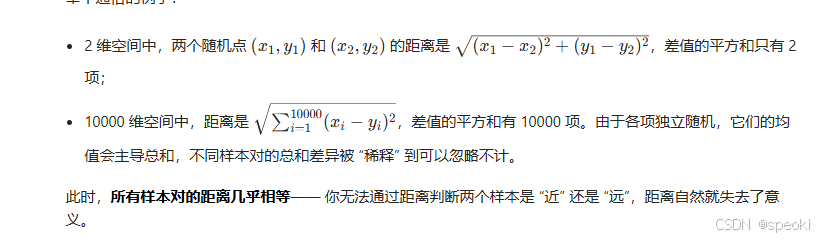

维度诅咒:随维度增长,随机点对距离分布的坍塌

图1:左图,随机点对在 2、10、100、1000 维空间中的距离分布。维度越高,分布越集中,方差趋零——“距离”失去区分能力。右图,1000 维随机向量两两余弦相似度的直方图,几乎全部堆积在零附近。

这给机器学习带来了一个根本性的问题:如果数据真的是高维随机的,那么任何基于距离或相似度的算法——包括神经网络在内——都不应该能工作。

但它们工作了。

这里有两种可能的解释:

第一,这些算法以某种我们没有完全理解的方式,绕过了高维几何的限制。

第二,数据本身就不是高维随机的。

第二种解释是对的

=================

等一下,先别急着接受"第二种解释是对的"这个结论。

- 为什么自然数据会聚集在低维流形上?这是一个需要解释的事实,不是公理。

一种答案是:物理定律约束了可能的状态空间——人脸的变化受制于骨骼、肌肉、光照物理,所以可能的人脸远少于可能的像素组合。 - 但这个答案暗含了一个假设:世界是有规律的,而这些规律是低维的。

- 这个假设凭什么成立?如果世界的真实规律是高维的、混沌的,流形假设就会崩塌——机器学习就不应该能工作。

那为什么它确实工作了?是因为物理规律确实是低维的,还是因为我们恰好只在"流形假设成立的那些问题"上测试过它?

先把这个问题放着。

===========

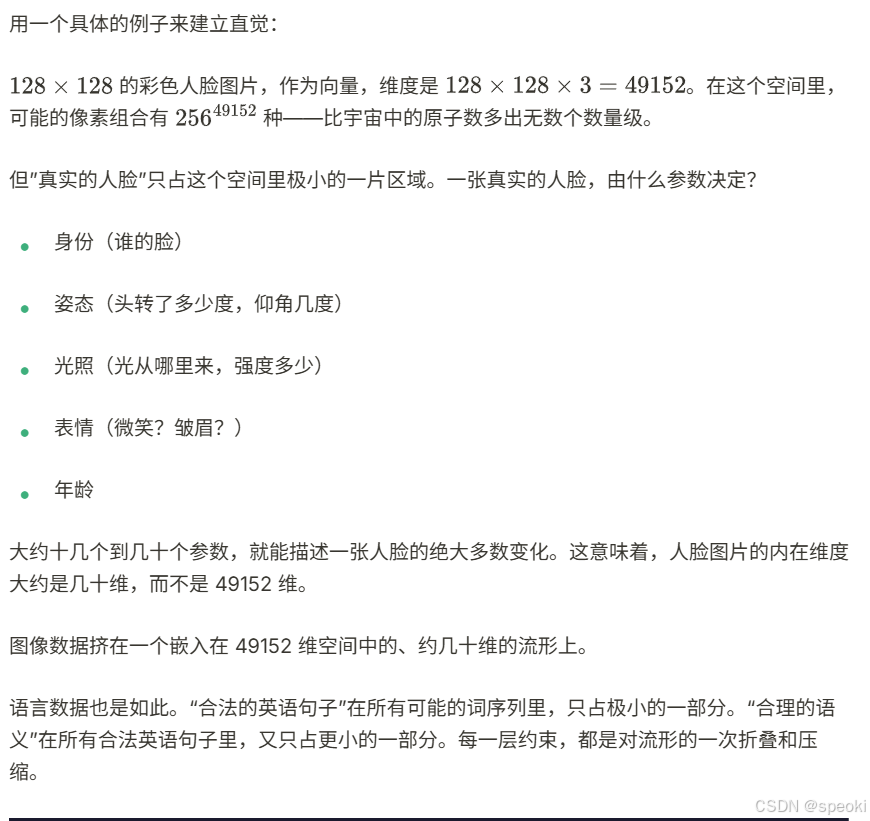

流形假设:约束造就曲面

流形假设(Manifold Hypothesis)的核心陈述是:

自然数据(图像、语言、声音)虽然生活在高维空间里,但它们实际上聚集在一个内在维度远低于环境维度的光滑曲面(流形)附近。

“流形”是一个数学术语,意思是局部看起来像[欧氏空间的拓扑结构]。一张二维曲面嵌入在三维空间里,就是一个流形——地球表面是流形,莫比乌斯带是流形,一根弯曲的管道的表面是流形。

流形是一种几何对象,它的定义是:局部看起来”平坦”(像普通的欧氏平面),但整体可以是弯曲的。

最好的例子:**地球表面。**你站在地球上的任意一点,如果只看脚下很小的一块,它看起来和平地没什么区别——这就是”局部像欧氏空间”。但整体来看,地球表面是球形的,不是平面。地球表面是一个二维流形,嵌入在三维空间里。

在机器学习语境里:

- 49152 维的人脸图片空间 = 三维空间的类比

- 人脸真实分布所在的几十维曲面 = 地球表面的类比

为什么流形假设重要? 因为它解释了为什么机器学习能工作:数据不是高维随机的,而是聚集在低维曲面上,算法实际上是在学习这个低维曲面的结构。

语言数据也是如此。“合法的英语句子”在所有可能的词序列里,只占极小的一部分。“合理的语义”在所有合法英语句子里,又只占更小的一部分。每一层约束,都是对流形的一次折叠和压缩。

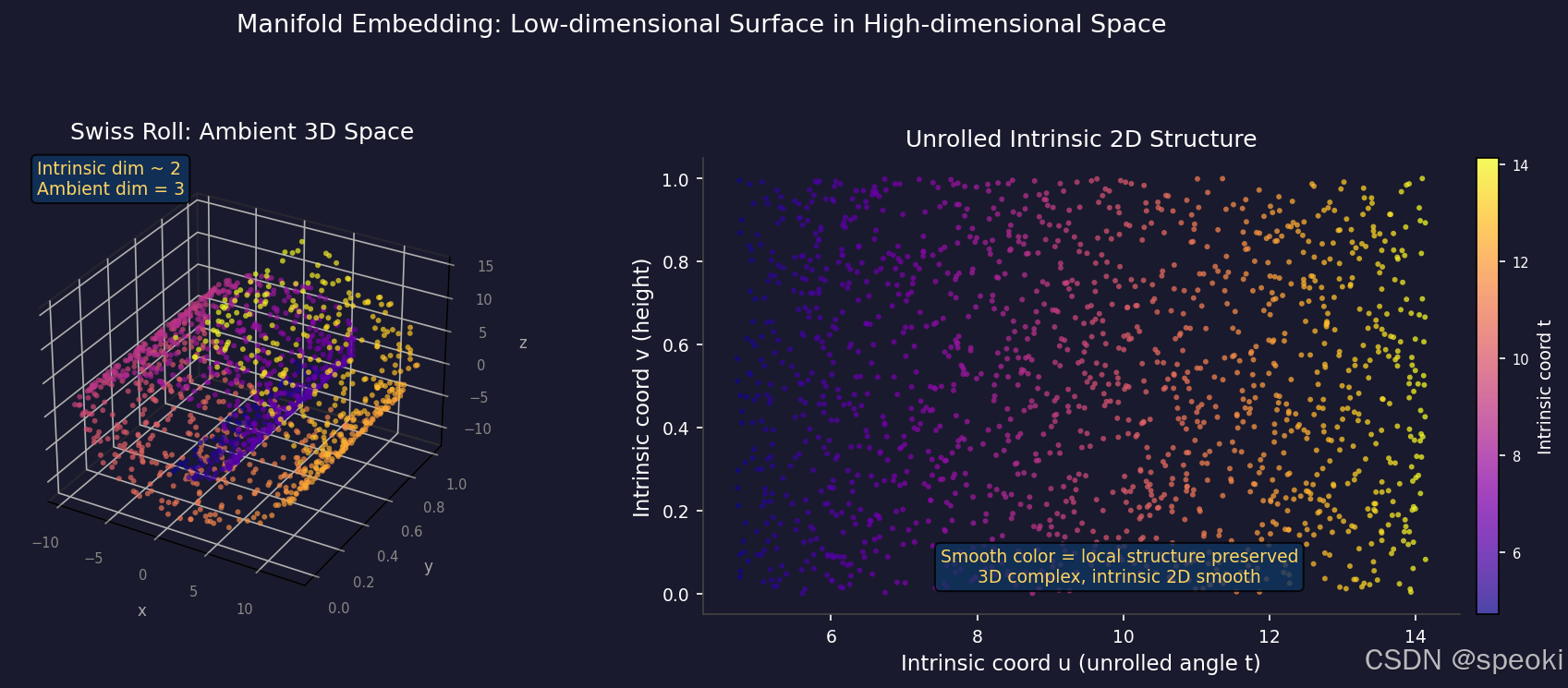

流形嵌入:低维曲面在高维空间中的结构

图2:左图,一个二维流形(Swiss Roll 数据集)嵌入在三维空间里——三维坐标看起来复杂,但数据沿两个内在维度(展开后的 u, v 坐标)平滑分布。右图,对同一数据集做流形学习(UMAP),恢复内在的二维结构。颜色编码内在坐标的连续性——局部邻近在高维空间里保持邻近。

为什么自然数据会聚集在流形上?这不是巧合,是生成过程的必然结果。

任何数据都是由某个生成过程产生的。人脸图片由生物过程产生——【DNA、骨骼结构、皮肤纹理】,这些参数是有限的,而且是连续变化的。语言由【语法规则和语义约束】产生。音乐由【物理学(声波)和文化惯例】产生。

生成过程的约束就是【流形的曲率】。约束越强,流形越低维,越弯曲。

这是一个深刻的事实:【数据的内在维度,不是数据的固有属性,而是生成数据的世界结构的投影。】

==========

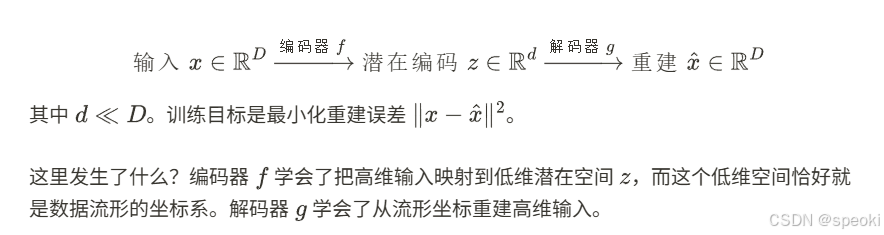

三、训练是折叠

现在我们到了这一章最重要的地方。

通常我们说神经网络在”学习”——学习识别猫,学习翻译语言,学习预测下一个词。这个说法很危险。“学习”暗示了某种理解,某种将知识内化的过程。

更准确的说法是:[神经网络在做流形变换]。

把一个自动编码器(Autoencoder)的工作原理展开来看:

换句话说,编码器学会的,是流形的参数化——它找到了一组坐标,可以用来描述流形上的点。解码器学会的,是这组坐标和原始高维表示之间的映射。

不只是自动编码器。分类网络做的也是这件事。当你训练一个 ResNet 识别图像类别,最后一个全连接层之前的特征向量,就是网络学到的流形坐标——只是这个坐标系被专门设计成”对分类有用的”。

[反向传播],就是调整这个坐标系的过程。每一次梯度更新,都在改变网络把高维输入映射到低维潜在空间的方式——也就是改变流形的参数化。

训练的本质,是把过去见过的数据的流形结构,折叠进参数的曲率里。

“折叠”这个词很重要。不是”存储”,不是”记忆”,是折叠。训练数据不是被逐条存进网络的——网络没有那么多参数来存储训练集的每一个样本。发生的事情是:数据的统计结构,数据所在的流形的几何特征,被压缩进了网络权重的配置里。

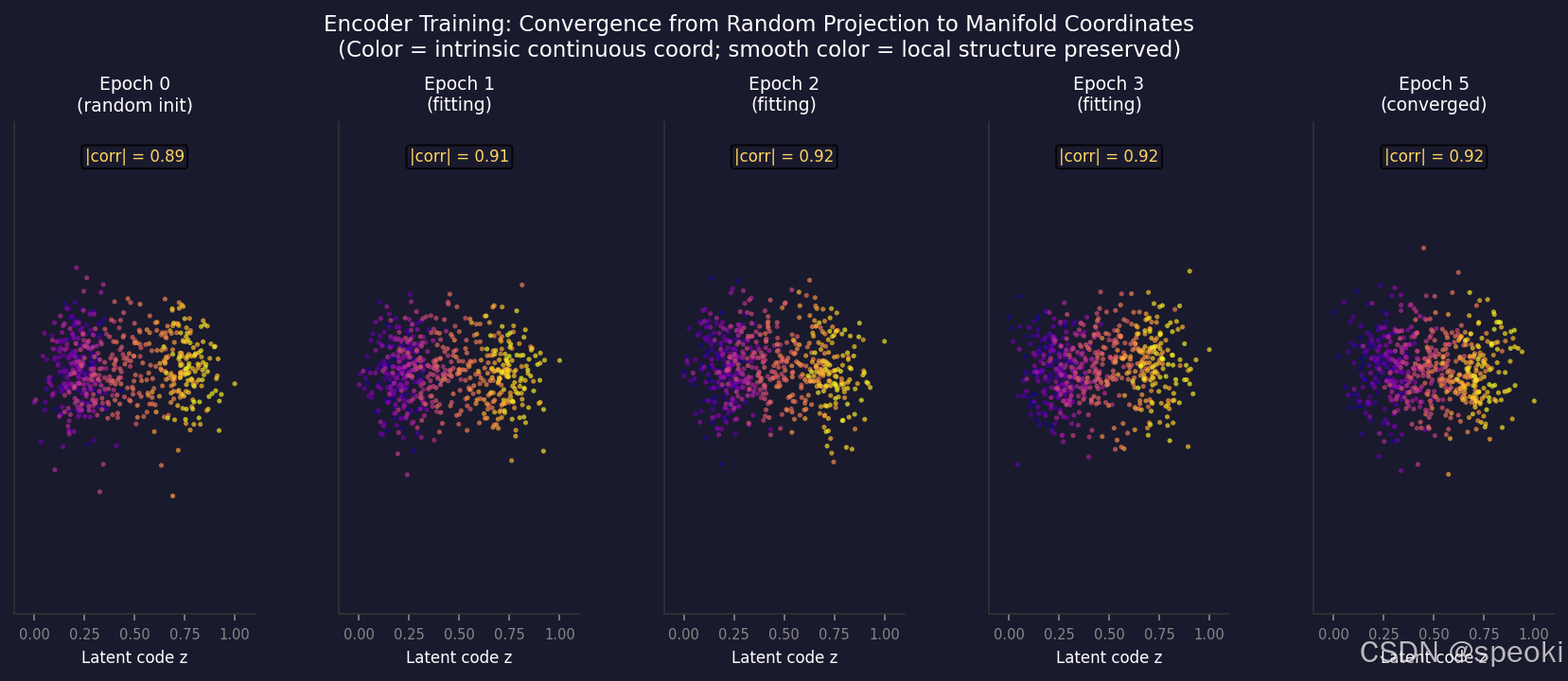

训练过程:从高维数据到压缩流形参数的映射

图3:上方,编码器将高维数据(散布在二维流形上的三维点云)逐步映射到一维潜在编码。下方,训练过程中潜在空间的演化——随着 epoch 增加,潜在表示从混乱走向结构化。颜色代表数据在原始流形上的连续坐标,颜色连续意味着局部结构被保留。

这里有一个值得停下来想的深层问题:参数里存的是什么?

一个直觉是:参数存储的是”知识”——关于猫长什么样,关于语法规则,关于物理定律。

但更准确的说法是:参数存储的是训练数据的流形结构的压缩编码。

知道了这一点,你就能理解为什么预训练有效——同一个流形(比如”自然图像”)可以被[多个任务共享],预训练学到的流形参数化可以被迁移。你也能理解为什么微调(fine-tuning)有时候能改变模型行为,有时候不能——取决于你的新任务所在的流形,是否是预训练流形的子集。以及,你开始能理解为什么大模型会产生幻觉——关于这一点,第四幕会讲。

==========================

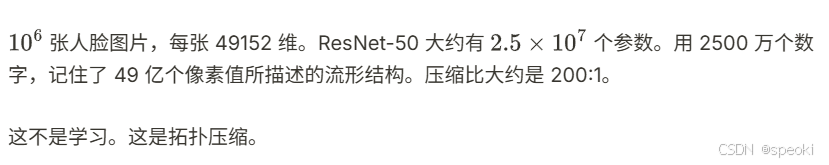

压缩的账单

任何压缩都有代价。这不是经验观察,这是信息论定理。

Shannon 的信源编码定理告诉我们:你能无损压缩的极限,是信源的熵。超过这个极限,你必须丢信息。神经网络的压缩远超这个极限,所以它一定在丢信息。

丢的是什么?

第一笔账:流形外的点

训练结束后,网络的参数里编码了训练数据所在的流形。当测试时遇到了不在这个流形上的点——来自不同分布的图像,从未见过的语言现象,反事实的推理场景——网络会怎么做?

它没有一个”这个点不在我的流形上”的警报。它只能把这个点硬拉到最近的流形区域,然后按照那个区域的逻辑给出答案。结果:自信的错误。不是”我不知道”,而是”它看起来像 X,所以我回答 X”——即使 X 是完全错误的。

这就是分布偏移(Distribution Shift)问题的几何根源:【模型学到的流形,和真实世界的流形,在训练分布之外的地方不一致。偏移越大,误差越大,但置信度不变】——因为置信度是流形坐标的函数,不是”距离流形有多远”的函数。

第二笔账:流形内部的等距性

压缩时,流形的某些区域被”伸展”,某些区域被”压缩”。

训练数据密集的地方,网络学到的参数化分辨率高——相邻的输入对应着相邻的潜在编码,局部几何被很好地保存。

训练数据稀疏的地方,网络参数化的分辨率低——相邻的输入可能被映射到潜在空间里相差很远的地方,或者相差很远的输入被映射到潜在空间里相邻的地方。

这意味着,网络对训练数据密集区域的泛化好,对稀疏区域的泛化差——不是随机的差,而是有规律的差:稀疏区域的流形结构被”脑补”出来,填充的是训练数据最常见的模式,而不是这个区域真实的结构。

脑补填充的结果,就是幻觉(hallucination)。

第三笔账:Tishby 的信息瓶颈

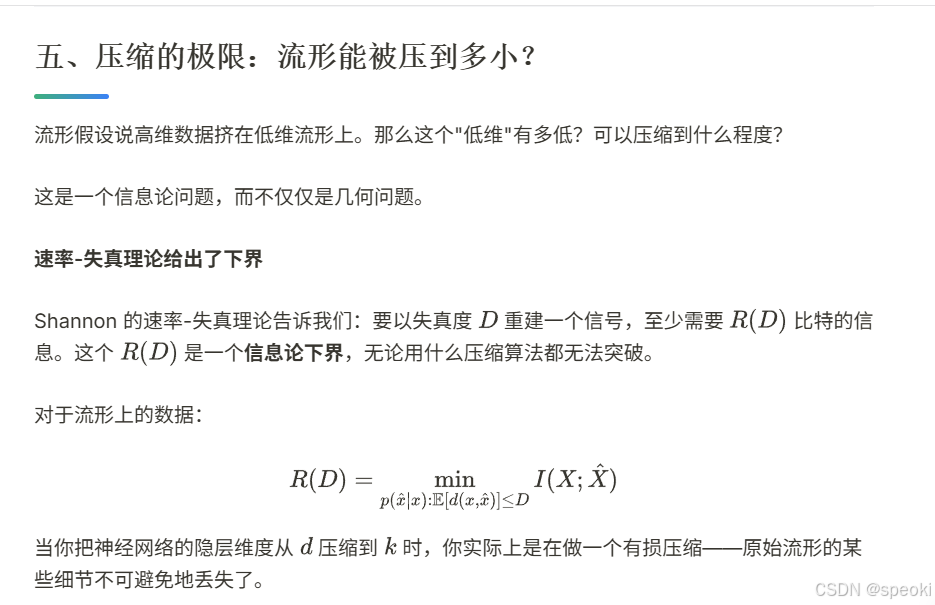

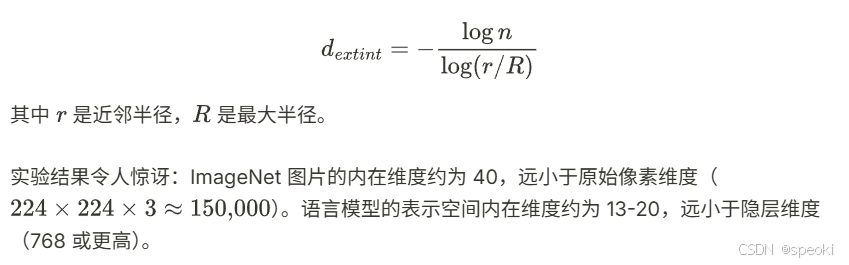

内在维度

流形的**内在维度(intrinsic dimensionality)**是描述流形所需的最少坐标数。这个量可以用两点距离的分布来估计:

这说明现实世界的数据,确实挤在极低维的流形上。

但存在一个【硬下界】

压缩不是无限的。一旦压缩到内在维度以下,失真急剧上升——你开始丢失流形本身的结构,而不仅仅是丢失噪声。

这就是为什么知识蒸馏(从大模型压缩到小模型)有一个性能悬崖:超过某个压缩比,模型不是"差一点",而是"彻底垮掉"。速率-失真曲线在拐点之后急剧下降。

这个硬下界,以及如何用随机化突破确定性压缩的极限,是第11章的主题。

=============

高维空间里,随机数据是无法被学习的——距离失去意义,采样需要指数级的数据量。机器学习之所以有效,不是因为它克服了高维,而是因为数据本身不是高维随机的。【自然数据聚集在低维流形上,这是生成数据的物理过程、生物约束、语法规则共同作用的结果。】

神经网络的训练,是把训练数据的流形结构压缩进参数的过程。不是存储,是压缩。压缩比大约是 100:1 到 1000:1 的量级。

**压缩有不可避免的代价:流形外的点被强行投影,稀疏区域的结构被脑补,分布偏移时置信度和准确率脱钩。**这些代价不是工程缺陷,是信息论约束的结构性后果。

这引出了第五章的问题:如果模型学到的是流形结构,而不是因果规律,【那么它在分布之外的表现为什么总是系统性地失败】?统计相关性和真正的推理,差距究竟在哪里?

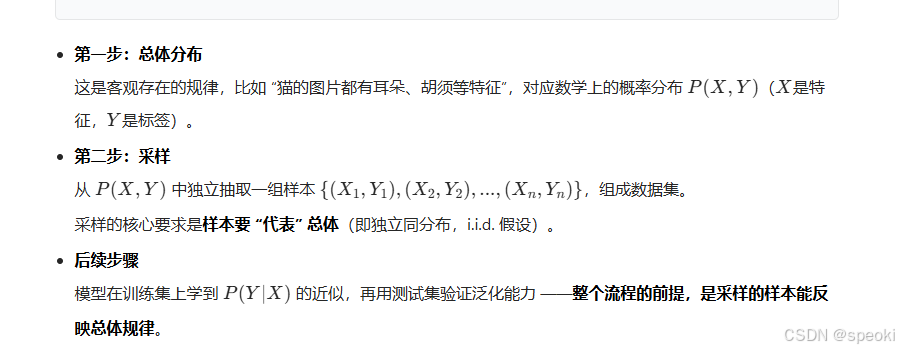

什么是采样?

采样是从总体(population) 中抽取一部分样本(sample) 的过程,目的是用少量样本的特性去估计总体的特性。这个概念不仅适用于机器学习,也贯穿于统计学、数据科学的所有领域。

为什么机器学习必须采样?机器学习的目标是学习数据的规律,而规律存在于全部数据的总体分布中,但我们永远无法获取 “全部数据”:

- 比如要训练一个 “识别猫” 的模型,总体是世界上所有的猫图片—— 数量无穷,不可能全部收集;

- 再比如训练一个预测股价的模型,总体是所有时间维度下的股价数据—— 未来的数据还没发生,无法获取。

- 因此,我们只能采样:收集一部分猫的图片、一部分历史股价数据,用这些样本训练模型,再期望模型能泛化到总体上。

总体分布(真实规律) → 采样 → 数据集(训练集/验证集/测试集) → 模型训练 → 模型泛化到新样本

【神经网络学到的流形,和真实世界数据的流形,到底有多”吻合”?我们没有好的工具来测量这个吻合程度。】

流形的内在维度可以被估计吗?有哪些方法,各有什么假设?在 LLM 的激活空间里,内在维度是多少?

远低于原始维度:

以 GPT-3(175B 参数)为例,其隐藏层维度为 12288,但内在维度估计结果通常在 数百到数千维 之间(具体取决于层位置和任务)。例如,研究表明 BERT 的中间层激活内在维度约为 500-1000,远低于其 768/1024 的原始维度。

层间差异显著:

- 底层激活(Embedding 层、低层 Transformer):内在维度较高,保留了更多的输入细节(如词汇的拼写、语法结构);

- 高层激活(顶层 Transformer):内在维度较低,更聚焦于语义、逻辑等抽象特征 —— 这说明 LLM 的表示学习过程,是主动将高维输入映射到低维语义流形的过程。

任务依赖性强:

同一 LLM 在不同任务上的激活空间内在维度不同 —— 例如,文本分类任务的激活内在维度低于机器翻译任务,因为前者需要的语义抽象程度更高。

【“压缩”丢失的那部分信息,是否包含了推理所需要的结构?还是说推理能力,恰好藏在被保留下来的部分里?】

这个问题的核心是 “表示学习的信息取舍逻辑”,目前学界的共识是:

1. 推理能力藏在被保留的低维流形结构中

神经网络的 “压缩” 不是随机丢弃信息,而是基于任务目标的【 “结构化压缩”】—— 它会保留与任务相关的不变性特征,丢弃的是噪声、冗余细节、任务无关的变异。

例如,图像识别模型压缩时,会保留 “物体的形状、边缘” 等核心特征,丢弃 “像素级的噪声、光照的细微变化”;

LLM 压缩时,会保留 “语义逻辑、实体关系” 等核心特征,丢弃 “用词的细微差异、句式的无关变化”。

推理能力的本质是特征之间的结构化关联(如因果关系、逻辑蕴含),这些关联正是低维流形的 “几何结构”—— 比如 “猫→哺乳动物→动物” 的层级关系,在词向量空间中体现为流形上的路径。

2. 丢失的信息:大多是冗余,而非核心结构

只有当压缩过度(如维度远低于内在维度)时,才会丢失推理所需的结构 —— 这会导致模型的 “欠拟合” 或 “推理能力退化”。一个经典的证据是:LLM 的蒸馏模型(通过压缩大模型得到小模型)在大多数推理任务上的性能,与大模型的差距远小于参数规模的差距 —— 这说明蒸馏过程保留了核心的语义流形结构。

【如果你用完全随机的数据训练一个神经网络,它会学到什么样的”流形”?这个思想实验的答案,会告诉我们流形假设的必要性。】

1. 输入是纯随机数据(无任何结构,服从均匀 / 正态分布)

训练过程:神经网络会拟合训练数据的随机噪声(即过拟合);

学到的 “流形”:是一个高维、无规律的 “伪流形”—— 本质上是训练数据在高维空间中的随机分布的 “复刻”,不具备任何可泛化的几何结构;

泛化能力:在测试集(同样随机)上的准确率接近随机猜测 —— 因为这个 “伪流形” 没有捕捉到任何真实规律。

2. 关键结论:验证流形假设的必要性

这个实验的结果说明:神经网络本身无法 “无中生有” 地创造流形结构—— 它学到的流形,本质上是对输入数据中已有流形结构的 “提取和重构”。

如果输入数据没有流形结构(纯随机),模型学到的只是噪声;

如果输入数据有低维流形结构(自然数据),模型才能学到可泛化的规律。

这直接证明了:流形假设是机器学习有效的必要前提—— 没有数据的低维流形结构,就没有模型的泛化能力。

【信息瓶颈的两阶段理论(拟合 + 压缩)在实验上仍有争议。如果压缩阶段不存在,神经网络泛化的原因是什么?】

信息瓶颈(Information Bottleneck, IB)理论的 “拟合 + 压缩” 两阶段框架,是解释泛化的主流理论之一,但确实存在争议(如实验中观察到部分模型压缩阶段不明显)。若压缩阶段不存在,学界提出了以下替代解释:

1. 正则化的隐式作用

神经网络的训练过程中,存在大量隐式【正则化机制】,它们替代了 “主动压缩”,迫使模型学习泛化特征:

- 梯度下降的隐式正则化:【SGD 倾向于找到 “平坦的极小值点”】,对应的模型对输入扰动更鲁棒,自然具备泛化能力;

- 参数共享(如 CNN 的卷积核):强制模型学习【平移不变】的特征,避免过拟合局部噪声;

- 数据增强:人为扩充【训练数据的分布】,迫使模型学习更通用的特征。

2. 自然数据的 “自正则化” 特性

自然数据的低维流形结构本身,就具备自正则化的作用: - 数据的流形结构限制了 “可学习的特征空间”—— 模型只能学习到流形上的结构化特征,而非噪声;

- 即使模型不主动压缩,流形的低维性也会让模型的表示空间 “天然低维”,从而具备泛化能力。

3. 泛化界的理论保障

从统计学习理论的角度,泛化能力的本质是模型复杂度与训练数据量的平衡: - 神经网络的有效复杂度(如 VC 维、Rademacher 复杂度)远低于其参数规模;

- 只要训练数据量足够大,模型就能在 “拟合数据” 的同时,保证泛化误差的上界 —— 无需显式压缩。

知识的流形结构:知识图谱是离散符号流形,词向量是连续语义流形。这两种流形如何相互映射、相互验证?是否存在一个统一的"知识流形"理论?

1. 两种流形的相互映射方法

映射的核心目标是实现离散符号与连续向量的双向转换,主流方法分为两类:

- 从知识图谱到词向量:符号嵌入

代表算法:TransE、TransR、ComplEx。核心思想是将知识图谱中的实体和关系映射到连续向量空间,让 “头实体 + 关系 = 尾实体” 的【逻辑关系】,在向量空间中体现为几何运算(如平移、旋转)。

本质:将离散的符号流形嵌入到连续的语义流形中。

- 从词向量到知识图谱:符号挖掘

代表方法:基于词向量的关系抽取、实体链接。核心思想是利用词向量空间的几何结构,挖掘隐藏的【实体关系】—— 例如,词向量空间中 “国王 - 男人 + 女人 = 女王” 的向量运算,对应知识图谱中的 “性别关系”。

本质:从连续的语义流形中还原离散的符号流形。

2. 统一 “知识流形” 理论的探索

目前学界尚未形成完全统一的理论,但存在两个主流的研究方向:

方向 1:混合流形表示

构建 “离散 - 连续混合空间”,同时容纳【符号结构】和【向量特征】。例如,知识图谱嵌入(KGE)+ 预训练语言模型(PLM) 的融合模型(如 KG-BERT)——PLM 提供连续语义流形,KGE 提供离散符号约束,两者在统一空间中协同优化。

方向 2:流形的拓扑等价性

从拓扑学角度,知识图谱的符号流形和词向量的语义流形,可能是【同一知识结构的不同拓扑表示】—— 符号流形是知识的【 “离散拓扑”】(如节点和边的连通性),语义流形是知识的 【“连续拓扑”】(如向量的聚类和路径)。两者的统一,本质是找到连接离散拓扑和连续拓扑的同胚映射。

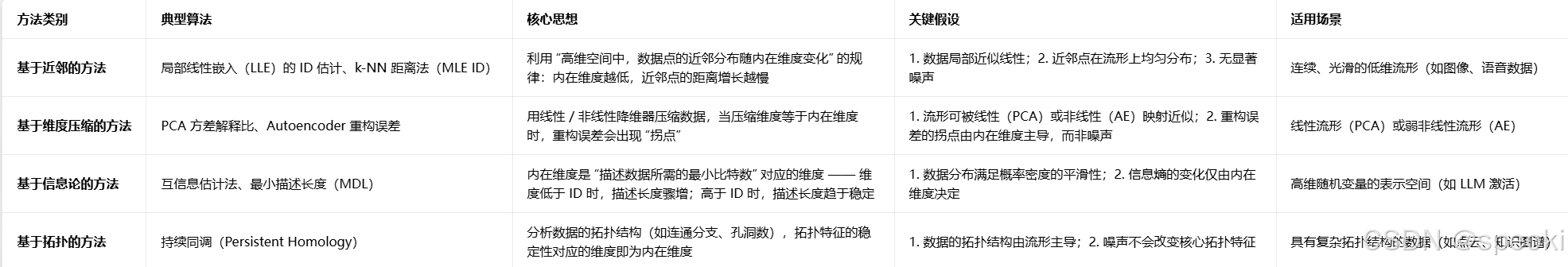

多层次的流形:物理系统(生命)的相空间流形、符号系统(知识)的逻辑空间流形、统计系统(学习)的表示空间流形——这些不同层次的流形之间是否存在同构或映射关系?

物理系统、符号系统、统计系统的流形,分别对应客观世界、人类认知、机器表示三个层面的规律,它们之间的关系是 “涌现 - 映射 - 逼近” 的层级结构,存在部分同构性,但并非完全一一对应:

同构性的核心证据

- 因果结构的一致性:物理流形的因果律(如 “力→加速度”)、符号流形的逻辑律(如 “前提→结论”)、统计流形的关联律(如 “特征→标签”),存在深层的结构同构;

- 降维的一致性:三个层次的流形都可以通过降维,提取核心特征 —— 例如,物理系统的相空间降维、符号系统的逻辑化简、统计系统的表示压缩,本质都是 “提取低维不变量”。

尚未解决的问题 - 如何严格证明不同层次流形的同构性?

- 如何构建跨越三个层次的统一流形模型?

这些问题的答案,可能需要融合物理学、认知科学、机器学习的跨学科研究。

Tishby, N. & Schwartz-Ziv, M. (2017). Opening the Black Box of Deep Neural Networks via Information — 信息瓶颈理论的深度学习版本,提出训练的两阶段假说 → [arXiv:1703.00810]

Saxe, A. et al. (2018). On the Information Bottleneck Theory of Deep Learning — 对 Tishby 信息瓶颈理论的批评与修正,表明压缩阶段依赖激活函数选择 → [arXiv:1812.09881]

Fefferman, C., Mitter, S. & Narayanan, H. (2016). Testing the Manifold Hypothesis — 流形假设的数学检验,何时流形假设成立、何时不成立 → [arXiv:1204.1423]

Bengio, Y., Courville, A. & Vincent, P. (2013). Representation Learning: A Review and New Perspectives — 表示学习综述,包含流形学习与深度表示的关系 → [arXiv:1206.5538]

Bellman, R. (1957). Dynamic Programming — 维度诅咒的原始来源,Bellman 在优化背景下命名了这个现象

[Zixi Li, 2026b] Collins — 随机化优化器, 状态压缩,安全压缩比的信息论证明

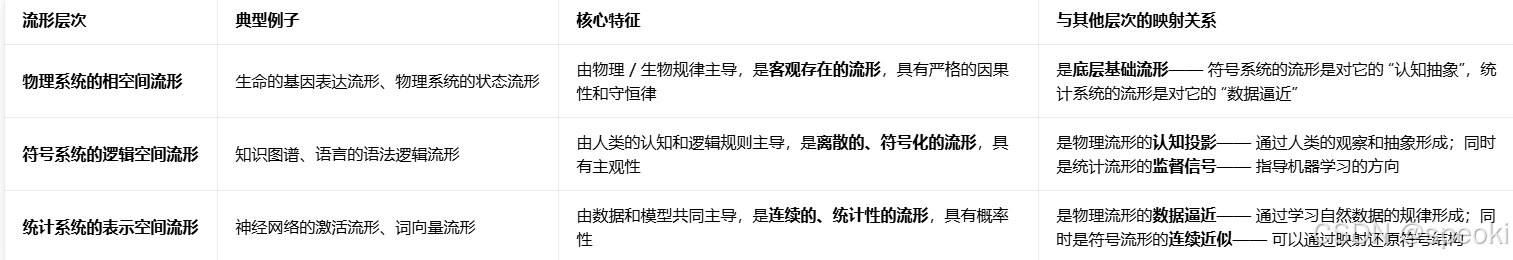

前四章也展示了知识表示的演进轨迹:

- 离散符号(第2章):If-Then规则、知识图谱三元组

- 连续向量(第3章):词嵌入、语义空间

- 低维流形(第4章):内在维度、数据的内在结构

- 关键洞察:知识图谱是离散符号流形,词向量是连续语义流形。两者都在尝试捕捉世界的结构,只是用不同的数学语言。

元问题:推理的多层次实现

这引向一个元问题:推理是什么?

- 物理答案:推理是生命对抗熵增的认知策略

- 符号答案:推理是符号系统遵循逻辑规则的推导

- 统计答案:推理是统计模型在流形上的模式匹配

这三个答案都对,但都不完整。真正的推理可能是三者的协同:

- 物理层提供存在基础(为什么需要推理)

- 符号层提供精确框架(如何形式化推理)

- 统计层提供实现机制(如何计算推理)

每个层次都有自己的边界:

- 物理层:热力学极限(Landauer原理)

- 符号层:知识边界(封闭世界假设)

- 统计层:泛化边界(流形假设)

最终问题:当AI系统"推理"时,它在哪个层次上工作?还是说,真正的智能需要跨越这些层次的整合?

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)