AI开始进入“危险区”?Anthropic封存最强模型,OpenAI押注网络安全模型,意味着什么?

## 引言:为什么这件事和工程师直接相关

> 摘要:本节给出关键结论、核心步骤和可执行建议。

> 大家想学习更多AI知识,可以收藏下面两个网站:

如果你还把“大模型安全”理解成提示词越狱、内容审核或 API 限流,那这波变化已经明显超出那个层级了。2026 年 4 月,Anthropic 宣布将未公开通用发布的前沿模型 **Claude Mythos Preview** 仅向防御方和关键软件维护者有限开放,原因不是模型“太会聊天”,而是它在**发现漏洞、分析漏洞、辅助利用**上的能力,已经强到足以显著放大真实攻击面 [1]。几乎同一时间,OpenAI 也把 **GPT-5.4-Cyber** 以受限方式交给经过审核的安全机构与研究者,明确表示这是在为未来几个月更强模型提前搭建防御能力基座 [2]。

这对工程师意味着两件事:

1. **AI 的风险边界从内容风险,转向基础设施风险。**

2. **模型接入方式、权限控制、审计体系,正在变成工程系统设计的一部分。**

如果你负责应用安全、平台工程、DevSecOps、代码托管、云原生平台,甚至只是维护一套企业内研发工具链,这个趋势都不再是“行业新闻”,而是会落到你的接入策略、日志策略、账号策略和发布流程上。

## 摘要

> 摘要:前沿模型正在跨入“高风险能力区间”,头部厂商不再默认全面开放,而是转向“高能力 + 受限访问 + 防御优先”的部署模式。

Anthropic 在 2026 年 4 月推出 **Project Glasswing**,并披露其未公开通用发布的 **Claude Mythos Preview** 已发现数千个高严重度漏洞,覆盖主要操作系统、浏览器和关键软件;官方明确表示,该模型在找漏洞与利用漏洞方面已超过绝大多数人类专家,因此先只向防御者和关键软件维护者有限开放 [1]。与此同时,OpenAI 推出 **GPT-5.4-Cyber**,采用“更 cyber-permissive 的变体”思路,但只对经过审核的安全厂商、机构与研究者迭代部署 [2]。

这不是巧合,而是治理逻辑收敛:**模型越强,越不能简单“全量上线”;要把能力释放优先给防御方,并配套分级访问、输入输出分类器、异步监控、越狱检测、事后响应等控制面** [4][5]。

从工程角度看,这意味着未来安全 AI 的主问题,不只是“模型能不能做”,而是:

- 谁能用;

- 在什么场景下能用;

- 用完如何留痕;

- 出现越权时如何熔断;

- 如何把高能力模型嵌入真实安全工作流,而不是变成新的攻击面。

## 从“模型更强”到“进入危险区”:官方信号已经很明确

> 摘要:所谓“危险区”不是媒体渲染,而是厂商在风险分级、部署控制和能力阈值上给出的正式信号。

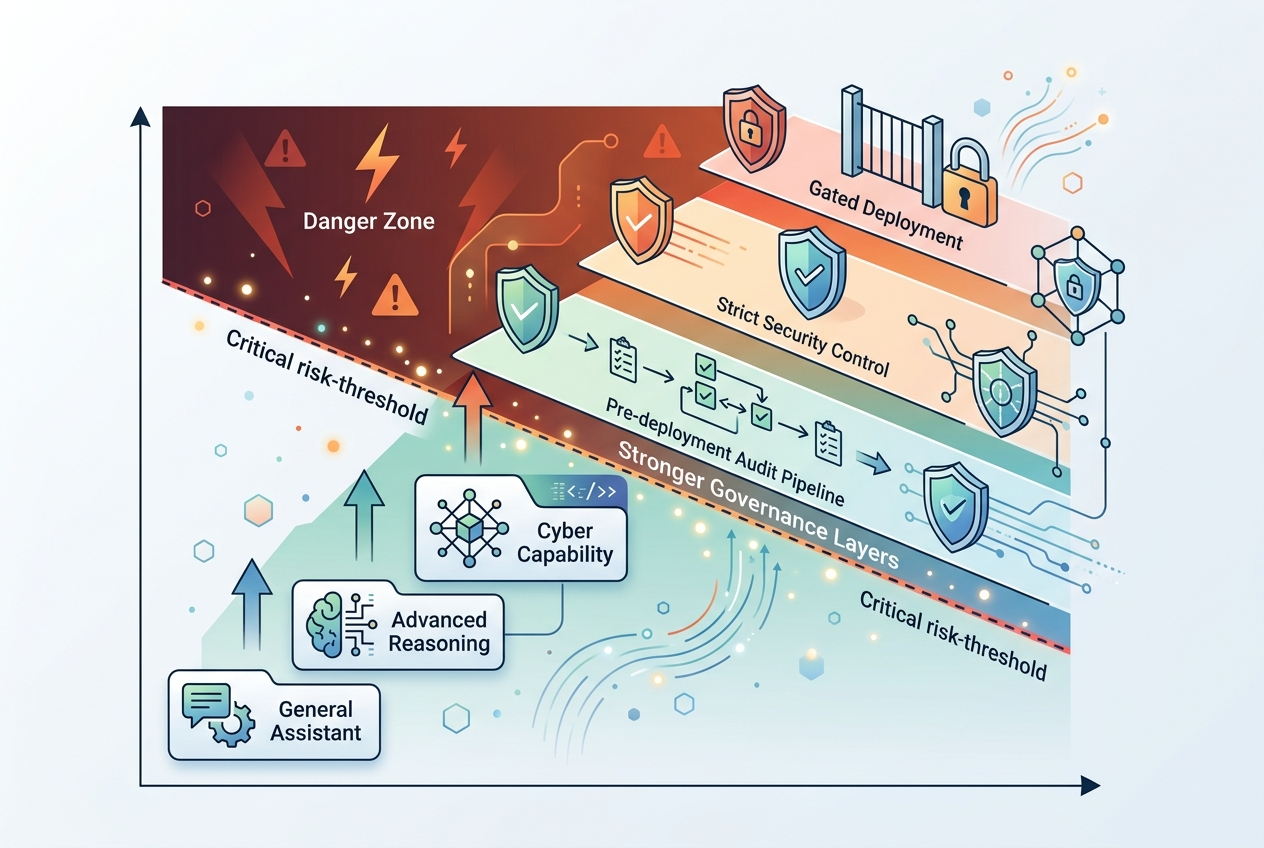

Anthropic 的证据最直接。其 2026 年 2 月风险报告显示,**Claude Opus 4.6 与 Claude Sonnet 4.6 均已强到需要 ASL-3 protections**,而较弱模型如 Haiku 4.5 不需要 [3]。这说明在 Anthropic 的内部治理体系里,最强商用模型已经不是“普通上线”级别,而是进入了更高保护等级。

RSP v3.0 的描述进一步说明了这一点:当模型能力跨过特定阈值后,厂商必须上更强的部署与权重安全措施,并引入持续风险报告、路线图与在特定情况下的第三方审查 [6]。更新页又显示,Anthropic 的安全政策在 2026 年 2 月到 4 月期间持续快速修订,说明这不是静态规则,而是在跟着模型能力上升实时调整 [4]。

Claude 4 System Card 则给出更工程化的解释:网络安全能力的关键风险,不只是模型“会不会回答攻击问题”,而是它是否**足以显著提升低水平攻击者,或者把高水平攻击者的行动规模化** [8]。这一定义很重要,因为它把风险判断从“单次输出是否违规”升级为“是否降低攻击门槛、提升攻击吞吐量”。

换句话说,今天所谓 AI 进入“危险区”,并不是模型突然“有恶意”,而是它们开始在真实世界的攻防生产率上产生足够大的杠杆。

## 为什么网络安全成为前沿治理的第一赛道

> 摘要:网络安全是最容易被模型能力放大的现实领域,因此也最先成为厂商治理重点。

Anthropic 和 OpenAI 的最新动作都指向同一个判断:**网络安全是前沿模型最先需要实施精细化准入控制的场景之一**。

Anthropic 在 Project Glasswing 中直接指出,Mythos Preview 已发现数千个高严重度漏洞,覆盖主流 OS、浏览器和关键软件 [1]。这意味着模型能力已经不再停留在“解释 CVE”或“写 PoC 样板”,而是在大规模、跨平台、接近生产级漏洞挖掘上展现出实战价值。

OpenAI 在 2026 年 2 月的 Trusted Access for Cyber 试点里也明确表示,随着不同供应商乃至开放权重模型广泛具备强网络能力,必须提前建立信任制访问机制 [5];到 4 月发布 GPT-5.4-Cyber 时,更把“未来更强模型能力提升”和“同步扩展防御能力”绑定 [2]。

为什么是网络安全而不是别的赛道最先升级治理?

工程上看,原因主要有三点:

1. **反馈闭环快**

漏洞验证、补丁比对、模糊测试、日志关联,本身就是可自动化、可迭代的流程,模型很容易嵌入。

2. **高杠杆**

模型哪怕只把一名普通分析员的效率提升 3-5 倍,都可能在大规模资产环境里产生显著效果;若用于攻击,放大也同样明显。

3. **结果可迁移**

一个好的攻击思路、一段利用链、一套枚举策略,很容易复制到大量相似系统。这种“可复制性”让模型的规模化放大风险尤其突出 [8]。

因此,AI 安全治理现在最先碰到的,不是“模型会不会写木马”这种老问题,而是“模型是否正在改变漏洞发现与利用的边际成本”。

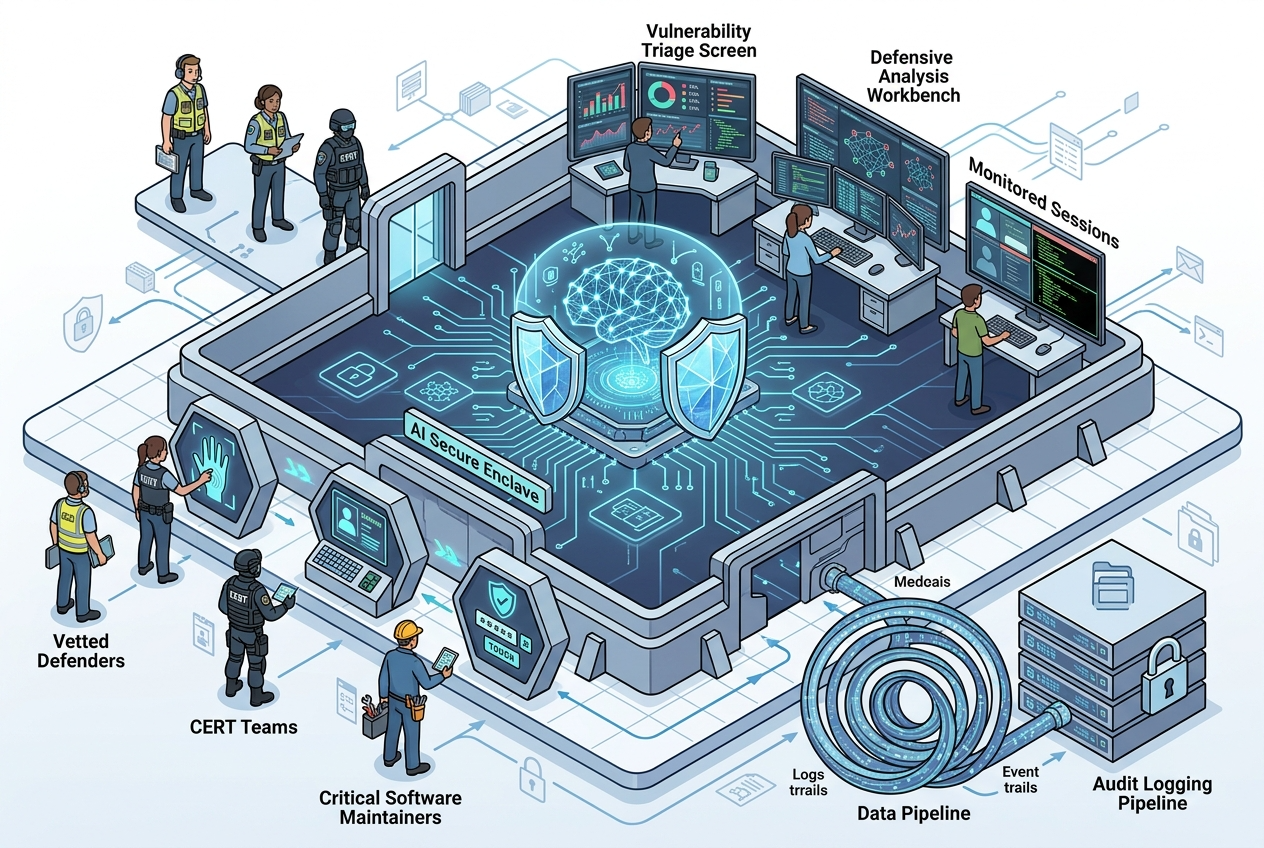

## Anthropic 的策略:不是不用,而是先交给防御者

> 摘要:Anthropic 采用“能力封顶不公开、优先防御落地、配套信用与监控”的工程化策略。

Project Glasswing 的设计非常值得工程团队关注。Anthropic 没有简单地说“这个模型太危险所以不上线”,而是选择了**有限开放给防御方、关键软件维护者和受信合作伙伴** [1]。合作方包括 AWS、微软、谷歌、CrowdStrike、Palo Alto Networks 等,并承诺提供最高 1 亿美元额度的使用 credits [1]。这说明它在做的不是 PR 级别的“安全表态”,而是在搭建一个实际可用的安全生态。

更关键的是,它并不是靠“人工审核一次”来兜底,而是有一整套治理栈支撑。Anthropic 在 RSP 更新页中列出了多层防护机制,包括:

- 分级访问;

- 实时输入/输出分类器;

- 异步监控分类器;

- 事后越狱检测;

- 快速响应机制;

- 对需要放宽默认防护的合作方进行增强尽调 [4]。

这套思路对企业内部接入也有启发:

**不要把高能力模型当成普通 SaaS API 接进来,而要把它当成“高危工具”接入。**

实践中建议至少做四层控制:

1. **主体控制**:谁可以调高能力模型,是否要求企业 SSO、MFA、硬件密钥。

2. **场景控制**:仅允许在漏洞响应、补丁验证、代码审计工单中调用。

3. **内容控制**:对提示词、工具调用、输出内容进行分类和过滤。

4. **事后审计**:所有高风险调用必须可回放、可归因、可触发封禁。

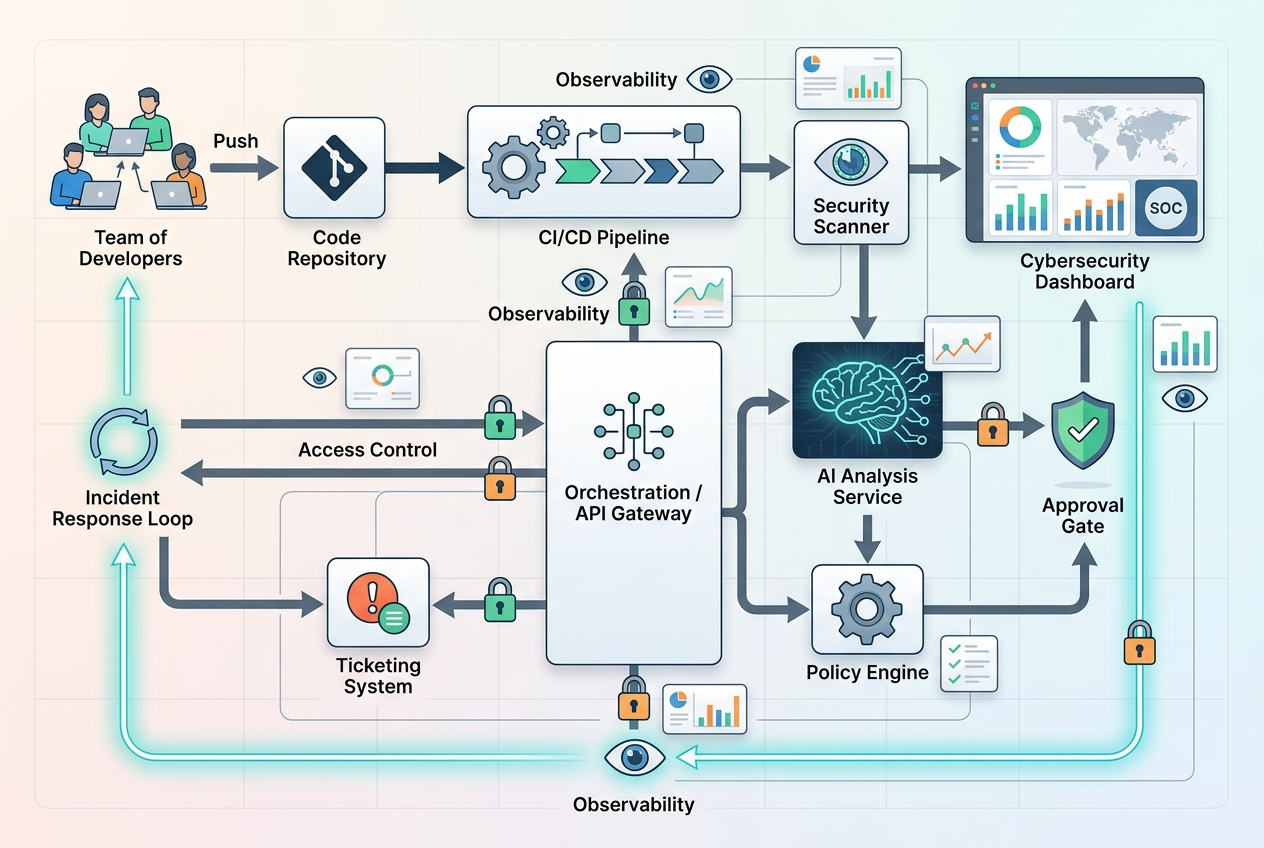

## OpenAI 的策略:Trusted Access 是“能力释放前的控制面”

> 摘要:OpenAI 的重点不是直接放开网络安全能力,而是先建立受信访问和安全运营机制。

OpenAI 从 2026 年 2 月开始就推出了 **Trusted Access for Cyber** 试点,强调要优先把最强网络安全模型交到防御者手中 [5]。当时其 GPT-5.3-Codex 已被称为“最具网络能力”的前沿推理模型,并配套恶意请求拒绝训练与分类器监控 [5]。到 4 月,GPT-5.4-Cyber 进一步作为面向防御性网络安全的受限模型发布,只给经过审核的安全厂商、机构与研究者 [2]。

这个路径很值得做平台的人借鉴:

**先搭控制面,再扩能力面。**

OpenAI 同期还启动了 **Safety Bug Bounty**,覆盖提示注入、数据外泄、代理型产品违规执行、模型泄露专有推理信息、账号与平台完整性绕过等问题 [7]。这很重要,因为它说明 OpenAI 已不再把“模型行为风险”和“系统安全风险”分开看,而是把二者放在统一运营体系下治理。

对于企业来说,这意味着:

- 不能只评估模型输出质量;

- 要把模型接入本身当成一个安全系统;

- 要把提示注入、工具越权、敏感数据外泄、日志泄密、代理误执行纳入常规安全测试。

如果说 Anthropic 更强调“高能力模型进入高风险等级后的分级治理”,那么 OpenAI 更强调“在更强模型到来前,先把受信访问和安全运营机制铺好”。两者方向不同,但工程结论一致:**高能力 AI 不应采用默认公开、默认平权、默认无监控的接入模式。**

## Key Comparison Table

> 摘要:从工程落地看,两家厂商的共同趋势是“高能力受限部署”,差异在于治理切入点与运营重点。

| Dimension | Anthropic | OpenAI | 对工程团队的启示 |

|---|---|---|---|

| 核心动作 | 推出 Project Glasswing,限制 Mythos Preview 面向防御方开放 [1] | 推出 GPT-5.4-Cyber,受信访问迭代部署 [2] | 高能力模型应分层开放,不宜默认全员可用 |

| 风险表述 | 明确称模型在找漏洞与利用漏洞上已超过绝大多数人类专家 [1] | 明确把未来更强模型与同步扩展防御能力绑定 [2] | 风险不只是内容违规,而是能力放大真实攻击面 |

| 治理框架 | RSP v3.0、ASL-3、防护分级、尽调与监控 [3][4][6] | Trusted Access、分类器监控、受限部署、Safety Bug Bounty [5][7] | 模型接入必须有身份、用途、行为三层控制 |

| 开放对象 | 防御者、关键软件维护者、可信合作方 [1] | 经审核的安全厂商、机构与研究者 [2] | 按角色和业务价值授予访问,不按“申请即开通” |

| 技术控制 | 实时 I/O 分类、异步监控、越狱检测、快速响应 [4] | 恶意请求拒绝训练、分类器监控、安全漏洞奖励 [5][7] | 需要在线拦截 + 离线审计 + 事件响应闭环 |

| 战略重点 | 优先保护关键软件与基础设施安全 [1] | 先把防御能力交给可信生态,为更强模型做准备 [2][5] | 从“模型可用”转向“安全可运营” |

| 风险触发逻辑 | 能力阈值触发更强保护,最强模型进入 ASL-3 [3][6] | 能力增强前先建立 Trusted Access 机制 [2][5] | 应把模型能力分级纳入平台治理基线 |

## 工程团队怎么落地:把 AI 网络安全能力接进企业系统的最小闭环

> 摘要:真正可落地的方案,不是采购一个“安全模型”,而是围绕身份、工单、审计、隔离建立闭环。

如果你的团队准备引入具备较强网络安全能力的模型,建议采用下面这个最小闭环架构:

### 1. 身份与准入

- 接入企业 SSO;

- 高风险能力必须要求 MFA;

- 按角色发放权限:IR、AppSec、PSIRT、平台安全、核心维护者分开;

- 对外部研究者和内部员工用不同租户或不同 project 隔离。

### 2. 工单绑定

所有高风险调用都必须绑定具体工单,例如:

- 漏洞响应单;

- 代码审计任务;

- 补丁分析任务;

- 资产加固任务。

没有工单号,不允许使用高风险提示模板或高级工具调用。

### 3. 提示与工具白名单

- 限制可调用的工具,例如代码索引、diff 分析、只读沙箱;

- 禁止默认访问生产环境;

- 对 exploit 生成、批量利用、横向移动类请求设置更高审批阈值。

### 4. 审计与留痕

- 记录输入摘要、输出摘要、工具调用链、审批人、工单号;

- 对敏感提示与异常调用做异步检测;

- 保留安全事件回放能力。

### 5. 人机协同而非全自动

当前阶段最合理的方式仍是:

**模型负责发现线索、聚类、解释、生成修复建议;人类负责判断、授权与最终执行。**

这与 Anthropic 和 OpenAI 的策略一致:先把能力优先交到防御方手中,而不是直接让模型无限制自动化行动 [1][2][5]。

## 代码块注释规范

> 摘要:安全相关代码示例必须把“目的、输入、边界、关键步骤”写清楚,避免误用和歧义。

下面给出 4 条实用规则,适合 CSDN 技术文和内部工程文档:

1. **开头先写目的注释**

用 1 行说明代码块是做什么的,比如“校验 AI 安全调用是否绑定工单号”。

2. **关键分支必须有边界说明**

例如“未命中白名单则拒绝”“高风险角色必须二次审批”,避免读者误解默认行为。

3. **涉及安全控制时,注释要解释原因,不只解释语法**

比如写“记录摘要而不是原文,降低敏感数据暴露风险”。

4. **避免注释泄露危险细节**

不在注释中提供可直接复用的攻击步骤、绕过思路或敏感内部路径。

## 实战代码示例

> 摘要:下面用两个最小示例展示如何做“高风险 AI 调用准入”和“异步审计告警”。

```python

# 目的:在服务端对高风险 AI 安全请求做准入校验

# 关键点:校验用户角色、工单号、用途标签,未满足条件直接拒绝

ALLOWED_ROLES = {"appsec", "incident_responder", "psirt", "core_maintainer"}

ALLOWED_USE_CASES = {"vuln_triage", "patch_review", "code_audit", "defense_research"}

def authorize_cyber_ai_request(user, ticket_id, use_case, model_name):

# 高能力网络安全模型需要更严格的角色限制

if model_name in {"gpt-5.4-cyber", "claude-mythos-preview"}:

if user.role not in ALLOWED_ROLES:

return False, "role_not_allowed"

# 必须绑定工单,避免脱离业务上下文滥用

if not ticket_id or not ticket_id.startswith("SEC-"):

return False, "invalid_ticket"

# 用途必须属于预定义防御场景

if use_case not in ALLOWED_USE_CASES:

return False, "invalid_use_case"

# 建议叠加 MFA / 硬件密钥校验,这里仅示意

if not user.mfa_verified:

return False, "mfa_required"

return True, "ok"

# 示例调用

class User:

def __init__(self, role, mfa_verified):

self.role = role

self.mfa_verified = mfa_verified

user = User(role="appsec", mfa_verified=True)

result = authorize_cyber_ai_request(

user=user,

ticket_id="SEC-2026-1042",

use_case="code_audit",

model_name="gpt-5.4-cyber"

)

print(result)

```

```yaml

# 目的:定义一个异步审计规则,对高风险提示或输出触发告警

# 关键点:只记录摘要与标签,不落完整敏感内容,减少数据暴露面

audit_rules:

- name: detect_high_risk_cyber_usage

enabled: true

match:

models:

- gpt-5.4-cyber

- claude-mythos-preview

risk_tags:

- exploit_generation

- lateral_movement

- credential_access

actions:

# 仅存摘要,避免原始敏感文本进入日志系统

- type: store_summary

fields:

- request_hash

- response_hash

- user_id

- ticket_id

- tool_calls

# 安全团队异步复核

- type: notify_soc

channel: secops-high

# 同一用户短时间多次命中时自动冻结访问

- type: rate_limit_and_hold

threshold: 3

window_minutes: 30

```

## 常见问题与排错

> 摘要:高能力安全模型最常见的问题,不是“模型不可用”,而是“治理链条不完整”。

1. **问题:模型接入后大家都能调用**

排查:是否只做了 API Key 管理,没有做角色和用途分级。

2. **问题:日志很多,但出了事无法追责**

排查:是否缺少工单号、审批人、工具调用链等关键上下文。

3. **问题:模型经常误拒绝正常安全分析请求**

排查:分类器规则是否过粗,是否缺少“防御用途”白名单标签。

4. **问题:提示注入导致模型读取了不该看的数据**

排查:工具权限是否最小化,是否默认给了过宽的检索或执行权限。

5. **问题:团队把模型输出当成结论直接执行**

排查:是否缺失人工审批、沙箱验证和变更前复核流程。

## 对普通工程团队最现实的影响:三件事必须提前做

> 摘要:即使你不用最强模型,组织也需要现在就建设面向未来的安全接入能力。

第一,**重新定义“高风险 AI 能力”**。

不要只按模型名字分级,而要按能力分级,例如:是否能进行漏洞分析、补丁差异推断、资产关联、命令生成、自动工具调用。Claude 4 System Card 已经说明,真正危险的是“能力放大与规模化” [8]。

第二,**把模型纳入安全运营体系**。

OpenAI 的 Safety Bug Bounty 很值得参考,它把提示注入、数据外泄、代理越权等纳入正式治理对象 [7]。企业内部也应建立类似通道:允许工程师报告模型滥用、越权、信息泄露、策略绕过。

第三,**从现在开始做分级接入,而不是等模型更强再补**。

OpenAI 的做法本质上是在说:更强能力即将到来,所以控制机制必须先到位 [2][5]。工程上,凡是等“问题已经出现”再做治理,代价通常都更高。

## 结论:这不是“AI 更聪明”这么简单,而是安全工程范式在切换

> 摘要:前沿模型进入高风险区间后,行业默认策略正从“广泛发布”转向“防御优先、分级开放、全过程审计”。

Anthropic 封存式有限开放 Mythos Preview、OpenAI 受信访问部署 GPT-5.4-Cyber,释放出的共同信号非常清楚:**最强模型的默认发布方式已经变了** [1][2]。这背后不是保守,而是一个工程事实——当模型足以显著提升漏洞发现、利用和攻击规模化能力时,模型接入本身就成了关键基础设施风险。

对团队的下一步建议很明确:

1. 先给 AI 能力分级,而不是给模型品牌分级;

2. 对高风险能力引入 SSO、MFA、工单绑定和审计回放;

3. 将提示注入、工具越权、数据泄露纳入常规安全测试;

4. 优先在人机协同、防御导向场景使用,不要默认全自动执行;

5. 建立内部 AI 安全问题上报机制,像处理传统安全漏洞一样处理模型滥用问题。

真正的变化不是“AI 开始危险”,而是**AI 已经强到必须按高风险工程系统来治理**。

## CSDN 发布建议(标签与专栏)

标签建议:人工智能、网络安全、Anthropic、OpenAI、DevSecOps、大模型安全、漏洞管理、安全工程

专栏建议:AI安全工程实战、前沿模型治理、企业级大模型落地、DevSecOps架构

## 参考资料

1. Project Glasswing: Securing critical software for the AI era

https://www.anthropic.com/glasswing

2. Trusted access for the next era of cyber defense

https://openai.com/index/scaling-trusted-access-for-cyber-defense/

3. Redacted Risk Report Feb 2026

https://www-cdn.anthropic.com/08eca2757081e850ed2ad490e5253e940240ca4f.pdf

4. Responsible Scaling Policy Updates

https://www.anthropic.com/responsible-scaling-policy

5. Introducing Trusted Access for Cyber

https://openai.com/index/trusted-access-for-cyber/

6. Responsible Scaling Policy Version 3.0

https://www.anthropic.com/news/responsible-scaling-policy-v3

7. Introducing the OpenAI Safety Bug Bounty program

https://openai.com/index/safety-bug-bounty/

8. Claude 4 System Card

https://assets.anthropic.com/m/6c940a1b69ed6a1c/original/Claude-4-System-Card.pdf

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)