AI 也能按设计规范出图?Qwen-Image-2512 本地海报生成实战

🚀 项目背景:为什么要做一个“本地海报生成器”?

在真实的产品宣传、品牌设计和内容运营场景中,“能生成图片”远远不够。我们往往需要的是:

-

文案内容必须准确:价格、优惠、CTA 不能乱编

-

版式要像“真实海报”:有层级、有留白、有网格

-

输出尺寸要可控:社媒、Banner、Poster 各不相同

-

数据和模型最好可私有化:不依赖公网 API,更安全、更稳定

因此,这个项目的目标并不是“再造一个文生图 Demo”,而是构建一个可用于真实商业场景的本地 AI 海报生成工作台。

在模型选择上,我使用的是 Qwen-Image-2512 ——这是阿里通义系列在图像生成方向的重要版本,具备以下几个非常适合“海报生成”的特性:

-

对 文字可读性与排版指令 的理解明显强于早期扩散模型

-

对结构化 Prompt(产品名 / 价格 / CTA)响应稳定

-

支持高分辨率输出,适合电商与品牌设计

-

可完全本地部署,适合私有算力环境

下面,我们就从代码出发,一步步拆解这个系统是如何搭建起来的。

⚡准备工作

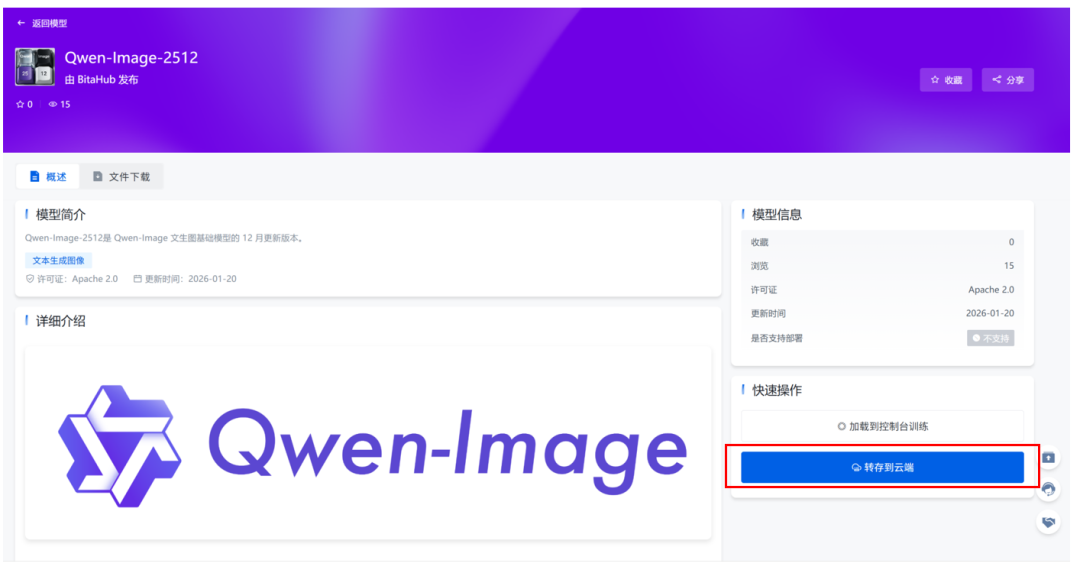

首先,进入 BitaHub 首页模型库搜索“Qwen-Image-2512”,并将其转存到个人的文件存储当中。

将上述准备好的模型文件夹挂载到 BitaHub 开发机任务的的文件存储中。此外,我们还需要定义容器端口,BitaHub 平台通过自定义容器端口功能,让外部能发 HTTP 请求到容器服务,Gradio 默认情况下使用端口号 7860 进行访问。

最后,选择单卡 A100 GPU,并通过JupyterLab访问方式进入开发环境。打开终端,通过 venv 创建虚拟环境→激活环境→安装依赖这一系列操作为项目搭建起独立运行环境。

python3 -m venv qwen_env

source qwen_env/bin/activate

pip -q install git+https://github.com/huggingface/diffusers

pip -q install transformers accelerate safetensors gradio pillow psutil🛠️ 代码深度解析

我们将代码分为六个核心部分,带你逐一攻克。

1. 环境准备与依赖导入

首先,我们需要引入处理图形、深度学习和界面交互的核心库。

import os

import gc

import random

import psutil

import torch

from diffusers import QwenImagePipeline

import gradio as gr这里使用了 diffusers(目前主流的扩散模型库)和 gradio(快速构建网页界面的利器)。

2. 显存管理:让模型跑得更稳

AI 模型是显存“大户”,为了防止程序崩溃,我们编写了 mem 和 cleanup 函数。

-

实时监控:随时查看 RAM 和显存占用。

-

强制回收:通过

gc.collect()和torch.cuda.empty_cache()及时释放不再使用的资源,确保在显卡上流畅运行。

os.environ["HF_HOME"] = "./hf_cache"

os.makedirs("./hf_cache", exist_ok=True)

def mem(tag=""):

"""实时监控内存和显存占用"""

ram = psutil.virtual_memory().used / 1e9

v_alloc = torch.cuda.memory_allocated() / 1e9 if torch.cuda.is_available() else 0

v_res = torch.cuda.memory_reserved() / 1e9 if torch.cuda.is_available() else 0

print(f"[{tag}] RAM={ram:.1f}GB | VRAM 已分配={v_alloc:.1f}GB 已预留={v_res:.1f}GB")

def cleanup(tag="cleanup"):

"""强制垃圾回收并清理显存"""

gc.collect()

if torch.cuda.is_available():

torch.cuda.empty_cache()

mem(tag)

# 基础环境检查

assert torch.cuda.is_available(), "本程序需要 GPU 运行环境"

print("使用的 GPU:", torch.cuda.get_device_name(0))

# 性能优化设置

torch.backends.cuda.matmul.allow_tf32= True

torch.set_float32_matmul_precision("high")

cleanup("初始化前")3. 模型加载与性能优化

LOCAL_MODEL_PATH = "/model-202601/Qwen-Image-2512"

DTYPE = torch.bfloat16

print(f"正在从本地加载模型: {LOCAL_MODEL_PATH} ...")

try:

pipe = QwenImagePipeline.from_pretrained(

LOCAL_MODEL_PATH,

torch_dtype=DTYPE,

low_cpu_mem_usage=True,

use_safetensors=True,

).to("cuda")

if hasattr(pipe, "vae") and pipe.vae is not None:

pipe.vae.to(dtype=torch.float32)

cleanup("模型加载完成")

except Exception as e:

print(f"模型加载失败,请检查路径是否正确: {e}")

exit(1)为了极致的生成速度,我们开启了 TF32 模式,并将 VAE 转换为 float32 以保证图像生成的稳定性,避免出现黑图或噪点。

4. 结构化提示词:AI 的“设计指南”

这是本项目的核心逻辑。我们通过 build_prompt 函数,将用户的零散需求(产品名、价格、优势)组装成一段结构严密的设计指令。

-

预设比例:提供了 Instagram、海报等多种常用尺寸方案。

-

确定性引导:明确要求 AI 保持“网格对齐”、“层级分明”,确保生成的不是随意的画作,而是专业的商业海报。

ASPECT_PRESETS = {

"Instagram Post (1:1) — 1328×1328": (1328, 1328),

"Instagram Story (9:16) — 928×1664": (928, 1664),

"YouTube / Banner (16:9) — 1664×928": (1664, 928),

"Poster (3:4) — 1104×1472": (1104, 1472),

"Slides (4:3) — 1472×1104": (1472, 1104),

"Fast Draft (1:1) — 768×768": (768, 768),

}

DEFAULT_NEG = " "

def build_prompt(product_name, product_desc, offer, price, cta, benefits, tone, style_keywords, language):

"""构建用于海报生成的结构化提示词"""

return f"""

Create a professional technology service promotional poster in {language}. Clean grid layout, strong hierarchy.

- Product name: "{product_name}"

- Product description: "{product_desc}"

- Offer headline (exact): "{offer}"

- Price (exact): "{price}"

- CTA button text (exact): "{cta}"

- Benefits (use these exact phrases, no typos):{benefits}

- Tone: {tone}

- Style keywords: {style_keywords}

- Text must be legible and correctly spelled.

- Do not add extra words, fake prices, or random letters.

- Align typography to a neat grid with consistent margins.

""".strip()

@torch.inference_mode()

def generate_image(product_name, product_desc, offer, price, cta, benefits, tone, style_keywords,

language, preset, negative_prompt, steps, true_cfg_scale, seed, show_seed):

w, h = ASPECT_PRESETS[preset]

prompt = build_prompt(product_name, product_desc, offer, price, cta, benefits, tone, style_keywords, language)

# 随机种子处理

if seed is None or int(seed) < 0:

seed = random.randint(0, 2**31 - 1)

seed = int(seed)

gen = torch.Generator(device="cuda").manual_seed(seed)

# 执行生成

result = pipe(

prompt=prompt,

negative_prompt=negative_prompt,

width=int(w),

height=int(h),

num_inference_steps=int(steps),

true_cfg_scale=float(true_cfg_scale),

generator=gen,

).images[0].convert("RGB")

return (seed if show_seed else None), result5. Gradio 交互界面:所见即所得

利用 gr.Blocks 布局,我们将界面分为左右两栏:

-

左侧: 参数输入区(产品描述、调性选择、高级设置)。

-

右侧: 结果展示区(生成的种子值、成品图片)。 这种设计符合大多数设计软件的操作习惯,直观且高效。

with gr.Blocks(title="Qwen Poster Studio (Local)") as demo:

gr.Markdown("## 🎨 Qwen Poster Studio — 本地部署版")

with gr.Row():

with gr.Column(scale=1):

product_name = gr.Textbox(value="BitaHub", label="产品名称")

product_desc = gr.Textbox(value="顶配 RTX 4090 算力集群,专为深度学习与 AI 创作打造", lines=2, label="产品描述")

offer = gr.Textbox(value="全网极低价,性能无保留", label="优惠标题")

price = gr.Textbox(value="¥1.48/h", label="价格")

cta = gr.Textbox(value="马上行动", label="CTA 按钮文字")

benefits = gr.Textbox(value="- 极致性价比\n- 顶配硬件性能\n- 开箱即用", lines=4, label="产品核心优势")

with gr.Row():

tone = gr.Dropdown(["Premium", "Minimal", "Bold", "Playful", "Tech"], value="Premium", label="调性")

language = gr.Dropdown(["English", "中文"], value="English", label="语言")

style_keywords = gr.Textbox(value="Server rack, futuristic circuit board lines, 8k resolution, cinematic lighting, 3D render style", label="视觉风格关键词")

preset = gr.Dropdown(list(ASPECT_PRESETS.keys()), value="Instagram Post (1:1) — 1328×1328", label="尺寸预设")

with gr.Accordion("高级选项 (Advanced)", open=False):

negative_prompt = gr.Textbox(value=DEFAULT_NEG, label="反向提示词", lines=2)

steps = gr.Slider(10, 80, value=50, step=1, label="推理步数 (Steps)")

true_cfg_scale = gr.Slider(1.0, 10.0, value=4.0, step=0.1, label="CFG Scale")

seed = gr.Number(value=-1, precision=0, label="随机种子 (-1 为随机)")

show_seed = gr.Checkbox(value=False, label="在输出中显示所用种子")

btn = gr.Button("开始生成海报", variant="primary")

with gr.Column(scale=1):

used_seed_out = gr.Number(label="本次使用的种子", precision=0)

image_out = gr.Image(label="生成的成品海报")

# 绑定点击事件

btn.click(

fn=generate_image,

inputs=[product_name, product_desc, offer, price, cta, benefits, tone, style_keywords,

language, preset, negative_prompt, steps, true_cfg_scale, seed, show_seed],

outputs=[used_seed_out, image_out]

)6. 启动服务

最后,通过 demo.launch 启动服务。设置 share=True 还可以生成一个临时外网链接,让你在手机上也能远程测试你的 AI 设计师。

if __name__ == "__main__":

print("\n" + "="*30)

print("模型已就绪,正在启动 Gradio 界面...")

print("="*30)

demo.queue().launch(

server_name="0.0.0.0",

server_port=7860,

share=True,

debug=True

)💡 如何使用?

将上述代码打包成一个完整的python文件并运行。

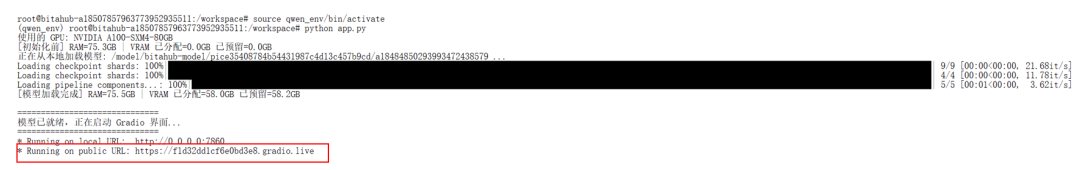

python app.py当终端显示出如下链接时,服务已经成功上线,点击 Public URL 即可进行访问。

-

输入产品信息:例如“4090 GPU 算力租赁”。

-

设置优惠内容:输入“新年特惠 7 折”。

-

选择风格:点击“Minimal(极简)”或“Tech(科技感)”。

-

生成:等待几秒,一张媲美专业设计师的精美海报就诞生了!

🌟 总结与展望

通过这段实战代码,我们不仅仅搭建了一个工具,更是实现了一次“设计工业化”的微型实验。Qwen-Image-2512 的本地部署不仅保障了数据隐私,更利用其强大的文字渲染优势,解决了 AI 绘画“不识字”的历史痛点。AI 的角色在这里发生了转变:它不再是取代设计师,而是将设计师从重复的排版、改字、对齐等繁琐劳动中解放出来,让设计回归到创意与策略本身。

温馨提示:

平台暂不支持一键部署,但已提供完整可下载资源,大家可根据教程自行搭建运行。另外,项目部分依赖包版本与最新版存在不适配情况,部署时请务必按照文中标注的具体版本号进行配置,详细依赖需求可查看最新说明,避免因版本问题导致运行异常

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)