基于 YOLO26 的多模态目标检测模型设计(RGB + IR 融合)

在复杂实际场景中,目标检测模型往往需要面对光照不足、遮挡严重以及低对比度等问题。传统基于 RGB 图像的检测方法在白天或理想环境下表现良好,但在夜间、烟雾环境或弱光条件下,其性能会显著下降。相比之下,红外(Infrared, IR)图像能够提供稳定的热辐射信息,不依赖可见光,从而在极端环境中仍具备良好的可观测性。因此,将 RGB 与 IR 两种模态进行融合,成为提升检测模型鲁棒性的重要方向。

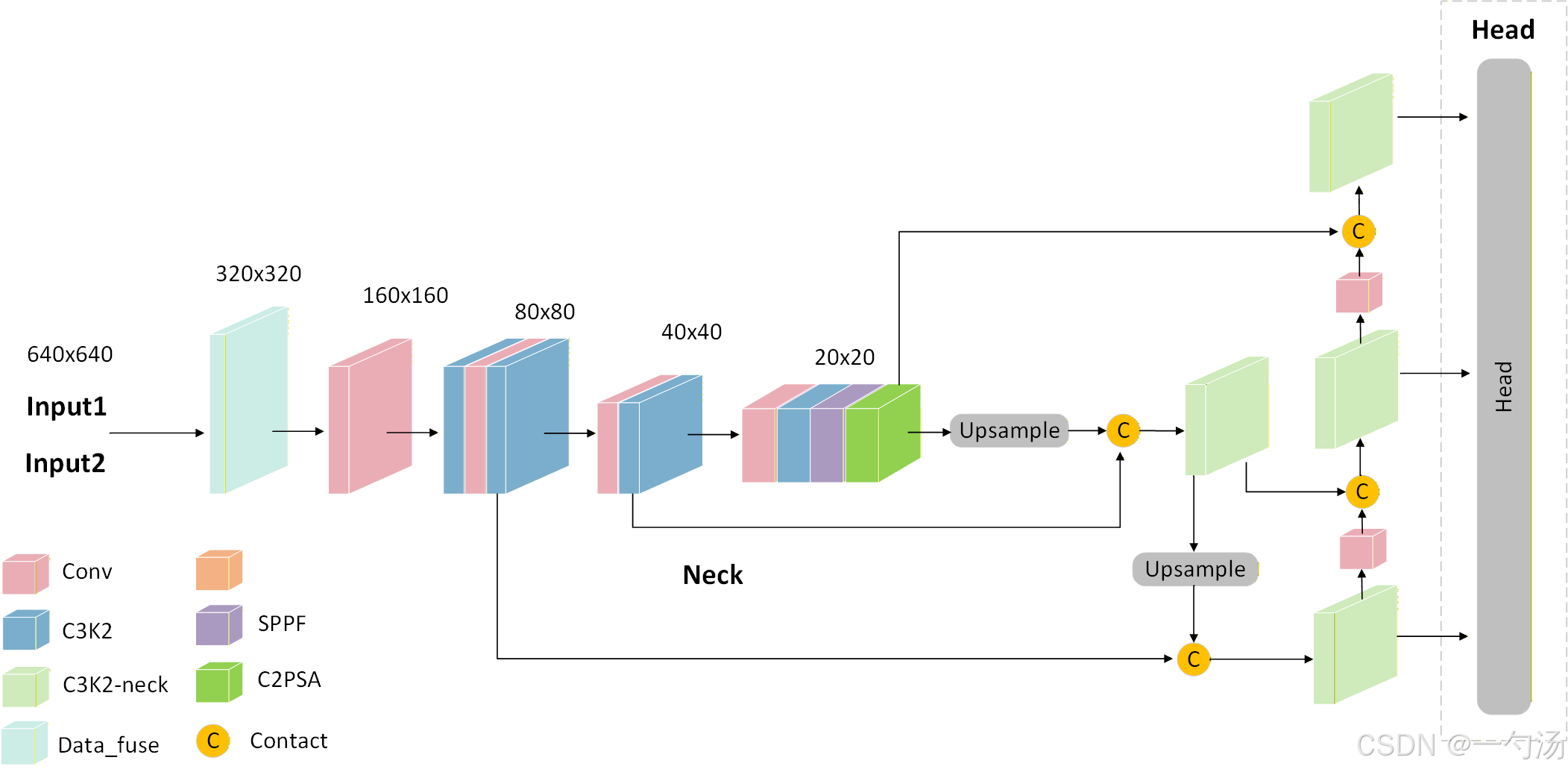

基于这一动机,本文设计了一种基于 YOLO26 的多模态目标检测模型。整体思路并不复杂,但具有很强的工程实用性:在输入阶段对 RGB 与 IR 图像进行融合,然后利用标准 YOLO 的 Backbone–Neck–Head 架构完成特征提取与目标检测。这种设计避免了复杂的跨模态结构,同时保留了 YOLO 系列模型高效、轻量的优势。

代码获取:https://github.com/tgf123/YOLOv8_improve

视频讲解:基于 YOLO26 的多模态目标检测模型设计(RGB + IR 融合)_哔哩哔哩_bilibili

模型整体结构

输入为两张对齐的图像(RGB 与 IR),尺寸均为 640×640。在进入主干网络之前,通过一个轻量级融合模块(ModalConcat)完成多模态信息整合,随后交由 YOLO26 主干网络进行特征提取,并通过多尺度检测头输出最终结果。

这种结构的核心优势在于:将多模态问题转化为单模态特征学习问题,从而可以直接复用成熟的目标检测框架。

这种方法属于典型的“早期融合(Early Fusion)”策略,其优点在于结构简单、计算开销小,并且可以无缝嵌入现有检测框架中。

本次改造严格遵循三大原则,确保方案的落地性:

-

最小化侵入:除输入端的融合模块外,完整保留 YOLO26 原生的 backbone、neck、head 结构,不修改任何原生模块,100% 兼容 Ultralytics 的全流程生态。

-

轻量化无负担:融合模块仅引入 1 个标准卷积层,几乎不增加参数量与计算量,改造后的模型与原生 YOLO26 的推理速度、显存占用基本一致。

-

端到端特性完整保留:完整继承 YOLO26 的 NMS-Free、无 DFL 的端到端特性,改造后的模型可直接导出部署,无需额外开发后处理逻辑

然而,由于没有显式建模模态之间的差异,该方法在面对模态分布差异较大或对齐误差较明显的场景时,仍存在一定局限性。

多模态融合带来的优势

相比单一 RGB 模型,引入 IR 模态后,模型在多个典型场景中表现出明显优势。例如,在夜间环境中,红外信息可以弥补可见光的不足;在烟雾或遮挡场景中,热信息有助于维持目标轮廓;在低对比度目标检测中,多模态信息能够显著提升区分能力。

尽管本文采用的 Early Fusion 方法已经具备良好的工程效果,但从研究角度来看,仍有较大的提升空间。

一种自然的改进方向是采用“双 Backbone”结构,使 RGB 与 IR 分别进行特征提取,再在中高层进行融合,从而实现更加充分的模态建模。此外,还可以引入注意力机制(如 SE、CBAM 或跨模态 Attention),动态调整不同模态的重要性。

进一步地,可以结合频域建模、小波变换或状态空间模型(如 Mamba)构建更高阶的多模态检测框架,从而在复杂工业场景中获得更优性能

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)