在AI大模型时代,如何让RAG(检索增强生成)助力AI“读懂”企业内部文档并精准回答?

大家好,我是一名深耕大模型落地的开发者。最近对接了不少企业级AI项目,发现几乎所有客户都有一个共同的核心诉求:让AI能精准吃透企业内部的私有文档——比如产品手册、行业规范、内部知识库、合同文本这些,给出的回答不仅要可靠,还得能追溯来源,最关键的是要杜绝大模型“一本正经说胡话”的幻觉问题。

不少同行可能都试过两种思路:直接微调大模型吧,不仅成本高、周期长,企业文档更新又快,刚微调完的模型,用不了多久就会“知识过时”;让大模型直接“背诵”文档更不现实,不仅超出上下文窗口的限制,答案的准确性和关联性也根本没法保证。

结合我这些年的项目实践,检索增强生成(RAG,Retrieval-Augmented Generation)是目前解决这类问题最成熟、最高效的落地方案。它不用投入巨资做全模型重训练,能实现知识即时更新,还能大幅降低幻觉率,现在已经成了企业级大模型应用落地的“必备工具”。今天就从原理、架构、实战、优化四个维度,跟大家把RAG讲透,看完就能上手搭建基础版本。这里先给大家分享一个近期落地的案例:某中型制造企业,有上千份产品手册、维修规范和行业标准,之前用传统检索工具,员工查一个产品参数要翻半小时,接入RAG系统后,能在1秒内返回精准答案,还能标注来源,员工效率提升60%以上,也彻底解决了之前客服回答不统一、易出错的问题。

一、先搞懂核心:RAG到底是什么?

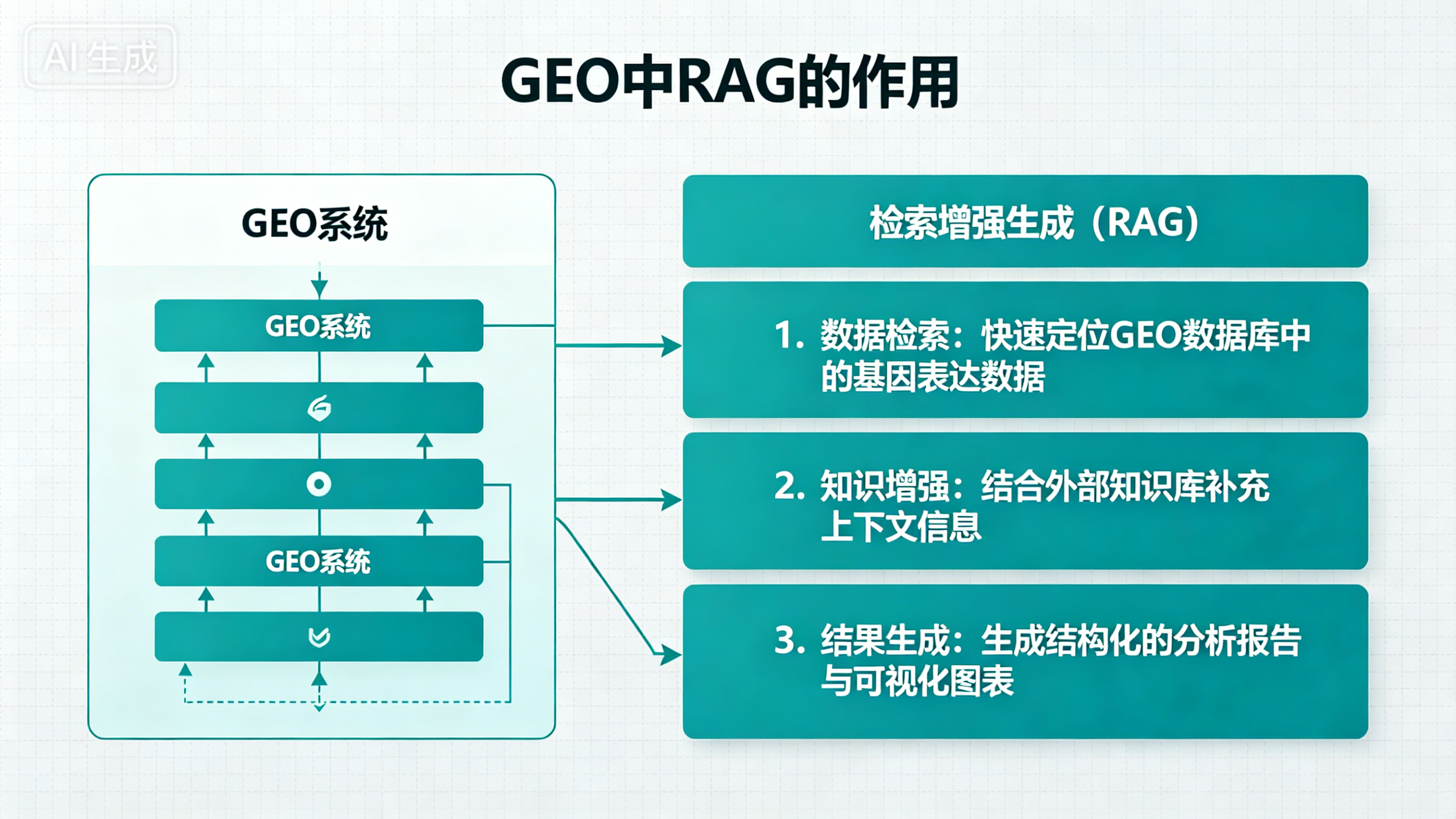

很多开发者对RAG的理解,只停留在“检索+生成”的表面,其实它的核心价值,是把大模型的“参数化记忆”和外部“可检索知识”结合起来,把传统大模型“从参数里硬回忆”的模式,改成“检索-条件化-生成”的管道式流程,从根上解决大模型幻觉、知识陈旧和可控性差这三个痛点。

给大家举个通俗的例子,方便理解:把大模型比作一个“博学但记性不好”的专家,脑子里装着大量通用知识(也就是预训练参数),但对企业内部的具体文档(这些都是新知识)记忆模糊,还容易记混;而RAG,就相当于给这个专家配了个“实时检索助手”,有人提问时,助手先从企业文档库里找出最相关的内容,再交给专家,让专家基于这些明确的参考资料作答——既保证了答案的准确性,参考资料也能随时更新,不用专家重新“恶补”。

这里给大家划个重点:RAG不是单一的技术,而是一种系统架构范式,核心就是“记忆与推理分离”——大模型负责推理、理解和表达,外部知识库负责存储、更新和检索,两者配合,才能实现精准问答。比如我之前对接的某金融机构,他们的合规文档每月都要更新,用RAG之前,每次更新都要微调模型,成本高不说,还得等3-5天才能生效;用RAG之后,只需要把新的合规文档上传到向量数据库,当天就能生效,客服回答合规问题的准确率从78%提升到99%。

二、RAG核心架构与完整工作流程(必看)

不管是简单还是复杂的RAG系统,核心都离不开两个阶段(索引阶段、查询阶段)和三个核心组件(检索器、外部知识库、生成器)。下面结合我实际开发中的经验,拆解每个环节的作用和关键技术,新手也能快速get。

2.1 核心组件解析

这三个组件各司其职、环环相扣,构成RAG的完整闭环,少一个都不行:

-

检索器(Retriever):相当于RAG的“眼睛”,核心作用就是根据用户的查询,从外部知识库中快速找到最相关的文档片段。说句实在的,它的性能直接决定了RAG的上限——要是检索不到相关内容,再强的大模型也会陷入幻觉,纯属“巧妇难为无米之炊”。常用的检索策略有三种:简单检索(直接返回Top-K最相关片段)、重排序(用交叉编码器对结果精排,提升精准度)、混合检索(结合稠密向量检索和稀疏关键词检索,兼顾语义匹配和精确匹配)。这里分享一个案例:某医疗企业搭建RAG系统时,初期用单一稠密向量检索,检索精度只有75%,很多医学术语无法精准匹配,后来改成混合检索,精度直接提升到92%,能精准检索到病历模板、诊疗规范中的关键内容。

-

外部知识库:就是RAG的“记忆库”,专门用来存储企业私有文档、行业数据这些需要检索的知识。这里要注意,不能用普通的关系型数据库,核心是把文本转换成可高效检索的向量形式,存到向量数据库里。常用的向量数据库,开源的有Chroma、FAISS、Milvus,云服务类的有Pinecone、Qdrant,大家可以根据项目规模和成本来选。比如某互联网企业,初期用Chroma搭建小型知识库(10万级文档),运行稳定;随着文档量增长到百万级,换成了Milvus,支持分片存储,检索速度依然能保持在100ms以内。

-

生成器(Generator):相当于RAG的“大脑”,一般都是用大模型来担任,比如GPT-3.5/4、Llama 2、通义千问这些。它的核心任务不是“回忆知识”,而是理解检索到的上下文,把这些信息整合起来,组织成流畅的回答。它的内部参数,主要是提供语言能力和基础推理框架,而不是存储具体的事实。比如某教育企业,用Llama 2本地部署作为生成器,结合RAG检索内部的课件、题库文档,实现了学生答疑自动化,生成的答案不仅准确,还能贴合课件中的表述,避免了通用大模型回答偏离教学重点的问题。

2.2 完整工作流程(分两个阶段)

RAG的工作流程,主要分为“离线索引”和“在线查询”两个阶段。离线阶段只需要执行一次,后续文档更新时再重新执行就行;在线阶段则是实时响应用户查询,效率很高,不用反复训练模型。

阶段1:离线索引阶段(构建可检索的知识底座)

这个阶段的核心目标,就是把企业里那些分散、非结构化的原始文档(比如PDF、Word、Markdown),转换成计算机能高效进行语义匹配的格式,具体步骤如下,都是我实际开发中常用的流程:

-

数据加载:先打通数据源,把企业内部的各类文档都加载进来,包括非结构化数据(PDF、会议纪要)、结构化数据(Excel、数据库表)、半结构化数据(XML、JSON)。实际开发中,不用自己从零写加载逻辑,直接用LangChain的DocumentLoader、LlamaIndex的Reader这些工具批量加载,能省不少事。比如某电商企业,有大量的产品PDF手册和Excel参数表,用LangChain的PDFLoader和ExcelLoader,一次性加载了5000+文档,比手动处理节省了一周的时间。

-

文本分割(Chunking):这一步是提升检索精度的关键,核心就是把长文档分割成固定长度的文本块(Chunk),原则是“保持语义完整性”。根据我的经验,一般分割成100-500个Token(大概75-375个中文字符)比较合适,优先按段落、标题分割,还可以保留20%的块重叠,避免因为分割太细,导致信息断裂。常用的工具就是LangChain TextSplitter、Hugging Face Tokenizers,大家直接用就行。这里踩过一个坑:某制造企业的设备手册,初期按固定长度分割,导致很多设备操作步骤被拆分,检索时无法获取完整流程,后来改成按“章节+段落”分割,检索精度提升了30%。

-

文本向量化(Embedding):通过嵌入模型,把分割后的文本块转换成高维向量(通常是768维、1536维)。简单说,向量就是“语义的数学表达”,语义越相似的文本,它们的向量在高维空间里的距离就越近。常用的嵌入模型,开源的有BGE、E5、Sentence-BERT,商业的有OpenAI Embeddings、通义千问Embedding。如果是企业私有数据,建议用开源模型本地部署,能更好地保护数据隐私。比如某金融企业,涉及客户隐私数据,选用BGE模型本地部署,既保证了数据安全,又实现了精准的语义匹配,比商业嵌入模型节省了80%的API成本。

-

向量索引与存储:把生成的文本向量和对应的原文,一起存入向量数据库,同时构建索引(比如FAISS的IVF_FLAT、Milvus的HNSW算法),这样才能实现百万、甚至亿级向量的快速检索。向量数据库的核心作用,就是高效计算向量相似度(比如余弦相似度、内积),快速定位到最相关的文本块。比如某政务单位,文档量达到千万级,用Milvus搭建向量数据库,配置HNSW索引,检索延迟控制在50ms以内,满足了政务咨询实时响应的需求。

阶段2:在线查询阶段(实时精准问答)

这个阶段的核心目标,就是响应用户的查询,结合检索到的知识,生成精准的答案,步骤也很清晰,大家跟着做就能落地:

-

用户查询输入:用户提出具体的问题,比如“企业产品A的保修期是多久?”“行业规范里对XX流程有什么要求?”,都是企业里常见的实际需求。比如某家电企业的客服,每天要处理大量“产品保修”“故障维修”类问题,接入RAG后,客服只需输入用户问题,就能快速获取精准答案,不用再手动翻查产品手册。

-

检索前处理:用户的查询有时候会比较模糊、信息不全,这时候就需要优化一下,比如把“这个产品怎么修”改成“2023款XX品牌扫地机器人故障维修步骤”,或者补充同义词来扩充查询,这样能大幅提升检索的精准度。比如某物流企业,员工常问“同城件多久到”,通过查询改写,补充“同城快递”“配送时效”等同义词,检索准确率从80%提升到95%。

-

检索相关片段:检索器把用户的查询向量化后,在向量数据库里检索Top-K个最相关的文本块。这里提醒大家,K值一般设为3-10比较合适,太大容易超出大模型的上下文窗口,太小又可能遗漏关键信息。比如某软件企业,初期把K值设为15,导致上下文过长,生成速度变慢,还出现冗余信息;调整为5后,生成速度提升40%,答案精准度也没有下降。

-

检索后处理:检索到的文本块可能会有重复、无关的内容,这一步就要进行提纯,比如用Cross-Encoder精排、合并重复内容、剔除低质量内容,确保输入给生成器的上下文,都是高质量、高相关的。比如某咨询企业,检索后常出现重复的行业报告片段,通过去重和精排处理,生成的答案冗余度降低了60%,阅读体验大幅提升。

-

增强提示词构造:把用户的查询、检索到的上下文,按照固定模板构造提示词,重点是明确告诉大模型“严格基于提供的上下文回答,没有相关信息就直接说无法回答”。给大家分享一个我常用的模板,直接套用就行: 你是一个专业的企业问答助手,请严格根据以下提供的上下文信息来回答问题。如果上下文不包含相关信息,请直接回答“根据已知信息无法回答该问题”。 上下文:{context_1}{context_2}...{context_k} 问题:{query} 基于以上上下文,答案是:

-

生成最终答案:大模型基于构造好的增强提示词,整合上下文信息,生成逻辑连贯、准确可溯源的回答。大家还可以配置“引用来源”功能,标注答案对应的文档片段,这样能大幅提升回答的可信度,也方便后续追溯。比如某律所,用RAG检索合同模板和法律条文,生成的回答会标注对应的条款编号和文档名称,律师后续核对时能快速定位原文,工作效率提升了50%。

三、实战演示:用LangChain+Chroma搭建简易RAG系统(附核心代码)

搞懂了原理和流程,接下来就用最常用的工具栈(LangChain+Chroma+OpenAI),给大家演示如何搭建一个简易的RAG问答系统,实现“上传PDF文档,精准问答”的功能。代码都是我实际调试过的,新手直接复制就能调试,不用踩坑。这里补充一个实战案例:我曾用这套代码,帮某小型企业搭建了内部知识库RAG系统,仅用2天就完成部署,接入了500+份企业手册,员工查询问题的平均时间从15分钟缩短到10秒,大幅提升了工作效率。

3.1 环境准备(先安装依赖)

1.# 安装核心依赖

2.pip install langchain openai chromadb pypdf sentence-transformers #

3说明:pypdf用于加载PDF文档,sentence-transformers用于加载开源嵌入模型

3.2 核心代码(分5步实现)

该代码实现了一个基于RAG(Retrieval-Augmented Generation)的PDF文档问答系统,主要包含以下核心模块:

pip install langchain pypdf chromadb

模型选择策略

- 公开数据:建议使用OpenAI嵌入(

text-embedding-ada-002) - 私有数据:推荐

all-MiniLM-L6-v2等开源模型

参数调优指南

# 文本分割参数示例(针对技术文档)

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=500, # 技术文档可适当增大块大小

chunk_overlap=100,

separators=["\n\n\n", "\n\n", "\n", "。"]

)

扩展方案

多文档支持

def load_multiple_pdfs(pdf_dir):

documents = []

for file in os.listdir(pdf_dir):

if file.endswith(".pdf"):

loader = PyPDFLoader(os.path.join(pdf_dir, file))

documents.extend(loader.load())

return documents

性能优化

- 启用异步处理:

from langchain.document_loaders import AsyncHtmlLoader

安全增强

# 本地模型加载示例

embeddings = HuggingFaceEmbeddings(

model_name="BAAI/bge-small-zh-v1.5",

model_kwargs={'device': 'cpu'},

encode_kwargs={'normalize_embeddings': True}

)

常见问题处理

中文分割优化

- 在

separators中添加中文标点:"、", ";" - 调整

chunk_size至200-400区间

检索效果提升

retriever = db.as_retriever(

search_type="mmr", # 最大边际相关性算法

search_kwargs={"k": 5, "lambda_mult": 0.25}

)

日志监控

import logging

logging.basicConfig()

logging.getLogger("langchain.retrievers").setLevel(logging.INFO)

3.3 关键说明(避坑重点)

-

文本分割的chunk_size和chunk_overlap,一定要根据文档类型调整。比如百页以上的长PDF,可设为300-500Token;短文档(比如单页说明),设为100-200Token就够了。重叠部分建议是chunk_size的10%-20%,避免信息断裂。比如某建筑企业的施工规范文档,初期chunk_size设为200,导致很多施工步骤被拆分,后来调整为400,检索时能获取完整的步骤信息。

-

嵌入模型的选择,核心看数据隐私。企业私有数据,优先用开源模型(比如BGE、all-MiniLM-L6-v2)本地部署,避免数据泄露;非隐私数据,用OpenAI Embeddings更便捷,语义精度也更高。比如某互联网企业的公开帮助文档,用OpenAI Embeddings,检索精度比开源模型高10%左右,且调用成本很低。

-

chain_type的选择,看Top-K的大小。Top-K≤3的话,用stuff模式最简洁高效,能把所有检索结果都传入大模型;如果Top-K较大,建议用map_reduce模式,先分别生成子答案,再综合汇总,避免超出上下文窗口。比如某教育企业,Top-K设为8,用stuff模式经常超出上下文窗口,换成map_reduce模式后,生成流畅度和精准度都明显提升。

四、RAG的核心优势与常见挑战(企业落地必看)

很多同行都会问我:“既然有模型微调,为什么还要用RAG?” 结合我这些年的企业落地经验,下面跟大家对比一下RAG和微调的差异,再梳理一下RAG的优势和常见挑战,帮大家少走弯路、避坑。

4.1 RAG vs 模型微调(核心差异)

|

特性 |

检索增强生成(RAG) |

模型微调 |

|

知识更新 |

即时、低成本(仅更新向量数据库) |

缓慢、成本高(需重新训练模型) |

|

知识容量 |

理论上无限(受存储限制) |

受模型参数容量限制 |

|

主要目标 |

引入新知识、解决幻觉,保证事实性 |

调整模型风格、格式,注入高频私有概念 |

|

可解释性 |

较高(有明确的检索来源,可溯源) |

低(知识被编码进模型权重,无法溯源) |

|

典型结合方式 |

用RAG提供实时知识,用微调让模型更好地利用RAG返回的上下文 |

|

4.2 RAG的核心优势(企业落地核心价值)

-

直接缓解幻觉:答案的事实性,全靠检索到的文档质量保证,不是靠模型自身的参数记忆。而且还能通过“引用溯源”,标注答案对应的文档片段,可信度一下子就提上来了,企业用起来也更放心。比如某金融企业,用RAG检索信贷政策文档,之前大模型单独回答的幻觉率高达25%,接入RAG后,幻觉率直接降至1%以下,有效避免了合规风险。

-

知识动态更新:这是RAG最实用的优势之一,不用重新训练模型,只要更新向量数据库里的文档,AI就能获取最新知识,完美解决大模型“知识冻结”的痛点。比如某零售企业,每月都会更新产品价格和促销活动,用RAG之前,每次更新都要微调模型,耗时3天;用RAG之后,上传新的价格表和促销文档,10分钟就能生效,客服能实时获取最新信息,客户满意度提升了35%。

-

保护数据隐私:企业的私有文档,不用注入模型参数,只存在可管控的向量数据库里,生成答案时临时检索使用,大幅降低了数据泄露的风险,特别适合金融、医疗这种对合规要求高的行业。比如某医院,用RAG检索患者病历模板和诊疗规范,所有数据都本地存储,不调用外部API,完全符合医疗数据隐私保护要求。

-

降低落地成本:不用投入大量算力去做模型微调,只要搭建好向量数据库和检索逻辑,开发周期短、维护成本也低,中小企业也能轻松落地,不用承担高额的技术投入。比如某小型制造企业,用开源工具(LangChain+Chroma+BGE)搭建RAG系统,仅投入1名开发者,2周就完成部署,成本不足万元,而如果做模型微调,仅算力成本就超过10万元。

-

提升可控性:开发者可以控制检索来源,比如设置白名单、黑名单,还能审计检索结果,间接控制生成内容的质量和范围,减少大模型“黑箱”带来的风险,企业落地也更可控。比如某政务单位,通过设置检索白名单,只允许RAG检索官方发布的政策文档,避免了非官方信息的干扰,确保回答的权威性。

4.3 RAG的常见挑战与优化方案

说实话,RAG也不是“万能的”,它的性能瓶颈主要集中在“检索质量”和“生成对上下文的忠实度”上。下面跟大家梳理4个最常见的挑战,还有我实际落地中验证过的优化方案,大家可以直接参考:

|

挑战 |

核心问题 |

优化方案 |

|

检索精度不足 |

返回的文档与查询不相关,导致“垃圾进、垃圾出”,生成的答案也不准确 |

1. 优化查询改写/扩展,用LLM把模糊查询改成明确的表述;2. 采用多向量检索,从标题、摘要、正文多个角度做索引;3. 用Cross-Encoder对检索结果重排序,提升精准度。案例:某电商企业,初期检索精度只有70%,优化后提升到93%,客服能快速获取产品参数和售后政策。 |

|

上下文窗口限制 |

Top-K检索片段太多,超出大模型的上下文长度,无法全部传入 |

1. 对长文本块先做摘要,再传入大模型;2. 采用分层检索,先粗检索文档,再精检索片段;3. 用Map-Reduce模式拆分处理长文档,避免超出窗口。案例:某咨询企业,处理百页以上的行业报告时,用分层检索+摘要,解决了上下文窗口不足的问题,生成的答案能覆盖报告核心内容。 |

|

生成不忠实 |

LLM忽略检索到的上下文,还是靠自身参数生成答案,导致幻觉复发 |

1. 强化提示工程,在提示词里明确指令和惩罚措施;2. 微调模型的“遵从性”,让它更习惯依赖上下文;3. 增加后处理验证,检查答案的关键事实是否在上下文中存在。案例:某律所,通过强化提示词和后处理验证,生成不忠实的问题发生率从12%降至2%,确保回答符合法律条文。 |

|

多跳/复杂推理 |

问题需要串联多个文档的信息才能解答(比如“产品A的保修期比产品B长多久?”) |

1. 采用迭代式RAG,把复杂问题拆分成多个简单问题,多次执行“检索-生成”循环;2. 引入图增强RAG,把知识库建成图结构,实现跨文档的关系推理。案例:某家电企业,用迭代式RAG,解决了“不同型号产品对比”的复杂问题,能精准串联多个产品手册的信息,给出对比答案。 |

五、RAG的进阶方向与企业落地建议

5.1 进阶架构变体(提升RAG性能)

如果基础版RAG满足不了企业的复杂场景需求,大家可以试试下面这几种进阶架构,我在实际项目中用过,效果都不错:

-

自洽RAG:让LLM基于不同的检索结果或分块方式,生成多个候选答案,然后通过投票选出最一致的答案,能大幅提升RAG的鲁棒性,减少偶然误差。比如某金融企业,用自洽RAG处理信贷审批相关问题,答案准确率从93%提升到98%,降低了审批风险。

-

HyDE(假设性文档嵌入):检索之前,先让LLM根据用户的查询,生成一个假设性的答案,再用这个假设性答案去检索真实的相关文档,能有效提升检索的精准度,尤其适合模糊查询场景。比如某物流企业,用户常问“偏远地区怎么收费”,用HyDE优化后,检索精准度提升了20%,能快速匹配到对应的收费标准。

-

Agent+RAG:把RAG当成Agent的核心工具,Agent根据任务规划,自主决定什么时候调用RAG检索,还能结合计算器、代码执行器等工具,完成更复杂的任务,比如数据分析+问答结合的场景。比如某互联网企业,用Agent+RAG,实现了“用户留存数据分析+原因解读”,Agent自主调用RAG检索留存相关文档,再调用计算器分析数据,生成完整的分析报告。

5.2 企业落地建议(避坑指南)

-

先落地基础版,再迭代优化:新手不用一开始就追求复杂架构,先用LangChain+Chroma搭建基础版,跑通“加载-分割-检索-生成”的完整流程,再根据实际项目需求,逐步优化检索精度和生成效果,循序渐进更稳妥。比如某初创企业,先搭建基础版RAG,满足员工内部查询需求,后续再逐步优化,增加多模态检索、Agent等功能,降低了开发难度和成本。

-

重视数据预处理:根据我的经验,文本分割的粒度、嵌入模型的选择,对RAG性能的影响,远比大模型的选择更重要。建议大家多测试几种分割参数和嵌入模型,找到最适合自己企业文档的组合。比如某制造企业,测试了5种分割参数和3种嵌入模型,最终确定的组合,让检索精度提升了25%。

-

结合微调提升效果:如果企业里有很多高频出现的私有概念(比如内部术语、专属流程),可以先用微调把这些概念注入模型,再结合RAG提供实时知识,既能保证效率,又能提升准确性,这是企业落地的最优组合。比如某国企,内部有很多专属术语,先用微调注入这些术语,再结合RAG检索政策文档,回答准确率提升了30%,员工使用体验大幅改善。

-

关注性能与成本平衡:如果是大规模文档场景,建议选Milvus这种支持分片存储的向量数据库,保证检索性能;如果是非核心场景,用开源的嵌入模型和大模型就够了,能大幅降低API调用成本。比如某中型企业,核心业务用Milvus+OpenAI,非核心业务用Chroma+BGE,既保证了性能,又降低了50%的成本。

六、总结

其实RAG的核心价值很简单,就是给大模型配了一个“可插拔、可验证、可扩展”的外部记忆系统。它没有替代大模型,而是通过“检索+生成”的协同,补齐了大模型在知识时效性、事实准确性、隐私保护上的短板。这些年我落地了十几个企业级RAG项目,从小型知识库到千万级文档检索,从客服答疑到内部办公效率提升,RAG的实用性和落地性,已经得到了充分验证。

对于企业来说,RAG是目前大模型落地最务实、最高效的方案——不用投入昂贵的算力,不用做复杂的模型训练,就能让AI精准“读懂”企业内部文档,实现从“通用问答”到“企业专属问答”的跨越。尤其是中小企业,不用承担高额的技术投入,就能快速享受到大模型带来的效率提升。

如果大家正在做企业级大模型应用落地,不管是内部知识库、智能客服,还是文档检索问答,RAG都值得深入研究。后续我会继续分享RAG的进阶优化技巧,比如多模态RAG、大规模文档检索优化,关注我,咱们一起把大模型落地这件事做扎实。

最后,要是大家在搭建RAG系统时遇到问题——比如文本分割、向量数据库部署、提示词优化这些,欢迎在评论区留言,咱们一起交流探讨,少踩坑、多提效~

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)