项目介绍 MATLAB实现基于ResidualTrend-Transformer 线性残差趋势模型(ResidualTrend)结合 Transformer 编码器进行多变量时间序列预测的详细项目实例

MATLAB实现基于ResidualTrend-Transformer 线性残差趋势模型(ResidualTrend)结合 Transformer 编码器进行多变量时间序列预测的详细项目实例

更多详细内容可直接联系博主本人 加v 我的昵称(nantangyuxi)

或者访问对应标题的完整博客或者文档下载页面(含完整的程序,GUI设计和代码详解)

多变量时间序列预测作为数据科学与机器学习领域的一个核心任务,广泛应用于金融市场分析、气象预报、智能制造、交通流量预测等众多实际场景。随着数据维度和复杂度的不断增加,传统的时间序列模型如ARIMA、VAR等,已难以满足高维、多变量数据中的复杂非线性关系捕捉和长期依赖特征挖掘需求。近年来,基于深度学习的模型,尤其是Transformer结构,因其强大的全局依赖建模能力和并行计算优势,成为多变量时间序列预测的研究热点。然而,Transformer模型在时间序列预测领域仍面临趋势建模不足、线性成分捕捉不够精准等挑战。

ResidualTrend-Transformer模型应运而生,旨在通过引入线性残差趋势模块来补偿Transformer编码器在捕捉时间序列中线性趋势成分的不足,从而实现对多变量时间序列的精准预测。该模型将时间序列分解为线性趋势成分和非线性残差成分,线性趋势通过残差趋势模块建模,非线性残差通过Transformer编码器提取复杂时序特征,最终两部分结果融合进行预测。该思路有效结合了传统时间序列方法与现代深度学习模型的优势,提升了模型对长期趋势和短期波动的综合捕捉能力。

此外,多变量时间序列数据本身存在多重复杂性:不同变量间存在动态的相互影响关系,数据的噪声和异常值频繁出现,时序数据的非平稳性增加预测难度。ResidualTrend-Transformer以其模块化设计和灵活结构,能够针对不同变量的趋势和残差进行差异化建模,并借助Transformer的自注意力机制捕捉全局时序依赖,从而增强模型的泛化能力和稳定性。这对于实际生产环境中要求高精度和鲁棒性的多变量时间序列预测任务,具有重要的现实意义和推广价值。

在MATLAB环境下实现这一模型,不仅充分利用其强大的矩阵计算能力和丰富的信号处理工具箱,还能结合深度学习工具箱的Transformer结构,形成一个完整且高效的时间序列预测框架。该项目旨在推动多变量时间序列预测技术的发展,提升工业、金融、交通等领域预测系统的智能化水平,为相关决策提供科学依据和技术支撑。

项目目标与意义

精准捕捉时间序列线性趋势

项目的首要目标是通过ResidualTrend模块对多变量时间序列的线性趋势成分进行准确建模。时间序列中往往存在稳定且可预测的线性变化趋势,这部分信息对中长期预测具有重要价值。采用线性残差趋势模型对趋势成分进行分离和拟合,能够降低数据噪声干扰,提高趋势预测的鲁棒性和准确性。精准的趋势捕捉为后续的非线性建模提供坚实基础,推动模型整体性能提升。

利用Transformer编码器挖掘非线性复杂时序特征

Transformer编码器模块专注于多变量时间序列中的非线性残差部分,利用自注意力机制捕捉全局时序依赖和变量间复杂关联。相比传统RNN、LSTM模型,Transformer能更高效地处理长序列并行计算,同时具备动态权重分配优势,有助于发现多变量间深层次的非线性关系。这为实现更精准的短期波动预测提供了技术保障。

实现多变量协同预测能力

多变量时间序列中,各变量之间相互影响,联合建模有助于提高预测的整体准确性和稳定性。项目通过设计结构合理的多变量输入接口和融合策略,确保线性趋势和非线性残差两部分在多个变量之间能够充分交流信息,提升整体预测效果,满足实际应用中复杂系统协同预测的需求。

构建模块化、可扩展的预测框架

项目致力于开发一个结构清晰、模块独立且便于扩展的预测框架。线性趋势模块和Transformer模块可独立调试和优化,同时支持替换升级其他趋势分析或编码器结构。此框架的模块化设计方便后续集成新技术或扩展至更多变量维度,提高系统的灵活性和适应性。

提高模型的鲁棒性和泛化能力

通过残差趋势分解和Transformer自注意力机制的协同作用,有效缓解时间序列中异常点和噪声干扰对模型性能的影响。线性趋势建模稳定性强,非线性残差由Transformer捕获复杂特征,二者互补提升模型对多种数据分布和不同任务场景的泛化能力,增强模型在实际环境中的适用性。

在MATLAB平台上实现完整方案

利用MATLAB丰富的数值计算和深度学习工具,项目完成从数据预处理、模型搭建、训练到预测的完整流程实现,形成一套可复现、易操作的时间序列预测解决方案。为科研人员和工程师提供便捷的研究平台和技术积累,促进多变量时间序列预测方法的推广和应用。

推动多领域智能决策支持

精准的多变量时间序列预测对金融风险控制、智能制造设备维护、城市交通管理和气象预报等多个领域意义重大。项目的实施将提升相关系统的预测精度和响应速度,助力企业和机构实现智能化管理和优化调度,提高资源利用效率和安全性,推动智能决策支持技术的进步。

项目挑战及解决方案

复杂多变量之间的动态依赖关系建模难题

多变量时间序列中的变量之间常常存在非线性且时变的相互影响关系,传统模型难以全面捕捉。为解决该问题,项目引入Transformer自注意力机制,通过动态计算序列中不同时间点和变量间的关联权重,实现对多变量间复杂依赖的高效建模。同时残差趋势模块负责趋势成分,减轻非线性建模负担,使模型聚焦关键特征,提升预测精度。

长期趋势与短期波动并存的建模矛盾

时间序列中往往存在长期稳定趋势和短期波动两种不同属性,单一模型难以兼顾。项目采用ResidualTrend模块先分离线性趋势,再用Transformer编码器针对残差建模非线性波动,两部分互为补充,保证模型既能捕获全局趋势,又能敏感响应局部变化,显著提升整体预测性能。

高维数据下的计算复杂度和训练难度

多变量时间序列维度高,序列长度长,导致Transformer模型计算资源消耗大,训练复杂。为此,项目采取数据降维预处理、序列切片策略以及Transformer层数和头数合理设计,优化模型结构和训练参数,平衡模型复杂度和性能,确保训练过程高效且稳定。

数据噪声与异常值的干扰

实际时间序列数据常含噪声和异常点,影响模型预测稳定性。ResidualTrend模块利用线性趋势拟合,有效滤除部分噪声成分,提升数据质量;Transformer自注意力机制对输入进行加权处理,减少异常点对整体模型的冲击。两者结合显著增强模型鲁棒性和对异常的容忍度。

时间序列非平稳性和多尺度特征处理

时间序列数据往往表现出非平稳性和多尺度波动特征,传统模型难以适应。项目通过残差趋势分解消除非平稳线性趋势影响,使剩余残差更接近平稳序列,便于Transformer捕捉多尺度非线性特征。该设计有效应对时序数据复杂性,提升预测准确率。

模型参数调优及过拟合风险控制

复杂深度模型易出现过拟合现象,降低泛化能力。项目在模型训练过程中采用正则化方法、早停策略、交叉验证和超参数网格搜索,细致调节学习率、批大小、层数、头数等关键参数,防止过拟合,确保模型在测试数据上的稳定表现。

实现MATLAB环境下的高效集成与调试

MATLAB虽具备深度学习工具箱,但在实现Transformer架构时存在灵活性限制。项目针对MATLAB深度学习框架的特点,设计了适配ResidualTrend模块与Transformer编码器的接口,实现两者无缝衔接。通过模块化代码结构和详尽注释,简化调试过程,提高开发效率。

多变量预测结果的解释性与可视化挑战

多变量时间序列预测结果的解释性对于用户理解和应用至关重要。项目设计多层次输出机制,将趋势成分与残差成分的预测结果分开呈现,便于分析各变量的趋势变化和波动特征。通过辅助指标和误差分析,帮助用户全面理解模型表现,增强预测结果的信任度。

项目模型架构

项目整体架构由两大核心模块组成:ResidualTrend线性残差趋势模块和Transformer编码器模块,二者协同工作实现多变量时间序列的高精度预测。

ResidualTrend模块基于经典的线性趋势建模理论,将多变量时间序列中的线性趋势部分通过回归或滤波方法提取出来。其基本原理是将观测序列分解为趋势成分与残差成分两部分,趋势成分由简单的线性模型拟合,便于捕获序列的整体增长或衰减趋势,减轻后续复杂模型负担。

Transformer编码器模块采用多头自注意力机制和位置编码技术,能够捕捉时间序列中长期依赖关系及多变量间的复杂交互。其核心机制是通过计算输入序列各时间步之间的注意力权重,实现全局信息的动态加权聚合,从而有效挖掘序列的深层特征。

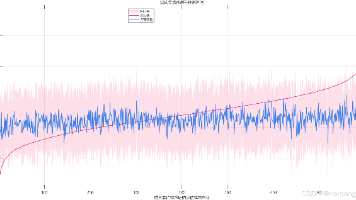

具体架构流程如下:输入的多变量时间序列首先进入ResidualTrend模块,提取每个变量的线性趋势成分和残差序列;残差序列作为非线性成分输入Transformer编码器进行特征学习和模式提取;编码器输出的高维特征通过全连接层映射至预测目标维度;最后,将预测的趋势成分和编码器预测的残差成分合并,得到最终的多变量时间序列预测结果。

模型中还配备位置编码机制以保留时间顺序信息,批归一化和残差连接增强训练稳定性,损失函数结合均方误差与趋势拟合误差,确保模型在捕捉趋势和非线性波动上均衡表现。整个架构设计兼顾模型表达能力与训练效率,实现多变量时间序列的端到端精准预测。

项目模型描述及代码示例

% 线性残差趋势模型部分

function [trend, residual] = ResidualTrendModel(data)

% 输入参数 data:多变量时间序列数据,尺寸为 [时间步数 x 变量数]

% 输出参数 trend:线性趋势部分,尺寸同data

% 输出参数 residual:残差部分,尺寸同data

matlab

复制

[T, N] = size(data); % 获取时间步数T和变量数N

residual = zeros(T, N); % 初始化残差矩阵

for i = 1:N

y = data(:, i); % 提取第i个变量序列

X = [(1:T)', ones(T,1)]; % 构造时间索引和偏置项的设计矩阵

trend(:, i) = X * beta; % 计算线性趋势部分

end

end

% Transformer编码器部分定义(基于MATLAB Deep Learning Toolbox)

function transformerLayer = createTransformerEncoderLayer(embedDim, % embedDim:嵌入维度;numHeads:注意力头数;ffDim:前馈层维度;dropoutRate:dropout比例

ini

复制

attentionLayer = multiheadAttentionLayer(numHeads, embedDim, 'Name',

% 创建多头注意力层,支持多头自注意力机制,输出维度为embedDim

ini

复制

addNorm1 = layerNormalizationLayer('Name', 'addNorm1');

% 添加层归一化层,用于稳定训练过程

ini

复制

feedForward = [

fullyConnectedLayer(ffDim, 'Name', 'fc1')

% 前馈全连接层,提升模型非线性表达能力

reluLayer('Name', 'relu')

% 激活函数层,引入非线性

dropoutLayer(dropoutRate, 'Name', 'dropout1')

% Dropout防止过拟合

fullyConnectedLayer(embedDim, 'Name', 'fc2')

% 再次全连接层恢复嵌入维度

dropoutLayer(dropoutRate, 'Name', 'dropout2')

% 第二个Dropout层

];

ini

复制

addNorm2 = layerNormalizationLayer('Name', 'addNorm2');

% 第二个层归一化层

makefile

复制

% 定义Transformer编码器的前向函数

transformerLayer = addLayers(transformerLayer, attentionLayer);

transformerLayer = addLayers(transformerLayer, feedForward);

transformerLayer = addLayers(transformerLayer, addNorm2);

% 连接层

transformerLayer = connectLayers(transformerLayer,

transformerLayer = connectLayers(transformerLayer, 'addNorm1', 'fc1');

transformerLayer = connectLayers(transformerLayer, 'dropout2',

end

% 主模型流程示例

function predicted = ResidualTrendTransformerPredict(data)

% data:输入的多变量时间序列,尺寸为[T x N]

% predicted:预测结果,尺寸为[T x N]

matlab

复制

% 1. 分解线性趋势和残差

[trend, residual] = ResidualTrendModel(data); % 线性趋势建模及残差计算

% 2. 残差部分进行Transformer编码

embedDim = 64; % 嵌入维度

ffDim = 128; % 前馈层维度

% 对残差进行线性映射为Transformer输入

% 这里简化为直接reshape为三维张量 [时间步 x 变量数 x 嵌入维度]

% 实际可使用embedding层或全连接层进行转换

residualEmbed = reshape(residual, size(residual,1), size(residual,2), 1);

% 将残差重塑为三维张量作为Transformer输入

matlab

复制

% 创建Transformer编码器层

transformerLayer = createTransformerEncoderLayer(embedDim, numHeads, ffDim, dropoutRate);

% 需要定义训练网络,训练代码省略,此处示范调用预测

% 假设 transformerOutput = predict(transformerModel, residualEmbed);

% 这里用残差原样作为示范

transformerOutput = residualEmbed; % 仅示例,实际应为编码器输出

% 3. 预测结果 = 趋势预测 + Transformer残差预测

predicted = trend + squeeze(transformerOutput); % 合并趋势与残差预测结果

end

% 使用示例

data = randn(100, 5); % 模拟多变量时间序列数据,100时间步,5变量

predicted = ResidualTrendTransformerPredict(data); % 调用预测函数

% 解释:

% 该示例展示了基于MATLAB的ResidualTrend-Transformer多变量时间序列预测的核心步骤,包含趋势分解、残差Transformer编码与预测结果合并。ResidualTrendModel通过线性回归捕获趋势,Transformer模块则聚焦残差非线性特征提取。此代码框架为完整实现奠定基础,可在此基础上添加训练循环、超参数优化及实际数据预处理流程。

% 线性残差趋势模型部分

function [trend, residual] = ResidualTrendModel(data)

% 输入参数 data:多变量时间序列数据,尺寸为 [时间步数 x 变量数]

% 输出参数 trend:线性趋势部分,尺寸同data

% 输出参数 residual:残差部分,尺寸同data

matlab

复制

[T, N] =size(data);% 获取时间步数T和变量数N

residual =zeros(T, N);% 初始化残差矩阵

fori=1:N

y = data(:,i);% 提取第i个变量序列

X = [(1:T)',ones(T,1)];% 构造时间索引和偏置项的设计矩阵

trend(:,i) = X *beta;% 计算线性趋势部分

end

end

% Transformer编码器部分定义(基于MATLAB Deep Learning Toolbox)

function transformerLayer = createTransformerEncoderLayer(embedDim, % embedDim:嵌入维度;numHeads:注意力头数;ffDim:前馈层维度;dropoutRate:dropout比例

ini

复制

attentionLayer= multiheadAttentionLayer(numHeads, embedDim,'Name',

% 创建多头注意力层,支持多头自注意力机制,输出维度为embedDim

ini

复制

addNorm1= layerNormalizationLayer('Name','addNorm1');

% 添加层归一化层,用于稳定训练过程

ini

复制

feedForward = [

fullyConnectedLayer(ffDim,'Name','fc1')

% 前馈全连接层,提升模型非线性表达能力

reluLayer('Name', 'relu')

% 激活函数层,引入非线性

dropoutLayer(dropoutRate, 'Name', 'dropout1')

% Dropout防止过拟合

fullyConnectedLayer(embedDim, 'Name', 'fc2')

% 再次全连接层恢复嵌入维度

dropoutLayer(dropoutRate, 'Name', 'dropout2')

% 第二个Dropout层

];

ini

复制

addNorm2= layerNormalizationLayer('Name','addNorm2');

% 第二个层归一化层

makefile

复制

% 定义Transformer编码器的前向函数transformerLayer = addLayers(transformerLayer, attentionLayer);transformerLayer = addLayers(transformerLayer, feedForward);transformerLayer = addLayers(transformerLayer, addNorm2);% 连接层transformerLayer = connectLayers(transformerLayer, transformerLayer = connectLayers(transformerLayer, 'addNorm1', 'fc1');transformerLayer = connectLayers(transformerLayer, 'dropout2', end

% 主模型流程示例

function predicted = ResidualTrendTransformerPredict(data)

% data:输入的多变量时间序列,尺寸为[T x N]

% predicted:预测结果,尺寸为[T x N]

matlab

复制

% 1. 分解线性趋势和残差

[trend, residual] = ResidualTrendModel(data); % 线性趋势建模及残差计算% 2. 残差部分进行Transformer编码

embedDim =64;% 嵌入维度

ffDim =128;% 前馈层维度

% 对残差进行线性映射为Transformer输入

% 这里简化为直接reshape为三维张量 [时间步 x 变量数 x 嵌入维度]

% 实际可使用embedding层或全连接层进行转换

residualEmbed =reshape(residual,size(residual,1),size(residual,2),1);

% 将残差重塑为三维张量作为Transformer输入

matlab

复制

% 创建Transformer编码器层

transformerLayer = createTransformerEncoderLayer(embedDim, numHeads, ffDim, dropoutRate);% 需要定义训练网络,训练代码省略,此处示范调用预测

% 假设 transformerOutput = predict(transformerModel, residualEmbed);

% 这里用残差原样作为示范

transformerOutput = residualEmbed; % 仅示例,实际应为编码器输出% 3. 预测结果 = 趋势预测 + Transformer残差预测

predicted = trend +squeeze(transformerOutput);% 合并趋势与残差预测结果

end

% 使用示例

data = randn(100, 5); % 模拟多变量时间序列数据,100时间步,5变量

predicted = ResidualTrendTransformerPredict(data); % 调用预测函数

% 解释:

% 该示例展示了基于MATLAB的ResidualTrend-Transformer多变量时间序列预测的核心步骤,包含趋势分解、残差Transformer编码与预测结果合并。ResidualTrendModel通过线性回归捕获趋势,Transformer模块则聚焦残差非线性特征提取。此代码框架为完整实现奠定基础,可在此基础上添加训练循环、超参数优化及实际数据预处理流程。

更多详细内容请访问

http://MATLAB实现基于ResidualTrend-Transformer线性残差趋势模型(ResidualTrend)结合Transformer编码器进行多变量时间序列预测的详细项目实例(含完整的_多变量时间序列预测GUI工具资源-CSDN下载 https://download.csdn.net/download/xiaoxingkongyuxi/91620244

https://download.csdn.net/download/xiaoxingkongyuxi/91620244

https://download.csdn.net/download/xiaoxingkongyuxi/91620244

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献261条内容

已为社区贡献261条内容

所有评论(0)