从白纸到对话:一文看懂大模型训练的完整技术栈与学习路径(一)

文章目录

为什么ChatGPT能听懂你的潜台词,而你家智能音箱只会回复“对不起,我没听懂”?

差距不在外观,而在于背后那一场耗时数月、耗资千万、吞吐万亿数据的“思维锻造”。

这不是魔法,是一条清晰的三步工艺路线:预训练赋予它海量知识,监督微调教会它听话办事,强化学习让它懂分寸、知进退。

本文将抛开晦涩的数学公式,为你绘制一张 “从白纸到对话”的完整技术路线图”。

大模型的三个基石

在深入那条耗资千万的训练流水线之前,我们需要先花几分钟,搞懂三个贯穿全文的核心概念。它们就像建筑的地基,理解之后,后面的复杂工序你一看就懂。

1. 什么是“模型”?

别被“模型”这个词吓到。在AI的世界里,模型本质上就是一个极其复杂的数学函数。

回忆一下初中数学:y = f(x)。输入一个 x,经过函数 f 的处理,输出一个 y。

大模型也是同样的逻辑:

- 输入(x):你向ChatGPT提出的问题,比如之前很火的“用鲁迅的口吻说一段话”。

- 函数(f):一个由数十亿甚至上万亿个参数构成的巨大神经网络架构。

- 输出(y):ChatGPT生成的那句仿鲁迅口吻话。

关键理解:什么是“参数”?

你可以把参数想象成大脑中无数个神经元之间的连接强度。有些连接很强(这是常识,不能错),有些连接很弱(这是生僻知识,很少用)。大模型的“大”,指的就是这种连接的数量巨大。GPT-4据传拥有约1.8万亿个参数。

一个比喻:

- 模型架构:就像一张超级复杂的乐谱(规定了音符排列的规则和结构)。

- 模型参数:就是乐谱上每一个音符的具体位置和音高(这是需要通过训练不断调整才能确定的)。

- 训练过程:就是让乐队反复演奏,不断调整每个音符的位置,直到演奏出最悦耳的旋律。

简单来说,模型训练的目标,就是找到一组最优的“参数值”,让这个巨大的数学函数,在接收你的问题时,能输出一个让你满意的答案。

2. 为什么是Transformer?

你可能听过一个叫Transformer的词。详细介绍请看上篇“扔掉“金鱼记忆”:Transformer 是如何让 AI 学会“一目十行”的?”它几乎出现在了当今所有顶级大模型(GPT、Claude、Gemini、文心一言)的技术报告中。它是大模型能成为“大”模型的基石。

2017年,Google的一篇论文《Attention is All You Need》横空出世,提出了这个革命性的架构。它的核心创新是一个叫做 “自注意力机制” 的东西。

别死记概念,我们用一个例子来理解自注意力:

句子:“我把苹果给吃了,因为它很甜。”

当人类读这句话时,我们的大脑会自然而然地知道,第二个“它”指的是前面的“苹果”。但这对计算机来说,是一个巨大的挑战。传统的模型会困惑:“它”是哪个词?是“我”吗?还是“苹果”?

而Transformer的自注意力机制,能够让模型在处理“它”这个字的时候,同时“看到”句子中所有其他字,并计算出它们之间的关联权重。它会发现“它”和“苹果”的关联度最高(比如0.8),而和“我”的关联度很低(比如0.1)。

结果就是,模型真正“读懂”了上下文。

正是这种并行处理全局信息的能力,让Transformer在理解长文本、捕捉复杂语义关系上,碾压了上一代模型(RNN/LSTM)。可以说,没有Transformer,就没有今天的大模型时代。

3. 什么是Token?

好了,现在我们知道模型是一个数学函数,它的心脏是Transformer。那么,我们日常说的话,是怎么变成它能理解的“数学语言”的呢?

答案就是 Token(词元)。

重要认知:模型不认识汉字、字母或单词。它只认识数字。

因此,所有输入模型的文本,都必须先被切分成一个个最小单元,并将每个单元映射成一个唯一的数字ID。这个过程叫分词,每个被切分出来的单元就是一个Token。

来看几个直观的例子:

- 中文:

"我爱学习AI"→ 可能被切成["我", "爱", "学习", "AI"]→ 可能映射为[1024, 2856, 3902, 15678] - 英文:

"I love AI"→ 可能被切成["I", " love", " AI"](注意空格的处理)

一个冷知识:

- 1个Token ≈ 0.75个英文单词 (所以"ChatGPT"是一个Token)

- 1个Token ≈ 0.5个常用汉字 (所以“人工智能”是四个字,但可能是两个Token)

为什么你需要知道这个概念?因为它直接和费用与性能挂钩(好的Token太贵啦):

- 计费单位:大部分AI模型的API是按处理的Token数量收费的(输入+输出)。

- 上下文窗口:我们说GPT-4 Turbo有128K的上下文,指的是一次对话最多能处理12.8万个Token(大约相当于一本中文长篇小说)。

- 模型性能:模型生成答案的速度,就是以“Token/秒”来衡量的。

训练全景图

在第一章,我们搞懂了模型、Transformer和Token这三个核心概念。现在,是时候站在高处,俯瞰整个大模型训练的完整流程了。

很多人在学习大模型时容易陷入一个误区:一头扎进某个技术细节里,却忘了问“这一步在整个流程中到底起什么作用”。本章的目的,就是帮你先建立全局视野,让后续的每一章你都知道它在整体拼图中的位置。

1. 一张图看懂:从原始数据到AI助手

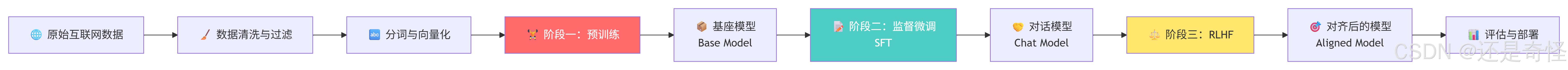

话不多说,先上图。这是一张大模型训练的完整技术流程图,请花30秒仔细看一下:

图注:红色代表预训练阶段(最耗时耗力),青色代表监督微调阶段(学会对话),黄色代表RLHF(Reinforcement Learning from Human Feedback,人类反馈强化学习)阶段(对齐人类偏好)。

如果你觉得上图不够直观,这里还有一个更简洁的文字版流水线:

原始数据 → [预训练] → 基座模型 → [监督微调] → 对话模型 → [RLHF] → 对齐模型 → 上线

└─ 阶段一 ─┘ └─ 阶段二 ─┘ └─ 阶段三 ─┘

这张图的精妙之处在于,它揭示了大模型训练的分层递进逻辑:

- 每一步的输出,都是下一步的输入。

- 每一步的目标,都建立在前一步成果的基础上。

- 跳过任何一步,你都得不到一个“能用”的AI助手。

2. AI的“求职记”

为了让你对这三个阶段有更生动的记忆,我准备了一个将贯穿全文的比喻。请想象你要培养一个顶级员工:

阶段一:预训练 = 上完所有学(博士毕业)

想象一个人,从小开始读遍世界上所有的书籍、论文、代码、论坛帖子。他学富五车,脑子里装着海量的知识。你问他任何问题,他都能从知识库里调取相关信息,滔滔不绝地讲下去。

但他有个致命的问题:他不懂“对话”的规矩。

你问他“怎么去故宫?”,他可能会从“故宫建于1420年”开始,讲到明清二十四位皇帝,再讲到建筑风格和馆藏文物……讲了十分钟,你依然不知道坐几号线地铁。

这就是基座模型(Base Model) 的状态:知识渊博,但不会“办事”。它只会根据你给的开头,预测接下来的文字,而不是直接回答你的问题。

阶段二:监督微调(SFT)= 入职培训

现在,这位博士毕业了,进入你的公司。

你不能让他用写论文的方式回复客户邮件。你需要给他看大量的优秀范例——客户问A,老员工是怎么回应的;客户问B,标准话术是什么。

在AI世界里,这些“优秀范例”就是高质量的指令-回答数据对。通过模仿这些范例,模型学会了:

- 用户说“帮我写一封请假邮件”,你应该直接输出邮件正文,而不是解释“邮件是什么”。

- 用户说“用一句话总结”,你就真的只说一句话,而不是三段。

这个阶段结束后,模型从“续写机器”变成了“对话助手”。但它依然可能犯错:有时候给的答案不够好,有时候语气太生硬,有时候会说一些不恰当的话。

阶段三:RLHF = 绩效考核 + 导师反馈

最后的打磨,靠的是“偏好”。

现在,对于同一个客户问题,让模型生成三个不同版本的回答。然后请一位资深导师(人类标注员)来排序:A比B好,B比C好。

模型通过无数次这样的比较,逐渐领悟到:什么样的回答是“好”的,什么样的回答是“差”的。它开始学会:

承认不知道,而不是胡编乱造(诚实)。

拒绝回答危险问题,而不是有求必应(安全)。

用更温暖、更有帮助的语气回复(友好)。

这个阶段,就是让模型的输出与人类的价值观和偏好对齐。

为了让这张“地图”更加清晰,我把三个阶段的特征整理成了一张对比表:

| 维度 | 阶段一:预训练 | 阶段二:监督微调 | 阶段三:RLHF |

|---|---|---|---|

| 核心目标 | 学习“世界知识” | 学习“对话格式” | 学习“人类偏好” |

| 数据来源 | 互联网公开数据 | 人工标注的问答对 | 人类偏好排序数据 |

| 数据规模 | 数万亿Token | 数万~数百万条 | 数万~数十万条 |

| 训练方式 | 自监督(预测下一词) | 监督学习(模仿答案) | 强化学习(最大化奖励) |

| 算力消耗 | 极高(数千GPU,数月) | 较低(数小时~数天) | 中等(数天~数周) |

| 产出物 | 基座模型 | 对话模型 | 对齐模型 |

| 比喻 | 上学读书 | 入职培训 | 绩效考核 |

一个关键洞察:你可能会注意到,数据规模在递减,但对数据质量的要求在递增。预训练追求的是“量”,SFT和RLHF追求的是“精”。这也是为什么后两个阶段虽然数据量小,却对最终体验至关重要。

3. 为什么必须分阶段训练?

读到这里,你可能会有个疑问:为什么不直接把三个阶段合并成一步?让模型一边学知识、一边学对话、一边对齐偏好,不是更高效吗?

答案是:技术上做不到,经济上不划算。

- 成本原因:预训练是极昂贵的。如果在预训练阶段就使用昂贵的人工标注数据,成本将是一个天文数字。把“学知识”和“学规矩”分开,可以最大化利用免费的互联网数据,只在最后的关键步骤使用人工。

- 稳定性原因:三个目标有时是冲突的。如果让一个还没学会基本语言规律的模型,同时去学习复杂的“人类偏好”,它的学习过程会变得极不稳定,最终可能什么都没学好。

- 灵活性原因:分层训练意味着,你只需要做一次昂贵的预训练,得到一个强大的基座模型。然后,你可以用这个基座模型,针对不同的场景(写代码、写小说、做客服)进行不同的微调和RLHF,快速派生出各种专业模型。一次筑基,多次复用。

在万亿Token中“自学成才”

在第二章,我们把预训练比作“上学读书”——让模型读遍全世界的书,成为一个知识渊博的“博士”。这一章,我们就走进这座“学校”,看看这位“博士”到底是怎么学习的。

1. 海量数据的收集与清洗

预训练的第一步,是给模型准备“教材”。这个教材可不是几百本书,而是整个互联网的精华。

数据的来源:一张全球知识的拼图

当今主流大模型的预训练数据通常来自以下几个渠道:

| 数据来源 | 具体内容 | 作用 |

|---|---|---|

| 互联网网页 | Common Crawl 等公开爬虫数据 | 提供广泛的语言覆盖和常识 |

| 书籍与学术论文 | 电子书、期刊、技术报告 | 提供深度知识和严谨表达 |

| 代码库 | GitHub、Stack Overflow | 赋予模型编程能力 |

| 百科知识 | Wikipedia、百度百科 | 提供结构化的事实知识 |

| 论坛与问答 | Reddit、知乎 | 注入真实的对话语境 |

以 Meta 的 Llama 3 为例,它的预训练数据总量高达 15.6 万亿 Token,是上一代的 7 倍,涵盖 30 多种语言,其中代码、数学、长文本文档等复杂语料的比例显著增加。而 DeepSeek-V3 则在 14.8 万亿 Token 的高质量多样化语料上完成了预训练。可以粗略推断,行业顶尖模型的数据规模已稳定在 10~20 万亿 Token 这一数量级。

数据的清洗:去掉“杂质”,保留“精华”

但问题来了:从互联网上爬下来的原始数据,充满了各种“脏东西”——HTML 标签、广告文案、乱码字符、重复内容、甚至有害信息。如果不加处理直接喂给模型,它就会学到这些“坏习惯”。

因此,数据清洗是预训练中最耗时、最繁琐,却也最关键的工序。一条典型的数据流水线包含以下步骤:

- 质量过滤:剔除太短、无意义、纯符号的文本;筛掉低质量的网页。

- 去重:用 MinHash 等算法识别并删除重复段落,防止模型“死记硬背”。

- 敏感内容清洗:屏蔽涉及暴力、色情、隐私等不安全的文本。

- 格式规范化:清理 HTML 标签、修复编码问题、统一标点符号。

- 分类与配比:根据内容类型(代码、数学、通用文本等)进行分类,按比例混合。

一个真实案例:上海创智学院等机构的研究团队开发了一个名为 DataEvolve 的系统,让 AI 自己进化出数据清洗策略。他们用这个系统清洗了一个包含 6720 亿 Token 的原始数据集,移除了约 25% 的低质量内容,最终产出了 5040 亿 Token 的高质量预训练数据。用清洗后的数据训练的 3B 小模型,在 18 个基准测试上的平均成绩从 40.17 提升到了 44.13。这生动地说明:数据质量比数据数量更重要。

2. 训练任务是什么?

有了干净的教材,模型就可以开始“上课”了。但问题又来了:谁来教它?谁来批改作业?

答案是:没有人。模型自己教自己。 这就是“自监督学习”的妙处。

核心机制:预测下一个 Token

还记得第一章讲的 Token 吗?预训练的核心任务极其简单:

给模型看一段文本的前半部分,让它猜下一个 Token 是什么。

举个例子,我们把句子“床前明月”输入给模型:

- 模型看到“床前明月”,根据它当前的“知识”,猜测接下来可能是“光”(概率 60%)、可能是“亮”(概率 20%)、可能是“照”(概率 10%)……

- 正确答案是“光”。

- 猜对了,模型就加强做出这个预测的神经通路。

- 猜错了,模型就调整参数,下次猜对的概率更高。

这个过程被重复 数万亿次。每一次“猜下一个 Token”,模型的参数都会微调一点点。经过足够多次的迭代,模型逐渐内化了语言的统计规律、语法结构、甚至逻辑关系。

“完形填空”只是表象,真正的收获是“理解”

表面上看,模型只是在玩一个无聊的接龙游戏。但这个游戏的副产品,恰恰是我们想要的:模型通过无数次“猜下一个词”的练习,学会了:

- 语法:“我吃苹果”是通顺的,“我苹果吃”是不对的。

- 常识:“太阳从____升起”的空白处,填“东方”的概率远高于“西方”。

- 推理:读到“问题:1+1=?答案:”,模型知道应该输出“2”。

这就是预训练的神奇之处——用一个极其简单的任务,撬动了极其复杂的语言理解能力的涌现。

3. Transformer 与注意力机制

在第一章,我们简单提过 Transformer 是“大模型的心脏”。现在,我们稍微深入一点,看看这个“心脏”在预训练中到底在做什么。

核心创新:自注意力机制

假设模型正在处理下面这句话:

“小明把苹果放在桌上,然后它滚到了地上。”

当模型读到“它”这个词时,它需要理解“它”指的是什么。自注意力机制的计算方式是:

- 让“它”这个 Token 同时“看”句子里所有其他 Token。

- 计算“它”与每一个其他 Token 的关联分数。

- 与“苹果”的分数最高(比如 0.85),与“小明”的分数较低(比如 0.10),与“桌上”的分数更低(比如 0.03)。

基于这个分数分布,模型就知道“它”指代的是“苹果”。模型“读懂”了上下文,而不是孤立地处理每个词。

两种核心架构:Dense 与 MoE

目前主流的预训练模型,在架构上分为两大流派:

| 架构类型 | 代表模型 | 核心特点 | 激活方式 |

|---|---|---|---|

| Dense(稠密) | Llama 3、Gemma 3 | 所有参数在每次推理时都被激活 | 全量激活 |

| MoE(混合专家) | DeepSeek-V3、Mixtral | 将模型分成多个“专家”,每次推理只激活部分专家 | 稀疏激活 |

MoE 是近年来的一个重要技术趋势。以 DeepSeek-V3 为例,它总共有 6710 亿参数,但处理每个 Token 时只激活其中的 370 亿。这种“稀疏激活”的设计,让 MoE 模型在保持巨大参数规模的同时,大幅降低了推理成本——就像一个拥有数百位专家的公司,每个任务只调用最相关的几位,而不是全员出动。

4. 算力的“军备竞赛”

预训练是大模型全生命周期中最烧钱的阶段。我们来拆解一下钱都花在了哪里。

硬件:GPU 集群是唯一选择

预训练的计算量极大,必须有大量高性能 GPU 协同工作。目前行业主流的方案是使用 NVIDIA H100 或 H800 GPU 组成的集群,单块 GPU 的售价在 2.5 万到 3.5 万美元之间。

以 DeepSeek-V3 为例,它的预训练使用了 2048 块 H800 GPU,总计消耗了 278.8 万 GPU 小时,训练过程持续了约两个月。

Meta 为训练 Llama 3 搭建了 24,000 块 GPU 的定制集群,采用数据、模型、流水线三重并行策略,实现了超过 95% 的 GPU 利用率,训练效率比上一代提升了约 3 倍。

成本:千万美元级别

综合算力租赁、电力消耗、工程师人力等各方面开销,训练一个千亿参数级别的大模型,单次预训练的成本区间大约在 200 万到 1200 万美元 之间。

下表整理了几个代表性模型的预训练成本估算:

| 模型 | 参数规模 | 训练数据量 | 估算训练成本 |

|---|---|---|---|

| GPT-3 | 1750 亿 | ~3000 亿 Token | ~500 万美元 |

| DeepSeek-V3 | 6710 亿(激活 370 亿) | 14.8 万亿 Token | ~500 万美元(H800) |

| GPT-4 | ~1.8 万亿(据估算) | ~13 万亿 Token | ~6300 万美元(据估算) |

| Llama 3 405B | 4050 亿 | 15.6 万亿 Token | 未公开(估算数千万美元) |

一个有趣的对比:Andrej Karpathy(OpenAI 创始成员)曾发布一个名为 nanochat 的实验性项目,用 8 块 H100 GPU、约 4 小时、仅 100 美元 (在最优条件下)就训练了一个 ChatGPT 式的微型对话模型。这说明技术门槛正在快速降低,但要达到商业级水平,依然需要海量投入。

5. 预训练的产出物:基座模型

经过数月的训练和数千万美元的投入,我们终于得到了预训练的成果——基座模型。

基座模型的特点:

| 优点 | 缺点 |

|---|---|

| 知识渊博,涵盖广泛领域 | 只会“续写”,不懂“对话” |

| 具备基本的逻辑推理能力 | 容易胡言乱语、答非所问 |

| 多语言能力 | 无法遵循明确的指令 |

| 可作为各种下游任务的“基础” | 缺乏安全对齐,可能输出有害内容 |

具体来说,如果你问基座模型“怎么做红烧肉?”,它可能会这样回复:

“怎么做红烧肉?首先你需要准备五花肉 500 克。但是如果你不喜欢吃猪肉,也可以用鸡肉代替。说到鸡肉,其实白切鸡也是一道不错的菜,它的做法是……”

这就是典型的“续写模式”:模型看到“怎么做红烧肉?”这几个字,它只是在预测“后面最可能出现的文字是什么”,而不是在“回答你的问题”。它可能会一直讲下去,从红烧肉讲到白切鸡,再讲到满汉全席,完全停不下来。

要让基座模型变成真正的“助手”,还需要后面两个阶段的打磨。 接下来,我们就进入第二阶段——监督微调。

小结

预训练是大模型训练中最基础、最昂贵、也最关键的阶段:

- 数据:从互联网、书籍、代码库等来源收集10~20 万亿 Token 的文本,经过质量过滤、去重、敏感内容清洗等多道工序。

- 方法:通过“预测下一个 Token”的自监督学习,让模型在海量文本中习得语言的统计规律。

- 架构:主流方案分为 Dense(全量激活)和 MoE(稀疏激活)两大流派,核心都是 Transformer 的自注意力机制。

- 成本:需要数千块 GPU 集群连续运行数月,单次训练成本在数百万到数千万美元之间。

- 产出:一个知识渊博但只会“续写”的基座模型,等待后续的微调和对齐。

如果把大模型训练比作建造摩天大楼,预训练就是打地基——耗时最长、投入最大、看不见却最重要。地基打好了,后面盖楼就事半功倍。

在下一章,我们将看到如何用监督微调,让这位“博士”学会“跟人好好说话”。

因篇幅原因,我就把剩下的内容放到下一章来写咯,请见:从白纸到对话:一文看懂大模型训练的完整技术栈与学习路径(二)

(未完待续)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)