CVPR 2026 | NVIDIA推出Fast-FoundationStereo:首个实时零样本立体匹配大模型,速度飙升10倍!

立体匹配(Stereo Matching)技术自诞生至今已有整整50年历史。近年来,尽管深度学习算法在各大公开基准测试中屡创佳绩,但它们往往高度依赖于在目标领域数据集上的微调(Fine-tuning)。

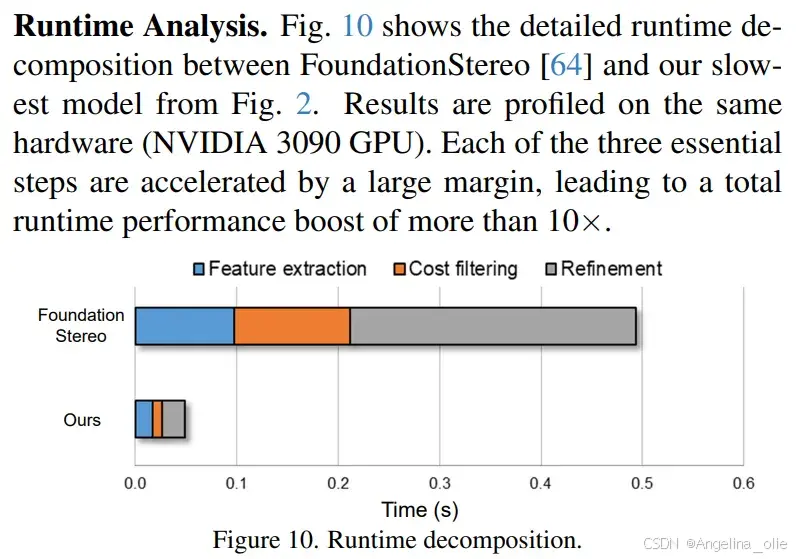

为了解决这一痛点,NVIDIA此前推出了FoundationStereo,它不仅通过融合视觉基础模型(如DepthAnythingV2)的先验知识打破了合成数据与真实世界之间的鸿沟,更实现了极强的零样本泛化能力(Zero-shot generalization)。然而,作为大模型,其计算成本极其高昂(在RTX 3090上单帧推理约需496ms),难以在机器人、自动驾驶等对延迟极度敏感的实时应用中落地。

为了打破高泛化与高效率不可兼得的魔咒,NVIDIA研究团队(Bowen Wen, Stan Birchfield等)重磅推出了全新架构——Fast-FoundationStereo。该模型在保持强大零样本泛化能力的同时,首次在同类基础模型中实现了实时推理,运行速度较原版提升10倍以上!目前,该论文已被CVPR 2026接收.

核心创新:分而治之的极速加速策略

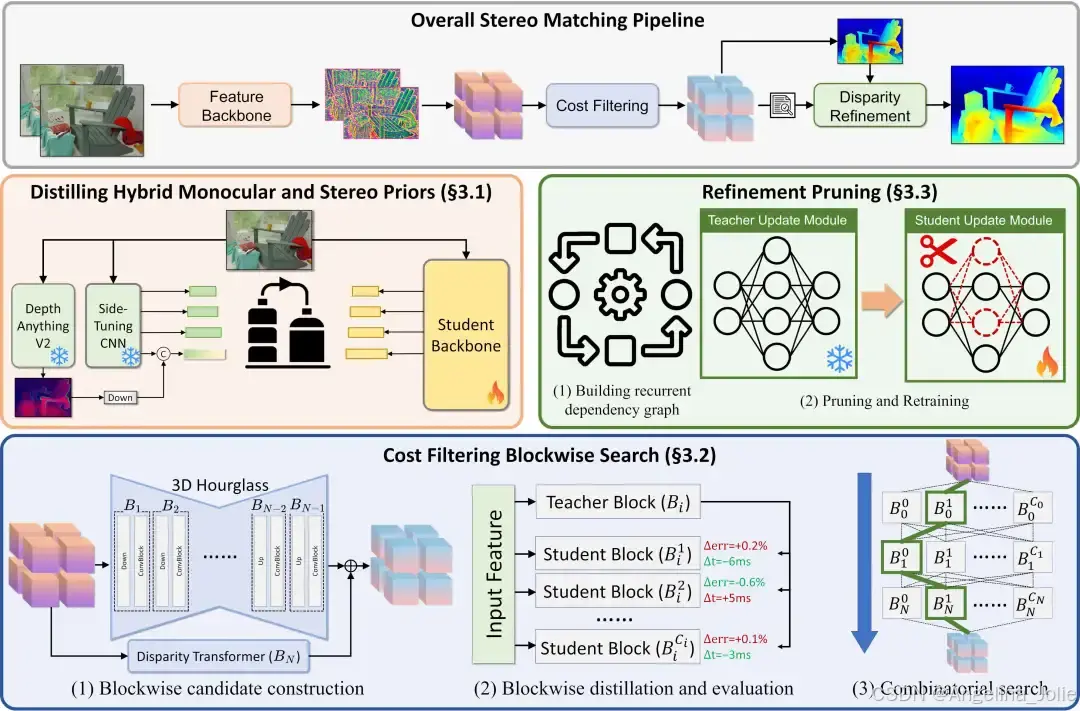

现有的轻量化立体匹配模型通常需要从头设计并训练,这不可避免地损失了网络容量,且牺牲了对复杂非结构化环境的鲁棒性。相反,Fast-FoundationStereo继承了大型教师模型(FoundationStereo)的强大能力,针对立体匹配的三大核心步骤(特征提取、代价滤波、视差细化),提出了一套“分而治之”的加速策略:

1.混合单目与立体先验的特征蒸馏(Knowledge Distillation)

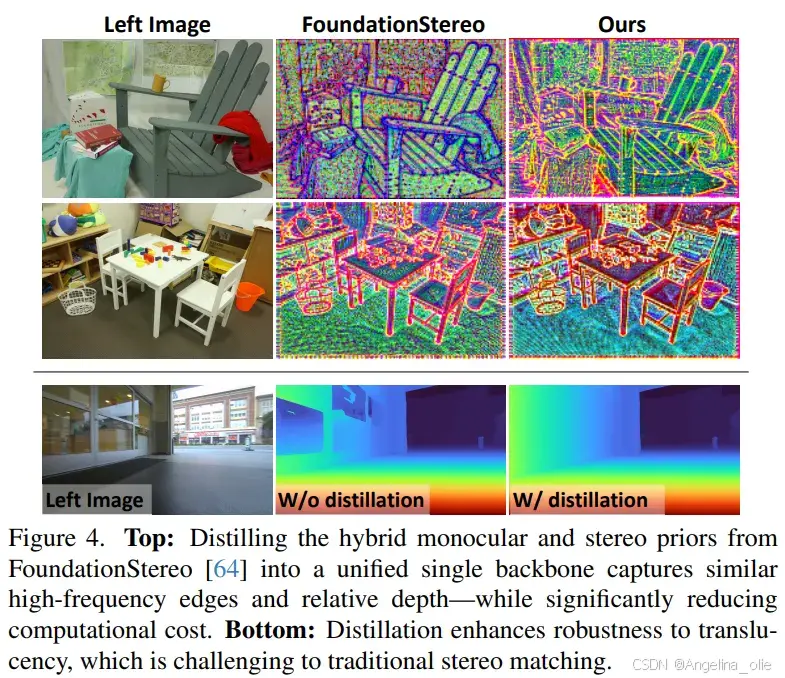

原版模型使用DepthAnythingV2结合CNN提取特征,极其消耗算力。本文提出通过知识蒸馏,将教师模型中庞大的混合单目与立体先验特征,直接压缩到一个高效的单一学生网络骨干中。实验表明,即便经过大幅压缩,学生模型依然能够敏锐地捕捉到相似的高频边缘和相对深度信息,极大增强了模型对半透明等复杂材质的鲁棒性。

2.代价滤波的高效分块架构搜索(Blockwise Architecture Search)

3D代价体滤波(Cost Filtering)是立体匹配的计算瓶颈。由于代价体通道数较少,直接剪枝会导致精度灾难性下降。研究人员没有选择费时费力的传统全局网络架构搜索(NAS),而是创造性地将网络划分为多个局部Block进行分块独立蒸馏。 随后,团队利用整数线性规划(ILP),在极短的时间内完成了在给定延迟预算下对数以亿计(5.8*10^19)的网络结构组合进行优选。这种方法将搜索复杂度从指数级降至线性级,大幅降低了计算成本。

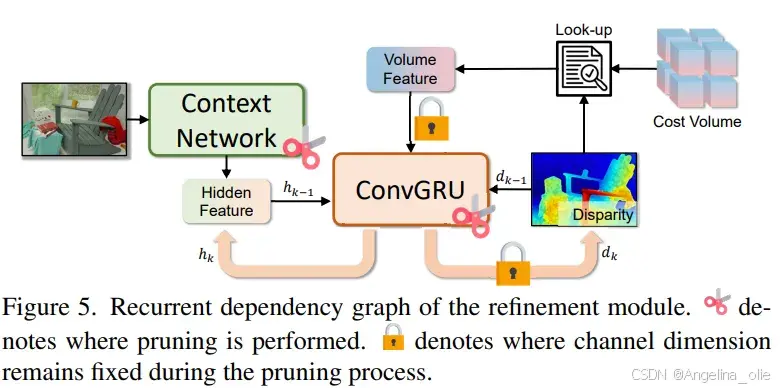

3.迭代细化的结构化剪枝(Structured Pruning)

在视差的迭代细化阶段(基于ConvGRU),为了消除网络冗余,研究人员针对其独有的循环特性,构建了带有循环约束的依赖关系图。通过一阶泰勒展开评估参数重要性并进行结构化剪枝,随后微调网络以恢复精度,这使得模型可直接受益于TensorRT等硬件加速库。

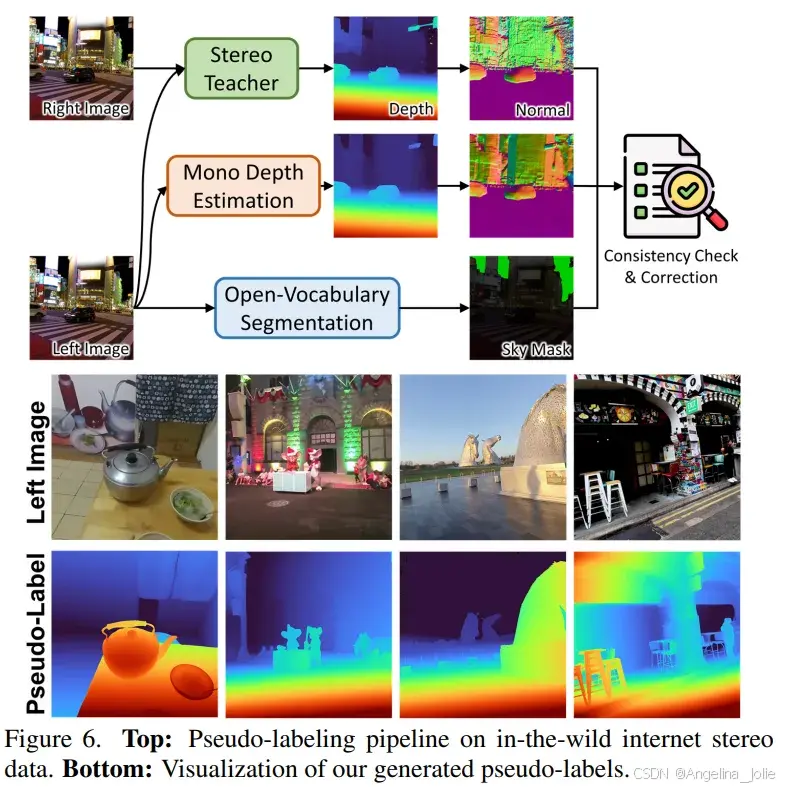

4.互联网级真实数据伪标签 (Internet-Scale Pseudo-Labeling)

为了补充合成数据的不足并进一步提升蒸馏效果,研究团队利用互联网上庞大的真实立体视频(Stereo4D数据集),建立了一套自动化的数据清洗流水线。该流水线通过交叉验证教师模型的双目视差预测与单目深度预测,生成一致性掩码,最终提炼出140万对高质量的“野外(In-the-wild)”真实图像伪标签,极大地增强了模型在各种真实场景中的泛化能力。

实验结果:零样本泛化横扫多榜单

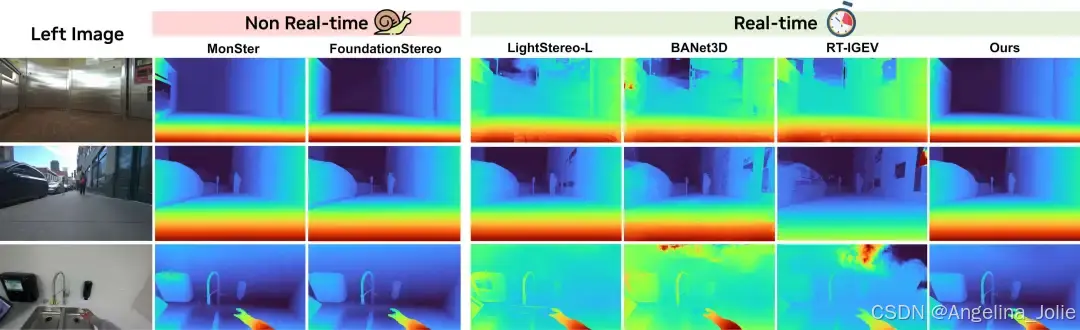

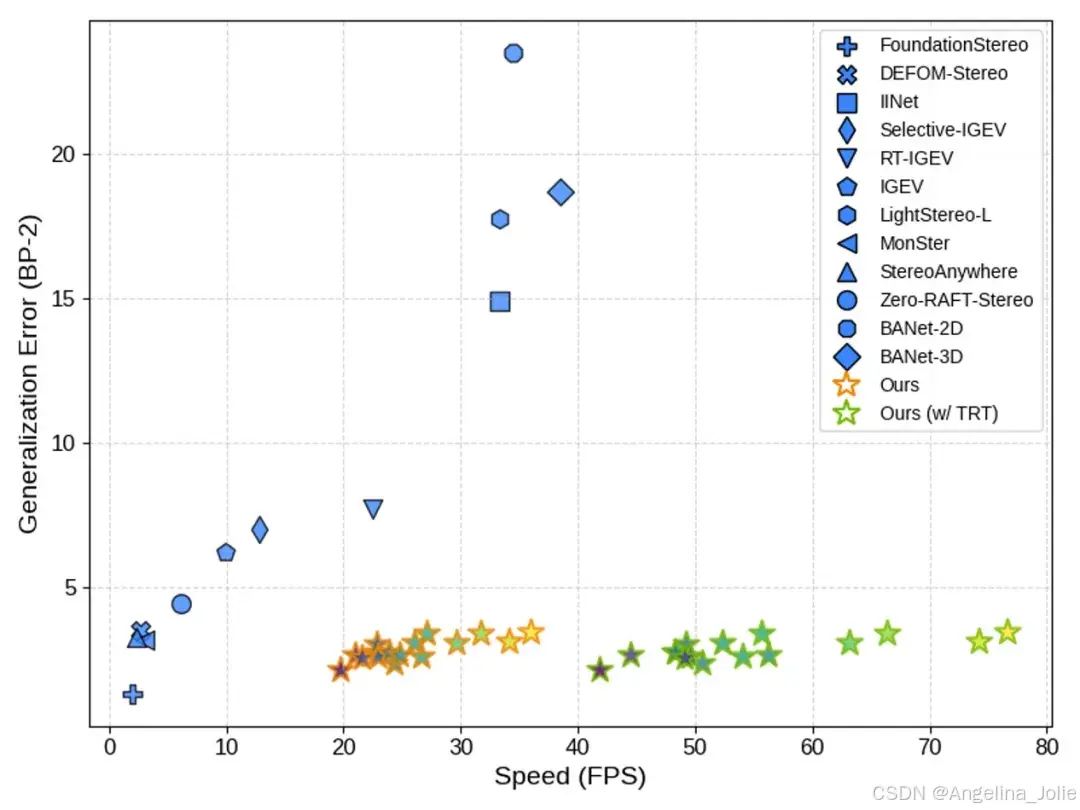

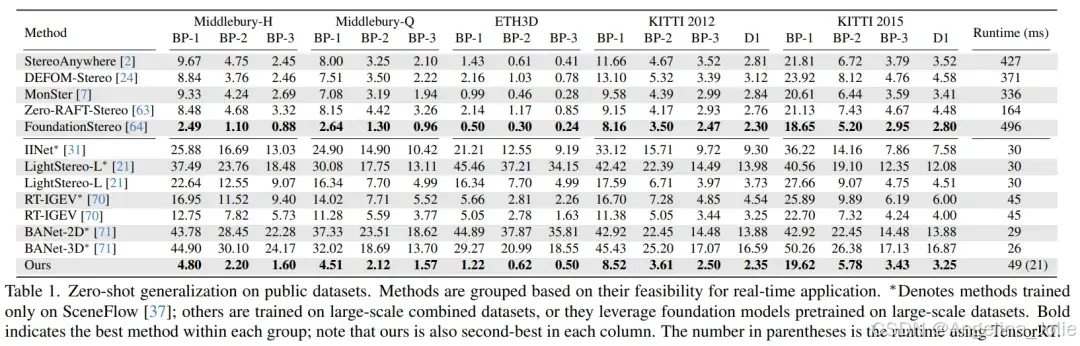

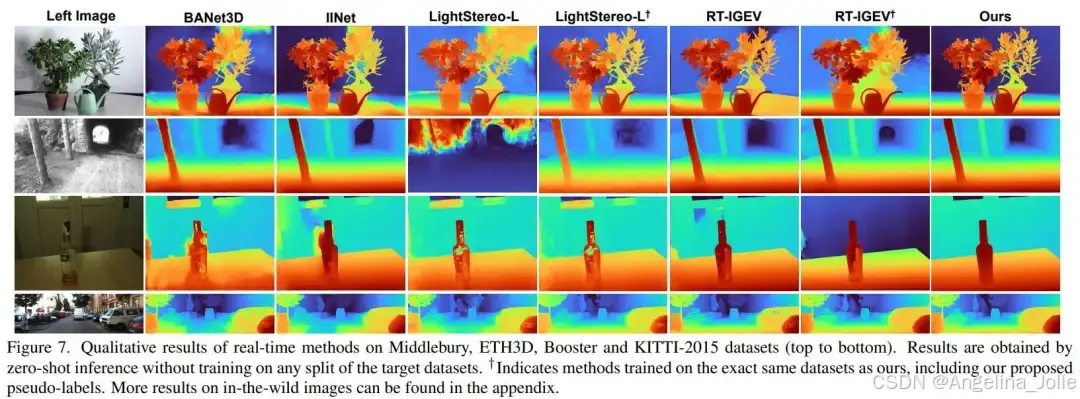

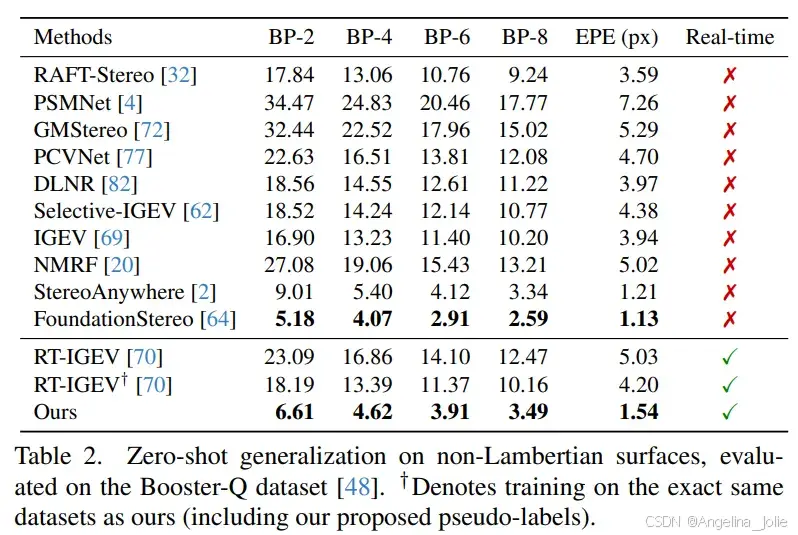

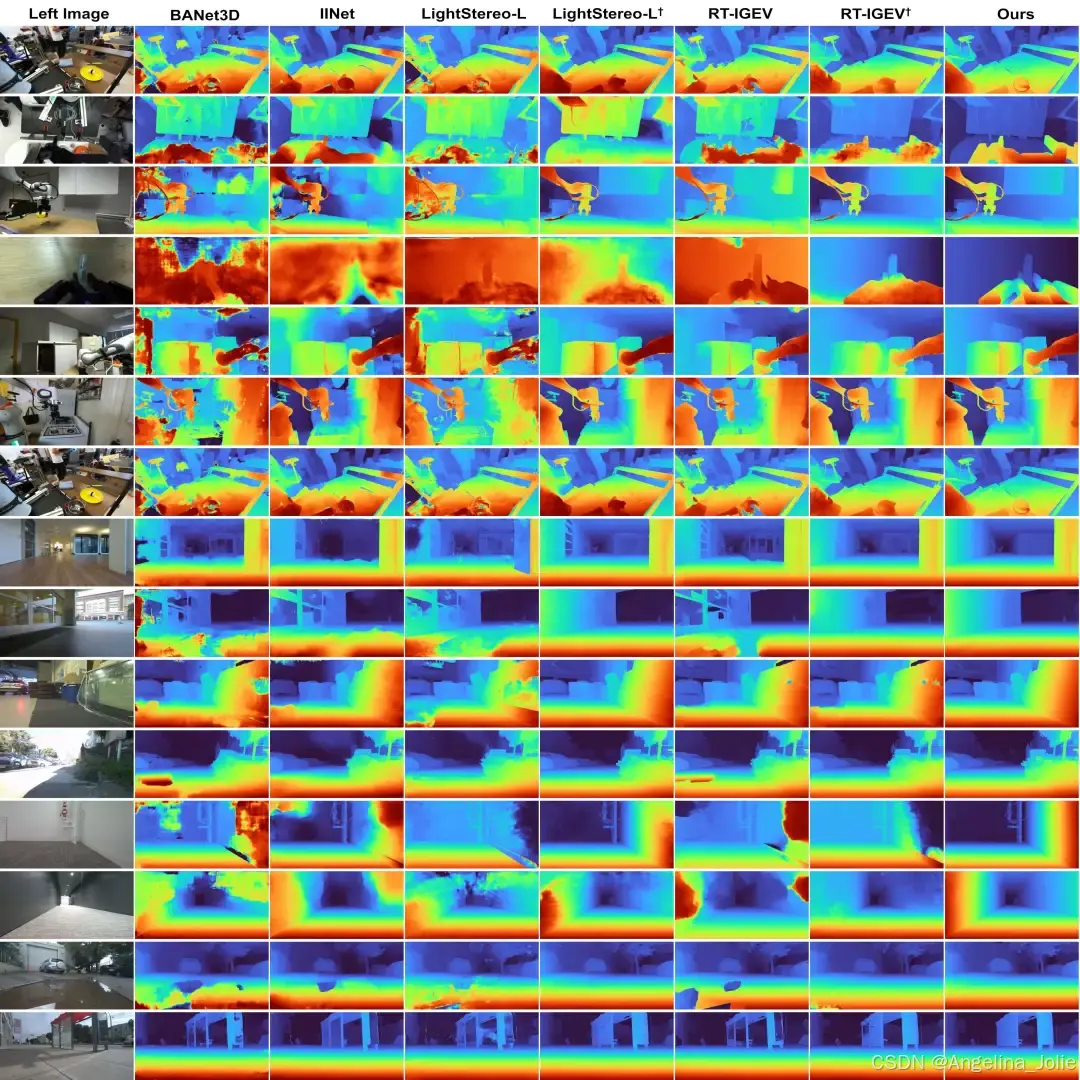

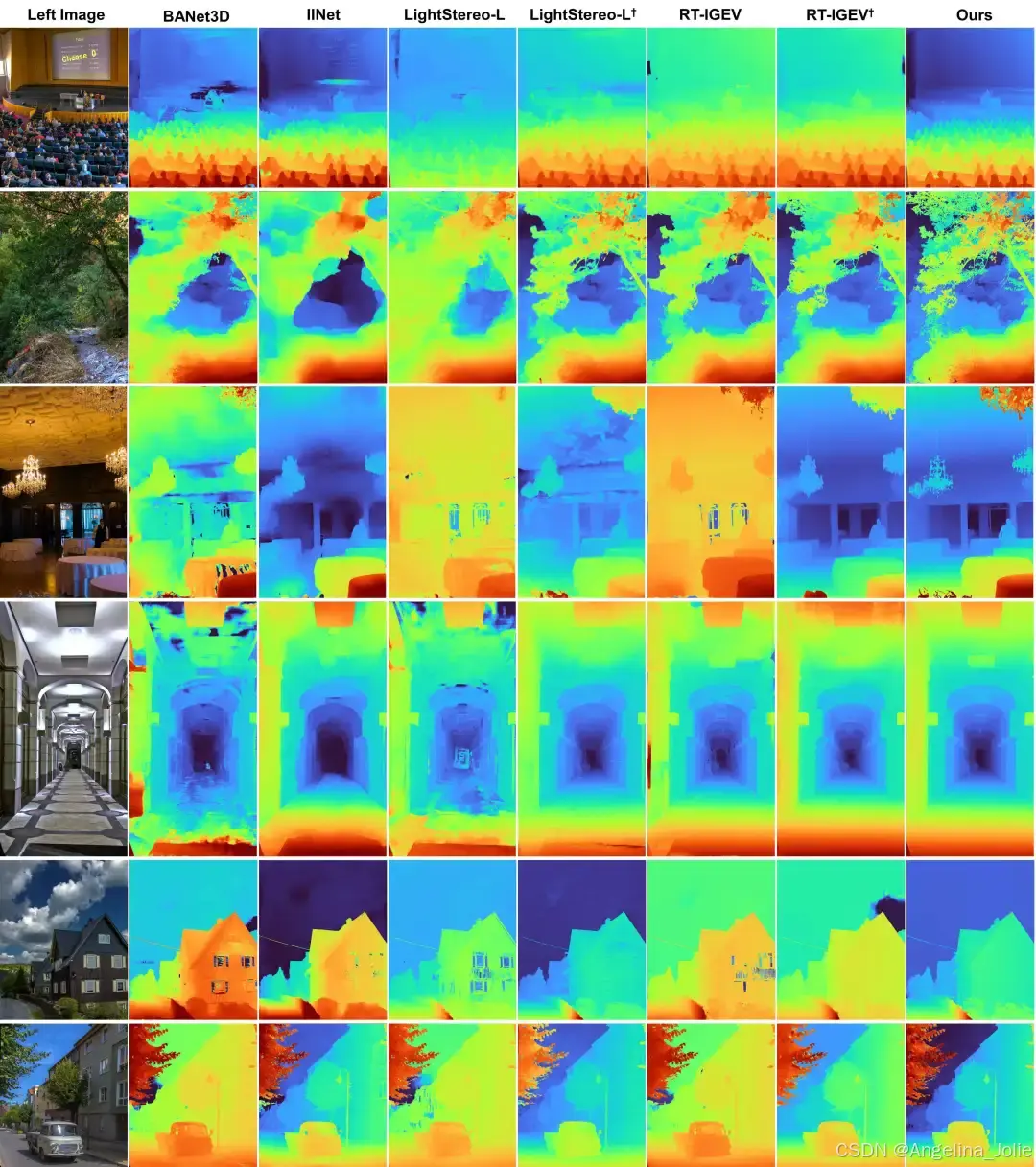

在实验验证中,研究人员将Fast-FoundationStereo与各种主流模型(包括实时模型与非实时大模型)在未见过的数据集(Middlebury, ETH3D, KITTI, Booster)上进行了零样本泛化测试(Zero-Shot Generalization)。

1.绝对碾压的实时SOTA:在与其他实时立体匹配方法(如 RT-IGEV, LightStereo-L, BANet3D等)的较量中,Fast-FoundationStereo 在所有基准测试中均展现出断崖式的领先优势。

2.比肩重量级大模型:尽管推理速度极快,Fast-FoundationStereo 的预测精度仍可与目前计算最为密集的顶级泛化模型(如StereoAnywhere, Zero-RAFT-Stereo)相媲美。

3.应对高难度材质与场景:得益于蒸馏出的视觉先验知识,模型在处理透明玻璃、弱纹理墙面、镜面反光及强曝光场景时,依然能够输出极其平滑和锐利的深度图。

4.极致加速体验:在同一块NVIDIA 3090显卡上,原版基础模型的耗时高达 496ms(约2 FPS),而 Fast-FoundationStereo 的耗时骤降至 49ms(经过TensorRT进一步优化可达21ms,即~47 FPS),完美适配实际部署需求。

总结

基础视觉大模型在三维视觉领域展现出了惊人的潜力,但落地的最后一公里往往受制于算力瓶颈。NVIDIA Fast-FoundationStereo采用分而治之的策略,结合蒸馏、NAS架构搜索、结构化剪枝与自动化真实数据伪标签生成技术,成功搭建了首个能在实时帧率下运行且具备顶级零样本泛化能力的立体匹配基础模型。这一突破为机器人导航、自动驾驶和空间计算等需要实时 3D 感知的应用铺平了道路。

•论文: https://arxiv.org/abs/2512.11130

•项目网页: https://nvlabs.github.io/Fast-FoundationStereo/

•代码、模型与数据集: https://github.com/NVlabs/Fast-FoundationStereo

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)