垂直领域大模型训练:如何清洗与构建高质量的行业数据集

👋 大家好,欢迎来到我的技术博客!

📚 在这里,我会分享学习笔记、实战经验与技术思考,力求用简单的方式讲清楚复杂的问题。

🎯 本文将围绕人工智能这个话题展开,希望能为你带来一些启发或实用的参考。

🌱 无论你是刚入门的新手,还是正在进阶的开发者,希望你都能有所收获!

文章目录

垂直领域大模型训练:如何清洗与构建高质量的行业数据集 🌐🤖🔬

在通用大语言模型(LLM)能力日益普及的今天,真正拉开企业智能化差距的,早已不是模型架构的微小调优,而是垂直领域高质量数据集的构建能力。医疗、金融、法律、工业制造、教育等行业场景对知识的准确性、逻辑的严密性以及合规性有着极高的要求。一个未经精心打磨的行业数据集,不仅无法让模型“懂行”,反而会将噪声、偏见甚至错误逻辑放大,导致严重的业务事故。数据质量决定模型上限,这并非一句口号,而是工程实践中的铁律 📉➡️📈。

本文将从工程落地的视角,系统梳理垂直领域大模型训练数据集的获取、清洗、标注、格式化与评估全流程。内容涵盖核心算法思路、可复现的代码实现、质量管控体系设计以及迭代闭环策略。无论你是算法工程师、数据科学家,还是负责AI基建的架构师,本文都能提供可操作的参考路径。

🔍 一、数据源探索与合法获取:地基决定建筑高度

构建行业数据集的第一步是明确数据边界与来源渠道。垂直领域的数据通常具有强专业性、高保密性与分布不均的特点。盲目堆砌数据量只会增加后续清洗成本,甚至引入不可控的法律风险。

1. 主流数据源分类

- 公开学术与行业基准:如PubMed文献、SEC财报、裁判文书网脱敏数据、国家标准库等。这类数据结构相对规整,但往往存在版权限制或使用条款约束。

- 企业内部沉淀:工单记录、客服对话、技术手册、内部Wiki、专家经验文档。这是最具业务价值的数据,但通常散落在不同系统,格式混乱且包含大量敏感信息。

- 合作伙伴与第三方采购:通过数据交易所或合规数据供应商获取结构化/半结构化数据,需注意数据授权范围与二次加工权限。

- 合成数据与规则生成:利用现有大模型生成对话、构造问答对、模拟业务场景。合成数据可快速扩充长尾分布,但必须经过严格的质量过滤与真实性校验。

2. 合规与隐私红线 🛡️

在数据采集阶段,必须前置考虑《个人信息保护法》《数据安全法》及行业监管要求。涉及个人隐私、商业机密、医疗病历、金融交易流水的数据,必须进行去标识化处理或采用差分隐私、联邦学习等技术架构。建议在数据入库前建立元数据登记制度,记录数据来源、授权协议、敏感字段分布与脱敏策略。

以下是一个基础的数据源接入与元数据登记示例,使用Python实现文件解析与基础信息追踪:

import os

import hashlib

import pandas as pd

from pathlib import Path

import json

from datetime import datetime

def log_dataset_metadata(source_dir: str, metadata_path: str) -> None:

"""扫描数据源目录,记录文件指纹、大小、格式与采集时间"""

records = []

for p in Path(source_dir).rglob('*'):

if p.is_file():

with open(p, 'rb') as f:

file_hash = hashlib.md5(f.read()).hexdigest()

records.append({

'file_path': str(p.relative_to(source_dir)),

'file_size_mb': round(p.stat().st_size / 1024**2, 3),

'md5': file_hash,

'extension': p.suffix,

'collected_at': datetime.now().isoformat(),

'status': 'raw'

})

meta_df = pd.DataFrame(records)

meta_df.to_csv(metadata_path, index=False, encoding='utf-8-sig')

print(f"✅ 元数据已记录: {len(meta_df)} 个文件")

return meta_df

# 示例调用

# log_dataset_metadata('./raw_industry_docs', './metadata_registry.csv')

建立清晰的血缘关系与版本管理是后续迭代的基础。推荐使用数据版本控制工具管理不同阶段的数据快照,确保训练过程可追溯、可复现 📦🔗。

🧹 二、数据清洗流水线构建:从噪声矿场到精炼提纯

原始行业数据往往包含HTML标签、乱码、重复段落、低质量问答、格式错乱表格、非目标语言混杂等问题。构建自动化、可监控、可回滚的数据清洗流水线,是垂直领域大模型训练的核心工程 🏭💧。

清洗核心环节设计

- 基础格式标准化:统一编码、移除不可见字符、修复断行、标准化标点符号。

- 冗余与重复过滤:精确去重无法应对语义重复,需引入局部敏感哈希(LSH)或向量相似度去重。

- 噪声与低质内容剔除:基于规则(长度阈值、符号占比、乱码检测)与模型(困惑度打分、文本连贯性)双重过滤。

- 敏感信息与合规处理:正则匹配+命名实体识别(NER)定位PII(个人身份信息)、商业机密,并进行掩码或替换。

- 结构化信息提取:从PDF/扫描文档/网页中恢复标题层级、表格关系、引用链接,保留领域知识拓扑。

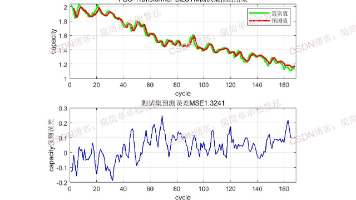

下图展示了典型的行业数据清洗流水线架构,各环节支持并行与降级回退:

代码实战:多维度清洗模块

1. 基础文本标准化与乱码过滤

import re

import unicodedata

def normalize_text(text: str) -> str:

"""统一全半角、修复常见乱码、标准化空白"""

if not text:

return ''

# NFKC规范化:全角转半角,兼容字符合并

text = unicodedata.normalize('NFKC', text)

# 替换连续空白为单个空格,移除不可见控制字符

text = re.sub(r'[\x00-\x08\x0b\x0c\x0e-\x1f\x7f]', '', text)

text = re.sub(r'\s+', ' ', text).strip()

# 修复中文标点混排问题(示例:英文句号转中文)

text = re.sub(r'(?<=[\u4e00-\u9fa5])\.(?=[\u4e00-\u9fa5])', '。', text)

return text

2. 基于MinHash的语义/近似去重

精确字符串匹配无法识别同义改写、段落顺序调换。工业界常用MinHash + LSH进行大规模近似去重:

from datasketch import MinHash, MinHashLSH

import re

import jieba

def build_minhash(doc_id: str, text: str, num_perm: int = 128) -> MinHash:

"""为文档构建MinHash签名"""

m = MinHash(num_perm=num_perm)

# 领域数据建议保留专业术语,此处使用jieba分词+过滤停用词

words = [w for w in jieba.lcut(text) if len(w.strip()) > 1]

for w in words:

m.update(w.encode('utf-8'))

return m, doc_id

def deduplicate_documents(texts: list[str], threshold: float = 0.85) -> list[int]:

"""返回保留的索引列表"""

lsh = MinHashLSH(threshold=threshold, num_perm=128)

hashes = []

kept = []

for idx, txt in enumerate(texts):

if len(txt.strip()) < 50: # 过短直接丢弃

continue

m, _ = build_minhash(f"doc_{idx}", txt)

if not lsh.query(m):

lsh.insert(f"doc_{idx}", m)

kept.append(idx)

return kept

💡 提示:医疗、法律等严谨领域阈值建议调低至

0.8~0.9,保留细微差异;营销、舆情领域可调高至0.92以压缩重复。

3. 质量打分与困惑度初筛

利用轻量级语言模型(如 distilgpt2 或领域小模型)计算文本困惑度(Perplexity, PPL),过高说明语言混乱,过低可能为模板复制:

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

def calculate_perplexity(text: str, tokenizer, model, device='cuda') -> float:

"""计算单条文本困惑度"""

inputs = tokenizer(text, return_tensors='pt', truncation=True, max_length=512).to(device)

with torch.no_grad():

outputs = model(**inputs, labels=inputs['input_ids'])

loss = outputs.loss

return torch.exp(loss).item()

# 使用示例:过滤PPL > 300的噪声段落(阈值依模型与语言而定)

结合规则与模型打分,可构建多维质量指标:质量分 = α * (长度合规) + β * (PPL逆映射) + γ * (专业实体密度)。设定阈值后可批量拦截劣质样本。

✅ 三、专家标注与质量管控体系:人机协同的黄金标准

自动化清洗能解决80%的通用噪声,但剩余20%的高价值领域知识往往需要人类专家介入。标注质量直接决定指令微调(SFT)与偏好对齐(DPO/RLHF)的效果 🧑⚖️🩺💼。

标注流程设计原则

- 指南先行:制定《领域标注规范手册》,明确边界案例(如:模糊表述是否改写、冲突知识如何取舍、是否允许合理推理补充)。

- 多人盲标与一致性检验:每条高价值数据至少由2~3名独立标注员处理,计算Cohen’s Kappa或Krippendorff’s Alpha,低于

0.7需重新培训或仲裁。 - 主动学习(Active Learning):优先标注模型预测不确定性高的样本,以最小成本提升数据多样性与边界覆盖。

- 审核与回溯机制:设立专家复核岗,对抽样数据进行错误归因分析,迭代更新标注指南。

代码实现:一致性检验与数据格式化

import pandas as pd

from sklearn.metrics import cohen_kappa_score

from sklearn.preprocessing import LabelEncoder

def calculate_kappa(annotator_a: pd.Series, annotator_b: pd.Series) -> float:

"""计算两位标注员在分类任务上的一致性"""

le = LabelEncoder()

combined = pd.concat([annotator_a, annotator_b])

le.fit(combined)

return cohen_kappa_score(

le.transform(annotator_a),

le.transform(annotator_b)

)

def format_sft_record(instruction: str, context: str, output: str,

domain_tag: str = 'unknown') -> dict:

"""构建标准指令微调样本"""

return {

"instruction": instruction.strip(),

"input": context.strip() if context.strip() else "",

"output": output.strip(),

"domain": domain_tag,

"source": "expert_annotated",

"quality_score": 1.0 # 初始满分,后续根据反馈调整

}

推荐使用成熟的标注平台(如 Label Studio、Prodigy 或定制Web界面),集成版本控制与任务分配逻辑。对于长文本理解、多跳推理、代码生成等复杂任务,建议采用“生成-校验-修正”三段式流水线,避免一次性标注导致认知负荷过重 📝🔁。

📦 四、数据集格式化与大模型对齐:让数据“说模型能懂的话”

清洗标注完成后,原始文本必须转换为大模型训练框架可读取的格式。当前主流范式为指令微调(Instruction Tuning),数据组织形式直接影响梯度更新方向与对话连贯性。

常见训练格式对比

| 格式类型 | 适用场景 | 特点 |

|---|---|---|

| Alpaca格式 | 通用SFT基线 | instruction, input, output 三字段分离,结构简单 |

| ChatML/对话格式 | 多轮对话、角色扮演 | 显式标记 system, user, assistant 角色,支持历史上下文 |

| DPO偏好对格式 | 价值对齐、风格控制 | 需构造 (prompt, chosen, rejected) 三元组 |

实战:构建HuggingFace Datasets与模板注入

from datasets import Dataset

import json

def convert_to_chatml_format(records: list[dict]) -> list[str]:

"""将标准记录转为ChatML格式字符串"""

chatml_data = []

for r in records:

messages = []

if r.get("system_prompt"):

messages.append({"role": "system", "content": r["system_prompt"]})

messages.append({"role": "user", "content": r["instruction"] + "\n" + r.get("input", "")})

messages.append({"role": "assistant", "content": r["output"]})

chatml_data.append(json.dumps({"messages": messages}, ensure_ascii=False))

return chatml_data

# 加载并打包为Dataset对象

# chatml_texts = convert_to_chatml_format(cleaned_records)

# dataset = Dataset.from_dict({"text": chatml_texts})

# dataset.push_to_hub("your-org/vertical-domain-sft-v1")

在训练前,务必使用 transformers 提供的聊天模板(Chat Template)进行序列验证,确保特殊Token(如 <|begin_of_text|>, <|end_of_turn|>)正确拼接,避免截断或错位导致幻觉 🧩🔗。

📊 五、质量评估与迭代闭环:数据不是一劳永逸的产物

数据集构建并非一次性工程。模型上线后的真实反馈、领域知识更新、长尾场景暴露,都会要求数据集持续进化。建立量化评估与数据迭代机制,是垂直大模型保持竞争力的关键。

评估维度

- 分布健康度:领域标签覆盖率、长度分布方差、专业术语TF-IDF集中度。

- 污染检测:使用基准测试集(如C-Eval, CMMLU垂直子集)进行检索重叠分析,避免训练集与测试集信息泄露。

- 业务指标映射:客服场景看首次解决率(FCR),医疗场景看诊断准确率,金融场景看研报摘要关键信息召回率。

- 人类盲评:组织领域专家进行A/B对比,采用Likert量表打分(准确性、流畅性、逻辑性、安全性)。

数据迭代流水线

线上推理日志 → 失败案例聚类 → 标注优先级排序 → 专家补充/修正 → 合并至训练集 → 增量微调 → A/B验证 → 发布新版本

建议建立数据版本基线与性能追踪看板。每次模型迭代不仅记录Loss与准确率,更要记录数据集版本哈希、清洗规则变更日志、标注一致性指标变化。当新数据注入导致性能波动时,可快速定位是分布偏移、噪声引入还是标注偏差 🔄📉。

🌍 扩展参考:关于数据版本管理与协作流水线,可查阅 DVC官方文档 获取最佳实践;关于垂直领域评测基准设计,OpenCompass 提供了多维度的评估框架与开源工具链。

🚀 六、进阶技巧与工程避坑指南

- 警惕“合成数据泡沫”:大模型自循环生成的数据容易收敛到特定表达模式,导致分布坍缩。必须混入真实数据,并引入多样性扰动(如Prompt改写、知识图谱注入、反向约束过滤)。

- 长尾知识注入策略:行业场景常遇低频但关键的知识(如罕见病并发症、特殊税务条款)。可采用检索增强(RAG)预标注、专家手动构造“黄金问答对”、或小批量高权重采样弥补。

- 成本控制优化:全量数据清洗与标注成本极高。建议采用“分层采样”:核心业务数据100%质检,通用辅助数据抽样质检,边缘数据仅做基础过滤。

- 数据卡片(Data Card)必备:每个发布的垂直数据集应附带标准化说明文档,涵盖数据来源、规模、清洗规则、已知局限、伦理声明与适用边界。这不仅是工程规范,更是合规审计的基础 📜✅。

📝 结语

在垂直领域大模型的竞赛中,参数规模与算力堆叠已逐渐步入边际递减区间,真正构筑护城河的,是那些经过严苛清洗、专家打磨、持续迭代的行业数据集。数据不是燃料,而是图纸;模型不是炼金炉,而是精密机床。只有将工程纪律、领域知识与科学评估深度融合,才能让大模型在关键场景中做到“懂行、可靠、可控”。

清洗与构建数据集是一条没有终点的马拉松。它要求数据工程师兼具代码能力与领域洞察,要求算法专家理解数据分布背后的业务逻辑,要求管理者建立容忍试错但坚守质量底线的文化。当你看到模型在专业问答中给出严谨推导、在复杂工单中精准路由、在合规审查中敏锐提示时,你会明白:那些深夜里逐行调试的清洗脚本、反复争论的标注边界、不断优化的版本管线,早已在无形中重塑了智能的边界。

愿每一位深耕垂直领域的AI实践者,都能用高质量的数据,点亮属于自己行业的智慧之光 💡✨。

🙌 感谢你读到这里!

🔍 技术之路没有捷径,但每一次阅读、思考和实践,都在悄悄拉近你与目标的距离。

💡 如果本文对你有帮助,不妨 👍 点赞、📌 收藏、📤 分享 给更多需要的朋友!

💬 欢迎在评论区留下你的想法、疑问或建议,我会一一回复,我们一起交流、共同成长 🌿

🔔 关注我,不错过下一篇干货!我们下期再见!✨

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献147条内容

已为社区贡献147条内容

所有评论(0)