AAAI 2025 | DiffCorr:用于无监督点云形状对应,基于可靠伪标签引导的条件扩散模型

论文信息

- 论文题目: DiffCorr: Conditional Diffusion Model with Reliable Pseudo-Label Guidance for

Unsupervised Point Cloud Shape Correspondence - 论文作者: Jiacheng Deng, Jiahao Lu, Zhixin Cheng, Wenfei Yang

- 发表会议: AAAI 2025

论文主要贡献

- 提出了一种新颖的条件扩散模型,为无监督点云形状对应提供了可靠的伪标签引导。

- 所提出的基于Transformer的条件扩散模型利用条件机制克服了大运动位移的瓶颈,并开发了一种可靠的伪标签生成器,无需人工标注即可有效筛选高质量的对应点对。

- 在SURREAL、SHREC、SMAL和TOSCA四个标准基准数据集上的大量实验结果表明,所提出的模型优于当前的最先进方法。

问题

- 现有方法在人和动物的大尺度运动场景中效果不佳。人和动物的大尺度运动会让对应点产生大幅位移,现有方法通过直接计算点嵌入之间的相似度得分来获取匹配结果,这种单步匹配难以精准匹配大位移的对应点。

- 点云本身稀疏、不规则,局部噪声多,进一步加剧匹配错误。

- 无监督条件下,没有真实标签来指引多步优化方向。

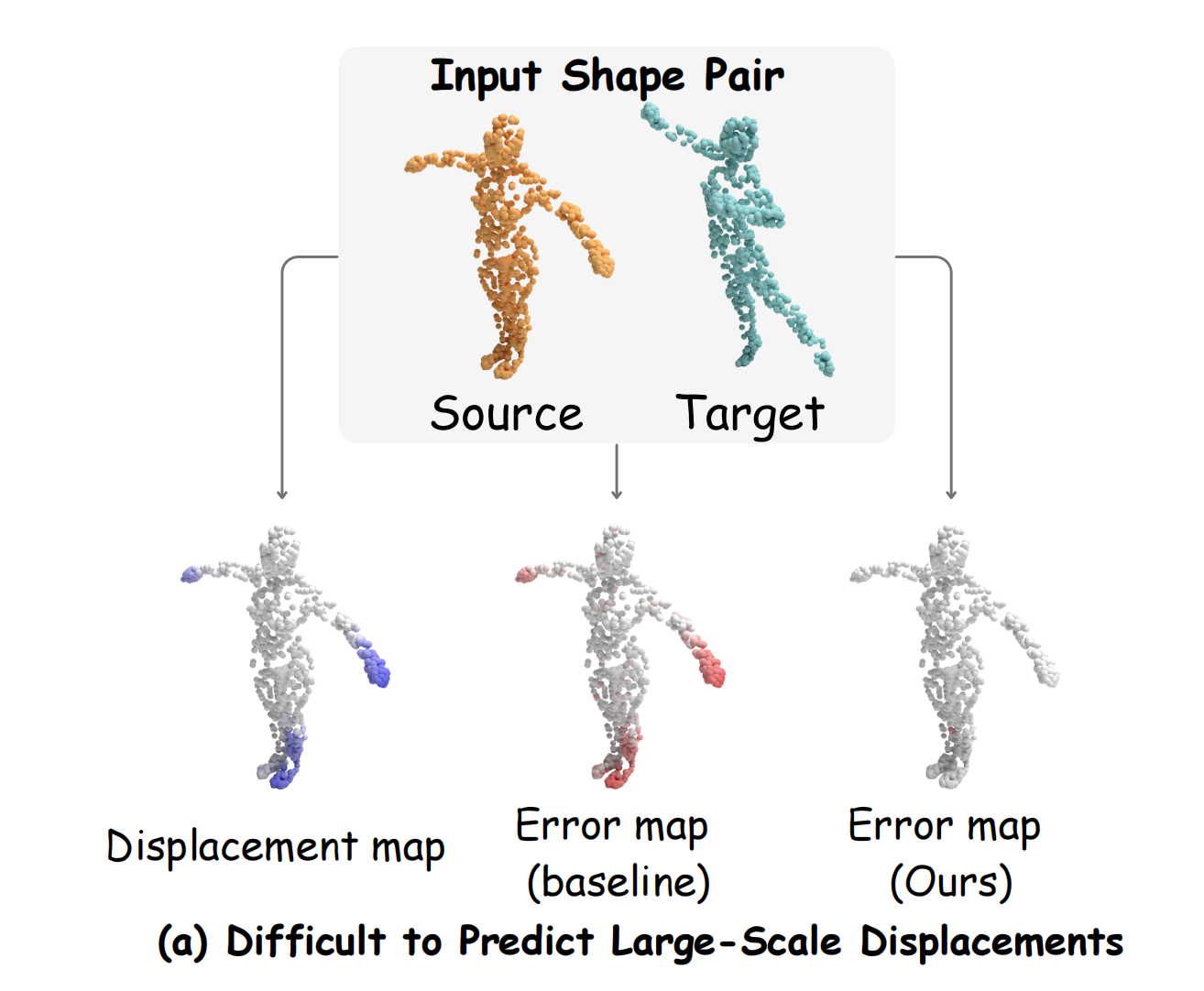

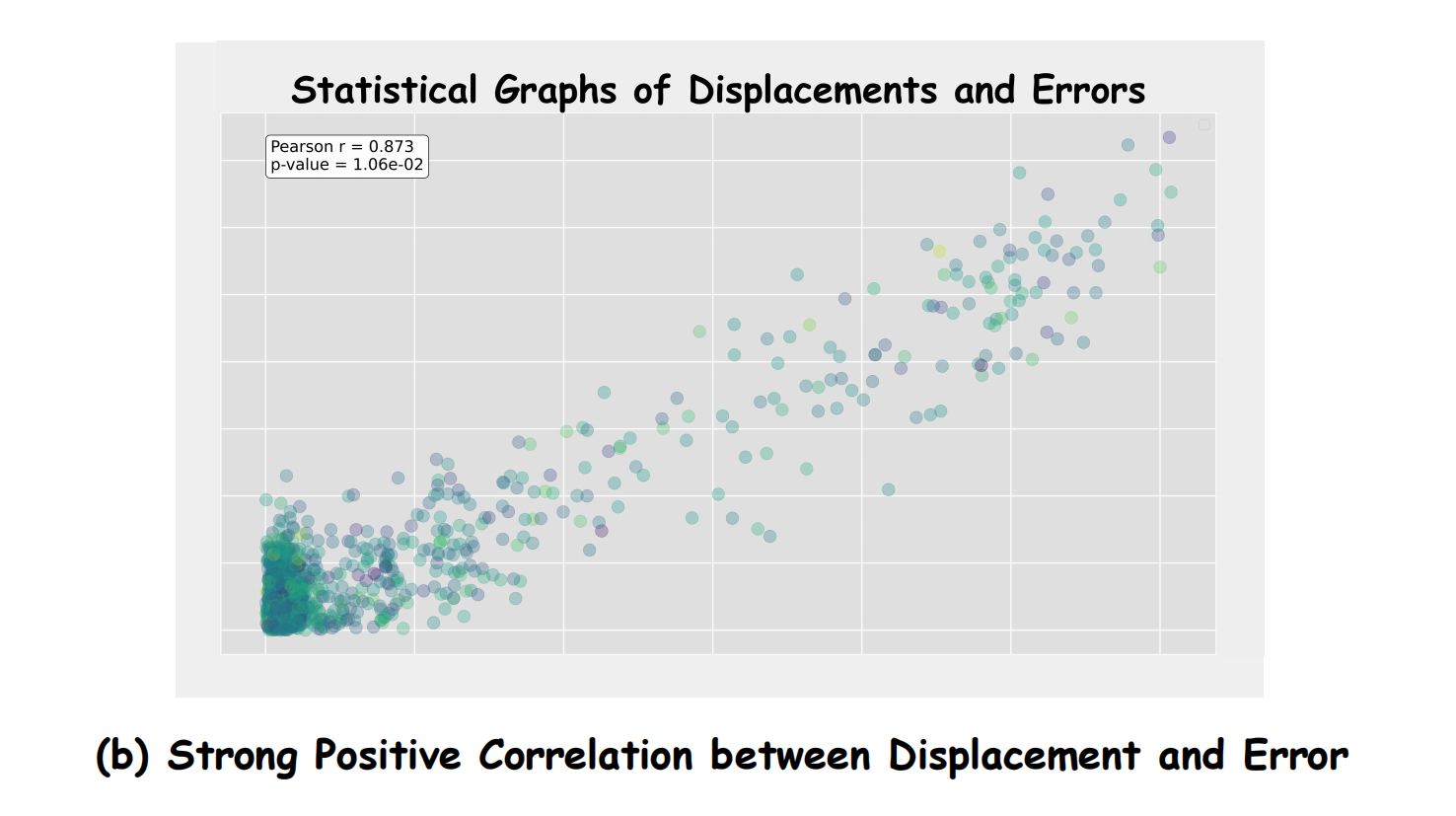

问题可视化:位移与误差的相关性。

图(a)展示了源点云和目标点云之间的逐点位移图(颜色越蓝表示位移越大),以及基线方法和DiffCorr方法预测的误差图(颜色越红表示误差越大)。表明DiffCorr方法解决了大位移匹配问题。

图(b)为散点图,呈现了点云中位移与误差之间的统计相关性。

论文创新点

- 采用

从粗到细的对应预测方法来替代单步范式,借助多步优化逐步收敛至精准的对应点。 - 设计选择策略筛选

高质量地标点作为多步优化方向的引导。 - 提出了一种用于无监督点云形状对应(DiffCorr)的

具备可靠伪标签引导的条件扩散模型,该模型包含基于Transformer的条件扩散模型(T-CDM),采用DDIM框架,并以结构感知的点云Transformer作为骨干网络,可在初始对应位置的局部区域内实现多步去噪优化。其条件包含两个组成部分:局部代价与初始流。可靠伪标签生成器(RPLG),设计了一种高效的高质量对应点对选择策略,以识别在扩散模型中引导去噪方向的关键点。

方法

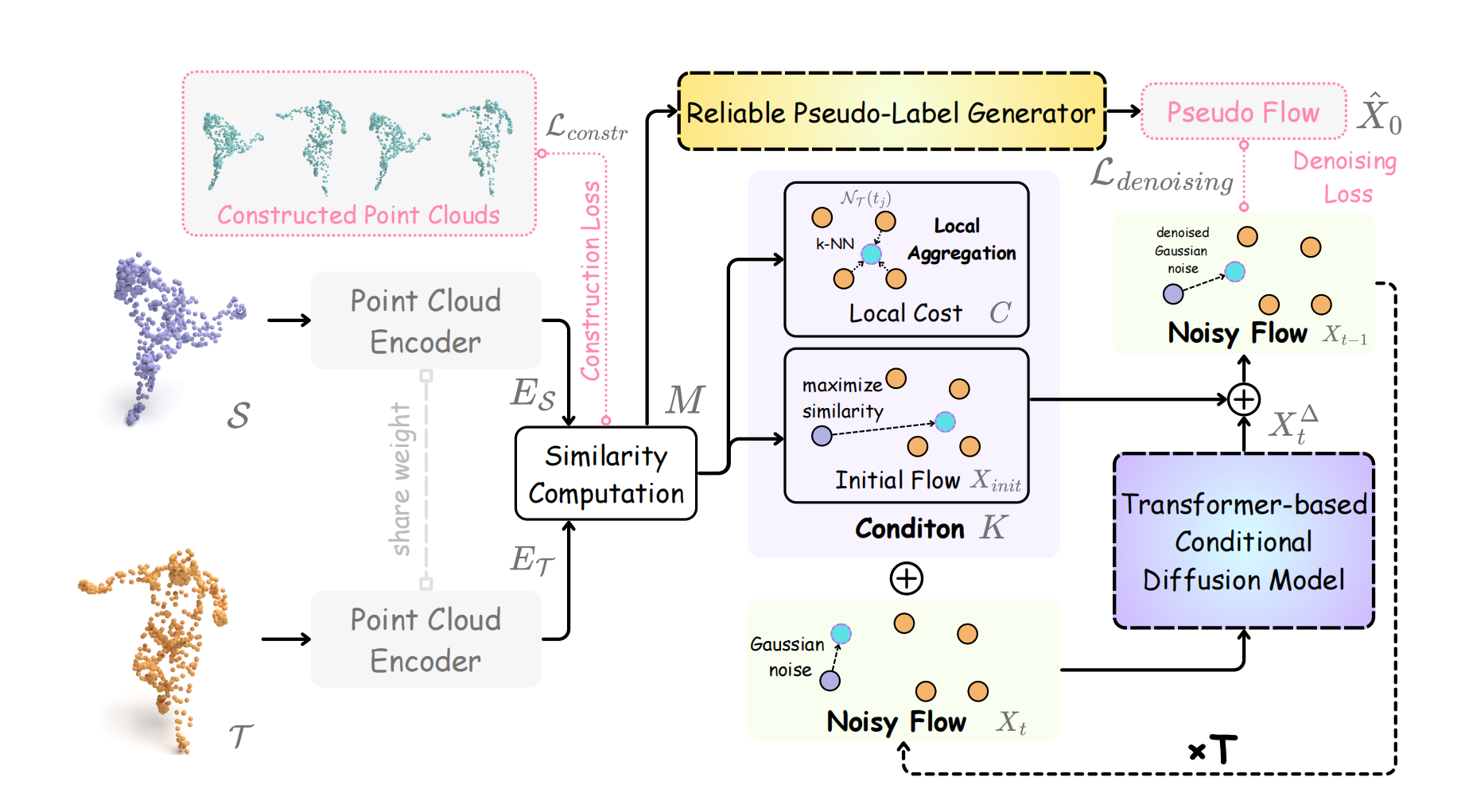

整体框架

输入:

S:源点云,作参考

T:目标点云,待匹配

点云编码器特征提取:

用点云编码器提取两个点云的特征,点云编码器采用Transformer架构,利用Transformer的输入不变性与点云分布的无序性之间的对齐关系,提取具有结构感知能力的点嵌入。

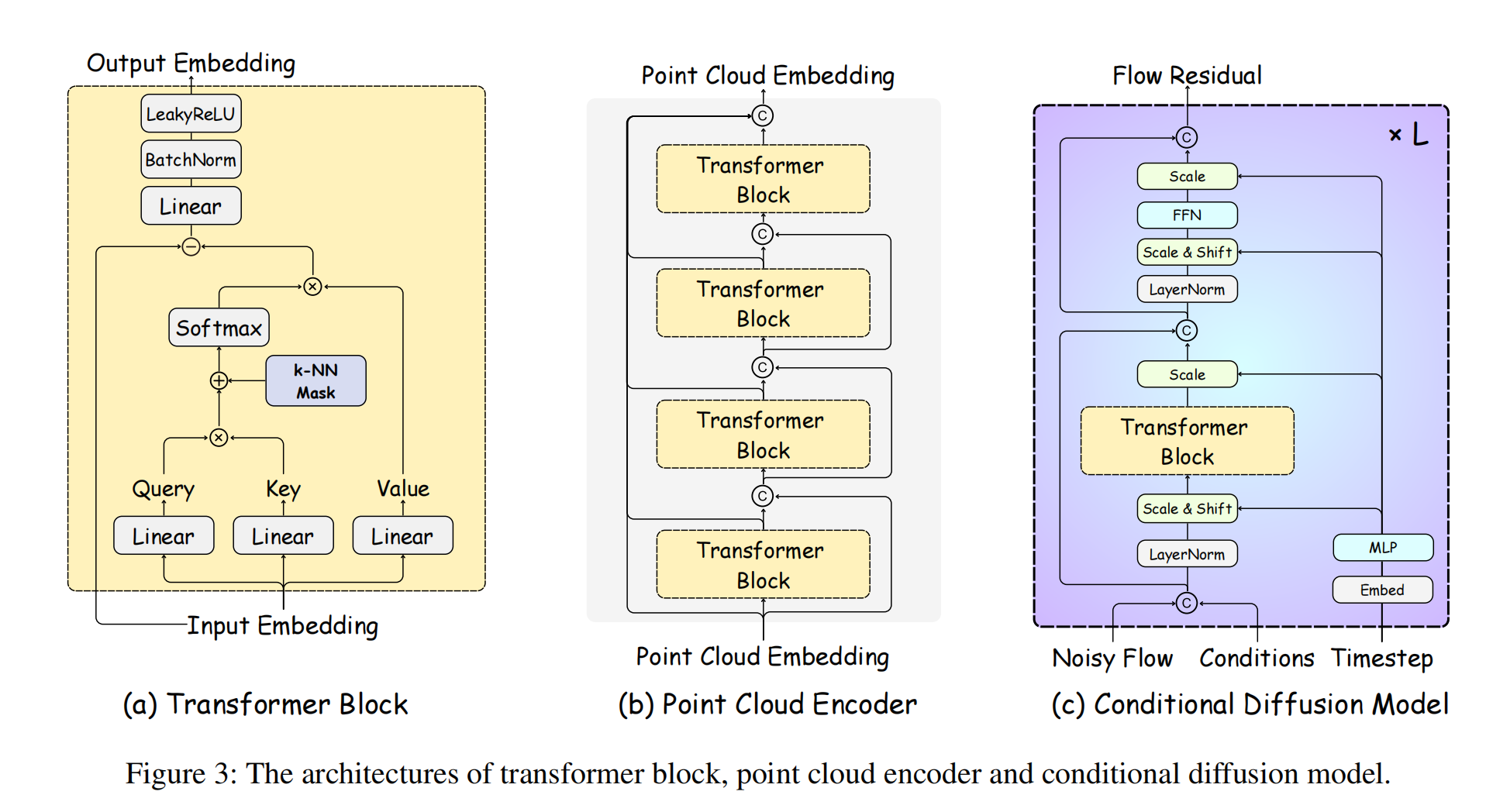

(a)Transformer Block:该模块以标准 Transformer 注意力机制为基础,通过 k-NN Mask 为注意力计算添加局部约束,让每个点仅与空间中最近的 k 个点交互,能够捕捉点云的局部几何结构,又能降低计算复杂度。

(b)Point Cloud Encoder:基于图(a)的 Transformer Block 堆叠而成,通过 4 层Transformer 模块,实现了从原始点云到高维结构感知特征的端到端提取。编码器权重共享,能保证源点云与目标点云的特征空间完全一致。

(c)Conditional Diffusion Model:Transformer 条件扩散模型(T-CDM)

通过 L 层堆叠的扩散块实现由粗到精的迭代去噪。

分别输入:

带噪匹配流:为初始粗匹配添加高斯噪声,让模型学习去噪能力;

条件信息:以初始匹配流 + 局部代价为方向,通过Scale & Shift机制注入网络,强制去噪方向贴合真实匹配,避免随机生成;

时间步:经Embed+MLP编码为高维特征向量,让模型感知当前去噪阶段。

复用带 k-NN 掩码的 Transformer Block,兼顾局部结构与全局建模;

FFN完成特征增强,通过残差连接保证训练稳定性;

**多层堆叠(×L)**实现多轮迭代,逐步将带噪粗匹配优化为高精度结果。

可靠伪标签生成器(RPLG)

在无监督场景下,自己生成高质量伪标签,监督扩散模型训练

用 最优传输(Sinkhorn) 解决一对多错配;

用循环一致性筛选双向匹配成立的高可信点对;

用相似度方差加权,弱化低置信度样本的影响

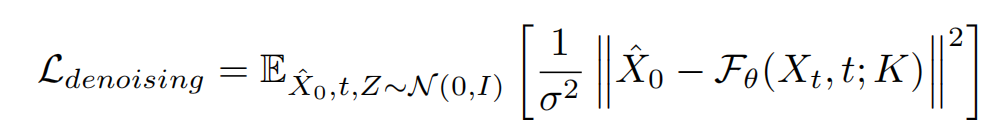

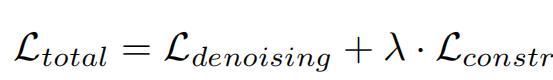

损失函数

去噪损失

让扩散模型 F θ \mathcal{F}_\theta Fθ,把“带噪声的初始匹配”还原成“正确的伪标签匹配”,误差越小越好。

E [ ⋅ ] \mathbb{E}[\cdot] E[⋅] :期望 ,对所有样本、所有时间步取平均;

X ^ 0 \hat{X}_0 X^0 :Pseudo Flow(伪标签)

X t X_t Xt :Noisy Flow 给初始匹配加了高斯噪声的输入;

t t t :时间步

K K K : Conditions,条件(初始流 + 局部代价) Z ∼ N ( 0 , I ) Z \sim \mathcal{N}(0,I) Z∼N(0,I) :高斯噪声,给匹配流加的噪声;

σ 2 \sigma^2 σ2: 噪声方差 | 归一化常数,让损失更稳定 |

∥ ⋅ ∥ 2 \|\cdot\|^2 ∥⋅∥2:欧氏距离平方 | 衡量预测值与标准答案的差距

损失函数包括构造损失(让编码器提取能正确匹配的特征)和去噪损失。

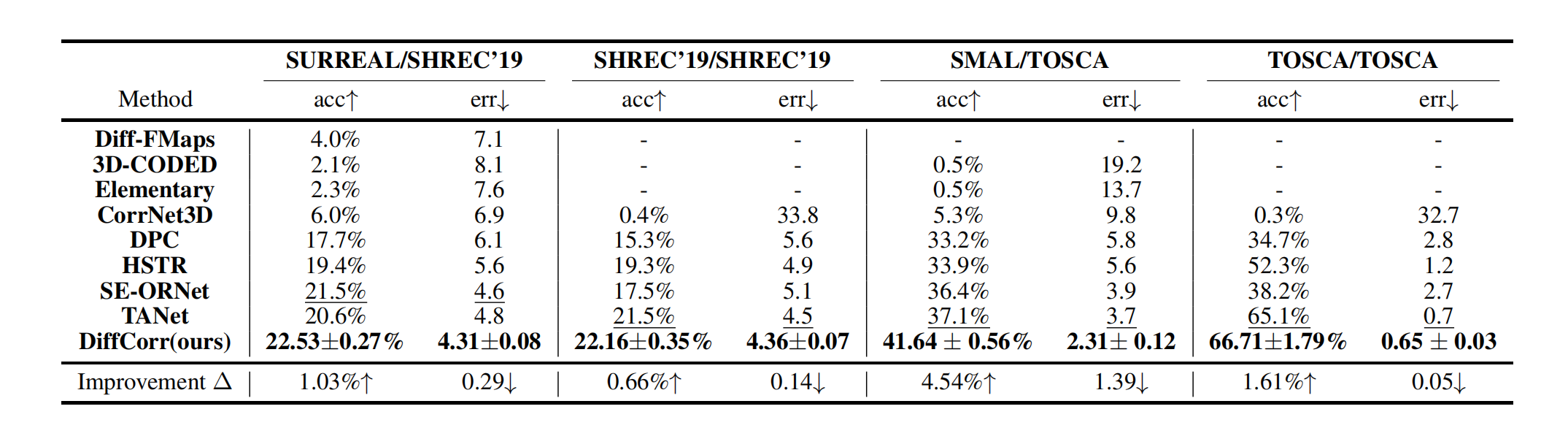

实验分析

四个基准测试的主要结果。在误差容限为0.01的情况下,将本文方法与SURREAL、SHREC’19、SMAL和TOSCA基准测试上的最新研究成果进行了对比。准确率越高、误差越低,代表性能越好。

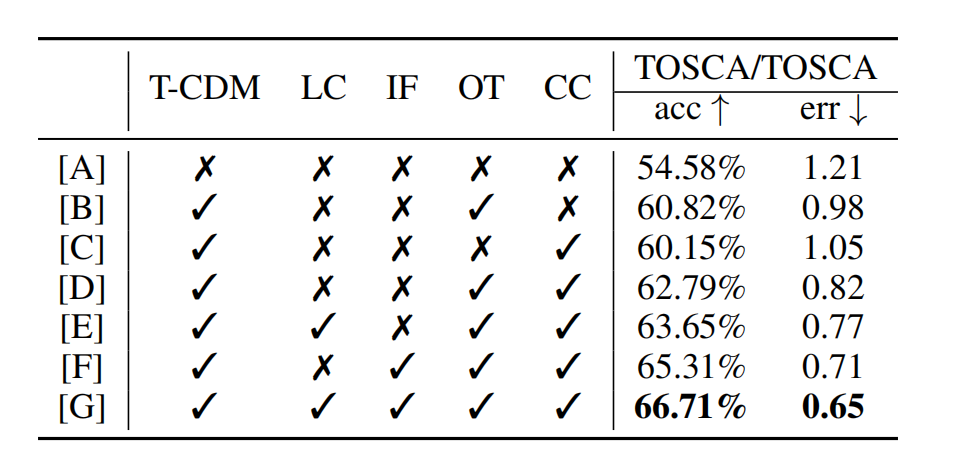

消融实验

不同设计的模型在TOSCA数据集上的评估结果。T-CDM指基于Transformer的条件扩散模型,LC代表局部代价,IF表示初始流,OT和CC分别表示可靠伪标签生成器中的最优传输和跨一致匹配策略。所有模块协同作用,共同实现了无监督点云匹配的 SOTA 精度

结论

本文提出一种具备可靠伪标签引导的条件扩散模型,用于无监督点云形状配准,具体而言,引入基于Transformer的条件扩散模型,以初始对应关系和局部结构信息为条件,通过去噪能力优化初始的粗略预测结果。可靠的伪标签生成器基于点云特征相似度筛选可靠的伪标签,用于训练条件扩散模型。在SHREC’19和TOSCA基准数据集上的大量实验证明了DiffCorr的优越性。在SURREAL和SMAL数据集上的跨数据集实验进一步展示了其出色的泛化能力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)