从零到1读懂AI Agent

前言

大语言模型(LLM)虽然可以理解输入、分析推理、输出文字或者代码, 但它更像一个“聪明的对话者” -———— 没有真正的记忆,不会主动规划, 也无法动手操作现实世界的东西(比如路线导航, 查询天气)。

Agent智能体 / 自主智能体,是当前大模型从 “问答工具” 走向 “自主完成复杂任务” 的核心技术。简单说:大模型是大脑,Agent 是让大脑能看、能想、能动手、能闭环的完整身体yi

一 Agent 智能体核心原理

1.1 核心定义与本质区别

LLM Agent(大语言模型驱动的智能体),是以大语言模型为核心大脑,具备自主感知、记忆存储、任务规划、工具调用、环境交互、反思迭代能力,能在最小人工干预下,自主完成复杂目标任务的智能实体。

它与两类传统方案有本质区别:

| 对比对象 | 核心差异 |

|---|---|

| 原生大语言模型(LLM) | 传统 LLM 是被动、单次、无状态、无行动能力的文本生成器;Agent 是主动、闭环、有状态、可交互的决策实体,能自主发起动作、持续迭代直至完成目标 |

| 传统规则型智能体 | 传统 Agent 依赖人工硬编码规则,仅能处理预设封闭场景,泛化能力极差;LLM Agent 基于大模型的通用语义与推理能力,可处理开放域非预设场景,泛化能力实现质的飞跃 |

1.2 理论起源与范式革命

- 理论溯源:Agent 概念起源于 1950 年代人工智能萌芽期,1980-1990 年代多智能体系统(MAS)在分布式人工智能领域兴起,但受限于当时 AI 的通用能力,仅能在工业控制、游戏 AI 等封闭场景落地。

- 范式革命:2022 年底 ChatGPT 发布,大模型的涌现能力为 Agent 提供了通用 “大脑”;2023 年 ReAct 论文发布,奠定了现代 LLM Agent 的核心范式,随后 AutoGPT、MetaGPT 等项目爆发,Agent 成为 AI 从 “对话工具” 走向 “生产力实体” 的核心载体。

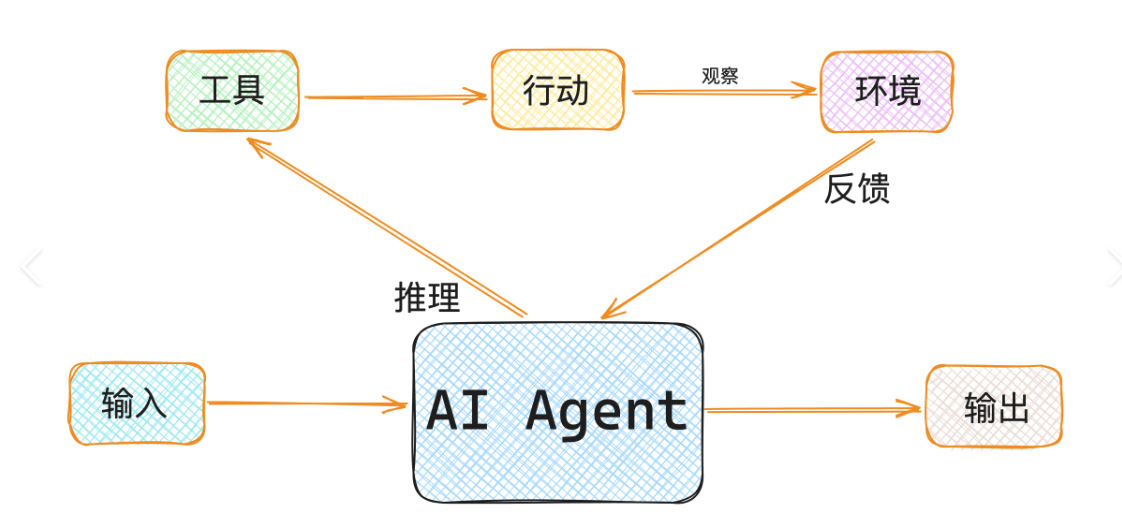

1.3核心智能闭环原理

Agent 的核心是一套完整的感知→记忆→规划→行动→反思的 OODA 循环(观察 - 判断 - 决策 - 行动),通过不断迭代闭环,自主逼近任务目标,这是 Agent 智能的核心来源。

| 闭环环节 | 核心作用 | 底层逻辑 |

|---|---|---|

| 感知(Perception) | 闭环的起点,获取外部环境、用户输入、任务反馈的能力 | 将异构信息(文本、结构化数据、多模态内容、工具返回结果)统一转化为 LLM 可理解的语义信息,实现对环境的认知 |

| 记忆(Memory) | 解决 LLM 无状态问题,存储和检索历史信息、知识、经验 | 模拟人类记忆体系,分为工作记忆、短期记忆、长期记忆三层,让 Agent 具备上下文感知、持续学习、经验复用的能力 |

| 规划(Planning) | 解决 LLM 单步推理不足、长任务上下文溢出问题 | 基于 “分而治之” 逻辑,将复杂目标拆解为可执行的子任务,制定执行路径,适配线性 / 非线性 / 多分支的复杂任务 |

| 行动(Action) | Agent 影响外部世界的唯一途径,执行规划的具体动作 | 核心是工具调用(Tool Use),LLM 自主决策调用工具的时机、类型、参数,执行后获取环境反馈,为下一轮循环提供输入 |

| 反思(Reflection) | Agent 自我迭代、抑制幻觉、提升成功率的核心 | 基于任务目标评估执行结果,分析失败原因,修正规划与行动策略,甚至优化自身的提示词与调用逻辑,实现 “从错误中学习” |

1.4 LLM 作为 Agent 大脑的核心价值

大模型是 Agent 不可替代的核心,承担三大关键职能:

- 语义理解与目标对齐:将用户自然语言目标、异构环境信息、工具返回结果,统一转化为可理解的语义表示,始终对齐核心任务目标;

- 推理与决策:基于感知和记忆信息,完成规划拆解、工具选择、参数生成、路径调整的全流程决策,是 Agent 的智能核心;

- 通用能力泛化:无需人工编写规则,仅通过自然语言描述,即可理解工具用途、规划逻辑、反思标准,适配开放域任意场景,这是传统 Agent 无法实现的核心突破。

二 Agent 智能体核心架构

2.1 通用单智能体标准架构

单智能体是所有 Agent 系统的基础,采用模块化设计,每个模块可独立替换、扩展,适配不同场景需求。

2.1.1 核心模块全解

2.1.1.1. 核心调度器(Agent Core)

- 本质:基于 LLM 的提示词工程 + 有限状态机,是整个 Agent 的指挥中心;

- 核心职责:接收目标指令,协调各模块运行,维护 Agent 运行状态,判断任务完成度,处理异常情况;

- 实现方式:通过系统提示词(System Prompt)定义 Agent 的角色、目标、运行规则、输出格式,配合状态机管理任务生命周期(初始化→规划→执行→校验→完成 / 失败)。

2.1.1.2. 感知模块

- 输入层:支持多模态输入(文本、图像、音频)、环境状态采集、用户实时交互、事件回调触发;

- 预处理层:将异构输入转化为 LLM 可理解的文本语义,过滤无效信息,控制内容长度;

- 事件触发层:支持主动感知,比如定时任务、数据更新、邮件到达等事件触发 Agent 执行。

2.1.1.3. 记忆系统

Agent 的 “知识库”,解决 LLM 无状态、上下文窗口有限的核心痛点,分为三层架构:

| 记忆层级 | 存储内容 | 实现方式 | 特点 |

|---|---|---|---|

| 工作记忆 | 当前正在处理的任务相关信息、推理过程 | LLM 上下文窗口 | 容量有限、读写速度最快,类似人类瞬时工作记忆 |

| 短期记忆 | 会话级历史交互、子任务完成状态、执行过程 | 本地缓存 / Redis | 会话级持久化、容量中等,支撑单轮复杂任务的上下文连贯 |

| 长期记忆 | 跨会话知识、用户偏好、历史成败经验、行业知识库 | 向量数据库 + RAG 架构 | 容量无限、持久化存储,通过语义检索实现跨任务经验复用 |

- 核心能力:记忆写入、语义检索、记忆压缩、过期清理、重要性排序,避免无效信息占用上下文窗口。

2.1.1.4. 规划模块

Agent 的 “任务拆解器”,是处理复杂长任务的核心,主流规划范式如下:

- 链式规划(CoT,思维链):一步一步线性推理,适合简单线性任务,实现门槛最低;

- 树状规划(ToT,思维树):多分支探索,评估每个分支的可行性,选择最优路径,适合多解决方案的复杂任务;

- 图状规划(GoT,思维图):支持循环、合并、分支的非线性规划,适合多依赖、强耦合的复杂任务;

- 预规划 + 执行(Plan-and-Execute):先制定完整的全局执行计划,再分步执行,执行中动态调整计划,是长周期任务的首选方案。

2.1.1.5. 工具调用与执行模块

Agent 的 “手脚”,是 Agent 与外部环境交互的唯一途径,核心基于 LLM 的 Function Call(函数调用)能力实现。

- 工具库:封装可执行工具,每个工具包含名称、功能描述、参数格式(JSON Schema)、执行函数、错误处理逻辑;

- 工具选择器:LLM 基于当前子任务,自主选择适配工具,生成符合格式要求的调用参数;

- 执行器:校验参数合法性,调用工具执行函数,处理超时、报错、重试等异常情况;

- 结果处理器:将工具返回的异构结果(API 数据、代码输出、搜索结果)转化为 LLM 可理解的语义信息,过滤冗余内容。

2.1.1.6. 反思与校验模块

Agent 的 “自我优化器”,是抑制幻觉、提升任务成功率的核心:

- 结果校验器:基于任务目标,校验执行结果是否达标,是否存在幻觉、错误、遗漏;

- 失败分析器:定位失败根因(规划错误 / 工具选择错误 / 参数错误 / 信息不足);

- 策略优化器:生成修正方案,调整规划、工具调用策略,更新长期记忆中的经验,避免重复犯错。

2.1.2 经典单智能体架构范式

| 范式名称 | 核心逻辑 | 优势 | 适用场景 |

|---|---|---|---|

| ReAct(2023) | 推理 + 行动交替循环,Thought→Action→Observation 闭环迭代 | 极简、稳定、易实现,是工业界主流基础范式 | 绝大多数工具调用场景、中等复杂度任务 |

| Plan-and-Execute(2023) | 先全局规划拆解子任务,再分步执行,动态调整计划 | 全局视角强,长任务稳定性高,避免目标偏离 | 多步骤长周期任务、复杂项目执行 |

| Reflexion(2023) | 在 ReAct 基础上增加反思闭环,执行→校验→反思→优化→重执行 | 准确率极高,幻觉抑制能力强 | 代码生成、数学推理、数据分析等高准确性要求场景 |

| AutoGPT(2023) | 全自主架构,完整的长期记忆、自主规划、多工具集成、自我迭代 | 自主性最强,可处理极复杂的长期目标 | 无人工干预的全自动化任务、长期目标执行 |

2.2 多智能体系统(MAS)架构

当任务需要多角色、多专业能力、强流程化协作时,单智能体能力边界不足,需引入多智能体系统 —— 多个具备独立能力的 Agent,通过分工协作共同完成复杂目标。

2.2.1 核心协作模式

| 协作模式 | 架构特点 | 优势 | 局限 |

|---|---|---|---|

| 中心化(主从模式) | 核心调度 Agent(Manager)负责全局规划、任务分配、结果汇总,Worker Agent 仅负责执行分配的子任务 | 结构简单、可控性强、流程清晰 | 调度 Agent 成为性能瓶颈,灵活性不足 |

| 去中心化(平等模式) | 所有 Agent 地位平等,通过消息总线通信,自主协商任务分配与协作方式 | 灵活性强、分布式执行、无单点瓶颈 | 易出现协商混乱、目标偏离、流程不可控 |

| 混合式(主流方案) | 核心调度 Agent 负责全局规划与协调,同时 Agent 之间可直接通信协同完成子任务 | 兼顾可控性与灵活性,适配绝大多数企业级场景 | 架构设计复杂度更高 |

2.2.2 主流工业级多智能体架构

-

MetaGPT(中科大 & 微软,2023)

- 核心设计:模拟软件公司标准化研发流程,基于 SOP(标准作业流程)的强角色分工,将人类成熟的工作流注入多智能体协作;

- 核心角色:产品经理→架构师→项目经理→工程师→测试工程师→运维工程师,严格按照 SOP 流转;

- 核心优势:强流程约束,输出标准化,大幅降低多智能体的协商混乱,适合软件开发、企业流程自动化等标准化场景。

-

CrewAI(开源,2023)

- 核心设计:基于「角色 - 任务 - 工具 - 流程」的轻量化多智能体框架,支持顺序执行、层级执行两种核心流程;

- 核心组件:Agent(角色定义)、Task(任务与依赖)、Crew(团队组合)、Process(执行流程);

- 核心优势:极简易用、灵活性极高,自定义程度强,是目前最受欢迎的多智能体快速开发框架。

-

ChatDev(清华,2023)

- 核心设计:模拟完整软件公司的研发全流程,分为设计→编码→测试→文档四大阶段,通过对话式交互完成角色协作;

- 核心优势:主打对话式协同,适配小型软件项目的全流程自动化开发。

三、Agent 如何“思考”?

Agent 的决策逻辑主要基于两种主流框架:

3.1 ReAct 框架:推理与行动同步

ReAct 的核心是 “先思考,再行动,再观察” 的循环。例如,用户要求“查询 2024 年诺贝尔物理学奖得主并总结贡献”:

Thought(思考):“我需要先确认得主,当前信息未知,需调用搜索引擎”

Action(行动):调用 Google Search 工具,输入关键词

Observation(观察):获取搜索结果,判断是否需要补充细节

循环:基于观察结果继续思考,直至完成总结

ReAct 灵活性高,适合需要动态调整策略的任务,但缺点是每步都需调用 LLM,效率较低。

3.2 Plan-and-Execute ReAct:先规划,再执行

为解决效率问题,该模式引入 “先全局规划,再批量执行” 的逻辑:

Plan:一次性拆解任务为子任务列表

Execute:按顺序或并行执行子任务,仅在规划和结果汇总时调用 LLM

典型代表 LLMCompiler 将子任务转化为有向无环图(DAG),支持并行执行,大幅提升复杂任务效率。

四、Agent五大核心模块

一个完整的 Agent 系统通常包含以下五大模块,形成数据与控制流的闭环:

4.1 感知模块(Perception Module)

负责从外部环境采集信息,支持文本、语音、图像等多模态输入。例如医疗诊断智能体需同时处理患者主诉文本、体检报告图像、可穿戴设备实时数据,通过 Transformer 架构编码器(如 BERT、ViT)分别处理后进行跨模态融合。

4.2 记忆模块(Memory Module)

存储并检索历史经验,为决策提供上下文:

短期记忆:存储当前会话的上下文,如聊天记录、临时数据

长期记忆:通过向量数据库(FAISS、Milvus、Chroma)存储结构化知识,支持语义检索

外部记忆:集成知识图谱、数据库或 API

4.3 意图识别模块(Intent Recognition)

理解当前目标或生成自主目标。可基于 LLM 模拟意图识别,通过少样本 Prompt 或微调模型进行分类-11。

4.4 决策引擎(Planner / Decision Maker)

智能体的“大脑”,负责根据感知层输入生成行动策略,可分为:

单步决策:适用于简单任务,通过预训练大模型直接生成回复

多步规划:复杂任务需结合规划算法(如蒙特卡洛树搜索、PPO 强化学习)与领域知识,拆解为子任务并动态调整计划-12

4.5 执行与通信模块(Actuator + Communicator)

将决策转化为具体动作,核心是工具调用(Function Calling)能力。通过函数调用机制,Agent 可调用 API 获取实时行情、计算估值、生成图表等,突破模型预训练数据的限制。

五、MCP 范式:新一代开发范式

MCP(Memory, Control, Planning)范式通过模块化设计,将 Agent 核心能力拆解为三大组件:

| 组件 | 核心功能 | 关键技术 | 应用示例 |

|---|---|---|---|

| Memory | 让 Agent 具备持续学习能力 | 向量数据库、语义检索 | 客服记住用户历史订单,提供个性化推荐 |

| Control | 动态调整 Agent 行为 | 规则引擎、反馈机制、多模态交互 | 游戏 NPC 行为符合角色设定;自动驾驶安全决策 |

| Planning | 实现复杂任务分解 | 任务分解、工具调用、动态调整 | 智能家居“回家模式”:开空调→调灯光→放音乐 |

六、主流开发框架对比

根据协作方式,Agent 框架可分为 Single-Agent 和 Multi-Agent 两类:

| 框架 | 类型 | 特点 | 适用场景 |

|---|---|---|---|

| LangChain | 单/多 | 功能强大的开源框架,提供模块化组件,支持 Chain 和 Agent 两种模式 | 单智能体、简单工具调用、RAG 应用 |

| LangGraph | 单/多 | LangChain 生态的图式工作流框架,支持复杂的状态管理和条件分支 | 需要精细控制执行流程的 Agent |

| AutoGPT | 单 | 全自主 Agent,接受高级目标后自动拆解并执行,可浏览、总结、编写代码 | 调研报告生成、自动化任务执行 |

| CrewAI | 多 | 为多智能体协作设计,可轻松定义具有不同角色的智能体团队 | 多角色协作完成复杂任务 |

| AutoGen | 多 | 微软出品,专注于简化多智能体应用开发,支持复杂的对话系统 | 多智能体对话、人机协同 |

| MetaGPT | 多 | 模拟软件公司架构,包含产品经理、架构师、工程师等角色 | 从需求到代码的完整软件开发 |

七、Agent实战

7.1 七步搭建指南

无论您是开发者还是业务人员,都可以遵循以下步骤开启智能体搭建之旅:

明确目标与范围:定义 Agent 要解决什么问题、核心功能是什么、成功标准是什么

选择工具与框架:根据任务复杂度选择 LangChain、AutoGen 或 CrewAI

搭建记忆系统:使用向量数据库存储用户偏好和历史交互

设计控制逻辑:定义规则引擎和反馈机制,确保行为符合预期

实现规划能力:通过任务分解和工具调用赋予 Agent“思考”能力

集成工具与 API:通过 Function Calling 连接外部服务

测试与迭代优化:根据反馈持续改进 Agent 性能和可靠性

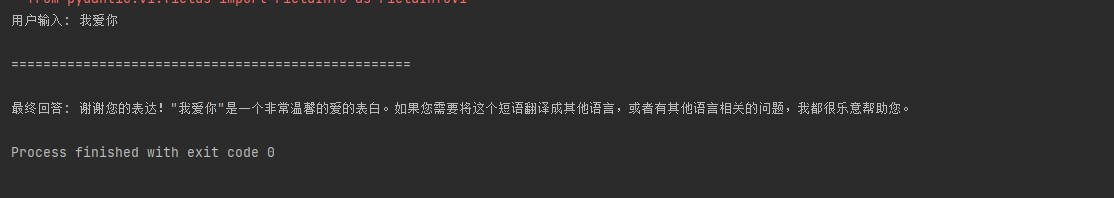

7.2 代码实战

7.2.1 翻译

from langchain_deepseek import ChatDeepSeek

from langgraph.prebuilt import ToolNode

from typing import Annotated, Literal, TypedDict

from langchain_core.messages import HumanMessage, AIMessage, ToolMessage

from langgraph.graph import StateGraph, END

from langgraph.graph.message import add_messages

dp_api_key = "xxxxxx"

def detect_language(text):

"""模拟语言检测"""

return "中文" if any("\u4e00" <= c <= "\u9fff" for c in text) else "未知"

def fake_translate(text):

"""模拟翻译(可替换为真实翻译 API)"""

# 实际场景可接入第三方翻译 API

return f"[Translated] {text}"

tools = [detect_language, fake_translate]

tool_node = ToolNode(tools)

llm = ChatDeepSeek(model="deepseek-reasoner", temperature=0, api_key=dp_api_key).bind_tools(tools)

class AgentState(TypedDict):

"""Agent 的状态定义"""

messages: Annotated[list, add_messages] # 消息列表,自动合并追加

def call_model(state: AgentState) -> dict:

"""调用 LLM 生成响应(可能包含工具调用)"""

messages = state["messages"]

response = llm.invoke(messages)

return {"messages": [response]}

def should_continue(state: AgentState) -> Literal["tools", END]:

"""判断下一步:调用工具 或 结束"""

messages = state["messages"]

last_message = messages[-1]

# 如果最后一条消息有工具调用请求,则进入工具节点

if hasattr(last_message, "tool_calls") and last_message.tool_calls:

return "tools"

# 否则结束流程

return END

# -------------------- Step 5: 构建图 --------------------

# 创建状态图

workflow = StateGraph(AgentState)

# 添加节点

workflow.add_node("agent", call_model) # Agent 决策节点

workflow.add_node("tools", ToolNode(tools)) # 工具执行节点

# 设置入口点

workflow.set_entry_point("agent")

# 添加边

workflow.add_conditional_edges(

"agent",

should_continue,

{

"tools": "tools",

END: END

}

)

workflow.add_edge("tools", "agent") # 工具执行后返回 Agent 继续思考

# 编译图

app = workflow.compile()

if __name__ == '__main__':

user_input = "我爱你"

print(f"用户输入: {user_input}\n")

print("=" * 50)

# 执行图

result = app.invoke({"messages": [HumanMessage(content=user_input)]})

# 打印最终答案

final_message = result["messages"][-1]

print("\n最终回答:", final_message.content)

7.2.2 极简 ReAct Agent

from deepseek_test import deep_llm

from dotenv import load_dotenv

from tavily_test import search

from langchain_core.tools import tool

from langgraph.prebuilt import create_react_agent

# 加载环境

load_dotenv()

# 2. 工具定义

@tool

def calculator(expression: str) -> str:

"""数学计算器,支持加减乘除和括号,示例:(300000*0.7*0.035/12)/(1-(1+0.035/12)**-360)"""

try:

return f"计算结果:{eval(expression)}"

except Exception as e:

return f"计算失败:{str(e)}"

tools = [search, calculator]

# 3. LangGraph 构建 ReAct 智能体(一行构建工业级循环)

agent = create_react_agent(deep_llm, tools)

# 4. 运行测试

if __name__ == "__main__":

print("=== 测试1:实时信息查询 ===")

res1 = agent.invoke({

"messages": [("user", "2026杭州亚运会时间和最新筹备情况")]

})

print(res1["messages"][-1].content)

print("\n=== 测试2:数学计算 ===")

res2 = agent.invoke({

"messages": [("user", "300万房子首付30%,贷款30年,年利率3.5%,月供多少?")]

})

print(res2["messages"][-1].content)

结果:

=== 测试1:实时信息查询 ===

根据搜索结果,我需要先澄清一个重要事实:**2026年亚运会并不在杭州举办。**## 重要澄清:2026年亚运会在日本名古屋

**第20届亚运会将于2026年在日本名古屋举办**:

- **举办时间**:2026年9月19日至10月4日

- **举办地点**:日本爱知县名古屋市

- **这是日本第三次举办亚运会**:此前曾在东京(1958年)和广岛(1994年)举办## 杭州已成功举办第19届亚运会

实际上,杭州举办的是**第19届亚运会**,原定2022年举行,因疫情推迟到**2023年9月23日至10月8日**举办。这届亚运会已经圆满结束。

## 杭州亚运会的筹备成果(回顾)

虽然2026年亚运会不在杭州,但杭州在2023年亚运会的筹备工作中取得了显著成就:

### 1. **场馆建设成果**

- 共有56个竞赛场馆(含亚残运会)

- 其中仅12个为新建场馆,其余均为改造(26个)、续建(9个)或临建(9个)

- 全部场馆已于2022年3月底竣工并完成验收

- 贯彻"绿色、低碳、可持续"理念,大部分场馆使用绿色电力### 2. **基础设施建设**

- 新建7条地铁线路和2条城际铁路

- 亚运村于2021年12月29日竣工,可容纳1万余名运动员和官员

- 实现亚运赛事专项气象观测全覆盖### 3. **技术创新应用**

- 测试6G相关技术(智能超表面技术)

- 数字治理和智能化服务系统

- 先进的通信保障体系## 杭州"后亚运时代"的遗产利用

杭州亚运会结束后,场馆和设施的后续利用规划十分清晰:

### 1. **全民健身开放**

- 56个竞赛场馆中的19个全民健身场馆将面向公众开放

- 24个市场化运营场馆将以低于市场价格的收费标准开放

- 黄龙体育中心每天可容纳6000余人次锻炼### 2. **打造"国际赛事之城"**

- 目标:到2025年成功举办3项国际顶级赛事

- 每年举办国际和国内高等级赛事10项以上

- 到2035年争取再举办一次高级别综合性赛事### 3. **城市发展促进**

- 提升了杭州的美誉度和国际影响力

- 加速了杭州"数字经济第一城"建设

- 促进了跨区域协同治理能力## 关于"2026杭州迷你亚运会"

搜索结果中提到的"2026杭州迷你亚运会"是一个**面向1-8周岁儿童的趣味体育活动**,并非正式的亚运会。这是一个传承亚运精神、面向儿童的运动推广活动。

## 总结

1. **2026年亚运会在日本名古屋**,不在杭州

2. **杭州已于2023年成功举办第19届亚运会**

3. 杭州亚运会的筹备工作充分体现了绿色、智能、可持续理念

4. 杭州正在积极推进亚运遗产利用,打造"国际赛事之城"如果您想了解更多关于2026年名古屋亚运会的具体信息,我可以为您进一步查询。

=== 测试2:数学计算 ===

根据您提供的信息,我们来计算一下月供金额:## 计算过程

1. **房屋总价**:300万元

2. **首付比例**:30% → 首付金额 = 300万 × 30% = 90万元

3. **贷款金额**:300万 × 70% = **210万元**

4. **贷款期限**:30年 = 360个月

5. **年利率**:3.5% → **月利率** = 3.5% ÷ 12 = 0.29167%## 等额本息还款公式

```

月供 = [贷款本金 × 月利率 × (1+月利率)^还款月数] / [(1+月利率)^还款月数 - 1]

```## 计算结果

```

月供 = 2100000 × (0.035/12) × (1 + 0.035/12)³⁶⁰ / [(1 + 0.035/12)³⁶⁰ - 1]

= **9,429.94元**

```## 总结

- **月供金额**:约 **9,430元/月**

- **还款总额**:9,430元 × 360个月 ≈ 339.48万元

- **支付利息总额**:339.48万 - 210万 ≈ 129.48万元## 注意事项

1. 这是按照**等额本息**还款方式计算的结果,每月还款额固定

2. 实际月供可能因银行政策、利率浮动、还款方式等因素略有差异

3. 如果选择**等额本金**还款方式,前期月供会更高,但总利息支出会更少

4. 建议咨询具体贷款银行获取精确计算结果

7.3 进阶实战:Multi-Agent 协作系统

对于更复杂的场景,可以构建多智能体协作系统。例如,阿里云 Assistant API 提供了无需提前定义、可自动规划编排任务流程的 Multi Agent 系统。

典型的多智能体架构包含以下角色:

Planner:接收用户问题,对其它 Agent 进行选择和编排

ChatAssistant:负责对话交互

InfoAssistant:负责特定领域信息查询

SummaryAssistant:汇总各 Agent 的输出并生成最终答案

通过给每个 Agent 制定明确的角色名称和职责描述,可以提升专业性和协作效率。

7.4 Agent 核心痛点与工业级优化方案

实战中 Agent 常出现幻觉、死循环、工具调用错误、上下文溢出等问题,以下是经过验证的核心优化方案:

-

幻觉抑制优化

- 强制工具校验:所有事实性内容必须通过搜索、数据库等工具校验,禁止 LLM 直接输出不确定的事实信息;

- 多轮反思校验:增加独立的校验环节,对输出内容进行二次事实核查;

- 低随机性设置:temperature 设置为 0~0.3,减少 LLM 的创造性输出;

- 来源标注:要求 Agent 输出所有事实信息的来源,强制对信息负责。

-

工具调用稳定性优化

- 精准的工具描述:明确工具的适用 / 不适用场景,参数 Schema 严格定义,无歧义;

- 参数前置校验:工具执行前增加参数合法性校验,避免错误格式传入;

- 重试与异常处理:设置 3 次以内的重试机制,错误信息必须清晰告知 LLM 错误原因与修正方向。

-

死循环与长任务优化

- 硬限制保护:设置 max_iterations 最大迭代次数,避免无限循环;

- 重复动作检测:检测到重复调用同一工具、传入相同参数超过 3 次,自动触发反思或终止;

- 任务拆解与分阶段执行:将长任务拆解为独立子任务,每个子任务设置明确的完成标准,仅传递核心结论到下一阶段,避免上下文溢出。

八、架构设计模式与演进趋势

8.1 三种主要设计模式

| 模式 | 特点 | 适用场景 |

|---|---|---|

| 单一智能体 | 一个智能体独立完成所有任务 | 目标明确、流程相对简单的场景 |

| 多智能体 | 多个智能体协同工作,各有专长 | 复杂任务需要多角色分工协作 |

| 人机协同 | 自动化流程关键节点引入人类审核 | 对可靠性和安全性要求高的场景 |

8.2 技术演进趋势

AI Agent 技术正从单一任务执行向多智能体协同进化-16,第三代架构(2025-未来)被定义为真正的自主智能体——具备目标感、能够自主规划任务路径、多 Agent 协作完成复杂任务-。未来,RAG 增强检索、多模态感知、具身智能等技术的融合,将进一步推动 Agent 向更通用、更智能的方向发展

九、Agent 前沿方向与行业落地

9.1 前沿研究方向

- 具身智能 Agent:Agent 与物理世界交互,控制机器人、自动驾驶等实体设备,完成物理世界的复杂任务;

- Agent 可解释性:解决 Agent 决策黑盒问题,实现思考过程可解释、可追溯、可控制;

- 多模态 Agent:支持文本、图像、音频、视频等多模态的感知与交互,适配更广泛的场景;

- Agent 安全对齐:解决自主行动中的有害行为、隐私泄露、权限滥用问题,确保 Agent 行为符合人类价值观与安全规范;

- 端侧小模型 Agent:基于轻量化开源小模型实现 Agent 核心能力,降低部署成本,实现端侧本地化部署。

9.2 主流行业落地场景

- 研发提效:代码生成、自动化测试、运维监控、故障排查,代表产品有 Devin、MetaGPT 等;

- 企业服务:智能客服、销售助理、HR / 财务智能助理,自动化企业日常流程;

- 金融行业:智能投研、风险控制、合规审核,自动化行业研究、财报分析、风险预警;

- 内容生产:自动化文案创作、新媒体运营、内容审核,多智能体协作完成全流程内容生产;

- 教育医疗:个性化学习助理、智能家教、病历分析、辅助诊断,实现个性化、专业化的服务提效。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)