留存预测最小特征集构建指南

基于行为日志构建留存预测模型,其核心在于从海量、原始的交互数据中,提炼出能够有效表征用户活跃度、投入度、成长轨迹及社交粘性的关键指标。一个设计精良的最小可行特征集(Minimum Viable Feature Set, MVF)应兼具预测效力强、计算成本低、业务可解释性高的特点。以下是一个系统性的构建方法与特征集设计方案。

一、 核心特征集构建框架

该框架遵循从基础行为到高阶综合指标的递进逻辑,确保特征既覆盖用户生命周期的关键维度,又避免冗余。

| 特征类别 | 特征名称 | 计算方式 / 描述 | 业务意义与预测逻辑 |

|---|---|---|---|

| 1. 基础活跃与强度 | session_count |

观测窗口内的总登录次数。 | 衡量用户访问的基本频率,是留存的基础前提。 |

total_duration |

观测窗口内的累计在线时长(秒)。 | 反映用户投入的绝对时间,深度参与的直接指标。 | |

avg_session_length |

total_duration / session_count。 |

评估单次访问的沉浸深度,区分“碎片化”与“深度”用户。 | |

active_days |

观测窗口内有登录行为的天数。 | 衡量用户活跃的持续性,高频持续活跃是强留存信号。 | |

| 2. 行为深度与成就 | level_reached |

观测窗口结束时达到的最高等级或进度。 | 核心成长指标,高等级通常与高留存正相关。 |

achievement_count |

获得的成就、奖杯总数。 | 衡量目标达成与正向反馈,激发持续参与的动力。 | |

key_task_completion_rate |

完成的主线/核心任务比例。 | 评估用户对核心内容的消耗进度和叙事/目标跟随度。 | |

resource_accumulation |

游戏币、高级货币等核心资源的净积累量。 | 反映经济系统参与度和积累的沉没成本。 | |

| 3. 社交与互动 | friend_count |

好友列表中的数量。 | 强预测因子,尤其在游戏后期,社交网络是留存的关键锚点。 |

interaction_frequency |

发起/接收组队、聊天、赠送等社交行为的次数。 | 衡量社交关系的活跃度和质量,互动越深,流失成本越高。 | |

guild_joined |

是否加入公会(1/0)。 | 标志用户寻求归属感,公会提供稳定的社交环境和持续目标。 | |

| 4. 消费与付费 | paying_user |

是否有过付费行为(1/0)。 | 付费用户流失意愿显著低于非付费用户。 |

total_spend |

累计付费金额。 | 沉没成本的直接体现,付费额度与留存意愿常呈正相关。 | |

last_pay_interval |

距最后一次付费的天数(若非付费用户则为NaN或极大值)。 | 付费活跃度指标,付费间隔拉长可能是流失前兆。 | |

| 5. 行为序列与变化趋势 | activity_trend |

基于每日活跃度的简单线性回归斜率。 | 量化活跃度的变化趋势,负斜率是潜在的流失预警信号。 |

recent_engagement_ratio |

(最近3天活跃度)/(观测窗口前3天活跃度)。 | 捕捉近期参与度的相对变化,锐减是高风险信号。 | |

session_regularity |

登录行为在时间分布上的规律性(如熵值或标准差)。 | 形成固定习惯的用户更稳定。 |

二、 特征工程与构建方法

直接从原始日志中计算上述特征,需经过以下关键步骤:

-

数据预处理与会话切割:

- 清洗日志,处理异常值与缺失值。

- 根据

user_id,timestamp,结合合理的“会话超时”规则(如30分钟无操作),将连续事件流切割为独立的会话。

-

特征计算与聚合:

- 以

user_id为键,在定义的观测窗口(例如,新用户首周、老用户最近14天)内进行聚合计算。 - 示例代码框架(Python Pandas):

import pandas as pd import numpy as np # 假设 df_logs 包含列:user_id, event_time, event_type, game_level, ... # 1. 定义观测窗口和标签窗口 observation_end = '2023-10-01' observation_days = 7 label_days = 7 # 预测未来7天是否留存 # 2. 过滤观测窗口数据 df_obs = df_logs[(df_logs['event_time'] >= pd.Timestamp(observation_end) - pd.Timedelta(days=observation_days)) & (df_logs['event_time'] < pd.Timestamp(observation_end))] # 3. 计算基础活跃特征 def calculate_mvf_features(df_group): features = {} # 活跃强度 features['session_count'] = df_group['session_id'].nunique() # 假设已切割会话 features['total_duration'] = df_group['duration'].sum() features['avg_session_length'] = features['total_duration'] / features['session_count'] if features['session_count'] > 0 else 0 features['active_days'] = df_group['event_date'].nunique() # 行为深度与成就 features['level_reached'] = df_group['game_level'].max() features['achievement_count'] = df_group[df_group['event_type'] == 'unlock_achievement'].shape[0] # ... 计算其他特征 # 社交特征 (假设有好友互动事件) features['friend_count'] = df_group['friend_id'].nunique() # 需从交互日志中提取 features['interaction_frequency'] = df_group[df_group['event_type'].isin(['chat', 'team_up'])].shape[0] return pd.Series(features) # 按用户聚合计算特征 user_features = df_obs.groupby('user_id').apply(calculate_mvf_features).reset_index() # 4. 构建标签 (是否在标签窗口内活跃) df_label_window = df_logs[(df_logs['event_time'] >= pd.Timestamp(observation_end)) & (df_logs['event_time'] < pd.Timestamp(observation_end) + pd.Timedelta(days=label_days))] retained_users = df_label_window['user_id'].unique() user_features['retained'] = user_features['user_id'].isin(retained_users).astype(int) - 以

-

特征选择与验证:

- 使用相关性分析、递归特征消除或基于树模型的特征重要性(如XGBoost)来评估上述特征对留存标签的预测能力。

- MVF原则:优先保留重要性排名靠前、且彼此相关性较低的特征。例如,若

total_duration和active_days高度相关,可考虑只保留一个。

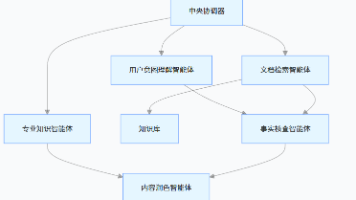

三、 基于系统架构的考量

在构建特征集时,需考虑底层数据架构的支撑能力。存算分离架构(如对象存储+弹性计算集群)允许低成本存储海量原始日志,并动态计算复杂的特征。对于实时预测,需要构建流式特征管道,计算如recent_engagement_ratio这类时间敏感指标。

一个完整的智能用户画像系统会在此基础上,融合更多维度的数据(如设备信息、渠道来源),并利用机器学习模型(如XGBoost、LightGBM)进行自动化特征交叉与高阶特征生成,以进一步提升预测精度。但对于定义“最小可行集”,上述基于领域知识的特征工程是最高效、最可解释的起点。

总结:一个有效的留存预测MVF特征集应围绕活跃强度、行为深度、社交网络和付费行为四大支柱构建。从原始日志到特征表的转化,关键在于清晰定义观测窗口、准确切割用户会话,并进行高效的聚合计算。此特征集不仅能服务于离线预测模型,也为后续构建更复杂的实时画像与个性化干预系统奠定了数据基础。

参考来源

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)