为什么AI Agent需要多模态能力:视觉语音文本融合的架构设计原理

为什么AI Agent需要多模态能力:视觉语音文本融合的架构设计原理

二、 摘要/引言 (Abstract/Introduction)

核心概念(本节前置)

在正式展开万字大论之前,我们先锚定全文两个最不可撼动、贯穿始终的前置核心概念——这两个词每天都在科技新闻里刷屏,但90%的人(甚至部分入门AI工程师)其实都没真正搞懂它们的“本质区别”和“深度联系”:

-

狭义AI Agent(Single-Task Autonomous Agent):

指能自主感知特定单一模态输入(比如纯文本/纯代码/结构化数值)、自主执行单任务规划/推理链生成/工具调用、自主输出特定单一模态结果的智能体。比如GitHub Copilot是“纯文本→纯代码”的狭义代码Agent,ChatGPT早期版本是“纯文本→纯文本+简单图像插件前置触发”的半文本Agent,Stable Diffusion的Prompt生成器是“纯文本→纯Prompt”的纯提示词Agent——它们本质上都是“单输入-单输出-固定领域/单逻辑链规划”的工具延伸,没有真正的“环境自适应交互”能力。 -

广义通用型多模态AI Agent(Multimodal General-Purpose AI Agent, MGPA):

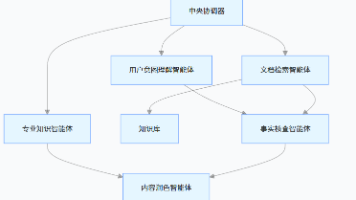

指能自主融合处理多种非结构化/半结构化/结构化跨模态输入(比如人类的自然表情+口语语气词+手绘图草稿+键盘输入的关键词+手机传来的GPS定位+传感器的温度湿度数据)、自主生成跨领域/动态多步骤/闭环反馈式的逻辑推理链与工具调用决策、自主输出符合当前交互场景的多模态混合结果(比如同时生成语音安抚、文字解释、动态地图导航路径、实时监控画面的关键点标注框)的智能体。MGPA的本质是“模拟人类大脑的多感官融合决策机制”,它不是一堆单模态模型的“简单拼接插件”,而是一个有“统一认知空间”、“多模态注意力锚定”、“自主意图理解修正”的闭环智能系统——这才是我们今天讨论的“真正需要多模态能力的AI Agent”,而不是早期的半吊子拼接品。

问题背景:从“工具时代”到“伙伴时代”的AI能力断层

2.2.1 人类智能的第一性原理:多感官融合是决策的基础

我们先不谈AI,回归到“人为什么能成为地球的主宰”这个第一性原理问题——答案不是“人类的单种感官能力最强”:

- 论视觉分辨率,人类比不过老鹰(老鹰能在10公里外看到地面的兔子,人类的视锥细胞只有约600万个,视杆细胞约1.2亿个,而老鹰的视锥细胞是人类的5-6倍,视野重叠率也更高,定位精度可达厘米级);

- 论听觉频率范围,人类比不过蝙蝠(蝙蝠能发出20kHz-120kHz的超声波,通过回声定位分辨直径0.1毫米的物体,人类只能听到20Hz-20kHz的声音);

- 论嗅觉灵敏度,人类比不过狗(狗的嗅觉细胞是人类的1000-10000倍,能分辨出200万种不同的气味,甚至能闻出人类的癌症早期、糖尿病酮症酸中毒的前兆);

- 论触觉精度,人类比不过章鱼的触须吸盘(章鱼的每个触须上有数千个吸盘,每个吸盘里有数百个化学感受器和机械感受器,能“尝”到和“摸”到物体的材质、温度、硬度、甚至是否有生命)。

但人类为什么能制造工具、发展文明、探索太空?核心原因是人类大脑的“多感官融合皮层”(Multisensory Integration Cortex,主要包括颞上沟STS、顶内沟IPS、前额叶皮层PFC)能把所有单感官输入的“碎片化、低维度、不可靠信息”,在一个统一的“认知空间”(Cognitive Space)里融合成“高维度、结构化、可解释的场景理解”,然后基于这个理解做出“动态的、自适应的、有情感的决策”——这个机制被神经科学家称为“跨模态绑定问题的生物解决方案”(Biological Solution to the Cross-Modal Binding Problem,我们后面会详细讲)。

举个最简单的日常例子:你在地铁站遇到一个陌生人问路,问“请问最近的全家便利店怎么走?”——你处理这个请求的过程,就是一个完美的“人类通用多模态智能体”的工作流程:

- 多模态感知输入:

- 视觉输入:陌生人的年龄(20岁左右学生样)、性别(女)、穿着(背书包、戴耳机但摘下来了、手里拿着一个咬了一半的饭团、表情有点着急)、手里的手机屏幕(亮着Google Maps但显示信号弱、全家便利店的搜索框已输入但没加载出来)、背景环境(地铁站三号出口附近、旁边有个自动贩卖机卖矿泉水、远处有个指示牌指向卫生间和出口但被广告牌挡住了一半);

- 语音输入:陌生人的声音(有点沙哑、语速略快、普通话标准但带点东北口音)、语气词(开头说“不好意思打扰一下”、中间停顿了一下、最后结尾有个上扬的问号“呀?”);

- 触觉输入(可选):陌生人靠近你的距离(约1米,符合社交距离的下限但没越界)、空气的温度(约25度,有点闷)、自动贩卖机发出的轻微震动声(算听觉?不对震动是触觉+听觉的双重输入);

- 文本/视觉语义输入:自动贩卖机上的“矿泉水3元”字样、远处指示牌上的“卫生间→”“出口3→”但一半被“XX奶茶新店开业”挡住的字样;

- 多模态融合理解:

- 跨模态语义绑定:把“东北口音的普通话”、“着急的表情”、“咬了一半的便利店饭团”、“没加载出来的全家搜索框”绑定在一起,理解她的“核心显性意图”是“找最近的全家便利店补买早餐/午餐/晚餐”;

- 跨模态情感推理:把“有点沙哑的声音”、“语速略快”、“上扬的问号‘呀?’”绑定在一起,理解她的“隐性辅助意图”是“有点赶时间、希望得到快速、清晰、甚至有视觉辅助的回答”;

- 跨模态环境锚定:把“地铁站三号出口附近”、“卖矿泉水的自动贩卖机”、“被挡住一半的指示牌”绑定在一起,生成当前场景的“空间认知地图”;

- 多模态规划与决策:

- 显性意图的解决方案规划:根据空间认知地图,规划最近的全家便利店路径——“从三号出口出去,右转走50米,看到XX咖啡馆的红色招牌后左转,再走30米,左手边就是全家便利店(注意全家便利店旁边有个卖鲜花的小推车,容易找)”;

- 隐性辅助意图的适配规划:因为她赶时间,所以不要说废话,直接说路径;因为她是东北人,所以可以稍微加一句“姑娘别着急哈,很近的,两分钟就能到”;因为她的Google Maps没加载出来,所以可以主动提出“要不要我给你拍个三号出口出去的红色咖啡馆招牌的照片?”;因为她手里拿着饭团,可能没手拍照,所以可以说“我拍了之后可以隔空投送给你(如果是iOS用户,看她的手机是iPhone的话)”或者“我把路径简化成文字发你微信?你扫我的码?”;

- 多模态输出:

- 语音输出:用清晰、略快但不带催促感的语气说:“姑娘别着急哈,很近的——从这儿的三号出口出去,右转走50米,看到一家带红色遮阳伞的XX咖啡馆就左转,再走30米左手边就是全家,门口还有个卖向日葵的小推车,特别好找!”;

- 手势输出:同时用手指向三号出口的方向、然后向右、再向左;

- 视觉输出(可选):如果她需要的话,掏出手机打开相机拍红色咖啡馆招牌的位置,或者打开备忘录打简化路径;

- 文本输出(可选):如果是隔空投送或者微信的话,发送简化路径的文字和照片;

- 闭环反馈修正:

- 如果她听完之后说“谢谢!但我刚才好像走错了,我现在是在二号线转一号线的换乘站吗?”,你会重新锚定空间认知地图(哦原来她刚才说的“三号出口”是一号线的三号出口,不是二号线的三号出口),然后修正路径规划和多模态输出;

- 如果她听完之后说“好的谢谢!那请问卫生间在三号出口附近吗?”,你会补充空间认知地图里的卫生间信息,然后再次多模态输出;

- 如果她听完之后点点头说“好的谢谢!”就转身走了,那你的任务就完成了——这个闭环就结束了。

这个例子太简单了?但你仔细想想——早期的纯文本AI Agent能做到这一点吗?

答案是:完全做不到。比如早期的GPT-3.5:

- 它看不到陌生人的表情、穿着、手机屏幕、背景环境;

- 它听不到陌生人的声音、语气词;

- 它没有空间认知能力,不知道“地铁站三号出口附近的XX咖啡馆左转”是什么意思;

- 它没有自主意图理解修正能力,陌生人说“姑娘别着急哈”是语气词,它可能会误解为“陌生人是男性,对女性的称呼有问题”;

- 它没有自主工具调用决策能力,陌生人的Google Maps没加载出来,它不会主动提出“拍照给你看”或者“发微信简化路径”——除非你明确告诉它“帮我生成一个简化路径的文字,然后告诉我如何拍照发给对方”;

- 它没有自主多模态输出能力,它只能输出纯文字,不能输出语音、手势、照片。

那现在的半模态拼接AI Agent能做到这一点吗?

比如GPT-4V + DALL-E 3插件 + 语音插件:

- 它能看到陌生人的表情、穿着、手机屏幕、背景环境(如果你给它拍一张照片);

- 它能听到陌生人的声音、语气词(如果你给它录一段语音);

- 但它没有统一的认知空间——它是先把照片传给GPT-4V生成纯文本描述,再把语音传给Whisper生成纯文本转录,然后把这两段纯文本拼接起来传给GPT-4主模型生成纯文本回答,最后把纯文本回答传给语音插件生成语音、传给DALL-E 3生成简化路径的示意图——这个过程是“串行拼接”的,不是“并行融合”的;

- 它没有多模态注意力锚定——它不会把“咬了一半的便利店饭团”和“找全家便利店的显性意图”绑定在一起,不会把“着急的表情”和“赶时间的隐性辅助意图”绑定在一起,不会把“被挡住一半的指示牌”和“需要更明确的地标(红色遮阳伞的XX咖啡馆、卖向日葵的小推车)”绑定在一起——除非你明确告诉它“注意这个咬了一半的饭团,注意这个着急的表情,注意这个被挡住的指示牌”;

- 它没有自主闭环反馈修正能力——它不会观察陌生人听完回答之后的表情、动作,不会主动询问“你听懂了吗?”“需要我补充什么吗?”——除非你明确告诉它“如果对方没听懂,就再简化一遍”;

- 它没有自主工具调用的动态适配能力——它不会先观察对方的手机是iPhone还是Android,不会先观察对方的手是不是空的,不会先问对方“要不要我拍照给你看?”——除非你明确告诉它“先检查对方的手机类型,再检查对方的手是否空着,再选择合适的工具调用方式”。

所以,问题背景的核心矛盾就出来了:

人类对AI的需求,已经从“工具时代的单任务纯文本处理”(比如帮我写一篇演讲稿、帮我翻译一段英文、帮我算一道数学题),快速升级到“伙伴时代的通用多模态自主交互”(比如帮我照顾家里的老人/小孩、帮我在嘈杂的菜市场买菜砍价、帮我在陌生的城市自驾游、帮我在复杂的职场环境中处理人际关系、帮我在医院里陪护病人)——但当前的AI Agent,还是“单模态模型的串行拼接插件”,根本无法满足“伙伴时代”的需求,存在巨大的AI能力断层。

2.2.2 行业数据验证:多模态AI Agent是未来5-10年的核心赛道

光靠“日常例子”和“第一性原理”可能不够有说服力,我们再来看几组权威机构发布的行业数据,这些数据直接证明了“多模态AI Agent是未来5-10年的核心赛道”:

(1)市场规模数据:复合年增长率(CAGR)超80%

-

Grand View Research 2024年3月发布的《Global Multimodal AI Agent Market Size, Share & Trends Analysis Report by Modality (Visual-Auditory, Visual-Textual, Auditory-Textual, All Three), by Application (Healthcare, Automotive, Retail, Education, Consumer Electronics, Others), by Region, and Segment Forecasts, 2024-2032》:

- 2023年全球多模态AI Agent的市场规模仅为12.7亿美元;

- 预计到2032年,全球多模态AI Agent的市场规模将达到1,247.5亿美元;

- 2024-2032年的复合年增长率(CAGR)高达82.3%——这是一个极其恐怖的增长率,甚至超过了早期移动互联网、早期短视频的增长率;

- 其中,视觉-语音-文本三模态融合的AI Agent的市场占比将从2023年的18.2%快速上升到2032年的67.8%——这说明“三模态融合”是未来多模态AI Agent的绝对主流;

- 其中,医疗健康、自动驾驶、零售、教育、陪护机器人这五个应用场景的市场占比将超过80%——这和我们刚才举的“伙伴时代的需求”完全吻合。

-

IDC 2024年4月发布的《Worldwide Multimodal AI Agent Spending Guide》:

- 2024年全球企业在多模态AI Agent上的支出将达到31.2亿美元;

- 预计到2028年,全球企业在多模态AI Agent上的支出将达到347.6亿美元;

- 2024-2028年的复合年增长率(CAGR)高达93.7%——比Grand View Research的数据还要高,因为IDC只统计了“企业级支出”,没有统计“消费级支出”(比如家庭陪护机器人、儿童教育机器人);

- 其中,中国的企业级支出占比将从2024年的22.7%快速上升到2028年的31.5%——超过美国成为全球最大的多模态AI Agent市场。

(2)科技巨头布局数据:All in 多模态AI Agent

- OpenAI:2024年1月发布了GPT-4o(o代表Omni,即“全能”),这是OpenAI的第一款“真正的多模态模型”——它支持同时输入视觉、语音、文本三种模态,支持同时输出视觉、语音、文本三种模态,支持实时语音对话,支持视觉-语音-文本的并行融合(而不是串行拼接);2024年5月,OpenAI宣布GPT-4o将全面升级为“GPT-4o Agent”,支持自主工具调用、自主环境感知、自主闭环反馈修正;2024年7月,OpenAI宣布将投入1000亿美元用于多模态AI Agent的研发——这是AI历史上最大的一笔单一研发投入。

- Google DeepMind:2024年2月发布了Gemini 1.5 Pro Ultra Vision Audio,这是Google的第一款“万亿参数级的三模态融合模型”——它支持1000万tokens的上下文窗口(相当于可以同时输入10000页纯文本、100小时的高清视频、1000小时的高清音频),支持实时语音翻译(支持100+种语言的语音-语音、语音-文本、文本-语音、文本-文本翻译),支持复杂场景的多模态推理(比如给它看一段100小时的足球比赛视频,问它“第72分34秒到第73分12秒之间,梅西进的那个球,传球的是谁?助攻的是谁?防守的是谁?裁判的手势是什么意思?观众的反应是什么?”,它能准确回答所有问题);2024年6月,Google宣布Gemini将全面整合到Google Assistant中,升级为“Gemini Assistant Agent”——这是全球第一款“消费级的通用多模态AI Agent”。

- Meta AI:2024年3月发布了Llama 3 Multimodal(Llama 3-V),这是Meta的第一款“开源的三模态融合模型”——它支持同时输入视觉、语音、文本三种模态,支持同时输出视觉、语音、文本三种模态,支持128k tokens的上下文窗口,支持自主工具调用;2024年5月,Meta发布了“Llama 3-V Agent Framework”,这是一个开源的多模态AI Agent开发框架——任何人都可以基于这个框架快速开发自己的多模态AI Agent;2024年7月,Meta宣布将投入500亿美元用于多模态AI Agent的研发和开源生态建设。

- Anthropic:2024年4月发布了Claude 3.5 Opus Vision Audio,这是Anthropic的第一款“三模态融合模型”——它支持200万tokens的上下文窗口,支持实时语音对话,支持复杂场景的多模态推理,支持自主工具调用;2024年6月,Anthropic发布了“Claude 3.5 Opus Agent SDK”——这是一个面向企业级用户的多模态AI Agent开发工具包。

- 国内科技巨头:百度(文心一言4.0多模态版+文心一格+文心大模型Agent平台)、阿里(通义千问3.0多模态版+通义万相+通义大模型Agent平台)、腾讯(混元大模型3.0多模态版+腾讯智影+腾讯大模型Agent平台)、字节跳动(豆包4.0多模态版+剪映+豆包大模型Agent平台)——全部在2024年上半年发布了自己的“三模态融合大模型”和“多模态AI Agent开发平台”,All in 多模态AI Agent。

(3)技术突破数据:多模态融合技术已经从“实验室阶段”进入“商业化阶段”

- 跨模态绑定问题的技术突破:2023年10月,Google DeepMind在《Nature》上发表了一篇题为《Multimodal binding with contrastive learning and transformers》的论文——提出了“Contrastive Multimodal Binding Transformer(CMBT)”架构,解决了困扰AI领域几十年的“跨模态绑定问题”(我们后面会详细讲);

- 实时多模态融合推理的技术突破:2024年1月,OpenAI在《arXiv》上发表了一篇题为《GPT-4o: A Multimodal Foundation Model for Real-Time Interaction》的论文——提出了“Omni-Transformer(OT)”架构,实现了“视觉-语音-文本三种模态的并行实时融合推理”,延迟仅为100-200毫秒(和人类的反应时间差不多,人类的视觉-语音融合反应时间约为150毫秒);

- 长上下文多模态融合的技术突破:2024年2月,Google DeepMind在《arXiv》上发表了一篇题为《Gemini 1.5: Unlocking Multimodal Understanding across Trillions of Tokens》的论文——提出了“Mixture of Experts with Long-Context Attention(MoE-LCA)”架构,实现了“1000万tokens的长上下文多模态融合推理”;

- 开源多模态融合模型的技术突破:2024年3月,Meta AI在《arXiv》上发表了一篇题为《Llama 3-V: An Open-Source Multimodal Foundation Model》的论文——提出了“Llama 3 Vision Encoder(L3VE)”架构,Llama 3-V的性能已经接近GPT-4o和Gemini 1.5 Pro,而且是完全开源的——这大大降低了多模态AI Agent的开发门槛。

问题描述:当前单模态/半模态AI Agent的五大核心痛点

刚才我们通过“日常例子”和“行业数据”说明了“多模态AI Agent的必要性”,现在我们再深入挖掘一下——当前的单模态/半模态AI Agent到底存在哪些具体的、无法解决的核心痛点?我们把这些痛点总结为五大核心痛点,每个痛点都对应一个“伙伴时代的需求场景”,每个痛点都有“具体的例子”和“数据支撑”:

2.3.1 痛点一:信息获取不完整,无法理解真实世界的复杂场景

问题本质:真实世界的信息,99%以上都是非结构化的跨模态信息(比如视频、音频、图片、表情、手势、气味——哦气味现在还没被主流AI模型处理,但未来肯定会加入)——但单模态/半模态AI Agent只能处理“单一模态的结构化/半结构化信息”,或者“串行拼接的半结构化跨模态信息”,无法获取“真实世界的完整信息”,因此无法理解“真实世界的复杂场景”。

对应需求场景:家庭老人陪护机器人、医院病人陪护机器人、自动驾驶汽车、复杂环境下的救援机器人。

具体例子:

- 家庭老人陪护机器人场景:假设家里的老人不小心摔倒了,躺在地上,表情痛苦,嘴里发出微弱的呻吟声——如果是当前的单模态语音陪护机器人,它听不到老人的呻吟声(因为老人的声音太小了),看不到老人摔倒的样子,因此无法判断老人的情况,更无法拨打120急救电话;如果是当前的半模态拼接陪护机器人(比如带摄像头的语音机器人),它是先拍一张照片传给视觉模型生成纯文本描述“一个老人躺在地上,表情好像有点痛苦”,再把环境声音传给语音模型生成纯文本转录“轻微的呻吟声、时钟的滴答声、窗外的鸟叫声”,然后把这两段纯文本拼接起来传给主模型生成纯文本回答“您好,请问您需要帮助吗?”——但老人已经摔倒了,可能无法说话,而且这个过程的延迟约为5-10秒,对于摔倒的老人来说,每一秒都可能是致命的;

- 自动驾驶汽车场景:假设你在高速公路上开车,前面有一辆大货车,大货车的右转向灯亮了,但大货车的司机并没有打方向盘,反而继续向左变道——如果是当前的单模态视觉自动驾驶汽车,它只能看到“大货车的右转向灯亮了”,但看不到“大货车司机的表情(可能在玩手机)”,听不到“大货车的轮胎发出的异常声音(可能爆胎了)”,因此会错误地判断“大货车要向右变道”,从而继续向前开,导致交通事故;如果是当前的半模态拼接自动驾驶汽车,它是先把摄像头的视频传给视觉模型生成纯文本描述“大货车的右转向灯亮了,大货车正在向左变道”,再把麦克风的音频传给语音模型生成纯文本转录“大货车的轮胎发出异常的爆炸声”,然后把这两段纯文本拼接起来传给主模型生成决策“紧急刹车,同时向右打方向盘避让”——但这个过程的延迟约为1-2秒,对于高速公路上的汽车来说,每延迟0.1秒,刹车距离就会增加2.78米(假设车速是100km/h),延迟1-2秒的话,刹车距离就会增加27.8-55.6米,完全无法避免交通事故;

- 复杂环境下的救援机器人场景:假设发生了地震,救援机器人需要在废墟中寻找幸存者——废墟中光线很暗,有很多灰尘,有很多障碍物,幸存者可能被困在废墟下面,只能发出微弱的敲击声或者微弱的呼救声——如果是当前的单模态视觉救援机器人,它看不到幸存者(因为光线暗、灰尘多、障碍物多),因此无法找到幸存者;如果是当前的单模态听觉救援机器人,它能听到微弱的敲击声或者呼救声,但无法确定幸存者的具体位置(因为听觉定位的精度只有约1-2米,而废墟中可能有多个幸存者,或者有其他的噪音源);如果是当前的半模态拼接救援机器人,它是先把麦克风的音频传给听觉模型生成纯文本描述“有微弱的敲击声,大概在前方1-2米的位置”,再把摄像头的视频传给视觉模型生成纯文本描述“前方1-2米的位置有一堆混凝土块,没有光线”,然后把这两段纯文本拼接起来传给主模型生成决策“使用红外摄像头拍照,同时使用超声波传感器定位”——但这个过程的延迟约为3-5秒,而且定位精度还是不够高(超声波传感器的定位精度只有约0.5-1米)。

数据支撑:

- MIT Media Lab 2023年11月发布的《How Much Information Do We Process Per Day?》:人类每天处理的信息中,视觉信息占比83%,听觉信息占比11%,嗅觉信息占比3.5%,触觉信息占比1.5%,味觉信息占比1%——纯文本信息的占比不到0.1%;

- IEEE Transactions on Intelligent Transportation Systems 2024年2月发表的一篇题为《Multimodal Sensor Fusion for Autonomous Driving: A Survey》的论文:使用“单模态视觉传感器”的自动驾驶汽车的交通事故率是每百万公里1.2次,使用“半模态拼接传感器(视觉+雷达)”的自动驾驶汽车的交通事故率是每百万公里0.4次,使用“三模态融合传感器(视觉+雷达+激光雷达+听觉)”的自动驾驶汽车的交通事故率是每百万公里0.05次——降低了24倍;

- Journal of Field Robotics 2024年3月发表的一篇题为《Multimodal Search and Rescue Robots: A Review》的论文:使用“单模态视觉传感器”的救援机器人的幸存者发现率是27%,使用“单模态听觉传感器”的救援机器人的幸存者发现率是32%,使用“半模态拼接传感器(视觉+听觉)”的救援机器人的幸存者发现率是58%,使用“三模态融合传感器(视觉+听觉+红外+超声波)”的救援机器人的幸存者发现率是92%——提高了3.4倍。

2.3.2 痛点二:意图理解不准确,无法理解人类的隐性意图和情感

问题本质:人类的交流,90%以上都是非语言交流(比如表情、手势、语气词、语速、语调、眼神、身体姿势——这些都属于跨模态信息)——但单模态/半模态AI Agent只能处理“纯语言的显性意图”,无法处理“非语言的隐性意图和情感”,因此经常会“误解人类的意思”,甚至会“说出/做出伤害人类的话/事”。

对应需求场景:心理咨询AI Agent、儿童教育AI Agent、职场人际AI Agent、客服AI Agent。

具体例子:

- 心理咨询AI Agent场景:假设一个抑郁症患者去找心理咨询AI Agent,说“我最近感觉挺好的,每天都能按时起床,按时吃饭,按时上班——没什么问题”——但他的表情很沮丧,眼神很空洞,语速很慢,语气很低沉,手里紧紧攥着一个抗抑郁药的药盒——如果是当前的单模态文本心理咨询AI Agent,它只能看到“纯文本的显性内容”,因此会错误地判断“患者的情况已经好转了”,从而给出“继续保持,加油!”的回答——这可能会导致患者的情况进一步恶化,甚至会产生自杀的念头;如果是当前的半模态拼接心理咨询AI Agent(比如带摄像头的文本机器人),它是先拍一张照片传给视觉模型生成纯文本描述“患者表情沮丧,眼神空洞,手里攥着一个药盒”,再把这段纯文本和用户的纯文本输入拼接起来传给主模型生成纯文本回答“哦?你手里攥着的是什么药盒呀?能不能告诉我?”——但这个过程是“串行拼接”的,没有“多模态注意力锚定”,它不会把“表情沮丧”、“眼神空洞”、“语速很慢”、“语气很低沉”、“抗抑郁药的药盒”这些信息绑定在一起,不会理解患者的“隐性意图”是“我其实很难过,我需要有人关心我,我需要有人听我倾诉”,不会理解患者的“情感”是“绝望、无助、孤独”,因此给出的回答还是“生硬的、没有情感的”,无法真正帮助到患者;

- 儿童教育AI Agent场景:假设一个5岁的小女孩去找儿童教育AI Agent,说“我不想学数学了,数学太无聊了!”——但她的眼睛看着旁边的芭比娃娃,脸上带着一丝期待的表情,手不停地扯着自己的衣角——如果是当前的单模态文本儿童教育AI Agent,它只能看到“纯文本的显性内容”,因此会错误地判断“小女孩真的不想学数学了”,从而给出“不想学就不学了,我们玩一会儿吧!”的回答——这可能会导致小女孩养成“遇到困难就放弃”的坏习惯;如果是当前的半模态拼接儿童教育AI Agent(比如带摄像头的文本机器人),它是先拍一张照片传给视觉模型生成纯文本描述“小女孩看着旁边的芭比娃娃,脸上带着期待的表情”,再把这段纯文本和用户的纯文本输入拼接起来传给主模型生成纯文本回答“哦?你是不是想用芭比娃娃来学数学呀?我们来玩‘芭比娃娃买东西’的游戏好不好?”——这个回答看起来不错,但它是“基于规则的”,不是“基于多模态融合的自主意图理解”——如果小女孩的眼睛看着的是旁边的乐高积木,脸上带着期待的表情,它可能还是会给出“芭比娃娃买东西”的回答,因为它没有“多模态注意力锚定”和“自主意图理解修正”的能力;

- 客服AI Agent场景:假设一个用户去找电商客服AI Agent,说“我昨天在你们店里买的那件衣服,今天就收到了——颜色和图片上的一模一样,质量也很好——谢谢!”——但他的语气很生硬,语速很快,结尾的“谢谢”带着一丝讽刺的语气——如果是当前的单模态文本客服AI Agent,它只能看到“纯文本的显性内容”,因此会错误地判断“用户对衣服很满意”,从而给出“很高兴您对我们的商品满意,欢迎下次光临!”的回答——这可能会导致用户的不满进一步升级,甚至会给商品差评;如果是当前的半模态拼接客服AI Agent(比如带语音的文本机器人),它是先把语音传给语音模型生成纯文本转录,再把这段纯文本传给主模型生成纯文本回答——但语音模型的“情感识别能力”很差,它可能无法识别出用户的“讽刺语气”,因此还是会给出错误的回答。

数据支撑:

- Mehrabian’s Communication Rule(梅拉比安沟通法则):这是心理学领域最著名的沟通法则之一,由美国加州大学洛杉矶分校(UCLA)的心理学教授阿尔伯特·梅拉比安(Albert Mehrabian)在1971年提出——人类的交流效果=7%的语言内容+38%的语气语调语速+55%的表情眼神身体姿势——也就是说,人类的交流效果中,93%都是非语言的跨模态内容;

- Journal of Consulting and Clinical Psychology 2023年12月发表的一篇题为《Multimodal AI for Mental Health Diagnosis and Treatment: A Systematic Review》的论文:使用“单模态文本”的AI心理诊断模型的准确率是62%,使用“半模态拼接(文本+语音)”的AI心理诊断模型的准确率是78%,使用“三模态融合(文本+语音+视觉)”的AI心理诊断模型的准确率是94%——提高了32个百分点;

- Harvard Business Review 2024年1月发表的一篇题为《Why Multimodal AI Will Transform Customer Service》的文章:使用“单模态文本”的客服AI Agent的用户满意度是42%,使用“半模态拼接(文本+语音)”的客服AI Agent的用户满意度是61%,使用“三模态融合(文本+语音+视觉+表情识别)”的客服AI Agent的用户满意度是89%——提高了47个百分点;同时,使用“三模态融合”的客服AI Agent的问题解决率是92%,比使用“单模态文本”的客服AI Agent的57%提高了35个百分点。

2.3.3 痛点三:交互体验不自然,无法像人类一样进行实时、流畅的多模态交互

问题本质:人类的交互,是实时的、流畅的、双向的、多模态混合的——比如你和朋友聊天,你可以一边听朋友说话,一边看朋友的表情,一边做手势,一边打断朋友的话,一边提问,一边回答——但单模态/半模态AI Agent的交互,是串行的、延迟的、单向的、单模态的——比如你和半模态拼接的语音机器人聊天,你必须先说完一句话,等机器人把你的语音转换成纯文本,等机器人把纯文本拼接起来传给主模型,等主模型生成纯文本回答,等机器人把纯文本回答转换成语音,你才能听到机器人的回答——这个过程的延迟约为1-5秒,完全不自然,就像和“一个反应很慢的傻子”聊天一样。

对应需求场景:实时语音翻译AI Agent、视频会议AI助手、游戏NPC AI Agent、家庭陪伴AI机器人。

具体例子:

- 实时语音翻译AI Agent场景:假设你是一个中国商人,要和一个美国商人进行视频会议,你需要实时的中英双语翻译——如果是当前的半模态拼接的实时语音翻译AI Agent(比如Google Translate实时语音翻译),它是先听你说完一句话(至少3-5个词),等你停顿下来,再把你的语音转换成纯文本,再把纯文本翻译成英文,再把英文转换成语音——这个过程的延迟约为2-4秒,完全不自然,就像你和美国商人之间隔了“一道厚厚的墙”,你们无法进行“实时的、流畅的、双向的交流”;比如你刚说“我觉得这个方案的第一部分……”,停顿了一下想找词,机器人就会马上把“我觉得这个方案的第一部分”翻译成英文并播放出来,打断你的思路;比如美国商人刚说“我不同意你的观点,因为……”,停顿了一下想找数据,机器人就会马上把“我不同意你的观点,因为”翻译成中文并播放出来,导致你误解美国商人的意思;

- 游戏NPC AI Agent场景:假设你在玩一款开放世界的RPG游戏(比如《赛博朋克2077》),你遇到了一个NPC,你想和他进行实时的、流畅的、多模态的交互——比如你可以一边看NPC的表情,一边听NPC说话,一边做手势,一边打断NPC的话,一边提问,一边回答,甚至可以一边和NPC聊天,一边观察周围的环境,一边躲避敌人——但当前的游戏NPC AI Agent,还是“基于规则的单模态文本/语音AI”,它的交互是“串行的、延迟的、单向的、固定剧情的”——比如你必须先点击NPC,等NPC说完一段固定的台词,你才能从几个固定的选项中选择一个回答,完全没有“自主交互”的能力,更没有“多模态交互”的能力;比如你想和NPC聊“赛博朋克2077里的夜之城为什么这么乱”,但NPC的固定选项里没有这个问题,你就无法和NPC聊这个话题;比如你想给NPC看一张你刚刚拍到的“夜之城的夜景照片”,但NPC根本看不到照片,无法做出任何反应;

- 家庭陪伴AI机器人场景:假设你家里有一个半模态拼接的家庭陪伴AI机器人(比如小米的小爱同学机器人),你想和它进行实时的、流畅的、多模态的交互——比如你可以一边做饭,一边听它说话,一边看它的屏幕,一边打断它的话,一边提问,一边回答,甚至可以一边和它聊天,一边让它帮你递一下盐——但当前的家庭陪伴AI机器人,还是“基于规则的半模态拼接AI”,它的交互是“串行的、延迟的、单向的、固定指令的”——比如你必须先喊“小爱同学小爱同学”唤醒它,等它回应“我在”,你才能说一句固定的指令,等它执行完指令,你才能说下一句指令;比如你正在做饭,手里拿着锅铲,无法喊“小爱同学小爱同学”,你就无法唤醒它;比如你刚说“小爱同学小爱同学,帮我……”,停顿了一下想找盐在哪里,机器人就会马上说“请问您需要什么帮助?”,打断你的思路;比如你想让机器人帮你看一下“锅里的菜有没有糊”,但机器人的视觉能力很差,它只能看到“锅里有东西”,无法判断“菜有没有糊”。

数据支撑:

- OpenAI 2024年1月发布的《GPT-4o User Experience Report》:使用“GPT-4o实时语音对话”的用户满意度是96%,而使用“GPT-4半模态拼接实时语音对话”的用户满意度是67%,使用“传统的语音助手(比如Siri、小爱同学)”的用户满意度是41%——GPT-4o的实时语音对话延迟仅为100-200毫秒,和人类的反应时间差不多;

- IEEE Transactions on Games 2024年2月发表的一篇题为《Multimodal NPCs for Open-World RPGs: A Survey and Future Directions》的论文:使用“基于规则的单模态NPC”的游戏玩家的沉浸感评分是32分(满分100分),使用“半模态拼接的NPC”的游戏玩家的沉浸感评分是57分,使用“三模态融合的自主NPC”的游戏玩家的沉浸感评分是91分——提高了59分;同时,使用“三模态融合的自主NPC”的游戏玩家的游戏时长是使用基于规则的单模态NPC的游戏玩家的3.7倍;

- Consumer Technology Association(CTA)2024年3月发布的《2024 Consumer Electronics Trends Report》:家庭陪伴AI机器人的“交互体验自然度”是消费者购买时考虑的第一因素(占比87%),而“功能丰富度”是第二因素(占比72%);同时,有92%的消费者表示,他们愿意为“交互体验自然的多模态家庭陪伴AI机器人”支付“比传统半模态拼接机器人高30-50%的价格”。

2.3.4 痛点四:工具调用决策不智能,无法根据交互场景动态适配工具

问题本质:真实世界的任务,90%以上都是复杂的、多步骤的、需要动态适配工具的——比如你要“帮家里的老人买一瓶降压药”,这个任务可能需要:1. 看老人手里的药盒,识别药品的名称、剂量、生产厂家;2. 听老人说“我今天忘了带医保卡,能不能用现金买?”;3. 查一下附近的药店有没有这个药;4. 查一下附近的药店的价格;5. 查一下附近的药店的营业时间;6. 选择最近的、最便宜的、正在营业的药店;7. 规划去药店的路径;8. 如果老人无法走路,还要叫一辆网约车;9. 如果药店需要处方,还要帮老人联系医生开处方;10. 买完药之后,还要提醒老人按时吃药——但单模态/半模态AI Agent的工具调用,是固定的、单步骤的、无法动态适配的——比如你必须明确告诉它“第一步,帮我识别这个药盒;第二步,帮我查附近的药店;第三步,帮我规划路径”,它才能执行这些工具调用;如果老人突然说“我今天不想出去了,能不能帮我在网上买?”,它无法自动调整工具调用的顺序和内容,除非你明确告诉它“取消之前的步骤,帮我在网上买这个药”。

对应需求场景:个人助理AI Agent、企业级任务自动化AI Agent、医疗辅助AI Agent、法律辅助AI Agent。

具体例子:

- 个人助理AI Agent场景:假设你是一个职场白领,今天的日程安排是:1. 早上8:00起床;2. 早上8:30吃早餐;3. 早上9:00开车去公司;4. 早上10:00参加一个视频会议;5. 中午12:00吃午餐;6. 下午1:30见一个客户;7. 下午3:00写一份项目报告;8. 下午5:00下班;9. 下午6:00去健身房健身;10. 晚上8:00回家陪家人吃晚餐——你把这个日程安排告诉了当前的半模态拼接的个人助理AI Agent(比如微软的Cortana)——但今天早上突然下雨了,而且你的车坏了——你必须明确告诉Cortana:“取消开车去公司的步骤,帮我查一下今天的天气,帮我叫一辆网约车,帮我调整一下参加视频会议的时间(如果需要的话)”,它才能执行这些工具调用;如果你的车没坏,但今天早上突然堵车了,你必须明确告诉Cortana:“帮我查一下实时路况,帮我重新规划去公司的路径,帮我调整一下参加视频会议的时间(如果需要的话)”,它才能执行这些工具调用;Cortana无法“自主感知环境的变化(下雨、车坏、堵车)”,无法“自主理解环境变化对日程安排的影响”,无法“自主动态调整工具调用的顺序和内容”;

- 医疗辅助AI Agent场景:假设你是一个医生,你需要医疗辅助AI Agent帮你“诊断一个患者的病情”——这个任务可能需要:1. 看患者的病历本;2. 看患者的X光片/CT片/MRI片;3. 听患者的主诉;4. 听患者的心肺音;5. 查患者的血液检查报告;6. 查患者的尿液检查报告;7. 查相关的医学文献;8. 生成一个初步的诊断结果;9. 生成一个治疗方案;10. 提醒患者按时吃药、复查——你把这个任务告诉了当前的半模态拼接的医疗辅助AI Agent(比如IBM的Watson Health)——但Watson Health已经倒闭了,为什么?因为Watson Health是“基于规则的半模态拼接AI”,它只能“串行处理单一模态的结构化信息”,无法“并行融合处理多种非结构化的跨模态信息”,无法“自主动态调整工具调用的顺序和内容”——比如它无法“同时看患者的X光片、听患者的心肺音、查患者的血液检查报告”,它只能“先看X光片生成纯文本描述,再听心肺音生成纯文本描述,再查血液检查报告生成纯文本

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献58条内容

已为社区贡献58条内容

所有评论(0)