基于云原生的 AI Agent Harness Engineering 架构设计

基于云原生的 AI Agent Harness Engineering 架构设计

引言

背景介绍

在当今快速发展的技术领域,两个趋势正在深刻改变我们构建和部署软件系统的方式:云原生(Cloud Native)架构和人工智能(AI)代理(Agent)系统。云原生技术,如容器化、微服务、Kubernetes编排和Serverless计算,为构建弹性、可扩展和高效的应用程序提供了强大的基础设施。与此同时,AI代理系统正从实验室走向实际应用,能够执行复杂任务、做出自主决策并与环境和其他代理进行交互。

然而,将这两个领域的优势结合起来并非易事。构建一个能够在云原生环境中高效运行的AI代理系统面临着诸多挑战,包括资源管理、可扩展性、通信复杂性和可靠性保证等问题。这正是本文要探讨的主题——基于云原生的AI Agent Harness Engineering架构设计。

核心问题

本文将围绕以下核心问题展开探讨:

- 如何设计一个能够充分利用云原生特性的AI代理架构?

- 如何在云环境中高效管理AI代理的生命周期和资源分配?

- 如何确保AI代理系统的可靠性、可观测性和安全性?

- 如何设计灵活的通信机制,支持AI代理之间以及代理与环境之间的复杂交互?

- 如何实现AI代理系统的持续部署和迭代更新?

文章脉络

本文将按照以下结构进行深入探讨:

- 首先,我们将介绍相关的基础概念,包括云原生技术、AI代理系统和Harness Engineering的定义。

- 接下来,我们将详细分析基于云原生的AI Agent Harness Engineering架构的核心设计原则和组件。

- 然后,我们将探讨关键技术实现,包括容器化策略、服务网格集成、资源调度和容错机制。

- 之后,我们将通过一个实际案例,展示如何在实际项目中应用这一架构。

- 最后,我们将总结全文,并展望这一领域的未来发展趋势。

通过本文的探讨,我们希望为开发者和架构师提供一个全面的指南,帮助他们设计和实现高效、可靠且可扩展的云原生AI代理系统。

基础概念

在深入探讨架构设计之前,我们需要先明确几个关键概念,为后续的讨论奠定基础。

云原生技术

云原生(Cloud Native)是一种构建和运行应用程序的方法,充分利用云计算模型的优势(弹性、可扩展性和容错性)。云原生计算基金会(CNCF)将云原生定义为包括以下几个关键要素:

- 容器化(Containerization):将应用程序及其依赖打包在轻量级、可移植的容器中,实现环境一致性和快速部署。

- 微服务架构(Microservices):将应用程序拆分为小型、独立的服务,每个服务负责特定功能,通过API进行通信。

- DevOps:结合开发(Development)和运维(Operations),实现持续集成(CI)和持续部署(CD),加速软件交付流程。

- 声明式API:通过声明期望的系统状态,而不是指定具体操作,来管理基础设施和应用程序。

- 弹性与可观测性:系统能够自动适应负载变化,并提供全面的监控、日志和追踪能力。

Kubernetes作为云原生生态系统的核心,提供了容器编排、服务发现、负载均衡和自我修复等关键功能,成为构建云原生应用的首选平台。

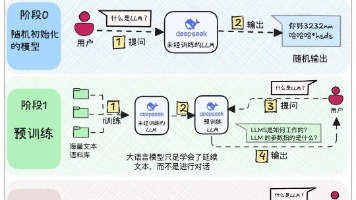

AI代理系统

AI代理(AI Agent)是指能够感知环境、做出决策并执行行动以实现特定目标的自主系统。与传统的软件系统不同,AI代理具有以下特点:

- 自主性:能够在没有人工干预的情况下执行任务。

- 反应性:能够感知环境变化并做出及时响应。

- 主动性:能够主动采取行动以实现长期目标。

- 社交能力:能够与其他代理或人类进行交互和协作。

AI代理可以基于不同的技术实现,包括规则引擎、机器学习模型、强化学习算法等。在复杂系统中,多个代理可以组成多代理系统(Multi-Agent System, MAS),通过协作完成单个代理无法完成的任务。

Harness Engineering

Harness Engineering是一个相对较新的概念,指的是设计和构建支撑复杂系统运行的框架或" harness"( harness原意指马具,引申为控制和利用力量的工具)。在AI代理的语境下,Harness Engineering关注的是:

- 生命周期管理:管理AI代理的创建、部署、监控和销毁过程。

- 资源编排:为AI代理分配和管理计算资源、存储和网络资源。

- 通信框架:提供AI代理之间以及代理与环境之间的通信机制。

- 安全与合规:确保AI代理系统的安全性和符合相关法规要求。

- 可观测性:提供监控、日志和追踪能力,以便理解和调试AI代理的行为。

Harness Engineering的目标是创建一个可靠、高效且灵活的框架,使AI代理能够在复杂环境中安全、有效地运行,同时降低开发和运维的复杂性。

核心架构设计

在理解了基础概念之后,我们现在来探讨基于云原生的AI Agent Harness Engineering架构的核心设计。

设计原则

一个好的架构设计应该基于明确的设计原则。对于基于云原生的AI Agent Harness Engineering架构,我们提出以下设计原则:

- 微服务化:将AI代理系统的各个功能组件拆分为独立的微服务,每个服务负责特定功能,实现高内聚低耦合。

- 容器化部署:将所有组件容器化,利用Kubernetes进行编排,确保环境一致性和部署灵活性。

- 声明式配置:使用声明式API定义系统状态,简化管理和自动化操作。

- 弹性伸缩:设计能够根据负载自动扩展或收缩的组件,充分利用云环境的弹性特性。

- 可观测性优先:从设计之初就考虑监控、日志和追踪,确保系统行为透明可理解。

- 安全性内置:将安全机制内置到架构设计中,而不是作为事后添加的功能。

- 容错与自我修复:设计能够检测和恢复故障的机制,提高系统可靠性。

架构组件

基于上述设计原则,我们提出一个多层次的云原生AI Agent Harness Engineering架构,包括以下主要组件:

1. 基础设施层

基础设施层是整个架构的基础,提供计算、存储和网络资源。在云环境中,这一层通常由云服务提供商(如AWS、Azure、GCP)或私有云基础设施提供。

关键组件包括:

- 计算资源:虚拟机(VM)、裸金属服务器或Serverless计算环境

- 存储资源:对象存储、块存储和文件存储

- 网络资源:虚拟网络、负载均衡器和网络安全组

- GPU/TPU资源:用于加速AI模型推理和训练的专用硬件

基础设施层的设计重点是资源的池化和抽象,使上层组件能够按需使用资源,而不需要关心底层的具体实现。

2. 容器编排层

容器编排层负责管理容器化应用的部署、扩展和操作。Kubernetes是这一层的事实标准,提供了丰富的功能来支持云原生应用的运行。

关键组件包括:

- Kubernetes控制平面:包括API服务器、调度器、控制器管理器和etcd

- 工作节点:运行容器的节点,包含kubelet、容器运行时(如Docker或containerd)和kube-proxy

- 自定义资源(CRDs):扩展Kubernetes API,以支持AI代理特定的概念和操作

- Operator模式:利用自定义控制器实现AI代理的自动化运维

在这一层,我们可以定义自定义资源,如AIAgent、AgentPool和AgentTask,来表示AI代理系统中的核心概念,并通过Operator模式实现这些资源的自动化管理。

3. 服务网格层

服务网格层负责管理服务之间的通信,提供服务发现、负载均衡、故障恢复、可观测性和安全性等功能。

关键组件包括:

- 数据平面:由轻量级代理(如Envoy)组成,部署为sidecar容器,与应用容器一起运行

- 控制平面:管理和配置数据平面代理,如Istio或Linkerd

- API网关:作为系统的入口点,处理外部请求并路由到内部服务

- 服务发现:使服务能够动态发现和相互通信

服务网格层对于AI代理系统尤为重要,因为它可以解决多代理通信中的复杂性,提供可靠的消息传递和流量管理。

4. AI代理运行时层

AI代理运行时层是专门为AI代理设计的执行环境,提供代理生命周期管理、资源分配和执行控制等功能。

关键组件包括:

- 代理控制器:管理AI代理的创建、调度、监控和销毁

- 资源调度器:根据代理需求和可用资源,智能分配计算资源

- 模型服务:提供AI模型的加载、缓存和推理服务

- 执行引擎:执行代理的决策逻辑和行动

- 状态管理:保存和恢复代理的内部状态

这一层的设计需要考虑AI代理的特殊需求,如模型加载时间、GPU资源分配和状态持久化等。

5. AI代理核心层

AI代理核心层包含实际的AI代理实现,是系统的业务逻辑所在。

关键组件包括:

- 代理实现:具体的AI代理代码,可以基于不同的技术栈(如Python、TensorFlow、PyTorch等)

- 感知模块:负责从环境中收集信息

- 决策模块:处理感知信息,做出决策

- 行动模块:执行决策,与环境或其他代理交互

- 学习模块:使代理能够从经验中学习和改进

这一层的组件应该被设计为可插拔的,允许根据具体需求使用不同的代理实现和算法。

6. 可观测性与治理层

可观测性与治理层提供监控、日志、追踪和安全治理功能,确保系统可靠、安全地运行。

关键组件包括:

- 监控系统:收集和分析系统指标(如Prometheus+Grafana)

- 日志系统:收集、存储和分析日志(如ELK Stack或Loki)

- 分布式追踪:跟踪请求在系统中的流动(如Jaeger或Zipkin)

- 安全策略:实施认证、授权和网络策略(如OPA或Kyverno)

- 合规管理:确保系统符合相关法规和标准

这一层对于理解AI代理的行为、排查问题和确保系统安全至关重要。

架构交互关系

为了更好地理解这些组件之间的交互关系,我们可以使用Mermaid图表来可视化整个架构和组件间的数据流。

首先,让我们看一下整体架构图:

这个架构图展示了各个层次之间的依赖关系和交互方式。数据和控制流从基础设施层向上流动,经过容器编排层、服务网格层、AI代理运行时层,最终到达AI代理核心层。同时,可观测性与治理层跨所有层次,提供监控和治理能力。

接下来,让我们看一下AI代理的生命周期管理流程:

这个序列图展示了AI代理从创建到销毁的完整生命周期,包括用户交互、资源分配、代理执行和状态管理等关键步骤。

关键技术实现

在了解了核心架构设计之后,我们现在来探讨一些关键技术的实现细节。

容器化策略

容器化是云原生架构的基础,对于AI代理系统,我们需要考虑特殊的容器化策略:

- 多层镜像构建:使用多阶段构建来减小镜像大小,同时保持构建环境和运行环境的分离。

# 构建阶段

FROM python:3.10-slim as builder

WORKDIR /app

COPY requirements.txt .

RUN pip install --user -r requirements.txt

# 运行阶段

FROM python:3.10-slim

WORKDIR /app

COPY --from=builder /root/.local /root/.local

COPY agent/ .

ENV PATH=/root/.local/bin:$PATH

CMD ["python", "main.py"]

-

模型与代码分离:将AI模型与代理代码分开打包,使用独立的容器或存储卷来管理模型,便于模型更新和版本控制。

-

GPU支持:为需要GPU加速的代理配置适当的容器运行时和设备插件,如NVIDIA Docker。

-

安全加固:使用非root用户运行容器,限制容器权限,扫描镜像漏洞,确保容器安全。

Kubernetes自定义资源与Operator

为了在Kubernetes中有效管理AI代理,我们可以定义自定义资源(CRDs)并实现相应的Operator:

首先,定义AIAgent自定义资源:

apiVersion: apiextensions.k8s.io/v1

kind: CustomResourceDefinition

metadata:

name: aiagents.ai.example.com

spec:

group: ai.example.com

names:

kind: AIAgent

listKind: AIAgentList

plural: aiagents

singular: aiagent

scope: Namespaced

versions:

- name: v1

served: true

storage: true

schema:

openAPIV3Schema:

type: object

properties:

spec:

type: object

properties:

model:

type: string

description: AI模型名称和版本

resources:

type: object

properties:

cpu:

type: string

memory:

type: string

gpu:

type: string

replicas:

type: integer

minimum: 1

env:

type: array

items:

type: object

properties:

name:

type: string

value:

type: string

status:

type: object

properties:

readyReplicas:

type: integer

phase:

type: string

conditions:

type: array

items:

type: object

properties:

type:

type: string

status:

type: string

lastTransitionTime:

type: string

reason:

type: string

message:

type: string

接下来,我们可以使用Kubernetes Operator SDK或Kubebuilder来实现AIAgent Operator。Operator的主要功能包括:

- 监听AIAgent资源的创建、更新和删除事件

- 根据AIAgent规范创建和管理相应的Kubernetes资源(如Deployment、Service、ConfigMap等)

- 监控代理的健康状态并更新AIAgent资源的状态

- 实现代理的自动扩缩容和自我修复

以下是一个简化的AIAgent Operator控制器实现(使用Python和kopf框架):

import kopf

import kubernetes.client

from kubernetes.client.rest import ApiException

@kopf.on.create('ai.example.com', 'v1', 'aiagents')

def create_fn(body, spec, name, namespace, logger, **kwargs):

logger.info(f"Creating AIAgent {name} in namespace {namespace}")

# 创建Deployment

deployment = create_deployment_spec(body, spec, name, namespace)

apps_api = kubernetes.client.AppsV1Api()

try:

apps_api.create_namespaced_deployment(namespace=namespace, body=deployment)

logger.info(f"Deployment {name} created successfully")

except ApiException as e:

logger.error(f"Error creating Deployment: {e}")

raise kopf.PermanentError(f"Failed to create Deployment: {e}")

# 创建Service

service = create_service_spec(body, spec, name, namespace)

core_api = kubernetes.client.CoreV1Api()

try:

core_api.create_namespaced_service(namespace=namespace, body=service)

logger.info(f"Service {name} created successfully")

except ApiException as e:

logger.error(f"Error creating Service: {e}")

# 这里可以选择是否回滚Deployment

raise kopf.PermanentError(f"Failed to create Service: {e}")

return {"message": f"AIAgent {name} created successfully"}

@kopf.on.update('ai.example.com', 'v1', 'aiagents')

def update_fn(body, spec, name, namespace, logger, **kwargs):

logger.info(f"Updating AIAgent {name} in namespace {namespace}")

# 更新Deployment

deployment = create_deployment_spec(body, spec, name, namespace)

apps_api = kubernetes.client.AppsV1Api()

try:

apps_api.patch_namespaced_deployment(name=name, namespace=namespace, body=deployment)

logger.info(f"Deployment {name} updated successfully")

except ApiException as e:

logger.error(f"Error updating Deployment: {e}")

raise kopf.PermanentError(f"Failed to update Deployment: {e}")

return {"message": f"AIAgent {name} updated successfully"}

@kopf.on.delete('ai.example.com', 'v1', 'aiagents')

def delete_fn(body, spec, name, namespace, logger, **kwargs):

logger.info(f"Deleting AIAgent {name} in namespace {namespace}")

# Kubernetes的级联删除会自动处理相关资源,这里只需要记录日志

return {"message": f"AIAgent {name} deletion in progress"}

@kopf.on.resume('ai.example.com', 'v1', 'aiagents')

@kopf.timer('ai.example.com', 'v1', 'aiagents', interval=60) # 每分钟检查一次

def reconcile_fn(body, spec, name, namespace, logger, **kwargs):

logger.info(f"Reconciling AIAgent {name} in namespace {namespace}")

apps_api = kubernetes.client.AppsV1Api()

try:

deployment = apps_api.read_namespaced_deployment(name=name, namespace=namespace)

# 更新AIAgent状态

ready_replicas = deployment.status.ready_replicas or 0

phase = "Running" if ready_replicas > 0 else "Pending"

# 更新自定义资源状态

patch = {

"status": {

"readyReplicas": ready_replicas,

"phase": phase,

"conditions": [

{

"type": "Ready",

"status": "True" if ready_replicas >= spec.get("replicas", 1) else "False",

"lastTransitionTime": kopf.now().isoformat(),

"reason": "DeploymentReady" if ready_replicas >= spec.get("replicas", 1) else "DeploymentNotReady",

"message": f"{ready_replicas}/{spec.get('replicas', 1)} replicas ready"

}

]

}

}

custom_api = kubernetes.client.CustomObjectsApi()

custom_api.patch_namespaced_custom_object_status(

group="ai.example.com",

version="v1",

namespace=namespace,

plural="aiagents",

name=name,

body=patch

)

except ApiException as e:

logger.error(f"Error reconciling AIAgent: {e}")

def create_deployment_spec(body, spec, name, namespace):

# 从spec中提取配置

model = spec.get("model", "default-model:latest")

replicas = spec.get("replicas", 1)

resources = spec.get("resources", {})

env = spec.get("env", [])

# 构建容器环境变量

container_env = [

{"name": "MODEL_NAME", "value": model},

{"name": "AGENT_NAME", "value": name},

{"name": "NAMESPACE", "value": namespace}

]

container_env.extend(env)

# 构建Deployment规范

return {

"apiVersion": "apps/v1",

"kind": "Deployment",

"metadata": {

"name": name,

"namespace": namespace,

"ownerReferences": [

{

"apiVersion": body["apiVersion"],

"kind": body["kind"],

"name": body["metadata"]["name"],

"uid": body["metadata"]["uid"],

"controller": True,

"blockOwnerDeletion": True

}

]

},

"spec": {

"replicas": replicas,

"selector": {

"matchLabels": {

"app": name

}

},

"template": {

"metadata": {

"labels": {

"app": name,

"ai-agent": "true"

}

},

"spec": {

"containers": [

{

"name": "agent",

"image": f"ai-agent-{model}", # 实际项目中应该有更复杂的镜像命名逻辑

"env": container_env,

"resources": {

"requests": {

"cpu": resources.get("cpu", "100m"),

"memory": resources.get("memory", "256Mi")

},

"limits": {

"cpu": resources.get("cpu", "500m"),

"memory": resources.get("memory", "512Mi")

}

},

"ports": [

{"containerPort": 8080, "name": "http"}

],

"livenessProbe": {

"httpGet": {"path": "/health/live", "port": "http"},

"initialDelaySeconds": 30,

"periodSeconds": 10

},

"readinessProbe": {

"httpGet": {"path": "/health/ready", "port": "http"},

"initialDelaySeconds": 5,

"periodSeconds": 5

}

}

]

}

}

}

}

def create_service_spec(body, spec, name, namespace):

return {

"apiVersion": "v1",

"kind": "Service",

"metadata": {

"name": name,

"namespace": namespace,

"ownerReferences": [

{

"apiVersion": body["apiVersion"],

"kind": body["kind"],

"name": body["metadata"]["name"],

"uid": body["metadata"]["uid"],

"controller": True,

"blockOwnerDeletion": True

}

]

},

"spec": {

"selector": {

"app": name

},

"ports": [

{"port": 80, "targetPort": "http", "name": "http"}

],

"type": "ClusterIP"

}

}

这个简化的Operator实现展示了如何管理AIAgent资源的生命周期。在实际项目中,我们还需要添加更多功能,如错误处理、更复杂的资源管理和与其他系统的集成等。

服务网格集成

服务网格在AI代理系统中起着关键作用,它可以解决多代理通信中的复杂性。我们可以使用Istio作为服务网格实现,为AI代理系统提供以下功能:

- 服务发现与负载均衡:自动发现AI代理服务并在实例之间分配流量。

- 流量管理:实现A/B测试、金丝雀发布和蓝绿部署等高级部署策略。

- 可观测性:提供分布式追踪、指标收集和日志聚合功能。

- 安全性:实现服务间的mTLS加密通信和细粒度的访问控制。

以下是一个Istio VirtualService配置示例,用于控制AI代理服务的流量:

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

metadata:

name: ai-agent-router

namespace: ai-system

spec:

hosts:

- ai-agents.example.com

gateways:

- ai-gateway

http:

- match:

- headers:

user-type:

exact: premium

route:

- destination:

host: premium-agent-service

port:

number: 80

weight: 100

- match:

- uri:

prefix: /v2/

route:

- destination:

host: agent-v2-service

port:

number: 80

weight: 90

- destination:

host: agent-v2-canary-service

port:

number: 80

weight: 10

- route:

- destination:

host: standard-agent-service

port:

number: 80

weight: 100

timeout: 5s

retries:

attempts: 3

perTryTimeout: 2s

这个配置展示了如何根据不同的条件(如用户类型、API版本)将流量路由到不同的AI代理服务,以及如何配置超时和重试策略。

资源调度与容错机制

AI代理系统通常对资源有特殊需求,如GPU加速和大量内存。我们需要设计专门的资源调度和容错机制:

- GPU调度:使用NVIDIA GPU Operator或AMD GPU Operator来管理GPU资源,并使用Kubernetes的节点亲和性和污点容忍度来调度需要GPU的代理。

apiVersion: ai.example.com/v1

kind: AIAgent

metadata:

name: gpu-intensive-agent

spec:

model: complex-model:v1

replicas: 2

resources:

cpu: "2"

memory: "8Gi"

gpu: "1"

nodeSelector:

hardware-type: gpu

tolerations:

- key: "nvidia.com/gpu"

operator: "Exists"

effect: "NoSchedule"

- 弹性伸缩:使用Kubernetes Horizontal Pod Autoscaler(HPA)或自定义控制器根据代理负载自动调整副本数量。

apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

metadata:

name: ai-agent-hpa

spec:

scaleTargetRef:

apiVersion: ai.example.com/v1

kind: AIAgent

name: my-ai-agent

minReplicas: 2

maxReplicas: 10

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 70

- type: Resource

resource:

name: memory

target:

type: Utilization

averageUtilization: 80

- type: Pods

pods:

metric:

name: agent_queue_length

target:

type: AverageValue

averageValue: 100

- 容错与自我修复:利用Kubernetes的自我修复功能,结合健康检查和优雅关闭机制,确保代理系统的高可用性。

from flask import Flask, jsonify

import signal

import sys

import time

app = Flask(__name__)

# 健康状态

is_ready = False

is_alive = True

@app.route('/health/live')

def health_live():

if is_alive:

return jsonify({"status": "healthy"}), 200

else:

return jsonify({"status": "unhealthy"}), 503

@app.route('/health/ready')

def health_ready():

if is_ready:

return jsonify({"status": "ready"}), 200

else:

return jsonify({"status": "not ready"}), 503

def initialize_agent():

"""初始化AI代理,加载模型等"""

global is_ready

# 模拟模型加载过程

print("Loading AI model...")

time.sleep(15) # 模拟较长的初始化时间

print("AI model loaded successfully")

is_ready = True

def graceful_shutdown(signum, frame):

"""处理优雅关闭信号"""

global is_alive, is_ready

print("Received shutdown signal, starting graceful shutdown...")

# 首先停止接收新请求

is_ready = False

# 处理完当前请求,保存状态等

print("Saving agent state...")

time.sleep(5) # 模拟状态保存过程

# 标记为不再存活

is_alive = False

print("Graceful shutdown completed")

sys.exit(0)

if __name__ == '__main__':

# 注册信号处理器

signal.signal(signal.SIGTERM, graceful_shutdown)

signal.signal(signal.SIGINT, graceful_shutdown)

# 在后台初始化代理

import threading

init_thread = threading.Thread(target=initialize_agent)

init_thread.daemon = True

init_thread.start()

# 启动Flask服务器

app.run(host='0.0.0.0', port=8080)

这个示例展示了如何在AI代理中实现健康检查和优雅关闭机制,确保代理能够在Kubernetes环境中可靠运行。

实际案例应用

为了更好地理解如何应用基于云原生的AI Agent Harness Engineering架构,让我们来看一个实际的案例:智能客服系统。

项目介绍

智能客服系统是一个多代理系统,由多个专门的AI代理组成,协同工作以提供高质量的客户服务。系统包括以下类型的代理:

- 路由代理:负责接收客户查询并将其路由到合适的专业代理

- 文本处理代理:处理文本查询,理解客户意图

- 知识库代理:从知识库中检索相关信息

- 情感分析代理:分析客户情绪,调整响应策略

- 对话管理代理:管理多轮对话,保持上下文连贯性

- 反馈收集代理:收集客户反馈,用于系统改进

环境安装

首先,我们需要设置一个Kubernetes集群并安装必要的组件。以下是环境安装的大致步骤:

-

设置Kubernetes集群:可以使用云服务提供商的Kubernetes服务(如EKS、GKE、AKS)或本地集群(如Minikube、Kind)。

-

安装Istio:

# 下载Istio

curl -L https://istio.io/downloadIstio | sh -

cd istio-*

export PATH=$PWD/bin:$PATH

# 安装Istio

istioctl install --set profile=demo -y

# 为default命名空间启用自动注入

kubectl label namespace default istio-injection=enabled

- 安装监控和日志组件:

# 安装Prometheus和Grafana

kubectl apply -f samples/addons/prometheus.yaml

kubectl apply -f samples/addons/grafana.yaml

# 安装Jaeger用于分布式追踪

kubectl apply -f samples/addons/jaeger.yaml

# 安装Kiali用于服务网格可视化

kubectl apply -f samples/addons/kiali.yaml

- 安装自定义资源定义和Operator:

# 应用AIAgent CRD

kubectl apply -f aiagent-crd.yaml

# 部署AIAgent Operator

kubectl apply -f aiagent-operator.yaml

系统功能设计

智能客服系统的主要功能包括:

- 多渠道接入:支持网页、移动应用、社交媒体等多种渠道接入

- 智能路由:根据客户查询内容和历史记录,将查询路由到最合适的代理

- 多语言支持:支持多种语言的客户查询

- 上下文感知:理解对话上下文,提供连贯的回复

- 情感智能:识别客户情绪,提供适当的响应

- 人工转接:在必要时将对话转接给人工客服

- 数据分析:收集和分析客户交互数据,用于系统改进

系统架构设计

以下是智能客服系统的详细架构设计:

这个架构图展示了智能客服系统的各个组件及其交互关系。客户请求通过接入网关层进入系统,由代理协调层进行路由和协调,然后由专业代理层处理,最后利用数据与服务层的资源提供响应。

系统接口设计

系统中的各个组件通过REST API或gRPC进行通信。以下是一些关键接口的设计:

- 路由代理接口:

openapi: 3.0.0

info:

title: Router Agent API

version: 1.0.0

paths:

/api/v1/route:

post:

summary: 路由客户查询

requestBody:

required: true

content:

application/json:

schema:

type: object

properties:

query:

type: string

description: 客户查询文本

userId:

type: string

description: 用户ID

sessionId:

type: string

description: 会话ID

metadata:

type: object

description: 附加元数据

responses:

'200':

description: 成功路由

content:

application/json:

schema:

type: object

properties:

route:

type: string

description: 目标代理类型

confidence:

type: number

format: float

description: 路由置信度

suggestedAgents:

type: array

items:

type: string

description: 建议的代理列表

- 文本处理代理接口:

openapi: 3.0.0

info:

title: NLP Agent API

version: 1.0.0

paths:

/api/v1/analyze:

post:

summary: 分析文本查询

requestBody:

required: true

content:

application/json:

schema:

type: object

properties:

text:

type: string

description: 待分析的文本

language:

type: string

description: 语言代码

context:

type: object

description: 对话上下文

responses:

'200':

description: 分析结果

content:

application/json:

schema:

type: object

properties:

intent:

type: string

description: 识别的意图

entities:

type: array

items:

type: object

properties:

entity:

type: string

value:

type: string

description: 提取的实体

confidence:

type: number

format: float

description: 意图识别置信度

系统核心实现源代码

以下是智能客服系统中几个核心组件的简化实现:

- 路由代理实现:

from flask import Flask, request, jsonify

import os

import requests

import json

app = Flask(__name__)

# 其他代理的地址

NLP_AGENT_URL = os.environ.get("NLP_AGENT_URL", "http://nlp-agent:8080")

KB_AGENT_URL = os.environ.get("KB_AGENT_URL", "http://kb-agent:8080")

SENTIMENT_AGENT_URL = os.environ.get("SENTIMENT_AGENT_URL", "http://sentiment-agent:8080")

DIALOG_AGENT_URL = os.environ.get("DIALOG_AGENT_URL", "http://dialog-agent:8080")

# 意图到代理的映射

INTENT_TO_AGENT = {

"information_request": "kb",

"complaint": "sentiment",

"technical_support": "dialog",

"feedback": "feedback",

"greeting": "dialog",

"farewell": "dialog"

}

@app.route('/api/v1/route', methods=['POST'])

def route_query():

try:

data = request.json

query = data.get('query')

user_id = data.get('userId')

session_id = data.get('sessionId')

metadata = data.get('metadata', {})

if not query:

return jsonify({"error": "Query is required"}), 400

# 首先调用NLP代理分析意图

nlp_response = requests.post(

f"{NLP_AGENT_URL}/api/v1/analyze",

json={

"text": query,

"language": metadata.get("language", "en"),

"context": {"sessionId": session_id, "userId": user_id}

},

timeout=5

)

if nlp_response.status_code != 200:

return jsonify({"error": "Failed to analyze query"}), 500

nlp_result = nlp_response.json()

intent = nlp_result.get("intent", "unknown")

confidence = nlp_result.get("confidence", 0.0)

# 确定目标代理

target_agent = INTENT_TO_AGENT.get(intent, "dialog")

# 构建响应

response = {

"route": target_agent,

"confidence": confidence,

"nlpAnalysis": nlp_result,

"suggestedAgents": get_suggested_agents(intent, confidence),

"metadata": {

"originalQuery": query,

"userId": user_id,

"sessionId": session_id,

"routedAt": request.headers.get("Date")

}

}

return jsonify(response)

except requests.exceptions.Timeout:

return jsonify({"error": "Request to NLP agent timed out"}), 504

except Exception as e:

app.logger.error(f"Error routing query: {str(e)}")

return jsonify({"error": "Internal server error"}), 500

def get_suggested_agents(intent, confidence):

"""根据意图和置信度获取建议的代理列表"""

suggestions = []

# 主要建议

primary_agent = INTENT_TO_AGENT.get(intent, "dialog")

suggestions.append(primary_agent)

# 如果置信度低,添加更多建议

if confidence < 0.7:

if primary_agent != "dialog":

suggestions.append("dialog")

if primary_agent != "kb" and intent in ["information_request", "technical_support"]:

suggestions.append("kb")

return suggestions

@app.route('/health/live', methods=['GET'])

def health_live():

return jsonify({"status": "alive"}), 200

@app.route('/health/ready', methods=['GET'])

def health_ready():

# 检查依赖服务是否可用

try:

requests.get(f"{NLP_AGENT_URL}/health/ready", timeout=2)

return jsonify({"status": "ready"}), 200

except:

return jsonify({"status": "not ready"}), 503

if __name__ == '__main__':

app.run(host='0.0.0.0', port=8080)

- AIAgent自定义资源示例:

apiVersion: ai.example.com/v1

kind: AIAgent

metadata:

name: router-agent

namespace: customer-service

spec:

model: router-model:v1.2.0

replicas: 3

resources:

cpu: "500m"

memory: "512Mi"

env

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献107条内容

已为社区贡献107条内容

所有评论(0)