通过逆动力学奖励将视频世界模型与可执行机器人动作对齐

26年3月来自港中文(广州)和深圳跨维智能(DexForce)公司的论文“Aligning Video World Models with Executable Robot Actions via Inverse Dynamics Rewards”。

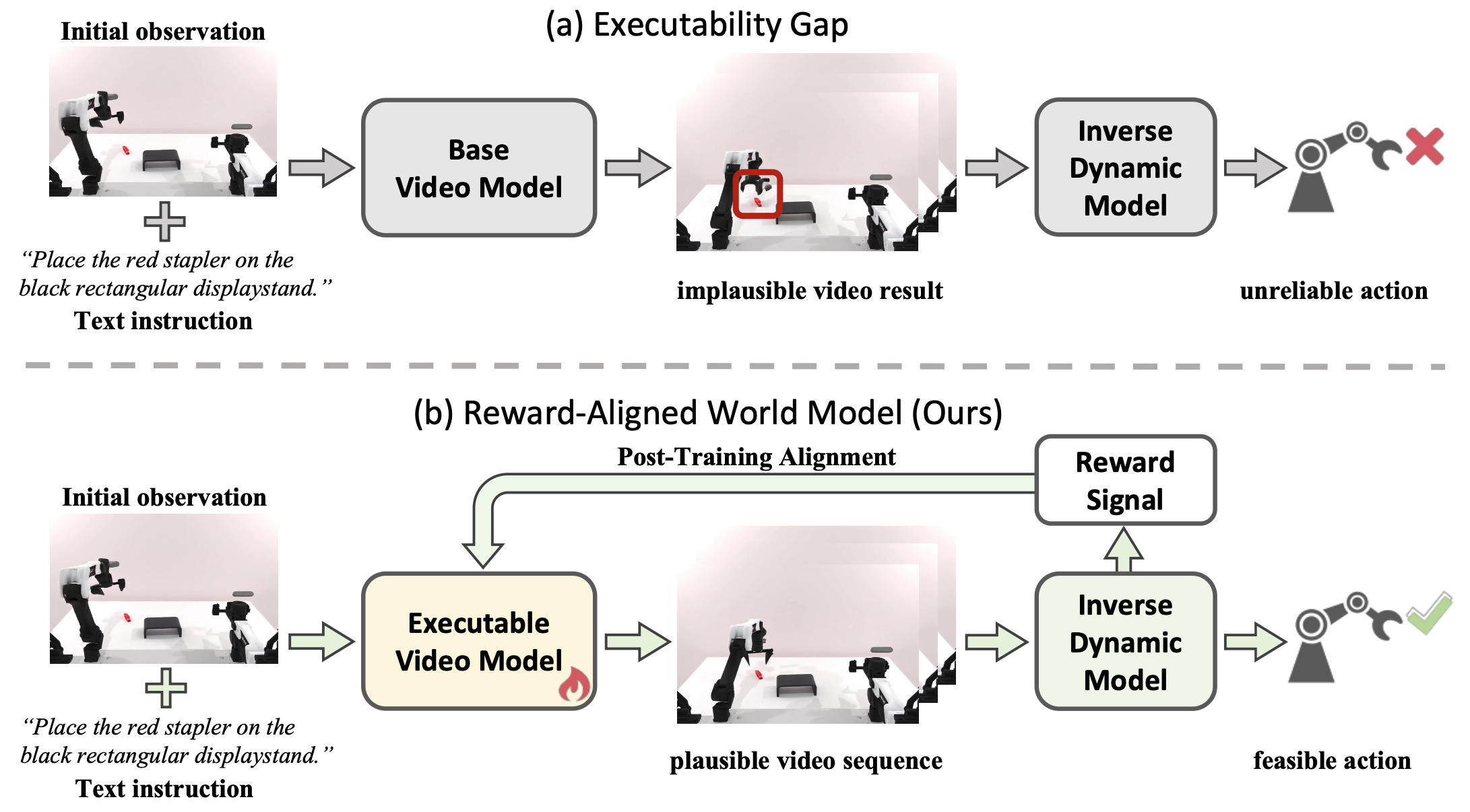

视频生成模型越来越多地被用作机器人世界模型。在视频生成模型中,模型根据当前观测结果和任务指令生成未来的视觉展开,而逆动力学模型(IDM)则将生成的帧转换为可执行的机器人动作。然而,当前的视频世界模型缺乏明确的可执行性约束。因此,视觉上连贯的展开仍然可能违反刚体和运动学一致性,导致IDM解码后产生不稳定或不可行控制指令。这种视觉生成与物理可执行控制之间的这种不匹配,称为可执行性差距。虽然可以使用诸如拒绝采样等技术在推理阶段缓解这种差距,但由于视频生成的成本很高,这些方法效率低下。本文利用可执行性差距作为训练信号,提出可执行视频对齐(EVA)——一种用于对齐视频世界模型的强化学习后训练框架。 EVA 基于真实机器人轨迹训练逆动力学模型,并将其重新用作奖励模型。该模型通过视频中诱发的动作序列来评估生成的视频,鼓励以速度、加速度和加加速度衡量的平滑运动,同时惩罚违反具身约束的动作。重要的是,即使生成的视频包含严重的视觉瑕疵,该奖励仍然有效,因为这些瑕疵通常会导致不稳定或超出边界的动作。在 RoboTwin 基准测试和真实双臂机器人上的实验表明,EVA 可以减少生成的滚动轨迹中与具身相关的瑕疵,并提高后续任务的执行成功率。

开发能够执行各种操作任务的通用机器人策略仍然是具身人工智能的核心目标。视觉-语言-动作(VLA)模型[4,5,24,31]通过将二维视觉观察和语言指令直接映射到底层运动命令,取得显著进展。然而,当物理和时间动态主要需要从有限的机器人交互数据中学习时,扩展鲁棒的长时域行为仍然具有挑战性[43]。与此同时,最近的研究探索视频生成模型作为机器人世界模型[3,10,23,33,47]。与静态图像-文本对不同,视频提供关于状态转换和物体交互的丰富的时空线索。这种能力催生一种新兴的解耦范式:视频世界模型首先作为视觉规划器,根据当前观察和语言指令生成未来的视觉轨迹;随后,逆动力学模型(IDM)从生成的帧中提取相应的可执行动作[2,15,37]。通过将高层时空推理与底层控制分离,这种方法为基于互联网规模视频数据的可扩展机器人学习提供了一条极具前景的途径。

尽管前景广阔,但这种解耦流程存在一个关键且尚未充分探索的局限性:缺乏明确的可执行性约束。将可执行性定义为生成的视频轨迹,在多大程度上可以转化为能够完成预期任务并满足机器人物理和运动学约束的运动指令。即使基础视频生成模型[6,42]能够在帧级别生成视觉上连贯的展开轨迹,机器人轨迹仍然可能是不可行的,因为它违反刚体和运动学的一致性,例如手臂变形、自相交或突发的时序不连续。在执行这些提取的动作序列时,以开环方式运行的IDM可能会将这些伪影映射到不可行的控制信号,从而导致关节突变、高频抖动或越界指令。更有趣的是,即使生成的视频包含严重的视觉伪影,解码后的动作通常也会出现明显的违规行为,例如关节突变或越界指令。这种视觉生成与物理可执行控制之间的不匹配,称之为可执行性差距,虽然可以在推理阶段通过诸如拒绝采样之类的技术来弥合,但考虑到视频生成的高昂成本,这些技术效率远不高。

受强化学习(RL)在基础模型对齐方面近期取得的成功[7,44,45]的启发,本文提出使用旨在惩罚可执行性差距的奖励来显式地微调视频生成模型。此框架称为可执行视频对齐(EVA)。具体来说,基于真实机器人数据训练一个逆动力学模型,该模型能够预测生成视频中机器人执行的动作。鉴于已知的机器人形态、任务性质以及合理机器人轨迹的隐含属性,构建一个基于逆动力学模型的奖励模型,该模型能够自然地在整个视频序列中提供密集的奖励:它(1)鼓励轨迹的平滑性(通过速度、加速度和加加速度来衡量),以及(2)惩罚超出机器人形态的、不合理的动作。因此,可以应用标准的强化学习算法,将视频分布与来自域知识、真实机器人数据以及训练好的逆动力学模型隐式正则化的先验信息进行对齐。

可执行视频世界建模概述如图所示。(a) 标准视频世界模型生成的展开轨迹存在运动学伪影,导致IDM预测的动作不可靠,这体现可执行性差距。(b) 本文提出的基于奖励对齐世界模型利用IDM衍生的奖励优化视频生成,生成物理上合理的展开轨迹,从而实现可行的机器人动作。

基于流匹配的视频生成

近期的大规模视频生成模型(例如 Wan-2.1)采用流匹配方法对潜空间中的视频分布进行建模。给定像素空间中的视频序列 V = {I_1,…,I_T},预训练的 3D 变分自编码器 (VAE) 将该序列编码为紧凑的潜表示 x_1 ∈ V。为了提高效率,生成建模随后在该潜空间中进行。

令 x_1 表示潜视频样本,x_0 ∼ N (0, I) 表示高斯噪声。流匹配通过线性插值 x_t = (1 − t)x_0 + tx_1(其中 t ∈ [0, 1])构建噪声和数据之间的连续概率路径。训练一个神经速度场 v_θ 来近似传输向量 x_1 − x_0。

在推理过程中,求解由 v_θ 定义的 ODE 将噪声 x_0 传递到潜视频样本 x_1,随后由 VAE 进行解码。

群体相对策略优化

群体相对策略优化 (GRPO) [36] 是一种策略梯度方法,它无需学习价值函数即可从一组采样轨迹中估计优势。将 GRPO 应用于流模型并非易事,因为标准的流匹配采样遵循确定性常微分方程:ẋ = v_θ (x, t),而该方程并未定义随机策略。Flow-GRPO [27] 通过构建一个边缘分布与原始流边缘分布相匹配的随机过程来解决这个问题。这产生了一个随机微分方程:dx = f_θ(x,t)dt + g(t)dw,其中漂移项 f_θ 由流速 v_θ 导出,扩散项 g(t) 引入随机性,定义轨迹分布 π_θ(τ|c)。

在训练过程中,GRPO 从该随机过程中采样 G 条轨迹 {τ_i},并使用奖励 {R_i} 对其进行评估。群体相对优势为 Aˆ_i = (R_i − μ_R)/(σ_R + ε),其中 μ_R 和 σ_R 分别表示群体奖励的均值和标准差。然后使用截断目标函数优化漂移网络 f_θ (x, t)。

经过微调后,按照原始流程公式,使用更新后的网络进行采样。

可执行视频对齐(EVA)框架,旨在通过明确的可执行性目标来改进预训练的视频生成模型。其核心思想是基于逆动力学模型(IDM)构建奖励模型:生成的视频会根据其隐动作序列是否流畅以及是否符合机器人的运动学限制进行评分。然后,该奖励用于微调视频生成器,使其展开分布与物理上合理的机器人运动保持一致。

逆动力学模型

IDM 从视觉观测的短时间窗口推断机器人控制指令。给定以时间 t 为中心的帧 I_t−k:t+k,IDM 预测该时刻执行的动作。用监督回归在机器人轨迹数据上训练 IDM。

在架构上,IDM遵循标准的视觉运动设计[25]:卷积主干提取空间特征,空间softmax层将每个通道转换为二维坐标,多层感知器(MLP)将这些坐标映射到动作。令F表示在通道维度上堆叠时间帧后的特征图。

将坐标 {(x_c,y_c)} 连接起来,并输入到多层感知器 (MLP) 中进行预测。在设置中,这种类似关键点的表示方法在解码生成的展开动作时比全局池化更稳定。

基于IDM的可执行性奖励

预训练的视频生成器针对视觉真实性进行优化,但并未受到机器人运动学的约束。因此,视觉上合理的展开动作可能仍然对应于不稳定或不可行的机器人运动(例如,突发的时间跳跃或模糊的关节运动),这在将展开动作转换为控制指令时会变得明显。因此,直接在动作空间中定义可执行性:如果展开动作的IDM解码动作序列平滑且满足具身性限制,则该展开动作是可执行的。

给定一个生成的视频V,冻结的IDM预测控制间隔∆t内的关节指令序列A = {a_t}。通过有限差分法计算关节空间速度v_t、加速度a_t 和抖动 j_t。为了惩罚不平滑的运动,对加速度和抖动应用鲁棒的Huber惩罚,即

P_α = E_t[Huber(α_t; δ_α)],

P_j = E_t[Huber(j_t; δ_j)]

进一步通过惩罚违反机器人速度和加速度限制的行为来加强对机器人外形尺寸的限制:

P_vel = E_t ||max(|v_t| − v_max, 0)||2_2 ,

P_acc = E_t ||max(|α_t| − a_max, 0)||2_2

总惩罚为:

P(A) = λ_j P_j + λ_α P_α + λ_v-lim P_vel + λ_a-lim P_acc.

将惩罚映射到有界奖励,用于微调视频模型。该奖励直接鼓励生成视频,使其隐含的机器人运动平滑且在物理上可行。

基础模型。视频世界模型是一个基于扩散transformer (DiT) [34] 的潜视频扩散模型。用 Wan2.1-14B 骨干网 [42] 实例化该模型,并结合扩散强制 [9] 来改进基于观测历史的展开生成。从基于大规模操作数据预训练的大型视频规划器 (LVP) 检查点 [10] 初始化模型,然后在特定的具身数据集上进行监督微调 (SFT),得到模型(不进行强化学习)。然后,应用 GRPO 后训练,并结合基于 IDM 的可执行性奖励,得到模型。IDM 的训练方式不变,并在 GRPO 微调期间保持冻结状态。

基线。为了评估展开质量,将其与 Vidar [17] 进行比较,Vidar [17] 从 Wan2.2-5B 检查点 [42] 初始化,并在相同的协议和数据下进行微调。对于仿真策略执行,将其与强模仿学习和 VLA 基线算法进行比较,包括:ACT [48]、扩散策略 (DP) [12]、RDT [29] 和 π0 [4]。对于真实机器人评估,还纳入 GE-Act [26]。

实现细节。在 GRPO 微调过程中,对每个提示采样 G = 8 个 展开。用 rank 为 32 的 LoRA 更新视频生成器。所有实验均在 8 个 NVIDIA A800 GPU 上进行,总批大小为 32。

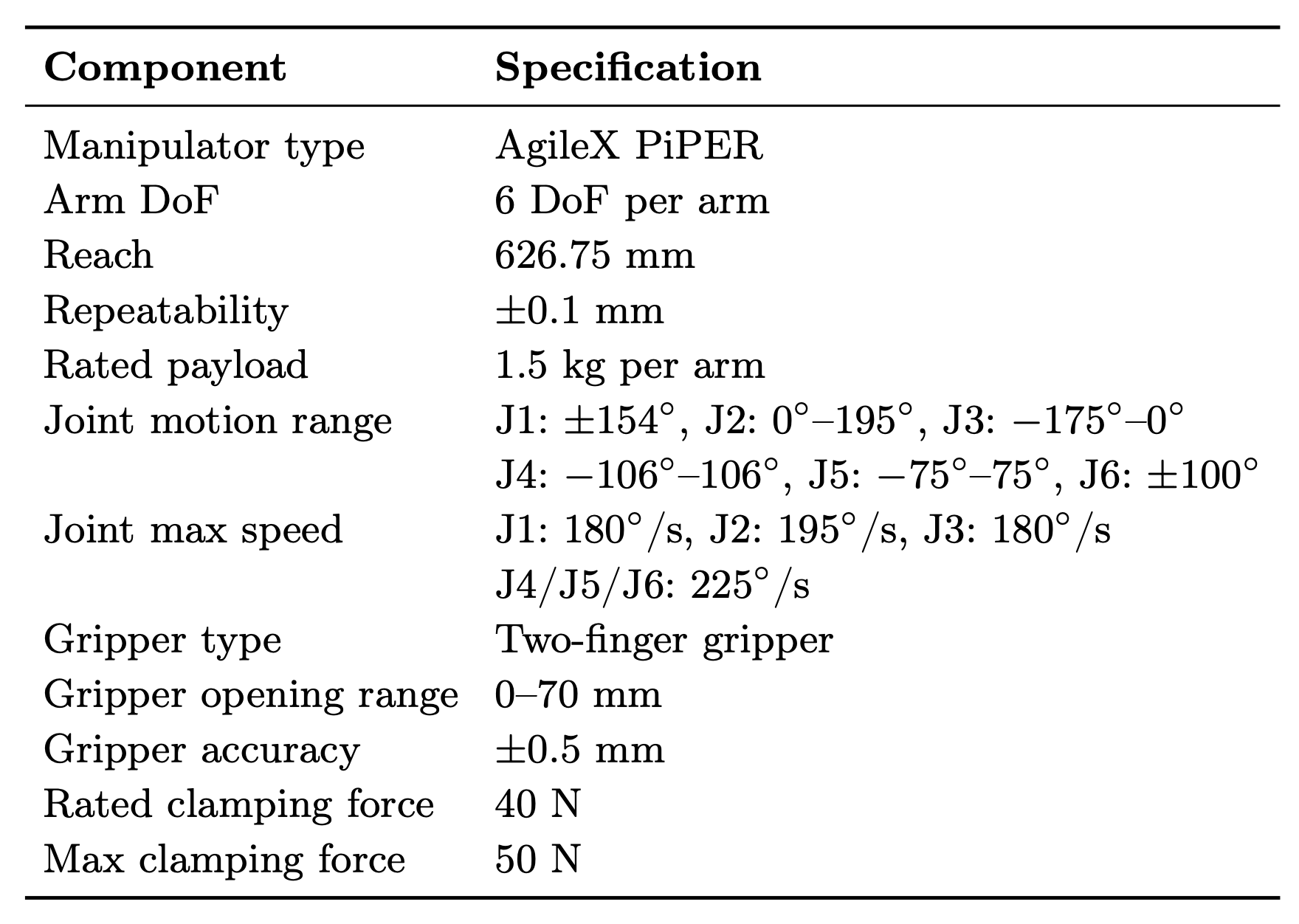

机器人平台搭建。实际实验是在 AgileX Cobot Magic 平台上进行的,如图和表所示。采用其双臂桌面配置,根据任务要求,每个任务可能涉及单臂或双臂操作。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献106条内容

已为社区贡献106条内容

所有评论(0)