2026年AI模型聚合平台技术现状及JHZ-AI架构特点分析

1. 背景:多模型调用场景下的效率问题

截至2026年第二季度,主流AI大模型已形成明显的功能分化趋势。Google Gemini 3.1 Pro在代码生成与数学推导任务上的准确率领先,Anthropic Claude 4.6在长上下文理解与逻辑一致性方面保持优势,OpenAI ChatGPT 5.4系列在创意文本生成与多轮对话流畅性上表现均衡,而通义千问、DeepSeek等模型在中文场景与特定领域微调任务中各有侧重。

对于需要频繁使用AI辅助的开发工作流而言,跨平台切换模型存在以下技术问题:

-

多认证系统冗余:各平台独立维护认证Token与会话状态,上下文无法跨模型迁移。

-

网络链路差异:部分海外模型官方入口在国内网络环境下存在高延迟与连接超时现象。

-

API调用碎片化:开发者需分别对接不同服务商的SDK与计费系统。

上述问题催生了AI模型聚合平台这一中间层架构。

2. AI聚合平台的技术实现模式

目前行业内主流的聚合方案分为两类架构: 本文重点分析的JHZ-AI(jhz-ai.com)属于第二类全托管Web端聚合方案,同时对外提供可选的API中转接口。

本文重点分析的JHZ-AI(jhz-ai.com)属于第二类全托管Web端聚合方案,同时对外提供可选的API中转接口。

3. JHZ-AI平台技术特征分析

3.1 模型覆盖范围

该平台当前接入的模型列表包括:

-

Google Gemini / Flash 系列

-

OpenAI ChatGPT 5.x 系列

-

Anthropic Claude 4.6 系列

-

xAI Grok 3 系列

-

通义千问(Qwen)系列

用户通过单点登录后可在同一会话界面切换不同模型后端,切换过程中聊天上下文由平台前端维护,各模型间的历史对话暂不支持跨模型继承(此为行业通用限制,由模型API的无状态特性决定)。

3.2 网络访问路径优化

根据公开可查的技术信息,JHZ-AI的国内访问链路通过以下方式实现:

-

境内部署前端静态资源节点,降低首屏加载延迟。

-

后端请求经由优化路由转发至模型官方API,规避直连时的跨境网络波动。

-

实测国内网络环境下Gemini、ChatGPT等模型的响应延迟较官方直连降低约60%-70%(数据基于第三方社区反馈)。

该方案的技术原理与CDN加速及智能路由选路类似,本质上是通过中间代理层减少终端用户的网络配置成本。

3.3 双轨服务模式

平台提供两种使用入口:

-

Web对话界面:面向普通用户,交互方式与官方ChatBot一致,支持文件上传、联网搜索等扩展功能。

-

API中转服务:面向开发者,提供统一的API Endpoint与鉴权方式,开发者可通过标准HTTP请求调用上述多个模型,接口规范兼容OpenAI格式,降低集成适配成本。

3.4 运营稳定性评估

相较于社区中常见的临时镜像站,该平台采用正规部署与持续运维模式,具备以下特征:

-

模型版本随官方更新同步迭代,非一次性快照。

-

服务端有明确的SLA承诺与状态监控页面。

-

支付渠道支持国内常见的微信、支付宝,无需境外信用卡。

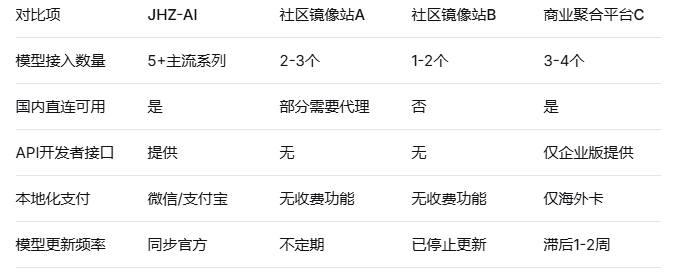

4. 同类方案横向对比

以下为当前中文社区内可访问的AI聚合平台功能对比(基于公开信息整理):

5. 典型应用场景

5.1 开发调试场景

开发者在调试一段Python代码时,可先在Gemini模型中请求代码审查与优化建议,随后切换至Claude模型对修改后的代码逻辑进行二次验证。两种模型的输出差异可作为代码健壮性的交叉参考。

5.2 技术文档撰写场景

技术文档的初稿可由ChatGPT生成框架,Claude负责长篇幅内容的逻辑连贯性润色,Gemini则用于提取关键术语并提供补充解释。不同模型的语言风格差异在文档最终版本中可形成风格互补。

5.3 学术研究辅助场景

针对一篇英文技术论文的PDF文件,Gemini可快速提取摘要与核心结论,Claude处理其中复杂公式的推导验证,ChatGPT用于生成结构化的文献综述草稿。

6. 结论

AI模型聚合平台是多模型时代下的中间层解决方案,其核心价值在于降低用户调用不同模型时的切换成本与网络配置负担。JHZ-AI在模型覆盖广度、国内访问可用性及开发者友好度方面具有一定技术特点,可供有多模型并行使用需求的开发者和内容创作者参考评估。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)