收藏级|大模型应用开发入门指南(小白&程序员必看)

本文专为小白程序员和刚接触大模型的开发者打造,全面拆解大模型应用开发的核心逻辑、必备技能、实战项目,结合LangChain、OpenAI等主流工具,补充实用技巧和避坑指南,助力快速入门并落地项目,同时附上职业发展和求职干货,建议收藏备用!

一、什么是大模型应用开发?(小白必懂)

1.1 定义与定位

大模型应用开发:核心是将大语言模型(LLM)的能力与实际业务场景结合,通过API调用、框架整合等方式,开发出可落地的应用程序,解决真实业务问题,无需从零训练模型,门槛更低、落地更快。

核心职责:

- 设计贴合业务的LLM应用架构,确保稳定性和可扩展性

- 优化模型调用策略,平衡效果、速度和成本

- 处理模型输出的不确定性(如幻觉、格式错乱),保障输出质量

- 集成企业现有系统(如数据库、API接口),实现端到端落地

与算法开发的核心区别:很多小白会混淆两者,一张表讲清差异,避免走弯路:

| 维度 | 大模型应用开发 | 算法开发 |

|---|---|---|

| 核心任务 | 调用现成API/框架,解决业务问题 | 训练、优化模型本身,提升模型性能 |

| 技术重点 | 工程架构、Prompt设计、工具整合 | 数学原理、算法优化、数据处理 |

| 工具使用 | LangChain、OpenAI API、向量数据库等 | PyTorch、TensorFlow、训练集群 |

| 入门门槛 | 较低(有Python基础即可上手) | 较高(需扎实的数学和算法基础) |

| 薪资范围 | 20-60K(需求量大,入门薪资友好) | 25-50K(需求量相对较少,对学历/能力要求高) |

| 市场需求 | 互联网、企业服务等多行业急需,缺口大 | 集中在AI实验室、大厂算法团队 |

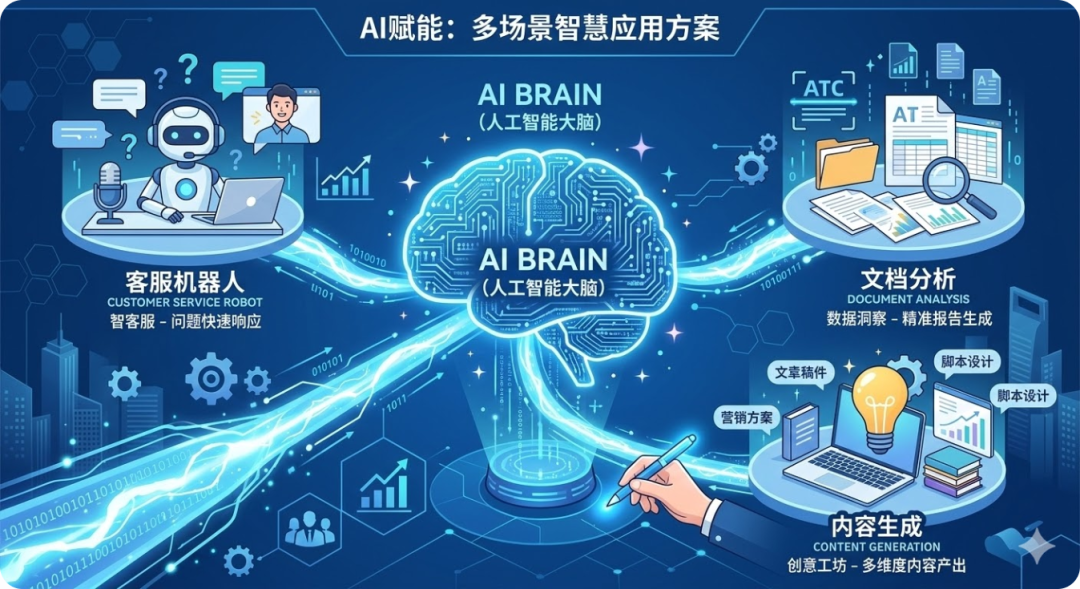

1.2 典型应用场景(附真实落地案例)

大模型应用早已渗透各行各业,以下是最常见、最易落地的5个场景,小白可优先从这些场景入手练手:

1. 内容生成(最易上手)

- 自媒体文章、营销文案、产品说明自动生成

- 代码生成(如Python脚本、前端组件)、技术文档编写

- 创意内容(短视频脚本、海报文案、诗歌故事)

✅ 小白练手:用OpenAI API+简单Prompt,实现"输入主题自动生成300字短文"。

2. 智能客服(企业刚需)

- 7x24小时自动问答,解决用户常见问题(FAQ)

- 用户投诉自动分类、情感分析,优先处理负面反馈

- 工单自动创建、分配,提升客服效率

3. 知识管理(企业/个人必备)

- 企业知识库智能问答(如员工查询规章制度、产品手册)

- 长文档(PDF、Word)快速检索、总结,提取关键信息

- 个人笔记智能整理、分类,实现高效检索

4. 数据分析(辅助决策)

- 文本分类、标注(如用户评论分类、舆情关键词提取)

- 舆情分析(监控行业动态、用户反馈,生成分析报告)

- Excel数据自动处理、可视化报告生成

5. 办公自动化(提升效率)

- 邮件自动起草、回复,会议纪要实时生成

- 任务管理(自动分配任务、提醒进度)

- 跨平台数据同步(如Notion、Excel、CRM系统)

1.3 技术架构(小白能看懂的流程图)

大模型应用的核心架构并不复杂,无需高深的技术功底,记住以下5层架构,就能搭建基础应用,结合LangChain框架可快速落地:

用户界面(Web/Mobile/API)

↓

应用层(业务逻辑:处理用户请求、调用工具)

↓

┌─────────────────────────────┐

│ 大模型服务层 │

│ - Prompt模板管理(统一格式) │

│ - 上下文管理(记忆对话历史) │

│ - 输出验证和过滤(避免幻觉) │

└─────────────────────────────┘

↓

┌─────────────────────────────┐

│ LLM调用层 │

│ - 主流API(OpenAI/Claude/文心一言)│

│ - 重试和错误处理(避免调用失败)│

│ - 成本优化(选择合适模型) │

└─────────────────────────────┘

↓

┌─────────────────────────────┐

│ 数据层 │

│ - 向量数据库(RAG知识库) │

│ - 业务数据库(用户/业务数据) │

│ - 缓存层(提升响应速度) │

└─────────────────────────────┘

💡 关键提示:小白无需自己搭建所有层,可借助LangChain(轻量易上手的大模型应用框架)快速整合各层能力,10行代码即可实现基础应用。

二、核心技能要求(必学,附学习重点)

大模型应用开发无需精通所有技术,重点掌握以下7个技能,就能胜任大部分岗位,小白可按"必备→进阶"的顺序学习,循序渐进:

2.1 必备技能(0基础小白优先学)

技能1:Python编程(核心基础)

为什么重要:AI生态的主流语言,几乎所有LLM SDK(如OpenAI、LangChain)都优先支持Python,且语法简洁,小白易上手。

学习重点(不用精通,掌握这些就够):

- 异步编程(asyncio):处理并发API请求,提升应用响应速度

- 类型提示(type hints):让代码更规范,便于维护和协作

- 请求处理(FastAPI/Flask):搭建简单的API服务,实现前端交互

- 数据处理(pandas、numpy):处理LLM的输入输出数据,如文本清洗、格式转换

✅ 小白练习:用Python编写一个简单的"调用OpenAI API回复消息"的脚本。

技能2:大模型API调用(核心能力)

无需自己训练模型,调用现成的API就能实现大模型能力,这是小白入门的最快路径,重点掌握主流API的使用方法和对比:

| API提供商 | 主流模型 | 核心优势 | 劣势 | 价格 | 小白推荐度 |

|---|---|---|---|---|---|

| OpenAI | GPT-4o、GPT-3.5-turbo | 综合能力强、生态完善,支持多模态,适配LangChain | 需科学上网,价格相对较高 | 较贵(GPT-4o:0.005美元/1K输入tokens) | ★★★★★(学习首选) |

| Anthropic | Claude 3.5 Sonnet | 长文本处理能力强,上下文窗口大 | 需科学上网,国内适配性一般 | 中等(性价比高于GPT-4o) | ★★★★☆(处理长文档首选) |

| 百度千帆 | 文心一言4.0 | 中文处理能力强,无需翻墙,国内部署方便 | 多模态能力略逊于OpenAI | 便宜(适合国内企业落地) | ★★★★☆(国内小白首选) |

| 阿里云 | 通义千问3.0 | 多模态支持好,对接阿里云生态方便 | API响应速度略慢 | 便宜 | ★★★☆☆(阿里云用户优先) |

| DeepSeek | DeepSeek-V3 | 性价比极高,支持本地部署,适合练手 | 生态较新,部分功能不完善 | 最便宜(适合小白练手) | ★★★★☆(练手首选) |

API调用实战代码(带重试机制,避免调用失败,小白可直接复制使用):

import asyncio

from openai import AsyncOpenAI

from tenacity import retry, stop_after_attempt, wait_exponential

class LLMClient:

def __init__(self, api_key: str, base_url: str = None):

self.client = AsyncOpenAI(

api_key=api_key,

base_url=base_url # 国内用户可填写代理地址

)

@retry(

stop=stop_after_attempt(3), # 最多重试3次

wait=wait_exponential(multiplier=1, min=2, max=10) # 指数退避等待

)

async def chat(

self,

messages: list[dict],

model: str = "gpt-3.5-turbo",

temperature: float = 0.7,

max_tokens: int = 2000

) -> str:

"""调用大模型API,带重试机制,避免网络超时"""

try:

response = await self.client.chat.completions.create(

model=model,

messages=messages,

temperature=temperature,

max_tokens=max_tokens

)

return response.choices[0].message.content

except Exception as e:

print(f"API调用失败: {e}")

raise

# 使用示例(小白替换api_key即可使用)

async def main():

client = LLMClient(api_key="your-api-key")

result = await client.chat([

{"role": "user", "content": "用Python写一个简单的Hello World脚本"}

])

print(result)

asyncio.run(main())

技能3:Prompt工程(决定输出质量)

同样的API,不同的Prompt,输出效果天差地别,这是小白最容易忽略、也最容易提升的技能,记住3个黄金法则,直接套用:

1. 明确角色(让模型知道"该做什么")

# 差Prompt(模糊,输出质量不稳定)

"总结这篇文章"

# 好Prompt(明确角色+任务,输出更精准)

"""

你是一个专业的内容分析师,擅长从长篇文章中提取关键信息,语言简洁、逻辑清晰。

你的任务是:总结文章的核心观点、重要论据和最终结论,不添加多余内容,控制在200字以内。

"""

2. 提供示例(Few-Shot,小白必用)

如果模型输出不符合预期,给1-3个示例,让模型"照猫画虎",适合文本分类、格式转换等场景:

prompt_template = """

你是一个文本分类助手,负责将用户输入的产品评论分类为:正面、负面、中立。

示例1:文本:这个产品太棒了,续航超久,推荐购买! 分类:正面

示例2:文本:产品质量很差,用了一天就坏了,不推荐。 分类:负面

示例3:文本:产品功能一般,价格还行,凑合用。 分类:中立

现在请分类:

文本:{user_input}

分类:

"""

3. 约束输出格式(避免杂乱,便于后续处理)

让模型按固定格式输出(如JSON、列表),方便后续代码解析,适合数据分析、信息提取场景:

prompt_template = """

请分析以下文本的情感,并严格以JSON格式输出,不要添加任何多余内容:

要求格式:

{

"sentiment": "正面/负面/中立",

"confidence": 0.0-1.0, # 情感判断置信度

"keywords": ["关键词1", "关键词2"], # 提取核心关键词

"reason": "简要说明判断理由(不超过50字)"

}

文本:{text}

"""

技能4:RAG技术(大模型"外挂知识库",必备)

什么是RAG:检索增强生成(Retrieval-Augmented Generation),简单说就是给大模型挂一个"知识库",让模型能回答特定领域的问题(如企业规章制度、产品手册),避免幻觉,提升输出准确性。

比如:让模型回答"公司年假有多少天",如果没有知识库,模型可能会编造答案;有了RAG,模型会从你上传的公司制度文档中检索答案,精准且可控。

RAG系统实战代码(基于LangChain+Chroma,小白可直接运行,附详细注释):

from langchain.embeddings import OpenAIEmbeddings

from langchain.vectorstores import Chroma

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain.chains import RetrievalQA

from langchain.chat_models import ChatOpenAI

class RAGSystem:

def __init__(self, persist_directory: str = "./chroma_db"):

# 初始化嵌入模型(将文本转换为向量)

self.embeddings = OpenAIEmbeddings(api_key="your-api-key")

# 初始化向量数据库(存储文本向量,用于检索)

self.vectorstore = Chroma(

persist_directory=persist_directory, # 数据库存储路径

embedding_function=self.embeddings

)

# 初始化文本切分器(将长文档切分成小片段,便于检索)

self.text_splitter = RecursiveCharacterTextSplitter(

chunk_size=500, # 每个片段500字

chunk_overlap=50 # 片段重叠50字,避免信息丢失

)

def add_documents(self, documents: list[str]) -> None:

"""添加文档到知识库(如公司制度、产品手册)"""

# 切分文档

texts = self.text_splitter.create_documents(documents)

# 存入向量数据库

self.vectorstore.add_documents(texts)

self.vectorstore.persist() # 持久化,避免重启后丢失

def query(self, question: str, k: int = 3) -> str:

"""查询知识库并生成答案(k=3表示检索3个最相关的片段)"""

# 创建QA链(连接检索和生成)

qa_chain = RetrievalQA.from_chain_type(

llm=ChatOpenAI(model="gpt-3.5-turbo", temperature=0, api_key="your-api-key"),

chain_type="stuff", # 简单直接的生成方式,适合小白

retriever=self.vectorstore.as_retriever(search_kwargs={"k": k}),

return_source_documents=True # 返回答案来源,便于验证

)

# 执行查询

result = qa_chain({"query": question})

# 提取答案和来源

answer = result["result"]

sources = [doc.page_content[:100] + "..." for doc in result["source_documents"]]

return f"答案:{answer}\n\n来源:{sources}"

# 使用示例(小白替换文档内容即可)

if __name__ == "__main__":

rag = RAGSystem()

# 添加知识库文档(可替换为自己的文档内容)

rag.add_documents([

"公司年假规定:工作满1年享受5天年假,满3年享受10天年假,满5年享受15天年假。",

"请假流程:员工需提前3天提交书面请假申请,经部门负责人审批通过后方可休假。",

"加班政策:工作日加班按1.5倍工资计算,周末加班按2倍工资计算,法定节假日按3倍工资计算。"

])

# 查询问题

print(rag.query("工作满3年有多少天年假?"))

2.2 进阶技能(提升竞争力,月薪翻倍)

技能5:向量数据库(RAG的核心,必学)

向量数据库是RAG系统的核心,用于存储文本向量,实现快速检索,小白无需深入底层原理,掌握主流数据库的使用和对比即可:

| 数据库 | 核心优势 | 劣势 | 适用场景 | 小白推荐度 |

|---|---|---|---|---|

| ChromaDB | 轻量、易上手,无需复杂部署,支持LangChain无缝集成 | 性能一般,不适合大规模数据 | 小白练手、小型项目 | ★★★★★(首选) |

| Pinecone | 性能好、托管服务,无需自己部署,支持大规模数据 | 需付费,免费额度有限 | 生产环境、中大型项目 | ★★★★☆(进阶学习) |

| Milvus | 开源、功能全,支持多模态检索,性能强劲 | 部署复杂,学习曲线略陡 | 企业级应用、大规模知识库 | ★★★☆☆(有基础后学习) |

| Weaviate | 多模态支持好(文本、图片、音频),生态完善 | 学习曲线陡,配置复杂 | 图文检索、多模态项目 | ★★★☆☆(多模态方向学习) |

技能6:流式输出(提升用户体验,面试高频)

为什么需要流式输出:像ChatGPT一样,逐字显示答案,避免用户长时间等待,提升应用体验,是中高级岗位的必备技能。

流式输出实战代码(小白可直接复制使用):

from openai import OpenAI

import sys

def stream_chat(messages: list[dict]):

client = OpenAI(api_key="your-api-key")

# 启用流式输出(stream=True)

stream = client.chat.completions.create(

model="gpt-3.5-turbo",

messages=messages,

stream=True

)

print("AI:", end="", flush=True)

# 逐字输出结果

for chunk in stream:

if chunk.choices[0].delta.content:

content = chunk.choices[0].delta.content

print(content, end="", flush=True)

print() # 换行

# 使用示例

stream_chat([{"role": "user", "content": "讲一个程序员相关的笑话,简短幽默"}])

技能7:成本优化(企业刚需,提升竞争力)

大模型API调用成本较高,尤其是大规模应用,掌握成本优化技巧,能显著提升你的职场价值,核心策略如下(附实战代码):

class CostOptimizedLLM:

def __init__(self):

# 主流模型价格(每1K tokens,仅供参考)

self.models = {

"gpt-4o": 0.005, # 输入价格

"gpt-3.5-turbo": 0.0005,

"deepseek-chat": 0.0001

}

def select_model(self, task_complexity: str) -> str:

"""根据任务复杂度选择模型,简单任务用便宜模型"""

if task_complexity == "简单": # 如文本分类、简单问答

return "deepseek-chat" # 最便宜,性价比最高

elif task_complexity == "中等": # 如文章生成、常规对话

return "gpt-3.5-turbo"

else: # 如复杂推理、代码生成

return "gpt-4o" # 最强,适合高要求场景

def estimate_cost(self, input_tokens: int, output_tokens: int, model: str) -> float:

"""估算调用成本,提前控制预算"""

input_cost = (input_tokens / 1000) * self.models[model]

output_cost = (output_tokens / 1000) * (self.models[model] * 2) # 输出通常是输入价格的2倍

return round(input_cost + output_cost, 4)

# 关键优化:缓存机制,避免重复调用(如用户重复提问相同问题)

from functools import lru_cache

@lru_cache(maxsize=100) # 缓存100个最常访问的查询结果

def cached_llm_call(prompt: str) -> str:

"""带缓存的LLM调用,重复查询直接返回结果,节省成本"""

# 实际调用LLM的逻辑(省略,可复用前面的API调用代码)

return result

# 使用示例

cost_llm = CostOptimizedLLM()

# 简单任务选择便宜模型

model = cost_llm.select_model("简单")

# 估算成本

cost = cost_llm.estimate_cost(input_tokens=100, output_tokens=200, model=model)

print(f"本次调用估算成本:${cost}")

三、实战项目(小白可直接落地,面试加分)

光学不练假把式,以下3个项目,从简单到复杂,小白可循序渐进完成,项目代码可直接复用,完成后可放到GitHub,作为求职作品集:

项目1:智能客服系统(入门级,最易落地)

功能需求

- 回答常见问题(FAQ):基于RAG知识库,自动回复用户常见问题

- 情感分析:识别用户情绪,负面情绪优先处理

- 工单自动分类:将用户咨询、投诉分类,便于后续处理

- 提供API接口:支持前端对接,可直接部署使用

核心代码(基于FastAPI+LangChain,小白可直接运行)

from fastapi import FastAPI, HTTPException

from pydantic import BaseModel

import asyncio

# 初始化FastAPI应用

app = FastAPI(title="智能客服系统(小白实战版)")

# 定义请求体格式

class CustomerQuery(BaseModel):

user_id: str

message: str

session_id: str = None # 会话ID,用于记录对话历史

# 导入前面实现的RAG系统和情感分析工具(简化版)

class SentimentAnalyzer:

async def analyze(self, text: str) -> str:

"""简单情感分析,实际可替换为更精准的模型"""

negative_words = ["差", "不好", "不满意", "投诉", "垃圾"]

for word in negative_words:

if word in text:

return "负面"

return "中立" if "一般" in text else "正面"

class CustomerServiceAgent:

def __init__(self):

self.faq_knowledge_base = RAGSystem("./faq_db") # 导入前面的RAG系统

self.sentiment_analyzer = SentimentAnalyzer()

async def handle_query(self, query: CustomerQuery) -> dict:

"""处理用户查询,核心逻辑"""

# 步骤1:情感分析

sentiment = await self.sentiment_analyzer.analyze(query.message)

# 步骤2:负面情绪优先处理,创建工单

if sentiment == "负面":

return {

"response": "非常抱歉给您带来不便,我们会立即处理您的问题!您的工单已创建,工号:#12345",

"sentiment": sentiment,

"action": "create_ticket",

"priority": "high" # 高优先级

}

# 步骤3:查询FAQ知识库

faq_answer = self.faq_knowledge_base.query(query.message)

# 步骤4:知识库无答案时,调用LLM兜底

if "未找到" in faq_answer:

# 调用前面实现的LLM客户端

client = LLMClient(api_key="your-api-key")

llm_response = await client.chat([{"role": "user", "content": query.message}])

return {

"response": llm_response,

"sentiment": sentiment,

"action": "llm_fallback"

}

# 步骤5:返回知识库答案

return {

"response": faq_answer,

"sentiment": sentiment,

"action": "faq_match"

}

# 初始化客服代理

agent = CustomerServiceAgent()

# 定义API接口

@app.post("/chat")

async def chat(query: CustomerQuery):

"""客服聊天接口,前端可直接调用"""

try:

response = await agent.handle_query(query)

return {

"code": 0,

"message": "success",

"data": response

}

except Exception as e:

raise HTTPException(status_code=500, detail=str(e))

# 运行应用(小白直接运行即可)

if __name__ == "__main__":

import uvicorn

uvicorn.run(app, host="0.0.0.0", port=8000)

# 运行后,访问http://127.0.0.1:8000/docs,可测试API

项目2:企业知识库系统(进阶版,面试加分)

功能需求

- 文档上传和管理:支持PDF、Word等文档上传,自动存入知识库

- 智能问答:基于文档内容,精准回答用户问题,展示引用来源

- 对话记忆:记住用户历史对话,支持多轮问答

- 权限控制:区分管理员和普通用户,限制文档访问权限

核心代码(重点实现文档上传和智能问答)

from langchain.chains import ConversationalRetrievalChain

from langchain.memory import ConversationBufferMemory

from langchain.chat_models import ChatOpenAI

from langchain.vectorstores import Chroma

from langchain.embeddings import OpenAIEmbeddings

from langchain.text_splitter import RecursiveCharacterTextSplitter

import datetime

class EnterpriseKnowledgeBase:

def __init__(self):

# 初始化向量数据库和对话记忆

self.embeddings = OpenAIEmbeddings(api_key="your-api-key")

self.vectorstore = Chroma(

persist_directory="./enterprise_kb",

embedding_function=self.embeddings

)

# 对话记忆:记住用户历史对话

self.memory = ConversationBufferMemory(

memory_key="chat_history",

return_messages=True

)

# 对话式QA链(支持多轮问答)

self.qa_chain = ConversationalRetrievalChain.from_llm(

llm=ChatOpenAI(model="gpt-3.5-turbo", temperature=0, api_key="your-api-key"),

retriever=self.vectorstore.as_retriever(

search_type="similarity_score_threshold",

search_kwargs={

"k": 3,

"score_threshold": 0.7 # 只返回相似度>0.7的结果,避免无关回答

}

),

memory=self.memory,

return_source_documents=True, # 返回答案来源

verbose=False

)

async def ask(self, question: str, session_id: str) -> dict:

"""多轮问答,支持对话记忆"""

result = await self.qa_chain.acall({

"question": question,

"chat_history": self.memory.load_memory_variables({}).get("chat_history", [])

})

# 提取答案和来源(简化版,实际可优化来源展示)

answer = result["answer"]

sources = [

{

"content": doc.page_content[:100] + "...", # 显示前100字

"metadata": doc.metadata # 文档元数据(如上传时间、作者)

}

for doc in result["source_documents"]

]

return {

"answer": answer,

"sources": sources,

"session_id": session_id

}

def upload_document(self, file_path: str, metadata: dict) -> None:

"""上传文档到知识库(支持TXT、PDF等,此处以TXT为例)"""

# 读取文档内容

try:

with open(file_path, 'r', encoding='utf-8') as f:

content = f.read()

except Exception as e:

raise Exception(f"文档读取失败:{e}")

# 切分文档(长文档切分成小片段)

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=500,

chunk_overlap=50,

separators=["\n\n", "\n", "。", "!", "?", ".", "!", "?"]

)

texts = text_splitter.create_texts([content])

# 添加元数据(如文档名称、上传时间、作者)

for i, text in enumerate(texts):

self.vectorstore.add_texts(

[text],

metadatas=[{

**metadata,

"chunk_id": f"{file_path}_{i}",

"timestamp": datetime.now().isoformat()

}]

)

self.vectorstore.persist() # 持久化数据

# 使用示例

if __name__ == "__main__":

kb = EnterpriseKnowledgeBase()

# 上传文档(替换为自己的文档路径)

kb.upload_document(

file_path="./company_policy.txt",

metadata={"file_name": "公司规章制度", "author": "admin", "type": "policy"}

)

# 多轮问答测试

print(await kb.ask("公司年假有多少天?", session_id="user_123"))

print(await kb.ask("那工作满5年呢?", session_id="user_123")) # 记住历史对话

项目3:内容生成平台(高级版,提升竞争力)

功能需求

- 多类型内容生成:文章、邮件、营销文案等

- 多语言翻译:支持中英文互译,适配多场景

- 内容优化:精简、扩展、调整语气等

- 批量处理:支持批量生成多条内容,提升效率

核心代码(重点实现批量生成和内容优化)

from typing import Literal

from openai import AsyncOpenAI

import asyncio

class ContentGenerationPlatform:

def __init__(self):

self.client = AsyncOpenAI(api_key="your-api-key")

# 内容生成模板(可自定义扩展)

self.templates = {

"article": """你是一个专业的文章作者,文风流畅、内容充实。

请根据以下要求撰写文章:

主题:{topic}

字数:{words}字

风格:{style}(如专业、活泼、简洁)

目标读者:{audience}

要求:

1. 结构清晰,有引言、正文、结尾

2. 内容有具体例子,不空洞

3. 语言符合目标读者水平,无冗余内容

4. 原创内容,避免抄袭

请开始撰写:""",

"email": """你是一个专业的邮件撰写助手,语气得体、简洁专业。

请撰写一封邮件:

收件人:{recipient}

目的:{purpose}

要点:{points}(用逗号分隔)

语气:{tone}(如正式、亲切、委婉)

要求:

1. 主题明确,开头问候,结尾落款

2. 简洁明了,不冗余,突出核心要点

3. 语气符合场景,避免生硬

请撰写:"""

}

async def generate_content(

self,

content_type: Literal["article", "email"],

**kwargs

) -> str:

"""生成指定类型的内容,支持自定义参数"""

# 获取模板,无模板则直接调用LLM

template = self.templates.get(content_type, "{content}")

prompt = template.format(**kwargs)

# 调用LLM生成内容

response = await self.client.chat.completions.create(

model="gpt-3.5-turbo",

messages=[{"role": "user", "content": prompt}],

temperature=0.7, # 保留一定创造性

max_tokens=2000

)

return response.choices[0].message.content

async def optimize_content(

self,

original_content: str,

goal: Literal["shorten", "expand", "improve", "tone_change"],

**kwargs

) -> str:

"""优化内容,满足不同需求"""

# 优化提示词模板

prompts = {

"shorten": f"请将以下内容精简,保留核心信息,不丢失关键细节,控制在原长度的50%以内:\n{original_content}",

"expand": f"请扩展以下内容,增加具体例子和细节,使内容更充实,扩展到原长度的1.5倍左右:\n{original_content}",

"improve": f"请改进以下内容的表达,使其更清晰、流畅、有吸引力,修正语法错误,优化逻辑:\n{original_content}",

"tone_change": f"请将以下内容的语气改为{kwargs.get('tone', '专业')},保持核心内容不变,语气自然:\n{original_content}"

}

prompt = prompts.get(goal, original_content)

# 调用LLM优化

response = await self.client.chat.completions.create(

model="gpt-3.5-turbo",

messages=[{"role": "user", "content": prompt}],

temperature=0.5 # 优化时稳定性优先

)

return response.choices[0].message.content

async def batch_generate(

self,

tasks: list[dict]

) -> list[dict]:

"""批量生成内容,限制并发数,避免API限流"""

semaphore = asyncio.Semaphore(5) # 最多5个并发请求,可调整

async def process_task(task):

async with semaphore:

try:

result = await self.generate_content(**task)

return {"task": task, "result": result, "status": "success"}

except Exception as e:

return {"task": task, "error": str(e), "status": "failed"}

# 并发处理所有任务

results = await asyncio.gather(*[process_task(task) for task in tasks])

return results

# 使用示例

if __name__ == "__main__":

platform = ContentGenerationPlatform()

# 批量生成文章(示例:生成3篇不同主题的短文)

batch_tasks = [

{

"content_type": "article",

"topic": "Python入门技巧",

"words": "300",

"style": "简洁实用",

"audience": "小白程序员"

},

{

"content_type": "article",

"topic": "LangChain基础使用",

"words": "300",

"style": "专业详细",

"audience": "AI开发者"

},

{

"content_type": "article",

"topic": "大模型API成本优化",

"words": "300",

"style": "实用干货",

"audience": "企业开发者"

}

]

# 执行批量生成

batch_results = asyncio.run(platform.batch_generate(batch_tasks))

# 打印结果

for res in batch_results:

if res["status"] == "success":

print(f"任务成功:{res['task']['topic']}\n结果:{res['result']}\n")

else:

print(f"任务失败:{res['task']['topic']}\n错误:{res['error']}\n")

四、常见问题与解决方案(避坑指南,小白必看)

小白在开发过程中,常会遇到API调用失败、输出质量不稳定等问题,以下是最常见的3个问题及解决方案,直接套用即可:

4.1 输出质量不稳定(同样问题,回答不一样)

问题原因:大模型的随机性(由temperature参数控制),temperature越大,输出越随机;越小,输出越稳定。

解决方案(实战代码):

# 方法1:降低temperature,提升稳定性(适合需要固定格式、精准输出的场景)

from openai import AsyncOpenAI

client = AsyncOpenAI(api_key="your-api-key")

response = await client.chat.completions.create(

model="gpt-3.5-turbo",

messages=[{"role": "user", "content": "分类:这个产品很好用"}],

temperature=0, # 0表示最稳定,输出几乎固定

top_p=1.0 # 配合temperature使用,进一步控制随机性

)

# 方法2:添加示例(Few-Shot),引导模型输出格式

messages = [

{"role": "system", "content": "你是一个文本分类助手,只输出分类结果:正面/负面/中立"},

{"role": "user", "content": "这个产品太棒了!"},

{"role": "assistant", "content": "正面"},

{"role": "user", "content": "质量很差"},

{"role": "assistant", "content": "负面"},

{"role": "user", "content": "产品一般,凑合用"} # 实际输入

]

response = await client.chat.completions.create(

model="gpt-3.5-turbo",

messages=messages,

temperature=0.3

)

4.2 API调用失败(网络超时、限流、服务不可用)

问题原因:网络波动、API限流(如OpenAI每分钟调用次数限制)、服务临时故障。

解决方案(带重试+降级,实战代码):

from tenacity import retry, stop_after_attempt, wait_exponential, retry_if_exception_type

import logging

# 配置日志,便于排查错误

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

from openai import AsyncOpenAI, APIError, Timeout

client = AsyncOpenAI(api_key="your-api-key")

@retry(

stop=stop_after_attempt(3), # 最多重试3次

wait=wait_exponential(multiplier=1, min=2, max=10), # 指数退避等待(2s→4s→8s)

retry=retry_if_exception_type((ConnectionError, Timeout, APIError)) # 只重试指定异常

)

async def call_llm_with_retry(messages: list[dict]) -> str:

"""带重试机制的LLM调用,避免临时失败"""

try:

response = await client.chat.completions.create(

model="gpt-3.5-turbo",

messages=messages,

timeout=30 # 30秒超时,避免长时间等待

)

return response.choices[0].message.content

except Exception as e:

logger.error(f"LLM调用失败: {e}")

raise # 抛出异常,触发重试

async def call_llm_with_fallback(messages: list[dict]) -> str:

"""主模型失败时,切换到备用模型(降级策略),避免服务中断"""

try:

# 优先调用GPT-3.5-turbo

return await call_llm_with_retry(messages)

except Exception as e:

logger.warning(f"主模型(GPT-3.5-turbo)失败,切换到备用模型(DeepSeek): {e}")

# 切换到更稳定、更便宜的备用模型

response = await client.chat.completions.create(

model="deepseek-chat",

messages=messages,

timeout=30

)

return response.choices[0].message.content

# 使用示例

async def main():

messages = [{"role": "user", "content": "用Python写一个简单的RAG示例"}]

result = await call_llm_with_fallback(messages)

print(result)

asyncio.run(main())

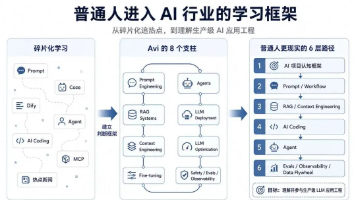

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线科技企业深耕十二载,见证过太多因技术卡位而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。我们整理出这套 AI 大模型突围资料包:

- ✅ 从零到一的 AI 学习路径图

- ✅ 大模型调优实战手册(附医疗/金融等大厂真实案例)

- ✅ 百度/阿里专家闭门录播课

- ✅ 大模型当下最新行业报告

- ✅ 真实大厂面试真题

- ✅ 2026 最新岗位需求图谱

所有资料 ⚡️ ,朋友们如果有需要 《AI大模型入门+进阶学习资源包》,下方扫码获取~

① 全套AI大模型应用开发视频教程

(包含提示工程、RAG、LangChain、Agent、模型微调与部署、DeepSeek等技术点)

② 大模型系统化学习路线

作为学习AI大模型技术的新手,方向至关重要。 正确的学习路线可以为你节省时间,少走弯路;方向不对,努力白费。这里我给大家准备了一份最科学最系统的学习成长路线图和学习规划,带你从零基础入门到精通!

③ 大模型学习书籍&文档

学习AI大模型离不开书籍文档,我精选了一系列大模型技术的书籍和学习文档(电子版),它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。

④ AI大模型最新行业报告

2025最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

⑤ 大模型项目实战&配套源码

学以致用,在项目实战中检验和巩固你所学到的知识,同时为你找工作就业和职业发展打下坚实的基础。

⑥ 大模型大厂面试真题

面试不仅是技术的较量,更需要充分的准备。在你已经掌握了大模型技术之后,就需要开始准备面试,我精心整理了一份大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

以上资料如何领取?

为什么大家都在学大模型?

最近科技巨头英特尔宣布裁员2万人,传统岗位不断缩减,但AI相关技术岗疯狂扩招,有3-5年经验,大厂薪资就能给到50K*20薪!

不出1年,“有AI项目经验”将成为投递简历的门槛。

风口之下,与其像“温水煮青蛙”一样坐等被行业淘汰,不如先人一步,掌握AI大模型原理+应用技术+项目实操经验,“顺风”翻盘!

这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

以上全套大模型资料如何领取?

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献154条内容

已为社区贡献154条内容

所有评论(0)