OpenCV DNN模块实现风格迁移:从原理到实战(附完整代码)

使用OpenCV的DNN(Deep Neural Networks)模块做风格迁移,是一项非常酷且适合初学者的技术。它最大的魅力在于,你不需要深入理解复杂的深度学习框架,仅用几十行代码,就能在普通电脑的CPU上,将一张普通照片瞬间变成一幅世界名画风格的作品。

下面,我会带你一步步了解它的核心原理和完整的实现流程。

🤔 什么是DNN模块?它和风格迁移的关系?

可以把DNN模块想象成一个“万能模型播放器”:

-

它的核心功能是“推理”而非“训练”:DNN模块不负责训练神经网络,它的任务是加载别人已经训练好的模型(就像播放一个现成的视频文件),然后用这个模型对新图像进行预测,得到风格化结果。

-

它极大地降低了AI应用的门槛:你无需安装庞大的TensorFlow或PyTorch,也无需昂贵的GPU。DNN模块像一个轻量级的深度学习“引擎”,可以高效地在CPU上运行,非常适合集成到已有的OpenCV项目中。

-

它广泛支持各种模型格式:DNN模块可以读取并运行来自多种主流深度学习框架的模型,比如TensorFlow (

.pb)、Caffe (.caffemodel)、Torch (.t7)、ONNX (.onnx)等。在风格迁移中,我们最常接触的是Torch的.t7模型文件。

🧠 风格迁移的“秘密”:快速神经风格迁移

我们通过DNN模块实现的,是一种被称为 “快速神经风格迁移” (Fast Neural Style Transfer) 的技术。

-

它的工作原理:你获得一个针对特定风格(如“星空”)预训练好的模型,它已经学会如何将“内容”图像重构为“星空”风格。使用时,只需将内容图像输入模型进行一次“前向传播”(Forward Pass),就能立刻得到结果。

-

它的效果是内容与风格的完美融合:最终生成的图像,会完美地保留原照片中的人物、建筑等核心轮廓(“内容”),同时呈现出目标画作(“风格”)的色彩、笔触和纹理。

🛠️ 核心API与实现流程

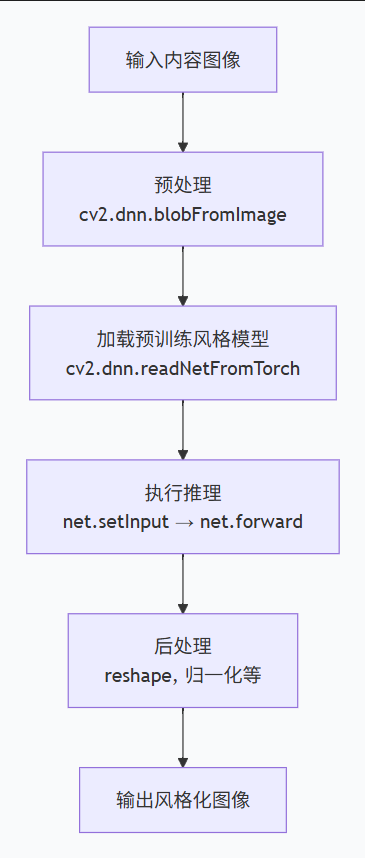

下面这张流程图可以帮你直观地理解整个实现过程:

其中,最关键的两个API是 cv2.dnn.blobFromImage 和 cv2.dnn.readNetFromTorch。

-

1. 图像预处理:

cv2.dnn.blobFromImage

这个函数负责将OpenCV读取的图像(BGR格式)转换成DNN模块能理解的格式,也就是一个叫 “blob” 的四维数据(形状通常为(1, 3, height, width))。它主要执行以下操作:-

尺寸调整:将图像缩放到模型要求的尺寸。

-

通道转换:将OpenCV的BGR通道转换为模型期望的RGB通道。

-

数值缩放:将像素值从

0-255缩放到0-1或-1~1的范围。

-

-

2. 加载模型与推理:

cv2.dnn.readNetFromTorch-

net = cv2.dnn.readNetFromTorch('model.t7'):这个函数专门用于加载Torch框架训练出来的.t7模型文件。 -

net.setInput(blob):将预处理好的blob数据设置为网络的输入。 -

output = net.forward():执行前向传播,得到风格化后的结果。

-

🚀 从零开始:静态图片风格迁移实战

环境准备

-

安装OpenCV:确保安装了包含DNN模块的OpenCV。建议安装

opencv-python或opencv-contrib-python。在终端执行:pip install opencv-python numpy -

准备模型:下载你喜欢的预训练风格迁移模型。最经典的资源来自 Justin Johnson 的 fast-neural-style 项目,你可以通过它的下载脚本获取常见的

.t7模型文件。你也可以在一些博客分享的资源中找到它们。

完整代码示例 (Python)

以下是一份完整的代码,包含了所有关键步骤和详细的注释,你可以直接复制运行:

import cv2

import numpy as np

# --- 1. 准备工作 ---

# 1.1 读取你的内容图片

image = cv2.imread('your_photo.jpg')

if image is None:

print("错误:无法读取图像,请检查文件路径!")

exit()

original_image = image.copy() # 保留一份原图用于显示

(h, w) = image.shape[:2]

# 1.2 加载你下载的风格模型

# 注意:将 'starry_night.t7' 替换为你下载的模型文件名和路径

model_path = 'models/starry_night.t7'

net = cv2.dnn.readNetFromTorch(model_path)

# --- 2. 图像预处理:转换为神经网络能接受的blob格式 ---

# 参数详解:

# - image: 输入的OpenCV图像 (BGR格式)

# - scalefactor: 像素值缩放因子,1.0表示不做缩放。但很多模型需要归一化到[0,1],因此常设为1.0/255.0

# - size: 输出blob的空间尺寸 (width, height),这里使用原图尺寸

# - mean: 要减去的均值 (R, G, B)。通常为0,表示不减去

# - swapRB: 是否交换第一个(R)和最后一个(B)通道。OpenCV是BGR,模型通常是RGB,所以设为True

# - crop: 是否在调整大小后中心裁剪。通常设为False

blob = cv2.dnn.blobFromImage(image, scalefactor=1.0/255.0, size=(w, h),

mean=(0, 0, 0), swapRB=True, crop=False)

# --- 3. 模型推理 ---

net.setInput(blob)

# 执行前向传播,获得风格化结果

output = net.forward()

# --- 4. 后处理:将网络输出转换回可显示的OpenCV图像 ---

# 4.1 重塑维度:网络输出形状为(1, C, H, W),我们需要去掉第0维的batch,变为(C, H, W)

output = output.reshape((output.shape[1], output.shape[2], output.shape[3]))

# 4.2 转置维度:OpenCV显示需要(H, W, C)格式,所以需要将(C, H, W)转置为(H, W, C)

output = output.transpose(1, 2, 0)

# 4.3 恢复像素值范围:预处理时缩放到[0,1],现在乘回255并转为uint8类型

output = np.clip(output * 255.0, 0, 255).astype(np.uint8)

# 4.4 注意:此时output的颜色通道是RGB,而OpenCV默认显示BGR,因此还需转换

output = cv2.cvtColor(output, cv2.COLOR_RGB2BGR)

# --- 5. 显示和保存结果 ---

cv2.imshow("Original Image", original_image)

cv2.imshow("Stylized Image", output)

cv2.imwrite("stylized_result.jpg", output) # 保存结果

cv2.waitKey(0)

cv2.destroyAllWindows()代码要点解析:

scalefactor=1.0/255.0:这是一个关键点。很多预训练模型期望输入的像素值范围在[0,1]之间,因此需要将原始0-255的像素值进行缩放。

swapRB=True:OpenCV默认读取图像的通道顺序是BGR,而大多数深度学习模型(包括风格迁移模型)在训练时使用的是RGB顺序。交换通道是确保模型正确理解颜色的关键一步。后处理:

net.forward()的输出是一个四维数组,需要经过reshape、transpose、数值裁剪和类型转换等步骤,才能变回OpenCV可以处理的图像格式。

🎬 进阶应用:实时摄像头视频风格迁移

将静态图片处理变为实时视频流处理,流程几乎完全一样,只需要对摄像头捕获的每一帧都执行上述操作。下面是一个简单的示例代码框架:

import cv2

# 加载模型

net = cv2.dnn.readNetFromTorch('models/udnie.t7') # 可以换其他模型

# 打开摄像头

cap = cv2.VideoCapture(0) # 0代表默认摄像头

while True:

# 读取一帧

ret, frame = cap.read()

if not ret:

break

# 获取帧的尺寸

(h, w) = frame.shape[:2]

# 预处理:创建blob (注意尺寸为(w, h))

blob = cv2.dnn.blobFromImage(frame, scalefactor=1.0/255.0, size=(w, h),

mean=(0, 0, 0), swapRB=True, crop=False)

# 推理

net.setInput(blob)

output = net.forward()

# 后处理 (与静态图片完全相同)

output = output.reshape((output.shape[1], output.shape[2], output.shape[3]))

output = output.transpose(1, 2, 0)

output = np.clip(output * 255.0, 0, 255).astype(np.uint8)

output = cv2.cvtColor(output, cv2.COLOR_RGB2BGR)

# 显示结果

cv2.imshow('Real-time Style Transfer', output)

# 按 'q' 键退出

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放资源

cap.release()

cv2.destroyAllWindows()💡 常见问题与解决方案

| 问题现象 | 可能原因 | 解决方法 |

|---|---|---|

| 运行代码没有反应或报错 | OpenCV版本不支持DNN模块,或缺少必要的库。 | 确保你安装的是较新版本的OpenCV(4.x以上)。可以尝试升级:pip install --upgrade opencv-python。 |

| 输出图像全黑或颜色怪异 | 预处理和后处理参数设置不当。 | 1. 检查 swapRB:确保设为 True,以完成BGR到RGB的转换。2. 检查 scalefactor:尝试设为 1.0/255.0 进行归一化,或设为 1.0 不做缩放,具体取决于模型训练时的参数。3. 检查通道转换:确保在后处理中,使用 cv2.cvtColor(output, cv2.COLOR_RGB2BGR) 将结果转回BGR格式。 |

| 处理速度很慢,尤其是视频 | 图像尺寸过大,模型推理开销大。 | 在调用 cv2.dnn.blobFromImage 时,将 size 参数设置小一些,例如 size=(300, 300)。这会大幅降低计算量,牺牲一些细节来换取流畅度。 |

| 输出图像出现黑白噪点或伪影 | 模型训练不完美,或内容图像本身质量不高。 | 尝试更换一个效果更好的模型。不同风格的模型对不同图像的适应性也不同。 |

🎨 玩转更多风格

你可以尝试不同的模型来获得丰富的艺术效果。以下是一些常见的 .t7 模型及其对应的风格:

-

candy.t7: 糖果色风格,色彩明亮、饱和,类似波普艺术。

-

composition_vii.t7: 抽象几何风格,灵感来自瓦西里·康定斯基的作品。

-

feathers.t7: 羽毛般的柔和笔触,富有诗意。

-

la_muse.t7: 模仿印象派或后印象派的肖像风格。

-

starry_night.t7: 文森特·梵高的《星空》,具有标志性的漩涡星云和厚重笔触。

-

the_scream.t7: 爱德华·蒙克的《呐喊》,表现主义风格,色彩和线条极具张力。

-

udnie.t7: 类似立体主义或抽象派风格,画面色彩丰富。

💎 总结与拓展

OpenCV DNN模块为风格迁移提供了一个极其友好的入口。通过理解“预处理 -> 加载模型 -> 推理 -> 后处理”这一核心流程,并熟练运用 blobFromImage 和 readNetFromTorch 这两个关键API,你就能轻松实现从静态图片到实时视频的各种创意应用。

以上提到的模型都可以在Justin Johnson的项目中下载。你可以先从 starry_night.t7 或 candy.t7 开始,直观地感受技术带来的乐趣。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)