DeCo: Decoupling Token Compression from SemanticAbstraction in Multimodal Large Language Models

摘要

视觉投影器作为连接视觉与语言模态、推动跨模态对齐的关键部件,是多模态大语言模型(MLLM)中的核心组件。然而,针对投影器在视觉—语言对齐中效果的度量问题仍缺乏充分探索,目前仅能通过多模态大语言模型在下游任务上的表现间接推断。受该问题启发,本文通过解读多模态大语言模型内部的视觉—语言语义流,对投影器模块展开研究。具体而言,我们将语义关联流从生成的语言令牌回溯至原始视觉编码器的图像块,以及投影器输出的中间特征。研究发现,压缩式投影器(如 QFormer)会将视觉图像块抽象为数量有限的语义概念(如目标或属性),进而产生**“双重抽象”现象**。 在多模态大语言模型中,该过程体现为:首先由投影器借助预定义查询令牌完成第一轮视觉语义抽象(视觉模态内),再由大语言模型根据文本指令完成第二轮语义提取(语言模态内)。双重抽象会降低训练效率,并导致视觉语义信息出现累积缺失。为缓解这一问题,本文提出**“压缩与抽象解耦(DeCo)”**的核心思路:由投影器在图像块层面完成视觉令牌数量的压缩,而将视觉语义抽象的任务完全交由大语言模型处理。基于此,我们采用一种简洁的压缩器——二维自适应池化,以无参数方式对视觉图像块进行下采样。 实验结果表明,DeCo 在效果与效率上均优于传统压缩式投影器。在多模态大语言模型基准测试、视觉定位以及开放式视觉问答任务上,DeCo 分别实现了 0.9%、7.1% 与 2.9% 的性能提升,同时可训练参数量更少、收敛速度更快。此外,DeCo 能够保留视觉空间局部性,并在各类多模态大语言模型结构中表现出稳健性,包括不同视觉主干网络、图像分辨率与大语言模型。代码开源地址:https://github.com/yaolinli/DeCo。

引言

多模态大语言模型(MLLM)[55,25,60] 为大语言模型(LLM)赋予了视觉感知能力,并在各类视觉—语言任务中展现出极强的通用性与专业能力 [30,81,71,9,41,79,78,16]。对于多模态大语言模型而言,学习良好的视觉—语言对齐是其智能表现的核心 [38,84,63,65]。为实现跨模态对齐,近期研究引入了一个中间模块,即**投影器(projector)**[45,84,51,19],将图像块特征 [22] 映射到大语言模型的嵌入空间中,形成视觉令牌。 目前广泛使用的投影器大致可分为两类:**非压缩型**与**压缩型**。非压缩投影器 [45] 直接采用线性层,将视觉令牌的维度转换为大语言模型所需维度,同时保持视觉令牌数量不变。尽管简单有效,但由于视觉令牌序列较长,线性投影器会带来较高的训练资源与计算开销。这种过长序列主要出现在两种常见场景中:(1) 序列长度随输入分辨率呈二次增长 [36,17];(2) 在处理视频帧时,序列长度随图像数量线性增长 [64,72,62],极端情况下序列长度可达百万级 [47]。 另一分支是目前主流的**压缩型投影器**,例如 QFormer [38,19]、Resampler [3] 和 D-Abstractor [11]。它们将原始视觉令牌聚合为更少的查询令牌,以减少视觉冗余,在性能与效率之间取得了更好的平衡。 然而,从可解释性角度分析现有投影器如何影响视觉到语言的语义对齐,这一问题仍缺乏充分研究。理解这一机制对于推动更优的结构设计、以及在高分辨率图像、视频等严苛场景下提升模型实用性至关重要。为此,本文通过分析生成的文本令牌、原始图像块与投影器中间输出之间的相关性,对该问题展开研究。

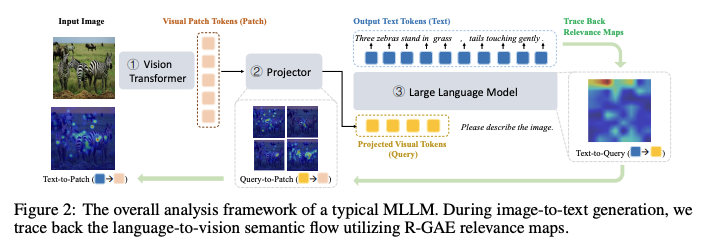

我们首先使用一种新的可解释性工具 **R-GAE** 追溯语言到视觉的语义流。具体而言,我们将图像生成文本过程中整体的“文本到图像块”语义相关性,解耦为“文本到查询令牌”与“查询令牌到图像块”两个子流。其中,文本到图像块的相关性揭示了大语言模型(文本)有效利用的来自视觉Transformer(ViT)的视觉上下文(图像块)。同时,查询令牌到图像块的相关性解释了查询令牌从原始图像块中学到的视觉模式。 基于 R-GAE 分析,我们得出两项重要发现:

第一,查询令牌通过**抽象语义级视觉概念**来压缩视觉令牌数量,进而导致视觉语义缺失,例如细粒度属性丢失与空间位置信息破坏。

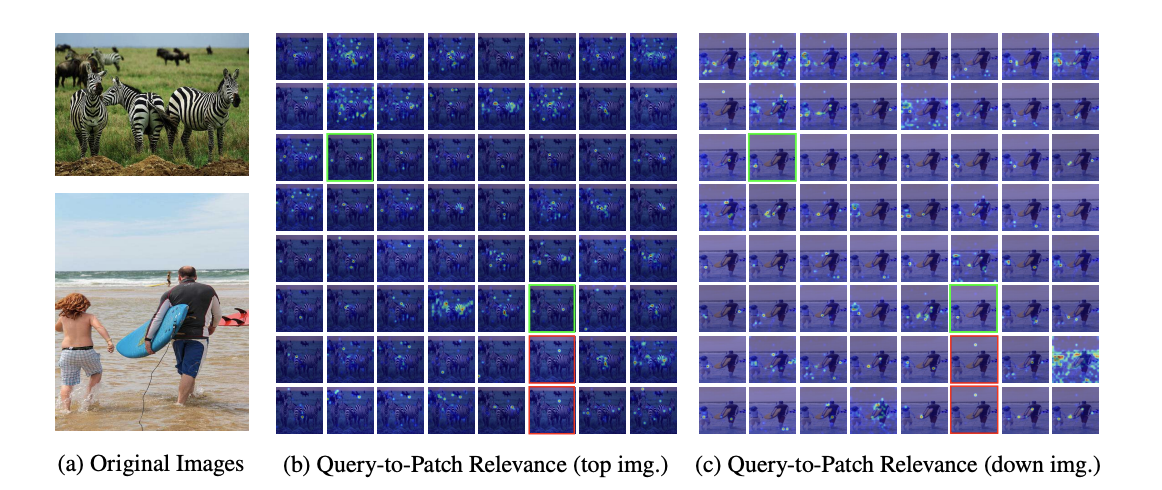

如图 1 所示,不同查询令牌会被原始图像中的不同视觉概念激活,如目标、属性或背景。对于上方草原斑马的图像,查询令牌分别关注三只斑马、身体部位、纹理以及远处背景等视觉模式。然而,固定数量的查询令牌只能表达有限的视觉语义。具体表现为:不同查询令牌在不同图像上呈现重复模式(如图 1 中彩色框标注);容易丢失细粒度视觉属性(如图 3 中的“紫色与红色”);此外,已有研究表明,普通 QFormer 在语义抽象过程中会丢失视觉空间位置信息 [11]。

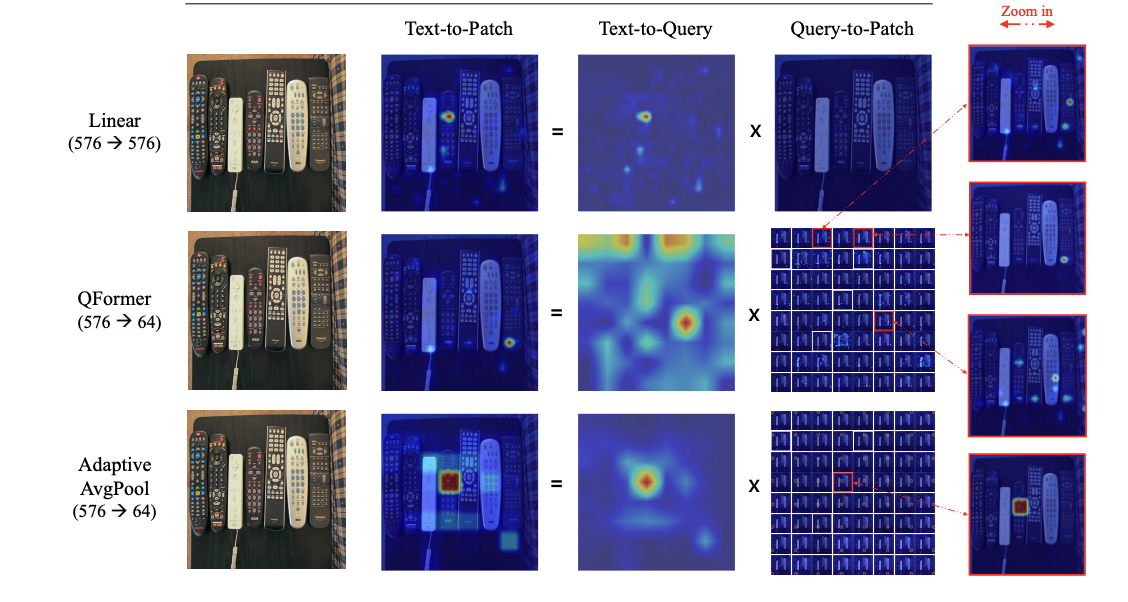

第二,大语言模型本身就可以**直接从图像块特征中完成出色的视觉语义抽象**。 如图 3 第一行所示,使用非压缩线性投影器可让大语言模型直接感知图像块级视觉表示,并精准关注对应视觉区域,不会出现预先的语义缺失。 因此,基于 QFormer 的多模态大语言模型系统会通过 QFormer 与大语言模型**重复进行两次视觉语义提取**,我们将其称为**冗余双重抽象现象**。这种双重抽象带来两个主要缺陷:

如图 3 第一行所示,使用非压缩线性投影器可让大语言模型直接感知图像块级视觉表示,并精准关注对应视觉区域,不会出现预先的语义缺失。 因此,基于 QFormer 的多模态大语言模型系统会通过 QFormer 与大语言模型**重复进行两次视觉语义提取**,我们将其称为**冗余双重抽象现象**。这种双重抽象带来两个主要缺陷:

(1) 语义层面的视觉缺陷累积,即 QFormer 抽象过程中丢失的细粒度语义与空间位置信息会传递给大语言模型;

(2) 为优化一个高效的视觉语义抽象器,训练复杂度显著增加。为此,需要一种更高效的压缩投影器,既能简化训练复杂度,又能保留更多视觉上下文。 本文提出将**令牌数量压缩与视觉语义抽象解耦(DeCo)**。DeCo 的核心是使用更简洁的投影器,直接在图像块层面操作并输出视觉令牌,以减少视觉令牌数量;随后由大语言模型独立从压缩后的令牌中抽象视觉语义概念。在 DeCo 框架中,我们采用简单的**二维自适应平均池化**作为天然的图像块级下采样器,再通过线性层完成视觉维度映射。 该投影器具有三重优势:第一,可通过自动计算池化核大小与步幅,灵活将视觉令牌压缩到任意指定数量;且无参数,收敛更快。第二,基于核的操作与邻域块融合能够保留视觉空间位置信息。在相同设置下与主流压缩投影器的对比实验验证了 DeCo 框架的有效性与高效性。同时,DeCo 表现出更强的空间理解能力,并在不同多模态大语言模型配置下具备稳健性,包括不同视觉主干网络、图像分辨率与大语言模型。 总而言之,本文的主要贡献有三点: (1) 设计了一种新的分析工具 R-GAE,用于解析多模态大语言模型投影器中学到的视觉语义。 (2) 借助该工具揭示了语义层面的双重抽象现象,这一现象会导致多模态大语言模型性能受损。针对该问题,我们提出 DeCo 架构,通过自适应池化机制实现令牌压缩与视觉语义抽象的解耦。 (3) 实验结果表明,DeCo 简洁高效,能显著提升多模态大语言模型在多个基准上的空间理解能力。

3 视觉投影器分析

在本节中,我们使用一种新颖的 R‑GAE 可解释性工具,从**语义流**的角度分析投影器模块对多模态大语言模型(MLLM)的影响。在图像到文本生成过程中,视觉上下文对大语言模型(LLM)的感知能力起着不可或缺的作用。图像与文本之间的相关相关性图(如注意力图)[74] 可用于解释视觉—语言语义对齐效果 [14,77,10,61]。 如图 2 所示,给定 MLLM 结构中的一段参考描述,从文本单词回溯到图像块的相关性图(记为**文本到图像块**)能够体现与 LLM 对齐的视觉语义,并进一步指示 LLM 所利用的有效视觉上下文。为探究作为中间模块的投影器所产生的影响,我们将文本到图像块的相关性图**拆解**为文本到查询向量、查询向量到图像块这两个子图,如图 3 所示。其中,查询向量到图像块的图可以解释查询(压缩)令牌学到的视觉模式;而由投影器导致的文本到图像块与文本到查询向量之间的差异,则揭示了投影器对视觉—语言语义对齐的影响。 一个典型的 MLLM 结构包括:一个视觉 Transformer(ViT),用于获取包含 \(N\) 个图像块的视觉表示

如图 2 所示,给定 MLLM 结构中的一段参考描述,从文本单词回溯到图像块的相关性图(记为**文本到图像块**)能够体现与 LLM 对齐的视觉语义,并进一步指示 LLM 所利用的有效视觉上下文。为探究作为中间模块的投影器所产生的影响,我们将文本到图像块的相关性图**拆解**为文本到查询向量、查询向量到图像块这两个子图,如图 3 所示。其中,查询向量到图像块的图可以解释查询(压缩)令牌学到的视觉模式;而由投影器导致的文本到图像块与文本到查询向量之间的差异,则揭示了投影器对视觉—语言语义对齐的影响。 一个典型的 MLLM 结构包括:一个视觉 Transformer(ViT),用于获取包含 \(N\) 个图像块的视觉表示 ;一个投影器,用于将视觉表示映射到文本嵌入空间;以及一个 LLM,用于同时处理视觉令牌与指令令牌,输出隐状态

并生成回答

。我们将广泛使用的投影器归纳为两类:

- **非压缩型投影器**:保持图像块令牌数量 \(N\) 不变,仅变换视觉嵌入维度以匹配 LLM 维度,例如线性投影器 [45]。投影后的视觉令牌可记为 。

- **压缩型投影器**:将图像块令牌数量 \(N\) 减少到指定的更小数量 \(M\)(\(M<N\)),从而节省训练资源。例如 QFormer [38] 通过学习预定义的查询令牌来压缩原始视觉令牌。

这些压缩后的查询令牌 随后被送入 LLM 以提供视觉信息。 为清晰表述,我们在本文中对**压缩**与**抽象**两个概念进行区分:压缩特指视觉令牌数量的减少;而抽象指对视觉语义概念(如目标、属性等)的提取。

3.1 R‑GAE:基于 GAE 的 MLLM 相关性图

我们旨在利用拆解后的文本到查询向量、查询向量到图像块的相关性图来分析投影器模块。一个直接的思路是使用 MLLM 各层中的原始注意力图作为相关性图 [61]。然而,注意力图仅反映单层内令牌之间的交互 [14]。我们需要的是一种能够**回溯 MLLM 中任意两层之间令牌对齐关系**的相关性图,例如从中间层查询向量到初始层输入图像块的对齐。为实现这一目标,我们提出一种新颖的 R‑GAE 相关性图,它基于通用注意力可解释性(GAE)[13] 推导而来。R‑GAE 将原本为分类任务设计的 GAE 方法扩展到生成式 MLLM 中,并使其适配典型 MLLM 结构,能够通过传播计算 MLLM 内任意两层之间的相关性。 我们初始化三类 R‑GAE 相关性图:文本到图像块 \(R^{T\to I}\)、文本到查询向量 \(R^{T\to Q}\)、查询向量到图像块 \(R^{Q\to I}\)。

基于“初始时每个输入令牌的相关性得分相等”这一直觉,每类图均初始化为单位矩阵。给定一张图像和一条指令(如“请用简洁的句子描述这张图”),MLLM 会依据视觉信息生成文本描述 。在生成第 t 步时,我们可以在前向传播中缓存 ViT、投影器与 LLM 的注意力图。随后,以单词类别

为目标预测,通过反向传播得到对应的梯度。对每一层,利用梯度在多个注意力头上取平均,即可得到单张 R‑GAE 相关性图。对于第 \(t\) 步,我们可以将文本到查询向量图

从 LLM 第一层传播至最后一层,得到最终图。同理,查询向量到图像块图

可从投影器第一层传播至最后一层。 整体的文本到图像块相关性图可通过矩阵相乘得到:

对于完整句子 \(Y\),我们对每一时间步 \(t\) 的 R‑GAE 相关性图取平均,得到与真实句子相关的整体视觉相关性。我们以图文对中的真实描述作为目标回答执行反向传播,这使得使用不同投影器的 MLLM 拥有一致的参考文本到图像块可视化结果。我们在附录 A 中提供 GAE 的背景知识与 R‑GAE 的具体传播公式,并在附录 B 中对比 R‑GAE 与原始注意力图的可视化效果。

3.2 压缩型投影器导致的冗余双重抽象现象

基于 R‑GAE 图,我们分析不同类型的投影器,并探究它们如何影响视觉到语言的语义对齐。为保证公平对比与分析,我们训练了结构完全相同、仅投影器不同的 MLLM,并保持其他所有变量一致(实验细节见 5.1 节)。我们在图 3 中可视化了非压缩投影器(即线性层)与压缩投影器(即 QFormer)的 R‑GAE 图,并得出以下发现。

**发现 1:LLM 可以直接从图像块表示中成为优秀的视觉语义抽象器。** 非压缩投影器将图像块表示直接输入 LLM。如图 3 第一行所示,给定一段包含视觉目标(遥控器、按钮)与属性(紫色、红色)的描述,LLM 能够以细粒度方式高亮最相关的视觉区域,精准区分出带有紫红色按钮的遥控器。这表明 LLM 已在图像块表示的基础上建立了强文本—视觉语义对齐。近期采用非压缩投影的 MLLM [46,37,15] 取得成功,进一步证明 LLM 本身就是高效的视觉语义抽象器。例如使用简单 MLP 的 LLaVA‑NeXT [46] 在多个多模态基准上达到了最优性能。

**发现 2:压缩型投影器从图像块中提取的视觉语义概念有限。** QFormer 等压缩型投影器会预先从图像块中提取视觉语义概念,并向 LLM 提供语义层面上已精简的视觉令牌。如图 3 中的查询向量到图像块图所示,压缩后的 8×8 查询向量会被不同的视觉语义模式激活,如各类遥控器、按钮、控制面板与黑色底板。然而,固定数量的查询向量只能覆盖图像中有限的视觉语义概念。对比 64 个令牌的视觉模式后,我们发现它们在视觉上重复、语义上稀疏。例如,位置 (0,1) 与 (2,0) 的查询向量几乎完全相同,都关注右侧遥控器的右下区域。这些稀疏的查询向量导致**视觉语义缺失**,丢失了“紫红色按钮”这一细粒度属性。因此,当 LLM 在查询向量语义空间中再次提取视觉上下文时,会受到这种不可逆的视觉语义缺失影响。从文本到查询向量图可以看到,LLM 主要关注 (0,2)、(0,4)、(4,5) 位置的查询向量(红框标出),最终导致文本与图像块的对齐错误,这一点在文本到图像块图中得到验证。更多可视化样例见附录 D。 **核心洞察:视觉语义双重抽象导致 MLLM 系统效率低下。** 基于上述观察,我们得出结论:现有学习固定数量查询向量的压缩型投影器,在减少视觉令牌数量上属于**低效压缩器**。它们会形成一种“双重抽象”的 MLLM 系统:视觉语义先由投影器抽象,再由 LLM 重新提取。这种双重抽象过程存在两个主要缺陷: (1) **视觉语义累积丢失**。投影器作为连接 ViT 与 LLM 的中间模块,其在第一轮抽象中丢失的视觉语义会成为整个 MLLM 系统的瓶颈。 (2) **训练复杂度上升**。为缓解语义丢失,需要将投影器优化为有效的语义抽象器,这会显著增加训练代价与复杂度。例如使用重采样器投影器的 Qwen‑VL‑7B [6] 需要经过三个训练阶段,使用 14 亿预训练数据与 5000 万微调数据。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)