北德克萨斯大学:AI绘画师学会了看图说话,一秒生成人脸肖像

这项由北德克萨斯大学Bharath Krishnamurthy和Ajita Rattani领导的研究发表于2026年3月30日的计算机视觉领域,论文编号为arXiv:2603.29029v1。有兴趣深入了解的读者可以通过该编号查询完整论文。

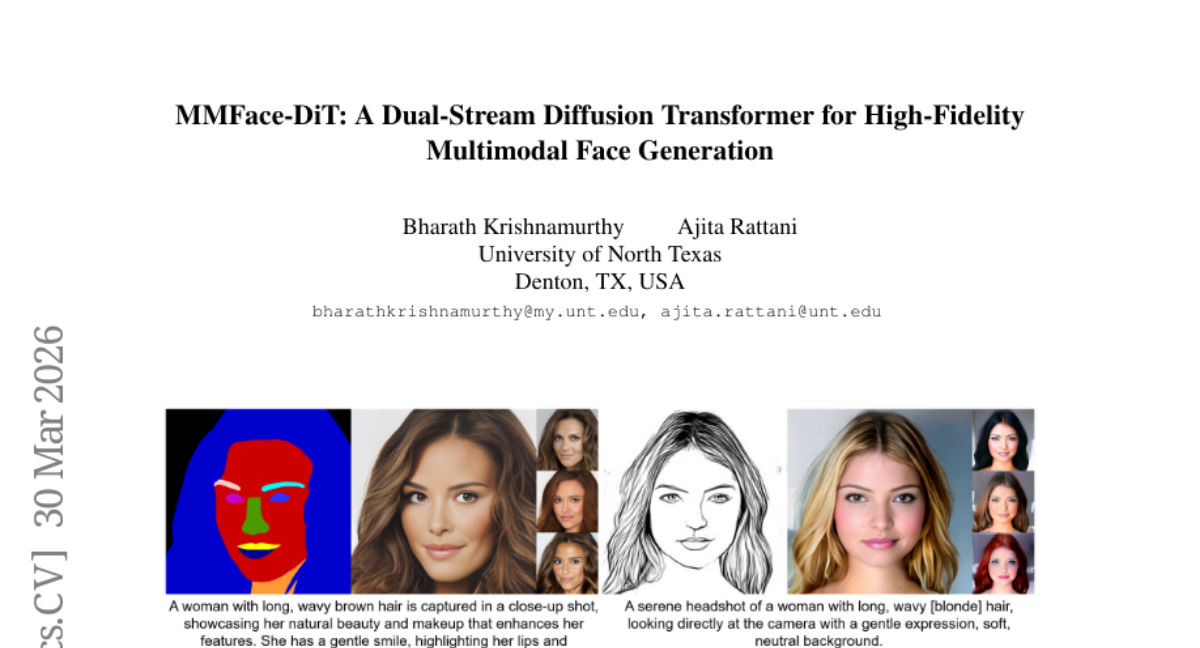

从前,如果你想要一张特定的人脸照片,你需要找到真人模特,安排拍摄,调整光影。现在,北德克萨斯大学的研究团队开发出了一个名为MMFace-DiT的人工智能系统,它就像一位神奇的肖像画师,只需要你用简单的语言描述想要的人脸特征,再提供一个粗略的草图或分割图,就能立刻为你生成一张逼真的人脸照片。

这个人工智能系统的特别之处在于,它不仅能理解你的文字描述,比如"一位有着卷曲棕色头发的微笑女性",还能同时理解你提供的视觉线索,比如一个简单的人脸轮廓草图。更令人惊讶的是,它能将这两种完全不同的信息完美融合,生成出既符合文字描述又遵循草图结构的高质量人脸图像。

在人工智能绘画的世界里,大多数系统要么只会根据文字画画,要么只会根据图片画画,很少有系统能同时处理这两种信息。就好比一位画师要么只会听你口头描述来作画,要么只会看着参考图临摹,但很难同时兼顾两者。而MMFace-DiT就像一位经验丰富的肖像画师,既能理解你的语言描述,又能参考你提供的草图,将两者巧妙结合创作出令人惊艳的作品。

传统的人脸生成技术往往存在一个根本性问题:当你同时提供文字和图像指引时,系统容易偏向其中一种信息而忽略另一种。比如,如果你提供了一个男性的轮廓图,但文字描述说要"长发飘逸",许多系统会产生冲突,要么忽略文字要求,要么完全违背图像结构。MMFace-DiT通过创新的双流处理架构解决了这个难题,它就像一位能够同时用左右脑思考的艺术家,左脑处理逻辑性的图像结构信息,右脑理解感性的文字描述,然后将两者和谐统一。

研究团队还解决了另一个重要问题:训练数据的缺乏。现有的人脸数据集要么缺少详细的文字描述,要么描述过于简单笼统。为此,他们开发了一套基于先进视觉语言模型的自动标注系统,为大量人脸图像生成了丰富详细的描述文字。这就像为每幅肖像画配上了详尽的说明文字,让AI系统能够更好地理解人脸的各种细节特征。

一、技术创新的核心秘密

MMFace-DiT的技术核心可以比作一个精密的双轨铁路系统。在这个系统中,文字信息和图像信息就像两列并行行驶的火车,它们在同一个轨道网络上运行,但走的是不同的路径。关键的创新在于,这两列火车会在每个重要的站点相遇交流,共享彼此的信息,最终到达同一个目的地。

传统的方法更像是两条完全分离的道路,文字和图像各走各的路,最后只能在终点勉强拼凑在一起。这种做法经常导致信息冲突和不协调的结果。而MMFace-DiT创造性地设计了一种"共享注意力机制",让文字和图像信息能够在处理过程中持续对话和协调。

具体来说,系统采用了一种叫做"旋转位置编码"的技术来处理空间信息。这个技术就像给每个图像区域都分配了一个独特的GPS坐标,让系统能够精确理解"眼睛应该在哪里"、"头发应该如何分布"等空间关系。同时,文字信息也被转换成类似的坐标系统,使得"蓝色眼睛"这样的描述能够准确对应到图像中的正确位置。

另一个重要创新是"模态嵌入器"的设计。这个组件就像一位同声传译员,能够理解你提供的是草图、分割图还是其他类型的视觉指引,然后相应地调整处理方式。这意味着用户可以使用同一个系统处理不同类型的输入,而不需要为每种输入类型准备不同的模型。

系统的训练过程采用了两种不同的策略:一种是传统的扩散模型训练方法,另一种是更新的流匹配训练方法。这就像培养一位艺术家时,既让他练习传统的素描技法,又让他学习现代的创作理念。实验表明,流匹配方法训练出的模型在图像质量上表现更优秀,能够生成更加自然逼真的人脸图像。

二、数据准备的智慧工程

创建高质量的训练数据对于任何AI系统都至关重要,就好比厨师需要新鲜优质的食材才能烹饪出美味佳肴。研究团队面临的挑战是,现有的人脸数据集要么完全没有文字描述,要么只有非常简单的标签,比如"金发女性"这样过于笼统的描述。

为了解决这个问题,研究团队开发了一套基于InternVL3视觉语言模型的自动标注系统。这个系统就像一位经验丰富的艺术评论家,能够仔细观察每张人脸照片,然后用丰富的语言描述其中的细节。但与人工标注不同的是,这个AI评论家不会疲倦,能够为数万张图片提供一致质量的详细描述。

标注过程采用了巧妙的多提示策略。系统会用十种不同的方式来"询问"视觉语言模型关于同一张图片的信息。有些问题专注于基本特征,如"这个人的头发是什么颜色";有些问题关注细节,如"这个人佩戴了什么装饰品";还有些问题探讨整体印象,如"这张照片给人什么感觉"。这种多角度的询问确保了最终描述的全面性和丰富性。

生成的原始描述还需要经过两轮精细的后处理。第一轮是基于规则的清理,就像文章编辑会检查语法错误和格式问题一样,去除那些明显不合理的内容。第二轮使用Qwen3语言模型进行智能优化,这一步就像请一位资深编辑重新润色文章,不仅纠正错误,还会改善语言表达,使描述更加自然流畅。

最终,这套系统为FFHQ和CelebA-HQ两个主要人脸数据集的十万张图片生成了一百万条高质量描述,每张图片对应十种不同风格的描述文字。这些描述不仅内容丰富详细,还严格控制在77个词以内,确保与现有文本编码器的兼容性。

三、模型架构的精巧设计

MMFace-DiT的架构设计可以比作一座现代化的智能工厂,其中有两条主要的生产线并行工作,最终生产出高质量的人脸图像产品。这座工厂的特殊之处在于,两条生产线不是独立运作的,而是在每个关键环节都会进行信息交换和协调。

整个系统建立在Transformer架构的基础上,包含28个处理模块,总参数量达到13.45亿个。这个规模相当于一座拥有十亿多个精密零件的复杂机械装置。每个模块都像一个专门的工作站,负责理解和处理输入信息的不同方面。

系统的输入处理颇具巧思。图像信息首先通过VAE编码器转换到一个压缩的潜在空间,这就像将一幅复杂的油画转换成更简洁但保持核心信息的素描。文字信息则通过CLIP文本编码器转换成数字向量,这个过程类似于将诗歌翻译成数学语言,虽然表现形式完全不同,但语义内容得以保留。

双流架构的核心在于共享的旋转位置编码注意力机制。这个机制就像一个智能的交通管制系统,能够协调来自不同方向的信息流。图像信息使用2D轴向位置编码,能够精确理解每个像素在二维空间中的位置关系;文字信息使用1D顺序位置编码,理解词语在句子中的先后顺序。当这两种信息在注意力层相遇时,系统能够建立起文字描述与图像区域之间的精确对应关系。

自适应层归一化机制充当着整个系统的指挥中心。它接收来自时间步、文本内容和模态类型的全局信息,然后为每个处理模块生成专门的调节参数。这就像一位经验丰富的乐队指挥,能够根据不同乐章的要求,精确控制每个乐器的演奏强度和节奏。

门控残差连接则像一套智能的信息过滤系统。在每个处理阶段,它都会评估新生成的信息是否有用,然后决定保留多少新信息,继承多少原有信息。这种机制防止了某种模态的信息过度主导整个生成过程,确保文字和图像信息能够平衡地影响最终结果。

四、训练方法的双重策略

MMFace-DiT采用了两种不同的训练范式,就像培养一位艺术家时采用古典派和现代派两种教学方法。每种方法都有其独特的优势,共同造就了系统的强大能力。

第一种方法基于去噪扩散概率模型,这是目前图像生成领域的经典方法。这种训练方式可以比作教学生学习"图像考古"——给学生一张被噪声严重破坏的图片,要求他们逐步去除噪声,最终恢复出清晰的原图。通过无数次这样的练习,模型学会了理解图像的本质结构,知道什么是有意义的内容,什么是无关的干扰。

为了优化训练效果,研究团队采用了最小信噪比加权策略。这个策略就像调整练习的难度曲线,确保模型在学习过程中能够平衡地掌握处理不同噪声水平的能力。通过这种方式,模型既能处理轻微损坏的图像,也能从严重破损的图像中恢复出高质量结果。

第二种方法基于修正流匹配,这是一种更加现代的训练理念。这种方法可以比作教学生学习"时间旅行"——给学生展示从随机噪声到完整图像的变化过程,要求他们学会预测这个变化的方向和速度。这种训练方式更加直接高效,能够让模型更快地理解图像生成的本质规律。

两种训练方法的结合使用体现了研究团队的深思熟虑。实验结果表明,虽然两种方法都能训练出优秀的模型,但修正流匹配方法在图像质量方面表现更佳,特别是在生成细节丰富、色彩自然的人脸图像方面具有明显优势。

训练过程采用渐进式策略,首先在256×256分辨率上训练300个回合,然后在512×512分辨率上精调50个回合。这种策略就像学画画时先练习小幅作品,熟练后再挑战大尺寸创作。渐进式训练不仅提高了训练效率,还确保了模型在不同分辨率下都能保持优秀的表现。

五、实验结果的突破性表现

为了验证MMFace-DiT的效果,研究团队进行了全面的对比实验,就像举办一场人脸生成技术的奥林匹克竞赛。他们选择了六个最先进的竞争方法,包括TediGAN、ControlNet、Unite and Conquer等知名系统,在相同的测试条件下进行公平比较。

实验结果令人印象深刻。在最重要的图像质量指标FID(越低越好)方面,MMFace-DiT的扩散版本达到了27.95,相比最强竞争对手UAC的48.88,实现了42.8%的显著提升。而流匹配版本的表现更加优异,FID值低至16.63,展现了近乎完美的图像生成质量。

在文本对齐度方面,MMFace-DiT同样表现卓越。CLIP分数达到31.69,比ControlNet高出24.8%,这意味着生成的图像能够更准确地反映用户的文字描述。语义一致性评分也达到了0.6372,远超其他方法,说明系统生成的图像不仅在表面特征上匹配文字描述,在深层语义理解上也更加准确。

特别值得注意的是,在草图条件生成任务中,MMFace-DiT的优势更加明显。流匹配版本的FID值达到了惊人的9.14,相比最强竞争对手MM2Latent的40.91,实现了77.6%的巨大提升。这个结果表明,系统在处理线条艺术等抽象视觉输入方面具有独特的优势。

结构保持能力的测试结果也令人满意。在像素准确度和平均交并比等指标上,MMFace-DiT都取得了最佳成绩,说明生成的图像能够严格遵循输入的空间约束,不会出现"张冠李戴"的情况。

定性分析展示了更多有趣的细节。在处理复杂的文字描述时,比如"佩戴金色耳环的高髻女性",MMFace-DiT能够准确渲染出每一个细节,包括耳环的材质光泽和发型的精致结构。而其他方法往往会遗漏某些重要特征,或者在特征组合上出现不合理的情况。

六、技术细节的深入解析

研究团队进行了详尽的消融实验,就像拆解一台精密机器来研究每个零件的作用。这些实验揭示了MMFace-DiT各个组件的重要性和贡献程度。

模态嵌入器的作用出乎意料地重要。当去掉这个组件时,模型需要为每种输入类型单独训练,这不仅增加了计算成本,还降低了系统的通用性。加入模态嵌入器后,FID值改善了9.1%,mIoU提升了3.3%,证明了这个看似简单的组件具有重要价值。

双流架构的优势在对比中更加明显。相比传统的单流处理方式,双流设计让CLIP分数提升了22.1%,mIoU改善了5.5%。这说明并行处理文字和图像信息确实能够带来实质性的性能提升,而不只是理论上的优势。

旋转位置编码的引入进一步提升了系统性能,特别是在空间结构保持方面表现突出,mIoU达到了50.05的高水平。这个结果证实了精确位置编码对于人脸生成任务的重要性。

VAE选择的实验揭示了一个有趣的发现。虽然SD3 VAE在FID指标上表现最佳,但其生成的图像往往呈现不自然的光泽感,影响视觉真实感。相比之下,Flux VAE在各项指标上达到了最佳平衡,既保证了统计质量,又确保了感知真实性。

训练策略的对比显示,修正流匹配方法在几乎所有指标上都优于传统的扩散训练方法。特别是在草图条件生成任务中,流匹配版本的FID值比扩散版本低了67%,这个差异足以改变用户的使用体验。

数据增强的效果同样不容忽视。使用VLM生成的丰富描述文字训练的模型,在各项指标上都明显优于使用原始简单标签训练的版本。这证明了高质量训练数据对于多模态生成任务的关键作用。

七、实际应用的广阔前景

MMFace-DiT技术的应用前景极其广阔,几乎可以革命性地改变多个行业的工作方式。在娱乐产业中,这项技术可以大幅降低角色设计的成本和时间。游戏开发者只需提供简单的草图和文字描述,就能快速生成各种风格的角色形象,从写实到卡通,从现代到古典,都能轻松应对。

广告和营销领域同样受益匪浅。品牌方可以根据不同市场的需求,快速生成符合当地审美和文化特色的代言人形象。这种灵活性使得品牌能够在全球范围内进行精准的本土化营销,而无需承担高昂的模特费用和拍摄成本。

在教育和培训领域,这项技术可以创造出更加生动的学习材料。历史课程可以"复原"古代人物形象,语言学习可以生成不同民族特征的虚拟教师,医学教育可以创建各种病例的患者形象进行模拟训练。

艺术创作领域的应用更是令人兴奋。艺术家们可以将这项技术作为创作助手,快速将脑海中的想法转化为初步的视觉形象,然后在此基础上进行进一步的艺术加工。这种人机协作的创作模式可能催生出全新的艺术表现形式。

社交媒体和虚拟现实应用也将迎来新的可能性。用户可以创建个性化的虚拟形象,这些形象不仅外观逼真,还能准确反映用户的审美偏好和个性特征。在虚拟世界中,人们可以以全新的身份进行社交互动,拓展现实生活的边界。

然而,这项技术的强大能力也带来了伦理和社会责任方面的考虑。如何防止恶意使用,如何保护个人肖像权,如何确保生成内容的多样性和包容性,这些都是需要认真对待的重要议题。研究团队强调,技术开发必须与相应的伦理框架和使用规范同步进行,确保创新成果能够造福社会而不是带来伤害。

归根结底,MMFace-DiT代表了人工智能在理解和生成人类面部图像方面的重大突破。它不仅在技术指标上创造了新的纪录,更重要的是展示了多模态人工智能的巨大潜力。随着技术的不断完善和应用的深入探索,我们有理由相信,这项技术将为人类的创造力插上新的翅膀,开启一个更加丰富多彩的数字世界。

Q&A

Q1:MMFace-DiT是什么技术?

A:MMFace-DiT是北德克萨斯大学开发的AI人脸生成系统,它能同时理解文字描述和图像输入(如草图、分割图),然后生成高质量的逼真人脸照片。就像一位既能听懂你描述又能看懂你草图的画师,能将两种信息完美融合创作出令人惊艳的肖像。

Q2:MMFace-DiT和其他AI绘画工具有什么区别?

A:主要区别在于MMFace-DiT采用了独特的双流处理架构,能同时处理文字和图像两种输入信息,而大多数现有工具只能处理其中一种。这使得它能避免信息冲突,生成既符合文字描述又遵循图像结构的高质量结果,在图像质量指标上比最强竞争对手提升了42.8%。

Q3:普通人能使用MMFace-DiT技术吗?

A:目前MMFace-DiT还处于研究阶段,研究团队承诺将公开代码和数据集供学术研究使用。虽然普通消费者暂时无法直接使用,但这项技术为未来的商业化应用奠定了基础,预计将在游戏开发、广告制作、艺术创作等领域发挥重要作用。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献100条内容

已为社区贡献100条内容

所有评论(0)