python项目实战07-DeepSeek调用测试(本地部署)

前言:

1.AI: 人工智能(Artificial Intelligence),是一个学科领域的统称,目标就是使机器能够像人类一样思考、学习、推理和解决问题。

2.AI大模型:也称为大语言模型(Large Language Models, LLM),是AI技术的一个分支。其实就是一个用代码模拟人脑神经网络的程序(参数量极其庞大,通常达到数十亿至数千亿级别),通过大量的数据训练后,使其具备理解人类语言、思考、推理并输出人类语言的能力。

3.AI应用:是指将AI大模型技术落地到具体的业务场景中,用来解决实际问题的产品或者服务。

4.大模型部署

API:应用程序编程接口(Application Programming Interface),是软件间的标准化的 "桥梁",允许开发者无需知晓内部细节即可调用外部功能或数据。

5.Ollama是一个在本地运行、管理大语言模型的工具。官网:https://ollama.com/。主流的大模型(如:DeepSeek、Kimi等)官方都提供了开放API,无需部署,就可以直接调用访问。

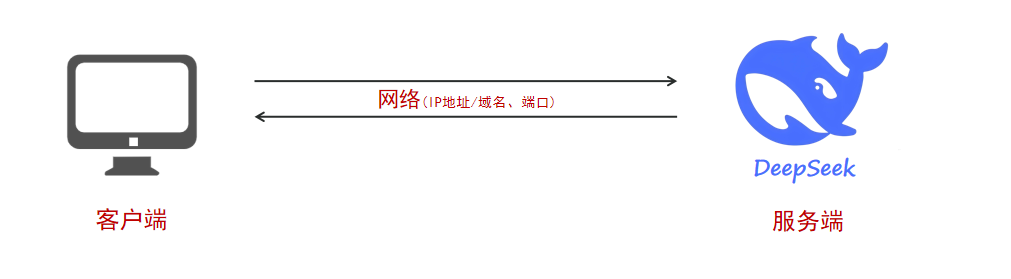

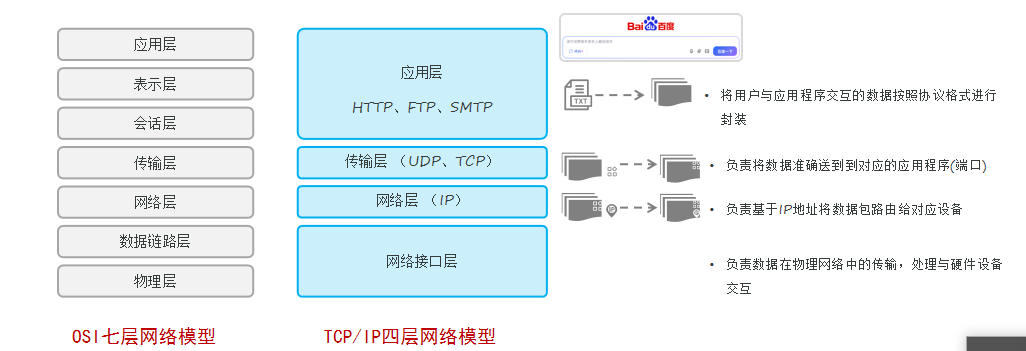

(1)网络模型

互联网(Internet)连接了数以亿计的设备,网络四通八达就如同时城市的复杂的道路。网络中传输的数据就像是城市道路中的车流,如果不加以管理那必然会出现混乱。在国际ISO组织就统一了程序在网络中通信的模型和标准。包括: OSI网络模型:全球网络互连标准模型 TCP/IP网络模型:可以认为是OSI的简化版

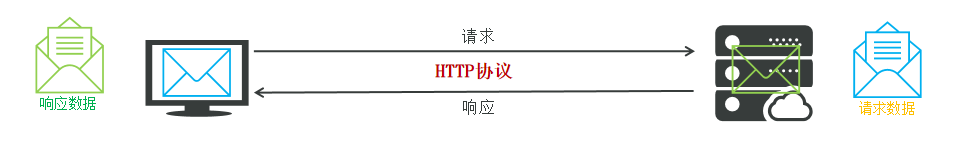

(2)HTTP协议

概念:Hyper Text Transfer Protocol,超文本传输协议,规定了客户端和服务器之间数据传输的规则。(只有在请求及响应中都遵循了统一的规则,服务端才能读懂客户端发送来的请求,客户端才能解析服务端响应的结果)

特点: 基于文本的协议:请求和响应的部分的协议内容为文本格式,底层通过TCP协议传输,稳定性强。 基于请求-响应模型:一次请求对应一次响应,必须由客户端先发起请求,服务端才会返回响应。 无状态:服务端不会记忆与客户端的历史交互信息,每次请求-响应都是独立的。

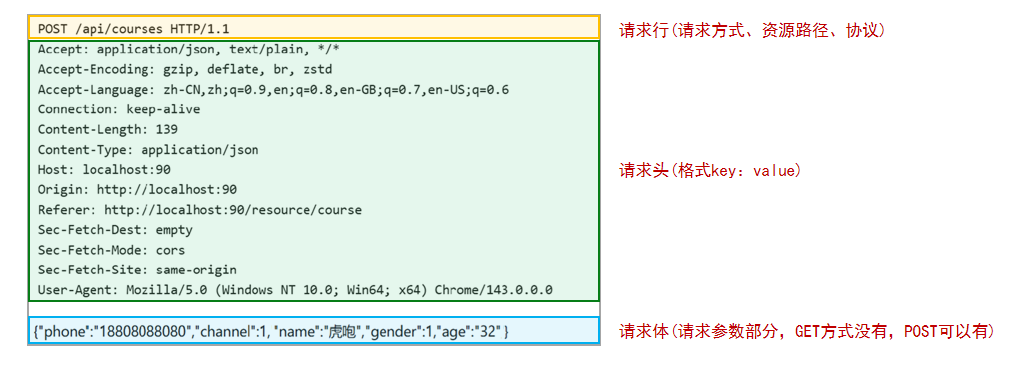

3.HTTP协议-请求数据格式

请求方式:

GET: 请求参数在请求行中,没有请求体。如:/api/courses?name=Python&status=1 。GET请求请求参数大小在浏览器中是有限制的。

POST: 请求参数在请求体中,POST请求大小是没有限制的。

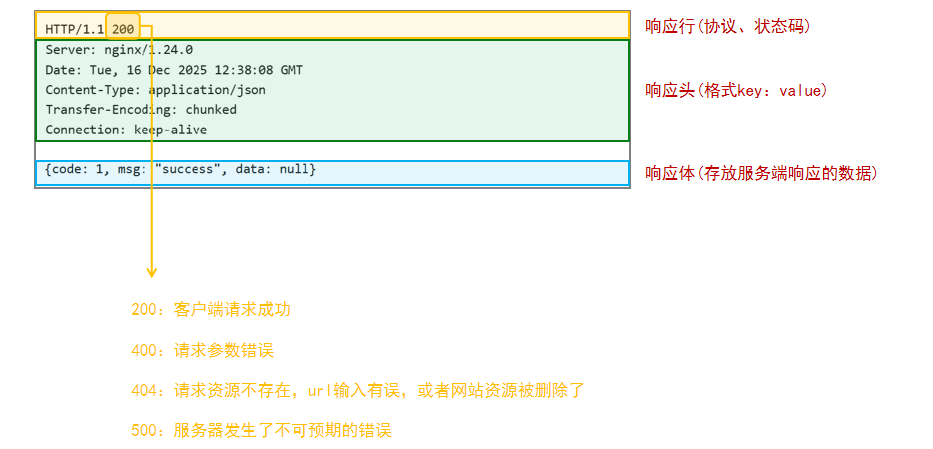

4.HTTP协议-响应数据格式

本地部署

1.首先,我们需要下载一个Ollama的客户端,在官网提供了各种不同版本的Ollama,大家可以根据自己的需要下载,下载地址:Ollama

2.默认安装

下载后双击即可安装,这里不再赘述。 默认Ollama是安装在C盘中的,具体的安装位置如下:

(1) 默认安装后的目录:C:\Users\用户名\AppData\Local\Programs\Ollama

(2) 默认安装的模型目录:C:\Users\用户名\ .ollama

(3) 默认的配置文件目录:C:\Users\用户名\AppData\Local\Ollama

3.自定义安装

Ollama默认安装目录是C盘的用户目录,如果不希望安装在C盘的话(其实C盘如果足够大放C盘也没事),就不能直接双击安装了。需要通过命令行安装。

(1) 命令行安装方式如下

在 OllamaSetup.exe 所在目录打开cmd命令行,然后命令如下:

OllamaSetup.exe /DIR=你要安装的目录位置

比如:

OllamaSetup.exe /DIR=D:/develop/ollama

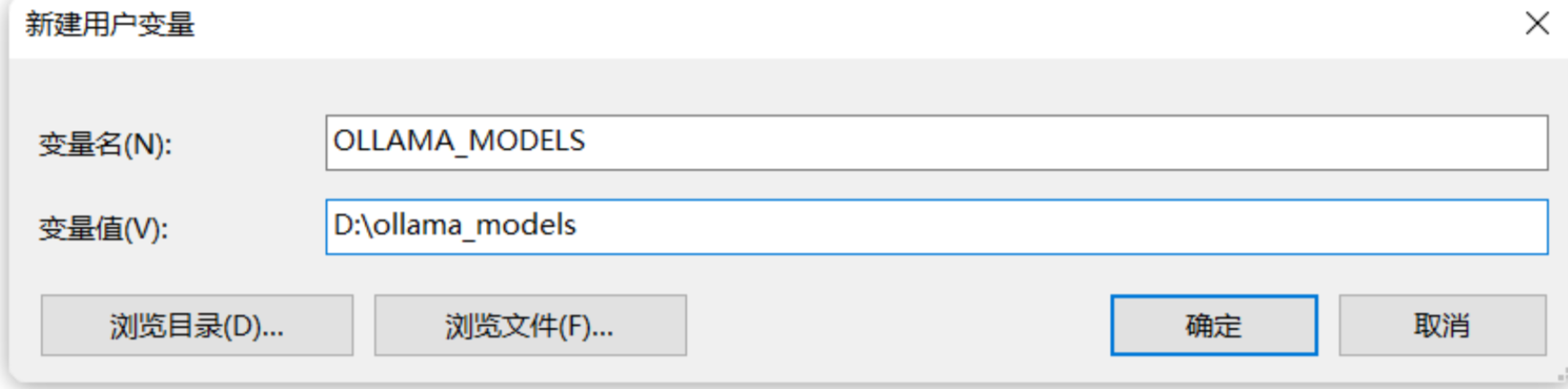

(2) 配置环境变量

安装完成后,还需要配置一个环境变量,更改Ollama下载和部署模型的位置。环境变量如下:

OLLAMA_MODELS=你想要保存下载的模型的目录

环境变量配置方式,和之前配置的方式是一致的,这里不再赘述,配置完成如图:

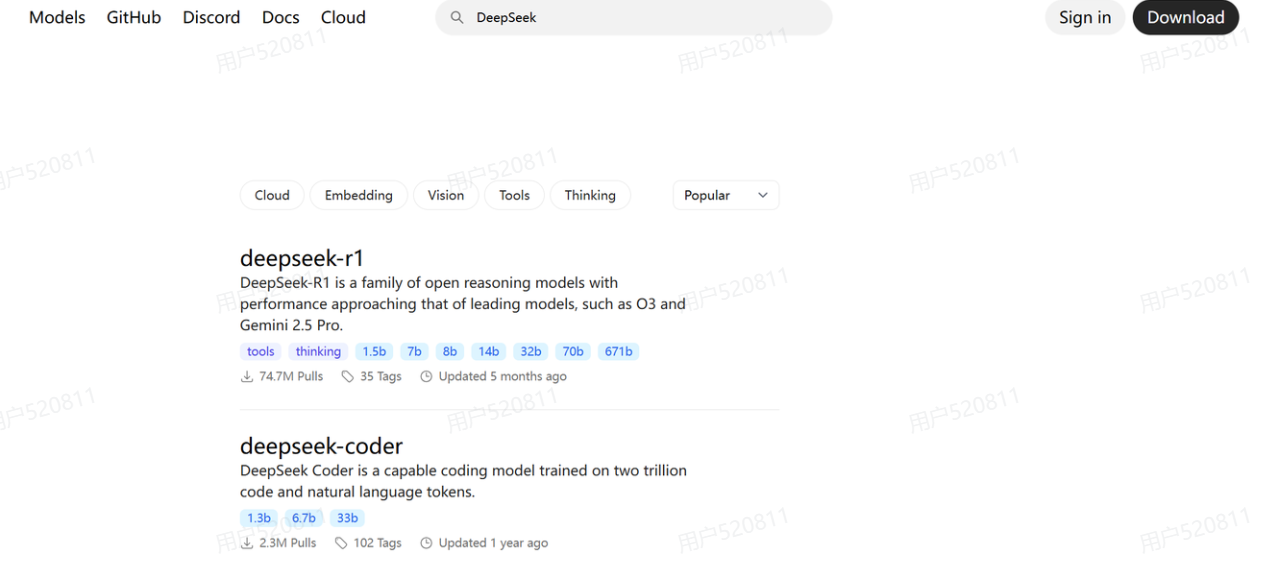

4.查找模型

ollama是一个模型管理工具和平台,它提供了很多国内外常见的模型,我们可以在其官网上搜索自己需要的模型:https://ollama.com/search

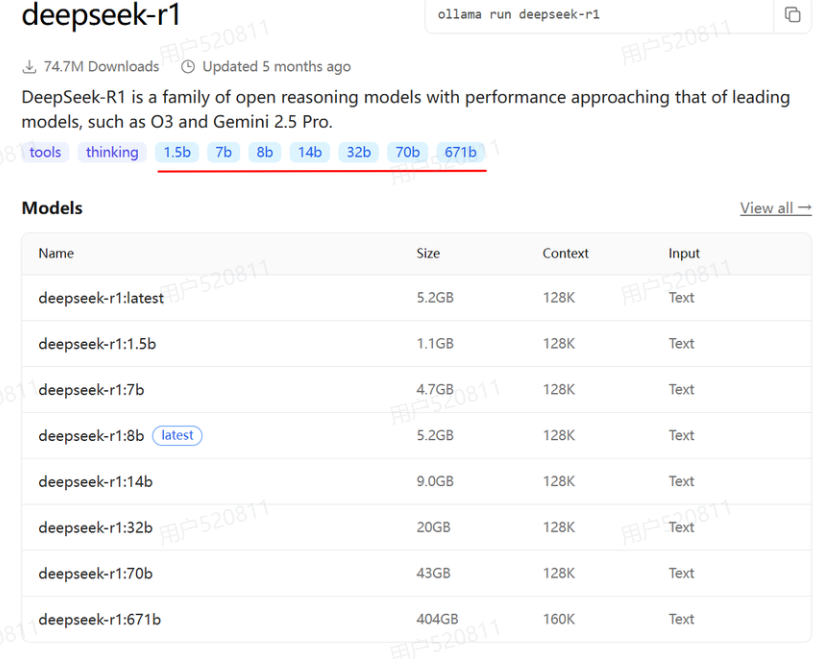

点击进入deepseek-r1页面,会发现deepseek-r1也有很多版本:

比如:1.5b,7b,8b,14b,32b,70b,671b。这些就是模型的参数大小,越大推理能力就越强,需要的算力也越高。671b版本就是最强的满血版deepseek-r1了。需要注意的是,Ollama提供的DeepSeek是量化压缩版本,对比官网的蒸馏版会更小,对显卡要求更低。对比如下:

比如电脑内存32G,显存是8G,选择部署的是8b的模型,当然7b也是可以的,差别不大,都是可以流畅运行的。

5.运行模型

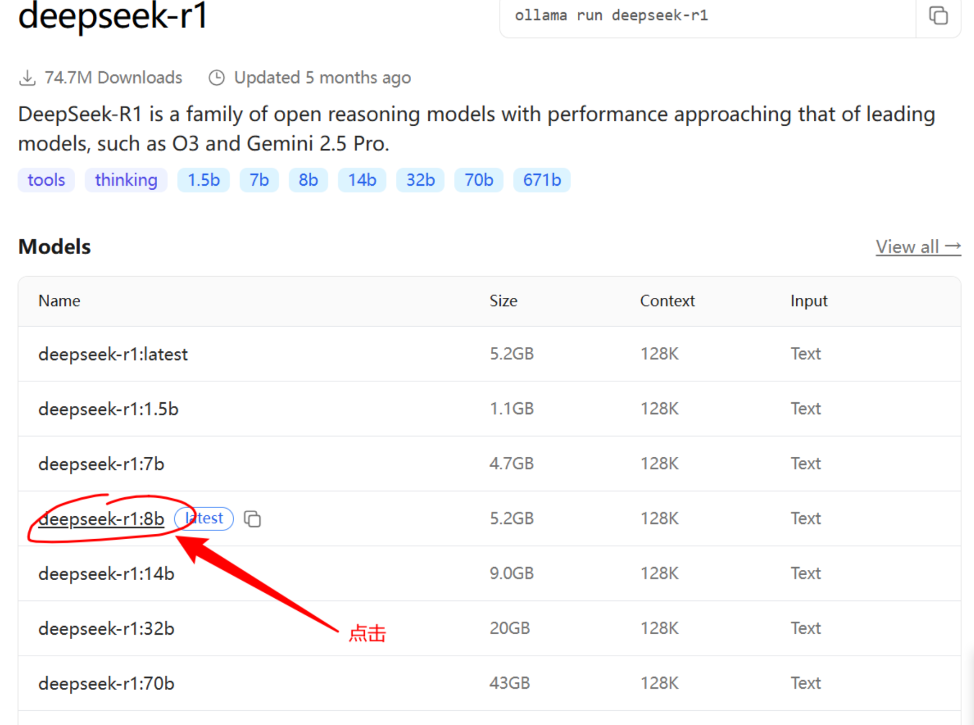

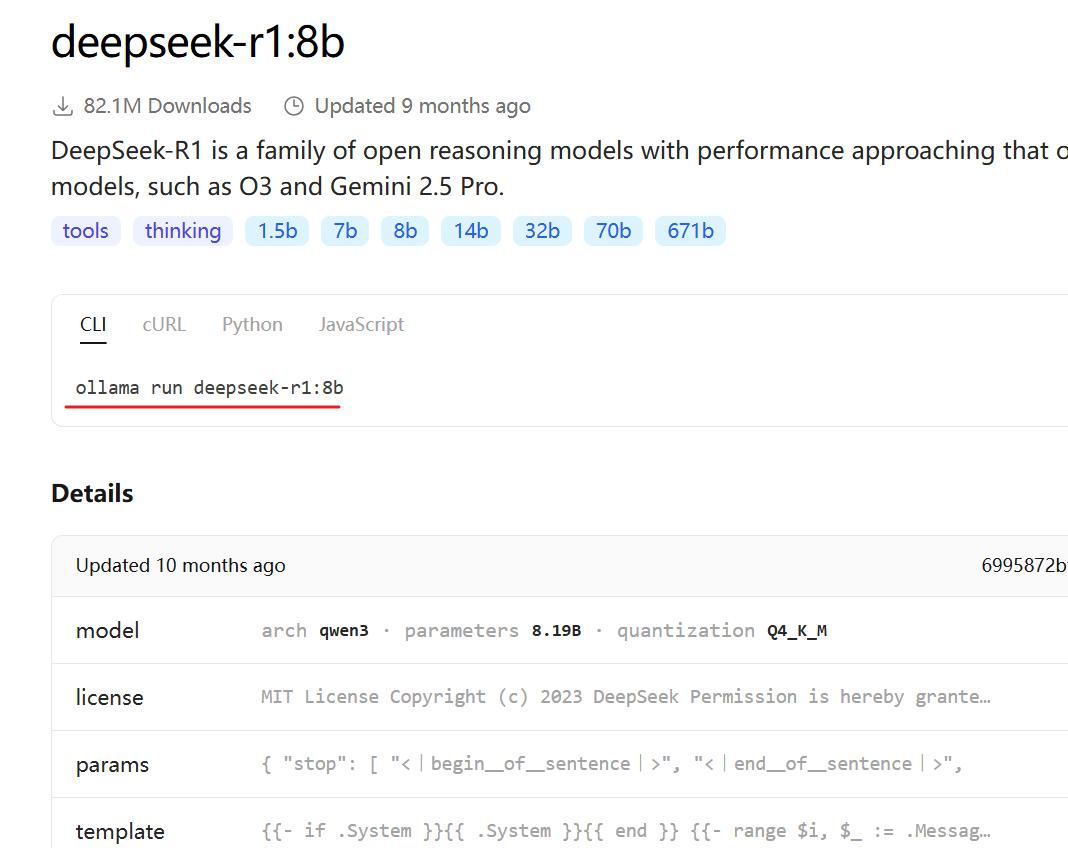

选择自己合适的模型后,点击对应的链接。

ollama会给出运行模型的命令:

注意:

(1) 首次运行命令需要下载模型,根据模型大小不同下载时长在5分钟~1小时不等,请耐心等待下载完成。

(2) ollama控制台是一个封装好的AI对话产品,与ChatGPT、DeepSeek官方提供的对话产品类似,具备会话记忆功能。

Ollama是一个模型管理工具,所有的命令如下:

-

ollama serve# 启动Ollama -

ollama create# 创建模型 -

ollama show# 查看模型的详细信息 -

ollama run# 运行一个模型 -

ollama stop# 停止正在运行的模型 -

ollama pull# 推送一个模型到远端 -

ollama push# 拉取(下载)一个模型 -

ollama list# 列出所有的模型 -

ollama ps# 列出正在运行的模型 -

ollama cp# 拷贝模型 -

ollama rm# 删除模型 -

ollama help# 查看帮助文档

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)