OpenClaw Agent 运行时:pi-mono 嵌入式设计

第一章:引言

在人工智能助手领域,Agent 运行时是连接大语言模型与真实世界的核心桥梁。一个优秀的 Agent 运行时不仅需要高效地处理用户请求,还需要具备出色的上下文管理能力、工具编排灵活性以及流式响应的用户体验。OpenClaw 作为一款开源的个人 AI 助手框架,其 Agent 运行时采用了独特的 pi-mono 嵌入式设计,在保持轻量级架构的同时,实现了企业级的功能完整性。

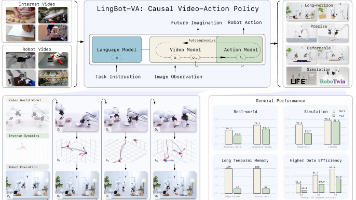

图 1-01

本文将深入剖析 OpenClaw Agent 运行时的核心技术实现,详细阐述其架构设计理念、上下文管理机制、流式响应原理以及工具编排决策流程。通过对这些关键技术点的深入分析,读者将能够全面理解 pi-mono 嵌入式设计的精髓,并将其设计思想应用于自己的 Agent 开发实践中。

OpenClaw 的设计哲学强调本地优先(Local-first)和嵌入式运行。与传统的云端 Agent 服务不同,OpenClaw 的 Agent 运行时可以直接运行在用户的个人设备上,通过嵌入式集成方式与 Gateway 进行通信。这种设计不仅保障了用户数据的隐私安全,还大大降低了服务部署的复杂度,使每个用户都能拥有完全自主可控的 AI 助手。

第二章:Agent 运行时架构溯源

2.1 架构设计理念

说明:以下架构分层是基于官方 Gateway 架构文档归纳的概念模型,非官方命名标准。官方术语请参考 docs.openclaw.ai/concepts/architecture。

OpenClaw Agent 运行时的核心架构采用了 pi-mono 嵌入式集成方式。pi-mono 是由 Mario Zechner 开发的 AI 编码代理 SDK,OpenClaw 通过嵌入式集成将其 agent 能力嵌入到 Gateway 架构中。pi-mono 提供了 createAgentSession()、SessionManager、ModelRegistry 等核心 API,使 OpenClaw 能够直接实例化 pi 的 AgentSession,而非通过子进程或 RPC 方式运行。

图 2-01

在 OpenClaw 的实现中,pi-mono 嵌入式设计主要体现在以下几个层面:

第一层:通信层。OpenClaw 采用 WebSocket 作为主要的通信协议,建立 Gateway 与 Agent 之间的长连接。这种通信方式不仅支持全双工数据传输,还能够维持长时间的会话状态,非常适合交互式 AI 应用场景。Gateway 作为控制平面,负责管理所有会话、通道、工具和事件的协调工作。

第二层:会话层。会话(Session)是 OpenClaw 的核心抽象单元。每个会话代表一次独立的 AI 对话上下文,包含完整的对话历史、工具调用状态和用户偏好设置。会话支持多种激活模式,包括直接对话(main)、群组隔离(group isolation)以及按需激活(activation modes)等。

第三层:Agent 核心层。这一层负责处理用户请求的核心逻辑,包括请求类型识别、语言模型调用、上下文管理和响应生成。Agent 核心层采用事件驱动的架构,通过发布 - 订阅模式实现各模块间的解耦通信。

第四层:工具层。工具层封装了所有外部能力的抽象接口,包括浏览器控制、Canvas 渲染、文件系统操作、系统命令执行等。每个工具都遵循统一的接口规范,使得新增工具变得简单快捷。

2.2 嵌入式集成运行机制

OpenClaw Agent 运行时采用 嵌入式集成模式运行,这是 pi-mono 嵌入式设计的核心特征。在这种模式下,Agent 通过 runEmbeddedPiAgent() 函数直接实例化并运行,与 Gateway 共享同一进程空间。

// OpenClaw 嵌入式 Pi agent 调用示例(真实 API)

// 参考:docs/pi.md 第 41-55 行

import { runEmbeddedPiAgent } from "./agents/pi-embedded-runner.js";

const result = await runEmbeddedPiAgent({

sessionId: "user-123",

sessionKey: "main:whatsapp:+1234567890",

sessionFile: "/path/to/session.jsonl",

workspaceDir: "/path/to/workspace",

prompt: "Hello, how are you?",

provider: "anthropic",

model: "claude-sonnet-4-20250514",

timeoutMs: 120_000,

runId: "run-abc",

});

注意:以下代码示例为示意代码,展示概念流程,非 OpenClaw 真实 API。

// 以下为示意代码,展示概念流程,非 OpenClaw 真实 API

// RPC 模式连接建立示例(示意)

const agent = new PiAgent({

gatewayUrl: 'ws://127.0.0.1:18789',

sessionId: 'main',

model: 'anthropic/claude-opus-4-6'

});

agent.on('message', (msg) => {

console.log('Received:', msg);

});

await agent.connect();

这种架构设计带来了显著的优势。首先,Agent 的故障不会影响 Gateway 的稳定运行,实现了故障隔离。其次,开发者可以在不同的环境中独立开发和调试 Agent,只需确保接口的兼容性即可。最后,嵌入式模式支持横向扩展,可以通过启动多个 Agent 实例来分担负载,提升系统的吞吐能力。

第三章:上下文管理机制

3.1 上下文管理的重要性

在 AI 对话系统中,上下文管理是决定用户体验的关键因素。一个优秀的上下文管理系统需要解决三个核心问题:记忆什么、如何记忆、何时回忆。OpenClaw 通过精心设计的上下文管理机制,优雅地解决了这些问题。

图 3-01

3.2 Session History 与上下文裁剪

OpenClaw 的上下文管理系统采用了分层存储的策略,主要包含 Session History(会话历史)和 Context Pruning(上下文裁剪)两个核心机制。

术语说明:本文使用的"短期记忆"、"长期记忆"等术语是为便于理解而采用的概念性描述,官方术语请参考 docs/concepts/session.md。

Session History(会话历史) 主要存储近期的对话历史,这是大语言模型理解当前对话上下文的基础。Session History 采用滑动窗口机制,自动保留最近 N 轮对话内容,并根据模型的最大上下文长度动态调整。当新的对话轮次添加时,系统会自动移除最旧的对话内容,确保上下文始终保持在模型的处理能力范围内。

注意:以下代码示例为示意代码,展示概念流程,非 OpenClaw 真实 API。

// 以下为示意代码,展示概念流程,非 OpenClaw 真实 API

// Session History 管理示例

class ShortTermMemory {

private messages: Message[] = [];

private maxTokens: number = 128000;

addMessage(role: 'user' | 'assistant', content: string) {

this.messages.push({ role, content, timestamp: Date.now() });

this.prune();

}

private prune() {

// 根据 token 数量进行裁剪

while (this.getTokenCount() > this.maxTokens) {

this.messages.shift();

}

}

getContext(): Message[] {

return [...this.messages];

}

}

Context Pruning(上下文裁剪) 用于处理需要跨会话持久化的信息。根据官方文档 docs/concepts/session-pruning.md,OpenClaw 的裁剪机制主要针对 tool results 进行裁剪,而非文章之前描述的"语义分块、重要性评估"等流程。

3.3 Compaction(会话压缩)

当对话历史过长时,直接将所有内容注入模型会导致两个问题:超过模型的最大上下文长度,以及过多的无关信息降低模型的回答质量。为此,OpenClaw 实现了 Compaction(会话压缩) 组件,对原始上下文进行智能处理。

图 3-02

Compaction 的工作流程主要包括:

- 摘要生成:对于必须压缩的长段落,使用摘要模型生成简洁的摘要替代原始内容。

- 选择性保留:根据对话的重要性,优先保留高重要性的内容。

- 上下文注入:压缩后的上下文通过系统提示词前缀传递给语言模型。

说明:官方文档中 Compaction 的具体实现细节请参考 docs/concepts/session-pruning.md。

第四章:流式响应实现原理

4.1 流式响应的技术优势

传统的 AI 响应模式是阻塞式的:用户发送请求后,需要等待模型完成全部内容的生成,才能收到响应。这种模式在处理长文本生成时会导致糟糕的用户体验——用户面对着一片空白的屏幕,无法知道模型是否正在工作,也无法预估等待时间。

图 4-01

**流式响应(Streaming Response)**技术的出现彻底改变了这一局面。通过将响应内容切分为多个小块(chunks),并通过 WebSocket 实时推送给客户端,用户可以即时看到模型正在生成的内容,交互体验大大提升。流式响应不仅改善了感知延迟,还为实现打字机效果、实时内容展示等高级交互模式奠定了基础。

4.2 OpenClaw 的流式架构

OpenClaw 的流式响应实现采用了双层流架构:工具流(Tool Streaming)和块流(Block Streaming)。这种设计使得用户不仅可以看到文本内容的实时生成,还能观察到工具调用的执行过程。

块流(Block Streaming)是 OpenClaw 的核心创新之一。在传统的流式响应中,内容是以原始 token 序列的形式传输的,客户端需要自行处理分词、断句等逻辑。OpenClaw 引入的块流机制,将响应内容组织为结构化的块(Blocks),每个块可以是一个文本段落、代码片段、工具调用或其他语义单元。

注意:以下代码示例为示意代码,展示概念流程,非 OpenClaw 真实 API。

// 以下为示意代码,展示概念流程,非 OpenClaw 真实 API

// 块流处理示例

agent.on('block', (block: Block) => {

switch (block.type) {

case 'text':

displayText(block.content);

break;

case 'tool_call':

displayToolProgress(block.toolName, block.args);

break;

case 'code':

highlightCode(block.content, block.language);

break;

}

});

**工具流(Tool Streaming)**则允许工具调用的中间结果实时回传。当 Agent 调用一个耗时较长的工具(如网页抓取、文件处理)时,工具可以将执行进度实时推送给客户端,让用户了解当前的处理状态。

4.3 流式响应的技术实现

OpenClaw 的流式响应基于 Server-Sent Events(SSE)或 WebSocket 实现。当语言模型开始生成内容时,运行时会启动一个流式处理器,将模型输出的 token 实时转发给客户端。

图 4-02

注意:以下代码示例为示意代码,展示概念流程,非 OpenClaw 真实 API。

// 以下为示意代码,展示概念流程,非 OpenClaw 真实 API

async function* streamResponse(prompt: string): AsyncGenerator<Chunk> {

const stream = await model.generate(prompt);

for await (const token of stream) {

const chunk = parseToken(token);

// 检测是否形成新的语义块

if (isBlockBoundary(chunk)) {

yield { type: 'block_end', blockId: currentBlockId };

currentBlockId = generateNewBlockId();

yield { type: 'block_start', blockId: currentBlockId };

}

yield { type: 'token', content: chunk };

}

}

真实配置示例(参考 docs/concepts/streaming.md 第 20-35 行):

// Block Streaming 配置示例(真实配置项)

{

agents: {

defaults: {

blockStreamingDefault: "on",

blockStreamingBreak: "text_end",

blockStreamingChunk: { minChars: 500, maxChars: 2000 }

}

}

}

通过这种设计,OpenClaw 实现了高效率、低延迟的流式响应能力,同时保持了架构的简洁性和可维护性。

第五章:工具编排决策流程

5.1 工具编排的核心职责

工具编排(Tool Orchestration)是 Agent 系统的核心能力之一。当用户请求需要执行特定操作时,Agent 需要决定使用哪个工具、如何传递参数、如何处理结果,这一系列决策过程就是工具编排。OpenClaw 的工具编排引擎采用了意图驱动 + 动态规划的混合策略,既能快速响应简单请求,也能优雅处理复杂的多步骤任务。

图 5-01

5.2 请求类型识别

工具编排的第一步是请求类型识别。OpenClaw 将用户请求分为两大类:工具调用请求和普通对话请求。这种二分法是整个编排流程的起点,决定了后续处理路径。

注意:以下代码示例为示意代码,展示概念流程,非 OpenClaw 真实 API。实际工具编排流程请参考 docs/concepts/agent-loop.md。

// 以下为示意代码,展示概念流程,非 OpenClaw 真实 API

// 请求类型识别逻辑

function classifyRequest(input: string): RequestType {

// 检查是否包含工具调用意图

if (containsToolKeywords(input) || matchesToolPattern(input)) {

return 'tool_invocation';

}

// 检查是否需要工具辅助

if (requiresExternalKnowledge(input) || requiresComputation(input)) {

return 'augmented_conversation';

}

// 默认为普通对话

return 'plain_conversation';

}

请求类型识别主要基于以下几种策略:

- 关键词匹配:识别用户输入中的明确意图词汇,如"搜索"、“计算”、"创建"等。

- 模式匹配:使用预定义的正则表达式匹配特定类型的请求。

- 语义分类:调用轻量级分类模型,对请求进行意图分类。

- 上下文推断:结合对话历史,推断当前请求的隐含意图。

5.3 工具选择与参数准备

对于工具调用请求,下一步是选择合适的工具并准备调用参数。OpenClaw 的工具注册表维护了所有可用工具的元信息,包括工具名称、功能描述、参数模式等。

图 5-02

注意:以下代码示例为示意代码,展示概念流程,非 OpenClaw 真实 API。

// 以下为示意代码,展示概念流程,非 OpenClaw 真实 API

// 工具调用参数准备

async function prepareToolCall(

toolName: string,

userInput: string,

context: Context

): Promise<ToolInvocation> {

const tool = toolRegistry.get(toolName);

// 从用户输入中提取参数

const rawArgs = extractArguments(userInput, tool.parameterSchema);

// 参数类型转换与验证

const validatedArgs = validateAndTransform(rawArgs, tool.parameterSchema);

// 注入上下文信息

const contextArgs = enrichWithContext(validatedArgs, context);

return {

tool: toolName,

arguments: contextArgs,

callId: generateCallId()

};

}

5.4 多工具编排策略

当单个工具无法满足用户需求时,OpenClaw 需要协调多个工具完成复杂任务。多工具编排采用**有向无环图(DAG)**的执行模型,根据工具间的依赖关系自动确定执行顺序。

图 5-03

注意:以下代码示例为示意代码,展示概念流程,非 OpenClaw 真实 API。

// 以下为示意代码,展示概念流程,非 OpenClaw 真实 API

// 多工具编排执行

async function orchestrateMultipleTools(

toolCalls: ToolInvocation[],

context: Context

): Promise<ToolResult[]> {

// 构建依赖图

const dependencyGraph = buildDependencyGraph(toolCalls);

// 拓扑排序确定执行顺序

const executionOrder = topologicalSort(dependencyGraph);

// 分批执行(支持并行执行的工具一起执行)

const batches = groupByDependencyLevel(executionOrder);

const results: ToolResult[] = [];

for (const batch of batches) {

// 并行执行同批次工具

const batchResults = await Promise.all(

batch.map(tool => executeTool(tool, context, results))

);

// 合并结果到上下文

for (const result of batchResults) {

context.mergeToolResult(result);

}

results.push(...batchResults);

}

return results;

}

这种编排策略确保了工具执行的正确性(依赖关系不被破坏)和高效性(无依赖工具并行执行)。

第六章:技术要点深度解析

6.1 RPC 通信协议的细节设计

OpenClaw Agent 运行时与 Gateway 之间的通信是整个系统的基础设施。在 WebSocket 之上,OpenClaw 设计了一套轻量级的通信协议,支持请求 - 响应模式、推送模式和流式模式三种通信方式。

说明:以下通信模式描述是基于官方协议文档归纳的,详细技术细节请参考 docs/concepts/architecture.md。

图 6-01

请求 - 响应模式用于需要等待结果的同步调用,如获取会话列表、查询配置信息等。客户端发送请求后,会阻塞等待服务端返回结果或超时。

****推送模式**用于服务端主动向客户端发送消息,如事件通知、错误告警等。这种模式不需要客户端主动发起请求,非常适合实现实时状态同步。

流式模式用于大数据量或长时间运行的操作,如流式响应、工具执行进度等。服务端通过持续发送数据块,客户端逐步处理,实现高效的实时通信。

6.2 会话状态管理

会话(Session)是 OpenClaw 的核心抽象,每个会话维护了独立的对话状态。会话状态管理涉及多个关键组件的协同工作:

图 6-02

消息历史:存储对话中的所有消息记录,包括用户输入、模型输出和系统消息。每条消息都包含时间戳、元数据和可选的思考过程(thinking)内容。

工具状态:跟踪当前会话中所有工具的调用状态,包括已调用的工具列表、调用参数和返回结果。工具状态支持回溯和重放,便于调试和错误恢复。

上下文快照:定期保存上下文的快照,用于会话恢复和上下文压缩。会话快照存储了完整的上下文信息,可以在需要时快速恢复到特定状态。

说明:会话状态实际存储于

~/.openclaw/agents/<agentId>/sessions/<SessionId>.jsonl文件中,而非内存结构体。参考 docs/concepts/session.md。

注意:以下代码示例为示意代码,展示概念流程,非 OpenClaw 真实 API。

// 以下为示意代码,展示概念流程,非 OpenClaw 真实 API

// 会话状态管理接口

interface SessionState {

sessionId: string;

messages: Message[];

toolCalls: ToolCall[];

contextSnapshot: ContextSnapshot;

metadata: SessionMetadata;

// 状态操作方法

addMessage(msg: Message): void;

addToolCall(call: ToolCall): void;

takeSnapshot(): ContextSnapshot;

restore(snapshot: ContextSnapshot): void;

}

6.3 错误处理与重试机制

在分布式系统中,网络波动、服务异常等情况在所难免。OpenClaw 实现了完善的错误处理与重试机制,确保系统的健壮性。

图 6-03

错误处理策略包括:

- 连接断开处理:当 WebSocket 连接断开时,自动尝试重新连接,并根据指数退避算法控制重试频率。

- 工具执行失败:工具执行失败时,根据错误类型决定是否重试。暂时性错误(如网络超时)会自动重试,永久性错误(如参数错误)则直接返回错误信息。

- 模型调用失败:模型调用失败时,尝试使用备用模型或返回缓存的响应。

6.4 安全性设计

作为处理用户请求的系统,安全性至关重要。OpenClaw 在架构设计中融入了多重安全机制:

图 6-04

输入验证:所有用户输入都会经过严格的验证,防止注入攻击和恶意请求。

工具权限控制:每个工具都可以配置权限要求,用户需要显式授权才能使用敏感工具(如执行系统命令、访问文件系统等)。

沙箱隔离:对于非可信会话(如群组对话),OpenClaw 支持在 Docker 沙箱中运行,提供更强的安全隔离。详细安全配置请参考官方安全文档:docs.openclaw.ai/gateway/security。

第七章:完整流程图解析

7.1 端到端请求处理流程

综合以上各章的内容,我们可以绘制出 OpenClaw Agent 运行时的完整请求处理流程:

图 7-01

步骤详解:

- 用户请求入口:用户通过任意渠道(WhatsApp、Telegram、Slack 等)发送消息。

- Gateway 接收:Gateway 接收消息并根据渠道和用户信息路由到对应的会话。

- 请求分类:Agent 运行时分析请求类型,判断是普通对话还是工具调用。

- 上下文准备:从上下文管理器获取当前会话的上下文信息,进行必要的压缩处理。

- 模型调用:将用户输入和上下文组合后发送给语言模型。

- 响应生成:模型生成响应内容,可能包含文本回复、工具调用或两者的组合。

- 工具执行:如果响应包含工具调用,调度相应的工具执行。

- 结果处理:工具执行完成后,将结果合并到上下文,并可能触发再次调用模型。

- 流式输出:将响应内容通过流式方式推送给用户。

- 状态持久化:更新会话状态,保存消息历史和工具调用记录。

7.2 关键路径分析

在完整流程中,有几个关键路径值得特别关注:

图 7-02

直接对话路径:适用于简单的问答场景,跳过工具编排步骤,直接由模型生成响应。

单工具调用路径:适用于需要外部信息的场景,如查询天气、搜索网页等。模型生成工具调用请求,执行工具后将结果注入上下文,再次调用模型生成最终响应。

多工具编排路径:适用于复杂任务场景,需要按照依赖关系协调多个工具的执行。每个工具的结果都会更新上下文,影响后续工具的执行。

第八章:总结与展望

8.1 技术要点回顾

本文深入解析了 OpenClaw Agent 运行时的 pi-mono 嵌入式设计,涵盖了以下核心技术要点:

- 架构设计:基于嵌入式集成模式,实现了故障隔离和水平扩展能力。

- 上下文管理:Session History 结合 Context Pruning 和 Compaction,确保模型始终获得高质量的上下文信息。

- 流式响应:创新的块流机制,提供了丰富的实时交互能力。

- 工具编排:意图驱动的决策流程,配合 DAG 执行模型,优雅处理复杂任务。

- 安全机制:多层次的安全防护,确保系统安全可靠。

8.2 未来发展方向

随着 AI 技术的快速发展,Agent 运行时的能力边界也在不断扩展。OpenClaw 的 pi-mono 设计为后续的功能演进提供了良好的架构基础。未来的发展方向可能包括:

- 多模态能力增强:支持图像、音频、视频等多种模态的输入输出

- 长期记忆系统:构建更强大的知识图谱,实现跨会话的个性化学习

- 协同工作流:支持多个 Agent 之间的协作,共同完成复杂任务

- 边缘计算优化:进一步优化运行时性能,支持更低资源消耗的部署场景

OpenClaw 的 pi-mono 嵌入式设计代表了现代 Agent 运行时的一个重要方向。通过平衡功能性与轻量性、复杂性与可维护性、安全性与易用性,OpenClaw 为开发者提供了一个可靠的技术基础,也为终端用户带来了卓越的 AI 助手体验。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)