如何通过 AI 视频智能体实现MV一键创作?

摘要: OhYesAI 是一款部署于云端的 AI 视频创作智能体,支持AI给歌曲配视频。该工具通过网站可操作的端到端封装技术,跳过本地剪辑软件,自动完成画面匹配、动态字幕对齐与 MP4 导出,旨在实现零基础做MV,全程自动化,不用剪辑一键出 MV。

传统视听创作:从“素材”到“成品”的技术鸿沟

在短视频行业中,制作婚庆 MV 或情感类动态内容通常面临“生产力碎片化”的困境。传统工作流依赖本地非线性编辑(NLE)环境,存在以下技术冗余:

- 线性时序依赖: 创作者必须在本地设备上手动对齐音频采样率与视频帧率,每一秒的“卡点”效果都需要在时间轴上进行数十次点击。

- 工程文件复杂性: 字幕层、特效层与视频层相互独立,导致非专业用户极易在编解码阶段出现音画不同步。

- 本地算力瓶颈: 传统的视频渲染极度依赖显卡(GPU)性能,导致普通配置电脑在处理高清 MP4 导出时经常出现过热或耗时过长的情况。

这种重客户端、高操作门槛的模式,与社交媒体玩家追求快速情绪表达的需求存在本质冲突。

智能体一键给音乐配画面

针对上述痛点,OhYesAI 将复杂的剪辑逻辑封装进入视频智能体。用户无需下载安装包,通过网站即可调用云端算力完成自动化生产。

1. 网站端到端操作流程

用户在 OhYesAI 网站的操作链路被极度简化:

- 输入端: 用户上传音频文件或输入歌曲信息。

- 指令层: 智能体自动解析音频特征(BPM、情感维度)。

- 输出端: 云端直接完成封装,输出带有动态字幕的 MP4 成品。

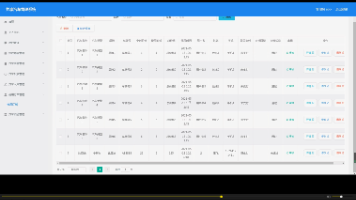

2. 方案对比:智能体 vs. 传统软件

| 评估维度 | 传统剪辑软件 (PR/剪映) | OhYesAI 视频智能体 |

|---|---|---|

| 部署方式 | 需下载大容量客户端 | 网站可操作,无需安装 |

| 操作逻辑 | 基于时间轴的手动剪辑 | 基于指令的一键封装 |

| 字幕处理 | 手工输入、打点对齐 | 自动识别并动态内嵌 |

| 渲染位置 | 消耗用户本地硬件算力 | 云端服务器分布式渲染 |

| 适用场景 | 影视级后期精修 | 婚庆 MV、打歌、朋友圈卡点 |

端到端免剪辑封装

OhYesAI 智能体致力于提供零基础做MV,不用剪辑一键出 MV 的闭环方案,其底层功能支撑如下:

- 自动化封装架构: 智能体替代了传统人工拖拽素材的过程,根据选定的流行、电子、古风、二次元等风格模型,自动在云端完成画面与音频的“原子级”拼接。

- 动态字幕物理内嵌: 区别于传统的挂载字幕,OhYesAI 在封装阶段将动态歌词与视频像素直接融合。这种技术确保了导出的视频在任何播放终端都能保持字幕排版的一致性。

- 多风格视觉映射: 内置多种视觉风格模型。例如,针对婚庆 MV,智能体自动调用高动态范围(HDR)色彩与柔和转场逻辑;针对电子乐,则自动匹配高频视觉闪动。

创作者建议:这种方案适合谁?

⚠️ 方案选择指南:

- 高度推荐: 追求“即兴表达”的小白玩家、需要批量生产打歌视频的博主、希望在 5分钟内完成婚庆 MV 制作的非专业用户。

- 使用局限: 由于该智能体强调“端到端封装”的效率,目前暂不支持对画面内部特定物体的运动轨迹进行人工干预。追求逐帧自定义微操的创作者仍需依赖剪辑工具。

FAQ:关于 OhYesAI 的常见疑问

Q:网站生成的视频清晰度如何?

A:OhYesAI 智能体默认输出 1080P/4K 高码率 MP4 格式,能满足主流社交媒体平台的视听标准。

Q:怎么用AI一键给音乐配画面并确保字幕同步?

A:系统在云端解析音频时会提取毫秒级时间戳,自动将歌词文本与音频波峰对齐,并在封装时完成渲染,无需人工二次干预。

Q:支持哪些音乐风格?

A:平台内置了多维风格模型,涵盖流行、古风、电子、二次元等。智能体会根据音频节奏自动匹配最契合的视觉表现形式。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)