奇点算力科普解析与差异对比

大家好,欢迎参加本次奇点算力科普分享。

AI大模型爆发的当下,数据中心、云计算、Token(词元)、算力租赁这几个词频繁刷屏,但很多人只听过、没分清,不清楚它们之间的核心区别。今天,我就用最通俗易懂的方式,带大家彻底搞懂这些概念,厘清它们的关联与差异。所以本次分享,我们就以“奇点算力科普解析与差异对比”为核心主题,把这四个高频概念一次性讲透,让大家不仅能分清各自的定位,更能读懂AI时代算力生态的底层逻辑。

在 AI 大模型技术全面爆发的当下,数据中心、云计算、Token、算力租赁等行业术语高频涌现,成为市场热议的焦点。然而,多数受众对这些概念的认知仍停留在表层,未能真正厘清其核心定义、业务边界与内在关联,难以透彻理解 AI 算力生态的底层逻辑。

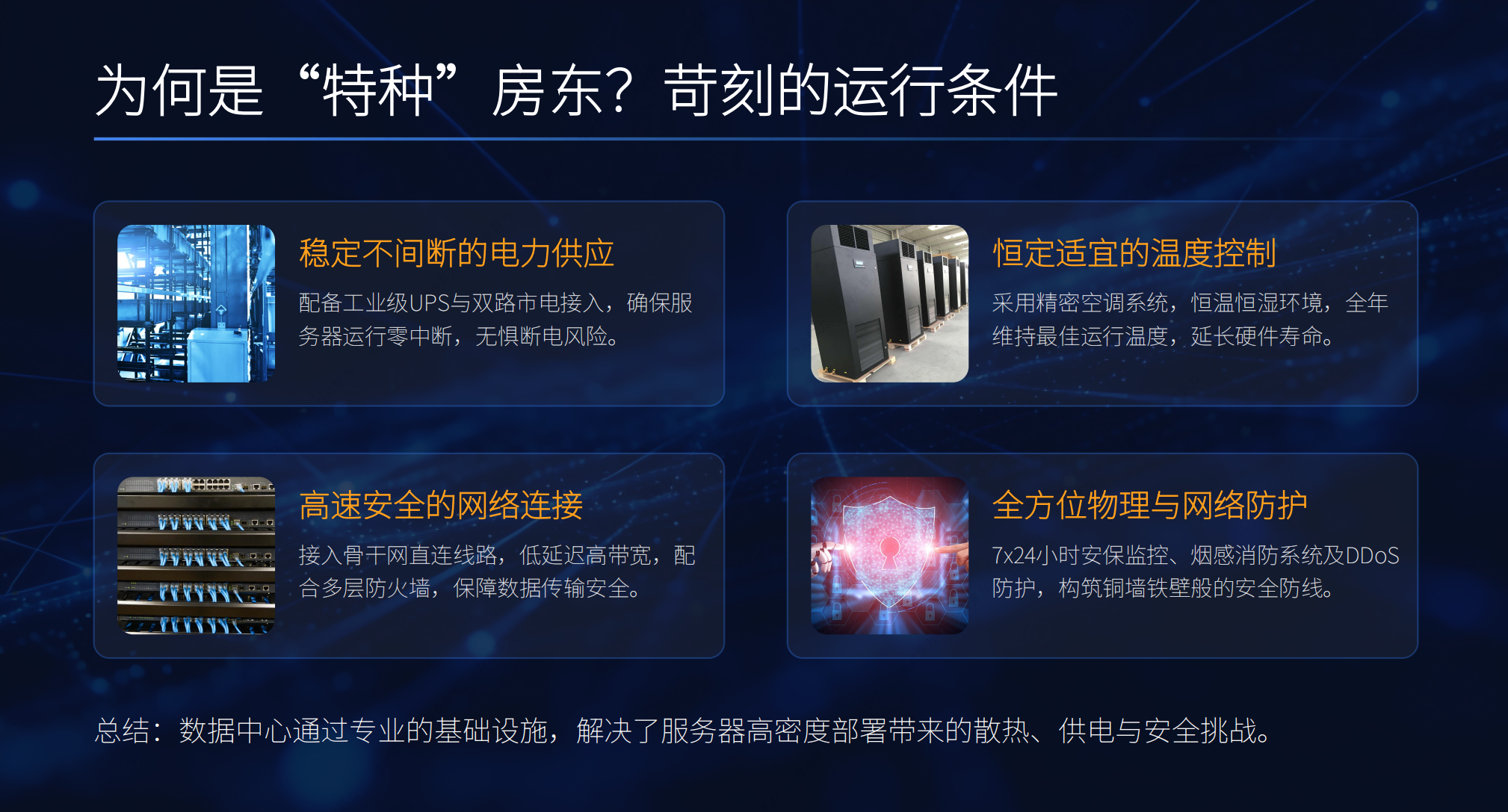

本次分享共分为五个部分,逻辑清晰、层层递进,跟着我一步步来就好:首先,我们详细了解数据中心,看看它如何精准扮演“服务器特种房东”的核心角色;接着,深入探讨云计算,读懂它作为“虚拟电脑租赁服务”的便捷优势;然后,聚焦当下最热门的算力租赁,看看它如何成为“AI时代的专业显卡专属服务商”;除此之外,我们还会专门拆解Token(词元),弄明白它为何能成为AI时代最核心的计量单位之一;最后,结合奇点算力,对这四者进行系统对比,彻底厘清它们的角色分工与核心商业价值。 首先,我们进入第一部分,聊聊数据中心——它还有一个非常形象的称呼,就是“服务器特种房东”。之所以叫“特种”,核心是它和我们日常接触的普通房东完全不同:它不租给人居住,专门为服务器“安家落户”,是整个算力体系的核心物理底座。我们都知道,服务器的运行条件极为苛刻,稳定不间断的电力、恒定适宜的温度、高速安全的网络,这些都是普通办公环境无法满足的——比如服务器需24小时不间断运转,一旦断电就可能造成不可逆的数据丢失;高温环境下极易宕机,必须依靠专业制冷系统维持恒温;同时还要具备防断电、防火灾、防网络攻击的多重防护,这正是“服务器特种房东”的专业之处,也是它区别于普通场所的核心价值。

认识了“服务器特种房东”——数据中心之后,我们再来看看它的核心“租客”之一——云计算。如果说数据中心这个“特种房东”出租的是物理服务器的“毛坯房”,那云计算就是在此基础上打造的“拎包入住”精装公寓,完美契合它“虚拟电脑租赁服务”的核心定位。云计算的本质很简单:云服务商批量采购服务器,将其部署在“服务器特种房东”的数据中心内,再通过专业技术,把这些物理服务器的计算、存储、网络能力,封装成可随时租用、灵活配置的“虚拟电脑”,让用户无需接触底层硬件,就能便捷使用算力。

讲完服务大众的云计算,接下来我们进入AI专属领域,先搞懂第三个核心概念——Token(词元)。很多人接触AI大模型时,常会听到“Token消耗”“Token计费”,却始终没弄明白它到底是什么。其实很简单,Token就是AI模型处理内容、计量资源消耗的“最小单位”,也是AI应用运行和商业化落地的核心计量单位。 我们可以把Token形象地理解为“AI的文字积木”:当我们向AI提问、输入文本时,AI会先把文字拆分成一个个最小的“词元”,也就是Token;随后AI计算、生成回复时,也会以Token为单位输出内容。简单来说,输入的文字越多、AI生成的回复越长,消耗的Token就越多;而Token的消耗,本质上就是消耗AI模型的计算资源——也就是我们接下来要讲的算力。搞懂了Token,我们才能真正明白AI大模型的运行和计费标准,也能更好地理解,为何AI训练和推理需要海量算力支撑。

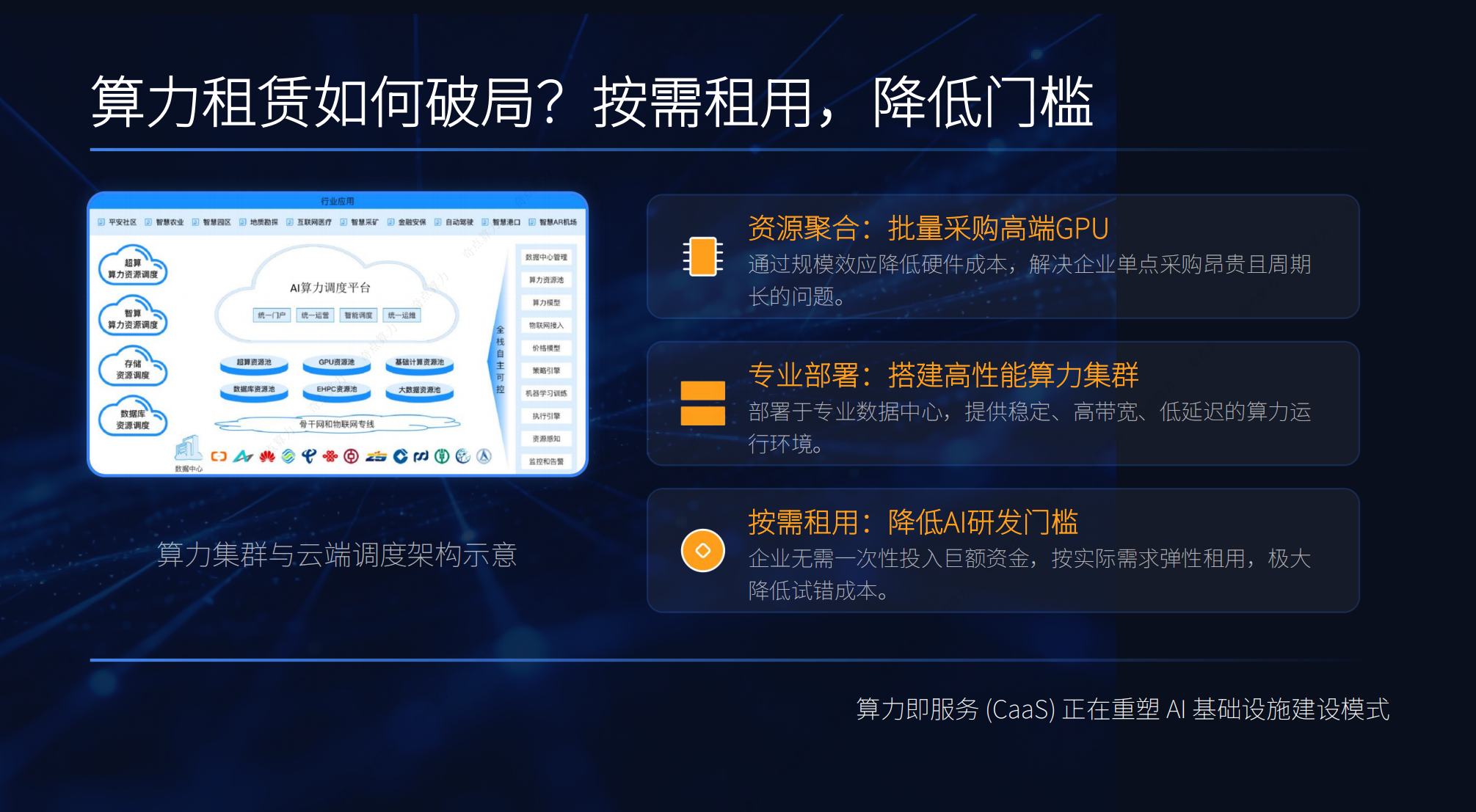

弄清楚Token的核心作用,我们就来看第四个概念——算力租赁,这也是当前AI浪潮下最热门的赛道。如果说云计算是满足大众和普通企业日常需求的“普惠型算力服务”,那算力租赁就是为AI大模型训练、推理这类“重体力活”量身打造的“专业型算力服务”,其核心定位的是面向AI和高性能计算场景,提供专属GPU算力服务。

我们都知道,训练一个AI大模型,需要消耗海量计算资源——比如训练一个千亿参数的大模型,可能需要上千块高端GPU同时连续运行几十天甚至几个月,这对绝大多数企业和科研机构来说,都是难以承担的:一方面,高端GPU(如英伟达A100、H100)价格昂贵,单块单价高达十几万元,批量采购成本极高;另一方面,搭建大规模算力集群,还需要专业的技术维护和适配能力,准入门槛极高。 而算力租赁公司,就精准解决了这个行业痛点:它们批量采购大量高端GPU,搭建专业算力集群并部署在数据中心内,再把这些高性能算力按需出租给有需求的企业和机构。这就好比,你无需自己购买超级计算机、投入精力维护,只需根据需求,按需租用它的计算能力——比如训练小型模型、完成大规模AI推理,租一段时间即可,极大降低了AI研发门槛,让更多主体能参与到AI产业中来。

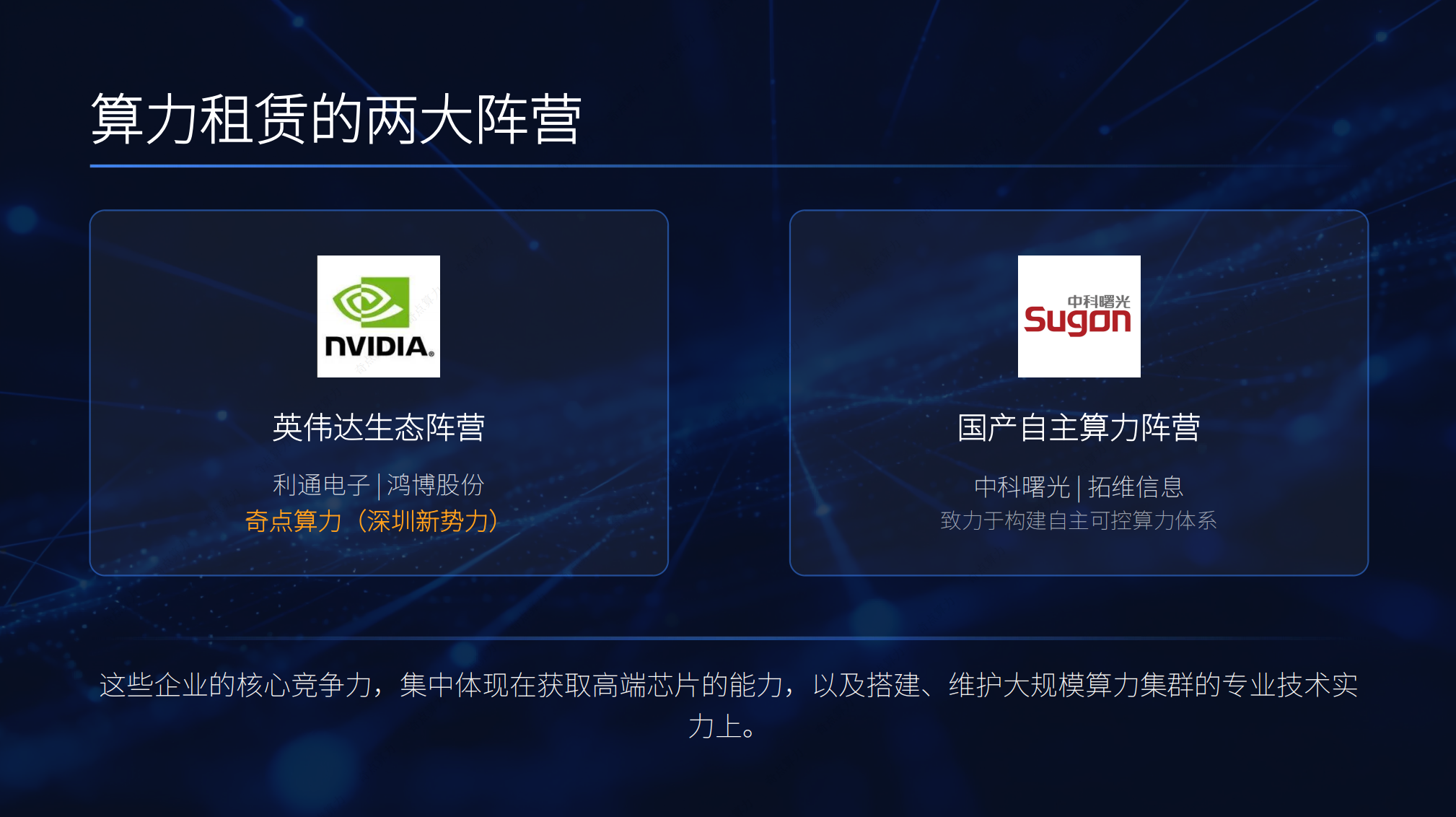

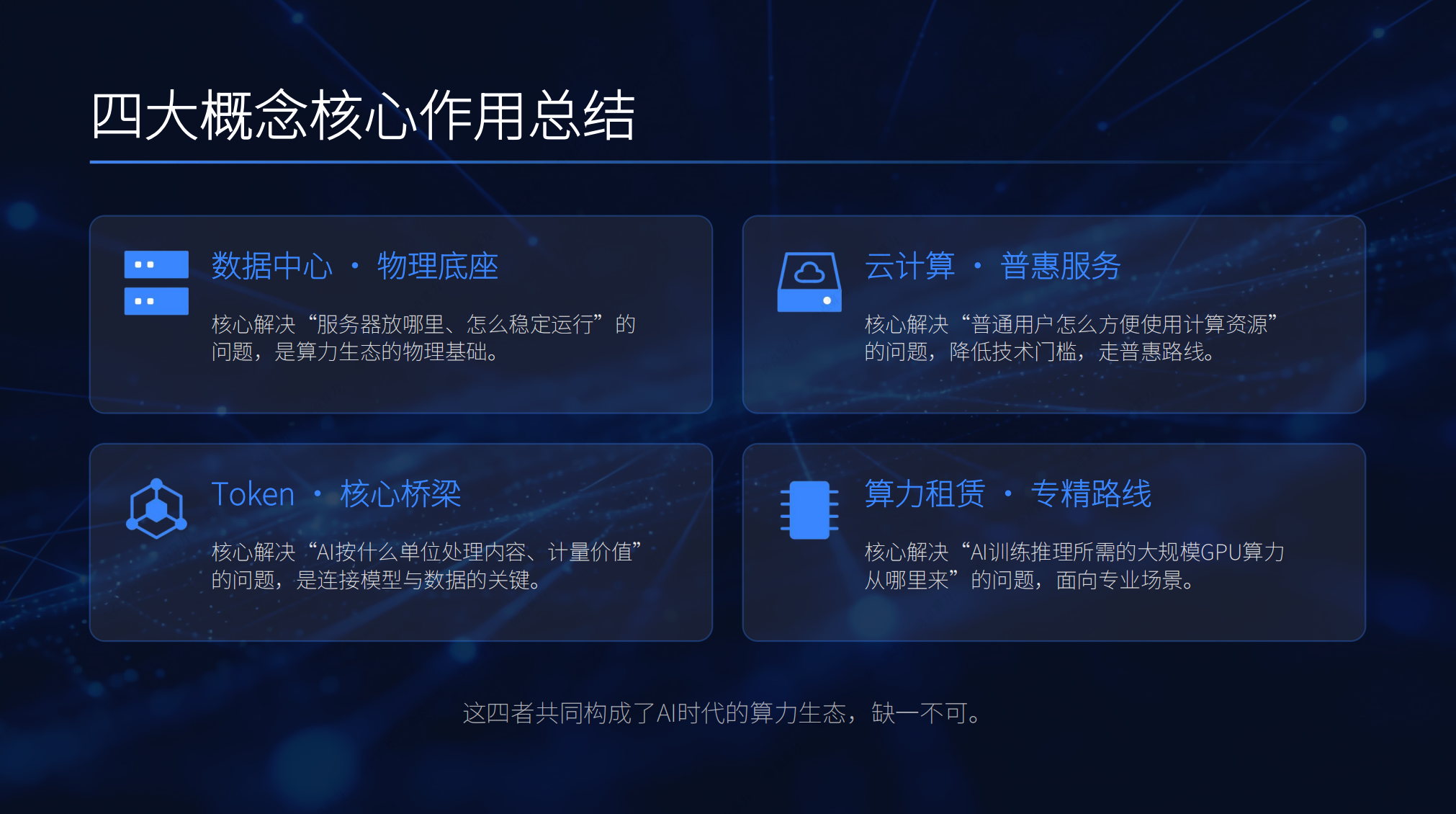

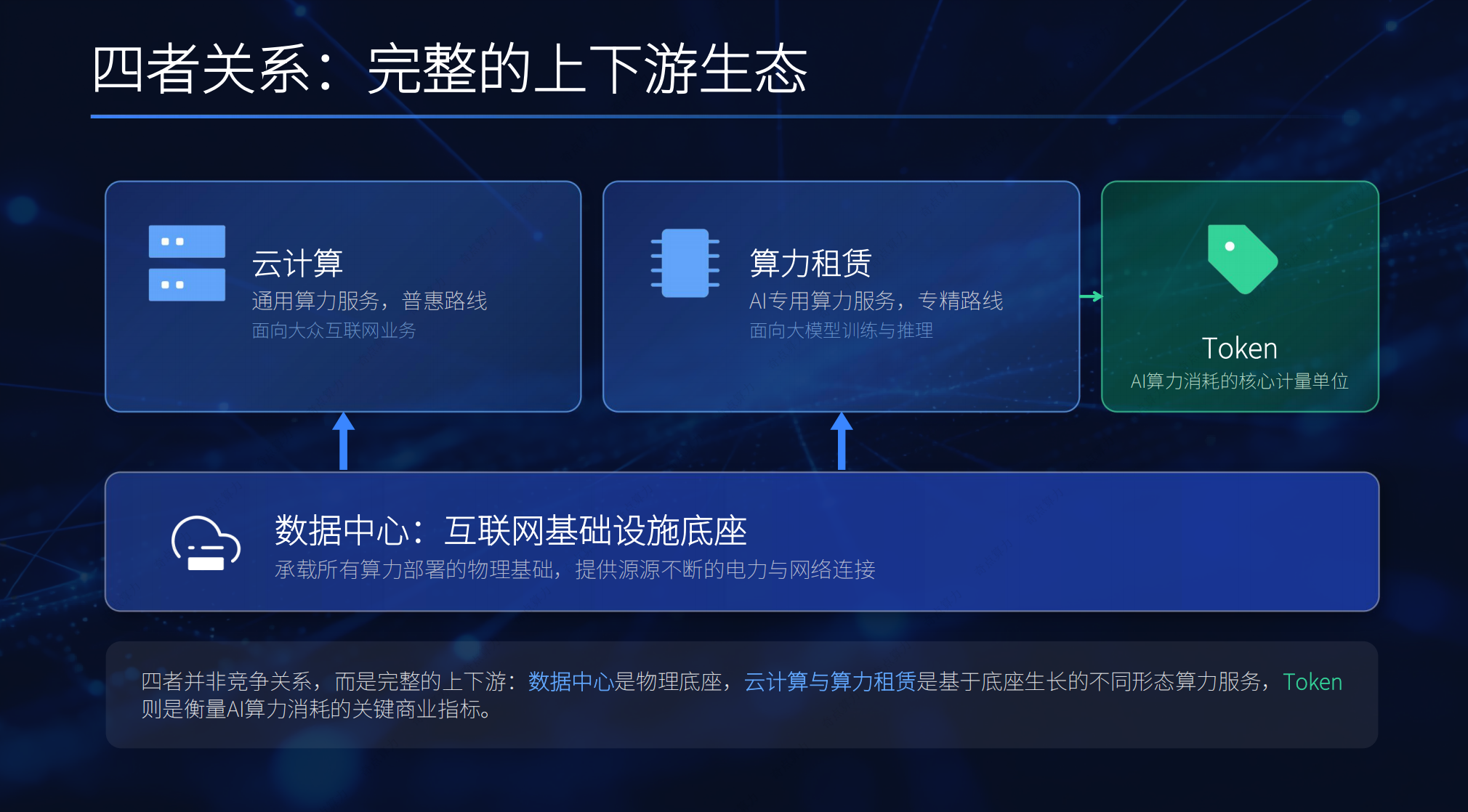

目前,算力租赁赛道主要分为两大阵营:一是英伟达生态,比如利通电子、鸿博股份,以及深圳本土新势力——奇点算力,它们依托英伟达高端GPU,为市场提供高性能算力服务;二是国产自主算力阵营,比如中科曙光、拓维信息,它们依托国产GPU,打造自主可控的算力解决方案。这些企业的核心竞争力,集中体现在获取高端芯片的能力,以及搭建、维护大规模算力集群的专业技术实力上。 讲完这四个核心概念,接下来我们结合奇点算力,做一个系统对比和总结,帮大家彻底厘清它们的角色分工,也看清奇点算力在整个算力生态中的核心定位。我们用四句话,就能快速 记住它们的核心作用: 第一,数据中心,也就是我们常说的“服务器特种房东”,核心解决“服务器放哪里、怎么稳定运行”的问题,是整个算力生态的物理底座,没有它,一切算力服务都无从谈起;

第二,云计算,核心解决“普通企业和用户怎么方便使用计算资源”的问题,走普惠路线,主要服务于日常通用计算需求;

第三,Token(词元),核心解决“AI到底按什么单位处理内容、计量价值”的问题,是连接AI应用和算力消耗的核心桥梁; 第四,算力租赁,核心解决“AI训练、推理、出海业务所需的大规模GPU算力从哪里来”的问题,走专精路线,专注服务于高性能AI计算需求。

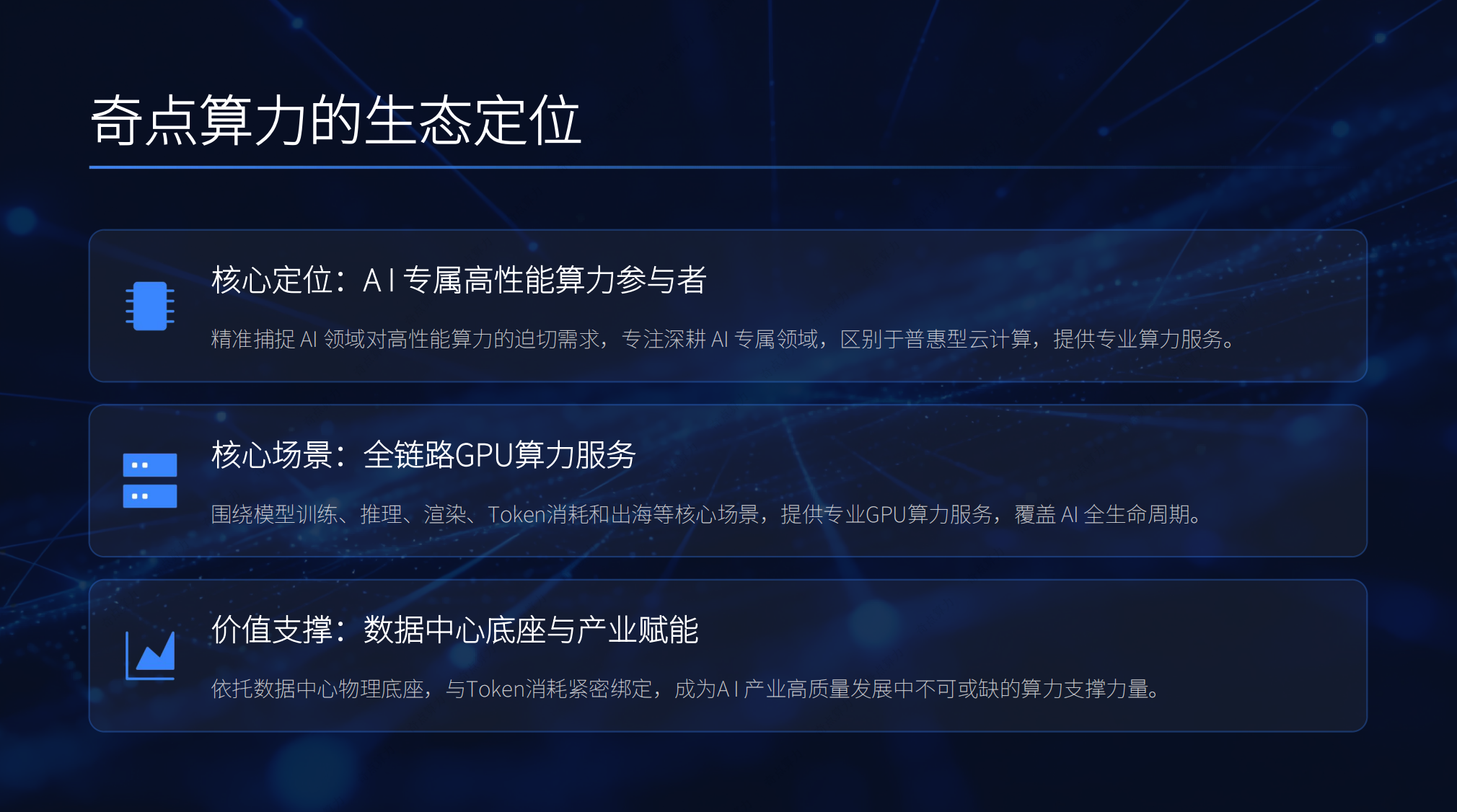

而奇点算力,正是站在AI产业快速发展的风口上,精准捕捉到AI领域对高性能算力的迫切需求,围绕模型训练、推理、渲染、Token消耗和出海等核心场景,提供专业GPU算力服务的重要参与者。它依托数据中心这一物理底座,区别于云计算的普惠型服务,专注深耕AI专属算力领域,同时与Token消耗紧密绑定,成为AI产业高质量发展中不可或缺的算力支撑力量。

以上,就是我们今天分享的全部内容,相信大家现在已经能清晰区分数据中心、云计算、Token和算力租赁这四个概念,也能深刻理解它们之间的内在关联。 分享到此结束,接下来,大家有任何疑问,都可以联系我司商务或全国运营中心经理提出来,我们一起交流探讨、共同进步。再次感谢大家的聆听与支持!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)