值得收藏!零基础打造你的第一个AI Agent实战指南:从核心原理到完整落地

一直以来,都很少有人把“怎么从零做出一个 AI Agent”这件事,真正整理成一套谁都能看懂、照着就能上手的完整教程。

如果你愿意花一点时间读完这篇文章,今天就有机会把自己的第一个 Agent 做出来,而且是一个真正对你有用的 Agent。因为为了“做 Agent 而做 Agent”没有意义,重点是它到底能替你解决什么问题。

所以作者做了什么?

他把来自 Anthropic、OpenAI,以及网上其他研究者和实战者的零散资料全部收拢起来,再结合自己和 Claude 一起整理的理解,拼成了一份给普通人看的完整入门课。目标很明确:不是讲概念炫技,而是让你今天就能开始做。

这篇文章很长,但结构非常清楚。为了方便你跳着读,作者把全文拆成了 8 个部分,每一部分都配了插图,你可以直接挑自己最关心的部分开始看:

- Agent 是怎么工作的

- 五种工作流

- 如何搭建你的 Agent

- 怎么使用工具

- 怎么给 Agent 加记忆

- 怎么让 Agent 真正在现实里跑起来

- 多 Agent

- 最后的收束

好,直接开始。

1:AGENT 是怎么工作的

这一部分很重要。你要是连这个都不知道,就根本不知道自己到底需不需要 Agent。所以先从这里讲起。

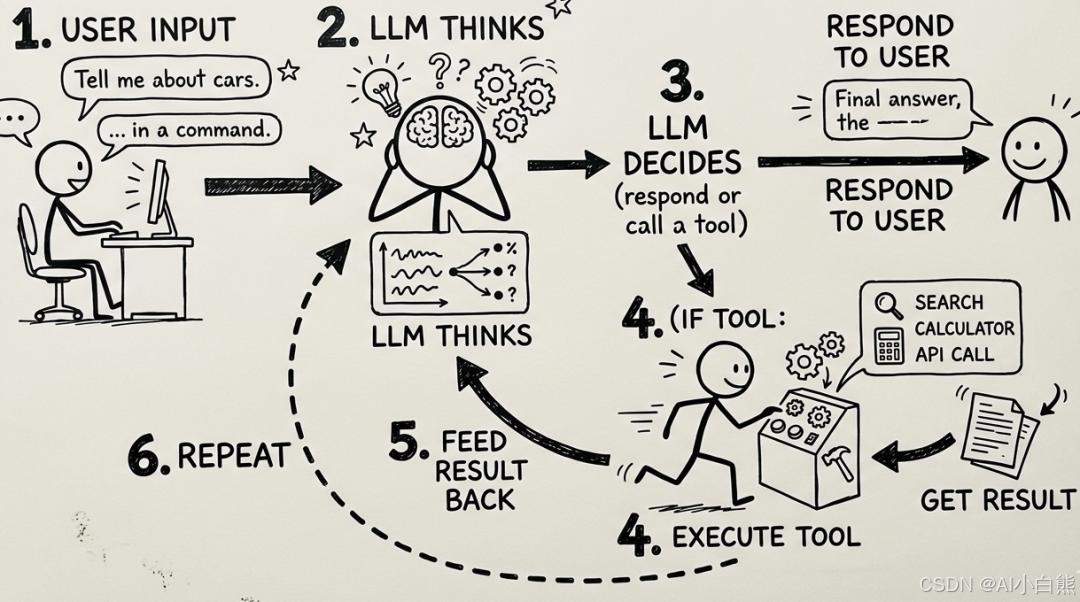

所有 Agent 共用的核心循环是这样的:

用户输入 → LLM 思考 → LLM 决定(直接回答,或者调用工具)→ 如果调用了工具:执行工具,把结果喂回去 → 重复

LLM 是负责推理的“大脑”。工具是负责干活的“双手”,比如计算器、网页搜索、文件读写。记忆则像一个“记事本”,用来记录前面发生过什么。无论你用的是 LangGraph、CrewAI、Anthropic 的 SDK,还是 OpenAI 的 Agents SDK,本质上都只是把这个循环包装得更方便而已,它们没有改变这个核心。

增强型 LLM

普通 LLM 只能吃进文本,再吐出文本。增强型 LLM 则多了三种能力:

- 工具:模型可以调用的函数,比如计算器、数据库、API、文件操作等。Anthropic 和 OpenAI 都用 JSON Schema 来描述工具;Anthropic 用的是

input_schema,OpenAI 则把函数包在带parameters的 function object 里。 - 检索:能从外部来源拉取相关信息,比如搜索引擎、文档、向量数据库。

- 记忆:能通过消息历史或者其他持久化存储,在多轮交互中保留信息。

工作流和真正的 Agent 有什么区别

这两者的区别,在你决定怎么做的时候非常关键。工作流是确定性的:执行顺序由你的代码控制,同样的输入总会走同样的路径。它很适合步骤固定、定义明确的任务,而且更便宜,因为 LLM 调用次数更少。Agent 则是动态的:下一步怎么做,由 LLM 自己决定,它还可能反复调用工具。它更适合开放型任务,但成本也更高。对你来说,判断要不要做 Agent,最好的起点通常不是直接上 Agent,而是先从一个简单工作流开始,看看这个东西是否真的有必要继续升级成自治 Agent。

2:五种核心工作流模式

信不信由你,大多数问题其实根本不需要“完全自治”的 Agent。Anthropic 文档里总结的这五种模式,已经覆盖了很多常见场景,而且现在也被广泛采用。每一种模式都依赖增强型 LLM。

模式 1:提示链(Prompt Chaining)

它是什么:把任务拆成一连串顺序步骤。每一次 LLM 调用都处理前一步的输出。步骤之间可以加程序化“关卡”来检查质量。

什么时候用:适合那些能清楚拆成固定子任务的工作。你用速度换准确率,因为每一次 LLM 调用都更简单。

例子:先生成营销文案,再把它翻译出来;先写大纲,确认关键话题都覆盖了,再写完整正文。

模式 2:路由(Routing)

它是什么:先给输入做分类,再把它送到对应的专用处理器。每个处理器都有自己专门优化过的提示词。

什么时候用:当不同类别的输入需要完全不同的处理方式时。客服分流就是最经典的例子。

模式 3:并行化(Parallelisation)

它是什么:同时发起多次 LLM 调用。Sectioning 是把任务切成互不依赖的小块并行处理;Voting 则是让同一个任务跑多次,再把结果汇总,以提高置信度。

什么时候用:当子任务彼此独立时,用 Sectioning;当你需要对关键判断做“集体表决”时,用 Voting。

模式 4:协调者-执行者(Orchestrator-workers)

它是什么:一个中心 LLM,也就是协调者,动态拆解任务,再把子任务分配给执行者 LLM。和并行化不同的是,这里的子任务不是你预先写死的,而是协调者在运行时决定。

什么时候用:适合那些你事先没法预测结构的复杂任务,比如跨多个文件的代码生成、研究任务、写报告等。

模式 5:评估者-优化者(Evaluator-optimiser)

它是什么:一个 LLM 先生成结果,另一个来评估并给反馈。如果评估不过关,反馈会回流给前者。这个循环会一直继续,直到质量达标。

什么时候用:当你有明确的评判标准,而且反复迭代确实能带来明显提升时,比如翻译、代码生成和写作任务。

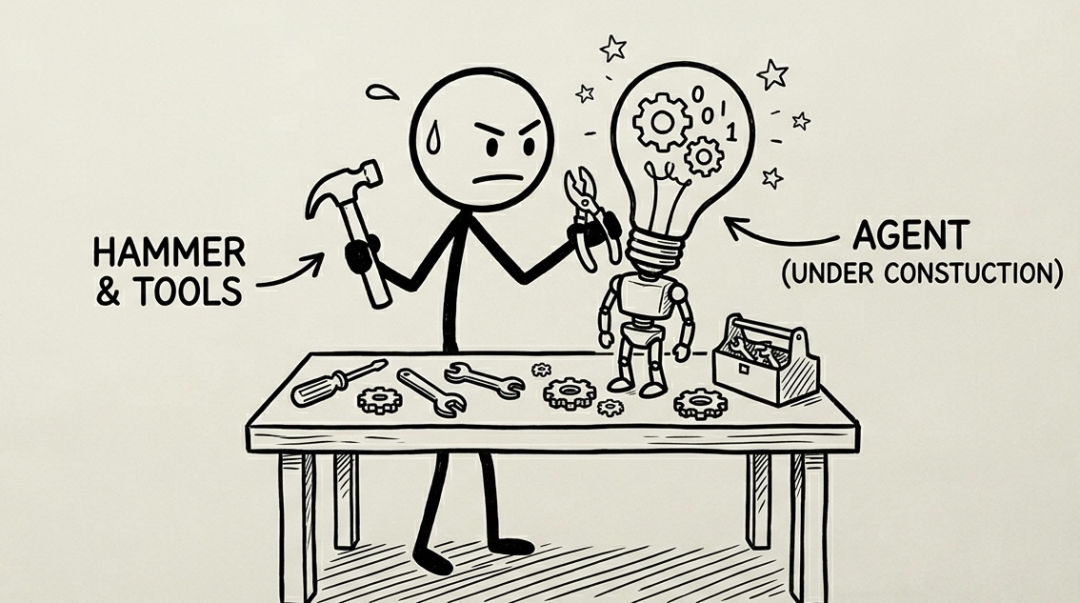

3:搭建你的 Agent

这才是你点开这篇文章真正想看的部分。开始吧。

那到底怎么把“我想做一个能完成 XYZ 的 Agent”变成一个真正能跑的东西?

最容易理解的方法就是:

- 把它的工作写清楚

- 决定它需要哪些工具

- 告诉模型该怎么表现

- 用 5 个真实例子测试它

- 只有在它失败时,再增加复杂度

你不需要先精通五种框架,才能做出第一个 Agent。对我和你来说,最适合入门的其实就是:

- 如果你想做一个像“能操作环境的助手”那样的 Agent,能用工具、文件、Shell 命令、网页动作,而且很适合写代码,那就选 Anthropic

- 如果你想要一个更干净的开发者 SDK,自带托管工具、任务交接、护栏,而且更容易走向生产环境,那就选 OpenAI

这篇指南主要就围绕这两个来讲。

最简单的心智模型

当你要搭建 Agent 时,先回答这四个问题:

- 最终结果是什么?

这个 Agent 最后到底要产出什么?

例子:

- “研究一个主题并写一份总结”

- “读取我的笔记并把它们变成抽认卡”

- “看客服请求并把它们分到正确的类别”

- “比较几个产品并告诉我最好的选择”

- “审阅我的内容并按我的语气重写”

-

它需要什么信息?

它需要网页搜索、文件、数据库、表格、CRM,还是只需要用户当前发来的消息?

-

它被允许做什么动作?

它只能回答?还是可以搜索?可以改文件?可以发邮件?可以写代码?可以调用你自己写的函数?

-

它必须遵守哪些规则?

包括语气、格式、约束、安全规则、不确定时怎么处理,以及什么样才算“好”。

只要你能把这四个问题答清楚,通常一天之内就能做出第一个版本的 Agent。

一个稍后会展开的速成技巧:把你的想法直接丢给 LLM,让它深度思考,然后让它替你把上面这四个问题都答出来。

在真正动手之前,先用 AI 帮你把 Agent 设计清楚

一个很实用的办法是:编码之前,先让 Claude 或 ChatGPT 帮你把 Agent 定义清楚。

你可以直接贴这样的提示词:

我想做一个 AI Agent。我的目标:[描述你想让它做什么]用户会这样提问:[写 5 个真实一点的例子]这个 Agent 应该能访问:[网页搜索 / 文件 / 计算器 / 自定义 API / 其他都不要]它必须始终:[列出不能妥协的规则]它绝不能:[列出边界]请把这些整理成:1. 一份清晰的 Agent 规格说明2. 一段 system prompt3. 一份工具清单4. 第一版路线图5. 10 个测试用例

这一个提示词,就足以帮初学者把一个模糊想法变成可以真正落地的方案。

一套适合新手的 Agent 设计公式

每次都用这个结构:

Agent = 角色 + 目标 + 工具 + 规则 + 输出格式

例子:

- 角色:加密项目研究助手

- 目标:找到准确的信息,并把它清楚总结出来

- 工具:网页搜索、文件搜索、计算器

- 规则:要给出处,不要乱猜,遇到不确定的地方要标出来

- 输出格式:总结、风险、机会、最终结论

这就是大多数实用 Agent 的地基。

先从下面这五类新手 Agent 里选一种开始:

如果你是新手,不要一上来就做多 Agent 群体系统。先从下面这五种之一开始:

- 研究型 Agent

适合:你想让 Agent 去收集信息,再做总结。

例子:

- “研究一下脚踝扭伤最好的康复训练”

- “查一下某个加密协议的最新进展”

- “比较三台笔记本电脑”

需要:

- 网页搜索

- 如果你想让它用你的文档,再加文件搜索

- 清晰的输出格式

- 内容型 Agent

适合:你想让 Agent 写作、改写、总结,或者转换内容形式。

例子:

- “把我的笔记整理成一封 newsletter”

- “按我的品牌语气重写这段文字”

- “总结这份会议纪要”

需要:

- 通常只要一个强一点的 system prompt

- 可选的文件访问

- 你偏好风格的示例

- 流程型 Agent

适合:你想让 Agent 跑一个可重复的业务流程。

例子:

- “给客服工单分类”

- “把线索分配到正确类别”

- “检查表单提交内容并生成回复草稿”

需要:

- 清晰的分类

- 规则

- 有时还需要自定义工具或 API 调用

- 个人知识 Agent

适合:你想让 Agent 只基于你的文档来回答问题。

例子:

- “只用我的 PDF 来回答”

- “搜索我的笔记并解释这个主题”

- “找出所有提到这个客户的地方”

需要:

- 文件搜索或 RAG

- 明确要求它必须基于提供的材料,不要乱发挥

- 操作型 Agent

适合:你想让 Agent 在某个环境里真正采取动作。

例子:

- “读这些文件并修改它们”

- “上网搜索,整理结果,再保存成报告”

- “运行 Shell 命令,帮我调试代码”

需要:

- 工具

- 权限

- 强边界的安全规则

Anthropic:怎么理解“做出第一个 Agent”这件事

如果你希望模型会用工具、能在环境里操作,那 Anthropic 的 Agent 工具链会特别顺手。Claude Code 在 2025 年 2 月发布,之后 Claude Code SDK 又在 2025 年 9 月改名为 Claude Agent SDK。到 2026 年 3 月,GitHub 上列出的当前版本是 v0.1.50。

什么时候 Anthropic 是个好选择

如果你想做一个这样的 Agent,就优先选 Anthropic:

- 能读、写、改文件

- 能用 Shell 命令

- 能搜索网页

- 能使用 MCP 工具

- 很适合编码和技术任务

- 用起来像一个会一步一步操作的能干助手

你在 Anthropic 里实际上在做什么

站在入门角度,事情其实只有三步:

- 给 Claude 一个工作

- 给 Claude 一些工具

- 让 Claude 循环下去,直到任务完成

就这么简单。

新手例子:一个“研究并总结”的 Agent

假设你想要的是:

“一个能帮我研究某个主题,并写出清晰报告的 Agent。”

那你的搭建方案会像这样:

- 角色:高级研究助理

- 目标:找到准确的信息,并把它清楚总结出来

- 工具:网页搜索,也许再加文件访问

- 规则:引用来源;不确定就明说;保持简洁

- 输出:要点总结 + 关键风险 + 结论

它就可以变成你的 system prompt:

SYSTEM_PROMPT ='''You are a careful research assistant.Your job is to help the user research topics accurately.Use tools when needed.Do not guess.If information is uncertain or incomplete, say so clearly.Always produce:1. Summary2. Key findings3. Risks or uncertainty4. Final conclusion'''

现在用户就可以问:

- “研究一下最新的 AI Agent SDK”

- “比较一下 Anthropic 和 OpenAI,哪个更适合新手做 Agent”

- “找 3 个强来源并总结一下”

这已经是一个真正能用的 Agent 了。

新手例子:一个基于文件的写作 Agent

也许你想做的是:

“读取我的笔记,然后按我的语气把它改写成一篇干净的文章。”

那你的设计就会变成:

- 角色:写作助手

- 目标:把粗糙笔记打磨成成稿

- 工具:文件读取,也许再加文件写入

- 规则:保留原意,提升清晰度,匹配语气

- 输出:最终文章 + 可选标题建议

这就比一个模糊的“内容型 Agent”容易做得多。

在开始做 Anthropic Agent 之前,你应该先问 AI 什么?

让 LLM 帮你把方案定义清楚:

帮我设计一个 Anthropic Agent。我的目标是:[goal]我希望这个 Agent 能够:[list actions]我希望它使用这些工具:[list tools]我希望最后输出长这样:[format]请给我:1. 一段强一点的 system prompt2. 一份最小工具清单3. 一个第一版 Python 示例4. 10 个测试提示词5. 提高可靠性的建议

通常这一个提示词,就能帮你把 80% 的工作先做出来。

OpenAI:怎么理解“做出第一个 Agent”这件事

OpenAI 在 2025 年 3 月 11 日发布了 Agents SDK,同时还发布了 Responses API 和内建工具,比如网页搜索、文件搜索、电脑操作。到 2026 年 3 月,Python 包 openai-agents 的版本是 0.13.1。

什么时候 OpenAI 是个好选择

如果你想要下面这些东西,就优先选 OpenAI:

- 一个非常干净的 Agent API

- 很容易接入自定义函数工具

- 自带托管工具

- 专家 Agent 之间的任务交接

- 护栏和追踪

- 从原型走向生产更顺的路径

你在 OpenAI 里实际上在做什么

站在入门角度,这套东西其实也只有几步:

- 创建一个 Agent

- 给它说明

- 如果需要,再加工具

- 用真实用户请求去跑它

就是这样。

新手例子:一个客服分流 Agent

假设你的目标是:

“读取传入的客服请求,然后判断它属于账单、技术,还是销售。”

那它会变成:

- 角色:客服分流助手

- 目标:正确给请求分类

- 工具:先不需要,后面也许可以接 CRM 工具

- 规则:只能选一个类别;简短解释原因

- 输出:类别 + 原因

代码大概会像这样:

from agents import Agent, Runneragent = Agent( name="Support Triage Agent", instructions=\"\"\"You classify customer requests.Choose exactly one category:- billing- technical- salesReply with:1. Category2. One sentence explaining why\"\"\",)result = Runner.run_sync(agent,"I was charged twice for my subscription this month.")print(result.final_output)

这已经是一个有实际用途的 Agent 了。

新手例子:加一个自定义工具

现在假设你还想让它:

“在需要的时候,帮用户做计算。”

from agents import Agent, Runner, function_tool@function_tooldefcalculate(expression:str)->str:import math allowed ={k: v for k, v in math.__dict__.items()ifnot k.startswith("__")}returnstr(eval(expression,{"__builtins__":{}}, allowed))agent = Agent( name="Math Helper", instructions="Help the user solve maths problems. Use the calculator tool when needed.", tools=[calculate],)result = Runner.run_sync(agent,"What is compound growth on 10000 at 5 percent for 8 years?")print(result.final_output)

这样一来,Agent 就不只是聊天了,它会通过工具去真正采取动作。

新手例子:使用托管工具

OpenAI Agents SDK 也支持托管工具,比如网页搜索、文件搜索和代码解释器,SDK 文档里有对应的辅助函数。对新手来说,你可以把这些理解成“预制能力”,直接挂到 Agent 上就行,不用你自己从头写。

这意味着你可以做出这样的 Agent:

- “去网上研究这个主题,再总结给我”

- “搜索我的文件,然后基于文件回答”

- “运行代码来分析这些数据”

在开始做 OpenAI Agent 之前,你应该先问 LLM 什么?

帮我设计一个 OpenAI Agent。我的目标:[goal]我想让它处理的任务:[list tasks]我觉得它需要这些工具:[list tools]输出应该长这样:[format]请给我:1. 一段清晰的 Agent 指令2. 最简单的第一版3. 如果需要工具,再给一个带工具的版本4. 10 个测试提示词5. 常见失败模式,以及怎么修

怎么把你的 Agent 真正定制成你想要的样子

这是新手最容易翻车的地方。很多人做出来的不是“具体 Agent”,而是一个泛泛的通用助手。

用这个检查清单。

- 把工作范围缩窄

差的写法:

- “帮我处理一些业务相关的事”

好的写法:

- “把销售电话总结成行动点”

- “把线索分成热、温、冷”

- “研究加密项目,输出风险、催化因素和结论”

- 定义输出格式

差的写法:

- “给我一个答案”

好的写法:

- “返回:总结、证据、风险、下一步”

- “返回 JSON,字段包括 category、confidence、explanation”

- “按 5 个标题输出项目符号列表”

- 给例子

如果你在意语气、结构或者分类质量,例子会非常有帮助。

你可以直接告诉模型:

- “这里有 3 个好的输出示例”

- “这里有 5 个请求分类示例”

- “就按这个风格写”

- 只在真的需要时再加工具

如果任务只是改写笔记,就别加网页搜索。

如果答案只应该来自提示词本身,就别加文件访问。

每多一个工具,复杂度就会上升一点。

- 用真实提示词测试,而不是理想化提示词

要用真实用户会打出来的那种乱糟糟输入去测。

不要只测这种:

- “请分类这个技术问题”

也要测这种:

- “我的账号出故障了,而且一直在被扣费,我该怎么办?”

这才是你真正看清自己的 Agent 到底在干嘛的时候。

下面是你的搭建路径:

第 1 步:用一句话写清这个 Agent 是干什么的

例子:“我想做一个能把我的零散笔记整理成每周 newsletter 的 Agent。”

第 2 步:让 Claude 或 ChatGPT 帮你把它整理成:

- 一份 Agent 规格说明

- 一段 system prompt

- 一份工具清单

- 10 个测试提示词

第 3 步:做出最小可用版本

不要一开始就上多 Agent。

不要一开始就做复杂记忆。

除非真的需要,否则别急着上 RAG。

第 4 步:拿 10 个真实例子测试它

第 5 步:每次只改一个东西

- 提示词

- 输出结构

- 示例

- 工具

- 记忆

- 检索

这个顺序很重要。别把自己困在一大堆复杂东西里。

避免这个常见错误:

最大的错误,就是一开始就想做一个“全能超级 Agent”。

不要从下面这些开始:

- 网页搜索

- 文件搜索

- 数据库访问

- 记忆

- 多 Agent 任务交接

- 复杂护栏

- 自定义仪表盘

- 20 个工具

应该从这些开始:

- 一个工作

- 一个 Agent

- 一段清晰提示词

- 最多一两个工具

- 5 到 10 个真实测试用例

这才是最容易做成的路径,不要一开始就把自己复杂化。

这一部分的实际收获

现在你已经看完第 3 部分了。看到这里,你应该已经能说出下面这些话:

- 我知道我的 Agent 是干什么的

- 我知道它需要哪些工具

- 我知道它必须遵守什么规则

- 我知道输出应该长什么样

- 我知道该从 Anthropic 还是 OpenAI 开始

- 我知道怎么用 AI 自己来帮我设计第一版

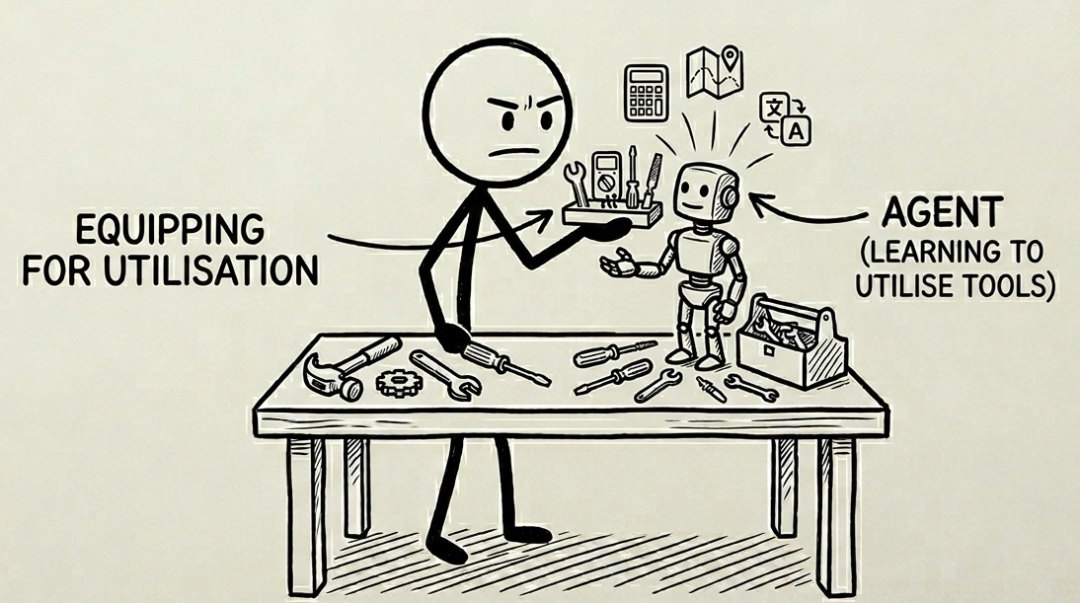

4:怎么使用工具

这一点大多数人都搞错了。

他们会觉得:

“工具越多,Agent 就越聪明。”

错。

更好的工具,才会带来更聪明的 Agent。

更少的工具,通常也意味着更可靠的 Agent。

理解工具最简单的方法

工具本质上就是:

“AI 自己做不到,所以要借外部能力来做的东西。”

比如:

- 计算数字

- 搜网页

- 读你的文件

- 发邮件

- 查数据库

第 1 步:先问自己,“这件事真的需要工具吗?”

在你加任何东西之前,先问:

- 模型只靠推理能不能回答?

- 还是它真的需要现实世界的数据或动作?

例子:

不需要工具:

- “改写这封邮件”

- “总结这段文字”

- “解释这个概念”

需要工具:

- “现在天气怎么样?”

- “搜索最新新闻”

- “算一下复利”

- “从我的表格里把数据拉出来”

👉 规则:

只要它需要外部数据或实际动作,就用工具不需要,就别加

第 2 步:用 AI 帮你把工具想清楚

我正在做一个 AI Agent。我的目标:[describe goal]我觉得这个 Agent 需要完成这些事:[list actions]哪些事情需要工具?我应该做哪些工具?请尽量保持简单、够用就好。返回:1. 工具清单2. 每个工具的说明3. 每个工具需要哪些输入

这会帮你省掉很多时间。

第 3 步:保持简单,真的

坏工具:

manage_files(action,file, destination, overwrite,format, permissions)

好工具:

read_file(path)write_file(path, content)delete_file(path)

👉 规则:

一个工具,只做一件清楚的事

第 4 步:明确告诉 Agent,什么时候该用这个工具

这正是大多数人失败的地方。

差的写法:

“计算工具”

好的写法:

“只要涉及数学运算,就使用这个工具。不要靠猜。”

第 5 步:让 Agent 出错,然后把它修好

用真实测试去跑,比如:

- “what’s 2^16”

- “calculate 7% growth over 10 years”

如果它:

- 不用工具,那就改工具描述

- 工具用错了,那就改输入设计

- 产生幻觉,那就把规则写得更严格

你看到这里,应该已经明白:

- 你不需要很多工具

- 你可以用 AI 帮你设计工具

- 工具越简单,Agent 越好

- 工具说明往往比工具本身更重要

好,继续。

5:给你的 Agent 加记忆

很多人把这件事想得太复杂了。

你其实只需要明白这一点:

记忆只有两种

- 短期记忆(对话记忆)

也就是:

“到目前为止,对话里说过什么”

这个你默认就已经有了。

- 长期记忆(外部知识)

也就是:

“Agent 以后还能查到的东西”

比如:

- 你的笔记

- 文档

- 数据库

你到底什么时候真的需要记忆?

问自己:

- Agent 需要跨消息记住事情吗?如果要,那就是短期记忆

- 它需要用外部文档吗?如果要,那就是长期记忆

- 否则,大概率你根本不需要记忆

第 1 步:先让 AI 帮你判断到底需不需要

我正在做一个 AI Agent。我的目标:[goal]这个 Agent 需要:1. 对话记忆吗?2. 外部知识(RAG)吗?如果需要,请解释为什么。如果不需要,也请解释为什么。尽量说简单一点。

第 2 步:你其实只有三种选择

选项 A:不要记忆(从这里开始)

- 对大多数新手来说,这是最好的起点

- 70% 的使用场景都能靠它解决

选项 B:对话记忆

- 大多数 SDK 本来就已经处理好了

- 只要别重置消息就行

选项 C:基于文件的记忆(简单版 RAG)

- 上传文档

- 使用文件搜索工具

第 3 步:别一上来就用过头

很常见的错误是:

- 先上向量数据库

- 再上 embeddings

- 再上复杂流水线

结果你甚至都还没搞清楚自己到底需不需要这些。

👉 规则:

如果你的 Agent 不加记忆也能正常工作,那就别加

好,到第 5 部分结束,你现在应该知道:

- 大多数 Agent 根本不需要复杂记忆

- 先从简单开始

- 只有在真的出问题时,再加记忆

6:怎么让你的 Agent 真正在现实里跑起来

这一部分决定了你的 Agent 最后到底会变成垃圾,还是会真的很好用。很多 Agent 之所以一塌糊涂,通常就是因为:

- 提示词写得烂

- 没有测试

- 期待不现实

所以:

第 1 步:用 AI 帮你生成测试用例

我做了一个 AI Agent,它的目标是:[goal]请生成 15 个真实一点的用户输入:- 要乱一点- 要模糊一点- 要像现实里人会打出来的话另外还要包括:- 边界情况- 容易混淆的输入- 坏输入

第 2 步:像真实用户一样测试

不要测这种:

“请对该计费请求进行分类。”

要测这种:

“搞什么鬼,我怎么又被扣钱了?”

第 3 步:每次只修一个点

当它失败时,问自己:

- 是提示词不清楚吗?

- 是输出格式太模糊吗?

- 是缺了工具吗?

- 是缺了规则吗?

第 4 步:用 AI 帮你调试 Agent

这是我的 Agent:这是我的输入:[input]这是它的输出:[output]哪里出问题了?我要怎么修?请具体一点。

第 5 步:别太早发疯式加复杂度

在下面这些东西之前,先忍住:

- 多个 Agent

- 复杂工作流

- 自动化流水线

前提是:

- 你的简单版本已经能稳定工作

看到这里,你应该已经明白:

- 测试就是一切

- AI 可以帮你调试它自己

- 在加复杂度之前,先把清晰度修好

下一部分。

7:多个 Agent

这一块特别容易把自己带偏。

很多人会觉得:

“Agent 越多,就越强。”

错。

先从一个 Agent开始。

永远先这样做。

只有在下面这些情况下,你才需要多个 Agent:

- 任务可以被明确拆开

- 一个 Agent 已经明显扛不住了

- 不同角色真的差异很大

真正需要多个 Agent 的情况,其实只有 3 种

- 技能不同

比如:

- 研究 Agent

- 写作 Agent

- 流水线很清楚

比如:

- 输入 → 分析 → 写作 → 输出

- 权限不同

比如:

- 一个 Agent 能读数据

- 一个 Agent 能执行动作

第 1 步:先用 AI 帮你判断,到底需不需要多个 Agent

我做了一个 AI Agent。它的工作是:[describe]这应该是:1. 单个 Agent2. 多个 Agent如果是多个:- 分别是什么角色?- 为什么?尽量保持简单。

最稳妥的模式

监督者模式:

用户 → 主 Agent →(有需要时再调用其他 Agent)

不要从这些开始:

- swarm(多个代理同时跑、互相传话、互相分工,系统更像“一群代理自己协作)

- 完全自治的多 Agent 系统

这些东西非常容易坏。

第 2 步:角色保持简单

差的写法:

- “带有动态认知分层的 AI 战略 Agent”

好的写法:

- “研究 Agent”

- “写作 Agent”

第 3 步:慢慢加

先从:

- 1 个 Agent

然后最多到:

- 2 个 Agent

只有在你真的看见明确收益时,再继续往上加。

这一部分的结论是什么?

- 大多数人根本不需要多个 Agent

- 一个 Agent 加上好的工具,通常就够了

- 只有被现实逼到的时候,再加复杂度

8:给这篇文章收个尾

这篇指南里最重要的洞见是:Agent 在概念上其实很简单,但在落地上要求很高。那个核心循环,也就是 LLM 思考、调用工具、重复执行,50 行 Python 就能写出来。真正难的地方在于工具设计、错误处理、评估,以及你要知道什么时候更简单的模式,比如提示链、路由,会比自治 Agent 更好用。

给刚开始的人三个可以立刻执行的建议:

- 先把最原始的 Agent 做出来。只有理解底层循环,任何框架对你来说才不会显得像魔法。你会更快定位问题,也更知道该怎么选工具。

- 从最简单、但能跑通的模式开始。提示链能处理大多数多步骤任务。路由能处理大多数“先分类、再动作”的流程。只有在你真的需要让 LLM 自己动态决定执行路径时,再升级到自治 Agent。

- 早点把精力花在工具设计和评估上。一个名字清楚、说明准确、错误信息结构化的工具,对 Agent 表现的提升,往往比你换模型或换框架更大。而 20 个高质量测试用例,能帮你抓到的 bug,通常比你手工瞎试一通更多。

这个领域变化非常快。MCP 在不到一年里就成了通用标准,两大主流提供方都推出了 Agent SDK,新框架更是几乎每个月都冒出来。但这篇指南里的基本面是稳定的:Agent 循环、五种工作流模式、好工具设计的原则,以及“先从简单开始”的纪律。把这些吃透,你就能应对后面冒出来的一切。

你现在已经可以开始做 Agent 了。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献41条内容

已为社区贡献41条内容

所有评论(0)