【世界模型】Advancing Open-source World Models

标题:推进开源世界模型

原文链接:https://github.com/Robbyant/lingbot-world/blob/main/LingBot_World_paper.pdf

源码链接:https://github.com/Robbyant/lingbot-world

我们提出LingBot-World,一款源自视频生成的开源世界模拟器。作为顶级世界模型,LingBot-World具备以下核心特性:

- 在写实场景、科学场景、卡通风格等广泛环境中,均能保持高保真度与稳健的动力学特性;

- 可实现分钟级生成时长,同时维持时间维度的上下文一致性(即长期记忆);

- 支持实时交互,在16帧/秒的生成速率下,延迟可控制在1秒以内。

我们公开代码与模型权重,致力于缩小开源技术与闭源技术的差距。我们相信本次发布将赋能社区,在内容创作、游戏、机器人学习等领域落地实用应用。

官网:https://technology.robbyant.com/lingbot-world

GitHub:https://github.com/robbyant/lingbot-world

模型权重:https://huggingface.co/robbyant/lingbot-world

图1 跨多样环境的交互式世界模拟. 本图展示了LingBot-World生成的精选样本,体现其在写实景观、科学可视化、风格化艺术世界等多领域合成高保真视频的能力。图中叠加的键盘图标(W、A、S、D)凸显模型的可控性,支持用户无缝导航并与动态环境交互。

1 引言

在计算机视觉与机器学习领域,研发能够理解并模拟物理世界的人工智能[41, 84],长期以来被视为“圣杯”级目标。当前,生成式模型正经历范式转变,从静态的文本生成视频[7–9, 64],迈向更具野心的文本生成世界模拟目标[2, 5, 24, 27–28, 45, 53, 68–69, 73–74]。

尽管当前顶尖的视频生成模型[25, 63, 71–72, 77, 90]已能渲染出高保真、视觉连贯的短视频片段,但它们本质上仍是“梦境生成器”而非“模拟器”[9, 35]。这类模型基于统计关联生成像素过渡,却往往缺乏对底层规律的扎实理解,例如因果关系、物体恒存性以及交互的后续影响。要弥合这一差距,必须从生成被动视频片段,转向构建能够合成持久、可交互、逻辑一致环境的世界模型。

然而,从视频生成转向世界模拟[1, 27, 78, 80, 89]面临诸多重大挑战:

- 高质量交互式数据稀缺:与被动的网络视频不同,能够捕捉智能体决策与环境反馈复杂交互的数据,极难规模化获取[22, 48];

- 长时程一致性难题:标准扩散架构难以维持分钟级长序列的叙事与结构一致性,仅能支持秒级生成,存在“灾难性遗忘”问题[7, 8];

- 计算成本过高:传统扩散采样的计算开销过大,无法支持实时控制,导致现有模型大多局限于离线渲染而非实时交互;

- 技术壁垒:该领域最先进的解决方案仍为闭源技术,形成壁垒,阻碍社区广泛创新。

本文提出LingBot-World,一套全面的开源框架,旨在突破上述壁垒,推动大规模世界模型研究的民主化。LingBot-World并非单纯的生成式模型,而是一套学习虚拟世界动力学并实现实时渲染的完整系统。其核心竞争力源于三大支柱:

- 具备层级语义的可扩展数据引擎:构建混合引擎,摄入真实世界视频、游戏引擎录制数据、虚幻引擎(Unreal Engine)合成数据等多元数据源,解决数据瓶颈。为解决原始数据缺乏细粒度控制的问题,引入层级标注策略[15, 16, 82],通过叙事、场景静态、密集时间三类标注,有效解耦运动控制与静态场景生成,让模型学习精准的动作依赖动力学。

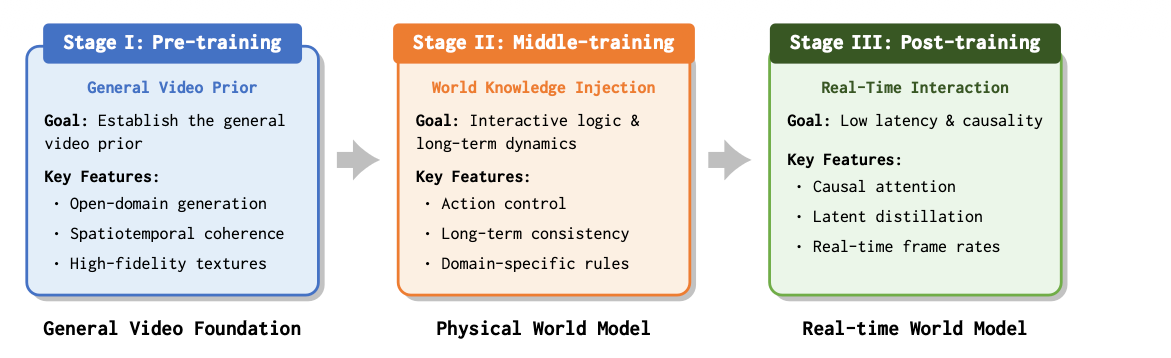

- 多阶段渐进式训练流程:提出渐进式训练策略,将基础视频生成器演进为交互式模拟器,分为预训练、中训练、后训练三阶段。阶段I通过预训练构建通用视频先验,支撑高保真纹理生成;阶段II采用混合专家(MoE)架构[17, 19, 36, 77]融入世界知识,实现动作可控性,聚焦“长期记忆”与长时程环境一致性;阶段III通过因果注意力适配与少步蒸馏[44, 59, 65],将双向扩散模型后训练为高效自回归系统[10, 30],实现亚秒级延迟。

- 面向具身AI的多元应用:除视觉合成外,LingBot-World还可作为下游任务的实用测试平台[1, 6, 20, 26, 29, 57–58, 78, 92],支持提示式世界事件生成、动作智能体训练、生成视频的一致三维重建[34, 50, 83],验证其几何完整性。

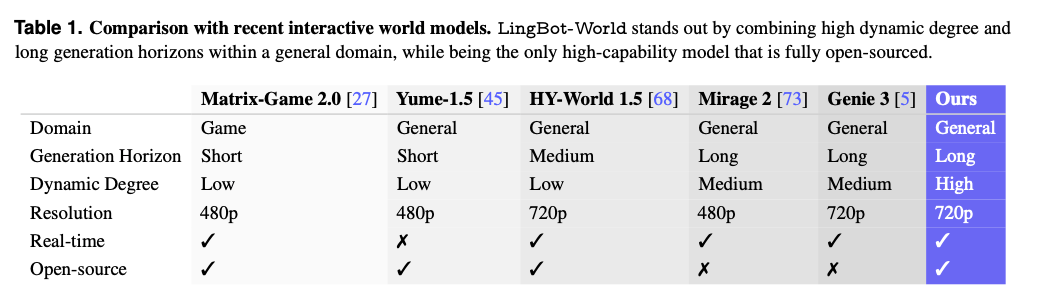

为明确本文贡献,表1对比了LingBot-World与近期交互式世界模型。尽管Genie 3[5]、Mirage 2[73]等系统取得进展,但往往在动态程度上妥协,或保持闭源。LingBot-World的独特之处在于:具备通用领域能力、长生成时长、高动态程度与实时性,且完全开源。我们开源代码与模型权重,旨在掀起新一轮创新浪潮,助力社区打造下一代虚拟世界。

通过开源LingBot-World(含模型权重与推理代码),我们希望激发新一轮创新。我们邀请社区超越被动观看视频,共同打造下一代无限、可游玩、可交互的虚拟世界。

表1 与近期交互式世界模型的对比 LingBot-World的核心优势:在通用领域内兼具高动态程度与长生成时长,且是唯一完全开源的高性能模型。

2 数据引擎

构建能够稳健处理全新视角、复杂动力学与长时程规划的世界模型,需要严谨的数据策略。我们将数据引擎设计为统一流水线,包含三个协同模块:(i) 数据获取、(ii) 数据剖析、(iii) 数据标注。

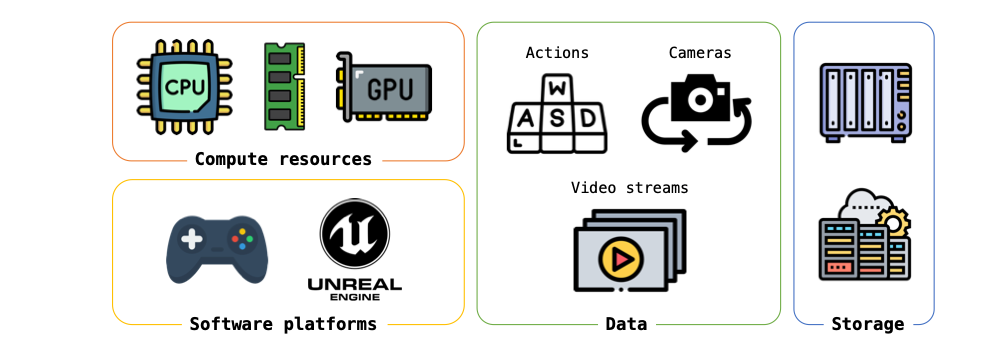

为搭建系统基础,数据获取阶段采用混合采集策略,确保训练语料丰富、高质量且具备交互性。首先,我们构建大规模高质量、多样化视频数据集,涵盖人类、动物、载具的第一人称[17, 22]与第三人称[4, 66]视角。其次,为精准捕捉动作依赖动力学,我们采集游戏数据,将RGB帧与用户控制输入(如W、A、S、D)、相机参数严格配对。最后,基于虚幻引擎(UE)[18]开发合成渲染流水线,将授权资产与自定义环境结合,设计自动化渲染流程,生成无碰撞、随机且合理的相机轨迹,输出与真实相机内参、外参对齐的RGB流。核心思路如图2所示。

图2 游戏与合成数据获取 系统依托计算资源与软件平台,采集与动作信号、相机状态时间对齐的视觉观测数据。

获取完成后,数据剖析模块作为关键标准化层。由于通用视频缺少游戏/UE数据的相机信息,我们先利用前沿位姿估计模型[33, 61–62]生成相机内参与外参伪标签。随后,系统执行基础过滤,按分辨率、时长剔除低质样本,并使用通用算法将视频切分为适配训练的片段[11, 67]。最后,借助视觉-语言模型(VLM)[54, 56, 70]完成语义分析,评估视觉质量、运动幅度、场景视角等属性,完成数据集筛选。

经过获取与过滤后,数据标注模块通过视觉-语言模型(VLM)[42, 75]为语料补充语义元数据。我们采用层级标注策略,生成三类描述,实现视频内容的多粒度理解:覆盖环境与相机运动的完整叙事标注、仅聚焦环境的场景静态标注、细粒度时间对齐的密集时序标注。

2.1 数据获取

2.1.1 通用视频筛选器

针对内部与开源仓库的海量原始视频数据,高效的数据筛选至关重要[9, 23, 55]。我们开发通用视频筛选器,过滤并检索符合训练目标的高价值样本。筛选优先聚焦世界探索类视频内容,最大化运动模式与环境场景的广度,涵盖行走、骑行、交通等多种移动方式,视角覆盖人/动物第一人称与第三人称。

2.1.2 游戏数据获取

我们搭建专用游戏数据获取平台,高精度采集与同步视觉数据、智能体动作、相机运动[49]。为保证纯净视觉基准,显示环境配置为无界面叠加,通过合适编码器保障视觉质量一致性。用户控制信号带高精度时间戳注册,确保与视频帧严格同步;同时记录相机轨迹,保障几何信息可靠。

为覆盖多样行为与复杂环境,我们制定标准化采集策略,分为四大类:

- 导航:覆盖虚拟世界常规移动

- 自由导航:随机轨迹的随机探索

- 环路漫游:闭合路径或多点往返录制

- 过渡导航:高差异场景切换,如走出建筑、跨室内环境切换

- 观光:细粒度观察,静态/动态环境细节审视、地标物体环绕拍摄,保障多视角一致性

- 长尾场景:覆盖标准数据缺失的罕见关键分布

- 固定观察:固定位置无平移,含360°旋转环视静态环境、固定视角记录动态元素(人群、车流)

- 后退导航:边后退边保持环境感知

- 世界交互:捕捉智能体-环境因果关系,从局部动作(拾取、开门)到触发重大状态变化的事件(战斗、破坏)

2.1.3 合成渲染流水线

本流水线基于虚幻引擎[18]生成可扩展合成数据集,提供精准相机位姿与自定义导航轨迹,两大核心优势:

- 提供动作训练所需的精准时间对齐相机位姿,真实世界传感器难以达到该保真度

- 突破真实数据集的轨迹偏向(多为前向运动),扩充空间记忆所需的重观测轨迹密度

为实现该能力,我们搭建轻量化自动化工作流:

- 在场景内随机采样语义合理的位置与朝向作为起点

- 随机参数采样或导入运动先验,自动生成相机轨迹

- 对轨迹执行严格碰撞检测

- 确认轨迹后渲染视频,并导出同步的真实相机位姿

轨迹生成阶段设两种模式,平衡随机多样性与行为真实性:

- 程序化路径生成:自主合成复杂相机运动,最大化环境探索,核心策略

- 几何模式合成:生成随机尺度矩形路径、多转速360°旋转等结构化轨迹,提供全景上下文,通过重复环境覆盖强化长期空间一致性

- 多点插值:随机空间路径点采样并双向回视过渡,强化空间关系记忆

- 真实轨迹导入:将物理设备采集的路径直接导入虚幻引擎,融入真实人类浏览行为(反复扫视房间、重访关注物体),保留手持运动细微特征(自然抖动、速度变化),还原真实用户交互的随机性与时间复杂度

2.2 数据剖析

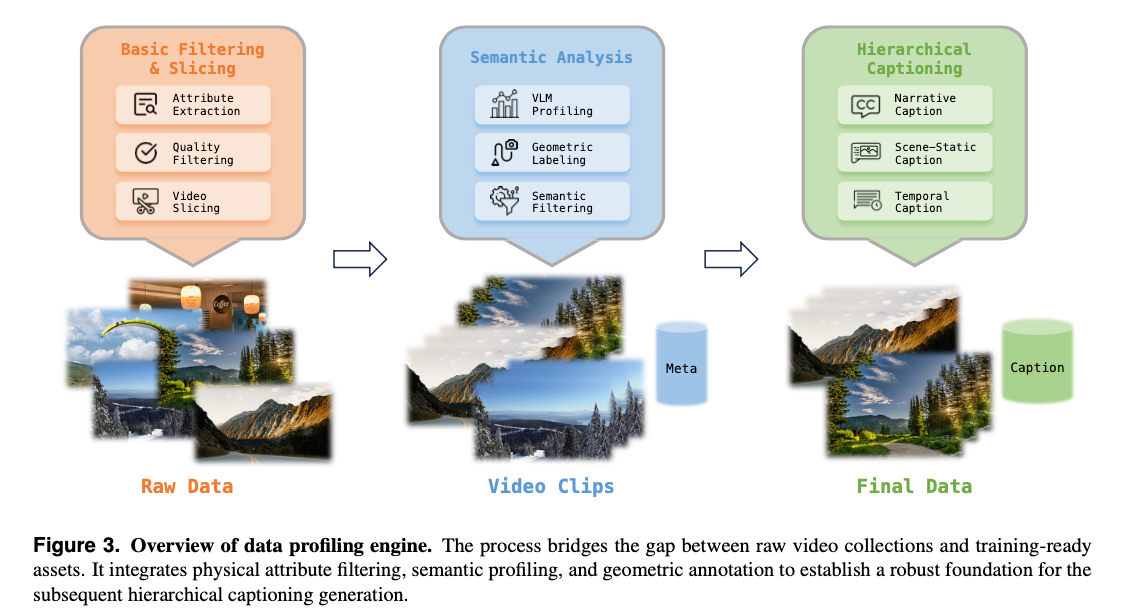

数据获取后,剖析引擎对每条视频提取多维元数据,分三级粒度执行,如图3所示。

图3 数据剖析引擎总览 该流程打通原始视频到训练资产的链路,融合物理属性过滤、语义剖析、几何标注,为层级标注生成提供稳健基础。

2.2.1 基础过滤与时序切片

基础层提取视频时长、分辨率、文件大小等基础属性,建立数据集基础索引。基于元数据剔除分辨率、时长不达标样本。随后,采用Koala[82]切片算法与TransNet v2[67]将视频切分为适配训练的片段,保留每段语义连贯性,保障下游高质量视频源。

2.2.2 语义分析

语义分析阶段,用内部视觉-语言模型(VLM)提取全套过滤属性,评估视觉质量(亮度、锐度)、量化运动幅度、识别场景类型与视角(第一/第三人称),为下游精准数据筛选提供依据。

为弥补原始视频几何信息缺失,用MegaSAM[37]为无几何信息视频生成相机位姿标注,确保所有样本具备训练所需的3D结构先验。

综上,两阶段剖析打通原始视频到训练资产的链路,将基础物理属性、高层语义描述、几何数据结合,为后续层级标注筑牢基础。

2.3 数据标注

数据筛选与剖析完成后,引入层级标注模块。为高效训练世界模型,我们设计专用标注策略,超越简单标签,为每条视频生成三类标注,适配不同粒度的语义控制与运动解耦:

- 完整叙事标注:全局、详细描述整条视频,融合视觉环境、相机轨迹与时间演变,作为全局语义提示

- 场景静态标注(动作解耦):仅描述静态环境与美学细节,刻意省略相机运动、角色动作,是世界模型解耦运动控制与场景生成的关键

- 密集时序标注:将视频分段,逐段细粒度时间对齐描述事件,支撑时间对齐训练

层级标注框架确保每条视频片段搭配丰富结构化文本条件,既覆盖静态视觉细节,也编码动态演变与相机意图。

3 LingBot-World

3.1 公式化表述

我们将世界模型公式化为条件生成过程,用于模拟由智能体动作驱动的视觉状态演化。设 V = { x 1 , x 2 , . . . , x T } V=\{x_{1}, x_{2}, ..., x_{T}\} V={x1,x2,...,xT} 表示视频帧序列,其中 x t ∈ R H × W × C x_{t} \in \mathbb{R}^{H ×W ×C} xt∈RH×W×C 表示时间步 t t t 的状态。设 A = { a 1 , a 2 , . . . , a T } A=\{a_{1}, a_{2}, ..., a_{T}\} A={a1,a2,...,aT} 表示对应的控制信号(动作)序列。

LingBot-World的目标是学习参数化模型 θ \theta θ,以近似环境的转移动力学。我们不严格将模型限制为单步预测,而是将目标一般化为:给定历史帧与当前控制信号,最大化未来状态的对数似然:

m a x θ E [ l o g p θ ( x t : t + L ∣ x < t , a t : t + L ) ] , ( 1 ) max _{\theta} \mathbb{E}\left[log p_{\theta}\left(x_{t: t+L} | x_{<t}, a_{t: t+L}\right)\right], \quad (1) maxθE[logpθ(xt:t+L∣x<t,at:t+L)],(1)

其中 L ≥ 1 L ≥1 L≥1 表示预测时域。为弥合标准视频生成器与高效交互式世界模拟器之间的差距,我们提出多阶段演进策略,将学习过程分解为三个渐进阶段:基础构建、知识注入、交互就绪。

3.1.1 阶段I:预训练——构建通用视频先验

初始阶段聚焦于建模自然视频序列的无条件分布,构建视觉动力学的通用先验。为此,我们基于大规模开放域视频数据预训练基础视频生成器,为LingBot-World赋予强大的时空一致性与开放域语义理解能力。该预训练模型可合成高保真物体纹理与连贯场景结构,作为后续交互动力学的通用视觉“画布”,而非编码特定物理规则。

3.1.2 阶段II:中训练——注入世界知识与长期动力学

中阶段将初始生成器升级为双向世界模型。在通用公式(1)中令 t = 0 t=0 t=0,即契合双向范式,使模型先捕获全局时间依赖,不受因果历史约束。尽管预训练模型在高保真视频生成上表现优异,但局限于短视频片段,且缺乏交互逻辑。因此,我们通过专用数据引擎进一步训练LingBot-World,融入动作控制、时间一致性与领域特定规则。本阶段核心改进如下:

- 长期一致性:为提升记忆容量,基于长视频序列训练模型。通过观测长时程上下文帧,LingBot-World学习缓解视频生成中的“遗忘”问题,确保生成的视觉世界在数分钟的交互中保持连贯,而非仅数秒。

- 动作可控性:为引入交互能力,通过自适应归一化[77, 84]将用户定义的动作信号融入模型。以显式动作为条件,LingBot-World生成的视觉世界不再由随机噪声驱动,而是遵循用户指定指令。

注:本阶段模型已成为完整的世界模拟器,可基于动作生成高保真未来轨迹,但依赖双向注意力,实时推演计算开销过大。

3.1.3 阶段III:后训练——因果架构适配与少步蒸馏

最终阶段将双向世界模型转换为高效自回归系统,支持实时交互生成。将公式(1)推广至 t ≥ 0 t ≥0 t≥0 并以历史上下文 x < t x_{<t} x<t 为条件,公式无缝切换至因果范式,满足交互所需的分步推理。尽管阶段II模型精准捕获世界动力学,但标准双向扩散模型因全时间注意力与多步迭代去噪,计算开销过高,难以部署。我们通过以下方式解决:

- 因果架构适配:将全时间注意力替换为分块因果注意力,结合块内局部双向依赖与块间全局因果性。以高噪声专家(阶段II)初始化模型,采用混合时间步协议训练,实现专家专业化衔接。该设计通过键值缓存(KV caching)支持高效自回归生成,同时保留时间一致性。

- 少步蒸馏:采用分布匹配蒸馏(DMD),结合自推演训练与对抗优化[39, 86–87]。该双路径方法蒸馏出少步生成器,在长时程推演中保持动作条件动力学与视觉保真度,无显著漂移。

图4 LingBot-World训练流程总览

我们提出多阶段演进策略,将基础视频生成器转换为交互式世界模拟器。预训练阶段构建稳健的通用视频先验,保障高保真开放域生成;中训练阶段注入世界知识与动作可控性,使模型能模拟具备一致交互逻辑的长期动力学;后训练阶段适配架构以支持实时交互,通过因果注意力与少步蒸馏实现低延迟与严格因果性。

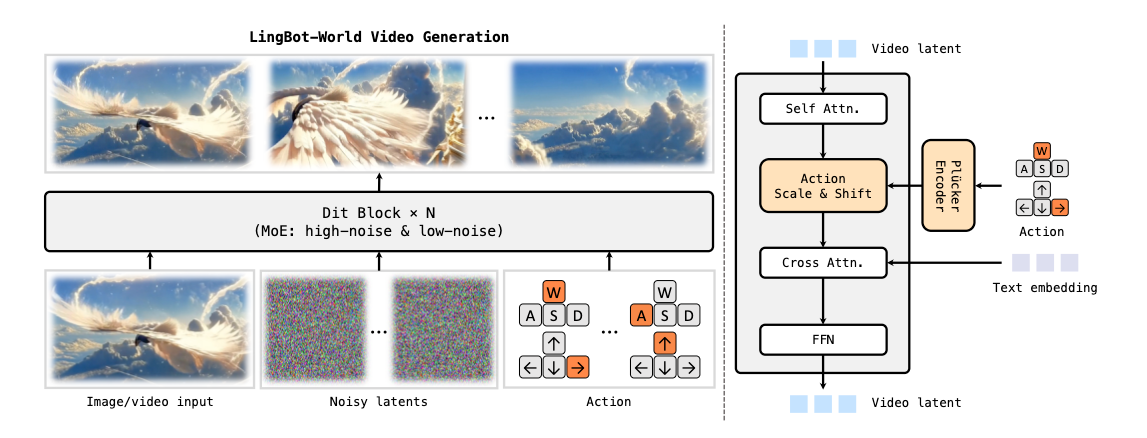

图5 LingBot-World流程 左侧为LingBot-World视频生成流程。LingBot-World以图像/视频、噪声隐变量与用户定义动作信号为输入,生成具备空间记忆、长期一致性与精准动作跟随能力的视频序列。右侧为LingBot-World中DiT模块的架构。视频隐变量先经过自注意力层,使模型学习时空一致性并涌现空间记忆能力;随后通过普吕克编码器(Plücker Encoder)注入动作信号,将输入动作投影为普吕克嵌入,并通过自适应归一化将其转换为缩放与偏移因子,调制视频隐变量;最后施加跨注意力层,以文本嵌入为条件约束视频隐变量。

3.2 预训练

预训练阶段的目标是选取预训练模型,为后续阶段提供强大的视频先验,使LingBot-World能生成多样、连贯、高保真的视频。近期世界模型研究[6, 13, 26](如Genie 3[5])已证明,从强大的视频基础模型初始化交互式世界模型的有效性。这类视频基础模型[25, 52, 60, 69, 76]可提供强大的内部先验(视觉真实性、物体恒存性、时间动力学),显著加速交互物理与可控视觉世界生成的学习进程。为此,我们采用140亿参数的Wan2.2图像转视频扩散模型[77]作为预训练模型,该模型尤其擅长捕获复杂时空一致性,生成高保真视频内容。

3.3 中训练

中训练阶段将预训练的视频扩散模型转换为双向世界模型,生成连贯、可交互的视觉世界。尽管预训练模型在高保真视频合成上表现优异,但天生局限于短视频片段,无法响应用户定义的动作信号。为解决该问题,我们依托前文提出的数据引擎(2节),为中训练阶段生成动作条件、长时程扩展的视频序列。本阶段包含三大核心组件:

- 训练基础世界模型,获取长期时间一致性与涌现空间记忆,保障生成世界的稳定性(3.3.1节);

- 微调该基础世界模型,通过向DiT模块注入用户定义动作信号,支持动作条件生成,实现可控动力学(3.3.2节);

- 由于基础世界模型训练计算密集,搭建并行基础设施,实现高效训练,同时将GPU内存消耗控制在合理范围(3.3.3节)。

通过中训练阶段,LingBot-World逐步学习长期时间一致性、空间记忆与精准的动作条件动力学,弥合随机视频生成与交互式可控世界建模之间的差距。

3.3.1 基础世界模型

如图5所示,LingBot-World以图像/视频、噪声隐变量与用户动作为输入,生成可控视觉世界,而非随机视频合成。我们首先训练基础世界模型:给定任意初始状态(单张图像或视频),生成兼具长期视频一致性与空间记忆的视觉世界。训练策略如下:

- 混合专家(MoE)架构:沿用Wan2.2图像转视频扩散模型[77]的MoE设计[51],在提升模型性能的同时,推理开销基本不变。针对扩散过程的不同去噪阶段,LingBot-World采用双专家设计:高噪声专家在早期时间步激活,专注建模全局结构与粗粒度布局;低噪声专家在后期时间步激活,优化细粒度时空细节。每个专家约140亿参数,模型总规模280亿参数,但每个去噪时间步仅激活一个专家。该设计使推理时的计算量与GPU内存消耗接近稠密140亿参数模型。

- 渐进式课程训练:为实现长期视频一致性与空间记忆,采用渐进式课程训练策略。第一轮用5秒视频序列训练基础世界模型,拓宽内部生成域(预训练模型分布较窄);随后将训练时长从5秒逐步扩展至60秒,让模型学习长期时间一致性,催生空间记忆能力。同时,随视频时长增加逐步调整流移比例。该设计基于观察:长视频生成需更侧重高噪声时间步(负责全局场景结构),提升高噪声时间步占比可稳定长时程场景结构,减少漂移,提升长视频生成效果。

- 多任务训练:为赋予模型从任意初始条件预测未来世界状态的能力,采用图像转视频与**视频转视频(视频续播)**双目标多任务训练范式。两类任务对应不同初始状态:图像转视频使模型能从单张静态帧推演未来动力学;视频转视频则从历史序列预测未来帧,外推已观测运动。通过联合优化互补任务,模型学习统一的世界转移函数,泛化至多样初始条件,能从任意时间起点稳健预测未来世界状态。

3.3.2 动作条件世界模型

在训练基础世界模型以建立长期时间一致性与空间记忆后,我们进一步微调模型以支持交互控制。本阶段通过注入用户定义的动作信号,将视频生成器转换为响应式世界模拟器。

- 动作表示:为实现对生成环境的精准控制,采用混合动作表示策略,结合连续相机旋转与离散键盘输入(如W、A、S、D)。具体而言,使用普吕克嵌入(Plücker embeddings)表示相机旋转,提供适配连续三维变换的几何表示;同时将离散交互编码为多热向量。两种模态沿通道维度拼接融合,确保模型可处理平滑视角变化与明确的逻辑状态转换。

- 动作注入机制:为在不破坏预训练视觉先验的前提下将动作信号融入扩散过程,采用**自适应层归一化(AdaLN)**机制[84]。融合后的动作嵌入经投影注入DiT模块,使动作信号动态调制归一化特征,引导去噪过程生成与指定动作一致的视频帧。

- 微调范式:采用参数高效微调策略,保留基础模型的生成质量。具体而言,冻结预训练基础世界模型的主DiT模块,仅微调新增的动作适配层(含动作嵌入投影与AdaLN参数)。该设计基于两大核心动机:

- 有效解耦固有视频生成能力与动作控制能力;

- 高质量动作标注数据稀缺且多为合成数据(源自2.1.2节数据引擎),全量微调稠密模型存在灾难性遗忘或基础视觉质量退化风险。冻结主干网络确保模型保留高保真视频合成能力,同时学习遵循控制信号。

3.3.3 并行基础设施

在一分钟视频序列上训练280亿参数的LingBot-World基础世界模型,对GPU内存提出极高要求。原因在于大模型尺寸、长令牌长度,以及梯度计算、优化器状态管理、激活检查点等内存密集型操作的叠加。为克服这些挑战,我们搭建并行基础设施,将计算与内存高效分布至多块GPU。

- 全分片数据并行2(FSDP2):为支持280亿参数LingBot-World的高效训练,采用FSDP2[91]实现可扩展数据并行。FSDP2采用全分片方案,每块GPU仅持有模型参数、梯度与优化器状态的一部分,可训练超出单GPU内存上限的大规模模型。此外,通过通信与计算重叠及其他系统级优化,FSDP2实现高训练效率,模型尺寸与GPU数量增加时吞吐量接近线性扩展。

- 上下文并行(CP):为缓解长令牌长度带来的内存瓶颈,采用Ulysses[32]上下文并行策略。Ulysses沿时间(序列)维度划分输入张量,将切片分布至多块GPU。注意力计算时,高效的全对全集体通信模式重新分配所需激活,使每个设备可在本地计算其序列分片上的注意力。通过对序列维度分片,显著降低激活与注意力相关中间变量的单GPU内存占用,使LingBot-World可并行处理长序列。

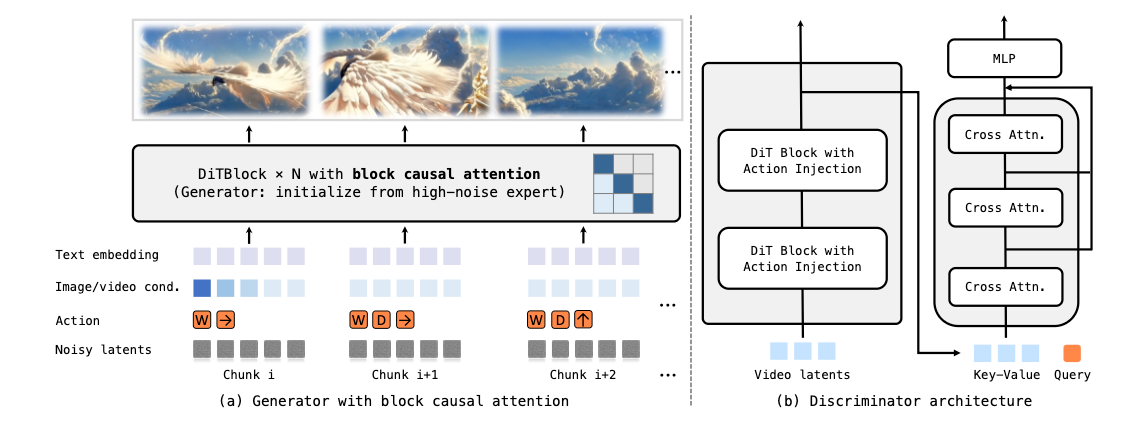

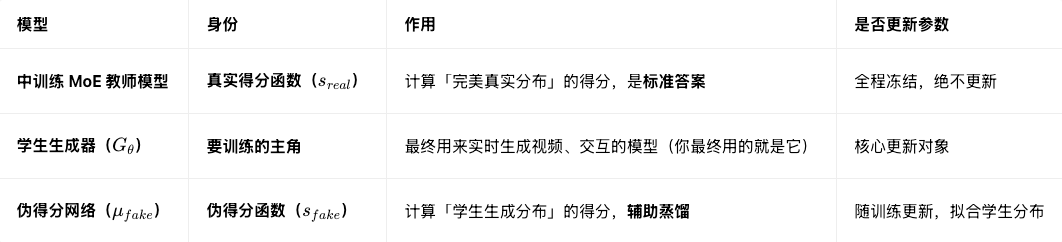

3.4 后训练

后训练阶段将双向世界模型转换为支持实时交互生成的高效自回归模型。该转换解决了双向注意力在实时应用中的计算约束,同时保留中训练阶段学习的丰富动力学。后训练方法包含两大关键阶段:首先通过扩散强制(diffusion forcing)机制[12]将双向架构适配为因果框架(3.4.1节);其次结合长时程训练实施少步蒸馏,将教师模型能力迁移至学生模型(3.4.2节)[30, 39]。整个过程优先保留两大核心能力:精准的动作条件动力学建模,以及长时程序列中持续的视觉保真度,无累积漂移。

图6 (a) 因果生成器适配。为实现自回归流式生成,我们采用分块因果注意力对高噪声专家进行适配。该机制在块间施加全局因果约束,同时维持局部双向一致性,以高效执行基于动作的序列推演。

(b)判别器架构。针对长时程训练,我们在伪得分网络的特征之上附加一个GAN分类头 D ( ⋅ ) D(\cdot) D(⋅)。该判别器借助跨注意力区分真实序列与合成序列,以此缓解分布匹配蒸馏过程中出现的累积漂移问题。

3.4.1 因果架构适配

- 模型初始化:中训练模型为混合专家图像转视频扩散模型,包含两个串行专家:高噪声专家与低噪声专家,分别专攻扩散过程特定时间步范围。为简化训练与推理,基于高噪声专家的优异动力学建模能力初始化因果学生模型。从中训练模型初始化可借助渐进式课程学习获得固有优势,模型已具备处理可变长度令牌序列的能力,使因果适配更稳定,可泛化至不同长度的推演。实验验证,从高噪声专家初始化相比低噪声专家,动作条件动力学建模效果更优。

- 架构适配:参照近期自回归视频蒸馏框架[14, 60],将双向教师模型适配为因果世界模型。具体而言,将全双向时间注意力替换为分块因果注意力,结合局部双向注意力与全局因果约束,平衡建模能力与自回归需求[30, 88]。每个时间块内,令牌双向注意力以捕获短程时间依赖,保持相邻帧局部一致性;块间注意力严格遵循因果性,当前块令牌仅能关注同块或前置块令牌,消除未来帧依赖。该混合注意力模式支持无界自回归生成,同时保留长程时间一致性。推理阶段,因果结构通过键值缓存支持高效流式生成,复用先前块的缓存表示,仅计算新生成令牌的注意力,大幅降低每步计算开销。

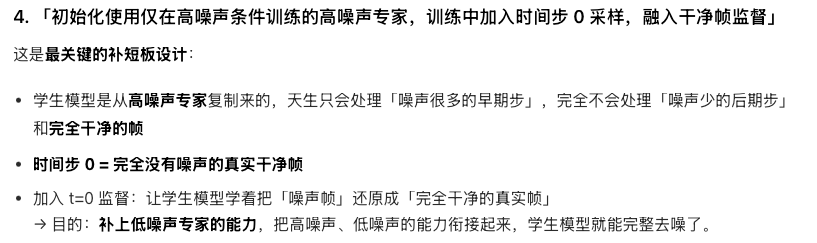

- 训练协议:训练时,将含N个噪声视频帧的序列划分为L个块,每个块按扩散强制范式[12, 88]分配独立噪声时间步。为在保留模型表达能力的同时优化训练效率,仅针对少量精选目标时间步 { t 1 , . . . , t m } \{t_{1}, ..., t_{m}\} {t1,...,tm}训练,作为后续阶段蒸馏目标。这些时间步覆盖去噪轨迹,同时保证计算可行性。由于初始化使用仅在高噪声条件训练的高噪声专家,训练中加入时间步0采样,融入干净帧监督[28, 69],使模型学习干净隐变量编码能力,有效衔接教师模型中高噪声与低噪声专家的专业化差距。训练损失公式如下:

L = E x i ∈ p ( x ) , t ∈ { t 1 , . . . , t m } ∥ G θ ( x t i , t , a ) − x 0 i ∥ 2 , \mathcal{L}=\mathbb{E}_{x^{i} \in p(x), t \in\left\{t_{1}, ..., t_{m}\right\}}\left\| G_{\theta}\left(x_{t}^{i}, t, a\right)-x_{0}^{i}\right\| ^{2}, L=Exi∈p(x),t∈{t1,...,tm} Gθ(xti,t,a)−x0i 2,

其中 G θ G_{\theta} Gθ 为学生网络, p ( x ) p(x) p(x) 为视频数据分布, a a a 为动作条件。

把长视频切块、只训关键噪声步、加干净真实帧监督,用简单损失逼着学生模型学会完整去噪 + 因果推理,补齐高噪声专家缺失的能力,最终变成能实时交互的世界模型。

3.4.2 结合长时程训练的少步蒸馏

尽管因果适配模型可生成符合用户输入动作的视觉合理视频帧,但因训练与推理条件的分布不匹配,超出训练时域后会出现显著累积漂移。为解决这一核心挑战,采用融合自强制训练与先进分布匹配技术的完整蒸馏框架。

- 自推演扩展时域训练:参照自强制范式[30, 40, 43, 85],基于学生模型自身生成序列训练,缩小训练-测试差距。训练时,模型以高效滚动键值缓存存储的先前生成帧为条件,迫使模型从自身生成瑕疵与累积误差中建立稳健恢复机制。该方法确保模型学习处理自回归生成中自然出现的分布偏移。为管控长时程推演的巨大计算开销,采用随机梯度截断策略:仅对最近K个生成步反向传播梯度,前向计算保留完整上下文,平衡训练效率与长程依赖学习。

- 分布匹配与对抗优化:应用**分布匹配蒸馏(DMD)**结合对抗优化[86–87],提升样本质量与时间一致性。以中训练混合专家教师模型为真实得分函数,用相同混合专家教师初始化伪得分网络以实现全步得分匹配。针对动作条件生成,关于学生参数 θ \theta θ的梯度为:

∇ θ E t [ D K L ( p θ , t ∥ p d a t a , t ) ] = − E t , x ^ t ∼ q t ∣ 0 ( x ^ t ∣ x ‾ ) , x ~ ∼ p θ ( x ‾ ∣ a ) [ ( s r e a l ( x ^ t , t , a ) − s f a k e ( x ^ t , t , a ) ) ∂ x ^ ∂ θ ] ( 3 ) \nabla _{\theta }\mathbb {E}_{t}[D_{KL}(p_{\theta ,t}\| p_{data,t})]=-\mathbb {E}_{t,\hat {x}_{t}\sim q_{t|0}(\hat {x}_{t}|\overline {x}),\tilde {x}\sim p_{\theta }(\overline {x}|a)}\left[ \left( s_{real}\left(\hat {x}_{t},t,a\right) - s_{fake}\left(\hat {x}_{t},t,a\right)\right) \frac {\partial \hat {x}}{\partial \theta }\right](3) ∇θEt[DKL(pθ,t∥pdata,t)]=−Et,x^t∼qt∣0(x^t∣x),x~∼pθ(x∣a)[(sreal(x^t,t,a)−sfake(x^t,t,a))∂θ∂x^](3)

其中 p θ , t p_{\theta, t} pθ,t 为学生模型在时间步 t t t的分布, p d a t a , t p_{data , t} pdata,t 为数据在时间步 t t t的分布, x ˉ \bar{x} xˉ 为学生生成的干净样本, x ^ t \hat{x}_{t} x^t 为前向扩散得到的噪声版本, a a a 为动作条件, s r e a l s_{real } sreal 与 s f a k e s_{fake } sfake 分别为真实与伪得分网络的近似得分。该梯度等价于以下易处理优化目标:

L D M D ( θ ) = E t , x ^ t , x ^ , a [ 1 2 ∥ x ^ − s g [ x ^ − ( μ r e a l ( x ^ t , t , a ) − μ f a k e ϕ ( x ^ t , t , a ) ) ] ∥ 2 ] , ( 4 ) \mathcal {L}_{DMD}(\theta )=\mathbb {E}_{t,\hat {x}_{t},\hat {x},a}\left[ \frac {1}{2}\left\lVert \hat {x}-sg\left[ \hat {x}-\left( \mu _{real}(\hat {x}_{t},t,a)-\mu _{fake}^{\phi }(\hat {x}_{t},t,a)\right) \right] \right\rVert ^{2}\right] ,(4) LDMD(θ)=Et,x^t,x^,a[21 x^−sg[x^−(μreal(x^t,t,a)−μfakeϕ(x^t,t,a))] 2],(4)

其中 μ f a k e ϕ \mu_{fake }^{\phi} μfakeϕ 为带参数 ϕ \phi ϕ的伪得分网络, s g [ . ] sg[.] sg[.] 为停止梯度算子。DMD训练中,学生网络按公式(4)更新,伪得分网络 μ f a k e ϕ \mu_{fake }^{\phi} μfakeϕ 基于学生生成视频以标准扩散损失训练,真实得分网络 μ r e a l \mu_{real } μreal 保持固定。参照文献[86],采用双时间尺度更新规则:学生每更新一次,伪得分网络 μ f a k e ϕ \mu_{fake }^{\phi} μfakeϕ 多次更新,使 μ f a k e ϕ \mu_{fake }^{\phi} μfakeϕ 紧密跟踪学生输出分布的演化,提升训练稳定性与蒸馏质量。

但DMD训练(分布匹配蒸馏训练)后,蒸馏生成器与教师模型仍存在性能差距,例如学生生成视频质量下降。差距源于多重因素:首先,学生从高噪声模型初始化,未继承低噪声模型学习的知识(负责细节与高频合成);其次,将注意力掩码替换为因果变体,推理时仅用少量采样步,进一步限制生成质量;更重要的是,DMD训练中生成器与教师均未直接受真实数据监督,可能导致学生继承教师的偏差与误差。为缓解这些问题,引入基于对抗训练的额外目标[21]:生成器旨在欺骗判别器,判别器学习区分真实视频与合成视频。借助真实数据监督,蒸馏生成器不再严格受教师限制,有望提升样本真实性与感知质量。

具体而言,在DMD的伪得分网络上附加分类头 D ( ⋅ ) D(\cdot) D(⋅),分类头架构参照APT[39]设计。对抗目标为:

L G = E p ( x ‾ ) [ f ( 1 − D ( μ f a k e ( x ‾ t , t , a ) ) ) ] , ( 5 ) \mathcal{L}_{G}=\mathbb{E}_{p(\overline{x})}\left[f\left(1-D\left(\mu_{fake }\left(\overline{x}_{t}, t, a\right)\right)\right)\right], \quad(5) LG=Ep(x)[f(1−D(μfake(xt,t,a)))],(5)

L D = E p ( x ) [ f ( D ( μ f a k e ( x t , t , a ) ) ) ] − E p ( x ~ ) [ f ( 1 − D ( μ f a k e ( x ~ t , t , a ) ) ) ] , ( 6 ) \mathcal {L}_{D}=\mathbb {E}_{p(x)}[f(D(\mu _{fake}(x_{t},t,a)))]-\mathbb {E}_{p(\tilde {x})}[f(1-D(\mu _{fake}(\tilde {x}_{t},t,a)))],\quad(6) LD=Ep(x)[f(D(μfake(xt,t,a)))]−Ep(x~)[f(1−D(μfake(x~t,t,a)))],(6)

其中 p ( x ) p(x) p(x) 与 p ( x ~ ) p(\tilde{x}) p(x~) 分别为真实与合成视频分布, μ f a k e \mu_{fake } μfake 为伪得分网络, t t t 为自强制[30]中当前去噪时间步, f ( ⋅ ) f(\cdot) f(⋅) 为软加函数。值得注意的是,对抗损失仅用于更新判别器头 D D D,伪得分网络 μ f a k e \mu_{fake } μfake 仅用DMD损失更新。此外,本设置中DMD目标足够稳定,未施加R1或R2[47]等正则项。借助增强对抗目标,在保留动作跟随能力与长时程时间一致性的同时,视觉质量显著提升。

4 评估

4.1 定性分析

4.1.1 多样结果

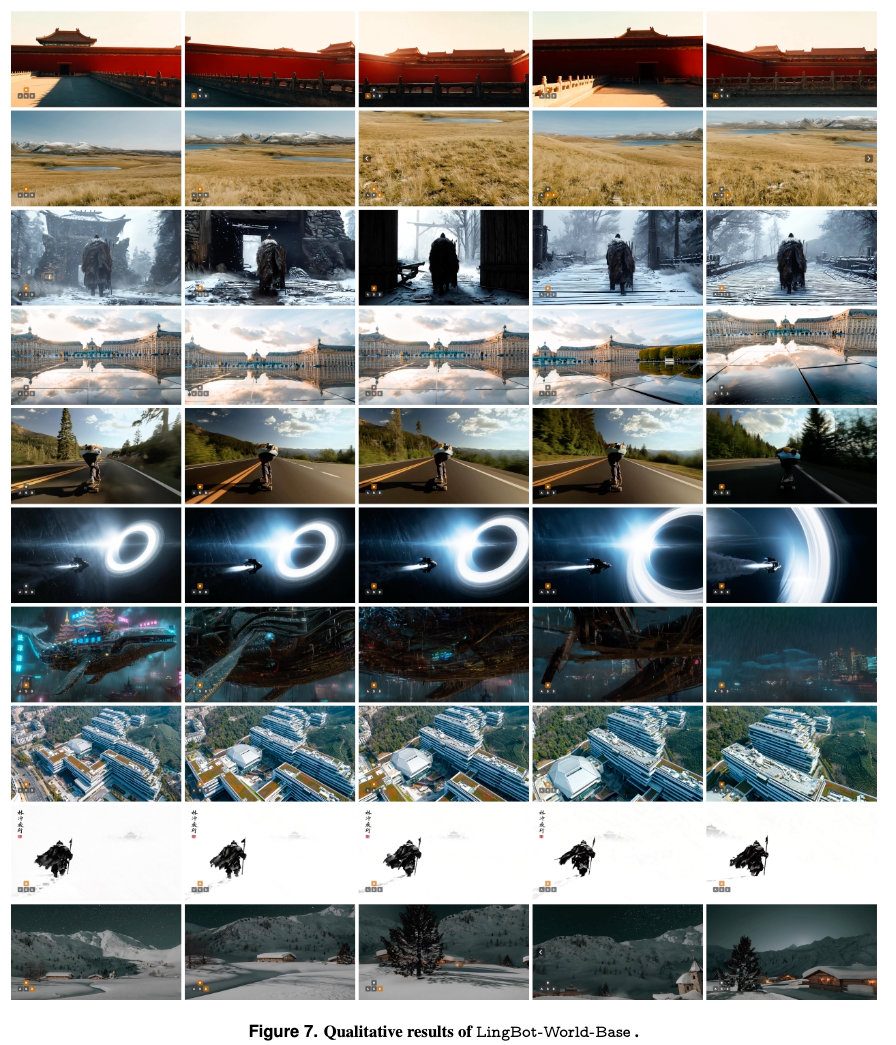

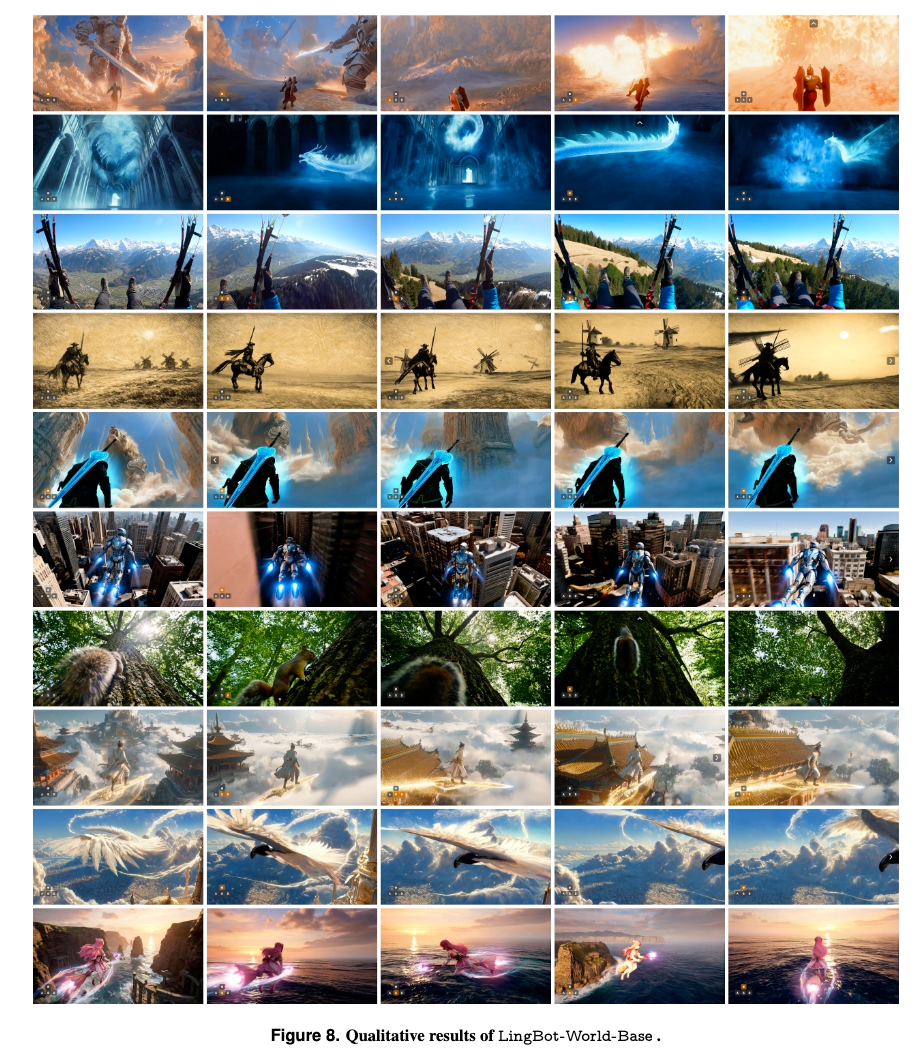

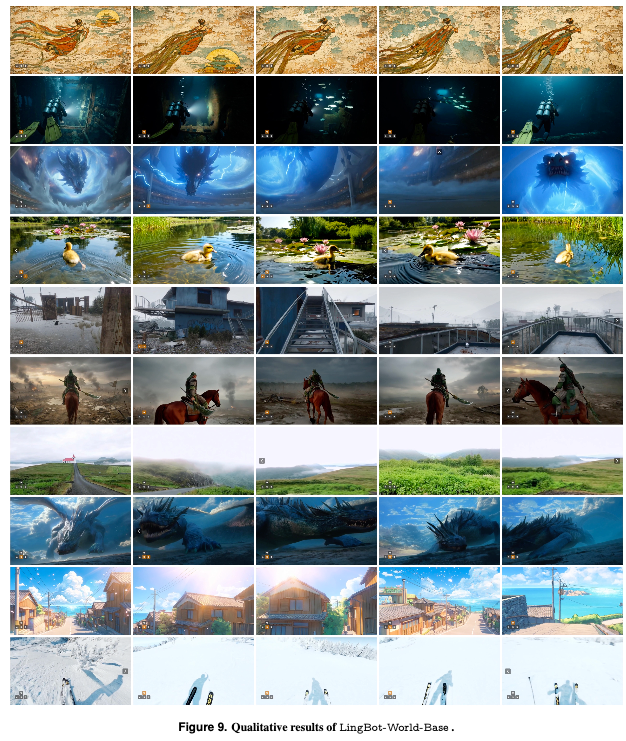

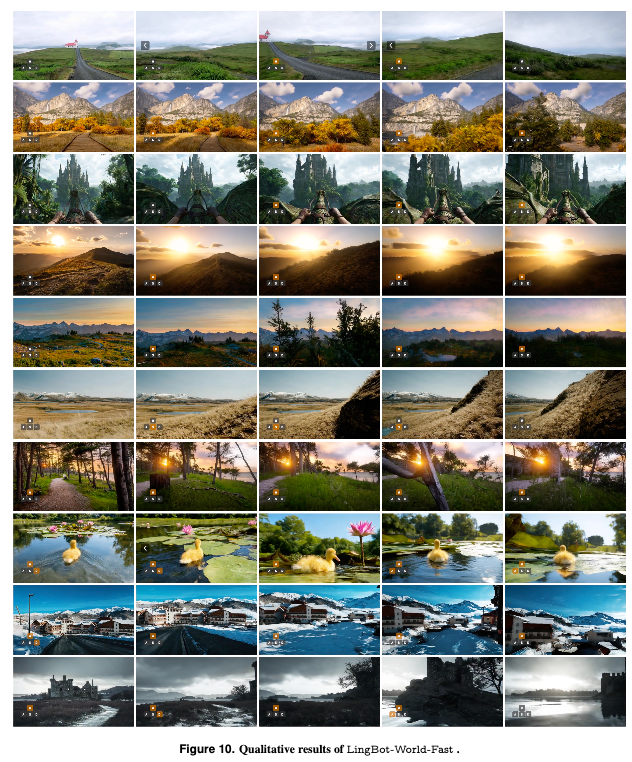

我们通过分析中训练模型LingBot-World-Base与后训练模型LingBot-World-Fast在多样场景下的定性输出,评估框架的泛化能力。

图7至图9展示LingBot-World-Base的结果,每行按时间采样关键帧。首先,高保真的LingBot-World-Base可有效处理不同物体属性与复杂空间布局,帧间过渡平滑且逻辑一致,体现模型捕获细粒度环境动力学的能力。

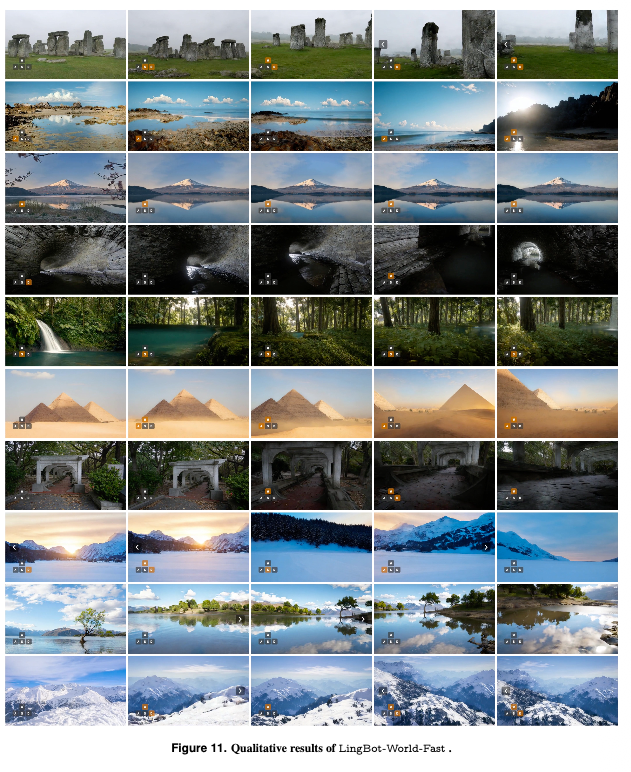

在此基础上,我们进一步分析实时变体LingBot-World-Fast——该模型在单GPU节点处理480p视频时,可达到16帧/秒的吞吐量。尽管加速过程在理论上限质量上存在必要折中,但视觉退化在感知上微乎其微。如图10与图11所示,LingBot-World-Fast成功保留教师模型的结构完整性与物理逻辑,适配动态交互且无明显视觉伪影或模式崩溃,实现推理速度与生成质量的最优平衡。

图7 LingBot-World-Base定性结果

图8 LingBot-World-Base定性结果

图9 LingBot-World-Base定性结果

图10 LingBot-World-Fast定性结果

图11 LingBot-World-Fast定性结果

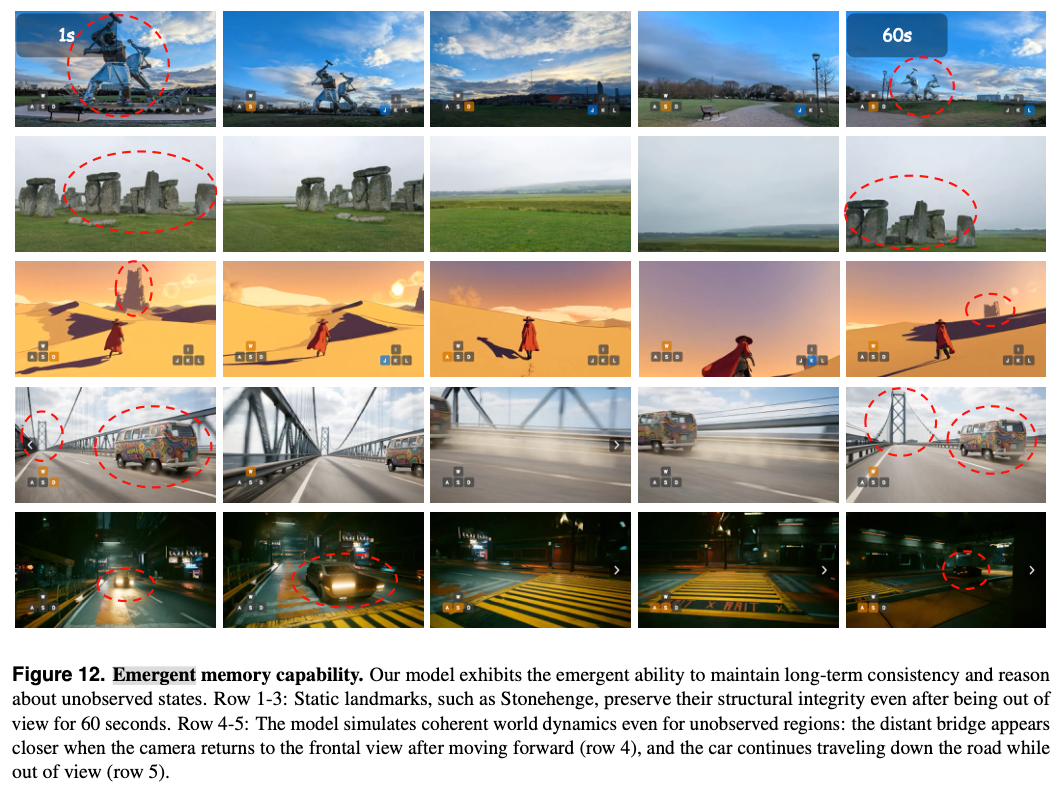

图12 涌现记忆能力

本模型展现出涌现能力:能够维持长期一致性,并对未观测状态进行推理。第1–3行:诸如巨石阵之类的静态地标,即使离开视野长达60秒,仍能保持结构完整。

第4–5行:模型即使对未观测区域也能模拟连贯的世界动力学: 相机向前移动后回到正面视角时,远处的桥显得更近(第4行);

汽车在离开视野期间,仍继续沿道路行驶(第5行)。

4.1.2 涌现记忆能力

LingBot-World的核心特性之一,是无需依赖高斯泼溅(Gaussian Splatting)[34]等显式三维表示,即可涌现全局一致性保持能力。如图12前3行所示,即使地标(雕像、巨石阵)离开视野长达60秒,模型仍能保留其结构完整性。这与已有观察一致[5, 46]:视频模型具备物体重现的隐式记忆。关键在于,与通常局限于静态场景重建的显式三维方法不同,本文基于视频的方案动态性更强,可自然建模流水、行人移动等复杂非刚性动力学——这类场景是传统静态三维表示难以处理的。

模型甚至涌现出推理未观测状态演化的能力。例如图12第4行,相机向前移动后回到正面视角,远处的桥被渲染得更近,精准反映随时间推移的向前运动。类似地,第5行中车辆离开画面、在视野外继续轨迹,并在物理合理的位置重新出现,而非消失或静止。这些行为表明,模型模拟的是真实世界底层的时空一致性,而非单纯记忆像素。

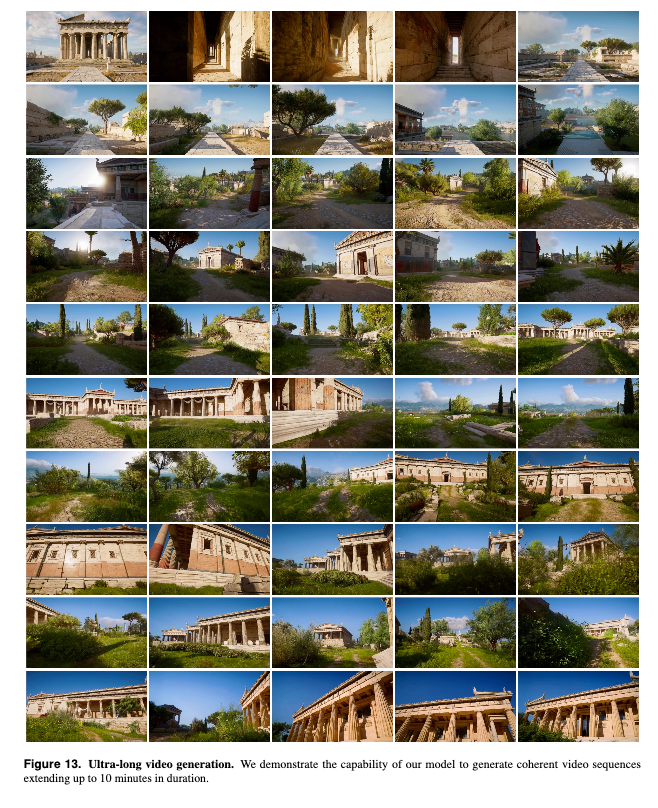

4.1.3 探索生成边界

如图13所示,我们突破视频合成时间一致性的边界,模型可维持稳定、高保真环境长达10分钟,视觉质量与叙事一致性无显著退化。该结果验证了本文方法处理长期时间依赖的鲁棒性。

图13 超长视频生成 本文模型可生成长达10分钟的连贯视频序列,验证其时长能力。

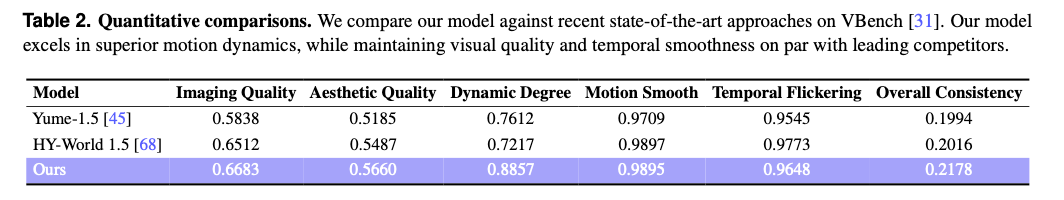

4.2 定量分析

定量评估方面,鉴于世界模型的评估协议仍处于初期阶段,且本文方法基于视频生成模型,我们在精选测试集(100条生成视频,每条时长超30秒)上采用VBench[31]开展全面分析,将LingBot-World与两款顶尖视频世界模型Yume-1.5[45]、HY-World 1.5[68]对比。如表2所示,本文方法在多数评估指标上表现更优。具体而言,视觉保真度上,模型在成像质量与美学质量均取得最高分,超越两款基线,说明生成场景具备更高真实感与视觉吸引力,这对交互式世界漫游的沉浸式体验至关重要。

表2 定量对比 基于VBench,本文模型与近期顶尖方案对比。本文模型在运动动力学上优势显著,同时视觉质量、时间平滑度与主流竞品相当。

对交互式世界模型而言,本文模型在动态程度上优势显著,得分0.8857,远超Yume-1.5的0.7612与HY-World 1.5的0.7217。该大幅差距表明,模型可响应用户控制生成更丰富的场景切换与更复杂的运动,避免视频生成中常见的静态模式。此外,尽管动态程度高,本文方法仍保持最佳整体一致性,验证模型在长期生成中始终保持对输入提示的强语义保真度。

时间特性方面,模型在运动平滑度与时间闪烁上取得有竞争力的结果,与主流基线HY-World 1.5相当,确保生成视频流流畅、无突兀伪影。综上,定量结果验证:相比现有方案,本文模型不仅提供更动态、交互性更强的环境,同时保持更优的视觉质量与一致性。

5 应用

本文的自回归框架通过以自然语言提示与离散动作为条件,将视频生成转换为交互式模拟。这种多模态可控性使模型可作为下游任务的通用平台。本节展示本设计支持的三大关键应用:(1) 提示式世界事件,用户通过文本语义控制全局与局部动力学;(2) 动作智能体,依托模拟器学习自主探索策略;(3) 三维重建,验证生成环境的涌现几何一致性与长期空间记忆。

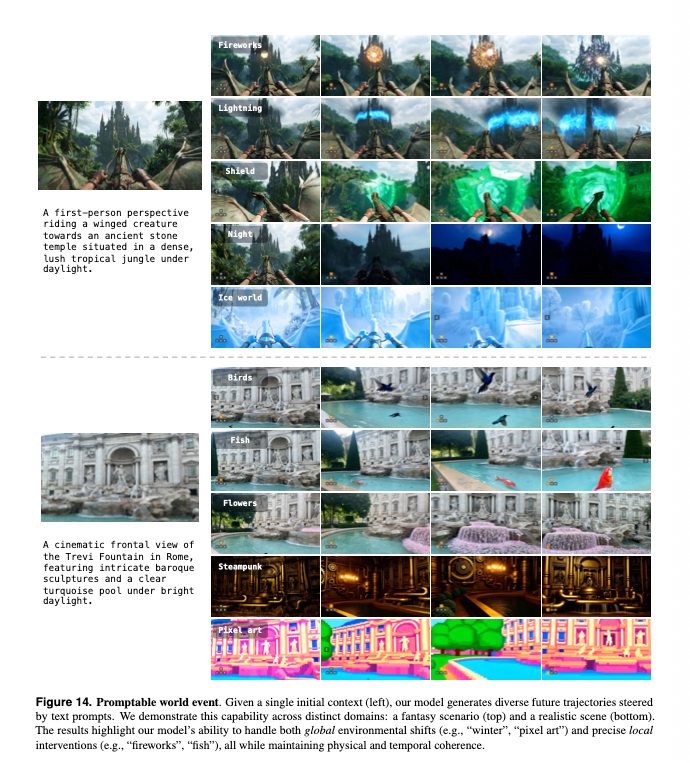

图14 提示式世界事件

给定单一初始上下文(左侧),模型可根据文本提示生成多样未来轨迹。本文在不同领域演示该能力:奇幻场景(上)与写实场景(下)。结果体现模型可处理全局环境变换(如“冬季”“像素风格”)与精准局部干预(如“烟花”“鱼”),同时保持物理与时间一致性。

5.1 提示式世界事件

本文主张采用响应式世界模型,模拟过程随交互动态变化,而非让用户在静态环境中被动导航。为此,我们演示提示式世界事件[5, 79]机制,支持用户通过自然语言主动引导未来轨迹。如图14所示,该能力将生成过程从单一确定性路径,拓展为多样化可能性的分支结构。给定单一初始上下文,模型可根据语义提示生成截然不同的未来,开启两大关键能力。

5.1.1 全局事件

全局事件指对模拟环境的整体修改,包括天气、光照与风格渲染。依托基础模型的文本条件特性与Ditto[3]变体,可在推理阶段通过调整提示词操控全局状态。如图14所示,加入环境描述(如“冬季”“夜晚”)可将场景无缝切换至目标域。模型可连贯渲染符合物理规律的效果(如城堡结冰、夜晚光照变化),同时保持与历史上下文的时间一致性。此外,模型支持风格域迁移,通过提示艺术风格(如“像素风格”“蒸汽朋克”),可转换视觉渲染效果,同时保留底层几何与运动动力学。

5.1.2 局部事件

局部事件指向场景中精准注入特定物体或动态智能体。如图14所示,用户可引入目标元素,如在城堡上方触发“烟花”、在喷泉处生成“鸟”与“鱼”。模型可将注入元素无缝融入动态场景,保证物理合理行为与时间稳定融合。这种细粒度控制对具身人工智能与自动驾驶至关重要,支持构建多样化、交互式训练环境,让智能体学习推理因果关系与动态变化。通过定义特定事件,可严格评估智能体感知、预测与响应细粒度物理交互的能力,弥合静态数据集学习与现实自适应之间的差距。

图15 动作智能体应用 给定初始图像,动作智能体预测一系列动作,模拟环境探索过程。预测的动作被转换为相机轨迹,驱动后续世界生成。

5.2 动作智能体

除学习动作条件世界模型外,我们还利用相同数据训练动作智能体,该智能体从单张视觉观测推断运动动力学,并以环境探索为激励,提升数据利用效率。

形式上,我们在图像-动作对上微调Qwen3-VL-2B[75]主干网络。每个训练样本由视觉观测与后续动作块序列 ( a 0 , a 1 , . . . ) (a_{0}, a_{1}, ...) (a0,a1,...)组成,每个 a i a_{i} ai指定驱动智能体探索环境的后续动作。给定视觉观测,模型学习预测未来动作。

本文设置中,智能体输出未来10秒的动作,包括用于移动的离散键盘控制(W、A、S、D)与用于相机旋转的离散鼠标方向(I、J、K、L)。预测的动作被转换为运动轨迹,输入世界模型以生成对应视频推演。生成结果可视化如图15所示。

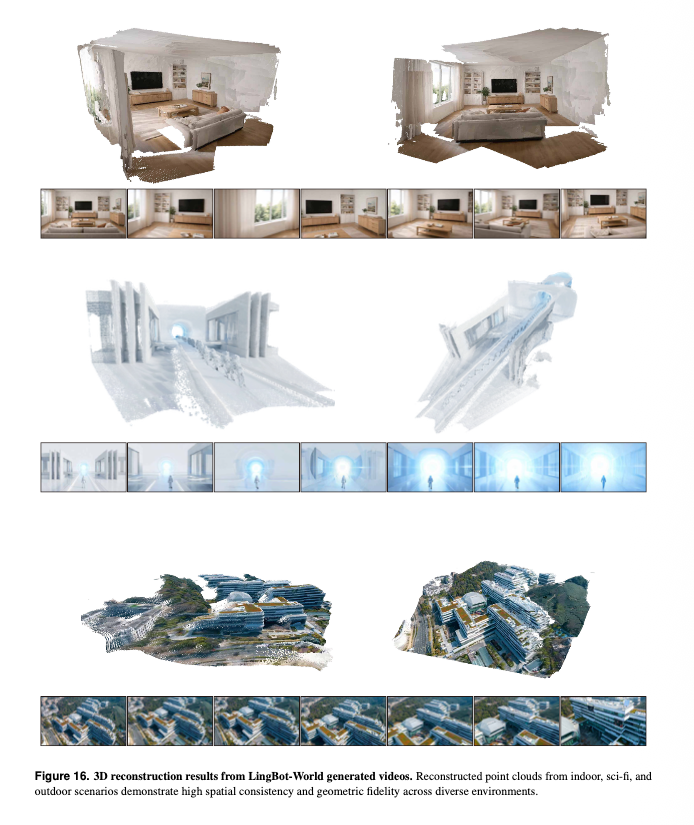

图16 基于LingBot-World生成视频的三维重建结果

从室内、科幻、户外场景重建的点云,在多样环境中均展现出高空间一致性与几何保真度。

5.3 三维重建

得益于高质量大规模长时程训练,LingBot-World涌现出三维空间一致性与长期空间记忆能力。如图16所示,依托大规模三维重建基础模型[38, 81],可将生成的视频序列进一步转换为高质量场景点云。这些点云在帧间具备强空间连贯性,可为下游具身智能训练提供丰富数据来源。这种涌现的三维一致性有效缓解传统视频生成模型中常见的跨视角不一致问题,实现更优的场景保真度与几何精度。

6 结论与讨论

6.1 总结:开源新前沿

本文提出一套全面框架,为世界模型确立全新开源前沿,有效弥合视频生成与可执行模拟之间的差距。本文贡献覆盖全流程:首先构建具备可扩展自动化采集系统的稳健数据引擎,保障高质量多样化训练数据;建模层面,研发针对精准动作控制优化的因果Transformer架构,并采用实时蒸馏实现高效推理;这些技术突破最终落地于多元应用,验证模型在执行智能体动作、一致性世界编辑与三维环境重建方面的能力。

6.2 局限性

尽管取得上述进展,打造完全沉浸式、持久化的虚拟世界仍面临诸多挑战:

- 记忆稳定性:当前模型的记忆是基于上下文窗口的涌现能力,而非显式存储模块,因此稳定性不足,长期模拟中会出现不一致。

- 计算成本:推理开销依然较高,运行模型需要企业级GPU,消费级硬件难以使用。

- 动作空间有限:可控动作范围受限,模型主要处理导航与基础移动,缺乏丰富的复杂交互能力。

- 交互精度:细粒度控制仍有难度,因缺乏精准的物体级定位,与特定目标物体(如杂乱桌面上的指定杯子)交互存在挑战。

- 生成时长与漂移:连贯生成时长不足以支持长时间游戏,视频长度增加后,场景会出现“漂移”问题,环境逐渐丢失原始结构。

- 单智能体模拟:当前框架仅支持单智能体视角,尚未考虑多智能体交互。

6.3 未来计划

展望未来,我们计划通过针对性路线图解决上述局限。核心目标是大幅拓展动作空间、强化物理引擎,实现更丰富、更真实的环境交互。为解决长期模拟的稳定性问题,我们将设计更完善的显式记忆模块,而非仅依赖涌现能力。此外,我们将聚焦解决漂移问题,支持更长视频生成,为无限时长游戏与更稳健的模拟奠定基础。

思考

方法总体采用三阶段训练:

- 预训练:用wan模型作为初始生成模型,构建通用的视频先验,学习生成高质量视频;

- 中训练:在初始生成模型的基础上,增强生成视频的长期一致性,引入动作可控性;

- 后训练:通过因果架构实现实时交互生成,通过少步蒸馏实现减少误差积累、减少去噪步数减少生成时间,实现实时性。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)