20260407_185833_2026大模型算法工程师技术栈指南

最近和很多研一、研二的同学聊,发现大家自学大模型时普遍会走一些弯路。我把通往大模型工程师的技术栈整理成了清晰的三步,希望能帮大校准方向,看清自己的位置:

1.基础能力:这是入行的门票。学完能让你跑通一些玩具项目,但离工业级应用还有距离,想凭此面试大厂算法岗,成功率不高。

2.进阶能力:这是成为合格工程师的标志。此时你能独立交付一个完整的大模型应用或服务,面试偏开发的大模型岗位会很有竞争力,但冲击核心算法岗可能还差临门一脚。

3.前沿与专家能力:这是你冲击大厂SSPOffer的决胜点。简历上必须有你的“杀手”一一那些“人无我有”的深度和亮点,这才是你技术热情和潜力的最终体现。

第一阶段:基础能力(打好地基,能够上手)

这个阶段的目标是让你从零到一,能够独立完成一个标准的大模型微调任务。

1.核心理论知识

数学基础:不要求你成为数学家,但以下概念得懂:

- 线性代数:向量、矩阵、张量及其运算。这是神经网络数据的基本表示形式。

- 微积分:导数、偏导数、链式法则。这是理解反向传播(Backpropagation)的根本。

2.核心编程与工具

- Python:精通。不仅仅是语法,更要熟悉其数据科学栈,尤其是NumPy和Pandas.

- PyTorch:业界主流,必须精通。你需要能用PyTorch熟练地构建模型、定义Dataset和DataLoader、编写自定义的训练循环。

- HuggingFace生态:这是当前大模型领域的“标准库”。

- transformers:学会用它加载预训练模型和分词器(Tokenizer)。

- datasets:学会高效地加载和预处理数据集。

- accelerate:了解它如何简化单机多卡训练。

- Git:必须熟练使用。你的GitHub就是你的第二张简历。

- 其他好用的包:LLaMA-Factory、Unsloth这些也可以自己玩玩,选一个就行。

阶段目标:

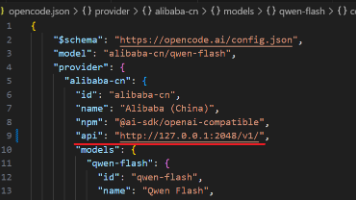

独立在GoogleColab、AutoDL或本地GPU环境下,使用HuggingFace

transformers和datasets,对一个开源模型(如Qwen3)在标准数据集

(如Alpaca)上完成一次完整的有监督微调(SupervisedFine-tuning,SFT),并能评估其结果。

第二阶段:进阶能力(能解决问题,创造价值)

这个阶段,你需要从一个“调包侠”转变为一个能理解底层、能设计复杂系统的工程师。

1.大模型核心算法

- Transformer架构:必须深刻理解其每一个组件的原理和实现,包括自注意力机制、多头注意力、位置编码、残差连接和层归一化。面试时这是必考题,要求能清晰地讲出数据流在其中如何变化。

- 参数高效微调(PEFT):由于全量微调成本高昂,PEFT用的也比较多。

- LoRA/QLoRA:必须掌握其原理、实现方式及其优缺点。这是目前最流行和实用的技术。

- 了解其他方法如P-Tuning,Prefix-Tuning,以拓宽知识面。

- 检索增强生成(RAG):这是目前大模型落地最主要的技术路线之一,用于解决模型知识更新和幻觉问题。

- 你需要理解整个RAG的流程:Query->Embedding->VectorSearch->Context->Prompt->LLMGeneration。

- 学习并使用LangChain或Llamalndex框架来快速构建RAG应用。

- 了解并使用至少一种向量数据库,如Faiss(本地),ChromaDB,Milvus。

- Agent(智能体):这是RAG的进阶,代表了从“知识问答”到“任务执行”的演进,是体现你应用架构能力的关键。

- 核心思想:理解Agent的本质一一一个以LLM为“大脑”的自主系统,它能规划(Planning)、使用工具(ToolUse)并根据外部反馈进行决策(DecisionMaking)

- 工程与系统能力

• Linux & Shell 脚本: 你大部分工作都将在远程服务器上完成,熟练的命令行操作是基本功。

• Docker: 必须掌握。用于创建可复现的、隔离的运行环境。

• API 开发: 学习使用 FastAPI 或 Flask 将你的模型封装成一个可供调用的服务。

阶段目标:

-

能够独立设计并实现一个完整的 RAG 应用,例如一个基于你专业领域 PDF 文档的问答机器人。

-

能将此应用通过 Docker 容器化,并通过 FastAPI 暴露 API 接口。

-

面试时,能手撕(或清晰讲解)一个简化版 Multi-Head Attention 的代码实现。

第三阶段:前沿与专家能力(推动技术边界)

达到这个层次,你将是团队中解决最棘手问题的人,并且具备一定的研究和创新能力。

- 大规模训练与推理

• 分布式训练:当模型大到单机无法容纳时,分布式训练成为必需。

○ 理解并能应用 DeepSpeed 或 Megatron-LM 框架。

○ 理论上要搞懂数据并行、张量并行、流水线并行的区别和适用场景。

• 高性能推理优化:这是模型部署上线、服务千万用户的关键。

○ 量化 (Quantization):理解 FP16, INT8, 4-bit 量化的原理,以及其对性能和精度的影响。

○ 学习使用 vLLM, TensorRT-LLM 等顶尖推理框架,它们通过 PagedAttention 等技术极大提升了吞吐量。

• 硬件知识:你需要对 GPU(如 NVIDIA A100/H100)的关键参数(如显存、带宽、计算单元)有深入了解,因为这直接决定了你技术方案的可行性和成本。

- 模型对齐与核心算法

• RLHF / DPO / GRPO:理解让模型(如 ChatGPT)变得“有用且无害”的核心技术。

○ RLHF:掌握其三阶段流程(SFT -> 奖励模型 -> PPO 强化学习)。

○ DPO (Direct Preference Optimization):了解这种更简单高效的对齐方法。

○ GRPO:2025当炸子鸡,不学不行。

• 底层算子开发(加分项):如果你追求极致性能,可能需要使用 CUDA 编写自定义的 GPU 算子。

- 研究与创新

• 论文阅读与复现(很重要):保持对 arXiv cs.CL 和 cs.LG 板块的持续关注。具备快速阅读、把握核心思想并复现关键模块的能力。

• 算法创新:在微调、对齐、推理等某个细分方向上,提出自己的改进方案并用实验验证。

阶段目标:

-

能够复现一篇顶级会议(如 NeurIPS, ICML, ACL)上关于大模型的论文,并进行有意义的改进。

-

简历上的项目能讲明白以下几点:基线模型、为什么需要优化、怎么优化、有什么结果。

给在读学生的最终建议:

• 扎实基础:不要急于求成,第一阶段是重中之重。一个扎实的基础远比涉猎一堆时髦技术名词更有价值。

• 项目驱动:知识是抽象的,项目是具体的。用实际项目(比如复现一篇论文、搭建一个有趣的 RAG 应用)来串联你的知识点。你的 GitHub 项目是你最好的名片。

• 保持专注:这个领域每天都有新技术,不可能全部掌握。选择一个你感兴趣的方向(如 RAG 应用、高效微调、推理优化),深入钻研下去。深度比广度更重要。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献89条内容

已为社区贡献89条内容

所有评论(0)