2026年,SEO内容自动化还是流量陷阱?一个运营者的实践反思

进入2026年,内容营销的战场早已不是比拼谁的文章写得更华丽,而是看谁的“内容流水线”更稳定、更智能、更能持续捕获搜索意图。过去几年,我们团队从手动选题、撰写、发布,到尝试各种AI写作工具,再到最终搭建一套近乎全自动的SEO内容系统,踩过的坑和获得的增长都同样真实。今天我想分享的,不是又一份“30款SEO工具清单”,而是关于“自动化内容生产”在真实业务环境中的生存状态——它究竟是一个解放生产力的终极方案,还是一个制造数字垃圾的精致陷阱?

从工具堆砌到流程失效:我们最初犯的错

和许多团队一样,我们最初对SEO自动化的理解,停留在“工具”层面。我们罗列了市面上所有声称能生成SEO文章、分析关键词、监控排名的软件。我们天真地认为,只要把这些工具串联起来,就能搭建一条高效的内容管道。结果呢?我们得到的是:一堆关键词报告、大量结构雷同但语义空洞的文章、以及几乎没有波动的流量曲线。

问题出在哪里?核心在于流程的断裂。工具A生成的关键词,导入工具B后,生成的文章与网站的实际业务相关性微弱。工具C负责发布,但发布的平台(如WordPress)的页面加载速度或结构,可能本身就不利于新内容的初始排名。每个工具都在自己的环节“表现良好”,但串联起来却形成了一个价值漏损严重的系统。更糟糕的是,没有人真正为最终的“流量结果”负责,大家只关心“文章数量”这个虚荣指标。

转折点:将“意图理解”置于流程中心

真正的转变始于我们重新定义了问题的核心:我们需要的不是“文章生成器”,而是一个能理解“搜索意图-内容匹配-发布优化”完整链路的智能体。这个过程必须闭环,且以最终的可索引、可排名、可转化为唯一成功标准。

这时,我们开始系统性评估那些号称提供“端到端”解决方案的平台。我们测试的一个关键场景是:给定一个我们电商网站上的产品页面,系统能否自动发现与该产品相关的、有真实搜索量的长尾问题(People Also Ask),并生成一篇能真正补充产品页面、解决用户信息需求的博客文章,然后自动发布到我们站点的正确分类下,并确保URL结构、元标签、内部链接都符合SEO最佳实践?

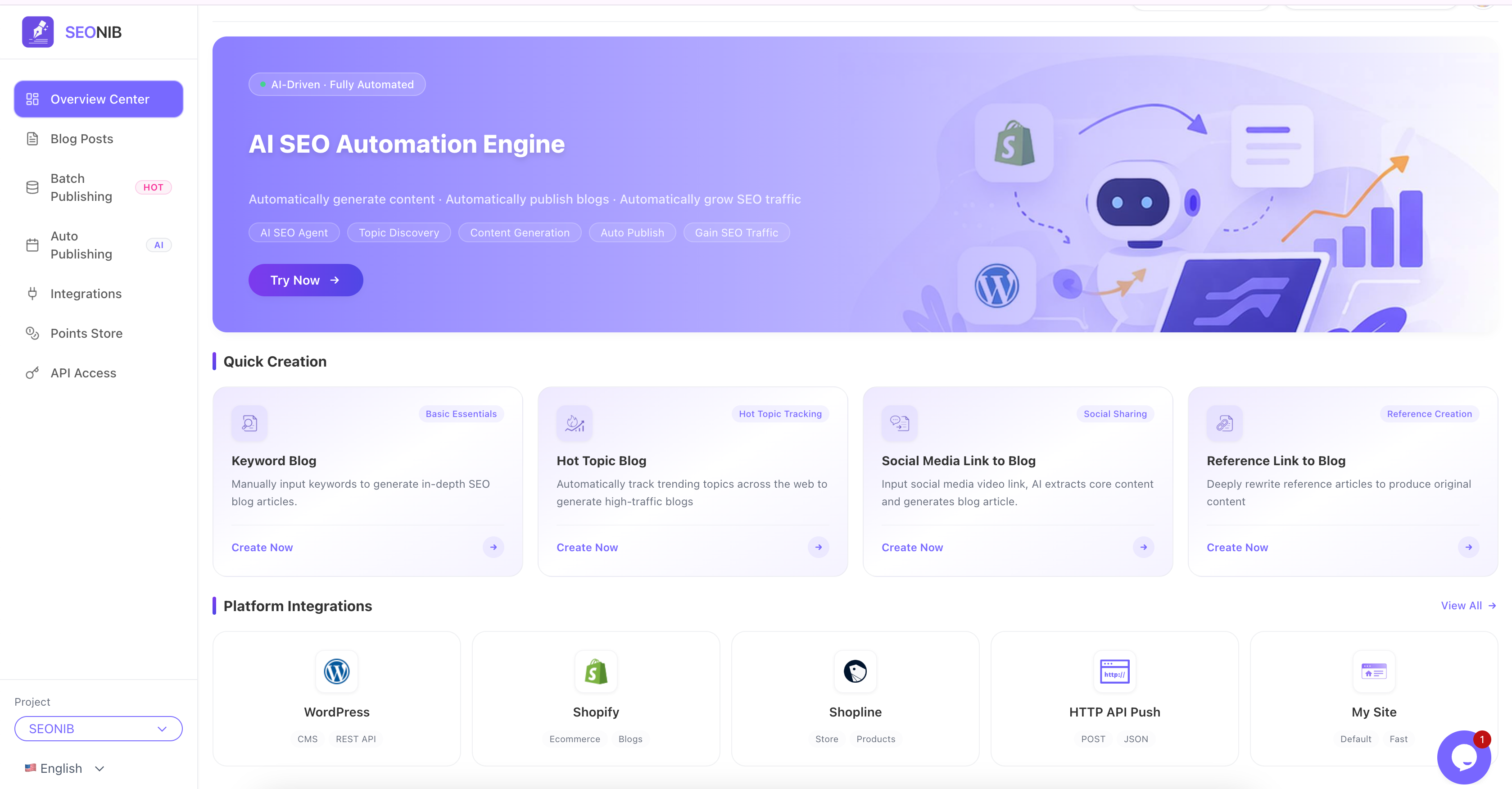

正是在这个深度测试阶段,SEONIB 进入了我们的视野。它吸引我们的点不在于某个单点功能多强大,而在于它试图构建的闭环逻辑:从多源(关键词、PAA、表格)发现内容需求,到生成针对性的、结构化的内容,再到一键发布至CMS(如我们的Shopify店铺),并附带基础的SEO元素设置。它不像一个工具,更像一个预设了工作流的自动化代理。我们决定将其接入我们的核心流程进行小范围试验。

自动化内容的质量悖论与编辑干预

接入SEONIB这样的自动化管道后,第一个迎面而来的挑战不是技术,而是质量与规模的悖论。全自动生成的内容,在语法和结构上无可挑剔,甚至关键词密度也恰到好处。但资深编辑一眼就能看出问题:缺乏独特的观点、案例过于通用、对复杂问题的理解流于表面。

我们曾一度对批量生成的内容感到失望,直到我们调整了策略。我们不再追求“完全无人干预”,而是将自动化流程定位为“超级内容助理”。具体做法是:

- 源控制:严格筛选信息源。我们不再批量导入宽泛的关键词,而是专注于从产品问答、客服日志、竞品评论中提取真实的用户问题,将其作为内容生成的“种子”。

- 大纲审核:系统生成的文章大纲,必须由编辑进行“意图校准”,确保文章角度与品牌调性、用户实际痛点相符。

- 数据与案例注入:自动化生成的内容框架,由编辑手动注入我们独有的业务数据、用户案例或深度分析段落。

这样一来,SEONIB扮演的角色就从“写手”变成了“高效的内容框架构建师和初稿撰写员”,节省了编辑70%以上的基础工作时间,让他们能聚焦于价值倍增的环节——注入洞察和独特性。

规模化后的隐形瓶颈:索引与时效性

当内容开始以每天数十篇的速度自动发布时,新的瓶颈悄然出现:搜索引擎索引速度跟不上发布速度。大量页面长时间停留在“已发现,未索引”的状态,成了数字孤岛。此外,对于基于热点生成的内容,从发现趋势到生成、发布、被索引,时间差可能导致内容发布时热度已过。

我们的应对策略是分层管理:

- 基石内容:针对常青话题的自动化内容,我们不追求即时索引,而是依靠网站整体的权威性和内部链接结构,让其自然被爬取。我们会定期使用SEONIB的批量发布功能,将这些内容均匀排布发布,避免给爬虫造成瞬时压力。

- 时效内容:对于趋势性内容,我们配置了更高的发布优先级,并自动将其推送到网站更显眼、权重更高的频道(如首页最新文章模块)。同时,我们集成了即时索引API(如Google Indexing API),对这类关键URL进行主动推送。

这个过程中,自动化管道能否与网站的技术栈(如CDN、缓存策略)和搜索引擎的接口友好协同,变得比内容生成本身更重要。

2026年,如何看待“自动化SEO内容”的价值?

回顾这段历程,我的结论是:纯粹的、无人值守的、以数量为核心的内容自动化,在2026年的搜索生态中价值有限,甚至有害。但将自动化作为核心工作流的基础设施,由人类智能进行战略指导和关键环节校准的“人机协同”模式,已成为内容规模化运营的必然选择。

它的核心价值不再是“替代写手”,而是:

- 极致的效率提升:将内容创作者从重复的信息搜集、结构搭建、基础写作中解放出来。

- 覆盖度的无限扩展:能够经济可行地覆盖海量长尾搜索意图,这是人工无法做到的。

- 流程的标准化与可迭代:将成功的SEO内容模式固化到自动化流程中,确保输出质量的基线稳定。

对于想要在2026年构建内容竞争力的团队,我的建议不再是“去试用哪30个工具”,而是:首先梳理清楚你内容的核心价值主张和用户决策旅程,然后寻找或搭建一个能够将你的“价值注入点”无缝嵌入到“从发现到发布”全流程中的自动化系统。 这个系统是否叫某个具体的名字并不重要,重要的是它的架构是否以“理解并满足搜索意图”为圆心,并能灵活适配你的业务独特性。

FAQ

Q1: 2026年,完全由AI生成的内容还能获得好的谷歌排名吗?

A1: 谷歌的排名核心始终是“内容价值与搜索意图的匹配度”。完全未经优化、缺乏独特信息或经验的纯AI生成内容,排名会越来越难。但AI作为强大辅助工具,在人类专业知识的指导下生成高质量内容,已经成为主流。关键在于内容是否真正解决了问题,而不在于谁执笔。

Q2: 自动化内容生产是否会导致网站内容重复或质量下降,从而被惩罚?

A2: 如果策略是批量生成低质、雷同的内容,风险极高。但合理的自动化策略是:以独特数据、业务场景为信息源,生成具有差异化的内容框架,再经人工润色。重点在于“增量价值”,而非简单复述网络已有信息。监控内容的跳出率、停留时间等用户体验指标是关键。

Q3: 对于小型团队或初创公司,应该从何处开始构建内容自动化?

A3: 不要一开始就追求全栈自动化。先从最痛点开始:比如,使用工具自动将产品FAQ转化为博客文章大纲,或从客户咨询中提取高频问题生成内容创意。选择一个能与你现有CMS(如WordPress, Shopify)轻松集成、允许你控制内容源和审核流程的平台开始小规模测试,验证流量效果后再逐步扩大规模。

Q4: 多语言SEO自动化内容效果如何?需要注意什么?

A4: 对于开拓全球市场,多语言自动化是利器,但陷阱很深。机器翻译后直接发布效果很差。需要确保生成流程是“本地化创作”,即基于目标市场的搜索习惯和文化语境生成内容,或至少由母语者进行深度校对。单纯的关键词翻译会导致意图偏差。

Q5: 如何衡量自动化内容工作的ROI?

A5: 摒弃“文章数量”指标。关注核心业务指标:由自动化流程产生的内容带来了多少合格的有机流量(非品牌词)?这些流量的转化率(如注册、咨询、购买)如何?多少篇内容进入了搜索结果的前10名?计算单篇有效内容的生产成本(包括工具成本和人工校准时间)与它带来的生命周期价值。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)