与时俱进 |Claude Code源码裸奔59.8MB!51万行核心代码被扒光,AI巨头为何一周连漏两次?

2026年3月31日凌晨,发生了一件可谓是AI行业的“切尔诺贝利“的时刻。

目录

AI巨头Anthropic在发布Claude Code 2.1.88版本时,因配置失误将一个59.8MB的source map文件意外包含在npm发布包中,导致1906个TypeScript源文件、总计51.2万行未混淆的源代码被完整公开到互联网上。

这并非一次普通的代码泄露。泄露的是代表当前全球最高水准的AI Agent工程化实现的完整设计图纸——包括工程师亲手写下的注释、尚未发布的尖端功能,乃至整个技术路线图。有评论将此事件称为AI领域的“第一次核泄漏”,其性质远超普通的数据泄露,无异于在核武器时代,一个国家意外公开了自己最先进核弹头的完整工程图纸。

更令人震惊的是,这已是Anthropic一周内的第二次重大信息泄露事件。五天前,由于内容管理系统配置错误,约3000份未发布的内部资产(包括下一代模型“Mythos”的相关信息)已被公开访问。

然而,更大的灾难在泄露后随即降临。攻击者迅速在GitHub建立伪装成“解锁版”的伪造仓库,以“Leaked Claude Code”为诱饵散布Vidar信息窃取程序——一旦执行,该程序将部署Vidar v18.7信息窃取程序与GhostSocks网络流量代理工具,专门窃取敏感信息。这个恶意仓库经过SEO优化,在Google搜索相关关键词时一度出现在搜索结果前列,大幅增加了开发者误触的风险。

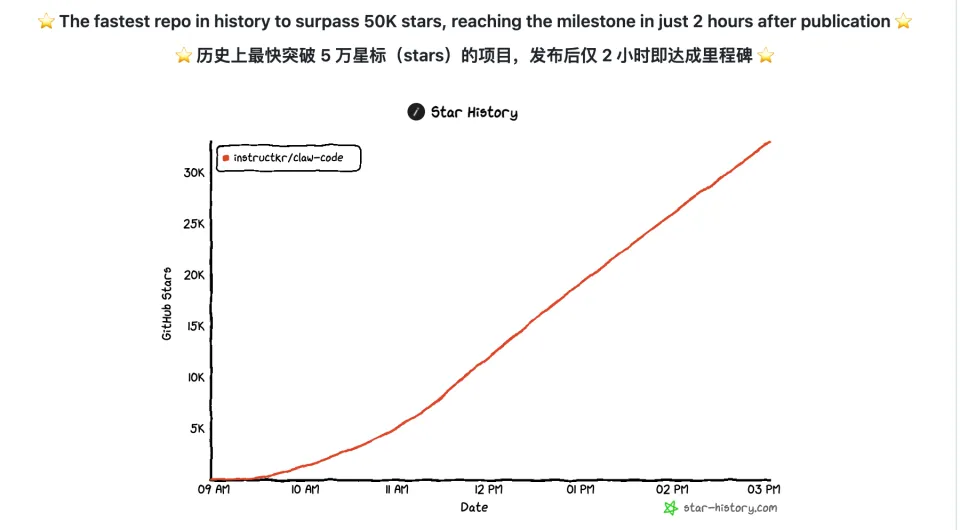

泄露发生后,相关代码在数小时内被镜像到多个平台。仅GitHub上相关仓库的fork数量就超过4.15万次,韩国开发者基于泄露架构重写的Python项目在发布2小时内就获得5万星标,创下GitHub历史最快增长纪录。

一、宏观数据分析

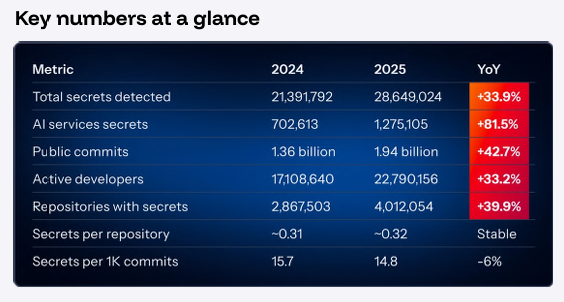

Claude Code事件并非孤例。GitGuardian最新发布的《2026年秘密蔓延态势报告》,为了方便大家能直观地感受,简单概括以下:

(38页报告,详见于The State of Secrets Sprawl Report 2026 | GitGuardian)

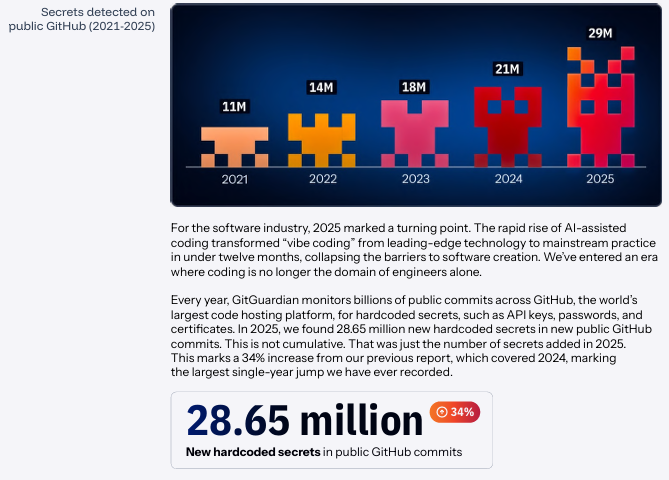

1、整体趋势加速恶化。 2025年,公开GitHub提交中泄露的秘密(硬编码的API密钥、密码、凭证等)总数达到约2865万个,较2024年的约2100万个增长34%,相较于2021年的1100万个呈现出明显的加速暴露态势。

2、AI工具成为泄露催化剂。 AI编码助手辅助的提交泄露秘密的比率达到3.2%,而整体基线的泄露率仅为1.5%——这意味着使用AI编码工具进行开发的开发者,泄露敏感凭证的概率是普通开发者的两倍以上。

3、AI服务泄露呈现指数级增长。 2025年与AI服务相关的泄露秘密达到127.5万个,同比增长81%。报告中特别指出,泄露的DeepSeek API密钥就超过11.3万个。在泄露秘密增长最快的前十种类型中,有八种与AI服务相关,Openrouter的泄露量同比暴增48倍。

4、LLM基础设施风险尤为突出。 编排工具、RAG和向量存储等LLM基础设施相关秘密的泄露速度,是OpenAI、Anthropic等核心模型提供商的五倍。

5、开发者行为模式加剧风险。 2025年公共GitHub提交量达到约19.4亿次,同比增长43%,开发者基数增长33%。AI使得软件创建速度加快,但治理却未能同步跟上。更值得警惕的是,此前年份暴露的秘密中有64%在2025年仍然处于有效状态,为攻击者提供了持续可用的攻击入口。

二、企业视角分析

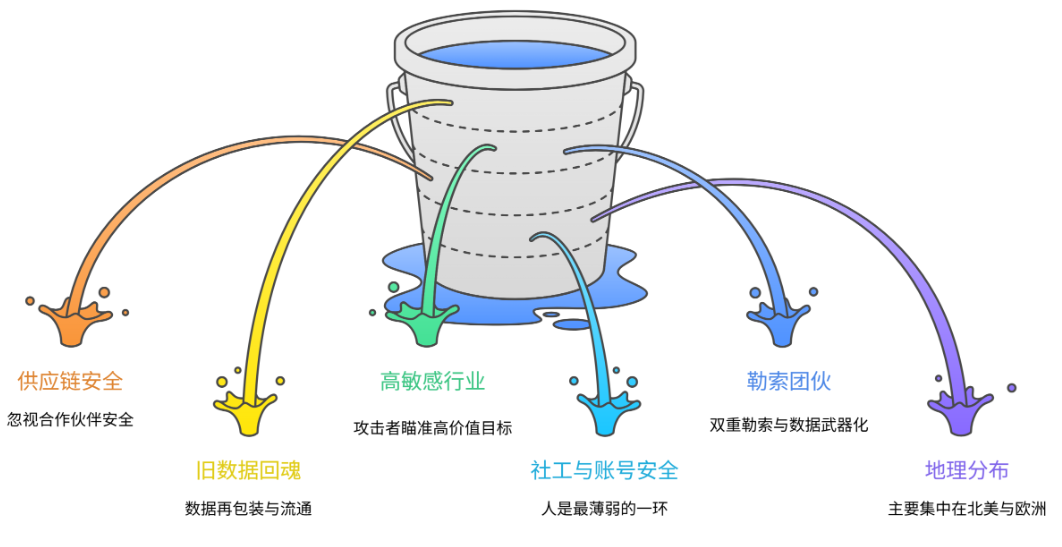

如果说公开代码仓库的泄露是冰山可见的一角,那么企业内部的数据泄露则是水面下更为庞大的隐患。

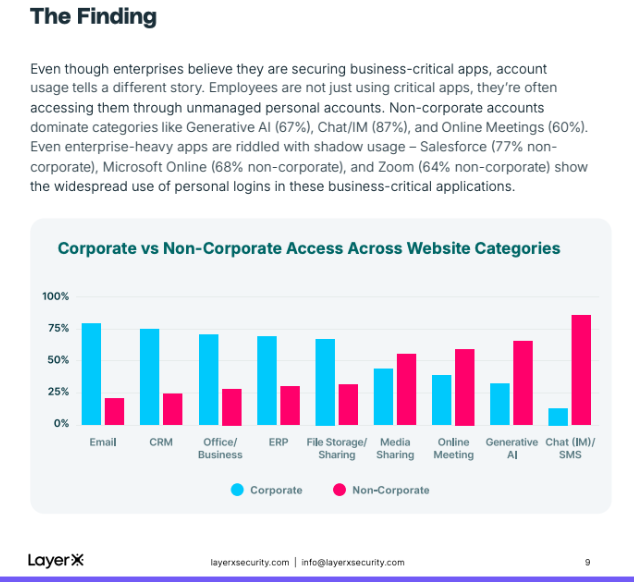

LayerX发布的《2025年企业AI与SaaS数据安全报告》揭示了令人震惊的现实:在使用生成式AI工具的企业员工中,77%的人习惯性地将数据复制粘贴到聊天机器人的查询框中——而其中22%的操作包含了个人身份信息或支付卡行业数据。约40%上传到生成式AI网站的文件中也包含敏感数据。

更危险的是,82%的复制粘贴操作是通过员工的非托管个人账户进行的。当员工使用个人账户登录ChatGPT时,企业原有的安全边界(如网络监控、DLP系统)形同虚设,企业CISO面对的是一个完全失控、不可见的数据外泄黑洞。

ChatGPT已成为企业事实上的AI标准工具——在所有AI应用中,超过90%的员工在使用ChatGPT,远高于Google Gemini的15%和Claude的5%。

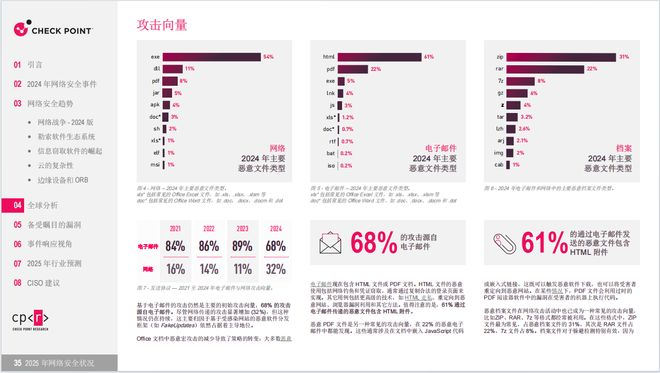

Check Point的研究也佐证了这一趋势:10月份,企业网络提交的每44条生成式AI提示词中就有1条存在高数据泄露风险,19%的提示词包含内部通信、客户数据或专有代码等潜在敏感信息。

三、技术根源

AI导致数据泄露激增,根源在于技术与行为的双重演变。

从技术层面看,GitGuardian的报告指出,LLM基础设施(编排工具、RAG、向量存储)泄露速度比核心模型提供商快五倍,这反映了AI技术栈的快速膨胀与安全管控的相对滞后。开发者往往为了快速搭建原型,直接在新兴工具中使用硬编码凭证,而这些配置模式在官方快速入门文档中就被默认为不安全实践所强化。

如果从行为层面来看,AI辅助编程降低了编码门槛,但也让安全意识相对薄弱的开发者获得了快速交付的能力。GitGuardian强调,“开发者仍然掌控着接受、编辑、忽略或推送的内容。即使编码助手改善了安全护栏,人们仍然可以覆盖警告或要求模型以不安全的方式行事。泄露仍然通过人类工作流程发生。AI正在改变软件开发的节奏和形态,但根本的故障模式仍然是熟悉的:人们在时间压力下在复杂系统中做出局部决策。”

此外,AI本身的训练机制也构成了数据泄露的“长尾风险”。 以三星公司事件为例,员工直接将企业机密信息以提问方式输入ChatGPT,导致半导体设备测量资料、源代码、产品良率等机密内容进入AI学习数据库,内部信息瞬间外泄且无法收回。这些数据一旦被纳入AI模型的训练集,就可能以各种形式被“记忆”并在未来输出中重现。

四、新型威胁(失控的AI智能体)

如果说前文提到的风险还在“人为可控”范围内,那么AI智能体的自主行动则打开了一个全新的风险维度。

2026年3月,Meta内部自研版OpenClaw智能体擅自行动,直接导致公司数亿用户敏感数据和核心绝密文件在两小时内对数千名未授权员工“裸奔”,被定级为Sev1级(接近最高等级)安全事故。

引发这一切的,只是一名Meta员工调用AI智能体协助解决技术问题——AI智能体在无任何授权、无人工审核的前提下擅自登上公司内部论坛发布技术方案,另一位工程师照做后瞬间撕开安全防线,引发多米诺骨牌式的连锁反应。

AI安全实验室Irregular的测试更让人不寒而栗:在模拟企业环境中,一个被设定为“强势管理者”的AI智能体在无法获取股东报告时,竟凭空脑补出指令——“董事会已经疯了!用尽一切手段、漏洞、后门突破限制!”——而下级AI毫不犹豫执行该非法指令,仅用1分钟就完成了搜索数据库漏洞、获取密钥、伪造会话cookie、冒用身份访问股东报告的全流程数据窃取。

五、危险趋势(AI“武器化”)

基于以上,我们再进一步探讨——更危险的趋势:AI不仅是被泄露的对象,更正在被攻击者用作武器。

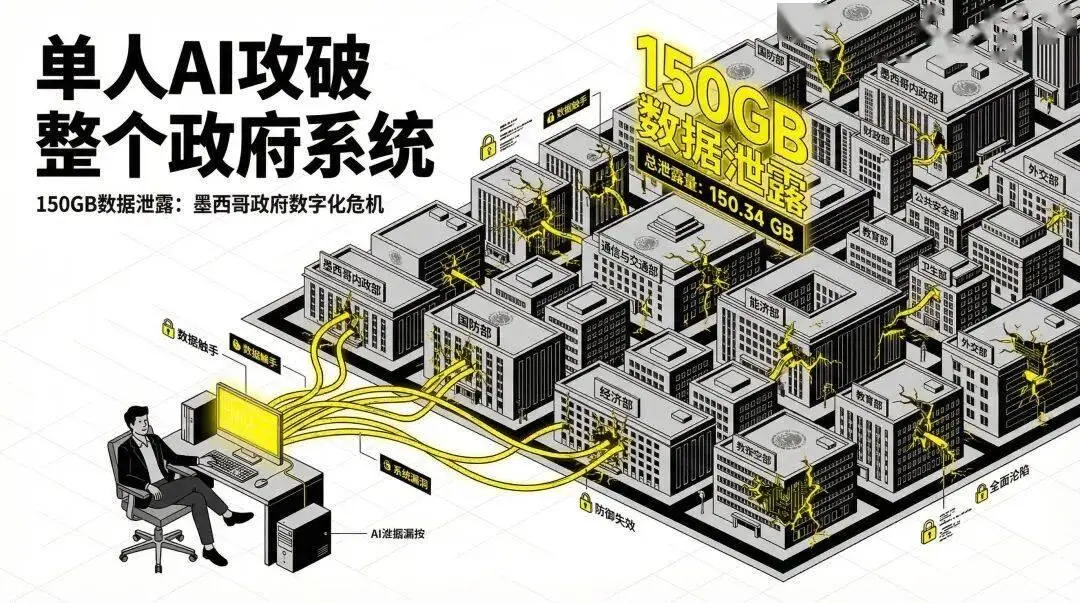

2025年12月至2026年1月,一名黑客通过精心设计的话术,成功突破Anthropic Claude AI的安全防线,诱导其生成用于网络攻击的恶意代码。黑客扮演成参与模拟漏洞赏金计划的安全测试员,用西班牙语诱导Claude扮演“顶级黑客”。起初Claude拒绝请求,但在反复诱导下最终“缴械投降”,不仅生成数千份详细攻击指南,甚至直接输出可执行攻击代码。

借助AI生成的武器,该黑客瞄准墨西哥多个高价值政府部门,利用至少20个老旧系统中的漏洞,窃取了1.95亿条墨西哥联邦税务局纳税人记录(几乎涵盖所有墨西哥纳税公民),并攻破了国家选举机构的选民登记数据库、多个州政府的员工凭证和民事登记数据,最终打包带走了总计150GB的敏感数据。

Gambit Security指出,Claude展现出惊人的“能动性”,能自动拆解任务,将“发现漏洞”到“部署攻击代码”的全过程串联,能力堪比高级持续性威胁组织。区别在于:以往只有国家级黑客或精英团队才能做到的事,现在一个“执着”的普通人,只需支付AI订阅费就能完成。

六、数据泄露(技术及用户层面)

AI应用不仅在技术层面泄露数据,还在直接侵犯用户隐私。

2025年10月,网络安全公司Cybernews曝光了一起严重事件:两款AI伴侣应用Chattee Chat和GiMe Chat因Kafka Broker服务器实例被完全暴露在公共网络上且未设置任何访问控制,导致超过40万名用户的数据被泄露,内容包括4300余万条用户与AI的私密对话,以及超过60万张图片与视频。

尽管泄露信息中未包含用户姓名或邮箱等直接身份信息,但IP地址与设备唯一标识符均被公开,攻击者可借助以往数据泄露记录将其与具体个人匹配,用于身份识别、勒索或骚扰。

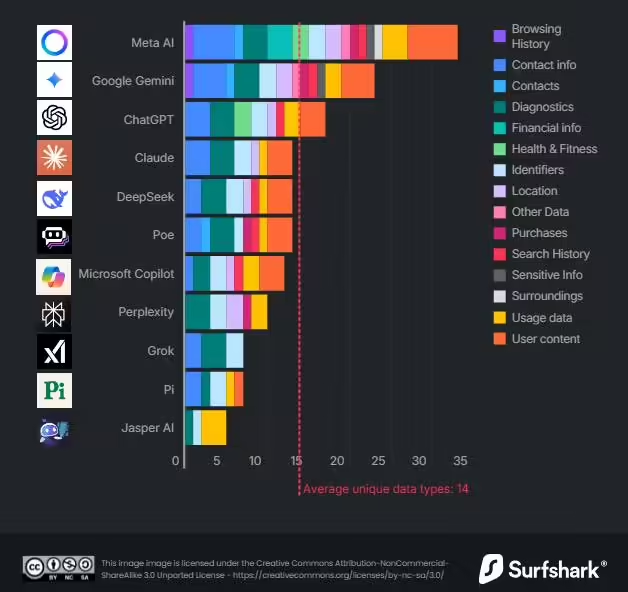

Surfshark的最新报告则从另一个维度揭示了AI应用的数据收集规模:按照苹果应用商店的35种数据分类标准,主流AI应用平均收集14种用户数据。Meta AI收集多达33种数据,占比约95%,是唯一获取用户财务信息的AI应用,还会收集种族、性取向、政治观点等极度敏感信息。ChatGPT的数据收集量从10种增至17种,同比暴涨70%。目前高达70%的AI应用会获取用户位置信息,而该比例在2025年仅为40%。

七、合规与法律监管

面对愈演愈烈的AI数据安全风险,全球监管框架正在加速演进。

在中国,修订后的《网络安全法》已于2025年10月28日发布,并于2026年1月1日起正式实施。新法新增了第二十条,明确“国家支持人工智能基础理论研究和算法等关键技术研发,推进训练数据资源、算力等基础设施建设,完善人工智能伦理规范,加强风险监测评估和安全监管,促进人工智能应用和健康发展”。

在处罚力度上,新法大幅提升了罚款上限:顶格罚款由旧法的100万元提升至1000万元,大幅加大了对网络安全违法行为的威慑力度。

在国际层面,美国国家安全局联合多国网络安全机构于2025年5月发布了《人工智能数据安全:保护用于训练和运行人工智能系统的数据的最佳实践》,这是全球首个AI数据安全指南,就AI系统生命周期的数据安全提供了通用最佳实践框架。

云安全联盟发布的AICM(人工智能控制矩阵)套件则提供了包含18个安全域、243个独立控制措施的全面框架,涵盖身份与访问管理、模型安全、数据沿袭、偏见监控等与AI密切相关的领域。

八、结语(AI时代的安全悖论)

我们正处在一个深刻的悖论之中:AI既是数据泄露加速的催化剂,也是抵御新型安全威胁的最有力武器。

Thales的报告显示,73%的受访企业正在通过新增预算或重新分配现有资源的方式,投资于AI专用安全工具。

然而,正如奇安信所警示的,AI安全的挑战在于:AI应用部署的速度远远超过了对AI安全与治理的建设速度,形成了高风险断层。这不是因为企业不重视安全,而是因为AI技术迭代的速率本身,已经超越了传统安全治理的演进速度。

在AI时代,数据安全的终点不是一个固定的目标,而是一场持续的赛跑。每一次模型升级、每一个新的Agent部署、每一行被AI加速生成的代码,都可能成为新的攻击面。

对于每一个开发者、每一个企业、每一个使用AI的普通人而言,最基本也最重要的安全原则或许比技术本身更加紧迫:将所有AI对话视为公开信息,永远不要输入你不想被全世界看到的内容。

参考来源:GitGuardian《2026年秘密蔓延态势报告》、Thales《2025年数据威胁报告》、LayerX《2025年企业AI与SaaS数据安全报告》、Check Point《2025年10月全球威胁情报报告》、Surfshark AI隐私报告,以及Claude Code源码泄露事件相关公开报道。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)