从“嘴炮”到“实干”:基于MCP构建AI工具调用能力

写在前面

我的RAG知识库问答系统上线后,经常收到一个反馈:“它能回答问题,但能不能帮我做点事?比如把检索到的文档发到我的邮箱,或者自动总结后保存到某个地方?”说实话,一开始我听到这个问题有点头大。让大模型“干活”——调用外部工具——一直是个棘手的事。模型在RAG管道里检索到答案,却没法执行下一步操作。直到我接触了MCP(Model Context Protocol),一个正在被Anthropic、OpenAI、Google、微软和AWS等巨头共同拥抱的开放协议。截至2026年初,MCP月SDK下载量已超过9700万,超过10,000个生产级服务器在运行。本文将从我的实战视角,带你理解MCP是什么、如何与RAG结合构建真正能“动手”的AI Agent,以及它在生产环境中的落地与挑战。

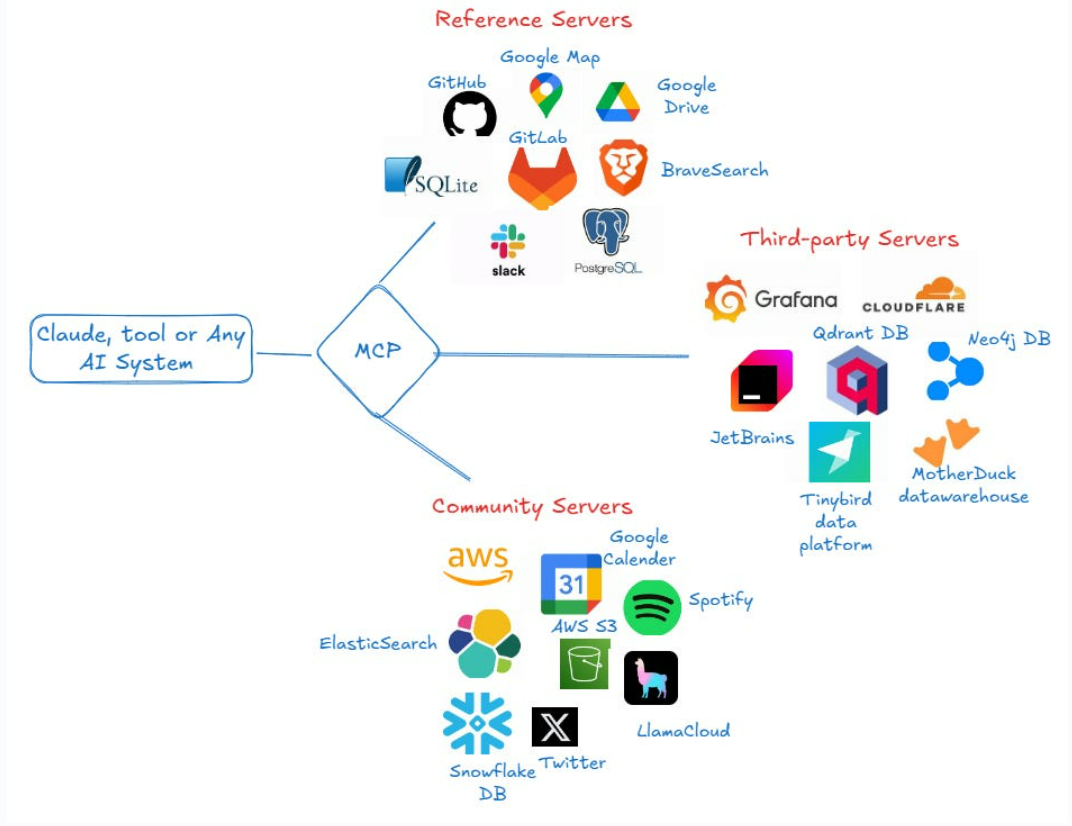

一、MCP到底是什么?——AI的“USB-C接口”

在MCP出现之前,给大模型接入一个外部工具,意味着要为每个模型单独写一套适配代码。OpenAI有Function Calling,Claude有自己的Tool Use格式,Gemini又是一套——碎片化问题极其严重。

MCP的出现就是为了终结这种混乱。它由Anthropic于2024年底首次推出,2025年12月被捐赠给Linux基金会的Agentic AI基金会,成为行业中立标准。最简洁的理解方式:把MCP想象成AI的USB-C接口——任何应用(Host)只要接上符合协议的MCP服务器,模型就能安全、可控地使用数据库、文件系统、浏览器等外部能力。

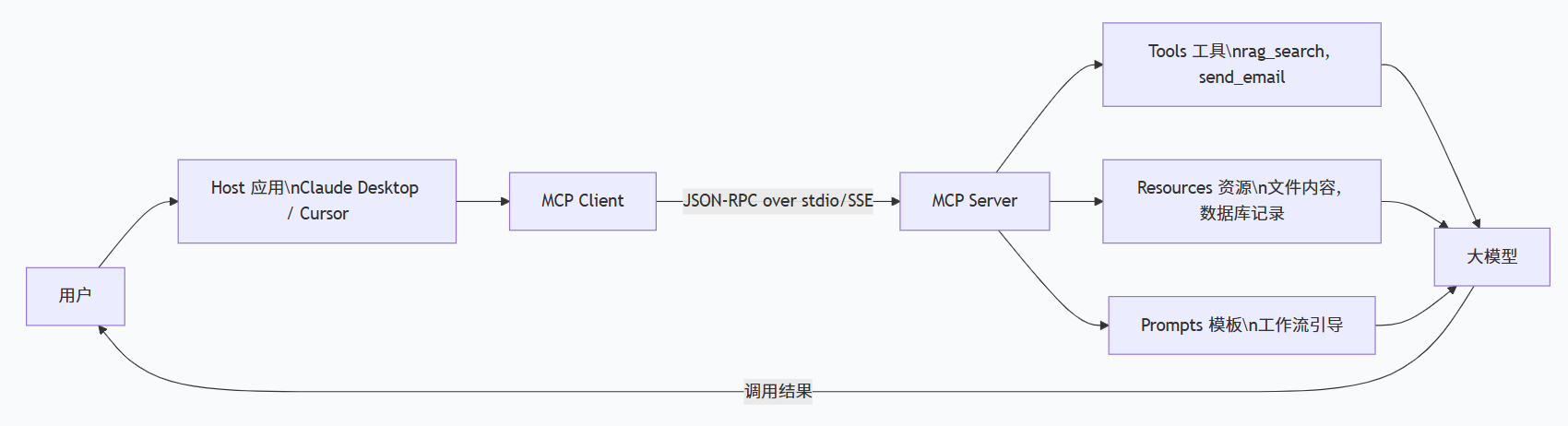

MCP的核心架构由三个角色构成:

-

Host(主机) :承载AI应用的运行环境,如Claude Desktop、Cursor IDE

-

MCP Client(客户端) :内嵌在Host中,负责与MCP服务器通信

-

MCP Server(服务器) :实际暴露工具、资源和提示模板的一方,封装具体功能

而MCP Server通过三个核心原语暴露能力:

-

Tools(工具) :模型可以调用的“行动”,例如“搜索知识库”“发送邮件”“保存文档”——这是我们最关心的部分

-

Resources(资源) :模型可以读取的数据源,如文件内容、数据库记录

-

Prompts(提示) :预定义的工作流模板,引导用户与模型完成特定任务

这三个原语的设计,让MCP既能支持“读取”场景(Resources),也能支持“执行”场景(Tools),还能支持“引导”场景(Prompts),覆盖了AI与外部世界交互的绝大多数需求。

二、MCP + RAG:让知识库Agent“动起来”

我现在的RAG系统已经能够很好地完成“检索→生成”的闭环。用户上传文档后,系统做向量化存储;用户提问时,系统检索相关内容,大模型基于上下文生成答案。但这条流水线有两个明显短板:

-

缺乏主动性:模型找到答案后,不能进一步操作——比如“把这个回答保存为PDF”或者“把检索到的文档列表发我邮箱”

-

工具集成困难:每增加一个功能(如邮件发送、文档导出),都要改业务代码,与模型逻辑耦合

MCP正好可以解决这两个问题。我在实践中规划了三条MCP集成路径:

路径一:MCP + 现有RAG管道(Quick Win)

最直接的方案是写一个MCP Server,封装现有的RAG检索能力。模型通过统一的MCP接口调用rag_search工具,拿到检索结果后再决定下一步动作。核心代码示意(Python + FastMCP):

from fastmcp import FastMCP

from your_rag_library import rag_search # 封装好的检索函数

mcp = FastMCP(name="RAG-Knowledge-Service")

@mcp.tool()

def search_knowledge_base(query: str, top_k: int = 5) -> list[dict]:

"""在知识库中检索与查询最相关的文档片段"""

results = rag_search(query, top_k=top_k)

return [{"content": r.content, "source": r.source, "score": r.score} for r in results]

@mcp.tool()

def export_result_to_pdf(content: str, title: str) -> str:

"""将检索结果导出为PDF文件,返回文件路径"""

# 调用你已有的PDF生成逻辑

file_path = generate_pdf(content, title)

return file_path这条路径的优点:不破坏现有RAG管道,只需加一层MCP封装,模型就能通过MCP协议调用知识库。这对于已经有成熟RAG系统、想快速接入工具生态的项目非常合适。

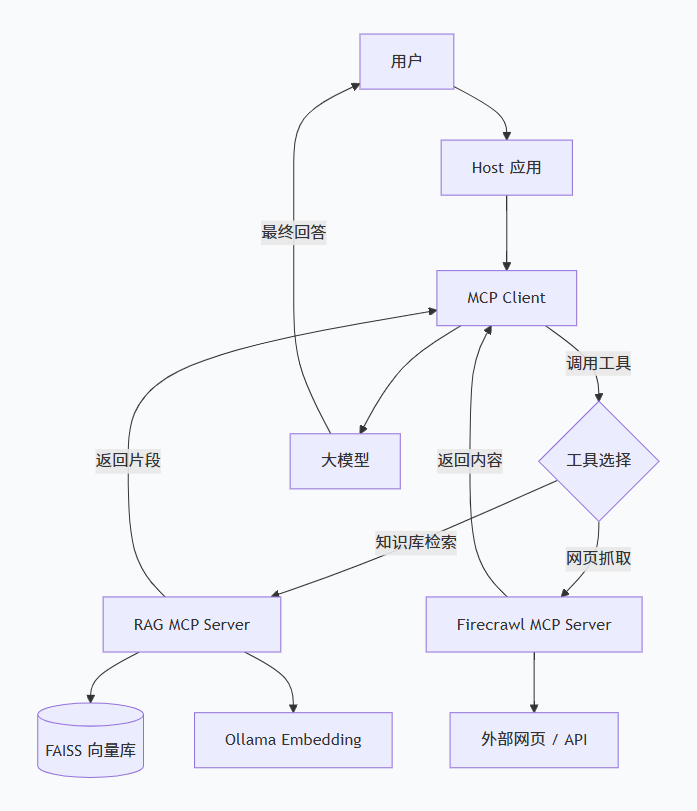

路径二:双服务器架构

参考社区中“双服务器MCP集成”的实践方案,可以让一个MCP服务器负责向量检索与知识库管理,另一个负责实时数据获取(如网络爬取、API调用),通过LangGraph这样的工作流引擎进行编排。

对于我的项目而言,这意味着:RAG Server(本地FAISS向量库 + 语义搜索)和Firecrawl Server(实时网页抓取)可以同时接入同一个MCP Client,模型根据需要选择调用哪个工具,甚至可以在一个任务中串联多个工具。

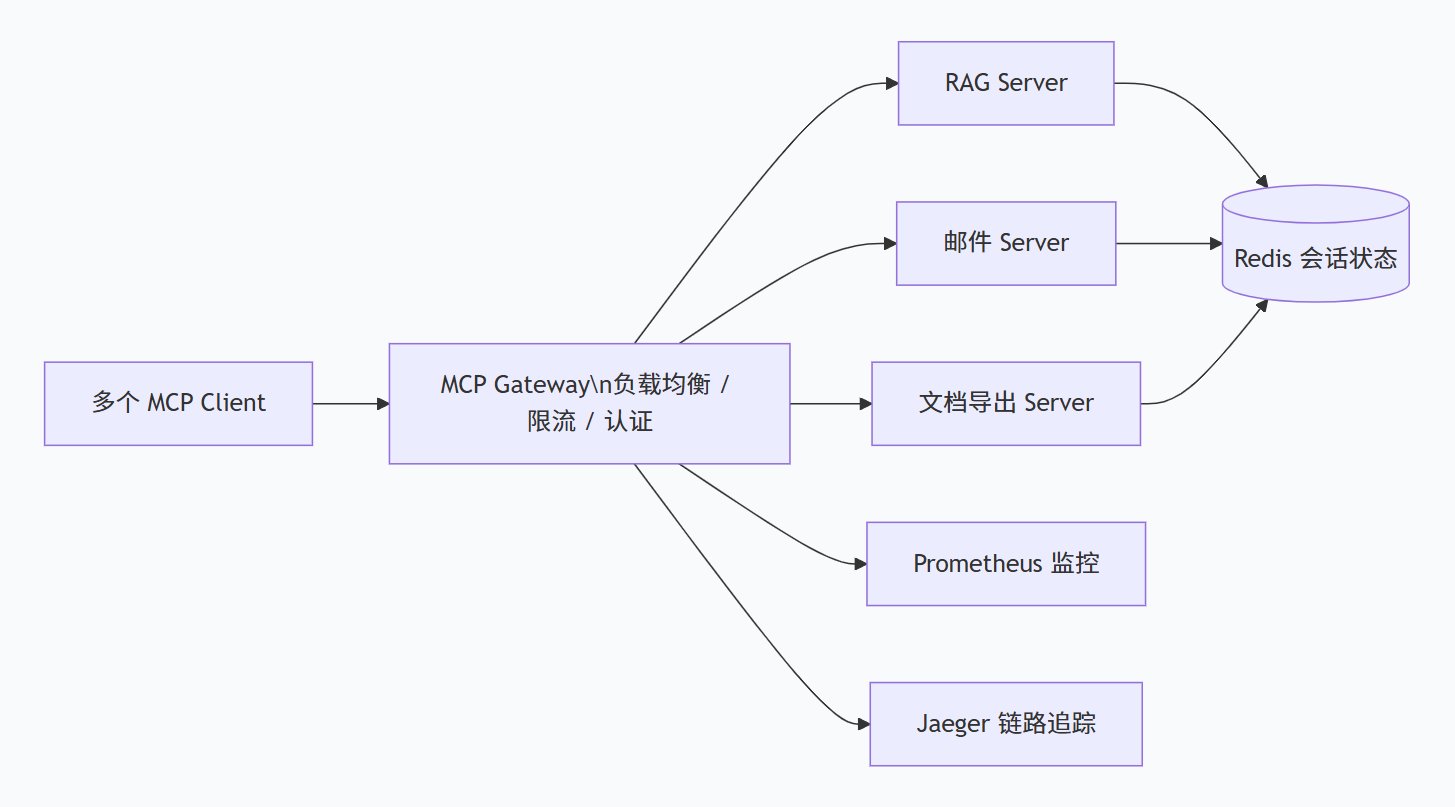

路径三:MCP Gateway——企业级Agent的“中枢神经”

如果未来需要让这个Agent服务多个部门或客户,单一MCP Server的模式会遇到瓶颈。小米等大厂的实践表明,MCP Gateway是解决大规模部署问题的关键:它实现MCP到RPC/HTTP的无损协议转换,注入全链路可观测性与服务治理能力(限流、熔断、认证),甚至引入语义检索实现基于自然语言的智能工具路由。

从架构设计的角度看,MCP + RAG的结合让AI Agent具备了“先理解、再行动”的能力。模型通过MCP调用知识库工具获取上下文(理解),基于上下文决策下一步操作(行动),形成完整的智能闭环。

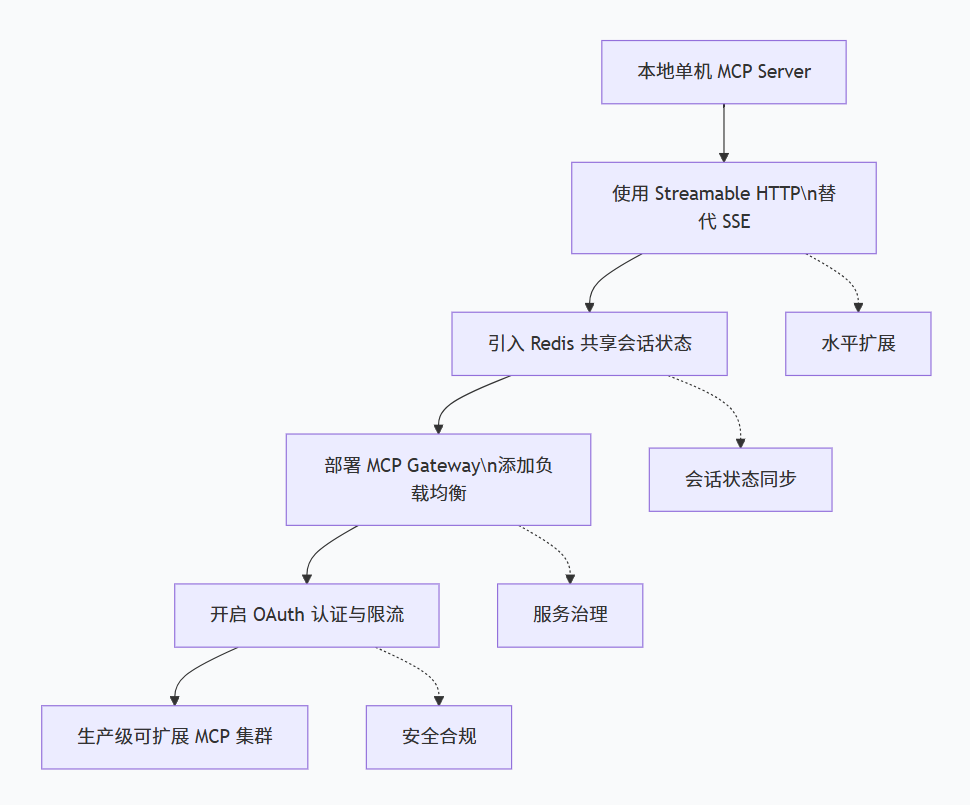

三、MCP生产环境落地的几个关键考量

MCP协议正在快速发展,但将其部署到生产环境并非一帆风顺。结合我的实践经验,以下几个问题值得提前关注:

1. 水平扩展的挑战

当前MCP依赖于长期存在的“有状态”会话,这使得在多实例之间或负载均衡器后部署MCP服务器变得困难。会话状态通常存储在处理连接的服务器上,而不是在机器之间共享。曾有开发者尝试使用Redis跨多个Pod构建无状态MCP服务器,但SDK尚未提供可靠的方式将客户端会话ID映射到服务器的内部事件流。

好消息是,项目维护者已将“传输演进和可扩展性”列为2026年路线图的优先发展领域,目标是让服务器能够水平扩展而不依赖单机内存状态。

2. 安全性:从零认证到OAuth

早期版本的MCP没有任何内置认证机制,这意味着任何人都可以调用暴露在公网上的MCP服务器。安全研究人员在2026年初已发现近7000个暴露在互联网上的MCP服务器,其中约半数没有任何授权控制。

幸运的是,生态正在快速完善。最新版本的MCP SDK已支持增强型授权发现机制和增量范围授权同意,实现了最小权限原则——客户端只需请求每次操作所需的最小访问权限,无需预先申请所有可能的权限。

3. 传输层演进:gRPC与Streamable HTTP

MCP默认使用基于HTTP的JSON-RPC作为传输层。但对于已经全面采用gRPC的企业,这意味着需要重写服务或搭建转码代理。谷歌已在2026年2月宣布为MCP贡献gRPC传输包,Protocol Buffers可显著降低网络带宽和CPU开销。

同时,2025年11月规范引入了Streamable HTTP,替代了传统的SSE传输,使MCP服务器可以部署为云原生的远程服务,支持水平扩展和负载均衡。

四、从RAG到Action:一个实际的思考

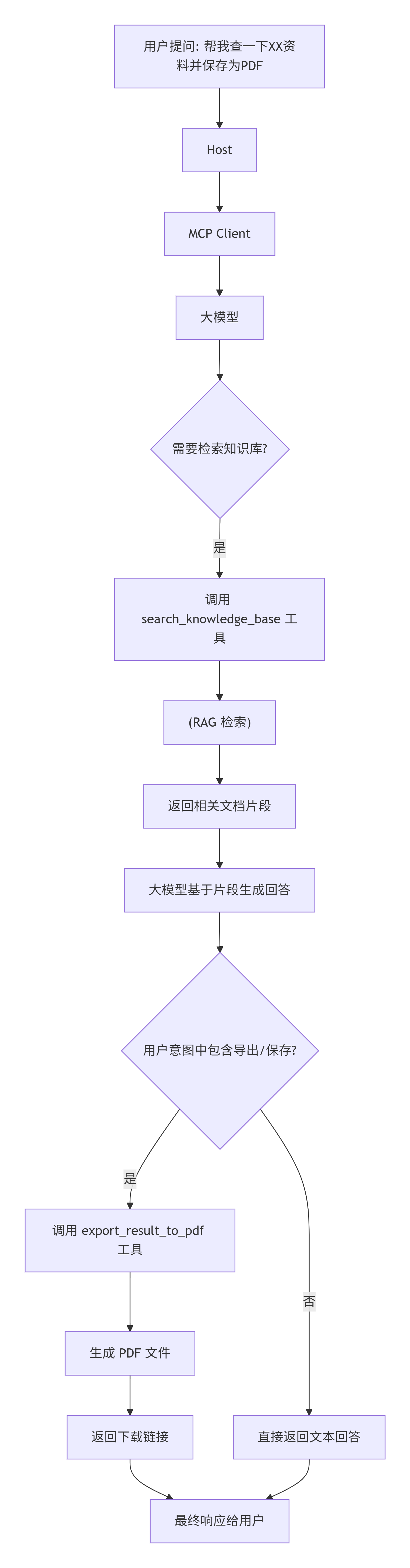

回到开头那个读者的提问——“能不能帮我做点事?”通过MCP,答案是肯定的。当用户向系统提问时,Agent的决策链路大致是这样的:

-

模型通过MCP调用

rag_search工具,检索知识库相关内容 -

基于检索结果生成回答

-

模型主动判断:用户后续是否可能想要导出结果?如果需要,调用

export_to_pdf工具 -

将生成的文件链接返回给用户

为了让这个决策更智能,我还在探索将MCP与LangGraph等状态化工作流引擎结合的可能性,让Agent具备更复杂的决策能力——比如根据问题类型自动选择检索策略,或者根据用户的历史行为预判下一步操作。

后续改进方向:

-

MCP+语义工具发现:当前模型通过工具名称和描述决定调用哪个工具。引入嵌入模型为工具功能生成向量,通过向量数据库进行自然语言查询,可实现更智能的工具路由

-

上下文压缩:MCP工具调用的返回值有时很大,浪费上下文窗口。社区已有方案(如MCP+)可将Token成本降低50%-75%

-

多Agent协作:随着MCP生态的成熟,不同能力的Agent可以通过MCP协议互相调用,构建更复杂的智能系统

总结

MCP正在成为AI Agent时代的底层基础设施——一套让大模型“动手干活”的标准化协议。截至2026年初,MCP已被Anthropic、OpenAI、Google、微软、AWS等所有主流AI厂商采纳,10,000多个生产级MCP服务器正在运行。对于已有RAG系统的开发者来说,MCP提供了一条清晰的路径:通过MCP Server封装知识库能力,让模型不仅能“知道”,更能“做到”。这套模式不仅适用于知识库问答,也可推广到任何需要AI与外部系统交互的场景。

当然,MCP还在快速演进中。水平扩展、安全治理、多Agent协作等问题正在被2026路线图逐一攻克。作为开发者,现在正是学习MCP、动手搭建第一个MCP Server的好时机。毕竟,未来的AI Agent,不会只是会聊天的“花瓶”。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献32条内容

已为社区贡献32条内容

所有评论(0)