深入解析Kubernetes中的RuntimeClass:容器运行时的“多面手调度器”

前言

在Kubernetes集群中,我们通常认为“容器就是容器”——所有的Pod都通过同一套容器运行时启动,享受相同的性能特性和安全边界。然而,随着业务场景的多样化、安全合规要求的升级以及硬件加速技术的普及,单一的容器运行时已无法满足所有场景的需求:

-

安全隔离需求:如何让处理金融交易的应用运行在强隔离的轻量级虚拟机中,抵御内核级漏洞的容器逃逸风险?

-

性能优化需求:如何为AI训练任务启用GPU共享和拓扑感知调度,最大化硬件利用率?

-

新兴技术融合:如何为Serverless函数提供极速启动的WebAssembly运行时,实现毫秒级冷启动?

-

多运行时共存:如何在同一个集群中,安全地混合运行runc、gVisor、Kata Containers等多种运行时,而非为每种需求单独搭建集群?

RuntimeClass正是Kubernetes为解决这些问题而设计的核心机制。它允许你声明式地定义不同的容器运行时配置,并通过Pod调度策略,将工作负载精确地分发到匹配的运行时环境中。它相当于为Kubernetes调度器增加了一把“运行时钥匙”,让Pod能够精准匹配到具备特定运行时能力的节点。

本文将深入剖析RuntimeClass的核心原理、配置方法、高级特性、真实应用场景与最佳实践,助你构建一个灵活、安全、高性能的异构运行时集群。

第一章 技术演进:从单一运行时到RuntimeClass

1.1 早期Kubernetes架构:Docker独大的时代

在Kubernetes v1.5之前的早期版本中,Kubelet的代码中直接包含了处理Docker的逻辑,Kubelet直接调用Docker API来创建容器。这种设计导致了两大严重问题:

-

耦合过深:每次Docker更新API,Kubernetes都必须跟着修改代码并重新编译;

-

扩展困难:当CoreOS推出rkt容器引擎时,Kubernetes为了支持它,被迫在Kubelet里添加了类似

if runtime == 'rkt'的判断逻辑,导致Kubelet变得极度臃肿且难以维护。

1.2 CRI的诞生:切断强耦合的关键一步

为了打破Kubelet与特定运行时之间的强耦合关系,Kubernetes在v1.5版本引入了CRI(Container Runtime Interface)。Kubelet转变为gRPC客户端,只负责发送标准化指令(如CreateContainer)。任何厂商只要实现了CRI的gRPC Server(称为CRI Shim),就能被Kubernetes使用。

CRI架构的引入使得Kubernetes能够支持多种容器运行时,但在一个集群中混合使用不同运行时仍然需要额外的机制——这正是RuntimeClass诞生的背景。

1.3 RuntimeClass的诞生与演进

随着CRI生态的成熟,除了标准的runc,市场上出现了强调安全隔离的gVisor(Google)和Kata Containers(基于轻量级虚拟机)。为了让用户能够在同一个集群中混合使用这些不同的运行时,Kubernetes在v1.12版本引入了RuntimeClass API对象,并在v1.20版本正式达到GA(General Availability)状态。

RuntimeClass的核心作用是:让Kubelet通过CRI传递请求时,能够带上一个runtime_handler字符串,明确告知底层运行时:“这个Pod请帮我用gVisor启动”。

1.4 弃用Dockershim:架构的进一步简化

Kubernetes在v1.24版本正式移除了Dockershim(那个为了兼容Docker而存在的“转接头”)。现在的架构变得更加简洁:Kubelet直接与containerd或CRI-O交互,这些CRI实现再通过OCI标准调用底层的runc、gVisor或Kata等运行时。

架构演进的关键时间线:

Pre-v1.5:Kubelet直接与Docker API通信

v1.5:CRI首次引入

v1.12:RuntimeClass作为Alpha特性引入

v1.20:RuntimeClass正式GA

v1.24:正式移除Dockershim

1.5 单一运行时的核心局限

传统Kubernetes集群采用统一的容器运行时,这导致了以下几方面的局限:

| 局限类别 | 具体问题 | 典型场景 |

|---|---|---|

| 安全合规 | 多租户环境下容器共享宿主机内核,存在逃逸风险 | 多租户SaaS平台、金融交易系统 |

| 性能隔离 | 密集型任务可能影响其他应用性能 | 大数据计算与在线服务混布 |

| 技术栈混合 | 无法在同一集群运行Wasm、VM等非标准容器 | Serverless函数、遗留虚拟机应用 |

| 硬件加速 | GPU、FPGA等特殊设备需定制化支持 | AI训练、高性能计算 |

RuntimeClass正是为解决这些痛点而设计,它通过为不同Pod指定不同的运行时,在性能、安全性与资源效率之间实现灵活平衡。

第二章 RuntimeClass核心概念与架构

2.1 什么是RuntimeClass?

RuntimeClass是一个集群级别的Kubernetes资源(Cluster-Scoped Resource),用于定义一组容器运行时的配置,并允许Pod通过声明选择特定的运行时环境。它相当于为Pod提供了一个“运行时菜单”,让应用能够“按需点菜”。

yaml

apiVersion: node.k8s.io/v1 kind: RuntimeClass metadata: name: gvisor # RuntimeClass的名称,供Pod引用 handler: gvisor # 节点CRI中注册的运行时句柄

2.2 核心价值

RuntimeClass为Kubernetes平台带来了以下核心价值:

-

抽象运行时差异:屏蔽runc、containerd、gVisor、Kata Containers等底层运行时实现细节,以统一API方式对外暴露运行时能力;

-

实现运行时调度:Kubernetes调度器根据Pod中指定的

runtimeClassName,将Pod调度到支持该运行时的节点上; -

支持多运行时共存:一个Kubernetes集群可以同时运行多种隔离级别和性能特征的容器,无需为每种需求单独维护集群;

-

统一管理接口:通过Kubernetes原生API统一配置运行时,大幅简化多环境运维复杂度。

2.3 关键组件与角色

RuntimeClass体系的运行涉及以下核心组件:

| 组件 | 职责 |

|---|---|

| RuntimeClass资源 | 集群级资源,定义运行时名称(metadata.name)、处理句柄(handler)和调度约束(scheduling) |

| Node(CRI实现) | 节点上运行的具体CRI实现(如containerd、CRI-O),通过配置文件注册可用的运行时handler |

| Kubelet | 根据Pod的runtimeClassName解析对应的RuntimeClass对象,并通过CRI调用对应的运行时处理程序 |

| Pod | 通过spec.runtimeClassName字段声明其所需的运行时类型 |

2.4 RuntimeClass资源结构详解

RuntimeClass资源定义于node.k8s.io/v1 API组,包含以下核心字段:

yaml

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: <RuntimeClass名称> # 集群级资源,需全局唯一

handler: <CRI handler名称> # 必需字段,必须与节点CRI配置中的handler一致

overhead: # 可选,定义Pod固定资源开销

podFixed:

cpu: "100m"

memory: "128Mi"

scheduling: # 可选,调度约束

nodeSelector: # 节点标签选择器

kubernetes.io/os: "linux"

accelerator: "gpu"

tolerations: # 容忍度配置

- key: "runtime/gvisor"

operator: "Exists"

effect: "NoSchedule"

2.4.1 handler字段

handler字段是RuntimeClass中唯一必需的核心字段,它指定了底层运行时及配置的名称。该值必须与节点CRI实现中配置的运行时handler名称精确匹配。handler必须满足以下要求:

-

全小写字母;

-

符合DNS标签(RFC 1123)规范;

-

创建后不可变(immutable)。

Kubernetes假设所有节点上都可用相同名称的handler,且相同名称的handler在所有节点上等效。例如,名为runc的handler可能指定使用runc OCI运行时(即原生Linux容器)来运行Pod中的容器。

2.4.2 overhead字段

overhead字段用于声明运行给定RuntimeClass的Pod所关联的资源开销。某些运行时(尤其是基于硬件虚拟化的运行时,如Kata Containers)会消耗额外的资源(如内存、CPU)来运行基础设施组件(如虚拟机监控器)。overhead字段允许集群管理员在资源调度时将此开销纳入考量。

yaml

overhead:

podFixed:

cpu: "250m"

memory: "512Mi"

当Pod引用了定义了overhead的RuntimeClass时,Kubernetes的准入控制器会自动将Pod的spec.Overhead字段设置为该开销值,调度器在计算节点资源容量时会将这些开销计入考虑。

2.4.3 scheduling字段

scheduling字段包含两个子字段,用于确保使用该RuntimeClass的Pod只被调度到支持该运行时的节点上:

nodeSelector:列出支持此RuntimeClass的节点上必须存在的标签。使用此RuntimeClass的Pod只能被调度到与该选择器匹配的节点上。在准入控制阶段,RuntimeClass的nodeSelector会与Pod自身已有的nodeSelector进行交集合并,如果存在冲突(即无任何节点同时满足两个选择器),Pod将被拒绝调度。

tolerations:在准入控制阶段,这些容忍度会被追加(去除重复项)到使用此RuntimeClass的Pod上,与Pod自身的容忍度取并集。这使得节点可以通过打上污点来限制哪些RuntimeClass的Pod可以调度到其上。

关键调度语义:

nodeSelector:交集(intersection)——RuntimeClass与Pod的选择条件必须同时满足

tolerations:并集(union)——RuntimeClass与Pod的容忍条件合并

如果scheduling字段未设置,则假定此RuntimeClass在所有节点上都受支持。

第三章 工作原理:从Pod到运行时的完整调度链路

3.1 整体工作流程

RuntimeClass的完整工作流程可分为六个关键阶段:

text

Pod创建 → 准入控制 → 调度决策 → 节点绑定 → Kubelet解析 → CRI调用 → 容器启动

3.2 阶段一:Pod创建与准入控制

当用户提交一个包含runtimeClassName字段的Pod定义时,Kubernetes API Server首先进行准入控制。准入控制器(RuntimeClass Admission Controller)负责:

-

根据Pod的

runtimeClassName查找对应的RuntimeClass对象; -

如果RuntimeClass定义了

overhead,则将该开销值注入到Pod的spec.Overhead字段; -

如果RuntimeClass定义了

scheduling.nodeSelector,将其与Pod的nodeSelector进行交集合并; -

如果RuntimeClass定义了

scheduling.tolerations,将其与Pod的tolerations进行并集合并。

3.3 阶段二:调度决策

经过准入控制处理后,Pod进入调度队列。Kubernetes调度器根据以下信息选择最合适的节点:

-

Pod自身的资源请求(包括通过

overhead注入的额外资源开销); -

Pod的节点选择器(合并了RuntimeClass的

nodeSelector); -

Pod的容忍度(合并了RuntimeClass的

tolerations); -

节点的可用资源、标签和污点状态。

如果没有任何节点满足所有约束条件,Pod将保持Pending状态并记录调度失败事件。

3.4 阶段三:节点绑定与Kubelet处理

调度器选定节点后,将Pod绑定到该节点。节点上的Kubelet负责:

-

解析Pod的

runtimeClassName引用; -

将对应的

handler名称传递给CRI实现; -

CRI实现根据

handler名称查找对应的运行时配置并启动容器。

如果引用的RuntimeClass不存在,或CRI无法运行对应的handler,Pod将进入Failed终止阶段,用户可通过kubectl describe pod查看相关事件获取错误信息。

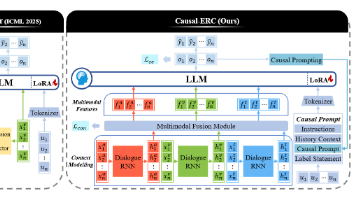

3.5 技术栈全景图

理解RuntimeClass在整体技术栈中的位置至关重要:

text

┌─────────────────────────────────────────────────────────────┐

│ Kubernetes API Server │

│ ┌─────────────────────────────────────────────────────────┐ │

│ │ RuntimeClass 资源 (node.k8s.io/v1) │ │

│ │ metadata.name | handler | overhead | scheduling │ │

│ └─────────────────────────────────────────────────────────┘ │

└─────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────┐

│ Kubelet │

│ ┌─────────────────────────────────────────────────────────┐ │

│ │ 解析 runtimeClassName → 获取 handler → 调用 CRI │ │

│ └─────────────────────────────────────────────────────────┘ │

└─────────────────────────────────────────────────────────────┘

│

▼ CRI (gRPC)

┌─────────────────────────────────────────────────────────────┐

│ High-Level Runtime (CRI实现) │

│ ┌───────────────┐ ┌───────────────┐ ┌───────────────┐ │

│ │ containerd │ │ CRI-O │ │ 其他CRI实现 │ │

│ └───────────────┘ └───────────────┘ └───────────────┘ │

└─────────────────────────────────────────────────────────────┘

│

▼ OCI (Open Container Initiative)

┌─────────────────────────────────────────────────────────────┐

│ Low-Level Runtime (OCI Runtime) │

│ ┌───────┐ ┌───────┐ ┌───────┐ ┌───────┐ ┌───────────┐ │

│ │ runc │ │ crun │ │ gVisor│ │ Kata │ │ WasmEdge │ │

│ └───────┘ └───────┘ └───────┘ └───────┘ └───────────┘ │

└─────────────────────────────────────────────────────────────┘

其中:

-

CRI(Container Runtime Interface):Kubernetes与高层运行时之间的接口规范,基于gRPC协议;

-

OCI(Open Container Initiative):高层运行时与底层运行时之间的接口规范,定义了容器镜像格式和运行时标准;

-

High-Level Runtime:负责镜像管理、网络集成和与Kubernetes的CRI对接;

-

Low-Level Runtime:负责实际的容器执行工作——创建Linux命名空间、设置cgroups、从OCI bundle中生成容器进程。

第四章 配置实战:从节点配置到Pod使用

4.1 前置条件:节点CRI配置

RuntimeClass的使用依赖于CRI实现层面的配置。每个需要支持的运行时handler都必须在每个节点上预先配置好。

4.1.1 containerd配置示例

以containerd为例,编辑/etc/containerd/config.toml配置文件,在plugins."io.containerd.grpc.v1.cri".containerd.runtimes块下添加运行时配置:

toml

version = 2

[plugins."io.containerd.grpc.v1.cri"]

sandbox_image = "registry.k8s.io/pause:3.9"

# 标准运行时 - 用于可信工作负载

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.runc]

runtime_type = "io.containerd.runc.v2"

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.runc.options]

SystemdCgroup = true

# 强化运行时 - 用于生产环境敏感应用

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.runc-production]

runtime_type = "io.containerd.runc.v2"

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.runc-production.options]

SystemdCgroup = true

CpuQuota = 100000

NoNewPrivileges = true

SelinuxLabel = "system_u:system_r:container_runtime_t:s0"

# gVisor安全沙箱运行时

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.gvisor]

runtime_type = "io.containerd.runsc.v1"

# Kata Containers硬件虚拟化运行时

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.kata]

runtime_type = "io.containerd.kata.v2"

privileged_without_host_devices = true

配置完成后,重启containerd使配置生效:

bash

sudo systemctl restart containerd

注意:handler名称(如

runc、gvisor、kata)必须与后续创建的RuntimeClass中的handler字段严格一致。handler必须是有效的DNS标签名。

4.1.2 CRI-O配置示例

对于CRI-O用户,编辑/etc/crio/crio.conf配置文件:

toml

[crio.runtime.runtimes.gvisor] runtime_path = "/usr/local/bin/runsc" runtime_type = "oci" [crio.runtime.runtimes.kata] runtime_path = "/usr/bin/kata-runtime" runtime_type = "vm"

重启CRI-O使配置生效:

bash

sudo systemctl restart crio

4.2 创建RuntimeClass资源

节点CRI配置完成后,需要为每个handler创建对应的RuntimeClass资源。RuntimeClass是集群级资源,不归属于任何Namespace,由集群管理员统一管理。

4.2.1 基础RuntimeClass示例

yaml

# runtimeclass-runc.yaml apiVersion: node.k8s.io/v1 kind: RuntimeClass metadata: name: standard handler: runc --- # runtimeclass-gvisor.yaml apiVersion: node.k8s.io/v1 kind: RuntimeClass metadata: name: secure handler: gvisor --- # runtimeclass-kata.yaml apiVersion: node.k8s.io/v1 kind: RuntimeClass metadata: name: isolated handler: kata

应用RuntimeClass:

bash

kubectl apply -f runtimeclass-runc.yaml kubectl apply -f runtimeclass-gvisor.yaml kubectl apply -f runtimeclass-kata.yaml # 查看已创建的RuntimeClass kubectl get runtimeclass

4.2.2 带调度约束的RuntimeClass

对于异构节点集群(例如只有部分节点安装了gVisor或Kata Containers),需要通过scheduling字段确保Pod被调度到正确的节点上:

yaml

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: gvisor-gpu

handler: gvisor

scheduling:

nodeSelector:

accelerator: "gpu" # 只调度到有GPU的节点

kubernetes.io/os: "linux"

tolerations:

- key: "nvidia.com/gpu"

operator: "Exists"

effect: "NoSchedule"

4.3 在Pod中使用RuntimeClass

配置完成后,Pod只需在spec中添加runtimeClassName字段即可指定所需的运行时:

yaml

apiVersion: v1

kind: Pod

metadata:

name: standard-app

spec:

runtimeClassName: standard # 使用标准runc运行时

containers:

- name: app

image: nginx:latest

---

apiVersion: v1

kind: Pod

metadata:

name: secure-app

spec:

runtimeClassName: secure # 使用gVisor安全沙箱

containers:

- name: app

image: nginx:latest

---

apiVersion: v1

kind: Pod

metadata:

name: isolated-app

spec:

runtimeClassName: isolated # 使用Kata轻量级虚拟机

containers:

- name: app

image: nginx:latest

重要提示:如果未指定

runtimeClassName,将使用集群的默认运行时(由CRI实现决定),相当于禁用RuntimeClass功能。

4.4 在Deployment中使用RuntimeClass

RuntimeClass同样适用于Deployment、StatefulSet、DaemonSet等高级工作负载:

yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: secure-web-app

spec:

replicas: 3

selector:

matchLabels:

app: web

template:

metadata:

labels:

app: web

spec:

runtimeClassName: secure

containers:

- name: nginx

image: nginx:latest

resources:

requests:

memory: "256Mi"

cpu: "250m"

limits:

memory: "512Mi"

cpu: "500m"

4.5 验证RuntimeClass配置

使用以下命令验证RuntimeClass配置是否正确:

bash

# 列出所有RuntimeClass kubectl get runtimeclass # 查看具体RuntimeClass的详细信息 kubectl describe runtimeclass <name> # 查看Pod实际使用的运行时 kubectl get pod <pod-name> -o yaml | grep runtimeClassName # 检查Pod调度状态 kubectl describe pod <pod-name>

第五章 高级特性详解

5.1 Pod Overhead:精准的资源核算

5.1.1 问题背景

某些容器运行时(特别是基于硬件虚拟化的运行时,如Kata Containers)在运行Pod时需要消耗额外的资源来支撑基础设施组件(如虚拟机监控器、guest内核等)。这些资源开销如果未被Kubernetes调度器感知,会导致节点资源的实际消耗超出调度时的预估,引发资源超卖和稳定性问题。

5.1.2 Overhead机制

Pod Overhead机制允许RuntimeClass声明一个固定资源开销,该开销会在调度时被添加到Pod的资源请求中。例如,Kata Containers运行时可能需要为每个Pod额外分配约128Mi内存和100m CPU来运行虚拟机监控器。

yaml

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: kata-with-overhead

handler: kata

overhead:

podFixed:

cpu: "100m"

memory: "128Mi"

当Pod引用此RuntimeClass时:

-

准入控制器将

overhead值注入到Pod的spec.Overhead字段; -

调度器将Pod的资源请求(

spec.containers[].resources.requests)与overhead相加,作为实际调度时的资源需求; -

节点上的kubelet在计算节点资源容量时会考虑这些开销。

5.1.3 使用场景

Overhead机制特别适用于以下场景:

-

硬件虚拟化运行时:Kata Containers、Firecracker等轻量级VM运行时;

-

安全沙箱运行时:gVisor等需要额外资源的安全隔离运行时;

-

特殊硬件加速场景:需要预留内存给GPU驱动或FPGA逻辑的Pod。

5.2 Scheduling:精细化的调度控制

5.2.1 nodeSelector合并语义

RuntimeClass的nodeSelector与Pod自身的nodeSelector在准入控制阶段进行交集合并——最终调度目标节点必须同时满足两者的标签要求。

例如,RuntimeClass定义:

yaml

scheduling:

nodeSelector:

accelerator: "gpu"

Pod定义:

yaml

spec:

nodeSelector:

zone: "us-east-1a"

最终的有效节点选择器为:accelerator: "gpu" AND zone: "us-east-1a"。

如果两个选择器不存在交集(即没有节点同时满足两者),Pod将被准入控制器拒绝,不会进入调度队列。

5.2.2 tolerations合并语义

RuntimeClass的tolerations与Pod自身的tolerations在准入控制阶段进行并集合并——Pod将同时容忍两者定义的所有污点。

yaml

# RuntimeClass的容忍度

scheduling:

tolerations:

- key: "runtime/gvisor"

operator: "Exists"

effect: "NoSchedule"

yaml

# Pod的容忍度

spec:

tolerations:

- key: "node.kubernetes.io/not-ready"

operator: "Exists"

effect: "NoExecute"

合并后,Pod可以容忍runtime/gvisor和node.kubernetes.io/not-ready两类污点。

5.2.3 异构节点集群调度

在异构节点集群中,不同节点可能支持不同的运行时集。例如:

-

节点组A:安装了runc和gVisor

-

节点组B:安装了runc和Kata Containers

-

节点组C:仅安装了runc

通过RuntimeClass的scheduling字段,可以精确地将Pod调度到支持所需运行时的节点组上,同时RuntimeClass的调度约束会自动应用于所有使用它的Pod,无需在每个Pod的YAML中重复编写相同的节点选择逻辑。

5.3 多版本兼容与API演进

RuntimeClass API经历了从Alpha到GA的演进过程:

| API版本 | 状态 | 主要变化 |

|---|---|---|

node.k8s.io/v1alpha1 |

Alpha | 初始实现,运行时配置嵌套于spec下,字段名为runtimeHandler |

node.k8s.io/v1beta1 |

Beta | 扁平化结构,runtimeHandler重命名为handler |

node.k8s.io/v1 |

GA (v1.20) | 稳定版本,完全支持所有特性 |

当前生产环境应使用node.k8s.io/v1 API版本。从v1alpha1迁移到v1beta1/v1时,主要注意handler字段名的变更和结构的扁平化。

第六章 多运行时场景深入剖析

6.1 主流容器运行时对比

6.1.1 runc(标准运行时)

技术原理:runc是OCI标准的参考实现,直接利用Linux内核的namespace和cgroup机制创建容器。容器进程作为宿主机上的普通进程运行,与宿主机共享内核。

隔离级别:基础级。通过namespace实现进程级隔离,但共享宿主机内核,存在内核漏洞导致容器逃逸的风险。

性能特征:原生性能,几乎零开销,启动速度极快(毫秒级)。

适用场景:

-

可信的内部应用和微服务

-

对性能要求极高的场景(AI推理、高频交易)

-

开发测试环境

6.1.2 gVisor(安全沙箱运行时)

技术原理:gVisor(runsc)提供了一个用Go编写的用户态内核,拦截并处理容器的系统调用,在容器与宿主机内核之间增加了一个安全层。系统调用首先由gVisor内核处理,只有安全的调用才会转发给宿主机内核。

隔离级别:高。提供进程级和系统调用级双重隔离,攻击面显著降低。

性能特征:中等开销。系统调用密集型应用性能下降较明显(约10-30%),但CPU密集型应用影响较小。

适用场景:

-

多租户环境中的不可信代码运行

-

Serverless/FaaS平台

-

CI/CD流水线中的构建任务

-

对安全性要求较高的微服务

6.1.3 Kata Containers(硬件虚拟化运行时)

技术原理:Kata Containers为每个Pod或容器创建一个轻量级虚拟机(使用QEMU、Firecracker等VMM),每个容器拥有独立的Guest Kernel,实现硬件级别的隔离。容器与宿主机之间通过虚拟化层隔离。

隔离级别:极高。硬件级别的虚拟机隔离,即使是内核漏洞也无法逃逸到宿主机。

性能特征:较高开销。启动时间较长(约100-500ms),每个Pod有额外的内存开销(约100-200Mi),I/O性能略有下降。

适用场景:

-

金融、政务等高安全合规要求场景

-

多租户公有云环境

-

运行不可信或第三方代码

-

区块链节点等高安全要求的应用

6.1.4 WebAssembly运行时

技术原理:Wasm运行时(如WasmEdge、Wasmer)在容器环境中执行WebAssembly模块,提供极快的冷启动速度(微秒级)和接近原生的执行性能。

隔离级别:高。Wasm模块在沙箱环境中执行,内存访问受严格限制。

性能特征:启动极快(微秒级),执行性能接近原生。

适用场景:

-

Serverless函数计算

-

插件系统和扩展机制

-

边缘计算场景

-

IoT设备上的轻量级应用

6.1.5 运行时对比总结

| 运行时 | 隔离级别 | 启动速度 | 性能开销 | 安全水平 | 典型场景 |

|---|---|---|---|---|---|

| runc | 进程级 | 毫秒级 | ~0% | 基础 | 可信内部应用 |

| gVisor | 系统调用级 | 毫秒级 | 10-30% | 高 | 多租户不可信代码 |

| Kata | 硬件级 | 100-500ms | 30-50%+ | 极高 | 金融、公有云多租户 |

| Wasm | 内存沙箱 | 微秒级 | 5-15% | 高 | Serverless、边缘计算 |

6.2 典型应用场景

6.2.1 场景一:多租户安全隔离

问题描述:在SaaS平台中,不同租户的工作负载运行在同一个Kubernetes集群中。恶意租户可能利用容器逃逸漏洞攻击其他租户或宿主机。

解决方案:使用RuntimeClass为不同租户分配不同的运行时。可信租户使用标准runc运行时以获得最佳性能;不可信租户(如运行用户上传代码的FaaS平台)使用gVisor或Kata Containers进行强隔离。

yaml

# 可信租户Pod - 使用runc apiVersion: v1 kind: Pod metadata: name: tenant-trusted-app spec: runtimeClassName: standard containers: ... # 不可信租户Pod - 使用gVisor沙箱 apiVersion: v1 kind: Pod metadata: name: tenant-untrusted-app spec: runtimeClassName: secure containers: ...

6.2.2 场景二:混合操作系统集群(Windows + Linux)

问题描述:在同时包含Windows节点和Linux节点的混合操作系统集群中,需要确保Windows容器只调度到Windows节点,Linux容器只调度到Linux节点。

解决方案:使用RuntimeClass封装操作系统相关的调度逻辑,自动将Pod路由到正确的OS节点,无需在每个Pod中手动添加nodeSelector。

yaml

# Windows节点RuntimeClass

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: windows-2022

handler: runhcs-wcow-process

scheduling:

nodeSelector:

kubernetes.io/os: windows

kubernetes.io/arch: amd64

node.kubernetes.io/windows-build: "10.0.20348"

tolerations:

- key: "os"

operator: "Equal"

value: "windows"

effect: "NoSchedule"

# Linux节点RuntimeClass

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: linux

handler: runc

scheduling:

nodeSelector:

kubernetes.io/os: linux

kubernetes.io/arch: amd64

在Pod中只需指定runtimeClassName即可:

yaml

apiVersion: v1

kind: Pod

metadata:

name: windows-app

spec:

runtimeClassName: windows-2022 # 自动路由到Windows节点

containers:

- name: iis

image: mcr.microsoft.com/windows/servercore/iis:windowsservercore-ltsc2022

6.2.3 场景三:GPU加速与异构计算

问题描述:AI训练任务需要GPU加速,而普通微服务不需要。需要确保GPU工作负载被调度到有GPU的节点上,并可能使用特殊的运行时配置(如NVIDIA容器运行时)。

解决方案:创建专用于GPU工作负载的RuntimeClass,通过nodeSelector限制到有GPU标签的节点,并配置对应的handler(如nvidia-container-runtime)。

yaml

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: gpu-accelerated

handler: nvidia

scheduling:

nodeSelector:

accelerator: "nvidia-gpu"

nvidia.com/gpu.product: "A100-SXM4-40GB"

tolerations:

- key: "nvidia.com/gpu"

operator: "Exists"

effect: "NoSchedule"

6.2.4 场景四:同一运行时的不同配置策略

问题描述:即使是同一种运行时(如runc),开发、测试、生产环境可能需要不同的配置——开发环境可能需要更宽松的安全限制以便调试,生产环境则需要强化安全配置。

解决方案:在containerd中为同一运行时配置多个handler(如runc-dev、runc-prod、runc-isolated),通过RuntimeClass暴露不同的配置选项。

yaml

# 开发环境RuntimeClass - 宽松配置 apiVersion: node.k8s.io/v1 kind: RuntimeClass metadata: name: dev handler: runc-dev # 生产环境RuntimeClass - 安全强化配置 apiVersion: node.k8s.io/v1 kind: RuntimeClass metadata: name: production handler: runc-production # 高隔离环境RuntimeClass - 最大安全配置 apiVersion: node.k8s.io/v1 kind: RuntimeClass metadata: name: hardened handler: runc-isolated

6.2.5 场景五:Serverless/WASM运行时

问题描述:Serverless函数需要极快的冷启动速度,传统容器(runc)的启动速度(几十到几百毫秒)在某些场景下仍然太慢。

解决方案:使用WebAssembly运行时,实现微秒级的冷启动,同时保持较高的安全隔离水平。

yaml

apiVersion: node.k8s.io/v1 kind: RuntimeClass metadata: name: wasm handler: wasmedge

第七章 生产环境最佳实践

7.1 运行时选择策略

7.1.1 根据工作负载特性选择运行时

| 工作负载类型 | 推荐运行时 | 理由 |

|---|---|---|

| 核心业务微服务 | runc | 性能优先,安全风险可控 |

| 多租户FaaS函数 | gVisor / Kata | 运行不可信代码,需要强隔离 |

| 金融交易系统 | Kata Containers | 合规要求高,需要硬件级隔离 |

| AI训练任务 | runc + GPU | 性能要求最高 |

| Serverless函数 | Wasm / gVisor | 快速冷启动,适度隔离 |

| CI/CD构建任务 | gVisor | 运行不可信构建脚本 |

| 区块链节点 | Kata Containers | 防止恶意合约逃逸 |

7.1.2 安全与性能的平衡

RuntimeClass的核心价值之一是在安全性和性能之间提供灵活的平衡点。不同运行时在这两个维度上的权衡如下:

-

极致性能路线:全部使用runc,但需要配合Pod Security Standards、Network Policies等机制加强安全性;

-

极致安全路线:全部使用Kata Containers或gVisor,但需要接受额外的性能开销和资源消耗;

-

混合路线(推荐):根据工作负载的信任级别和性能要求,为不同Pod分配不同运行时,实现最优的整体平衡。

7.2 RuntimeClass设计规范

7.2.1 命名规范

RuntimeClass名称应具有业务语义,便于理解和维护:

yaml

# 推荐命名模式:<环境>-<运行时类型>[-<变体>] metadata: name: prod-runc # 生产环境标准运行时 metadata: name: prod-gvisor # 生产环境安全沙箱 metadata: name: dev-runc # 开发环境宽松运行时 metadata: name: staging-kata # 预发布环境硬件隔离

7.2.2 权限管理

RuntimeClass是集群级资源,建议将其写操作(create、update、patch、delete)限定于集群管理员使用,普通用户仅拥有读取权限。

yaml

# RBAC示例:限制RuntimeClass的写操作 apiVersion: rbac.authorization.k8s.io/v1 kind: ClusterRole metadata: name: runtimeclass-admin rules: - apiGroups: ["node.k8s.io"] resources: ["runtimeclasses"] verbs: ["create", "update", "patch", "delete"] --- apiVersion: rbac.authorization.k8s.io/v1 kind: ClusterRole metadata: name: runtimeclass-viewer rules: - apiGroups: ["node.k8s.io"] resources: ["runtimeclasses"] verbs: ["get", "list", "watch"]

7.3 资源规划与容量管理

7.3.1 Overhead配置建议

使用安全运行时(gVisor、Kata Containers)时,务必配置overhead字段以确保调度器能准确计算节点资源容量。以下是基于实践的经验值:

yaml

# Kata Containers overhead经验值

overhead:

podFixed:

cpu: "200m"

memory: "256Mi"

# gVisor overhead经验值

overhead:

podFixed:

cpu: "100m"

memory: "64Mi"

注意:实际overhead值取决于节点配置、运行时版本和Pod特性,建议通过实际压测确定精确值。

7.3.2 节点容量规划

在规划节点容量时,需要考虑:

-

运行时overhead:每个Pod的安全运行时开销;

-

系统预留:操作系统、kubelet、容器运行时自身的资源消耗;

-

调度缓冲区:为突发流量和滚动更新预留约20-30%的缓冲区。

7.4 监控与可观测性

7.4.1 关键监控指标

使用RuntimeClass后,需要建立以下维度的监控体系:

| 监控维度 | 关键指标 | 建议工具 |

|---|---|---|

| Pod调度延迟 | 不同RuntimeClass的Pod调度时间 | Prometheus + kube-state-metrics |

| 容器启动时间 | 各运行时的容器启动耗时分布 | Prometheus + cAdvisor |

| 资源利用率 | 按RuntimeClass聚合的CPU/内存使用 | Prometheus + Grafana |

| 调度失败事件 | FailedScheduling事件按RuntimeClass统计 |

Kubernetes Events + Alertmanager |

7.4.2 运行时切换的可观测性

为确保运行时切换的透明度,建议:

yaml

# 在Pod中添加运行时标识标签

metadata:

labels:

runtime-class: "gvisor"

runtime-handler: "runsc"

通过Prometheus按runtime-class标签聚合指标,可以直观对比不同运行时的性能特征和资源消耗模式。

7.5 故障排查与调试

7.5.1 常见问题及解决方案

问题1:Pod一直Pending,显示节点不匹配

bash

# 检查Pod事件 kubectl describe pod <pod-name> # 检查RuntimeClass的nodeSelector是否与节点标签匹配 kubectl get nodes --show-labels # 检查RuntimeClass定义 kubectl get runtimeclass <name> -o yaml

问题2:Pod进入Failed状态,RuntimeClass不存在

bash

# 验证RuntimeClass是否存在 kubectl get runtimeclass # 检查Pod中runtimeClassName字段的拼写 kubectl get pod <pod-name> -o yaml | grep runtimeClassName

问题3:CRI无法运行handler

bash

# 检查节点CRI配置 cat /etc/containerd/config.toml | grep -A 5 runtimes # 重启CRI服务 sudo systemctl restart containerd # 查看kubelet日志 journalctl -u kubelet -f

问题4:Overhead导致节点资源不足

bash

# 检查节点的资源分配情况 kubectl describe node <node-name> # 验证RuntimeClass的overhead配置 kubectl get runtimeclass <name> -o yaml | grep -A 3 overhead

7.5.2 调试工具链

-

crictl:直接与CRI实现交互,绕过kubelet进行调试

-

kubectl describe:查看Pod事件和节点状态

-

kubectl get events:按时间线查看集群事件

-

节点日志:

/var/log/containerd/、/var/log/kubelet.log

第八章 安全考量与合规

8.1 多租户环境安全策略

在多租户Kubernetes环境中,RuntimeClass是实现安全隔离的关键工具。以下是一套完整的多租户安全策略:

8.1.1 强制运行时隔离

通过Pod Security Admission(PSA)和RuntimeClass结合,强制不可信租户使用安全运行时:

yaml

# 为不可信命名空间配置Pod Security Standard

apiVersion: v1

kind: Namespace

metadata:

name: tenant-untrusted

labels:

pod-security.kubernetes.io/enforce: "restricted"

pod-security.kubernetes.io/enforce-version: "latest"

---

# 配置Mutating Admission Webhook强制添加runtimeClassName

# 或者通过策略引擎(如OPA/Gatekeeper)强制执行

8.1.2 节点隔离策略

对于极高安全要求的场景,可以将安全运行时节点单独打上污点,只有配置了对应容忍度的RuntimeClass Pod才能调度到这些节点:

yaml

# 节点打上污点

kubectl taint nodes kata-node runtime=kata:NoSchedule

# RuntimeClass配置对应的容忍度

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: kata-isolated

handler: kata

scheduling:

tolerations:

- key: "runtime"

operator: "Equal"

value: "kata"

effect: "NoSchedule"

8.2 运行时安全加固

8.2.1 安全上下文配置

即使使用安全运行时,仍应配置Pod Security Context以提供纵深防御:

yaml

apiVersion: v1

kind: Pod

metadata:

name: secure-pod

spec:

runtimeClassName: gvisor

securityContext:

runAsNonRoot: true

runAsUser: 1000

seccompProfile:

type: RuntimeDefault

containers:

- name: app

image: nginx:latest

securityContext:

allowPrivilegeEscalation: false

capabilities:

drop: ["ALL"]

readOnlyRootFilesystem: true

8.2.2 审计日志

启用Kubernetes审计日志,记录RuntimeClass的创建、修改和删除操作,以及Pod的运行时选择情况。

8.3 合规要求满足

RuntimeClass可以帮助满足以下合规要求:

| 合规标准 | 相关要求 | RuntimeClass实现方式 |

|---|---|---|

| PCI-DSS | 隔离处理支付数据的系统 | 使用Kata Containers运行支付处理Pod |

| HIPAA | 保护医疗数据的机密性 | 安全运行时 + 节点级隔离 |

| SOC2 | 多租户隔离控制 | 按租户分配不同运行时级别 |

| ISO 27001 | 访问控制和隔离措施 | RuntimeClass RBAC + 运行时隔离 |

第九章 性能优化与调优

9.1 运行时性能对比

基于实际测试数据的运行时性能对比(仅供参考,实际性能因环境和配置而异):

| 运行时 | 容器启动时间(P99) | CPU开销(syscall密集) | 内存开销(每Pod) | 网络吞吐量 | 磁盘I/O |

|---|---|---|---|---|---|

| runc | 50-100ms | 基准值 | 基准值 | 基准值 | 基准值 |

| gVisor | 80-150ms | +20-40% | +20-50Mi | -5-10% | -5-15% |

| Kata | 200-500ms | +30-50% | +150-250Mi | -10-20% | -10-20% |

| Wasm | 0.1-1ms | +5-15% | +5-10Mi | -0-5% | 不适用 |

9.2 启动性能优化

9.2.1 预拉取镜像

对于Kata Containers等启动较慢的运行时,提前在节点上预拉取常用镜像:

bash

# 在节点上执行 ctr image pull --user <registry-auth> <image-name>

9.2.2 使用pause镜像优化

确保CRI配置中使用了合适的pause镜像,避免每次启动都拉取:

toml

[plugins."io.containerd.grpc.v1.cri"] sandbox_image = "registry.k8s.io/pause:3.9"

9.3 运行时特定调优

9.3.1 containerd调优

toml

# 增加并发处理能力 [plugins."io.containerd.grpc.v1.cri"] max_concurrent_downloads = 10 max_container_log_line_size = 16384 # 优化镜像拉取 [plugins."io.containerd.grpc.v1.cri".registry] config_path = "/etc/containerd/certs.d"

9.3.2 gVisor调优

toml

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.gvisor.options] # 使用更快的平台 Platform = "ptrace" # 或 "kvm" 以获得更好的性能 # 调整系统调用拦截策略 Debug = false

9.3.3 Kata Containers调优

toml

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.kata.options] # 使用更轻量的VMM ConfigPath = "/opt/kata/share/defaults/kata-containers/configuration-qemu.toml" # 减少启动时间 EnableVhostUserStore = false

第十章 未来展望

10.1 云原生运行时生态趋势

容器运行时生态正朝着多元化、专业化的方向发展:

-

安全运行时持续演进:机密计算(Confidential Computing)与容器运行时融合,提供加密内存级别的安全保障;

-

Wasm与容器融合:WebAssembly在容器生态中的集成将更加深入,实现更快的冷启动和更小的资源占用;

-

eBPF驱动的新运行时:利用eBPF技术实现更高效的安全观测和控制;

-

边缘计算运行时优化:针对边缘环境资源受限的特点,轻量级运行时将成为重点发展方向。

10.2 RuntimeClass的未来演进

RuntimeClass作为Kubernetes运行时的核心抽象层,未来可能在以下方向持续演进:

-

更丰富的调度语义:支持基于运行时性能特征的智能调度;

-

动态Overhead计算:根据Pod实际规格动态计算overhead,而非固定值;

-

运行时热切换:在不重启Pod的情况下切换运行时(适用于调试场景);

-

与设备插件更紧密的集成:运行时与GPU、FPGA等特殊设备的调度协同。

10.3 社区与生态

-

OCI(Open Container Initiative):持续推动容器运行时标准的演进

-

CRI-O:Kubernetes原生CRI实现的轻量级选项

-

Kata Containers:OpenInfra基金会下的开源安全容器项目

-

gVisor:Google开源的用户态内核安全运行时

-

WasmEdge:CNCF沙箱项目,提供高性能Wasm运行时

第十一章 总结

11.1 核心要点回顾

-

RuntimeClass是Kubernetes多运行时架构的核心抽象:它将不同容器运行时的能力抽象为统一的API资源,让Pod能够声明式地选择最适合其需求的运行时环境。

-

技术架构清晰分层:Kubernetes → CRI → 高层运行时(containerd/CRI-O)→ OCI → 底层运行时(runc/gVisor/Kata),各层职责明确,RuntimeClass在Kubernetes层面提供运行时选择的抽象。

-

配置链路完整:从节点CRI配置(定义handler)到RuntimeClass创建(绑定handler和调度策略),再到Pod引用(runtimeClassName),形成完整的配置闭环。

-

高级特性增强能力:

overhead提供精准资源核算,scheduling实现精细化调度控制,两者结合使RuntimeClass在生产环境中具备实用价值。 -

场景驱动选型:根据不同工作负载的安全和性能需求,在runc、gVisor、Kata Containers、Wasm等运行时之间灵活选择,实现安全与性能的最佳平衡。

11.2 实践建议清单

| 建议类别 | 具体建议 |

|---|---|

| 规划阶段 | 明确工作负载分类,制定运行时选型矩阵 |

| 配置阶段 | 先配置节点CRI,再创建RuntimeClass,最后在Pod中使用 |

| 生产部署 | 配置overhead确保资源准确性,使用scheduling控制调度 |

| 安全加固 | RuntimeClass写操作仅限管理员,结合Pod Security Standards |

| 监控告警 | 按RuntimeClass聚合指标,建立启动时间和调度失败告警 |

| 持续优化 | 定期评估运行时性能,根据实际负载调整运行时选择 |

11.3 结语

RuntimeClass是Kubernetes生态中一个低调而强大的特性。它不像Service Mesh那样引人注目,也不像CRD那样被广泛讨论,但对于需要在一个集群中同时满足性能、安全、合规等多维度需求的平台团队而言,RuntimeClass是构建灵活、安全、高性能异构运行时集群不可或缺的关键基础设施。

从最初的CRI引入,到v1.12的Alpha版本,再到v1.20的GA稳定,RuntimeClass的演进见证了Kubernetes社区对运行时生态的深刻理解。它不仅是容器运行时的“多面手调度器”,更是云原生时代多运行时架构的核心引擎。

掌握RuntimeClass,意味着你能够在同一个Kubernetes集群中:

-

为金融应用提供硬件级别的隔离保障;

-

为AI训练任务提供GPU直通的极致性能;

-

为Serverless函数提供毫秒级的冷启动体验;

-

为多租户环境提供安全可控的运行时隔离。

这正是云原生技术的魅力所在——通过标准化的抽象层,将多样化的底层能力统一呈现,让应用能够“各取所需、各得其所”。

附录

A. 相关命令速查

bash

# RuntimeClass管理 kubectl get runtimeclass # 列出所有RuntimeClass kubectl describe runtimeclass <name> # 查看RuntimeClass详情 kubectl create -f runtimeclass.yaml # 创建RuntimeClass kubectl delete runtimeclass <name> # 删除RuntimeClass # Pod运行时验证 kubectl get pod <pod-name> -o yaml | grep runtimeClassName kubectl describe pod <pod-name> | grep -A 5 "Runtime Class" # 节点CRI配置检查 cat /etc/containerd/config.toml | grep -A 10 "runtimes" sudo systemctl status containerd # 运行时调试(crictl) crictl ps -a # 列出所有容器 crictl inspect <container-id> | grep runtime # 查看容器运行时信息

B. 完整示例:多运行时集群配置

完整的RuntimeClass配置示例包含三个部分:节点CRI配置、RuntimeClass定义、Pod使用示例。

步骤1:节点CRI配置(/etc/containerd/config.toml)

toml

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes]

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.runc]

runtime_type = "io.containerd.runc.v2"

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.gvisor]

runtime_type = "io.containerd.runsc.v1"

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.kata]

runtime_type = "io.containerd.kata.v2"

步骤2:创建RuntimeClass

yaml

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: standard

handler: runc

---

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: secure

handler: gvisor

overhead:

podFixed:

cpu: "100m"

memory: "64Mi"

---

apiVersion: node.k8s.io/v1

kind: RuntimeClass

metadata:

name: isolated

handler: kata

overhead:

podFixed:

cpu: "250m"

memory: "256Mi"

scheduling:

nodeSelector:

runtime-support: "kata"

步骤3:在Pod中使用

yaml

# 使用标准运行时

apiVersion: v1

kind: Pod

metadata:

name: app-standard

spec:

runtimeClassName: standard

containers:

- name: app

image: nginx

# 使用安全沙箱运行时

apiVersion: v1

kind: Pod

metadata:

name: app-secure

spec:

runtimeClassName: secure

containers:

- name: app

image: nginx

# 使用硬件隔离运行时

apiVersion: v1

kind: Pod

metadata:

name: app-isolated

spec:

runtimeClassName: isolated

containers:

- name: app

image: nginx

C. 术语表

| 术语 | 英文 | 说明 |

|---|---|---|

| CRI | Container Runtime Interface | Kubernetes与容器运行时之间的接口 |

| OCI | Open Container Initiative | 容器运行时和镜像格式的开放标准 |

| RuntimeClass | - | Kubernetes中用于选择容器运行时的API资源 |

| Handler | - | CRI配置中定义的运行时处理程序名称 |

| Overhead | - | 运行特定运行时Pod所需的额外资源开销 |

| Sandbox | - | 提供额外隔离层的容器运行时环境 |

| runc | - | OCI标准的参考实现,直接使用Linux内核机制 |

| gVisor | runsc | Google开发的用户态内核安全沙箱运行时 |

| Kata Containers | - | 为每个容器提供轻量级虚拟机的安全运行时 |

| containerd | - | 行业标准的容器运行时,CNCF项目 |

| CRI-O | - | Kubernetes原生CRI实现的轻量级容器运行时 |

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)