驯化AI与智能系统

【注:本文的文字内容经AI调整与优化】

作为一名产品经理,精心规划了一个智能客服功能,上线后却收到业务方的连环追问:“为什么它昨天还能准确告知用户退货政策,今天就开始推荐起无关商品?”“上次演示时,它能完美总结会议纪要,这次怎么连谁说了什么都分不清了?”

作为一名研发工程师,满怀期待地接入了号称最强的开源大模型,却在与业务系统联调时陷入绝望——你期望它生成一句精准的数据库查询语句,它却时而给你一段无法执行的“SELECT * FROM unknown_table”,时而在返回的故障报告里,将简单的“网络延迟”分析成一段充满文学修辞的、天马行空的“服务器在沉思”的哲学探讨,迫使你不得不为它的每一次“自由发挥”打上厚厚的规则补丁,在无数个if-else中,为AI的“创造性”收拾残局?

如果你有碰到此类或类似的困扰,那么很可能遭遇了同一个核心问题:你面对的,是一个尚未被“驯化”的AI。

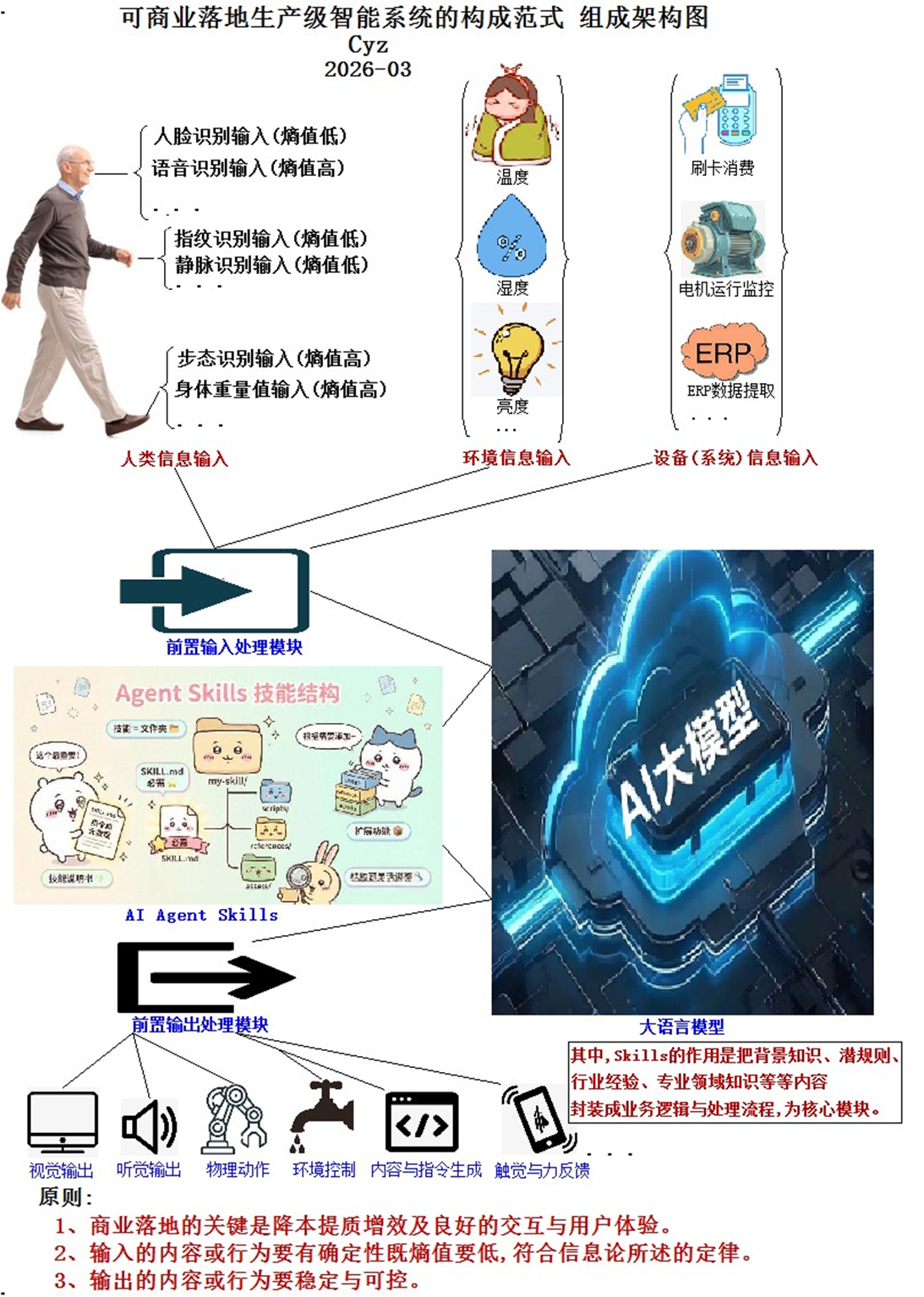

其中,以下两张图为笔者自己总结的智能系统构成范式及具有良好交互与用户体验的示例智能系统,希望能为各位看官带来思考与启示,也为继续阅读下文内容做好铺垫。

一、正视现实:我们正在使用的,是一个“概率机器”

让我们先达成一个基本共识,这源于一个极为犀利的观点:

当前主流的大语言模型(LLM),其本质不是一个逻辑引擎,而是一个“概率机器”。

它的工作原理,是基于海量数据训练出的统计规律,预测下一个词(或token)最可能是什么。这赋予了它惊人的“泛化”和“创造”能力,但也埋下了产业应用中最致命的隐患:不确定性。

产业场景的“确定性”铁律

想象一下,在真实的业务世界里:

- 在工厂里,设备经理需要知道:“3号产线的变频器,温度是否在**过去1小时内持续超过85℃**的阈值?” 他不需要一段充满“可能”、“或许”、“一般来说”的散文式描述。

- 在银行里,合规专员需要判断:“这份贷款合同的第8.3条,关于提前还款的罚金计算方式,是否完全符合银保监会【2023】1号文的明确规定?” 他不能接受一个含糊的“建议咨询专业人士”。

- 在医院里,放射科医生需要报告:“右肺上叶发现一个6mm的磨玻璃结节,分叶征阳性,建议3个月后复查。” 他绝不能得到一个“肺部有阴影,请注意身体健康,平时要早睡早起”的养生建议。

在这些场景中,模糊即是风险,不确定就是成本。一个“聪明但不可靠”的AI,其商业价值是负数。

AI价值的真正土壤:人已被数据淹没的地方

那么,AI难道一无是处吗?绝非如此。它的巨大价值,恰恰存在于那些人类智能已无法有效处理的海量、高速、复杂的场景中。

笔者的观点是:

真正需要AI的地方,往往是人已经被数据淹没的地方,比如工业设备、能源系统、制造现场、运维系统。这些场景里,问题不是“人不会判断”,而是数据太多、节奏太快,人根本跟不上。

- 工业物联网:一台风机每秒产生上百个传感器读数,一年数据量数十GB,靠人眼盯曲线发现早期故障无异于大海捞针。

- 系统运维:一个分布式微服务集群每日产生GB级的日志,故障根源往往隐藏在其中的几个服务、上万条错误日志的关联之中。

- 金融交易:市场每秒变化,影响价格的因素成百上千,人脑无法同时处理所有信息并做出毫秒级决策。

在这里,AI的核心价值不是替代人类做“终极裁决”,而是作为永不疲倦的“一级过滤器”和“预警机”,完成持续地看、持续地比、提前把问题推出来的重复性、高负荷工作。

结论一: 产业不需要一个“更聪明、更能侃”的AI,它需要一个“更专注、更听话、更稳定”的AI执行单元。

二、解药“Skills”:将“智能”锁进业务的“牢笼”

如何让一个“野性”的概率机器,变成可靠的业务组件?这里有一个核心的工程概念:AI Agent Skills(技能)。

请忘记那些炫酷的演示。一个Skill,本质上是一个针对特定业务场景的、高度封装的、可复用的“AI功能微服务”。

Skills到底是什么?一个精妙的比喻

你可以这样理解:

- 大语言模型(LLM) 是拥有庞杂知识、想象力丰富毕业于名校的“天才实习生”。他什么都懂一点,但做事随性,格式随意,时不时会犯一些基于错误联想的“幻觉”错误。

- API或工具(Tool) 是公司里一个个专业的“职能部门”,比如财务部(计算器)、资料室(数据库查询)、后勤部(发送邮件)。它们能力单一,但极其可靠、格式规范。

- Skill 则是那个经验老道的“项目经理”或“业务专家”。他深知业务该怎么做(业务逻辑),他负责向“天才实习生”下达清晰、无歧义的指令(Prompt),并管理“实习生”与各个“职能部门”的协作(工具调用),最终交付一个符合业务标准的成果。

例如,在一个“工业设备预测性维护”的场景中:

1. 业务需求与逻辑(项目经理的蓝图): 工厂的业务需求是“当关键设备出现早期故障征兆时,自动生成可执行的维修工单”。老道的“项目经理”(Skill)深知这需要:a) 判断故障是否存在,b) 评估严重等级,c) 明确维修建议,d) 触发后续流程。他绝不会只让“天才实习生”自由发挥写一篇关于设备健康的散文。

2. 达清晰指令(对LLM的Prompt): 他会给“天才实习生”(LLM)一份严格的作业指引:

“你是一名设备健康诊断专家。请严格根据提供的振动频谱分析数据(特征频率、幅值),判断故障类型(仅限:轴承内圈磨损、轴承外圈磨损、齿轮断齿、不平衡四种之一)。同时,根据附上的历史维修记录,参考同类故障的平均修复时间,给出维修时长预估。你的输出必须是且仅是以下JSON格式:{“fault_type”: “…”, “severity_level”: 1-5, “estimated_repair_hours”: 数字, “advice”: “…”}。不要解释,不要添加其他字段。”

3. 管理协作(工具调用): 在“实习生”开始工作前和工作中,“项目经理”会协调各个“职能部门”(Tools)提供精准输入并执行后续动作:

第一步: 他让“数据查询部”(数据库查询Tool)调取该设备过去24小时的振动时序数据。

第二步: 他让“算法分析部”(信号处理算法Tool)对原始数据进行快速傅里叶变换(FFT),生成一张标准的频谱图。

第三步: 他将频谱图和预设的指令(Prompt)一并交给“天才实习生”(LLM)进行分析。

第四步: 收到实习生格式化的JSON结果后,他让“工单系统接口”(API调用Tool)自动创建一张维修工单,并将故障类型、预估时间填入。

第五步: 他让“通知服务部”(消息推送Tool)向相关工程师的移动端发送告警。

4. 交付业务成果: 最终,业务方得到的不是一个需要二次解读的技术报告,而是一张直接贴在设备上的、包含故障码、维修指导和预计耗时的标准化工单,以及一条已经发送到工程师手机上的待办提醒。整个过程,LLM的“智能”被严格约束在故障类型判断和文本生成这个环节,而整体的业务流程、数据获取、逻辑判断、行动触发,全部由“项目经理”(Skill)掌控。

Skill的核心使命,是把非结构化的、发散的“智能”,转化为结构化的、确定的“能力”。

解剖一个Skill:四层铠甲,束缚“野性”

一个设计良好的生产级Skill,就像给AI穿上了四层铠甲,确保它只能在预设的轨道上运行。以下为具体的拆解分析:

第一层:元数据层(身份证)—— “我是谁,我能吃什么”

- 名称:check_contract_compliance (检查合同合规性)

- 描述:“根据《民法典》及公司标准模板,审查借款合同中的关键条款,识别合规风险点。” (这句描述是给LLM看的,用于意图匹配)

- 输入参数:contract_text: string (必须), contract_type: string (可选,默认‘loan’)。(强类型约束,杜绝AI瞎猜)

这一层解决了“乱认活”的问题。通过清晰的描述,AI系统能准确判断一个用户请求(如“帮我看看这份合同有没有坑”)应该由哪个Skill来处理,而不是让LLM自由发挥。

第二层:逻辑层(大脑与规则)—— “我该怎么想,按什么规矩办”这里是业务逻辑的所在地,通常有两种模式:

- 规则引擎模式:对于完全确定性的任务,这里就是纯粹的代码逻辑。

|

if 设备温度 > 85 且 持续时间 > 3600: return {"警报级别": "高危", "建议": "立即停机检修"} |

- Agentic模式:对于需要一定推理的任务,这里包含一个高度定制化的系统提示词(System Prompt),将LLM“催眠”成特定领域的专家。

“你是一位专注金融合同审查的AI助手,你的知识严格限定于《民法典》第三编、相关金融监管条例以及我司提供的标准合同模板。你的任务仅是对比输入合同与标准的差异,并指出具体条款号、修改建议及法律依据。对于合同无关的问题,你应明确拒绝回答。”

这一层解决了“乱思考”的问题。用提示词和业务规则,为AI的思考划出明确的边界,屏蔽无关的知识联想。

第三层:工具层(手和脚)—— “我要调用谁来完成”Skill本身不创造数据,它通过调用工具来与现实世界交互。

- 获取数据:query_database("SELECT * FROM sensor WHERE device_id=?”), call_internal_api(“/v1/contract/template”)

- 执行操作:send_alert_to_dingtalk(alert_info), create_jira_ticket(repair_task)

- 专业计算:calculate_fft(vibration_signal) (快速傅里叶变换,用于振动分析)

这一层解决了“光说不练”的问题。让AI的能力从生成文本,延伸到真实的数据查询和系统操作。

第四层:验证层(刹车与审计)—— “我输出的东西安不安全”这是生产环境的生命线,尤其在金融、医疗、工业领域。

- 输入验证:用户传入的温度值是-10℃?立即拒绝,参数非法。

- 权限校验:当前操作员是否有权限执行“紧急停机”这个Skill?

- 输出过滤与格式化:对LLM生成的文本进行关键词过滤,并强制转换为标准的JSON输出格式,确保下游系统能解析。

这一层解决了“捅娄子”的问题。是确保AI行为安全、可控的最后一道,也是必不可少的防线。

结论二: Skills是一套精密的工程框架,它通过描述界定范围、逻辑约束思考、工具赋予行动、验证保障安全,将“野性”的AI驯化成可靠的生产力组件。

三、实战推演:看Skills如何在不同战场“老实干活”

理论或许抽象,以下内容为笔者实践或同行交流时提供的案例(其实,每个案例都可以单独写一篇文章,限于本文篇幅,只写出关键部份,有兴趣的看官也可自行上网查或咨询AI),看看Skills如何在真实战场排兵布阵。

战场一:工业运维——预测性维护

业务痛点:工厂王师傅靠“听声音、摸温度”来保养设备,经验难传承,故障难预测,非计划停机一次损失数万。

Skills解决方案:

- Skill名称:predictive_maintenance_alert (预测性维护警报)

- 触发条件:实时监听来自物联网平台(如TDengine)的设备振动、温度数据流。

- 核心逻辑(规则+推理):

- 规则部分:连续5个采样点,振动幅值超过基线阈值20%,触发初级预警。

- LLM推理部分:将振动数据的频谱图(经FFT转换后)交给LLM,并提示:“你是旋转机械故障诊断专家。请分析此频谱,判断是轴承内圈磨损、外圈磨损还是齿轮啮合故障,并估算严重等级(1-10级)。仅输出故障类型和等级数字。”

- 工具调用:

- 调用CM(维护管理)系统API,自动生成工单,附带故障推测。

- 调用通知服务,向王师傅的APP推送消息:“3号离心泵,预测为轴承内圈磨损(等级7),建议48小时内安排检修。”

- 价值:将老师傅的“隐性经验”固化到Skill中,实现7x24小时无人值守监测,从“事后维修”变为“预测性维护”,降低非计划停机时间。

给研发/产品的启发:工业场景的Skill,输入是高确定性、实时的时序数据,逻辑层强烈依赖领域知识与物理规则,输出是可行动的结构化工单。确定性最高,AI的“野性”被约束得最死。

战场二:金融科技——智能合规审查

业务痛点:银行法务小李每天审查上百份格式各异的合同,眼酸手麻,还怕漏掉隐藏的“坑”。

Skills解决方案:

- Skill名称:loan_contract_review (贷款合同审查)

- 触发条件:上传或拖入一份合同PDF/Word文件。

- 核心逻辑(RAG增强推理):

- RAG检索:首先,将合同文本分段,与向量数据库中的“法规库”(《民法典》、《贷款通则》等)和“标准模板库”进行相似性检索,找出相关条款。

- LLM推理:将合同原文+检索到的相关法规/模板,一起喂给LLM,并提示:“请对比待审合同与标准模板及法规的差异,仅输出一个JSON数组,每个元素包含:{‘条款号’: ‘x.x’, ‘风险类型’: ‘合规/商业’, ‘风险描述’: ‘…’, ‘修改建议’: ‘…’}”

- 工具调用:无(或调用电子签章系统,在低风险时自动标记“已审核”)。

- 验证层:输出必须为严格JSON格式,否则重试;对“风险描述”字段进行关键词过滤(如屏蔽不当言论)。

- 价值:将小李从重复性劳动中解放,专注于高风险的复杂条款审查,效率提升数倍,且审查标准统一,杜绝人为疏漏。

给研发/产品的启发:金融合规场景高度依赖外部知识(RAG)。Skill的核心是构建高质量的法规知识向量库。输入是非结构化的文档,但通过RAG将其转化为有上下文的、相对结构化的提示,从而约束LLM的输出格式和范围。

战场三:医疗辅助——影像报告结构化

业务痛点:放射科医生阅读大量CT影像,口头描述诊断结果,再由录入员转为文字报告,流程长、易出错、术语不规范。

Skills解决方案:

- Skill名称:lung_nodule_assessment (肺结节评估)

- 触发条件:PACS系统传来一组肺部CT序列图像。

- 核心逻辑(多模态模型协作):

- 视觉模型调用:首先调用一个专业的肺部CT分割与检测模型(如U-Net),识别出所有结节,并计算出其位置、直径、体积等量化指标。

- LLM推理:将量化指标(如“右肺上叶,直径6mm,磨玻璃密度”)输入LLM,并提示:“你是一位放射科医生,请根据Lung-RADS(肺癌筛查报告和数据系统)指南,对上述结节进行分级(1-5级),并生成一段符合临床规范的结构化诊断意见。必须包含:位置、大小、特征、Lung-RADS分级、随访建议。”

- 工具调用:调用医院HIS系统接口,将结构化报告写入患者病历。

- 价值:生成标准化、结构化的报告,减少医生重复性劳动和描述差异,关键量化信息(如结节体积变化)可被系统追踪,助力精准医疗。

给研发/产品的启发:医疗场景是多模态Skill的典型。CV模型负责“看”,产出结构化数据;LLM负责“写”,将数据转化为专业报告。Skill的编排逻辑是关键。“可解释性”和“置信度” 必须作为输出的一部分,供医生决策参考。

结论三:尽管场景各异,但成功的Skill都遵循同一模式:清晰的输入边界、固化的业务逻辑/知识上下文、以及高度结构化的输出。它不追求AI的“全能”,而追求在特定任务上的“专精”与“可靠”。

四、行动指南:产品与研发如何并肩打造“可靠AI”

给产品经理的思维重塑清单

- 从“功能思维”转向“能力封装思维”:

- 不要规划“做一个AI客服”,而是规划“封装订单状态查询、退货政策解答、投诉工单生成这三个Skills”。

- 每个Skill的输入、输出、处理逻辑,都应是明确、可被技术实现的“微需求”。

- 定义“确定性”的边界:

- 在PRD中,必须明确:这个功能的输入是什么?(是用户自然语言,还是表格数据?)可接受的输出格式是什么?(必须是JSON,还是特定文本模板?)不可接受的“野”行为有哪些?(例如,绝不能对外部问题做出回答)。

- 主动与研发讨论,哪些部分适合用规则引擎(确定性高),哪些部分必须引入LLM(需一定推理)。

- 设计“人机协同”的流程:

- AI Skill不是终点。设计当Skill输出低置信度结果时,如何无缝转交人工处理。

- 设计如何收集人工对AI结果的修正反馈,并用于优化Skill(构建数据飞轮)。

- 寻找高价值种子场景:

- 优先选择那些数据可得、规则相对明确、价值密度高、容错成本相对较低的场景启动第一个Skill。比如“内部IT工单自动分类与路由”比“对外智能客服”更适合起步。

给研发工程师的架构与实现清单

- 拥抱“Skill as a Microservice”架构:

- 将每个Skill视为独立的微服务,拥有清晰的API接口(描述、输入、输出)。

- 使用像Model Context Protocol (MCP) 这样的新兴协议,来标准化Skill与LLM、Skill与工具之间的通信,降低集成复杂度。

- 构建四层实现的工程习惯:

- 实现元数据层:为每个Skill创建skill.yaml,明确定义其名称、描述和输入模式。这是Skill的“使用说明书”。

- 强化逻辑层:精心编写System Prompt,使用少样本示例(Few-shot) 引导输出格式。将业务规则代码化。

- 管理工具层:建立内部工具注册中心,让Skill能方便、安全地调用。

- 夯实验证层:输入验证、权限校验、输出格式化与过滤,这三者代码必须在Skill开发初期就编写,并作为核心部分进行测试。

- 掌握核心技术栈:

- RAG:熟练掌握文档分块(Chunking)、向量化(Embedding)、向量数据库(如Chroma, Weaviate)检索的全流程。这是为Skill注入私有知识的关键。

- 智能体(Agent)基础:理解规划(Planning)、工具调用(Tool Use)、反思(Reflection) 等核心概念,它们是你设计复杂Skill流程的思维工具。

- 可观测性(Observability):为每个Skill接入完整的日志、指标和追踪。不仅要记录输入输出,还要记录中间步骤、工具调用耗时、Token消耗。这是排查“AI黑箱”问题的唯一途径。

- 一个简单的代码框架示意:

|

class BusinessSkill: def __init__(self, name, description): self.name = name self.description = description self.tools = [] # 可调用的工具列表 self.safety_checker = SafetyChecker() # 验证器实例 def validate_input(self, user_input): """验证层:检查输入是否合法""" if not self.safety_checker.check_format(user_input): raise InvalidInputError("输入格式错误") return True def core_logic(self, validated_input): """逻辑层:业务处理核心""" # 1. 可能的RAG检索 context = self.retrieve_relevant_knowledge(validated_input) # 2. 构造严谨的Prompt prompt = self.build_system_prompt(context, validated_input) # 3. 调用LLM(约束在本次交互中) llm_response = call_llm(prompt, temperature=0.1) # 低temperature保证输出稳定 return llm_response def execute(self, user_input): """Skill执行总入口""" try: # 1. 验证 self.validate_input(user_input) # 2. 核心逻辑处理 raw_result = self.core_logic(user_input) # 3. 输出过滤与格式化 safe_result = self.safety_checker.filter_and_format(raw_result) # 4. (可选)调用工具产生副作用 if self.needs_action(safe_result): self.call_tools(safe_result) return safe_result except Exception as e: log_error(e) return {"status": "error", "message": "技能执行失败"} |

五、从今天开始:你的“驯化AI”路线图

- 第一步:共识与选型(第1周)

- 拉上你的产品经理/研发伙伴,一起阅读并理解“AI是概率机器”和“Skills是解药”这两个核心观点。

- 在你的业务中,挑选一个最小、最明确、可闭环的场景作为POC。例如:“从100条用户反馈中,自动分类出属于‘Bug反馈’的条目”。

- 第二步:构建第一个Skill(第2-4周)

- 产品定义清楚:输入(一段文本)、输出(标签:“Bug”、“需求”、“咨询”)、规则(什么是Bug?给出5个明确例子)。

- 研发实现四层:用简单的关键词规则(逻辑层)先实现;再尝试加入小模型微调或Few-shot Prompting;务必加上输入验证和输出格式化。

- 测试:不仅测准确率,更要测“出圈”情况——给它完全不相关的输入,看它是否会胡说八道。

- 第三步:迭代与扩展(第1-3个月)

- 基于第一个Skill的反馈,优化逻辑和Prompt。

- 尝试增加一个相关联的Skill,比如“提取Bug反馈中的关键实体”(如产品模块、错误代码)。

- 建立Skills之间的简单编排,比如先分类、再提取实体。

- 第四步:平台化思考(第3个月及以后)

- 思考如何管理越来越多的Skills?是否需要一个Skill注册中心?

- 如何监控所有Skills的健康度、性能和成本?

- 如何让非研发人员(如业务专家)也能参与配置或定义简单的规则型Skill?

结语:可靠,是AI最大的善意

我们正在经历一个从“AI是什么”到“AI怎么用”的关键转折点。对于投身于产业浪潮中的产品经理和研发工程师而言,最大的成就感将不再来自调试出最炫酷的模型,而来自看到自己设计的AI Skill,像一颗坚固可靠的齿轮,悄无声息地嵌入庞大的业务系统中,稳定运行,创造价值。

驯服AI的“野性”,不是限制它的潜力,而是为它指明发挥价值的唯一正道。当AI变得可靠,它便从橱窗里的“表演者”,变成了生产线上的“实干家”。

这场驯服之旅,始于你我今天对Skills这一工程思维的深刻认同与实践。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)