《从同步到消息驱动:现代后端交互模式的深度解析与工程实践》

《从同步到消息驱动:现代后端交互模式的深度解析与工程实践》

——以百万行报表导出为例,谈用户体验、可观测性、失败处理与成本权衡

在过去十多年里,我见证了 Python 从“小巧优雅的脚本语言”成长为支撑全球互联网、数据科学、AI 产业的核心力量。无论是 Web 服务、自动化任务、数据处理,还是如今的 LLM 应用,Python 都以其灵活、可读、生态丰富的特性成为开发者的首选。

而在所有后端系统中,一个绕不开的问题是:

“系统应该如何与用户交互?”

是同步返回?异步任务?还是彻底消息驱动?

这篇文章,我将结合多年工程经验,从用户体验、可观测性、失败处理、成本等维度,系统性比较三种交互方式,并以“导出百万行报表”为例给出可直接落地的最佳实践。

一、三种交互方式的本质区别

1. 同步 API(Synchronous API)

用户发起请求 → 服务处理 → 服务返回结果。

整个过程在一个 HTTP 请求生命周期内完成。

典型代码(Flask):

@app.route("/sum")

def compute():

n = int(request.args.get("n", 1000000))

return {"result": sum(range(n))}

优点:

- 用户体验直接、简单

- 调试方便,可观测性强(链路短)

- 适合轻量级、快速返回的操作

缺点:

- 阻塞线程,吞吐量有限

- 超时风险高(尤其是云环境 30s 限制)

- 不适合长耗时任务(如大文件导出、复杂计算)

2. 异步任务(Async Task / Background Job)

用户发起请求 → 服务立即返回任务 ID → 后台任务系统(Celery、RQ、Dramatiq)异步执行 → 用户轮询或回调获取结果。

典型代码(Celery):

@app.route("/export")

def export():

task = generate_report.delay()

return {"task_id": task.id}

@celery.task

def generate_report():

# 生成报表逻辑

...

优点:

- 不阻塞主线程,吞吐量高

- 适合中长耗时任务(秒级到分钟级)

- 可结合 Redis / RabbitMQ 实现可靠执行

缺点:

- 用户体验需要额外设计(轮询、回调)

- 任务状态管理复杂

- 需要额外的任务队列基础设施

3. 消息驱动(Event-driven / Message-driven)

系统不再以“请求-响应”为中心,而是以“事件”为中心。

例如:

“用户点击导出按钮” → 发布事件 → 多个消费者订阅并处理 → 最终生成结果。

典型代码(Kafka / RabbitMQ):

def on_export_event(event):

report = generate_report(event.user_id)

message_bus.publish("report.generated", report)

优点:

- 高扩展性、高解耦

- 天然支持分布式与高吞吐

- 适合复杂业务流程(多步骤、多服务协作)

缺点:

- 系统复杂度高

- 可观测性、调试难度大

- 需要成熟的事件建模与治理能力

二、从用户体验、可观测性、失败处理、成本四维度深度比较

为了让你快速抓住重点,我将三种方式放在同一张对照表中:

| 维度 | 同步 API | 异步任务 | 消息驱动 |

|---|---|---|---|

| 用户体验 | 最直接,但易超时 | 需要轮询或回调 | 用户无感知,但流程复杂 |

| 可观测性 | 最强(链路短) | 中等(任务链路) | 最弱(事件链路长) |

| 失败处理 | 简单(直接返回错误) | 需要重试、死信队列 | 需要事件溯源、补偿机制 |

| 成本 | 最低 | 中等(需要任务队列) | 最高(需要消息系统) |

| 适用场景 | 快速返回的轻量操作 | 中长耗时任务 | 大规模分布式业务流程 |

三、如何权衡?给你一个工程师视角的决策模型

1. 如果任务耗时 < 1 秒 → 用同步 API

例如:

- 查询用户信息

- 小型计算

- 简单 CRUD

同步是最自然的方式,用户体验最佳。

2. 如果任务耗时在 1 秒~30 秒 → 优先异步任务

例如:

- 导出 10 万行以内报表

- 调用第三方 API 但延迟不稳定

- 需要后台处理的计算任务

异步任务能显著提升吞吐量,并避免超时。

3. 如果任务耗时 > 30 秒 或涉及多步骤 → 消息驱动

例如:

- 导出百万行报表

- 多服务协作的业务流程(如订单 → 支付 → 发货)

- 大规模数据处理(ETL、日志分析)

消息驱动能让系统更稳定、更可扩展。

四、实践案例:导出百万行报表应该怎么做?

这是一个非常典型的场景:

同步 API 必死无疑,异步任务也可能吃不消,消息驱动才是最佳方案。

下面我给出一个可直接落地的工程方案。

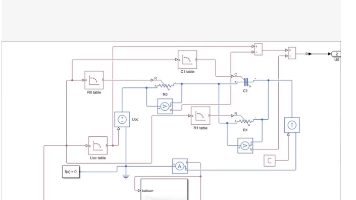

方案总览:三段式架构

为了让你更直观理解,我用一个教学式的流程图来呈现整个导出过程。

五、关键工程细节与最佳实践

1. 数据分批处理(Chunking)

一次性查询百万行会导致:

- 内存爆炸

- 数据库压力巨大

推荐方式:

def fetch_in_chunks(query, chunk_size=5000):

offset = 0

while True:

rows = query.limit(chunk_size).offset(offset).all()

if not rows:

break

yield rows

offset += chunk_size

2. 流式写文件(Streaming Write)

避免一次性将所有数据放入内存。

CSV 示例:

with open("report.csv", "w", newline="") as f:

writer = csv.writer(f)

for rows in fetch_in_chunks(query):

for row in rows:

writer.writerow(row.to_list())

3. 使用对象存储而不是本地磁盘

原因:

- 本地磁盘容量有限

- 多实例部署时无法共享文件

- 对象存储支持 CDN 加速、权限控制、生命周期管理

4. 使用事件驱动保证流程可扩展

例如 Kafka Topic 设计:

export.requestedexport.processingexport.readyexport.failed

每个事件都可以被多个服务订阅,实现天然扩展。

5. 可观测性:必须具备以下能力

- 每个事件必须有 trace_id

- 每个任务必须有状态(pending / running / success / failed)

- 每个失败必须有重试次数与错误原因

- 必须有死信队列(DLQ)

6. 成本控制建议

- 小团队:异步任务(Celery + Redis)即可

- 中型团队:异步任务 + Kafka(或 RabbitMQ)

- 大型团队:全链路事件驱动 + 数据湖 + 流处理

六、总结:如何选择正确的交互方式?

如果你只记住一句话,我希望是这句:

同步解决“快”,异步解决“稳”,消息驱动解决“复杂”。

- 同步 API:适合轻量、快速返回的操作

- 异步任务:适合中长耗时、可分离的后台任务

- 消息驱动:适合复杂流程、海量数据、高扩展性场景

而在“导出百万行报表”这种典型场景中,

消息驱动 + 流式处理 + 对象存储 是最优解。

七、互动时间

我很想听听你的经验:

- 你在实际项目中遇到过哪些“长耗时任务”?

- 你是如何在用户体验、性能、成本之间做权衡的?

- 你是否正在设计一个需要异步或消息驱动的系统?

欢迎在评论区分享你的故事,我们一起交流、一起成长。

如果你愿意,我也可以继续帮你写:

✔ 架构图

✔ 代码模板

✔ Kafka Topic 设计

✔ Celery 任务结构

✔ 完整的导出服务 Demo

只要告诉我你的技术栈即可。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)