eino进阶

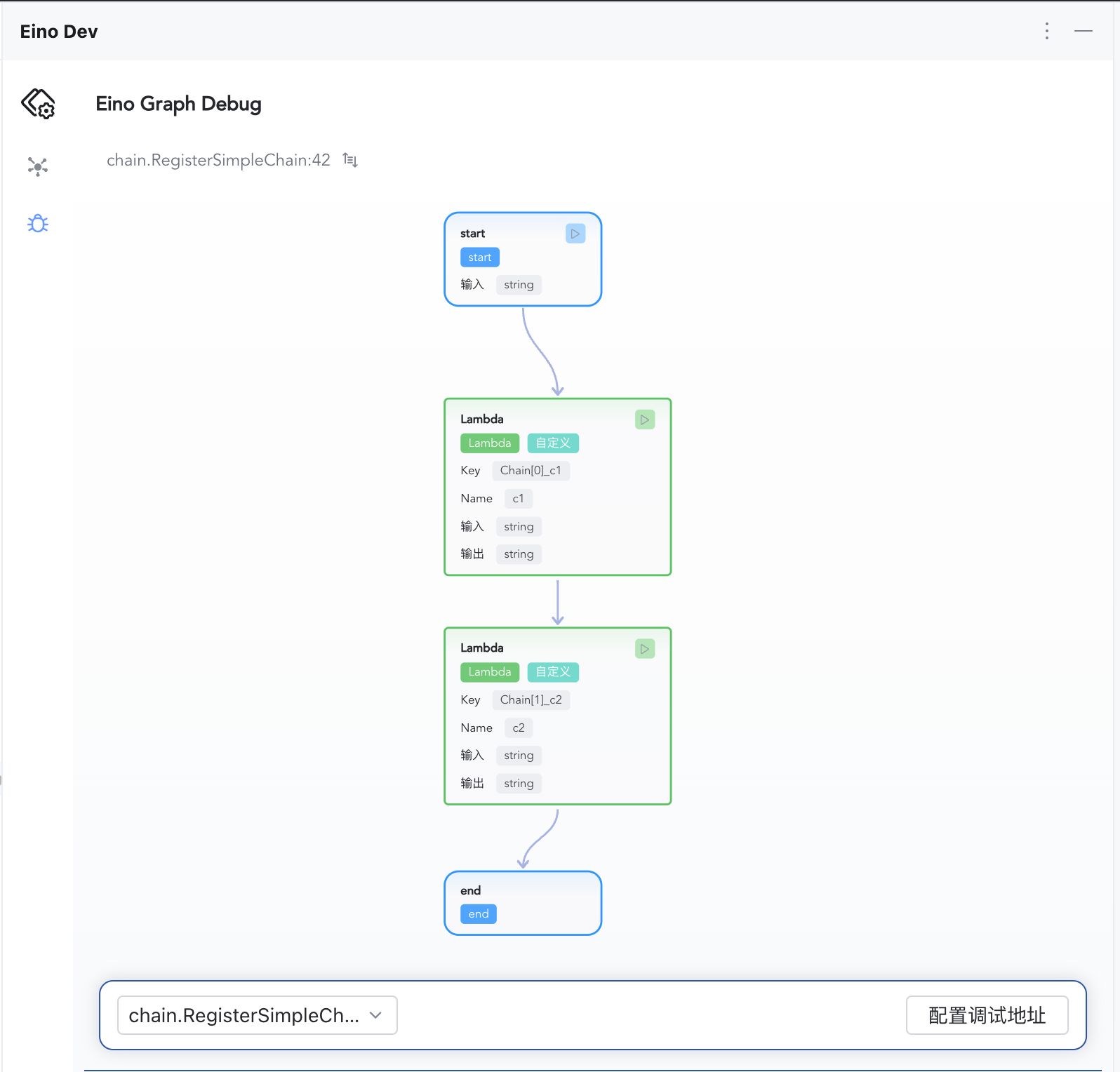

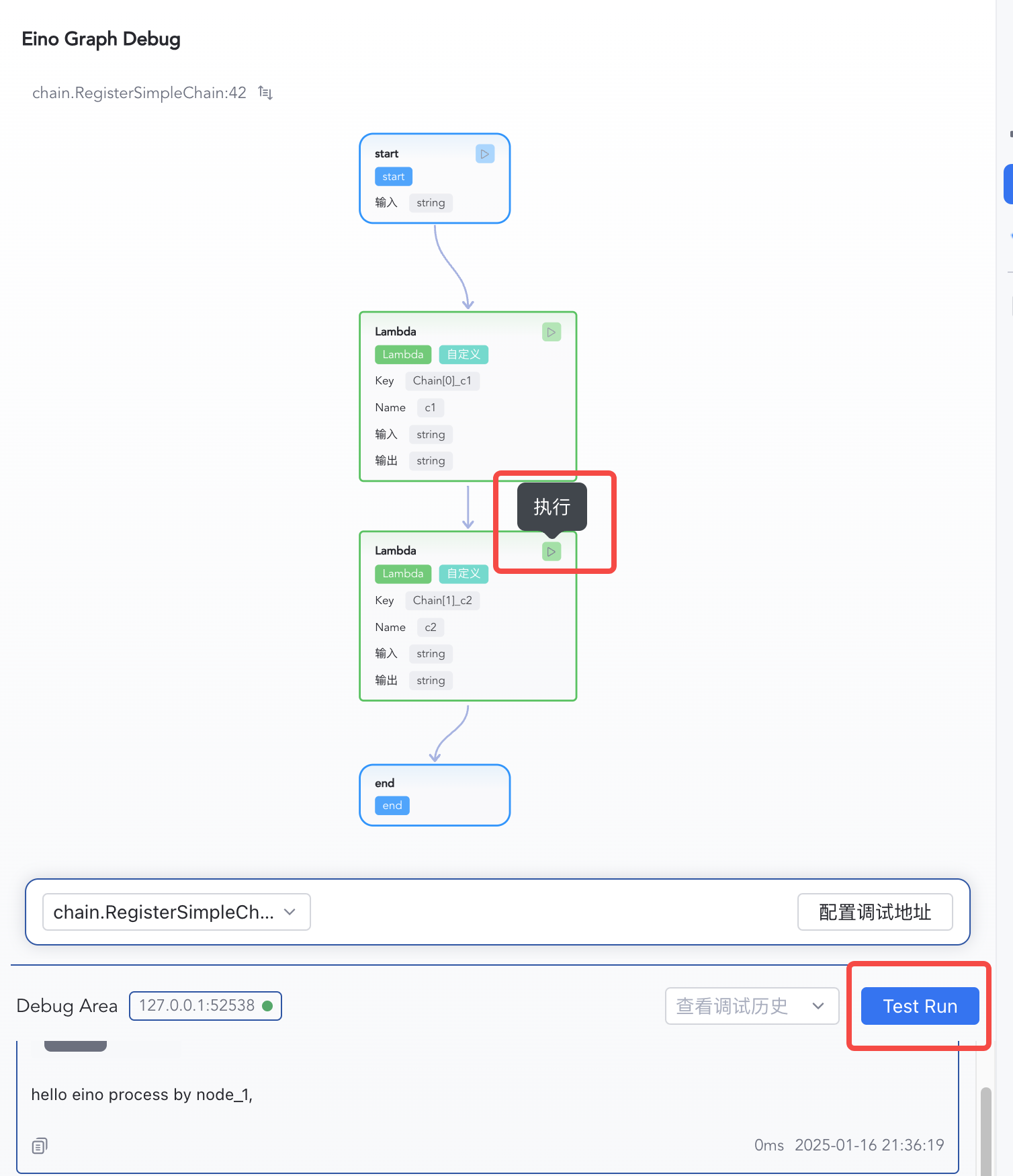

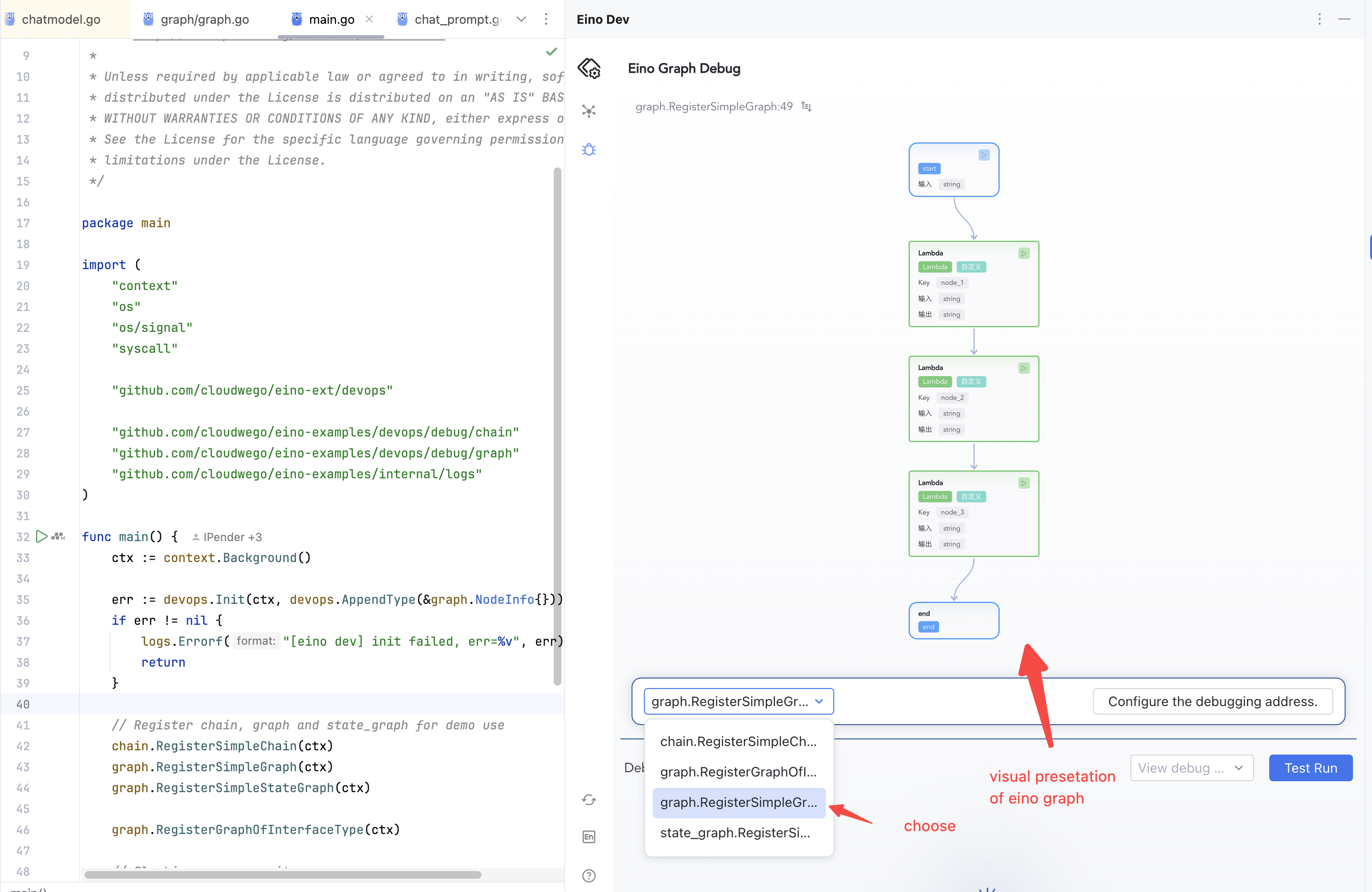

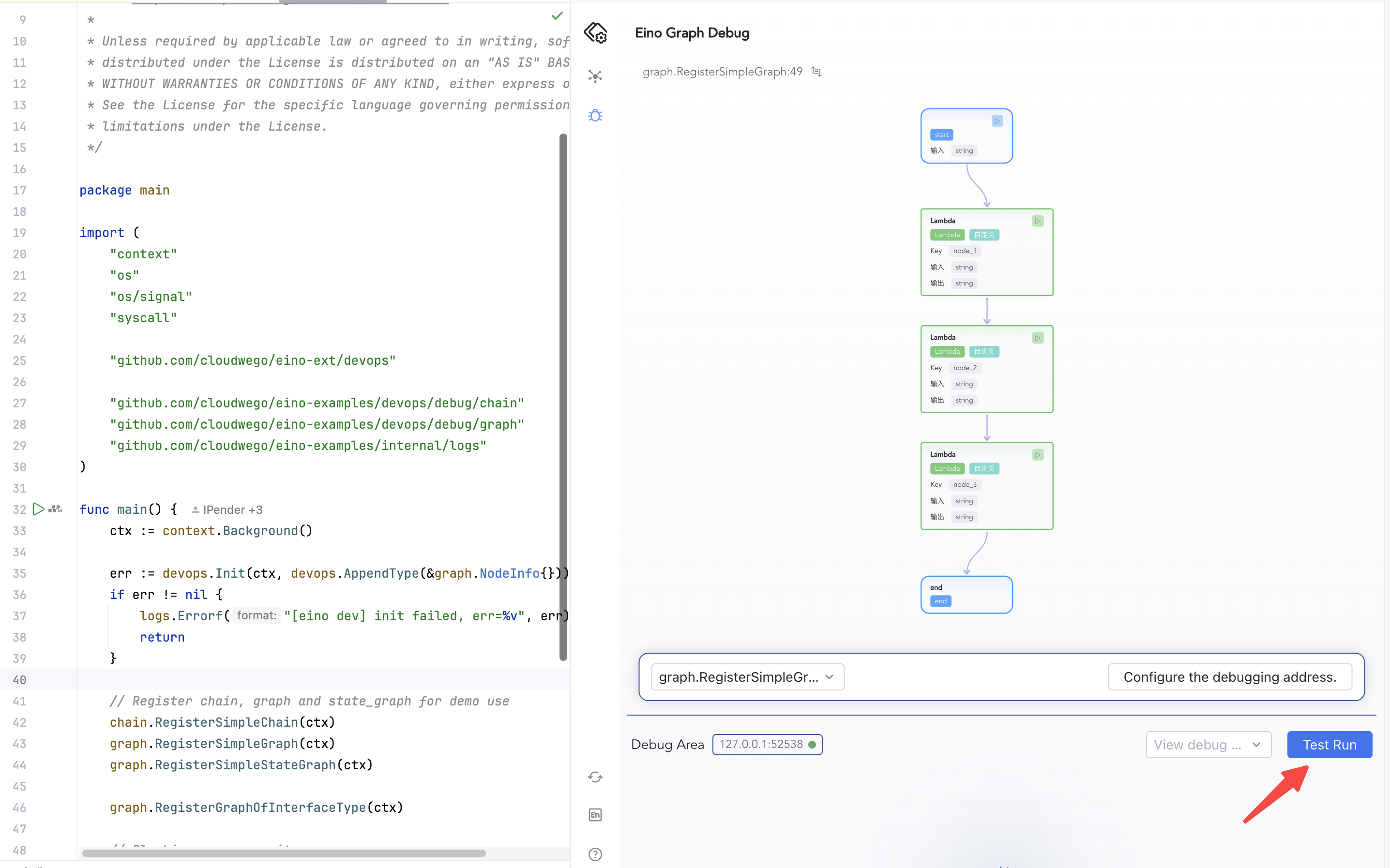

3.2 chain graph

在大模型应用中,Components 组件是提供 『原子能力』的最小单元,比如:

ChatModel提供了大模型的对话能力Embedding提供了基于语义的文本向量化能力Retriever提供了关联内容召回的能力ToolsNode提供了执行外部工具的能力

一个大模型应用,除了需要这些原子能力之外,还需要根据场景化的业务逻辑,对这些原子能力进行组合、串联,这就是 『编排』。

大模型应用的开发有其自身典型的特征: 自定义的业务逻辑本身不会很复杂,几乎主要都是对『原子能力』的组合串联。

传统代码开发过程中,业务逻辑用 “代码的执行逻辑” 来表达,迁移到大模型应用开发中时,最直接想到的方法就是 “自行调用组件,自行把结果作为下一组件的输入进行调用”。这样的结果,就是 代码杂乱、很难复用、没有切面能力……

于是,Eino 提供了 “基于 Graph 模型 (node + edge) 的,以组件为原子节点的,以上下游类型对齐为基础的编排” 的解决方案。

- 编排要成为在业务逻辑之上的清晰的一层,不能让业务逻辑融入到编排中。业务逻辑复杂度封装到组件内部,编排层拥有更全局的视角,让逻辑层次变得非常清晰。编排代码里,绝对不出现业务规则、业务判断、业务处理代码。

- 一切以 “组件” 为核心,规范了业务功能的封装方式,让职责划分变得清晰,让复用变成自然而然

- 抽象视角看编排:编排是在构建一张网络,数据则在这个网络中流动,网络的每个节点都对流动的数据有格式/内容的要求,一个能顺畅流动的数据网络,关键就是 “上下游节点间的数据格式是否对齐?”。提供了 “类型对齐” 的开发方式的强化,降低开发者心智负担,把 golang 的类型安全特性发挥出来

- 提供了切面能力,callback 机制支持了基于节点的统一治理能力

- 提供了 call option 的机制,扩展性是快速迭代中的系统最基本的诉求

- 提供了 “流的自动转换” 能力,让 “流” 在「编排系统的复杂性来源榜」中除名

设计理念

Graph 本身是强大且语义完备的,可以用这项底层几乎绘制出所有的 “数据流动网络”,比如 “分支”、“并行”、“循环”。

但 Graph 并不是没有缺点的,基于 “点” “边” 模型的 Graph 在使用时,要求开发者要使用

graph.AddXXXNode()和graph.AddEdge()两个接口来创建一个数据通道,强大但是略显复杂。而在现实的大多数业务场景中,往往仅需要 “按顺序串联” 即可,因此,Eino 封装了接口更易于使用的

Chain。Chain 是对 Graph 的封装,除了 “环” 之外,Chain 暴露了几乎所有 Graph 的能力。

编排对比

Chain = 一条流水线(线性)

Graph = 一张流程图(可分支 / 可循环 / 可并行)👉 Chain = 固定流程(你写死)

👉 Agent = 动态决策(模型决定怎么走)

Chain 很快会不够用,比如: 做不了这种 动态决策

如果用户问代码 → 调 code tool

如果问文档 → 调 rag

如果问天气 → 调 API

Graph(图编排)

节点 + 边(有向图)

┌── Tool A ──┐

User → LLM → LLM → 输出

└── Tool B ──┘

甚至可以:

┌─条件1─→ 节点A ─┐

输入 → 判断 → 输出

└─条件2─→ 节点B ─┘

-

支持动态路径

-

支持循环(Agent本质)

-

支持多工具调度

-

可扩展复杂逻辑

以上下游 类型对齐 为基本准则

大模型应用编排框架的主流语言是 python,这门语言以其灵活性著称,灵活性给 sdk 的开发带来便利,但同时也给 sdk 的使用者带来了心智负担。

基于 golang 的 eino 则是 静态类型 ,在 Compile 时做类型检查,避免了 python 等动态语言的运行时类型问题。

eino 的最基础编排方式为 graph,以及简化的封装 chain。不论是哪种编排方式,其本质都是

逻辑节点+上下游关系。在编排的产物运行时,都是从一个逻辑节点运行,然后下一步运行和这个节点相连的下一个节点。

这之间蕴含了一个基本假设:前一个运行节点的输出值,可以作为下一个节点的输入值。

在 golang 中,要实现这个假设,有两个基本方案:

-

把不同节点的输入输出都变成一种更泛化的类型,例如

any、map[string]any等。-

采用泛化成 any 的方案,但对应的代价是: 开发者在写代码时,需要显式转换成具体类型才能使用。这会极大增加开发者的心智负担,因此最终放弃此方案。

-

langchain 的方案可以看做是全程传递

map[string]any,各个逻辑节点根据自己的需要,用对应的 key 去取对应的 value。在 langchaingo 的实现中,即是按照这种方式实现,但同样,golang 中的 any 要被使用依然要使用类型断言才可使用。这种方案在开发者使用时依然有很大的心智负担。

-

-

每一个节点的输入输出类型保持开发者的预期,在 Compile 阶段保证上下游的类型是一致的。

方案 2 即是 eino 最终选定的方案。这种方案是编排时最容易被理解的,整个过程就像是 搭积木 一样,每一个积木突出的部分和凹陷的部分有各自的规格,仅有规格匹配了才能成为上下游关系。

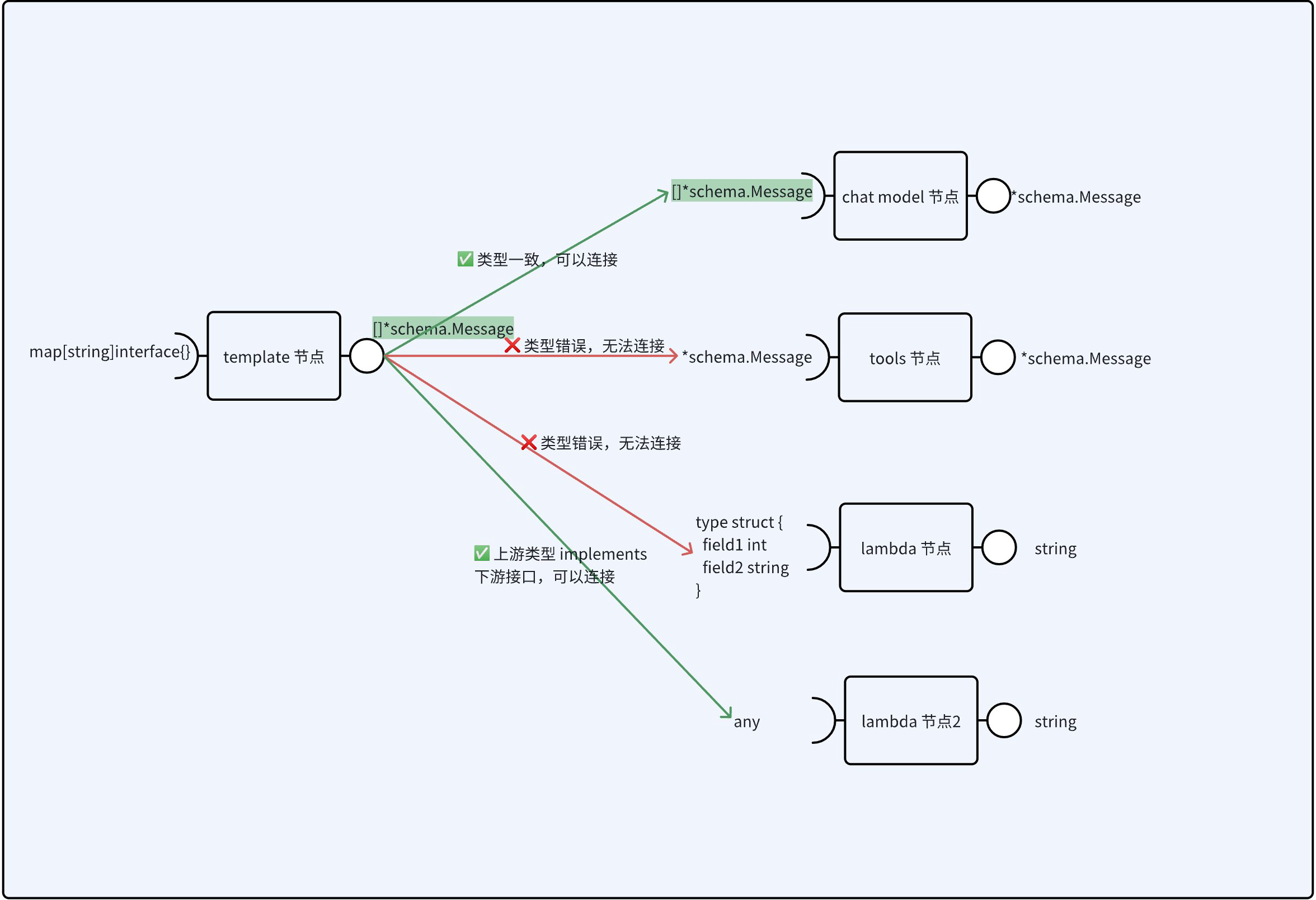

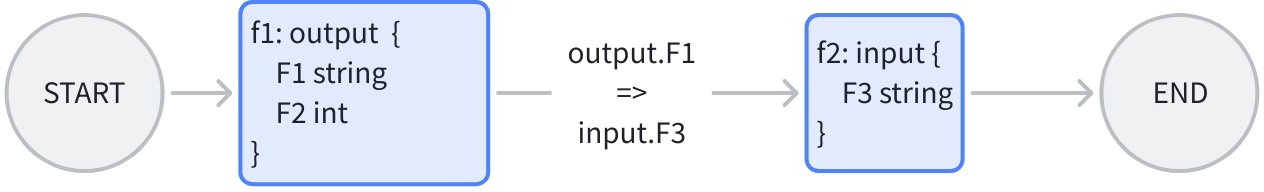

就如下图:

对于一个编排而言,只有下游能识别和处理上游的输出,这个编排才能正常运行。 这个基本假设在 eino 中被清晰地表达了出来,让开发者在用 eino 做编排时,能够有十足的信心清楚编排的逻辑是如何运行和流转的,而不是从一系列的 any 中去猜测传过来的值是否正确。

graph 中的类型对齐

edge

在 graph 中,一个节点的输出将顺着 边(edge) 流向下一节点,因此,用边连接的节点间必须要类型对齐。

普通边(绿色)= 直接赋值 = 类型必须对齐带转换的边(黄色)= 先转再赋 = 可以不对齐

Graph 里的节点连接:不一定需要天然类型对齐(因为 Graph 支持自动转换、InputKey/OutputKey、黄色边转换)

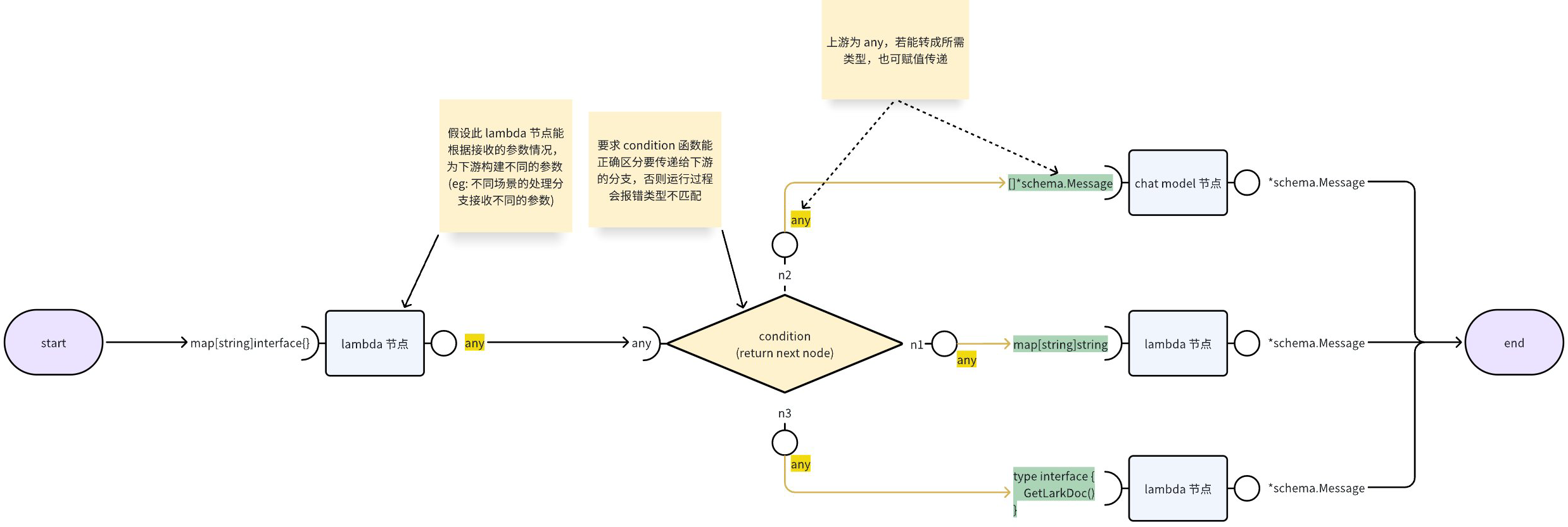

如下图:

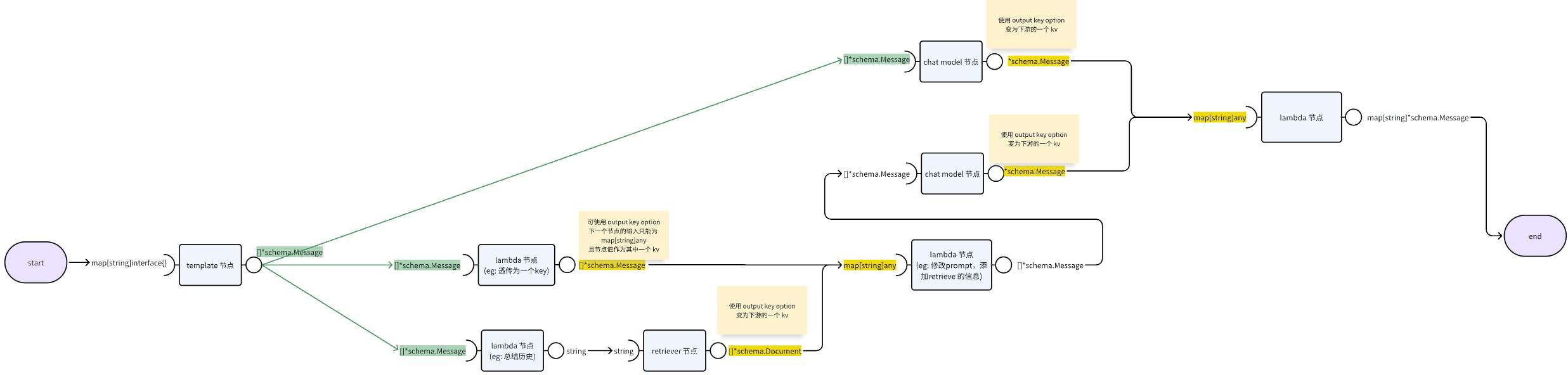

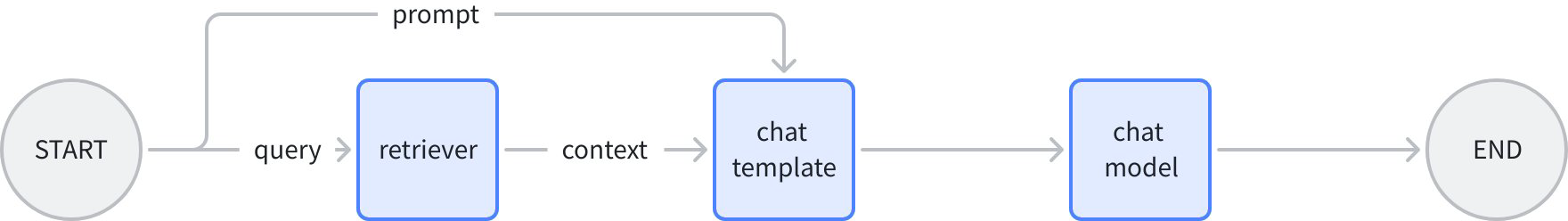

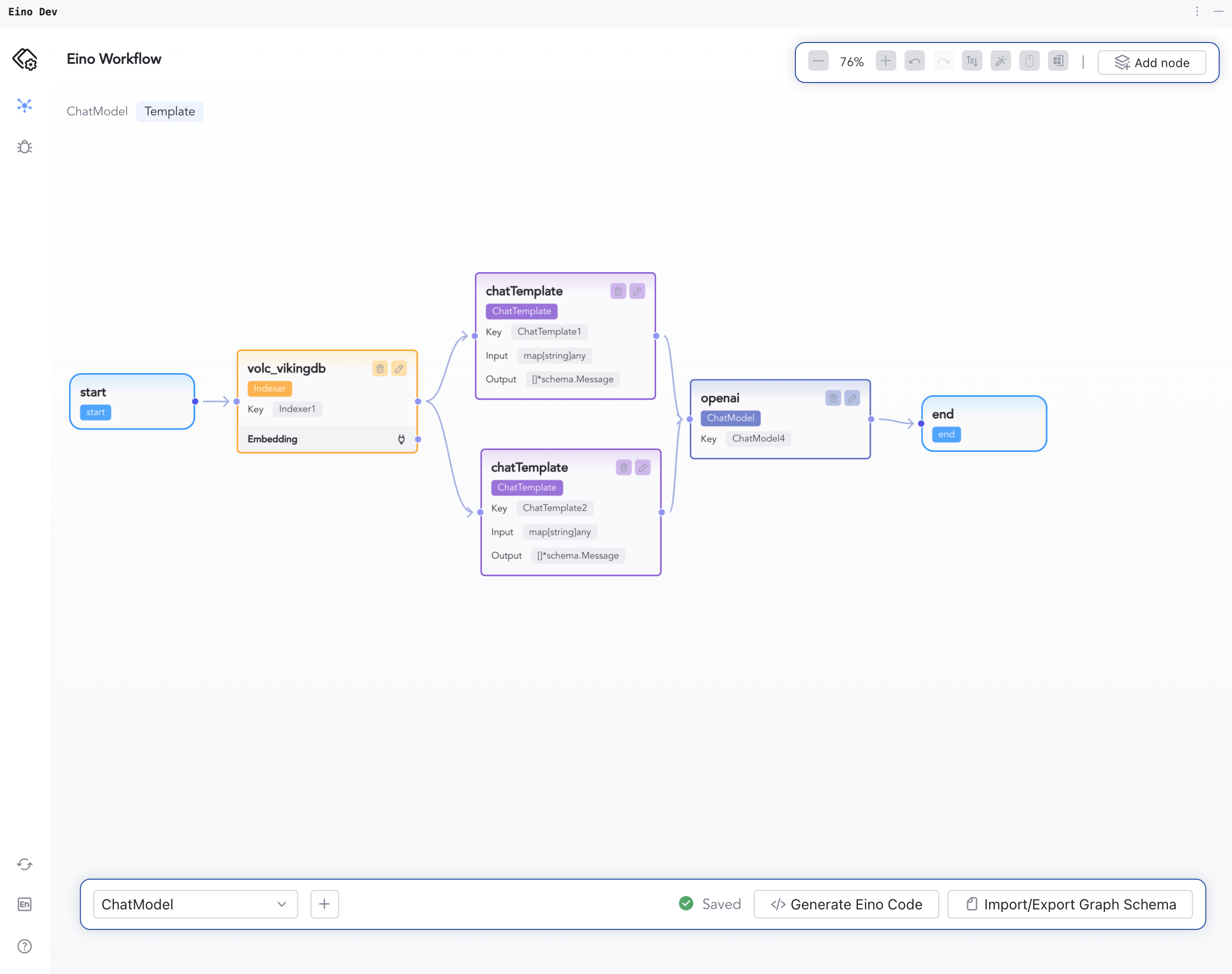

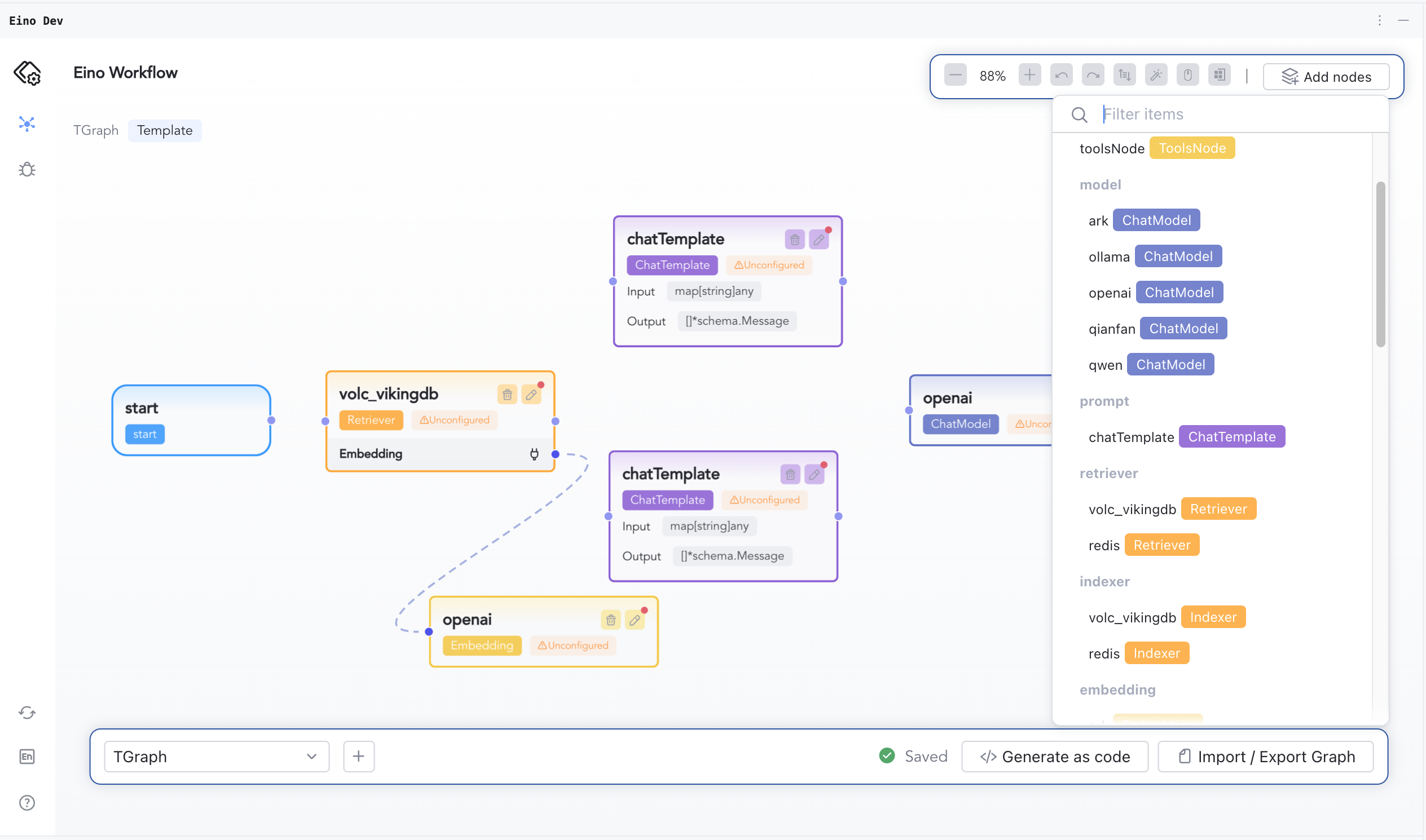

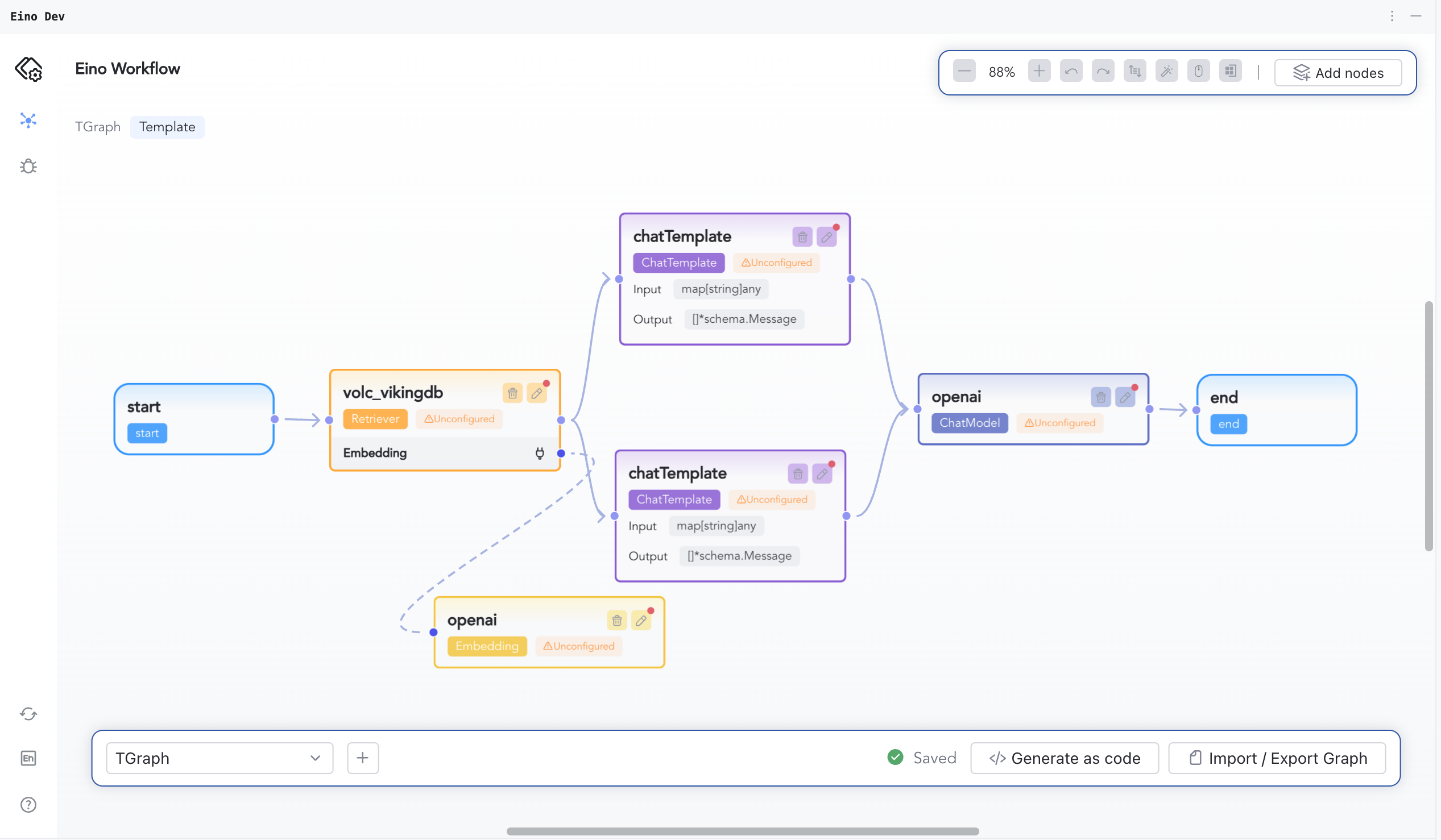

这是一个模拟 ① 直接和大模型对话 ② 使用 RAG 模式 的场景,最后结果可用于对比两种模式的效果

图中绿色的部分,就是普通的 Edge 连接,其要求上游的输出必须能 assign 给下游,可以接收的类型有:

① 上下游类型相同: 例如上游输出 *schema.Message 下游输入也是 *schema.Message

② 下游接收接口,上游实现了该接口: 例如上游结构体实现了 Format() 接口,下游接收的是一个 interface{ Format() }。特殊情况是下游是 any(空接口),上游一定实现了 any,因此一定可以连接。

③ 上游是 interface,下游是具体类型: 当下游具体类型 implements 上游的 interface 类型时,有可能可以,有可能不行,在 compile 时无法确定,只有在运行时,等上游的具体类型确定了,才能最终确定。时,详细描述可见: Eino: 编排的设计理念

图中黄色的部分,则是 eino 提供的另一个类型转换的机制,即: 若下游接收的类型是 map[string]any,但是上游输出的类型并不是 map[string]any,可以使用 graph.AddXXXNode(node_key, xxx, compose.WithOutputKey("outkey") 的方式将上游输出的类型转化为 map[string]any,其中 map 的 key 是 option 中指定的 OutputKey。 一般在多条边汇聚到某一个节点时,这种机制使用起来较为方便。

同理,若上游是 map[string]any ,但是下游输入的类型并不是 map[string]any,则可以使用 graph.AddXXXNode(node_key, xxx, compose.WithInputKey("inkey") 来获取上游输出的其中一个 key 的 value,作为下游的输入。

branch

如果一个节点后面连接了多个 edge,则每条 edge 的下游节点都会运行一次。

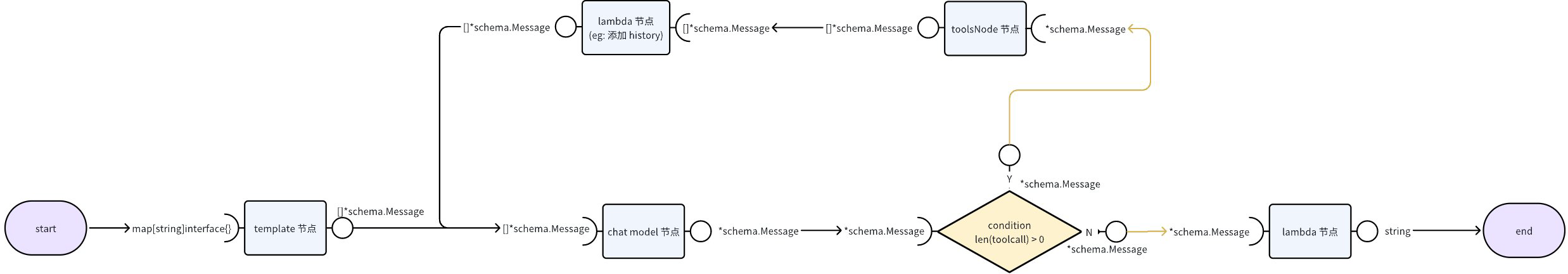

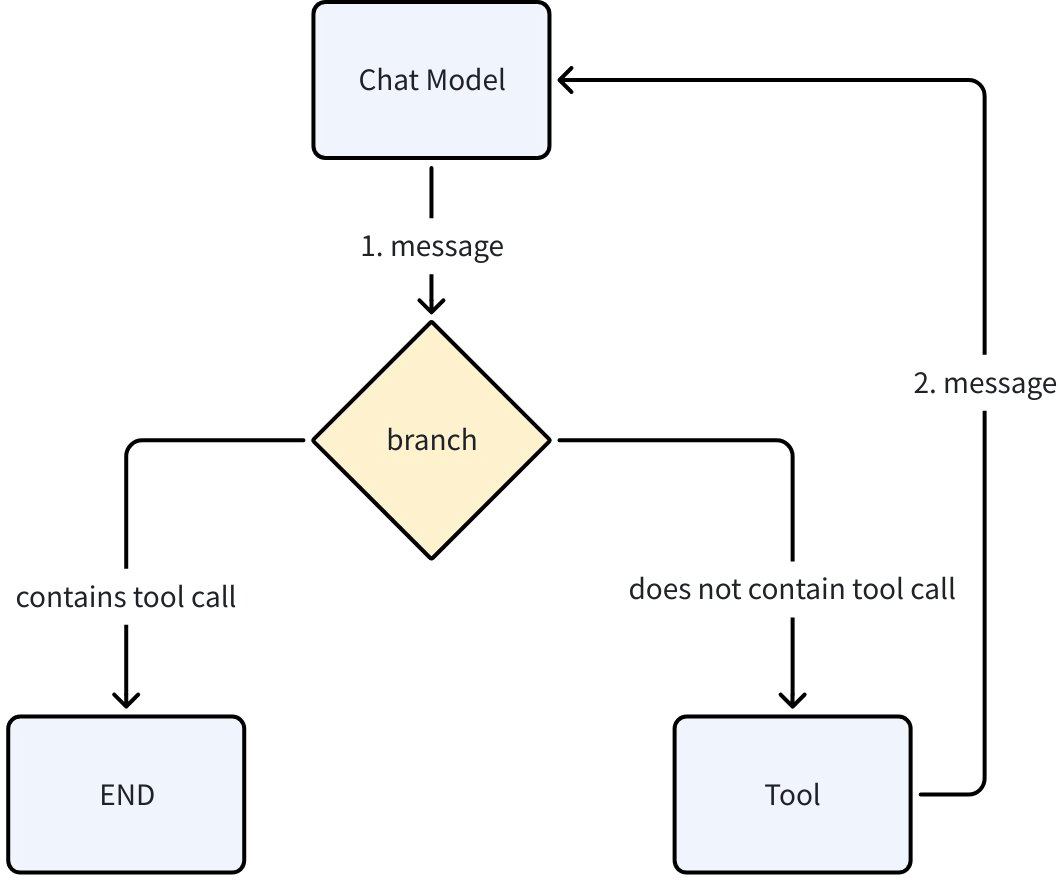

branch 则是另一种机制: 一个 branch 后接了 n 个节点,但仅会运行 condition 返回的那个 node key 对应的节点。同一个 branch 后的节点,必须要类型对齐。

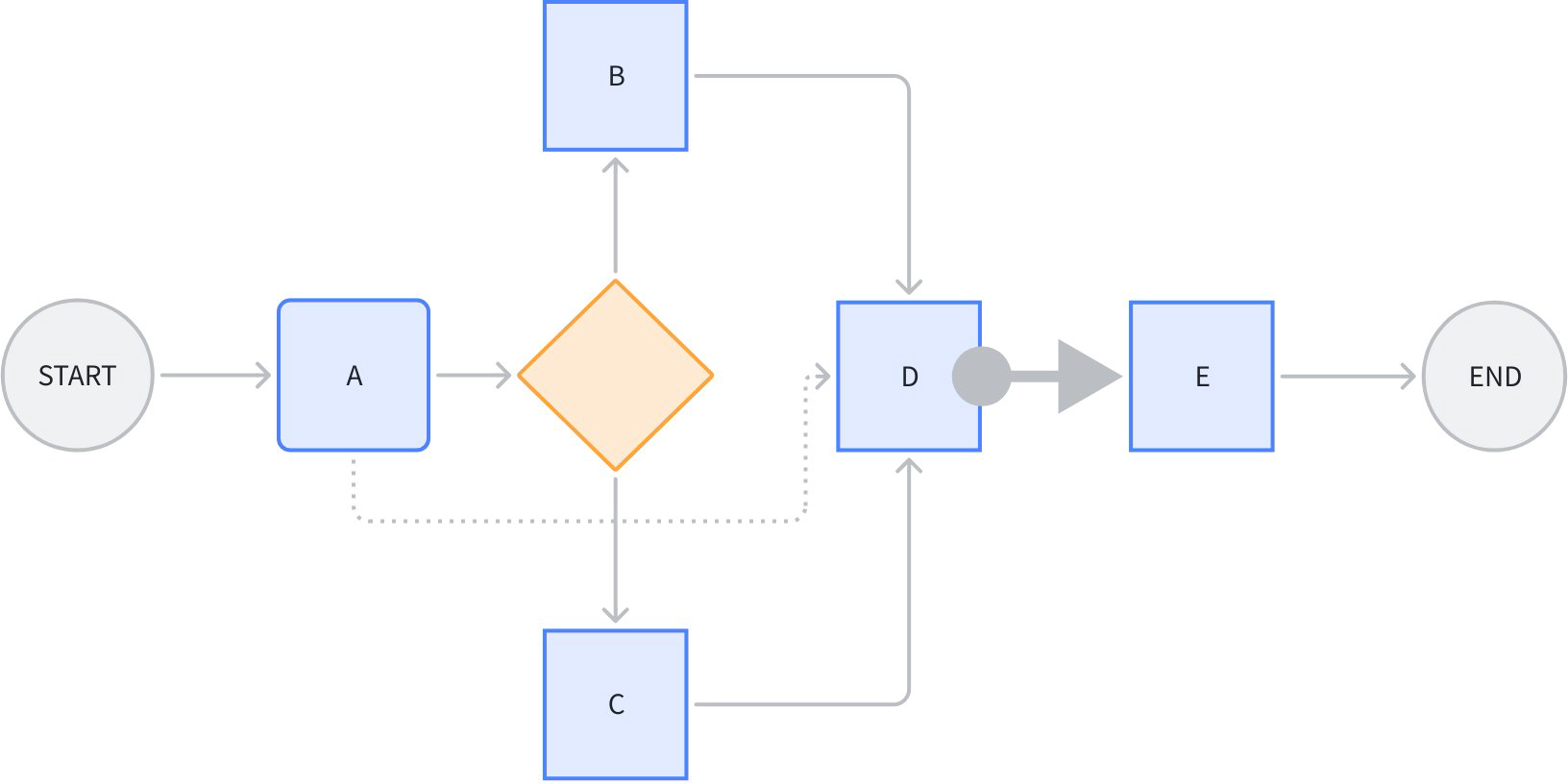

如下图:

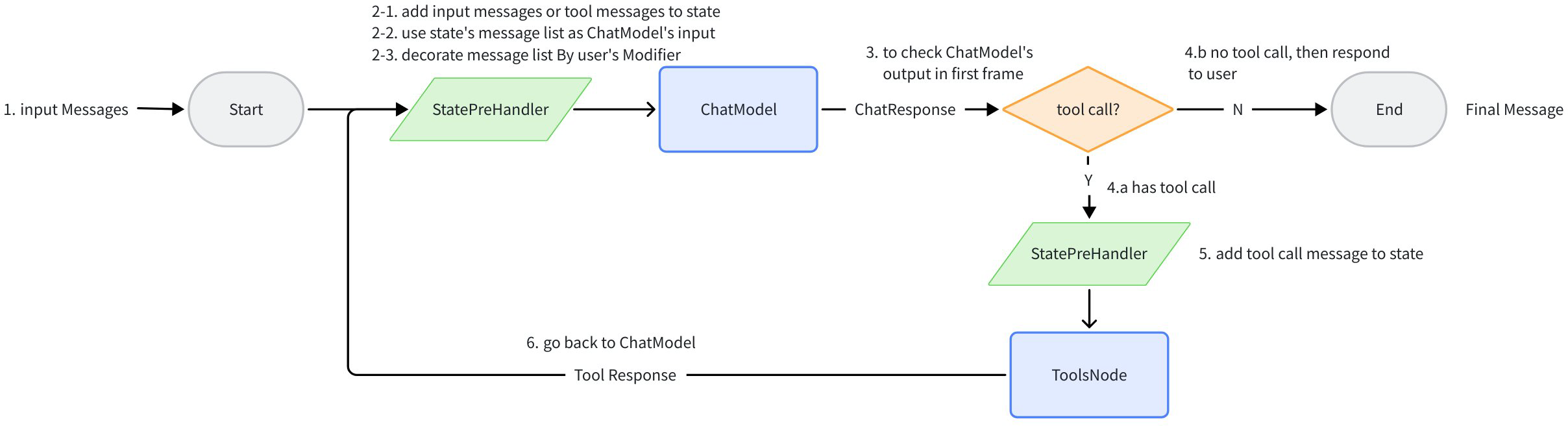

这是一个模拟 react agent 的运行逻辑

可以看到,一个 branch 本身拥有一个 condition, 这个 function 的输入必须和上游类型对齐。同时,一个 branch 后所接的各个节点,也必须和 condition 一样,要能接收上游的输出。

chain 中的类型对齐

chain

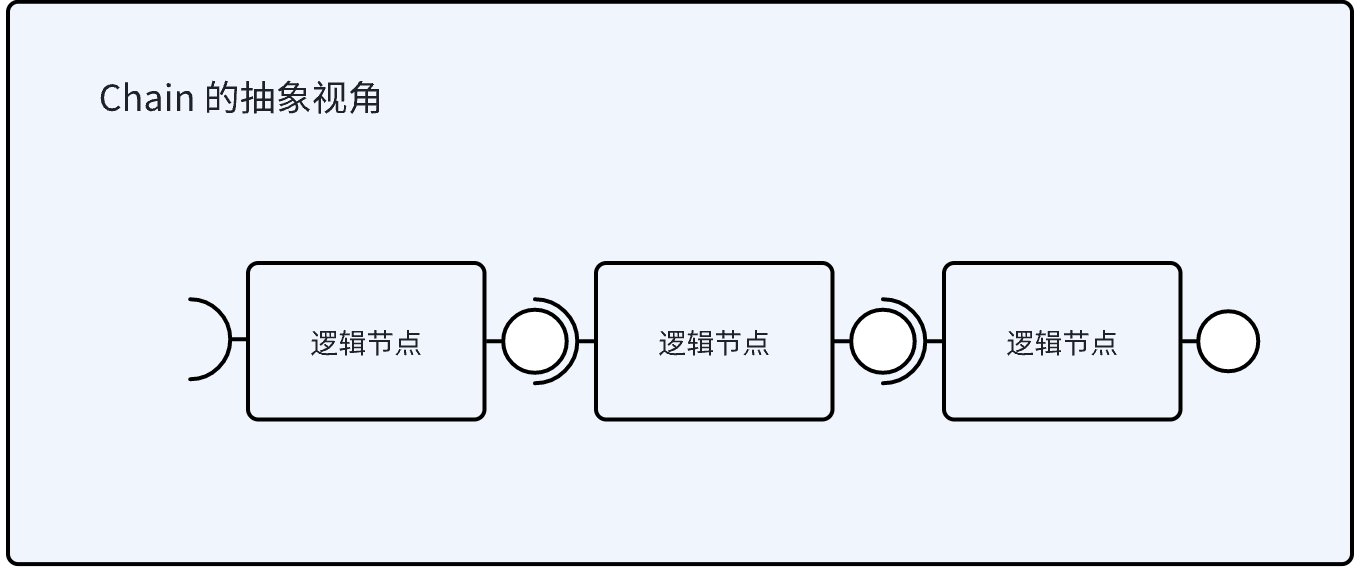

从抽象角度看,chain 就是一个 链条,如下所示:

逻辑节点的类型可以分为 3 类:

-

可编排组件 (例如 chat model、 chat template、 retriever、 lambda、graph 等等)

-

branch 节点

-

parallel 节点

可以看到,在 chain 的视角下,不论是简单的节点(eg: chat model) 还是复杂的节点 (eg: graph、branch、parallel),都是一样的,在运行过程中,一步的执行就是一个节点的运行。

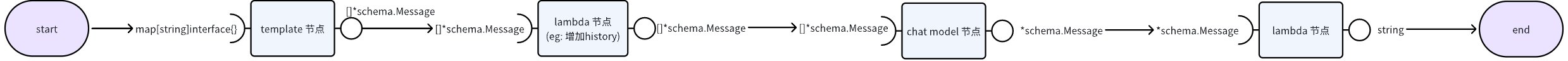

也因此,chain 的上下游节点间,类型必须是对齐的,如下:

func TestChain() {

chain := compose.NewChain[map[string]interface,string]()

nodeTemplate := &fakeChatTemplate{} // input: map[string]any, output: []*schema.Message

nodeHistoryLambda := &fakeLambda{} // input: []*schema.Message, output: []*schema.Message

nodeChatModel := &fakeChatModel{} // input: []*schema.Message, output: *schema.Message

nodeConvertResLambda := &fakeLambda{} // input: *schema.Message, output: string

chain.

AppendChatTemplate(nodeTemplate).

AppendLambda(nodeHistoryLambda).

AppendChatModel(nodeChatModel).

AppendLambda(nodeConvertResLambda)

}

上面的逻辑用图来表示如下:

若上下游的类型没有对齐,chain 会在 chain.Compile() 时返回错误。而 graph 会在 graph.AddXXXNode() 时就报错。

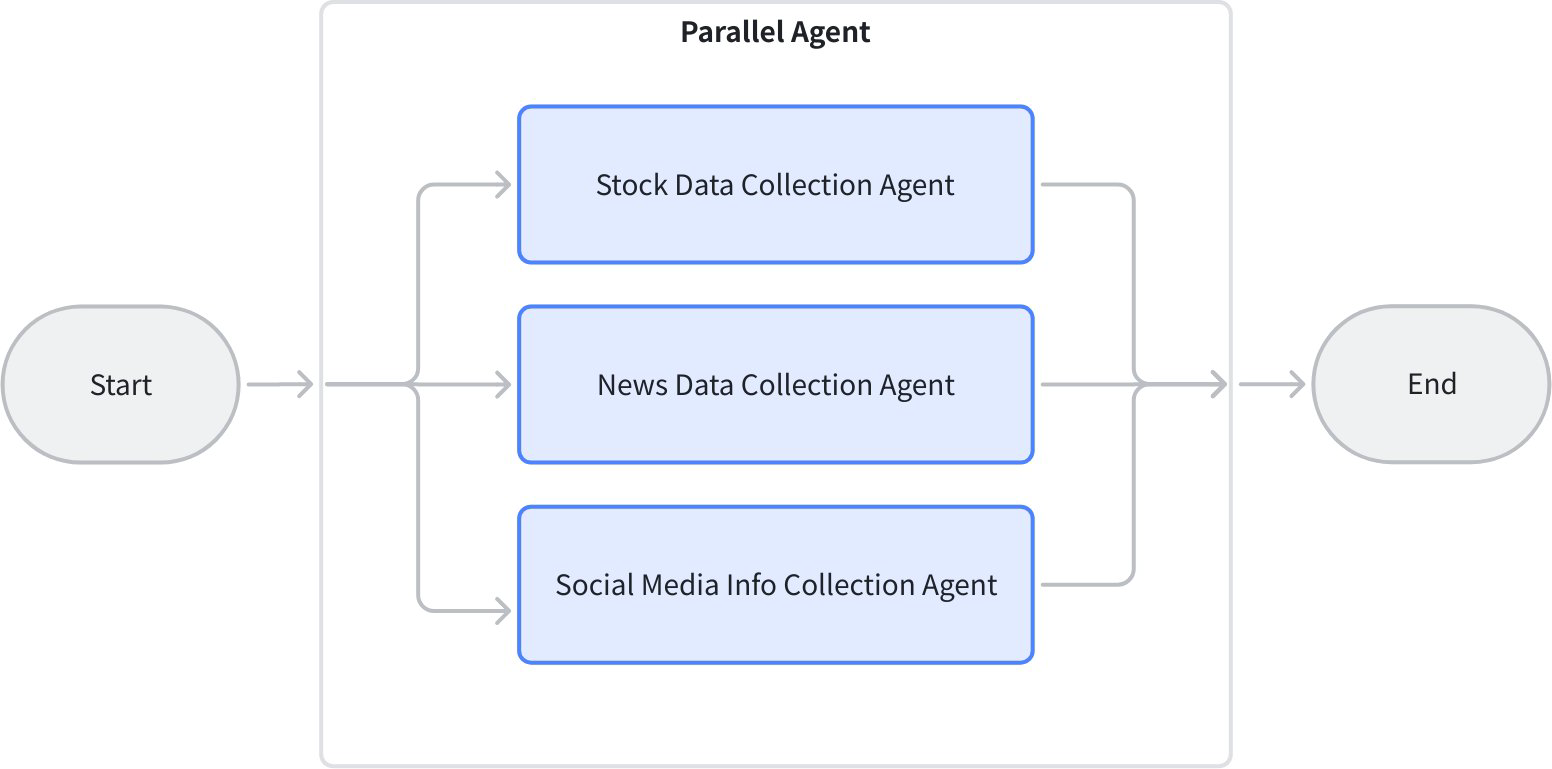

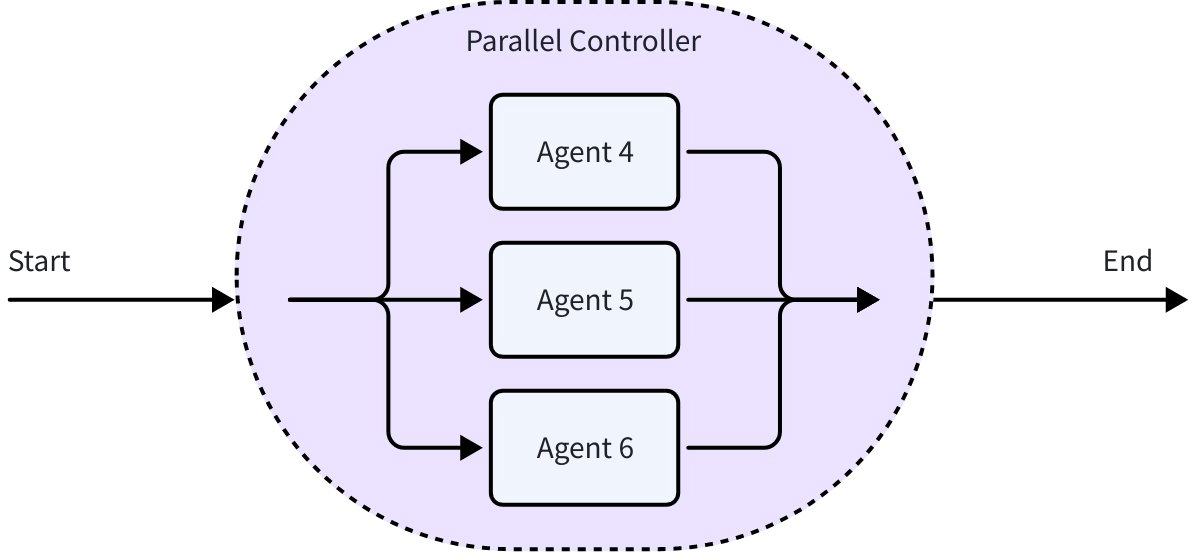

parallel

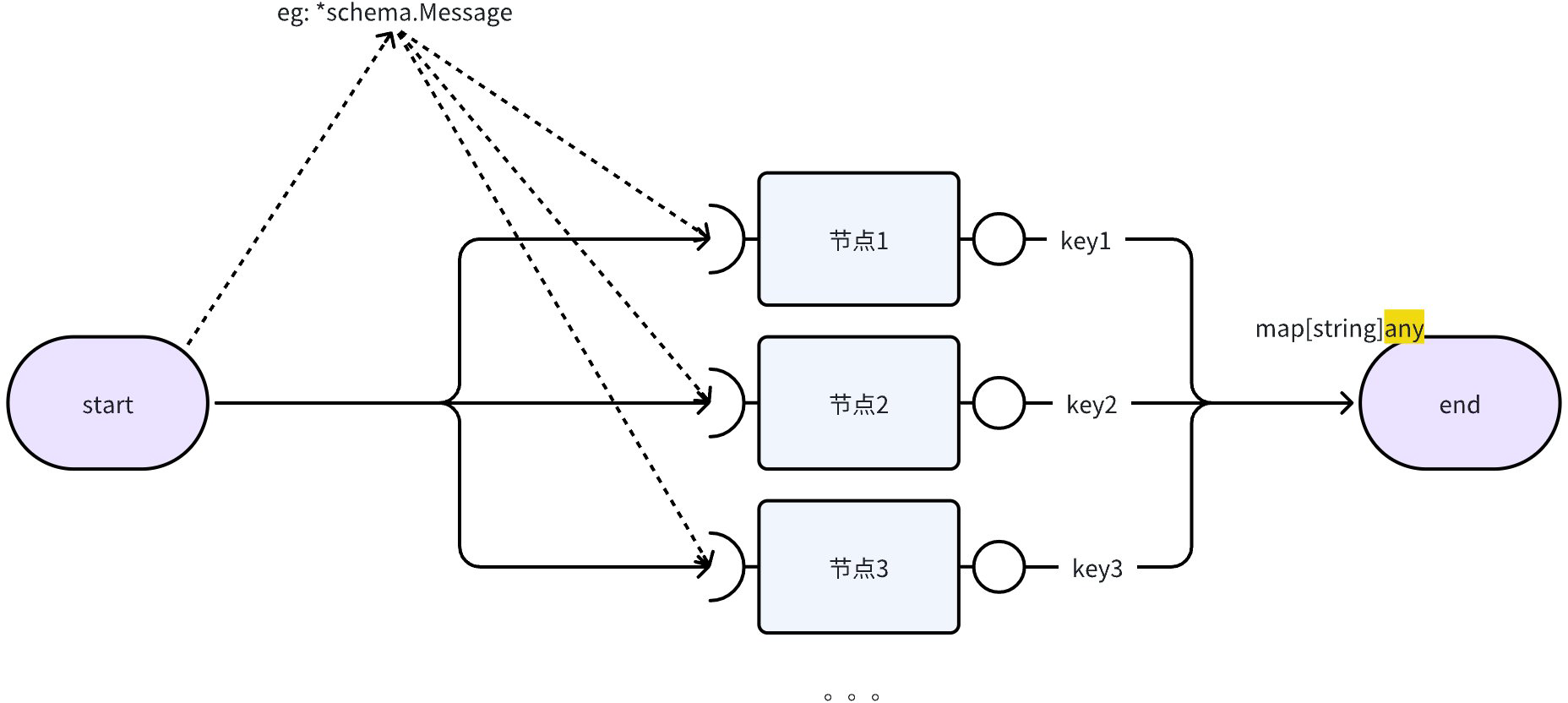

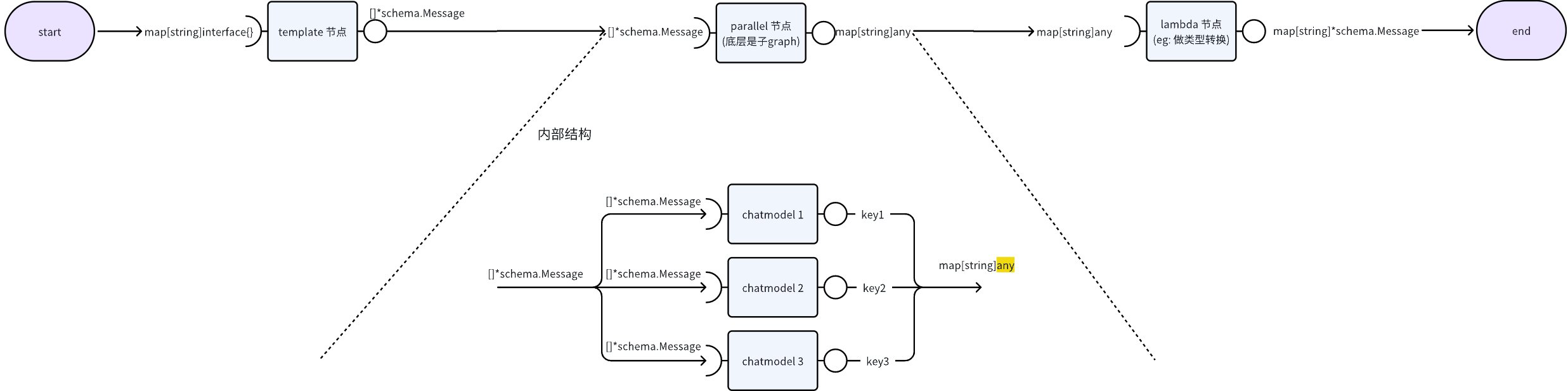

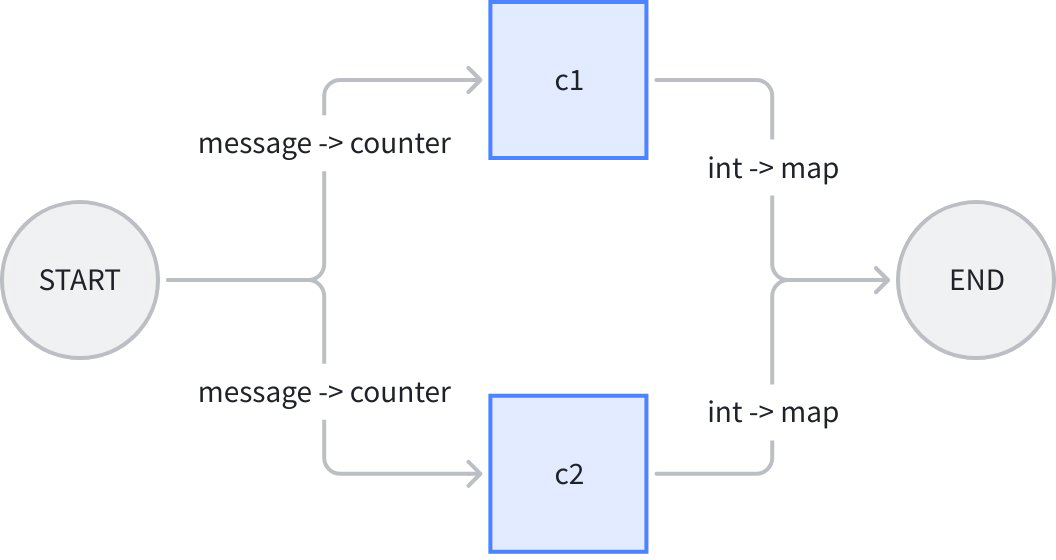

parallel 在 chain 中是一类特殊的节点,从 chain 的角度看 parallel 和其他的节点没啥区别。在 parallel 内部,其基本拓扑结构如下:

graph 中的多 edge 形成的结构其中一种就是这个,这里的基本假设是: 一个 parallel 的每一条边上有且仅有一个节点。当然,这一个节点也可以是 graph。但注意,目前框架没有直接提供在 parallel 中嵌套 branch 或 parallel 的能力。

在 parallel 中的每个节点,由于其上游节点是同一个,因此他们都要和上游节点的输出类型对齐,比如图中上游节点输出了 *schema.Message ,则每个节点都要能接收这个类型。接收的方式和 graph 中的一致,通常可以用 相同类型 、接口定义 、any、input key option 的方式。

parallel 节点的输出一定是一个 map[string]any,其中的 key 则是在 parallel.AddXXX(output_key, xxx, opts...) 时指定的 output_key,value 是节点内部的实际输出。

一个 parallel 的构建例子如下:

func TestParallel() {

chain := compose.NewChain[map[string]any, map[string]*schema.Message]()

parallel := compose.NewParallel()

model01 := &fakeChatModel{} // input: []*schema.Message, output: *schema.Message

model02 := &fakeChatModel{} // input: []*schema.Message, output: *schema.Message

model03 := &fakeChatModel{} // input: []*schema.Message, output: *schema.Message

parallel.

AddChatModel("outkey_01", model01).

AddChatModel("outkey_02", model02).

AddChatModel("outkey_03", model03)

lambdaNode := &fakeLambdaNode{} // input: map[string]any, output: map[string]*schema.Message

chain.

AppendParallel(parallel).

AppendLambda(lambdaNode)

}

一个 parallel 在 chain 中的视角如下:

图中是模拟同一个提问,由不同的大模型去回答,结果可用于对比效果

需要注意的是,这个结构只是逻辑上的视角,由于 chain 本身也是用 graph 实现的,parallel 在底层 graph 中会平铺到图中。

branch

chain 的 branch 和 graph 中的 branch 类似,branch 中的所有节点都要和上游节点的类型对齐,此处不再赘述。chain branch 的特殊之处是,branch 的所有可能的分支节点,都会连到 chain 中的同一个节点,或者都会连到 END。

Workflow 中的类型对齐

Workflow 的类型对齐的维度,由整体的 Input & Output 改成了字段级别。具体可分为:

-

上游输出的整体,类型对齐到下游的某个具体字段。

-

上游输出的某个具体字段,类型对齐到下游的整体。

-

上游输出的某个具体字段,类型对齐到下游输入的某个具体字段。

原理和规则与整体的类型对齐相同。

StateHandler 的类型对齐

StatePreHandler: 输入类型需要对齐对应节点的非流式输入类型。

// input 类型为 []*schema.Message,对齐 ChatModel 的非流式输入类型

preHandler := func(ctx context.Context, input []*schema.Message, state *state) ([]*schema.Message, error) {

// your handler logic

}

AddChatModelNode("xxx", model, WithStatePreHandler(preHandler))

StatePostHandler: 输入类型需要对齐对应节点的非流式输出类型。

// input 类型为 *schema.Message,对齐 ChatModel 的非流式输出类型

postHandler := func(ctx context.Context, input *schema.Message, state *state) (*schema.Message, error) {

// your handler logic

}

AddChatModelNode("xxx", model, WithStatePostHandler(postHandler))

StreamStatePreHandler: 输入类型需要对齐对应节点的流式输入类型。

// input 类型为 *schema.StreamReader[[]*schema.Message],对齐 ChatModel 的流式输入类型

preHandler := func(ctx context.Context, input *schema.StreamReader[[]*schema.Message], state *state) (*schema.StreamReader[[]*schema.Message], error) {

// your handler logic

}

AddChatModelNode("xxx", model, WithStreamStatePreHandler(preHandler))

StreamStatePostHandler: 输入类型需要对齐对应节点的流式输出类型。

// input 类型为 *schema.StreamReader[*schema.Message],对齐 ChatModel 的流式输出类型

postHandler := func(ctx context.Context, input *schema.StreamReader[*schema.Message], state *state) (*schema.StreamReader[*schema.Message], error) {

// your handler logic

}

AddChatModelNode("xxx", model, WithStreamStatePostHandler(postHandler))

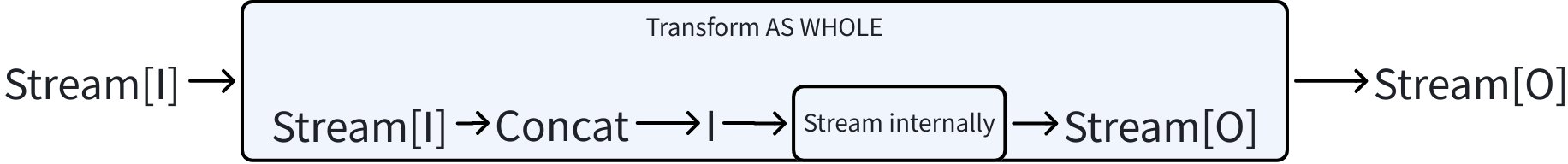

invoke 和 stream 下的类型对齐方式

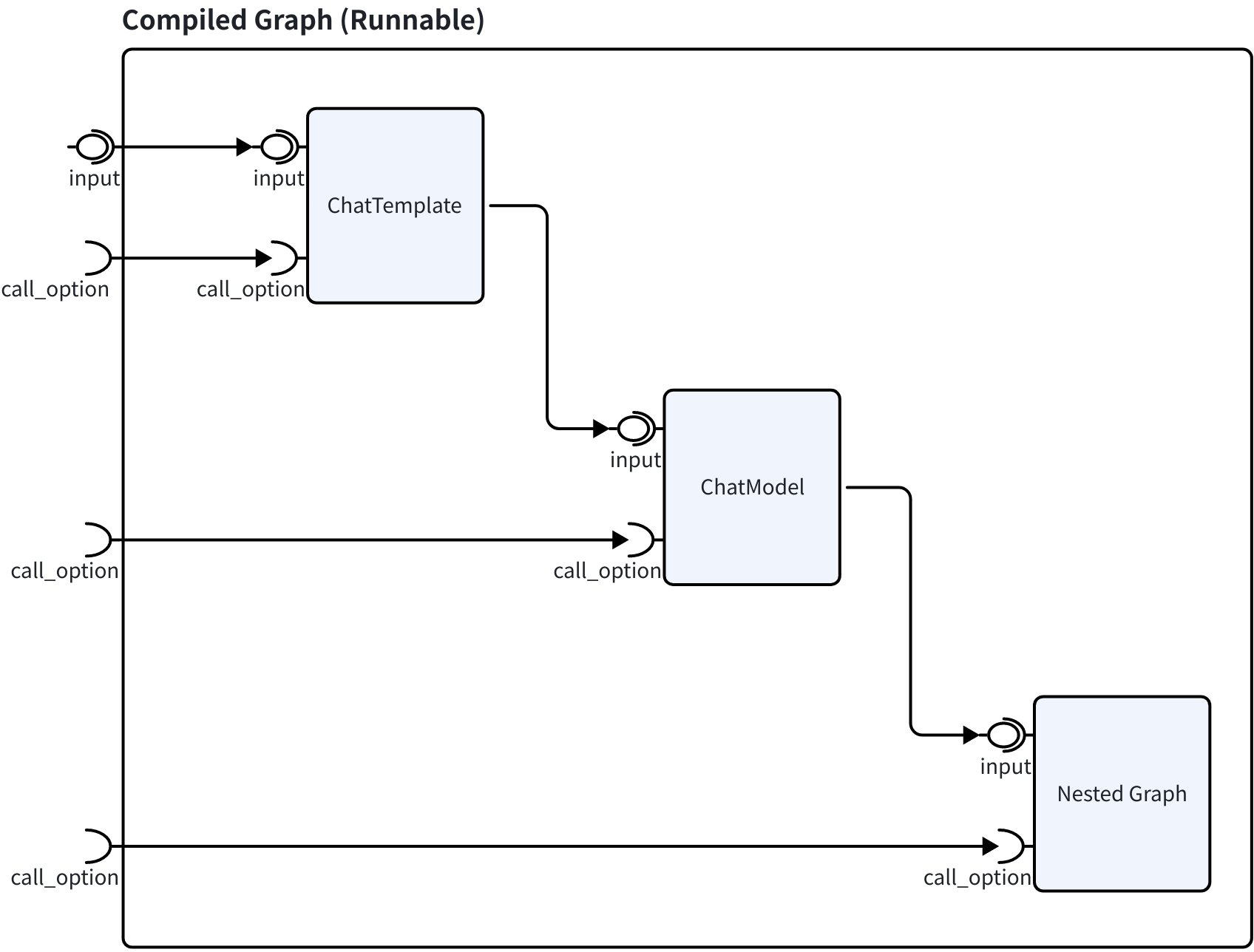

在 Eino 中,编排的结果是 graph 或 chain,若要运行,则需要使用 Compile() 来生成一个 Runnable 接口。

Runnable 的一个重要作用就是提供了 「Invoke」、「Stream」、「Collect」、「Transform」 四种调用方式。

上述几种调用方式的介绍以及详细的 Runnable 介绍可以查看: Eino 流式编程要点

假设我们有一个 Graph[[]*schema.Message, []*schema.Message],里面有一个 ChatModel 节点,一个 Lambda 节点,Compile 之后是一个 Runnable[[]*schema.Message, []*schema.Message]。

package main

import (

"context"

"io"

"testing"

"github.com/cloudwego/eino/compose"

"github.com/cloudwego/eino/schema"

"github.com/stretchr/testify/assert"

)

func TestTypeMatch(t *testing.T) {

ctx := context.Background()

g1 := compose.NewGraph[[]*schema.Message, string]()

_ = g1.AddChatModelNode("model", &mockChatModel{})

_ = g1.AddLambdaNode("lambda", compose.InvokableLambda(func(_ context.Context, msg *schema.Message) (string, error) {

return msg.Content, nil

}))

_ = g1.AddEdge(compose.START, "model")

_ = g1.AddEdge("model", "lambda")

_ = g1.AddEdge("lambda", compose.END)

runner, err := g1.Compile(ctx)

assert.NoError(t, err)

c, err := runner.Invoke(ctx, []*schema.Message{

schema.UserMessage("what's the weather in beijing?"),

})

assert.NoError(t, err)

assert.Equal(t, "the weather is good", c)

s, err := runner.Stream(ctx, []*schema.Message{

schema.UserMessage("what's the weather in beijing?"),

})

assert.NoError(t, err)

var fullStr string

for {

chunk, err := s.Recv()

if err != nil {

if err == io.EOF {

break

}

panic(err)

}

fullStr += chunk

}

assert.Equal(t, c, fullStr)

}

当我们以 Stream 方式调用上面编译好的 Runnable 时,model 节点会输出 *schema.StreamReader[*Message],但是 lambda 节点是 InvokableLambda,只接收非流式的 *schema.Message 作为输入。这也符合类型对齐规则,因为 Eino 框架会自动把流式的 Message 拼接成完整的 Message。

在 stream 模式下,拼接帧 是一个非常常见的操作,拼接时,会先把 *StreamReader[T] 中的所有元素取出来转成 []T,再尝试把 []T 拼接成一个完整的 T。框架内已经内置支持了如下类型的拼接:

-

*schema.Message: 详情见schema.``ConcatMessages``() -

string: 实现逻辑等同于+= -

[]*schema.Message: 详情见compose.concatMessageArray() -

Map: 把相同 key 的 val 进行合并,合并逻辑同上,若存在无法合并的类型,则失败 (ps: 不是覆盖) -

其他 slice:只有当 slice 中只有一个元素是非零值时,才能合并。

对其他场景,或者当用户想用定制逻辑覆盖掉上面的默认行为时,开发者可自行实现 concat 方法,并使用 compose.RegisterStreamChunkConcatFunc() 注册到全局的拼接函数中。

示例如下:

// 假设我们自己的结构体如下

type tStreamConcatItemForTest struct {

s string

}

// 实现一个拼接的方法

func concatTStreamForTest(items []*tStreamConcatItemForTest) (*tStreamConcatItemForTest, error) {

var s string

for _, item := range items {

s += item.s

}

return &tStreamConcatItemForTest{s: s}, nil

}

func Init() {

// 注册到全局的拼接方法中

compose.RegisterStreamChunkConcatFunc(concatTStreamForTest)

}

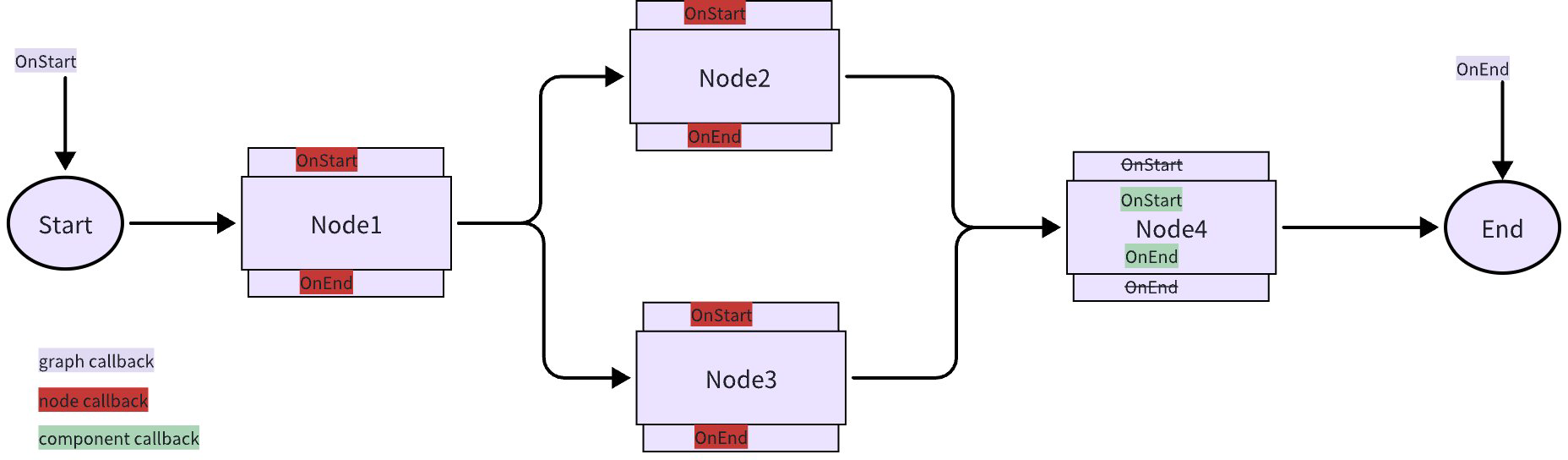

类型对齐在运行时检查的场景

eino 的 Graph 类型对齐检查,会在 err = graph.AddEdge("node1", "node2") 时检查两个节点类型是否匹配,也就能在 构建 graph 的过程,或 Compile 的过程 发现类型不匹配的错误,这适用于 Eino: 编排的设计理念 中所列举的 ① ② ③ 条规则。

当上游节点的输出为 interface 时,若下游节点类型实现了该 interface,则上游有可能可以转成下游类型 (类型断言),但只能在 运行过程 才能清楚能否转换成功,该场景的类型检查移到了运行过程中。

其结构可见下图:

这种场景适用于开发者能自行处理好上下游类型对齐的情况,可根据不同类型选择下游执行节点。

带有明确倾向性的设计选择

外部变量只读原则

Eino 的 Graph 中的数据在 Node、Branch、Handler 间流转时,一律是变量赋值,不是 Copy。当 Input 是引用类型,如 Struct 指针、map、slice 时,在 Node、Branch、Handler 内部对 Input 的修改,会对外部有副作用,可能导致并发问题。因此,Eino 遵循外部变量只读原则:Node、Branch、Handler 内部不对 Input 做修改,如需修改,先自行 Copy。

这个原则对 StreamReader 中的 Chunk 同样生效。

扇入与合并

扇入:多个上游的数据汇入到下游,一起作为下游的输入。需要明确定义多个上游的输出,如何**合并(Merge)**起来。

默认情况下,首先要求多个上游输出的实际类型必须相同且为 Map,且相互间 key 不可重复。其次:

-

在非流式场景下,合并后成为一个 Map,包含所有上游的所有键值对。

-

在流式场景下,将类型相同的多个上游 StreamReader 合并为一个 StreamReader。实际 Recv 时效果为从多个上游 StreamReader 中公平读取。

在 AddNode 时,可以通过添加 WithOutputKey 这个 Option 来把节点的输出转成 Map:

// 这个节点的输出,会从 string 改成 map[string]any,

// 且 map 中只有一个元素,key 是 your_output_key,value 是实际的的节点输出的 string

graph.AddLambdaNode("your_node_key", compose.InvokableLambda(func(ctx context.Context, input []*schema.Message) (str string, err error) {

// your logic

return

}), compose.WithOutputKey("your_output_key"))

也可以通过注册 Merge 方法来实现任意类型的 merge:

// eino/compose/values_merge.go

func RegisterValuesMergeFunc[T any](fn func([]T) (T, error))

Workflow 可以做到多个上游的多个输出字段映射到下游节点的不同字段。这并不属于合并场景,而是点对点的字段映射。事实上,eino workflow 目前不支持“多个上游字段同时映射到相同的下游字段”。

流式处理

Eino 认为,组件应当只需要实现业务场景中真实的流式范式,比如 ChatModel 不需要实现 Collect。因此,在编排场景中,Eino 自动帮助所有的节点补全缺失的流式范式。

以 Invoke 方式运行 Graph,内部各节点均以 Invoke 范式运行,以 Stream, Collect 或 Transform 方式运行 Graph,内部各节点均以 Transform 范式运行。

自动拼接(Concatenate):Stream chunk 拼接为完整内容的场景,优先使用用户注册的自定义拼接函数,其次执行框架提供的默认行为,包括 Message, Message 数组,String,Map 和 Struct 及 Struct 指针。

自动流化(Box):需要将非流式的 T 变成 StreamReader[T] 的场景,框架自动执行。

自动合并(Merge):见上文“扇入与合并”环节。

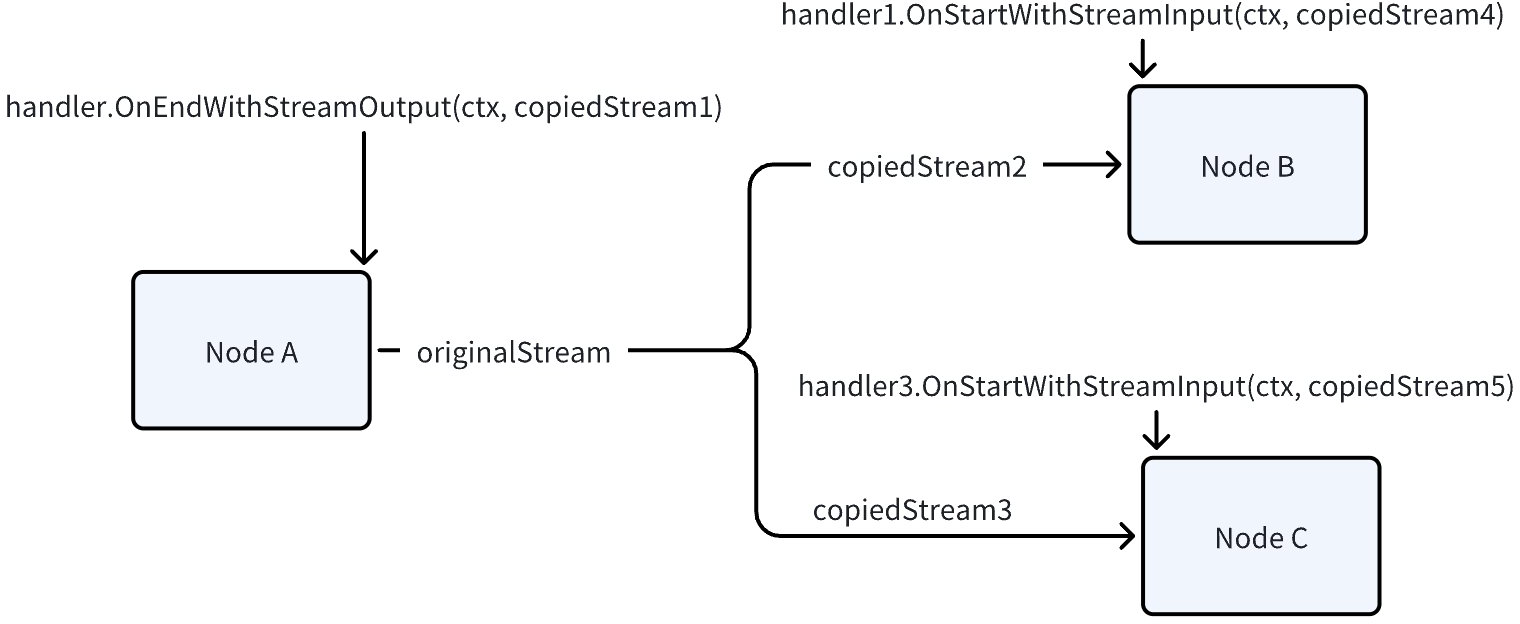

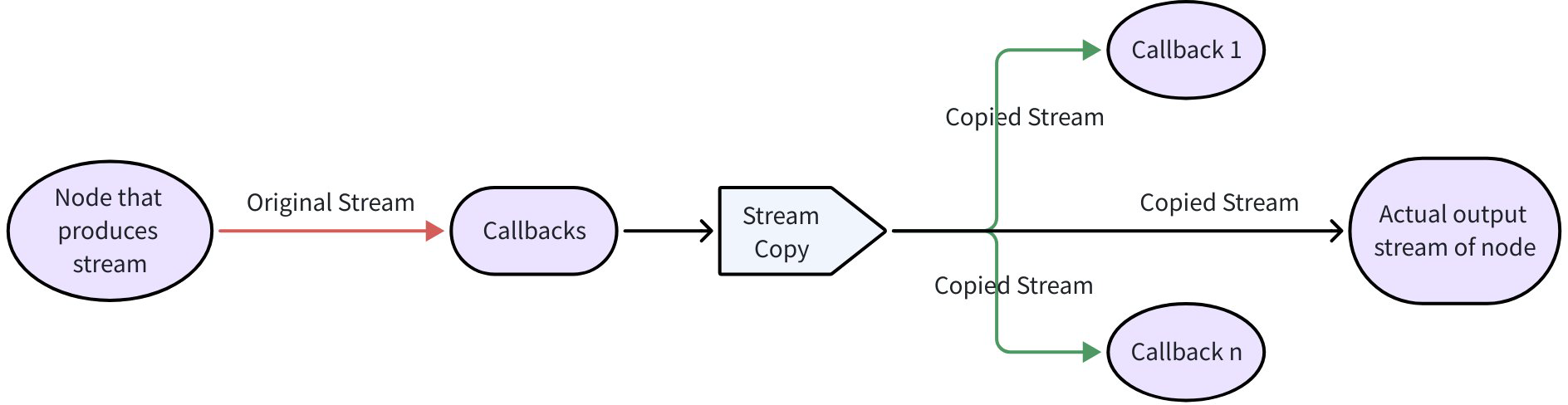

自动复制(Copy):在需要做流的复制的场景自动进行流的复制,包括一个流扇出到多个下游节点,一个流进入一个或多个 callback handler。

最后,Eino 要求所有编排元素能够感知和处理流。包括 branch,state handler,callback handler,passthrough,lambda 等。

关于 Eino 对流的处理能力,详见 Eino 流式编程要点。

全局状态

State:在 NewGraph 时通过 compose.WithGenLocalState 传入 State 的创建方法。这个请求维度的全局状态在一次请求的各环节可读写使用。

Eino 推荐用 StatePreHandler 和 StatePostHandler,功能定位是:

-

StatePreHandler:在每个节点执行前读写 State,以及按需替换节点的 Input。输入需对齐节点的非流式输入类型。

-

StatePostHandler:在每个节点执行后读写 State,以及按需替换节点的 Output。输入需对齐节点的非流式输出类型。

针对流式场景,使用对应的 StreamStatePreHandler 和 StreamStatePostHandler,输入需分别对齐节点的流式输入和流式输出类型。

这些 state handlers 位于节点外部,通过对 Input 或 Output 的修改影响节点,从而保证了节点的“状态无关”特性。

如果需要在节点内部读写 State,Eino 提供了 ProcessState[S any](ctx context.Context**, handler func(context.Context, **S) error) error 函数。

Eino 框架会在所有读写 State 的位置加锁。

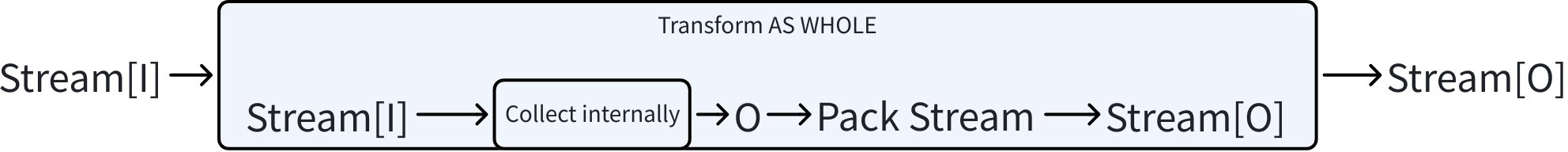

回调注入

Eino 编排框架认为,进入编排的组件,可能内部埋入了 Callback 切面,也可以没有。这个信息由组件是否实现了 Checker 接口,以及接口中 IsCallbacksEnabled 方法的返回值来判断。

-

当

IsCallbacksEnabled返回 true 时,Eino 编排框架使用组件实现内部的 Callback 切面。 -

否则,自动在组件实现外部包上 Callback 切面,(只能)上报 input 和 output。

无论哪种,都会自动推断出 RunInfo。

同时,对 Graph 整体,也一定会注入 Callback 切面,RunInfo 为 Graph 自身。

关于 Eino 的 Callback 能力完整说明,见 Eino: Callback 用户手册。

Option 分配

Eino 支持各种维度的 Call Option 分配方式:

-

默认全局,即分配到所有节点,包括嵌套的内部图。

-

可添加某个组件类型的 Option,这时默认分配到该类型的所有节点,比如 AddChatModelOption。定义了独有 Option 类型的 Lambda,也可以这样把 Option 指定到自身。

-

可指定任意个具体的节点,使用

DesignateNode(key ...string). -

可指定任意深度的嵌套图,或者其中的任意个具体的节点,使用

DesignateNodeWithPath(path ...*NodePath).

关于 Eino 的 Call Option 能力完整说明,见 Eino: CallOption 能力与规范。

图嵌套

图编排产物 Runnable 与 Lambda 的接口形式非常相似。因此编译好的图可以简单的封装为 Lambda,并以 Lambda 节点的形式嵌套进其他图中。

另一种方式,在编译前,Graph,Chain,Workflow 等都可以直接通过 AddGraph 的方式嵌套进其他图中。两个方式的差异是:

-

Lambda 的方式,在 trace 上会多一级 Lambda 节点。其他 Callback handler 视角看也会多一层。

-

Lambda 的方式,需要通过 Lambda 的 Option 来承接 CallOption,无法通过 DesignateNodeWithPath。

-

Lambda 的方式,内部图需事先编译。直接 AddGraph,则内部图随上级图一起编译。

内部机制

执行时序

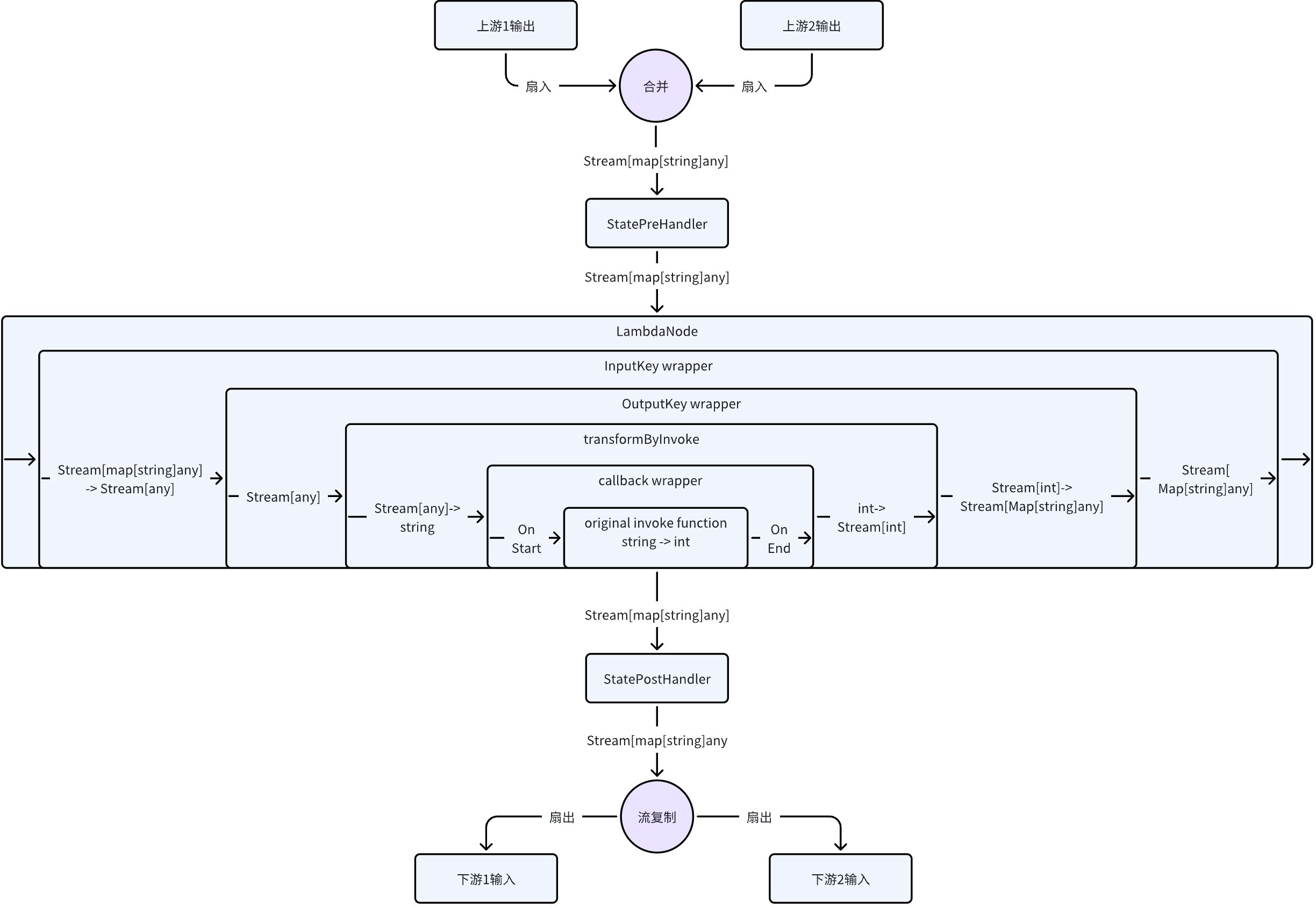

以一个添加了 StatePreHandler、StatePostHandler、InputKey、OutputKey,且内部没有实现 Callback 切面的 InvokableLambda(输入为 string,输出为 int)为例,在图中的流式执行完整时序如下:

在 workflow 的场景中,字段映射发生在两个位置:

-

在节点执行后的 StatePostHandler 以及“流复制”步骤后,每个下游需要的字段会分别抽取出来。

-

在节点执行前的“合并”步骤之后、StatePreHandler 之前,会将抽取出来的上游字段值转换为当前节点的输入。

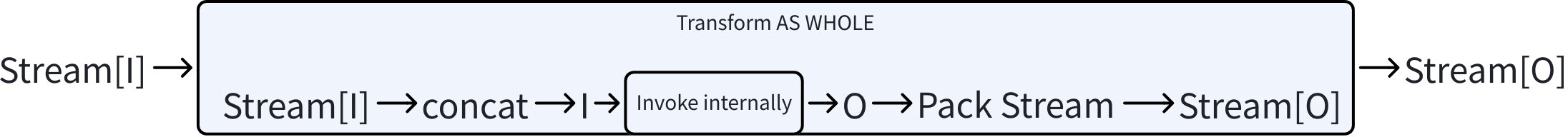

运行引擎

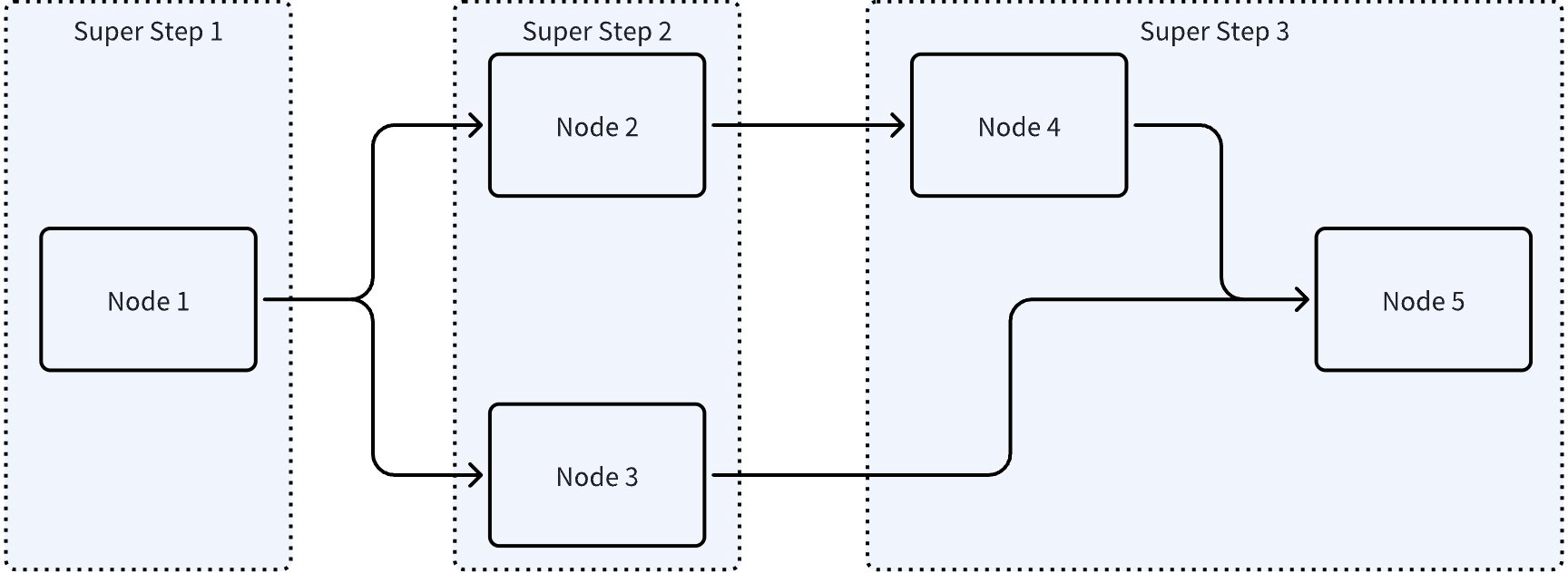

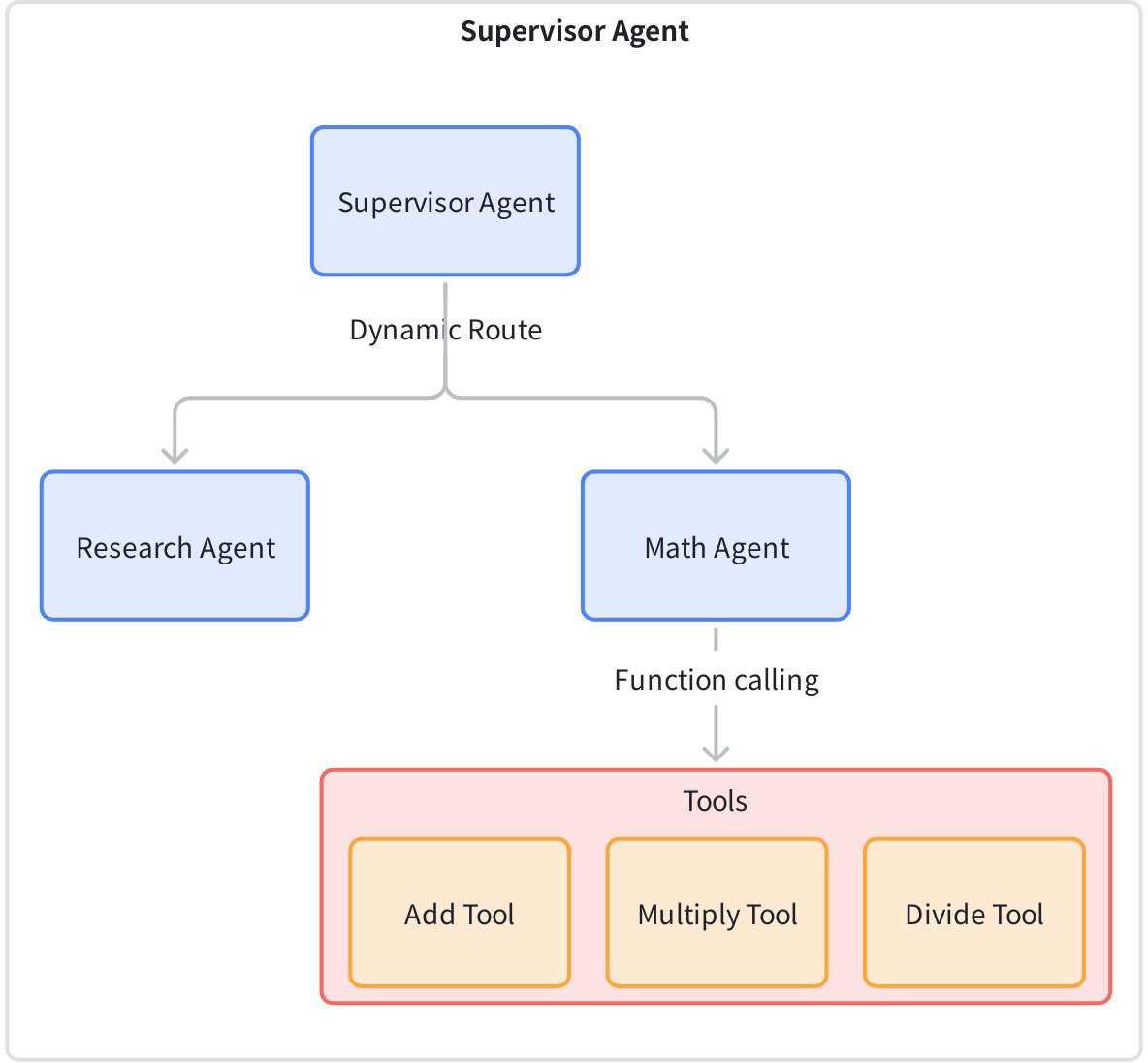

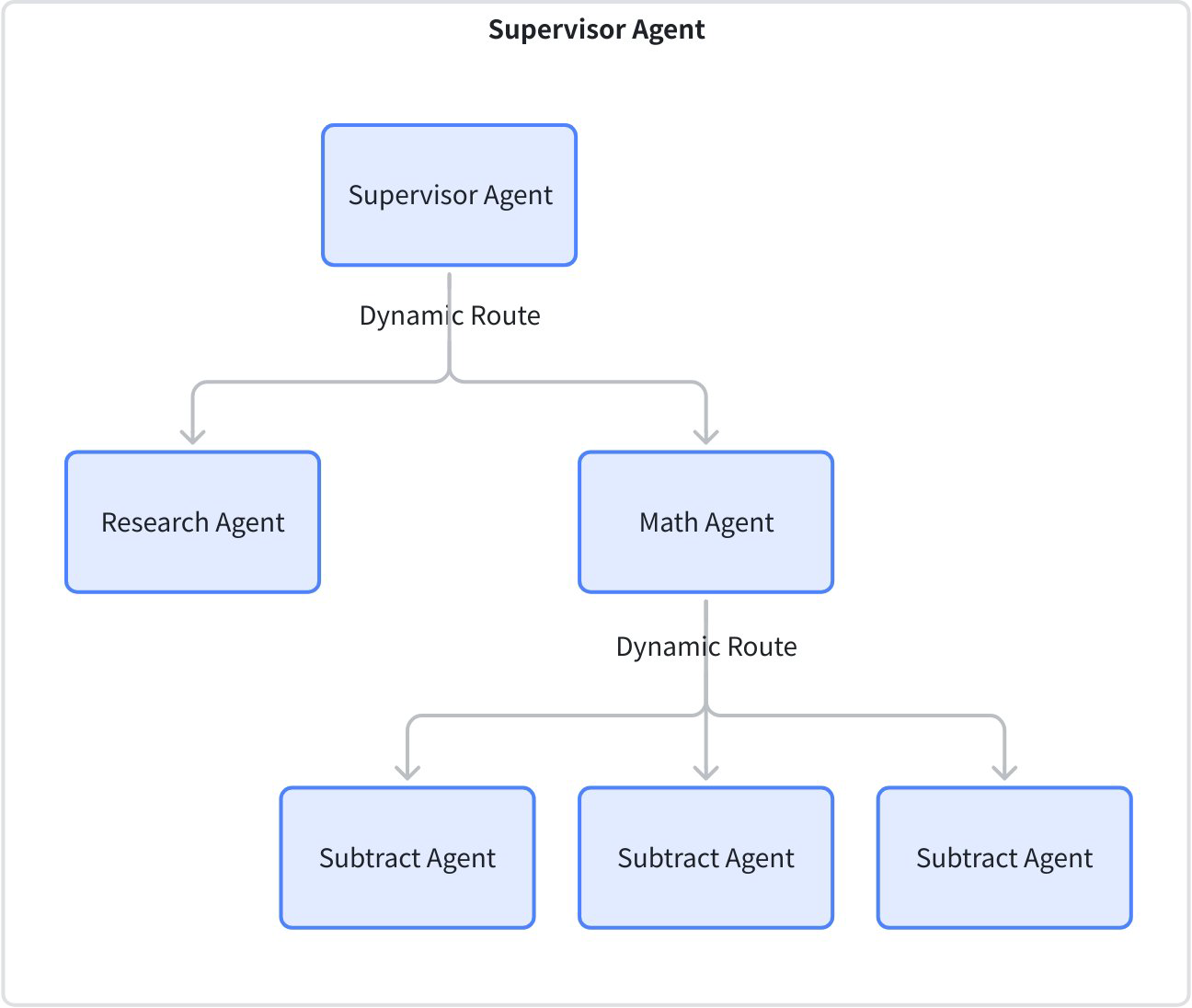

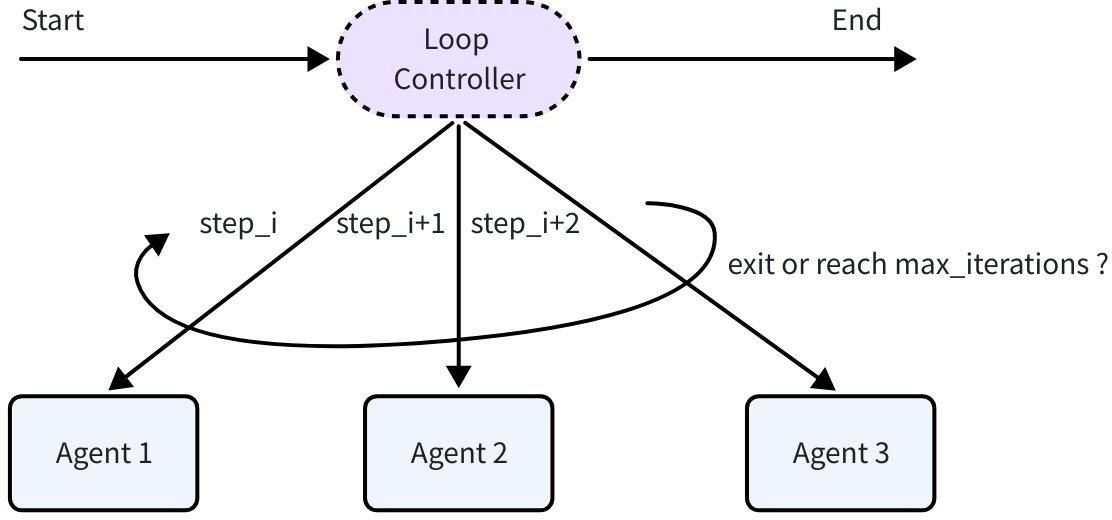

NodeTriggerMode == AnyPredecessor 时,图以 pregel 引擎执行,对应的拓扑结构是有向有环图。特点是:

-

当前执行中的一个或多个节点,所有的后序节点,作为一个 SuperStep,整体一起执行。这时,这些新的节点,会成为“当前”节点。

-

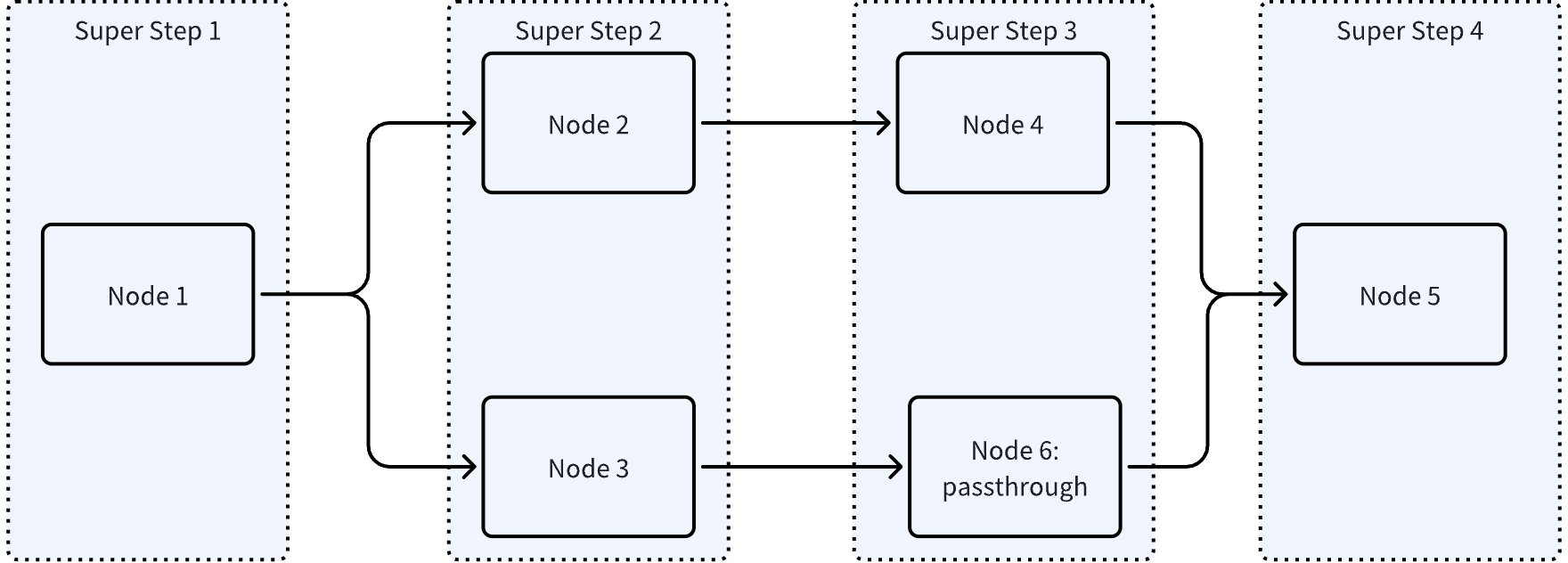

支持 Branch,支持图中有环,但是可能需要人为添加 passthrough 节点,来确保 SuperStep 中的节点符合预期,如下图:

上图中 Node 4 和 Node 5 按规则被放在一起执行,大概率不符合预期。需要改成:

NodeTriggerMode == AllPredecessor 时,图以 dag 引擎执行,对应的拓扑结构是有向无环图。特点是:

-

每个节点有确定的前序节点,当所有前序节点都完成后,本节点才具备运行条件。

-

不支持图中有环,因为会打破“每个节点有确定的前序节点”这一假定。

-

支持 Branch。在运行时,将 Branch 未选中的节点记为已跳过,不影响 AllPredecessor 的语义。

💡 设置 NodeTriggerMode = AllPredecessor 后,节点会在所有前驱就绪后执行,但并不是立即执行,而是依然遵循 SuperStep——在一批节点全部执行完成后再运行新的可运行节点。

如果在 Compile 时传入 compose.WithEagerExecution(),则就绪的节点会立刻运行。

在 Eino v0.4.0 版本及之后的版本中,设置 NodeTriggerMode = AllPredecessor 后会默认开启 EagerExecution。

总结起来,pregel 模式灵活强大但有额外的心智负担,dag 模式清晰简单但场景受限。在 Eino 框架中,Chain 是 pregel 模式,Workflow 是 dag 模式,Graph 则都支持,可由用户从 pregel 和 dag 中选择。

实现

Graph

package main

import (

"context"

"fmt"

"io"

"github.com/cloudwego/eino/components/model"

"github.com/cloudwego/eino/components/prompt"

"github.com/cloudwego/eino/compose"

"github.com/cloudwego/eino/schema"

)

const (

nodeOfModel = "model"

nodeOfPrompt = "prompt"

)

func main() {

ctx := context.Background()

g := compose.NewGraph[map[string]any, *schema.Message]()

pt := prompt.FromMessages(

schema.FString,

schema.UserMessage("what's the weather in {location}?"),

)

_ = g.AddChatTemplateNode(nodeOfPrompt, pt)

_ = g.AddChatModelNode(nodeOfModel, &mockChatModel{}, compose.WithNodeName("ChatModel"))

_ = g.AddEdge(compose.START, nodeOfPrompt)

_ = g.AddEdge(nodeOfPrompt, nodeOfModel)

_ = g.AddEdge(nodeOfModel, compose.END)

r, err := g.Compile(ctx)

if err != nil {

panic(err)

}

in := map[string]any{"location": "beijing"}

ret, err := r.Invoke(ctx, in)

fmt.Println("invoke result: ", ret)

// stream

s, err := r.Stream(ctx, in)

if err != nil {

panic(err)

}

defer s.Close()

for {

chunk, err := s.Recv()

if err != nil {

if err == io.EOF {

break

}

panic(err)

}

fmt.Println("stream chunk: ", chunk)

}

}

type mockChatModel struct{}

func (m *mockChatModel) Generate(ctx context.Context, input []*schema.Message, opts ...model.Option) (*schema.Message, error) {

return schema.AssistantMessage("the weather is good", nil), nil

}

func (m *mockChatModel) Stream(ctx context.Context, input []*schema.Message, opts ...model.Option) (*schema.StreamReader[*schema.Message], error) {

sr, sw := schema.Pipe[*schema.Message](0)

go func() {

defer sw.Close()

sw.Send(schema.AssistantMessage("the weather is", nil), nil)

sw.Send(schema.AssistantMessage("good", nil), nil)

}()

return sr, nil

}

func (m *mockChatModel) BindTools(tools []*schema.ToolInfo) error {

panic("implement me")

}

ToolCallAgent

go get github.com/cloudwego/eino-ext/components/model/openai@latest

go get github.com/cloudwego/eino@latest

package main

import (

"context"

"os"

"github.com/cloudwego/eino-ext/components/model/openai"

"github.com/cloudwego/eino/callbacks"

"github.com/cloudwego/eino/components/prompt"

"github.com/cloudwego/eino/components/tool"

"github.com/cloudwego/eino/components/tool/utils"

"github.com/cloudwego/eino/compose"

"github.com/cloudwego/eino/schema"

"github.com/cloudwego/eino-examples/internal/gptr"

"github.com/cloudwego/eino-examples/internal/logs"

)

func main() {

openAIBaseURL := os.Getenv("OPENAI_BASE_URL")

openAIAPIKey := os.Getenv("OPENAI_API_KEY")

modelName := os.Getenv("MODEL_NAME")

ctx := context.Background()

callbacks.AppendGlobalHandlers(&loggerCallbacks{})

// 1. create an instance of ChatTemplate as 1st Graph Node

systemTpl := `你是一名房产经纪人,结合用户的薪酬和工作,使用 user_info API,为其提供相关的房产信息。邮箱是必须的`

chatTpl := prompt.FromMessages(schema.FString,

schema.SystemMessage(systemTpl),

schema.MessagesPlaceholder("message_histories", true),

schema.UserMessage("{user_query}"),

)

modelConf := &openai.ChatModelConfig{

BaseURL: openAIBaseURL,

APIKey: openAIAPIKey,

ByAzure: true,

Model: modelName,

Temperature: gptr.Of(float32(0.7)),

APIVersion: "2024-06-01",

}

// 2. create an instance of ChatModel as 2nd Graph Node

chatModel, err := openai.NewChatModel(ctx, modelConf)

if err != nil {

logs.Errorf("NewChatModel failed, err=%v", err)

return

}

// 3. create an instance of tool.InvokableTool for Intent recognition and execution

userInfoTool := utils.NewTool(

&schema.ToolInfo{

Name: "user_info",

Desc: "根据用户的姓名和邮箱,查询用户的公司、职位、薪酬信息",

ParamsOneOf: schema.NewParamsOneOfByParams(map[string]*schema.ParameterInfo{

"name": {

Type: "string",

Desc: "用户的姓名",

},

"email": {

Type: "string",

Desc: "用户的邮箱",

},

}),

},

func(ctx context.Context, input *userInfoRequest) (output *userInfoResponse, err error) {

return &userInfoResponse{

Name: input.Name,

Email: input.Email,

Company: "Bytedance",

Position: "CEO",

Salary: "9999",

}, nil

})

info, err := userInfoTool.Info(ctx)

if err != nil {

logs.Errorf("Get ToolInfo failed, err=%v", err)

return

}

// 4. bind ToolInfo to ChatModel. ToolInfo will remain in effect until the next BindTools.

err = chatModel.BindForcedTools([]*schema.ToolInfo{info})

if err != nil {

logs.Errorf("BindForcedTools failed, err=%v", err)

return

}

// 5. create an instance of ToolsNode as 3rd Graph Node

toolsNode, err := compose.NewToolNode(ctx, &compose.ToolsNodeConfig{

Tools: []tool.BaseTool{userInfoTool},

})

if err != nil {

logs.Errorf("NewToolNode failed, err=%v", err)

return

}

const (

nodeKeyOfTemplate = "template"

nodeKeyOfChatModel = "chat_model"

nodeKeyOfTools = "tools"

)

// 6. create an instance of Graph

// input type is 1st Graph Node's input type, that is ChatTemplate's input type: map[string]any

// output type is last Graph Node's output type, that is ToolsNode's output type: []*schema.Message

g := compose.NewGraph[map[string]any, []*schema.Message]()

// 7. add ChatTemplate into graph

_ = g.AddChatTemplateNode(nodeKeyOfTemplate, chatTpl)

// 8. add ChatModel into graph

_ = g.AddChatModelNode(nodeKeyOfChatModel, chatModel)

// 9. add ToolsNode into graph

_ = g.AddToolsNode(nodeKeyOfTools, toolsNode)

// 10. add connection between nodes

_ = g.AddEdge(compose.START, nodeKeyOfTemplate)

_ = g.AddEdge(nodeKeyOfTemplate, nodeKeyOfChatModel)

_ = g.AddEdge(nodeKeyOfChatModel, nodeKeyOfTools)

_ = g.AddEdge(nodeKeyOfTools, compose.END)

// 9. compile Graph[I, O] to Runnable[I, O]

r, err := g.Compile(ctx)

if err != nil {

logs.Errorf("Compile failed, err=%v", err)

return

}

out, err := r.Invoke(ctx, map[string]any{

"message_histories": []*schema.Message{},

"user_query": "我叫 zhangsan, 邮箱是 zhangsan@bytedance.com, 帮我推荐一处房产",

})

if err != nil {

logs.Errorf("Invoke failed, err=%v", err)

return

}

logs.Infof("Generation: %v Messages", len(out))

for _, msg := range out {

logs.Infof(" %v", msg)

}

}

type userInfoRequest struct {

Name string `json:"name"`

Email string `json:"email"`

}

type userInfoResponse struct {

Name string `json:"name"`

Email string `json:"email"`

Company string `json:"company"`

Position string `json:"position"`

Salary string `json:"salary"`

}

type loggerCallbacks struct{}

func (l *loggerCallbacks) OnStart(ctx context.Context, info *callbacks.RunInfo, input callbacks.CallbackInput) context.Context {

logs.Infof("name: %v, type: %v, component: %v, input: %v", info.Name, info.Type, info.Component, input)

return ctx

}

func (l *loggerCallbacks) OnEnd(ctx context.Context, info *callbacks.RunInfo, output callbacks.CallbackOutput) context.Context {

logs.Infof("name: %v, type: %v, component: %v, output: %v", info.Name, info.Type, info.Component, output)

return ctx

}

func (l *loggerCallbacks) OnError(ctx context.Context, info *callbacks.RunInfo, err error) context.Context {

logs.Infof("name: %v, type: %v, component: %v, error: %v", info.Name, info.Type, info.Component, err)

return ctx

}

func (l *loggerCallbacks) OnStartWithStreamInput(ctx context.Context, info *callbacks.RunInfo, input *schema.StreamReader[callbacks.CallbackInput]) context.Context {

return ctx

}

func (l *loggerCallbacks) OnEndWithStreamOutput(ctx context.Context, info *callbacks.RunInfo, output *schema.StreamReader[callbacks.CallbackOutput]) context.Context {

return ctx

}

Graph with state

Graph 可以有 graph 自身的“全局”状态,在创建 Graph 时传入 WithGenLocalState Option 开启此功能:

// compose/generic_graph.go

// type GenLocalState[S any] func(ctx context.Context) (state S)

func WithGenLocalState[S any](gls GenLocalState[S]) NewGraphOption {

// --snip--

}

Add node 时添加 Pre/Post Handler 来处理 State:

// compose/graph_add_node_options.go

// type StatePreHandler[I, S any] func(ctx context.Context, in I, state S) (I, error)

// type StatePostHandler[O, S any] func(ctx context.Context, out O, state S) (O, error)

func WithStatePreHandler[I, S any](pre StatePreHandler[I, S]) GraphAddNodeOpt {

// --snip--

}

func WithStatePostHandler[O, S any](post StatePostHandler[O, S]) GraphAddNodeOpt {

// --snip--

}

在 Node 内部,用 ProcessState,传入一个读写 State 的 函数:

// flow/agent/react/react.go

var msg *schema.Message

err = compose.ProcessState[*state](ctx, func(_ context.Context, state *state) error {

for i := range msgs {

if msgs[i] != nil && msgs[i].ToolCallID == state.ReturnDirectlyToolCallID {

msg = msgs[i]

return nil

}

}

return nil

})

完整使用例子:

package main

import (

"context"

"errors"

"io"

"runtime/debug"

"strings"

"unicode/utf8"

"github.com/cloudwego/eino/compose"

"github.com/cloudwego/eino/schema"

"github.com/cloudwego/eino/utils/safe"

"github.com/cloudwego/eino-examples/internal/logs"

)

func main() {

ctx := context.Background()

const (

nodeOfL1 = "invokable"

nodeOfL2 = "streamable"

nodeOfL3 = "transformable"

)

type testState struct {

ms []string

}

gen := func(ctx context.Context) *testState {

return &testState{}

}

sg := compose.NewGraph[string, string](compose.WithGenLocalState(gen))

l1 := compose.InvokableLambda(func(ctx context.Context, in string) (out string, err error) {

return "InvokableLambda: " + in, nil

})

l1StateToInput := func(ctx context.Context, in string, state *testState) (string, error) {

state.ms = append(state.ms, in)

return in, nil

}

l1StateToOutput := func(ctx context.Context, out string, state *testState) (string, error) {

state.ms = append(state.ms, out)

return out, nil

}

_ = sg.AddLambdaNode(nodeOfL1, l1,

compose.WithStatePreHandler(l1StateToInput), compose.WithStatePostHandler(l1StateToOutput))

l2 := compose.StreamableLambda(func(ctx context.Context, input string) (output *schema.StreamReader[string], err error) {

outStr := "StreamableLambda: " + input

sr, sw := schema.Pipe[string](utf8.RuneCountInString(outStr))

// nolint: byted_goroutine_recover

go func() {

for _, field := range strings.Fields(outStr) {

sw.Send(field+" ", nil)

}

sw.Close()

}()

return sr, nil

})

l2StateToOutput := func(ctx context.Context, out string, state *testState) (string, error) {

state.ms = append(state.ms, out)

return out, nil

}

_ = sg.AddLambdaNode(nodeOfL2, l2, compose.WithStatePostHandler(l2StateToOutput))

l3 := compose.TransformableLambda(func(ctx context.Context, input *schema.StreamReader[string]) (

output *schema.StreamReader[string], err error) {

prefix := "TransformableLambda: "

sr, sw := schema.Pipe[string](20)

go func() {

defer func() {

panicErr := recover()

if panicErr != nil {

err := safe.NewPanicErr(panicErr, debug.Stack())

logs.Errorf("panic occurs: %v\n", err)

}

}()

for _, field := range strings.Fields(prefix) {

sw.Send(field+" ", nil)

}

for {

chunk, err := input.Recv()

if err != nil {

if err == io.EOF {

break

}

// TODO: how to trace this kind of error in the goroutine of processing sw

sw.Send(chunk, err)

break

}

sw.Send(chunk, nil)

}

sw.Close()

}()

return sr, nil

})

l3StateToOutput := func(ctx context.Context, out string, state *testState) (string, error) {

state.ms = append(state.ms, out)

logs.Infof("state result: ")

for idx, m := range state.ms {

logs.Infof(" %vth: %v", idx, m)

}

return out, nil

}

_ = sg.AddLambdaNode(nodeOfL3, l3, compose.WithStatePostHandler(l3StateToOutput))

_ = sg.AddEdge(compose.START, nodeOfL1)

_ = sg.AddEdge(nodeOfL1, nodeOfL2)

_ = sg.AddEdge(nodeOfL2, nodeOfL3)

_ = sg.AddEdge(nodeOfL3, compose.END)

run, err := sg.Compile(ctx)

if err != nil {

logs.Errorf("sg.Compile failed, err=%v", err)

return

}

out, err := run.Invoke(ctx, "how are you")

if err != nil {

logs.Errorf("run.Invoke failed, err=%v", err)

return

}

logs.Infof("invoke result: %v", out)

stream, err := run.Stream(ctx, "how are you")

if err != nil {

logs.Errorf("run.Stream failed, err=%v", err)

return

}

for {

chunk, err := stream.Recv()

if err != nil {

if errors.Is(err, io.EOF) {

break

}

logs.Infof("stream.Recv() failed, err=%v", err)

break

}

logs.Tokenf("%v", chunk)

}

stream.Close()

sr, sw := schema.Pipe[string](1)

sw.Send("how are you", nil)

sw.Close()

stream, err = run.Transform(ctx, sr)

if err != nil {

logs.Infof("run.Transform failed, err=%v", err)

return

}

for {

chunk, err := stream.Recv()

if err != nil {

if errors.Is(err, io.EOF) {

break

}

logs.Infof("stream.Recv() failed, err=%v", err)

break

}

logs.Infof("%v", chunk)

}

stream.Close()

}

Chain

Chain 可以视为是 Graph 的简化封装

package main

import (

"context"

"fmt"

"log"

"math/rand"

"os"

"github.com/cloudwego/eino-ext/components/model/openai"

"github.com/cloudwego/eino/components/prompt"

"github.com/cloudwego/eino/compose"

"github.com/cloudwego/eino/schema"

"github.com/cloudwego/eino-examples/internal/gptr"

"github.com/cloudwego/eino-examples/internal/logs"

)

func main() {

openAPIBaseURL := os.Getenv("OPENAI_BASE_URL")

openAPIAK := os.Getenv("OPENAI_API_KEY")

modelName := os.Getenv("MODEL_NAME")

ctx := context.Background()

// build branch func

const randLimit = 2

branchCond := func(ctx context.Context, input map[string]any) (string, error) { // nolint: byted_all_nil_return

if rand.Intn(randLimit) == 1 {

return "b1", nil

}

return "b2", nil

}

b1 := compose.InvokableLambda(func(ctx context.Context, kvs map[string]any) (map[string]any, error) {

logs.Infof("hello in branch lambda 01")

if kvs == nil {

return nil, fmt.Errorf("nil map")

}

kvs["role"] = "cat"

return kvs, nil

})

b2 := compose.InvokableLambda(func(ctx context.Context, kvs map[string]any) (map[string]any, error) {

logs.Infof("hello in branch lambda 02")

if kvs == nil {

return nil, fmt.Errorf("nil map")

}

kvs["role"] = "dog"

return kvs, nil

})

// build parallel node

parallel := compose.NewParallel()

parallel.

AddLambda("role", compose.InvokableLambda(func(ctx context.Context, kvs map[string]any) (string, error) {

// may be change role to others by input kvs, for example (dentist/doctor...)

role, ok := kvs["role"].(string)

if !ok || role == "" {

role = "bird"

}

return role, nil

})).

AddLambda("input", compose.InvokableLambda(func(ctx context.Context, kvs map[string]any) (string, error) {

return "你的叫声是怎样的?", nil

}))

modelConf := &openai.ChatModelConfig{

BaseURL: openAPIBaseURL,

APIKey: openAPIAK,

ByAzure: true,

Model: modelName,

Temperature: gptr.Of(float32(0.7)),

APIVersion: "2024-06-01",

}

// create chat model node

cm, err := openai.NewChatModel(context.Background(), modelConf)

if err != nil {

log.Panic(err)

return

}

rolePlayerChain := compose.NewChain[map[string]any, *schema.Message]()

rolePlayerChain.

AppendChatTemplate(prompt.FromMessages(schema.FString, schema.SystemMessage(`You are a {role}.`), schema.UserMessage(`{input}`))).

AppendChatModel(cm)

// =========== build chain ===========

chain := compose.NewChain[map[string]any, string]()

chain.

AppendLambda(compose.InvokableLambda(func(ctx context.Context, kvs map[string]any) (map[string]any, error) {

// do some logic to prepare kv as input val for next node

// just pass through

logs.Infof("in view lambda: %v", kvs)

return kvs, nil

})).

AppendBranch(compose.NewChainBranch(branchCond).AddLambda("b1", b1).AddLambda("b2", b2)). // nolint: byted_use_receiver_without_nilcheck

AppendPassthrough().

AppendParallel(parallel).

AppendGraph(rolePlayerChain).

AppendLambda(compose.InvokableLambda(func(ctx context.Context, m *schema.Message) (string, error) {

// do some logic to check the output or something

logs.Infof("in view of messages: %v", m.Content)

return m.Content, nil

}))

// compile

r, err := chain.Compile(ctx)

if err != nil {

log.Panic(err)

return

}

output, err := r.Invoke(context.Background(), map[string]any{})

if err != nil {

log.Panic(err)

return

}

logs.Infof("output is : %v", output)

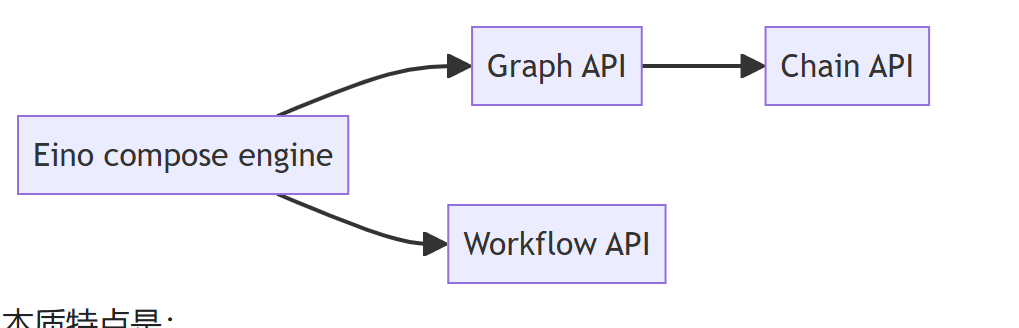

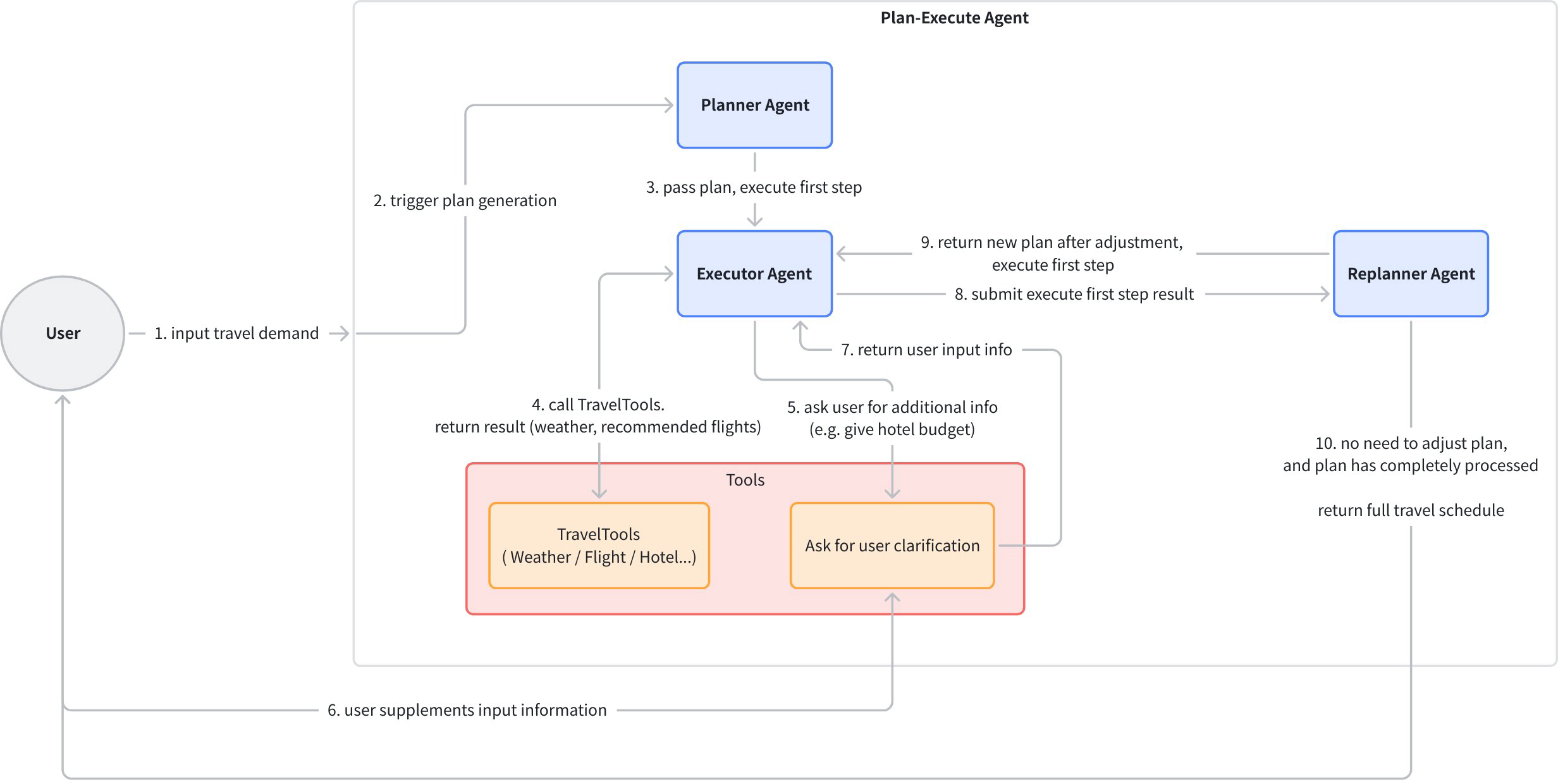

}workflow

是一套编排的 API,与 Graph API 在架构上处于同一层:

Eino compose engine

Graph API

Workflow API

Chain API

本质特点是:

-

与 Graph API 具有同等级别的能力,都是编排“围绕大模型的信息流”的合适框架工具。

-

在节点类型、流处理、callback、option、state、interrupt & checkpoint 等方面保持一致。

-

实现 AnyGraph 接口,可以在 AddGraphNode 时作为子图加入上级 Graph/Chain/Workflow。

-

也可以把其他 Graph/Chain/Workflow 添加为自己的子图。

-

-

字段级别映射能力:节点的输入可以由任意前驱节点的任意输出字段组合而成。

-

原生支持 struct,map 以及任意嵌套层级的 struct 和 map 之间的相互映射。

-

-

控制流与数据流分离:Graph 的 Edge 是既决定执行顺序,又决定数据传递。Workflow 中可以一起传递,也可以分开传递。

-

不支持环(即类似 react agent 的 chatmodel->toolsNode->chatmodel 的环路)。NodeTriggerMode 固定为 AllPredecessor。

灵活的输入输出类型

例如需要编排两个 lambda 节点,里面是两个“现存的业务函数 f1, f2”,输入输出类型都是符合业务场景的特定结构体,各自不一样:

Workflow 编排时,将 f1 的输出字段 F1,直接映射到 f2 的输入字段 F3,同时保留 f1,f2 的原始函数签名。达到的效果是:每个节点是“业务场景决定输入输出”,不需要考虑“谁给我输入,以及谁用我的输出”。

Graph 编排时,因为“类型对齐”的要求,如果 f1 -> f2,则 f1 的输出类型和 f2 的输入类型需要对齐,需要二选一:

-

定义一个新的 common struct,把 f1 的输出类型和 f2 的输入类型都改成这个 common struct。有成本,可能入侵业务逻辑。

-

f1 的输出类型和 f2 的输入类型都改成 map。丢失了强类型对齐的特性。

控制流和数据流分离

看下面这个场景:

节点 D 同时引用了 A、B、C 的某些输出字段。其中 A-D 的这条虚线,是单纯的“数据流”,不传递“控制”信息,即 A 执行完成与否,不决定 D 是否开始执行。

节点 D 到 E 之间的粗箭头,代表节点 E 不引用节点 D 的任何输出,是单纯的“控制流”,不传递“数据”。即 D 执行完成与否,决定 E 是否开始执行,但是 D 的输出不影响 E 的输入。

图中其他的线,是控制流与数据流合一的。

需要注意的是,数据流能传递的前提,是一定有一条控制流存在,比如 A->D 的数据流,依赖 A->branch->B->D 或者 A->branch->C->D 的控制流存在。即数据流只能引用前驱节点的输出。

例如这个“跨节点”传递特定数据的场景:

上图中,chat template 节点的输入可以是非常明确的:

map[string]any{"prompt": "prompt from START", "context": "retrieved context"}

相对的,如果使用 Graph 或者 Chain API,需要二选一:

-

用 OutputKey 转换节点输出类型(START 节点没法加,所以得额外加 passthrough 节点),ChatTemplate 节点的输入会包含 START 和 retriever 的全量输出(而不是真正需要的某几个字段).

-

START 节点的 prompt 放到 state 里面,ChatTemplate 从 state 中读。额外引入了 state。

如何使用 Workflow

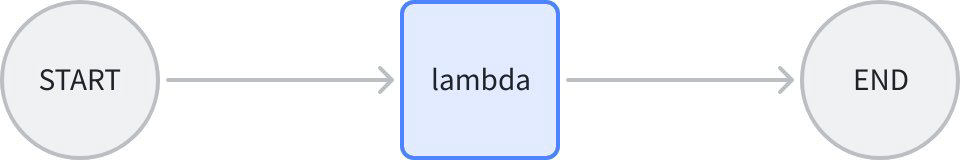

最简单的 workflow

START -> node -> END

// creates and invokes a simple workflow with only a Lambda node.

// Since all field mappings are ALL to ALL mappings

// (by using AddInput without field mappings),

// this simple workflow is equivalent to a Graph: START -> lambda -> END.

func main() {

// create a Workflow, just like creating a Graph

wf := compose.NewWorkflow[int, string]()

// add a lambda node to the Workflow, just like adding the lambda to a Graph

wf.AddLambdaNode("lambda", compose.InvokableLambda(

func(ctx context.Context, in int) (string, error) {

return strconv.Itoa(in), nil

})).

// add an input to this lambda node from START.

// this means mapping all output of START to the input of the lambda.

// the effect of AddInput is to set both a control dependency

// and a data dependency.

AddInput(compose.START)

// obtain the compose.END of the workflow for method chaining

wf.End().

// add an input to compose.END,

// which means 'using ALL output of lambda node as output of END'.

AddInput("lambda")

// compile the Workflow, just like compiling a Graph

run, err := wf.Compile(context.Background())

if err != nil {

logs.Errorf("workflow compile error: %v", err)

return

}

// invoke the Workflow, just like invoking a Graph

result, err := run.Invoke(context.Background(), 1)

if err != nil {

logs.Errorf("workflow run err: %v", err)

return

}

logs.Infof("%v", result)

}

核心的几个 API:

-

func NewWorkflow[I, O any](opts ...NewGraphOption) *Workflow[I, O]-

构建一个新的 Workflow。

-

与

NewGraph签名完全一致。

-

-

func (wf *Workflow[I, O]) AddChatModelNode(key string, chatModel model.BaseChatModel, opts ...GraphAddNodeOpt) *WorkflowNode-

向 Workflow 中添加一个新的节点。

-

可添加的节点类型与 Graph 完全一致。

-

与 Graph 的 AddXXXNode 的差异是,Workflow 不会立刻返回 error,而是在最终 Compile 的时候统一处理和返回 error。

-

AddXXXNode 拿到的是一个 WorkflowNode,后续向 Node 上添加字段映射等操作,直接用 Method Chaining 来做

-

-

func (n *WorkflowNode) AddInput(fromNodeKey string, inputs ...*FieldMapping) *WorkflowNode-

给一个 WorkflowNode 添加输入字段映射

-

返回 WorkflowNode,可继续 Method Chaining。

-

-

(wf *Workflow[I, O]) Compile(ctx context.Context, opts ...GraphCompileOption) (Runnable[I, O], error)-

Compile 一个 Workflow。

-

与 Compile Graph 的签名完全一致。

-

字段映射

START(输入 struct)-> [并行 lambda1, lambda2] -> END(输出 map)。

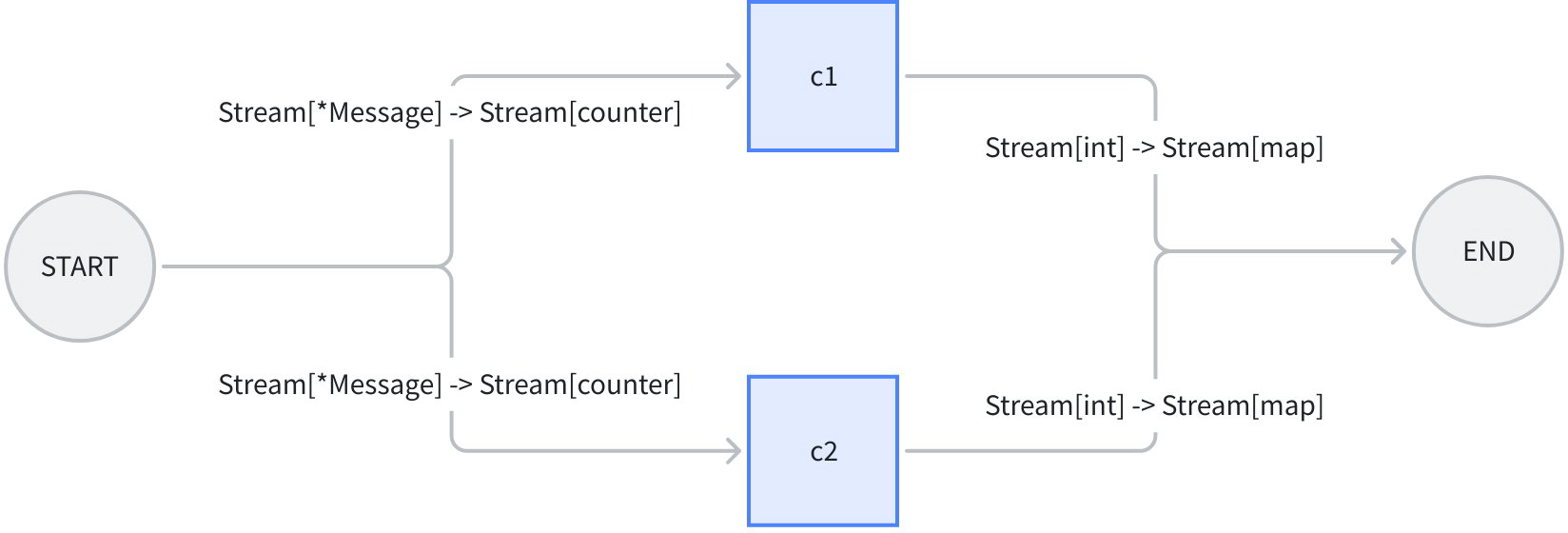

我们举一个“计算 string 中字符出现次数的”例子。workflow 整体输入一个 eino 的 Message 和一个 sub string,将 Message.Content 给一个计数器 c1,将 Message.ReasoningContent 给另一个计数器 c2,并行分别计算 sub string 的出现次数,再分别映射到 END:

上图中,workflow 整体的输入是 message 结构体,c1, c2 两个 lambda 的输入都是 counter 结构体,输出都是 int,workflow 整体输出是 map[string]any. 代码如下:

// demonstrates the field mapping ability of eino workflow.

func main() {

type counter struct {

FullStr string // exported because we will do field mapping for this field

SubStr string // exported because we will do field mapping for this field

}

// wordCounter is a lambda function that count occurrences of SubStr within FullStr

wordCounter := func(ctx context.Context, c counter) (int, error) {

return strings.Count(c.FullStr, c.SubStr), nil

}

type message struct {

*schema.Message // exported because we will do field mapping for this field

SubStr string // exported because we will do field mapping for this field

}

// create a workflow just like a Graph

wf := compose.NewWorkflow[message, map[string]any]()

// add lambda c1 just like in Graph

wf.AddLambdaNode("c1", compose.InvokableLambda(wordCounter)).

AddInput(compose.START, // add an input from START, specifying 2 field mappings

// map START's SubStr field to lambda c1's SubStr field

compose.MapFields("SubStr", "SubStr"),

// map START's Message's Content field to lambda c1's FullStr field

compose.MapFieldPaths([]string{"Message", "Content"}, []string{"FullStr"}))

// add lambda c2 just like in Graph

wf.AddLambdaNode("c2", compose.InvokableLambda(wordCounter)).

AddInput(compose.START, // add an input from START, specifying 2 field mappings

// map START's SubStr field to lambda c1's SubStr field

compose.MapFields("SubStr", "SubStr"),

// map START's Message's ReasoningContent field to lambda c1's FullStr field

compose.MapFieldPaths([]string{"Message", "ReasoningContent"}, []string{"FullStr"}))

wf.End(). // Obtain the compose.END for method chaining

// add an input from c1,

// mapping full output of c1 to the map key 'content_count'

AddInput("c1", compose.ToField("content_count")).

// also add an input from c2,

// mapping full output of c2 to the map key 'reasoning_content_count'

AddInput("c2", compose.ToField("reasoning_content_count"))

// compile the workflow just like compiling a Graph

run, err := wf.Compile(context.Background())

if err != nil {

logs.Errorf("workflow compile error: %v", err)

return

}

// invoke the workflow just like invoking a Graph

result, err := run.Invoke(context.Background(), message{

Message: &schema.Message{

Role: schema.Assistant,

Content: "Hello world!",

ReasoningContent: "I need to say something meaningful",

},

SubStr: "o", // would like to count the occurrences of 'o'

})

if err != nil {

logs.Errorf("workflow run err: %v", err)

return

}

logs.Infof("%v", result)

}

这个例子的主要信息是 AddInput 方法可以传递 0-n 个字段映射规则,同时可以多次调用 AddInput。这意味着:

-

节点可以从一个前驱节点的输出中引用任意多个字段。

-

节点可以从任意多个前驱节点中引用字段。

-

一个映射,可以是“整体到字段”,可以是“字段到整体”,也可以是“整体到整体”,也可以是嵌套字段间的映射。

-

上面不同的类型,有不同的 API 来表达这个映射:

-

顶层字段到顶层字段:

MapFields(string, string) -

全部输出到顶层字段:

ToField(string) -

顶层字段到全部输入:

FromField(string) -

嵌套字段到嵌套字段:

MapFieldPaths(FieldPath, FieldPath),只要上游或下游有一方是嵌套的,就需要用 -

全部输出到嵌套字段:

ToFieldPath(FieldPath) -

嵌套字段到全部输入:

FromFieldPath(FieldPath) -

全部输出到全部输入:直接使用

AddInput,不需要传FieldMapping

-

进阶功能

只有数据流,没有控制流

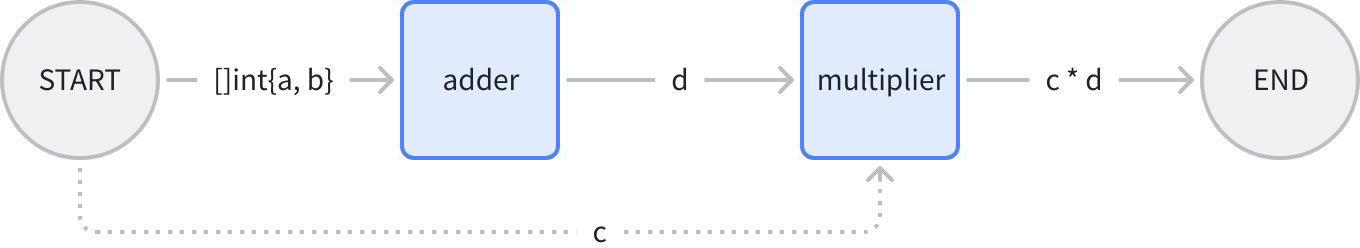

想象一个简单的场景:START -> 加法节点 -> 乘法节点 -> END。其中“乘法节点”是将 START 的一个字段和加法节点的结果相乘:

上图中,乘法节点在加法节点之后执行,即“乘法节点”被“加法节点”控制。但 START 节点不直接控制“乘法节点”,仅仅把数据传了过去。在代码中通过 AddInputWithOptions(fromNode, fieldMappings, WithNoDirectDependency) 来指定纯数据流:

func main() {

type calculator struct {

Add []int

Multiply int

}

adder := func(ctx context.Context, in []int) (out int, err error) {

for _, i := range in {

out += i

}

return out, nil

}

type mul struct {

A int

B int

}

multiplier := func(ctx context.Context, m mul) (int, error) {

return m.A * m.B, nil

}

wf := compose.NewWorkflow[calculator, int]()

wf.AddLambdaNode("adder", compose.InvokableLambda(adder)).

AddInput(compose.START, compose.FromField("Add"))

wf.AddLambdaNode("mul", compose.InvokableLambda(multiplier)).

AddInput("adder", compose.ToField("A")).

AddInputWithOptions(compose.START, []*compose.FieldMapping{compose.MapFields("Multiply", "B")},

// use WithNoDirectDependency to declare a 'data-only' dependency,

// in this case, START node's execution status will not determine whether 'mul' node can execute.

// START node only passes one field of its output to 'mul' node.

compose.WithNoDirectDependency())

wf.End().AddInput("mul")

runner, err := wf.Compile(context.Background())

if err != nil {

logs.Errorf("workflow compile error: %v", err)

return

}

result, err := runner.Invoke(context.Background(), calculator{

Add: []int{2, 5},

Multiply: 3,

})

if err != nil {

logs.Errorf("workflow run err: %v", err)

return

}

logs.Infof("%d", result)

}

这个例子中新引入的 API:

func (n *WorkflowNode) AddInputWithOptions(fromNodeKey string, inputs []*FieldMapping, opts ...WorkflowAddInputOpt) *WorkflowNode {

return n.addDependencyRelation(fromNodeKey, inputs, getAddInputOpts(opts))

}

以及新的 Option:

func WithNoDirectDependency() WorkflowAddInputOpt {

return func(opt *workflowAddInputOpts) {

opt.noDirectDependency = true

}

}

组合起来,可以给节点添加纯“数据依赖关系”。

只有控制流,没有数据流

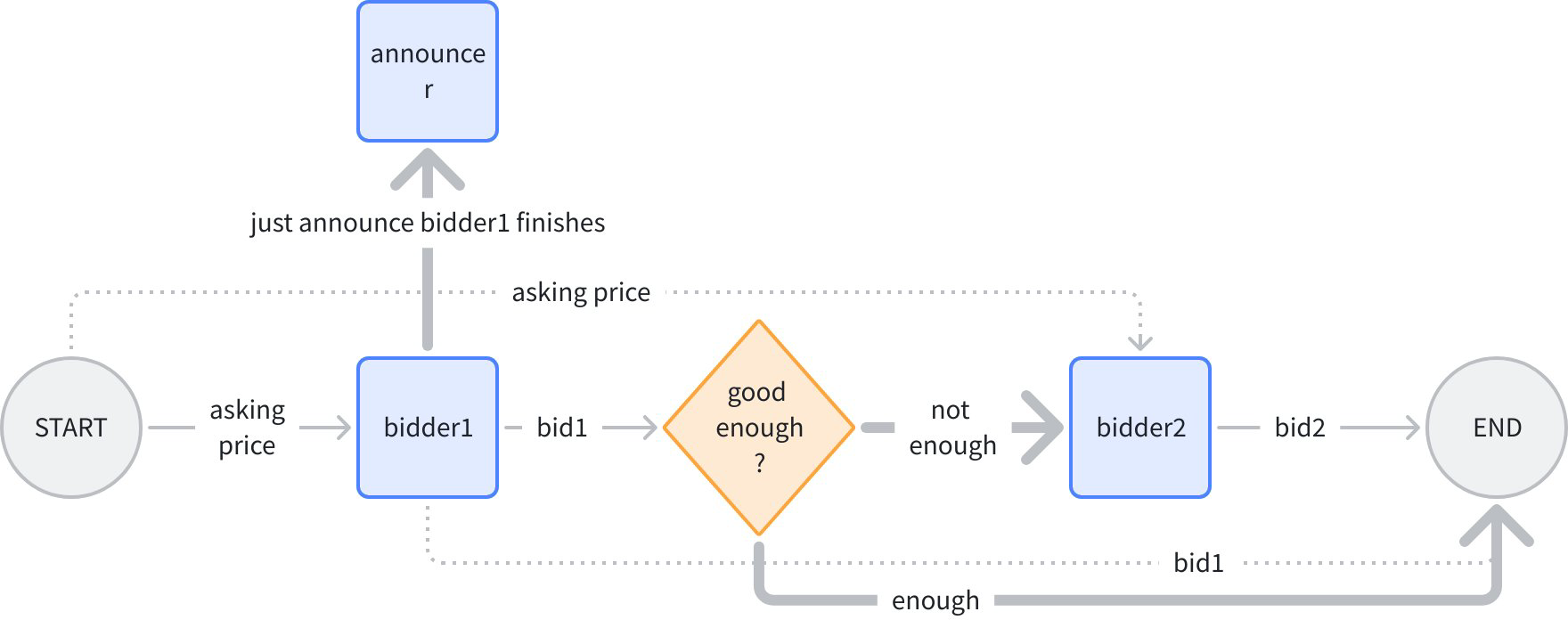

想象一个“依次竞拍,但报价保密”的场景:START -> 竞拍者 1 -> 是否达标 -> 竞拍者 2 -> END:

在上图中,普通连线是“控制 + 数据”,虚线是“只有数据”,加粗线是“只有控制”。逻辑是:输入一个初始价格,竞拍者 1 给出报价 1,分支判断是否足够高,如果足够高则直接结束,否则把初始价格再给到竞拍者 2,给出报价 2,最后将报价 1、2 汇总输出。

当竞拍者 1 给出报价后,发布公告”竞拍者完成竞拍“。注意 bidder1->announcer 是粗实线,“只有控制”,因为发布公告的时候需要对金额保密!

分支出来的两条加粗线,都是“只有控制”,因为无论 bidder2 还是 END,都不依赖分支给出数据。在代码中通过 AddDependency(fromNode) 来指定纯控制流:

func main() {

bidder1 := func(ctx context.Context, in float64) (float64, error) {

return in + 1.0, nil

}

bidder2 := func(ctx context.Context, in float64) (float64, error) {

return in + 2.0, nil

}

announcer := func(ctx context.Context, in any) (any, error) {

logs.Infof("bidder1 had lodged his bid!")

return nil, nil

}

wf := compose.NewWorkflow[float64, map[string]float64]()

wf.AddLambdaNode("b1", compose.InvokableLambda(bidder1)).

AddInput(compose.START)

// just add a node to announce bidder1 had lodged his bid!

// It should be executed strictly after bidder1, so we use `AddDependency("b1")`.

// Note that `AddDependency()` will only form control relationship,

// but not data passing relationship.

wf.AddLambdaNode("announcer", compose.InvokableLambda(announcer)).

AddDependency("b1")

// add a branch just like adding branch in Graph.

wf.AddBranch("b1", compose.NewGraphBranch(func(ctx context.Context, in float64) (string, error) {

if in > 5.0 {

return compose.END, nil

}

return "b2", nil

}, map[string]bool{compose.END: true, "b2": true}))

wf.AddLambdaNode("b2", compose.InvokableLambda(bidder2)).

// b2 executes strictly after b1 (through branch dependency),

// but does not rely on b1's output,

// which means b2 depends on b1 conditionally,

// but no data passing between them.

AddInputWithOptions(compose.START, nil, compose.WithNoDirectDependency())

wf.End().AddInput("b1", compose.ToField("bidder1")).

AddInput("b2", compose.ToField("bidder2"))

runner, err := wf.Compile(context.Background())

if err != nil {

logs.Errorf("workflow compile error: %v", err)

return

}

result, err := runner.Invoke(context.Background(), 3.0)

if err != nil {

logs.Errorf("workflow run err: %v", err)

return

}

logs.Infof("%v", result)

}

这个例子中引入的新 API:

func (n *WorkflowNode) AddDependency(fromNodeKey string) *WorkflowNode {

return n.addDependencyRelation(fromNodeKey, nil, &workflowAddInputOpts{dependencyWithoutInput: _true_})

}

可以通过 AddDependency 来给节点指定纯“控制依赖关系”。

分支(Branch)

在上面的例子中,我们用与 Graph API 几乎完全相同的方式添加了一个 branch:

// add a branch just like adding branch in Graph.

wf.AddBranch("b1", compose.NewGraphBranch(func(ctx context.Context, in float64) (string, error) {

if in > 5.0 {

return compose.END, nil

}

return "b2", nil

}, map[string]bool{compose.END: true, "b2": true}))

branch 语义与 Graph 的 AllPredecessor 模式下的 branch 语义相同:

-

有且只有一个’fromNode’,即一个 branch 的前置控制节点只能有一个。

-

可单选(NewGraphBranch),可多选(NewGraphMultiBranch)。

-

Branch 选中的分支,可执行。未选中的分支,标记为 skip。

-

一个节点,只有在所有入边都完成(成功或 skip),且至少有一条边成功时,这个节点才可以执行。(如上面例子中的 END)

-

如果一个节点的所有入边都是 skip,则这个节点的所有出边自动标为 skip。

同时,workflow branch 与 graph branch 有一个核心差异:

-

Graph branch 始终是“控制和数据合一的”,branch 下游节点的输入,一定是 branch fromNode 的输出。

-

Workflow branch 始终是“只有控制的”,branch 下游节点的输入,自行通过 AddInputWithOptions 的方式指定。

涉及到的新 API:

func (wf *Workflow[I, O]) AddBranch(fromNodeKey string, branch *GraphBranch) *WorkflowBranch {

wb := &WorkflowBranch{

fromNodeKey: fromNodeKey,

GraphBranch: branch,

}

wf.workflowBranches = append(wf.workflowBranches, wb)

return wb

}

与 Graph.AddBranch 签名几乎完全相同,可以给 workflow 添加一个分支。

静态值(Static Values)

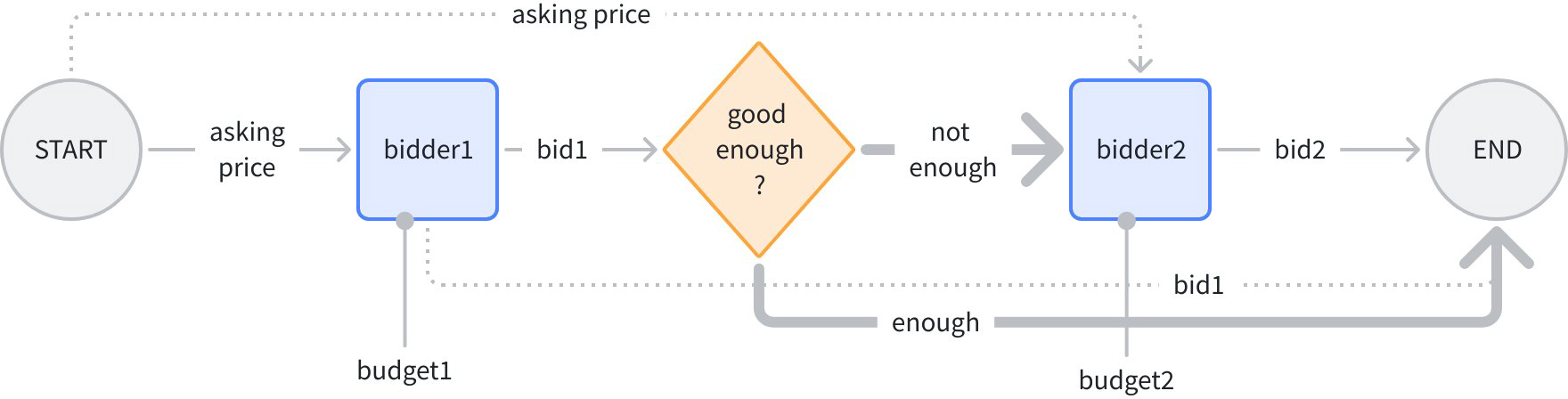

让我们修改下上面的“竞拍”例子,给竞拍者 1 和竞拍者 2 分别给一个“预算”的静态配置:

budget1 和 budget2 会分别以“静态值”的形式注入到 bidder1 和 bidder2 的 input 中。使用 SetStaticValue 方法给 workflow 节点配置静态值:

func main() {

type bidInput struct {

Price float64

Budget float64

}

bidder := func(ctx context.Context, in bidInput) (float64, error) {

if in.Price >= in.Budget {

return in.Budget, nil

}

return in.Price + rand.Float64()*in.Budget, nil

}

wf := compose.NewWorkflow[float64, map[string]float64]()

wf.AddLambdaNode("b1", compose.InvokableLambda(bidder)).

AddInput(compose.START, compose.ToField("Price")).

// set 'Budget' field to 3.0 for b1

SetStaticValue([]string{"Budget"}, 3.0)

// add a branch just like adding branch in Graph.

wf.AddBranch("b1", compose.NewGraphBranch(func(ctx context.Context, in float64) (string, error) {

if in > 5.0 {

return compose.END, nil

}

return "b2", nil

}, map[string]bool{compose.END: true, "b2": true}))

wf.AddLambdaNode("b2", compose.InvokableLambda(bidder)).

// b2 executes strictly after b1, but does not rely on b1's output,

// which means b2 depends on b1, but no data passing between them.

AddDependency("b1").

AddInputWithOptions(compose.START, []*compose.FieldMapping{compose.ToField("Price")}, compose.WithNoDirectDependency()).

// set 'Budget' field to 4.0 for b2

SetStaticValue([]string{"Budget"}, 4.0)

wf.End().AddInput("b1", compose.ToField("bidder1")).

AddInput("b2", compose.ToField("bidder2"))

runner, err := wf.Compile(context.Background())

if err != nil {

logs.Errorf("workflow compile error: %v", err)

return

}

result, err := runner.Invoke(context.Background(), 3.0)

if err != nil {

logs.Errorf("workflow run err: %v", err)

return

}

logs.Infof("%v", result)

}

这里涉及到的新 API:

func (n *WorkflowNode) SetStaticValue(path FieldPath, value any) *WorkflowNode {

n.staticValues[path.join()] = value

return n

}

通过这个方法给 Workflow 节点的指定字段上设置静态值。

流式效果

回到之前的“字符计数”例子,如果我们的 workflow 的输入不再是单个 message,而是一个 message 流,并且我们的计数函数可以对流中的每个 message chunk 分别计数并返回“计数流”:

我们对之前的例子做一些修改:

-

InvokableLambda 改成 TransformableLambda,从而可以消费流,并产生流。

-

把输入里面的 SubStr 改成静态值,注入到 c1 和 c2 中。

-

Workflow 的整体输入改成 *schema.Message。

-

以 Transform 方式来调用 workflow,并传入包含 2 个 *schema.Message 的流。

完成后的代码:

// demonstrates the stream field mapping ability of eino workflow.

// It's modified from 2_field_mapping.

func main() {

type counter struct {

FullStr string // exported because we will do field mapping for this field

SubStr string // exported because we will do field mapping for this field

}

// wordCounter is a transformable lambda function that

// count occurrences of SubStr within FullStr, for each trunk.

wordCounter := func(ctx context.Context, c *schema.StreamReader[counter]) (

*schema.StreamReader[int], error) {

var subStr, cachedStr string

return schema.StreamReaderWithConvert(c, func(co counter) (int, error) {

if len(co.SubStr) > 0 {

// static values will not always come in the first chunk,

// so before the static value (SubStr) comes in,

// we need to cache the full string

subStr = co.SubStr

fullStr := cachedStr + co.FullStr

cachedStr = ""

return strings.Count(fullStr, subStr), nil

}

if len(subStr) > 0 {

return strings.Count(co.FullStr, subStr), nil

}

cachedStr += co.FullStr

return 0, schema.ErrNoValue

}), nil

}

// create a workflow just like a Graph

wf := compose.NewWorkflow[*schema.Message, map[string]int]()

// add lambda c1 just like in Graph

wf.AddLambdaNode("c1", compose.TransformableLambda(wordCounter)).

AddInput(compose.START, // add an input from START, specifying 2 field mappings

// map START's Message's Content field to lambda c1's FullStr field

compose.MapFields("Content", "FullStr")).

// we can set static values even if the input will be stream

SetStaticValue([]string{"SubStr"}, "o")

// add lambda c2 just like in Graph

wf.AddLambdaNode("c2", compose.TransformableLambda(wordCounter)).

AddInput(compose.START, // add an input from START, specifying 2 field mappings

// map START's Message's ReasoningContent field to lambda c1's FullStr field

compose.MapFields("ReasoningContent", "FullStr")).

SetStaticValue([]string{"SubStr"}, "o")

wf.End(). // Obtain the compose.END for method chaining

// add an input from c1,

// mapping full output of c1 to the map key 'content_count'

AddInput("c1", compose.ToField("content_count")).

// also add an input from c2,

// mapping full output of c2 to the map key 'reasoning_content_count'

AddInput("c2", compose.ToField("reasoning_content_count"))

// compile the workflow just like compiling a Graph

run, err := wf.Compile(context.Background())

if err != nil {

logs.Errorf("workflow compile error: %v", err)

return

}

// call the workflow using Transform just like calling a Graph with Transform

result, err := run.Transform(context.Background(),

schema.StreamReaderFromArray([]*schema.Message{

{

Role: schema.Assistant,

ReasoningContent: "I need to say something meaningful",

},

{

Role: schema.Assistant,

Content: "Hello world!",

},

}))

if err != nil {

logs.Errorf("workflow run err: %v", err)

return

}

var contentCount, reasoningCount int

for {

chunk, err := result.Recv()

if err != nil {

if err == io.EOF {

result.Close()

break

}

logs.Errorf("workflow receive err: %v", err)

return

}

logs.Infof("%v", chunk)

contentCount += chunk["content_count"]

reasoningCount += chunk["reasoning_content_count"]

}

logs.Infof("content count: %d", contentCount)

logs.Infof("reasoning count: %d", reasoningCount)

}

基于上面这个例子,我们总结出 workflow 流式的一些特点:

-

依然是 100% 的 Eino stream:四种范式(invoke, stream, collect, transform),由 Eino 框架自动转换、复制、拼接、合并。

-

字段映射的配置,不需要特殊处理流:无论实际的输入输出是不是流,AddInput 的写法都一样,Eino 框架负责处理基于流的映射。

-

静态值,不需要特殊处理流:即使实际输入是个流,也可以一样的方式 SetStaticValue。Eino 框架会把静态值放在 input stream 中,但不一定是第一个读到的 chunk。

字段映射各场景

类型对齐

Workflow 遵循与 Graph 同一套类型对齐规则,只是对齐的粒度由完整的输入输出对齐,变为了映射成对的字段间的类型对齐。具体为:

-

类型完全相同,在 Compile 时会校验通过,一定能对齐。

-

类型不同,但上游可以 Assign 到下游(比如上游具体类型,下游 Any),在 Compile 时会校验通过,一定能对齐。

-

上游无法 Assign 到下游(比如上游 int,下游 string),在 Compile 时会报错。

-

上游可能能 Assign 到下游(比如上游 Any,下游 int),在 Compile 时无法确定,会推迟到执行时,取出上游的实际类型,再判断。此时如果判断上游不能 Assign 到下游,则会抛出 error。

Merge 的各场景

Merge 是指一个节点的输入映射自多个 FieldMapping 的情况。

-

映射到多个不同的字段:支持

-

映射到一个相同的字段:不支持

-

映射到整体,同时也有映射到字段:冲突,不支持

嵌套的 map[string]any

比如这个映射:ToFieldPath([]string{"a","b"}),目标节点的输入类型是 map[string]any,映射时的顺序是:

-

第一级“a”,此时的结果是

map[string]any{"a": nil} -

第二级“b”,此时的结果是

map[string]any{"a": map[string]any{"b": x}}

可以看到,在第二级的时候,Eino 框架自动把 any 替换为了实际的 map[string]any

CustomExtractor

有些场景,标准的字段映射语义无法支持,比如上游是 []int,想取出第一个元素映射到下游,此时我们用 WithCustomExtractor :

t.Run("custom extract from array element", func(t *testing.T) {

wf := NewWorkflow[[]int, map[string]int]()

wf.End().AddInput(_START_, ToField("a", WithCustomExtractor(func(input any) (any, error) {

return input.([]int)[0], nil

})))

r, err := wf.Compile(context.Background())

assert.NoError(t, err)

result, err := r.Invoke(context.Background(), []int{1, 2})

assert.NoError(t, err)

assert.Equal(t, map[string]int{"a": 1}, result)

})

当使用 WithCustomExtractor 时,一切 Compile 时的类型对齐校验都无法进行,只能推迟到执行时校验。

一些约束

-

Map Key 的限制:只支持 string,或者 string alias(能 convert 到 string 的类型)。

-

不支持的 CompileOption:

-

WithNodeTriggerMode,因为固定为AllPredecessor。 -

WithMaxRunSteps,因为不会有环。

-

-

如果映射来源是 Map Key,要求 Map 中必须有这个 key。但如果映射来源是 Stream,Eino 无法判断 stream 中的所有帧中是否至少有一次出现这个 key,因此 Stream 时无法校验。

-

如果映射来源字段或者目标字段属于 struct ,则要求这些字段必须是导出的,因为内部使用了反射。

-

映射来源是 nil:一般情况下支持,只有当映射目标不可能是 nil 时报错,比如目标是基础类型(int 等)。

实际应用

Coze-Studio 工作流

Coze-Studio 开源版的工作流引擎是基于 Eino Workflow 编排框架。参见:11. 新增工作流节点类型(后端)

流式编程编排

编排流式概述

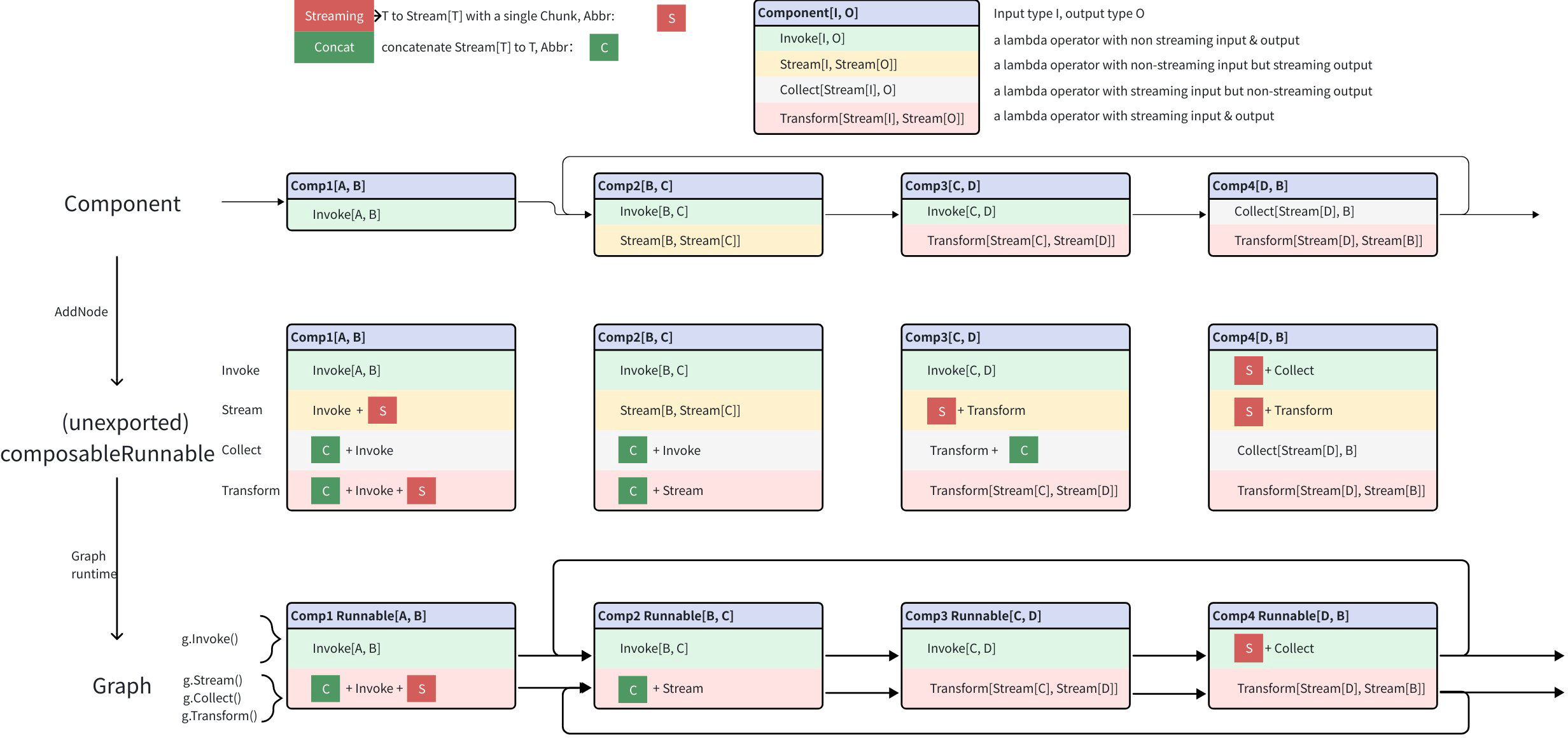

编排流式的 Graph 时,需要考虑的几个关键要素:

-

组件/Lambda 中包含哪几种 Lambda 算子: 从 Invoke、Stream、Collect、Transform 中任选

-

编排拓扑图中,上下游节点的输入、输出是否同为流或同为非流。

-

如果上下游节点的流类型无法匹配。 需要借助 流化、合包 两个操作

-

流化(Streaming):将 T 流化成单 Chunk 的 Stream[T]

-

合包(Concat):将 Stream[T] 合并成一个完整的 T。Stream[T] 中的每一“帧”是这个完整 T 的一部分。

-

Eino 流式编程的内涵

有的组件,天然支持分“帧”来输出,每次输出一个完整出参的一部分,即“流式”输出。流式输出完成后,需要下游把这些“帧”拼接(concat)成完整的出参。典型的例子,是 LLM。

有的组件,天然支持分“帧”来输入,接收到不完整的入参时,就能开始有意义的业务处理,甚至完成业务处理的过程。比如 react agent 中用来判断是调 tool 还是结束运行的 branch 里面,拿到 LLM 的流式输出,从第一个帧里面就可以通过判断 message 是否包含 tool call 来做出决策。

因此,一个组件,从入参角度看,有“非流式”入参和“流式”入参两种,从出参角度看,有“非流式”出参和“流式”出参两种。

组合起来,有四种可能的流式编程范式

|

函数名 |

模式说明 |

交互模式名称 |

Lambda 构造方法 |

说明 |

|

Invoke |

输入非流式、输出非流式 |

Ping-Pong 模式 |

compose.InvokableLambda() |

|

|

Stream |

输入非流式、输出流式 |

Server-Streaming 模式 |

compose.StreamableLambda() |

|

|

Collect |

输入流式、输出非流式 |

Client-Streaming |

compose.CollectableLambda() |

|

|

Transform |

输入流式、输出流式 |

Bidirectional-Streaming |

compose.TransformableLambda() |

单个组件角度的流式

Eino 是个 “component first” 的框架,组件可以独立使用。定组件接口的时候,需要考虑流式编程的问题吗?简单的答案是不需要。复杂的答案是“以业务真实场景为准”。

组件自身的业务范式

一个典型的组件,比如 Chat Model,Retriever 等,根据实际的业务语义定接口就行,如果实际上支持某种流式的范式,就实现那一种流式范式,如果实际上某种流式范式没有真正的业务场景,那就不需要实现。比如

-

Chat Model,除了 Invoke 这种非流式的范式外,还天然支持 Stream 这种流式范式,因此 Chat Model 的接口中,实现了 Generate 和 Stream 两个接口。但是 Collect 和 Transform 没有对应的真实业务场景,所以就没有实现相应的接口:

type ChatModel interface {

Generate(ctx context.Context, input []*schema.Message, opts ...Option) (*schema.Message, error)

Stream(ctx context.Context, input []*schema.Message, opts ...Option) (

*schema.StreamReader[*schema.Message], error)

// other methods omitted...

}

-

Retriever,除了 Invoke 这种非流式的范式外,另外三种流式范式都没有真实的业务场景,因此只实现了 Retrieve 一个接口:

type Retriever interface {

Retrieve(ctx context.Context, query string, opts ...Option) ([]*schema.Document, error)

}

组件具体支持的范式

|

组件名称 |

是否实现 Invoke |

是否实现 Stream |

是否实现 Collect |

是否实现 Transform |

|

Chat model |

yes |

yes |

no |

no |

|

Chat template |

yes |

no |

no |

no |

|

Retriever |

yes |

no |

no |

no |

|

Indexer |

yes |

no |

no |

no |

|

Embedder |

yes |

no |

no |

no |

|

Document Loader |

yes |

no |

no |

no |

|

Document Transformer |

yes |

no |

no |

no |

|

Tool |

yes |

yes |

no |

no |

Eino 官方组件中,除了 Chat Model 和 Tool 额外支持 stream 外,其他所有组件都只支持 invoke。组件具体介绍参见:[更新中]Eino: Components 抽象&实现

Collect 和 Transform 两种流式范式,目前只在编排场景有用到。

多个组件编排角度的流式

组件在编排中的流式范式

一个组件,单独使用时,入参和出参的流式范式是框定的,不可能超出组件定义的接口范围。

-

比如 Chat Model,入参只可能是非流式的 []Message,出参则可能是非流式的 Message 或者流式的 StreamReader[Message],因为 Chat Model 只实现了 Invoke 和 Stream 两个范式。

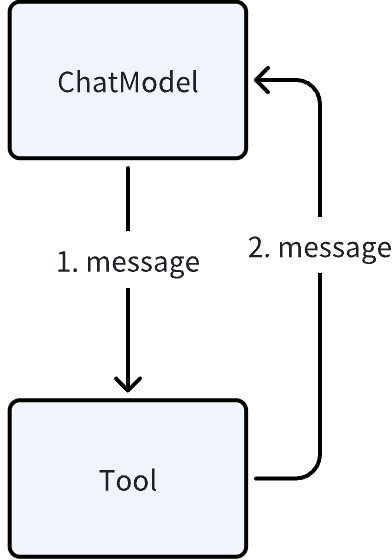

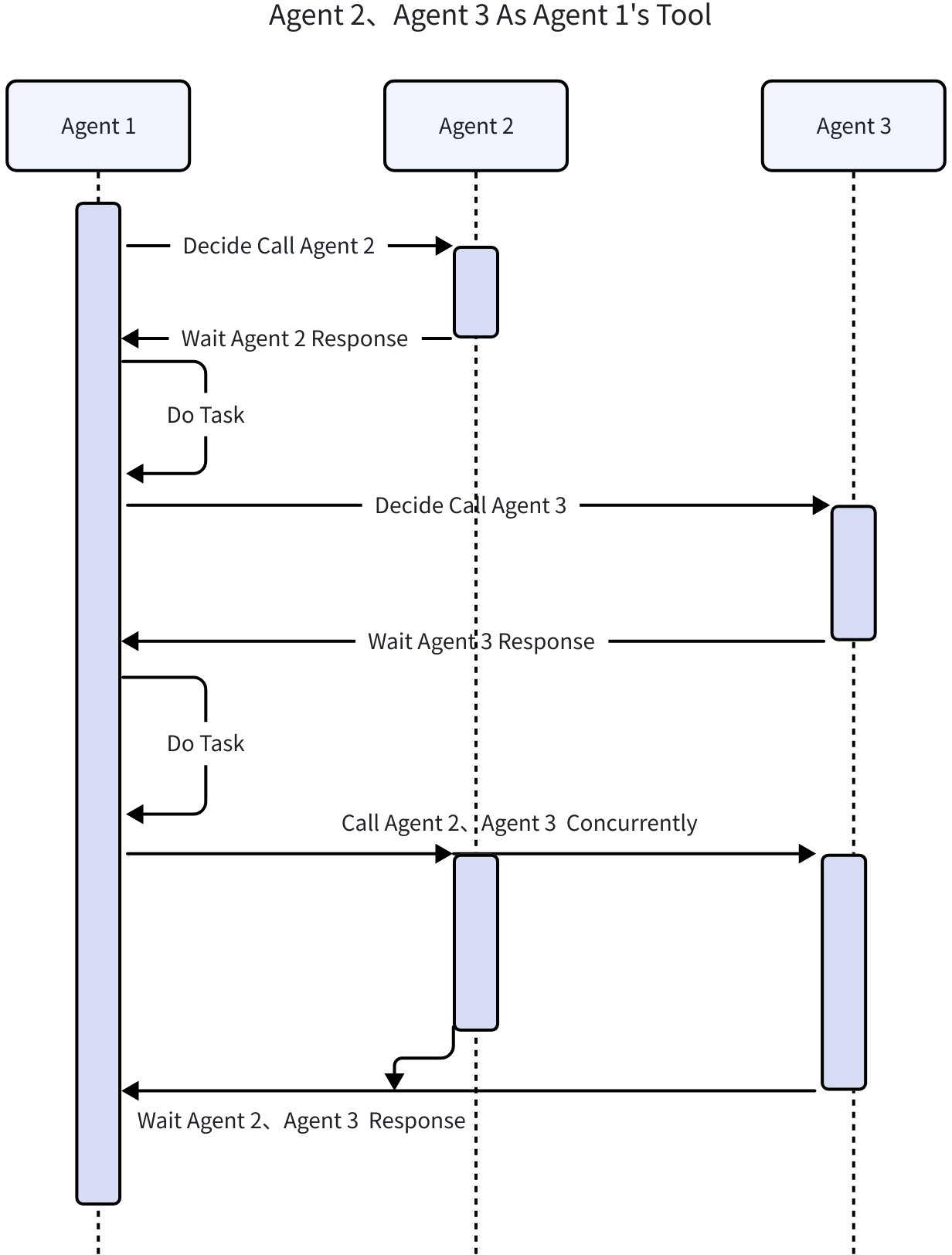

但是,一个组件,一旦处在多个组件组合使用的“编排”场景中,它的入参和出参就没那么固定了,而是取决于这个组件在编排场景中的“上游输出”和“下游输入”。比如 React Agent 的典型编排示意图:

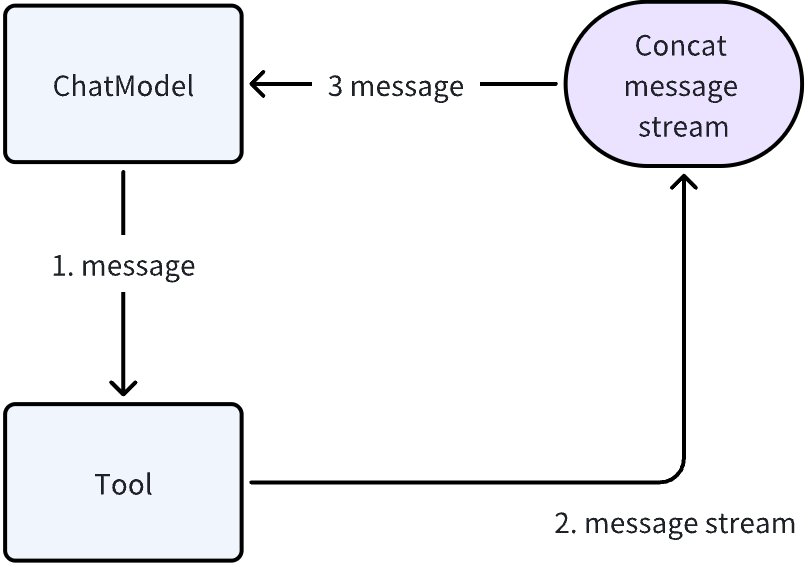

上图中,如果 Tool 是个 StreamableTool,也就是输出是 StreamReader[Message],则 Tool -> ChatModel 就可能是流式的输出。但是 Chat Model 并没有接收流式输入的业务场景,也没有对应的接口。这时 Eino 框架会自动帮助 ChatModel 补足接收流式输入的能力:

上面的 Concat message stream 是 Eino 框架自动提供的能力,即使不是 message,是任意的 T,只要满足特定的条件,Eino 框架都会自动去做这个 StreamReader[T] 到 T 的转化,这个条件是:在编排中,当一个组件的上游输出是 StreamReader[T],但是组件只提供了 T 作为输入的业务接口时,框架会自动将 StreamReader[T] concat 成 T,再输入给这个组件。

💡 框架自动将 StreamReader[T] concat 成 T 的过程,可能需要用户提供一个 Concat function。详见 Eino: 编排的设计理念 中关于“合并帧”的章节。

另一方面,考虑一个相反的例子。还是 React Agent,这次是一个更完整的编排示意图:

在上图中,branch 接收 chat model 输出的 message,并根据 message 中是否包含 tool call,来选择直接结束 agent 本次运行并将 message 输出,还是调用 Tool 并将调用结果再次给 Chat Model 循环处理。由于这个 Branch 可以通过 message stream 的首个帧就完成逻辑判断,因此我们给这个 Branch 定义的是 Collect 接口,即流式输入,非流式输出:

compose.NewStreamGraphBranch(func(ctx context.Context, sr *schema.StreamReader[*schema.Message]) (endNode string, err error) {

msg, err := sr.Recv()

if err != nil {

return "", err

}

defer sr.Close()

if len(msg.ToolCalls) == 0 {

return compose._END_, nil

}

return nodeKeyTools, nil

}

ReactAgent 有两个接口,Generate 和 Stream,分别实现了 Invoke 和 Stream 的流式编程范式。当一个 ReactAgent 以 Stream 的方式被调用时,Chat Model 的输出是 StreamReader[Message],因此 Branch 的输入是 StreamReader[Message],符合这个 Branch condition 的函数签名定义,不需要做任何的转换就可以运行。

但是,当这个 ReactAgent 以 Generate 的方式被调用时,Chat Model 的输出是 Message,因此 Branch 的输入也会是 Message,不符合 Branch Condition 的 StreamReader[Message] 的函数签名定义。这时,Eino 框架会自动将 Message 装箱成 StreamReader[Message],再传给 Branch,而这个 StreamReader 里面只会有一个帧。

💡 这种只有一个帧的流,俗称“假流”,因为它并没有带来流式的实际好处即“首包延迟低”,而是仅仅为了满足流式出入参接口签名的要求而做的简单装箱。

总结起来,就是:在编排中,当一个组件的上游输出是 T,但是组件只提供了 StreamReader[T] 作为输入的业务接口时,框架会自动将 T 装箱成 StreamReader[T] 的单帧流,再输入给这个组件。

编排辅助元素的流式范式

上面提到的 Branch,并不是一个可单独使用的组件,而是只在编排场景中才有意义的“编排辅助元素”,类似的仅编排场景有意义的“组件”,还有一些,详见下图:

|

组件名称 |

使用场景 |

是否实现 Invoke |

是否实现 Stream |

是否实现 Collect |

是否实现 Transform |

|

Branch |

根据上游输出,在一组下游 Node 中动态选择一个

|

yes |

no |

yes |

no |

|

StatePreHandler |

Graph中,进入 Node 前修改 State 或/与 Input。可支持流式。 |

yes |

no |

no |

yes |

|

StatePostHandler |

Graph中,Node 完成后修改 State 或/与 Output。可支持流式 |

yes |

no |

no |

yes |

|

Passthrough |

在并行情况下,为了打平每个并行分支的 Node 个数,可以给 Node 个数少的分支加 Passthrough 节点。Passthrough 节点的输入输出相同,跟随上游节点的输出或跟随下游节点的输入(预期应当相同)。 |

yes |

no |

no |

yes |

|

Lambda |

封装官方组件未定义的业务逻辑。业务逻辑是哪种范式,就选择对应的那种流式范式来实现。 |

yes |

yes |

yes |

yes |

另外还有一种只有编排场景才有意义的“组件”,就是把编排产物作为一个整体来看待,比如编排后的 Chain,Graph。这些整体的编排产物,既可以作为“组件”来单独调用,也可以作为节点加入到更上级的编排产物中。

编排整体角度的流式

编排产物的“业务”范式

既然整体的编排产物,可以被看做一个“组件”,那从组件的视角可以提出问题:编排产物这个“组件”,有没有像 Chat Model 等组件那样的,符合“业务场景”的接口范式?答案是既“有”也“没有”。

-

“没有”:整体而言,Graph,Chain 等编排产物,自身是没有业务属性的,只为抽象的编排服务的,因此也就没有符合业务场景的接口范式。同时,编排需要支持各种范式的业务场景。所以,Eino 中代表编排产物的 Runnable[I, O] 接口,不做选择也无法选择,提供了所有流式范式的方法:

type Runnable[I, O any] interface {

Invoke(ctx context.Context, input I, opts ...Option) (output O, err error)

Stream(ctx context.Context, input I, opts ...Option) (output *schema.StreamReader[O], err error)

Collect(ctx context.Context, input *schema.StreamReader[I], opts ...Option) (output O, err error)

Transform(ctx context.Context, input *schema.StreamReader[I], opts ...Option) (output *schema.StreamReader[O], err error)

}

-

“有”:具体而言,某一个具体的 Graph、Chain,一定是承载了具体的业务逻辑的,因此也就一定有适合那个特定业务场景的流式范式。比如类似 React Agent 的 Graph,匹配的业务场景是 Invoke 和 Stream,因此这个 Graph 在调用时,符合逻辑的调用方式是 Invoke 和 Stream。虽然编排产物本身接口 Runnable[I, O] 中有 Collect 和 Transform 的方法,但是正常的业务场景不需要使用。

编排产物内部各组件在运行时的范式

从另一个角度看,既然编排产物整体可以被看做“组件”,那“组件”必然有自己的内部实现,比如 ChatModel 的内部实现逻辑,可能是把入参的 []Message 转化成各个模型的 API request,之后调用模型的 API,获取 response 后再转化成出参的 Message。那么类比的话,Graph 这个“组件”的内部实现是什么?是数据在 Graph 内部各个组件间以用户指定的流转方向和流式范式来流转。其中,“流转方向”不在当前讨论范围内,而各组件运行时的流式范式,则由 Graph 整体的触发方式决定,具体来说:

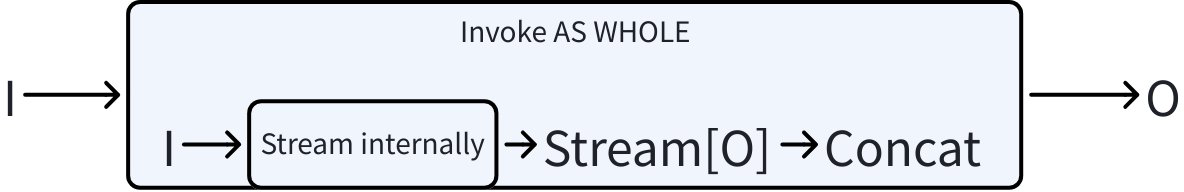

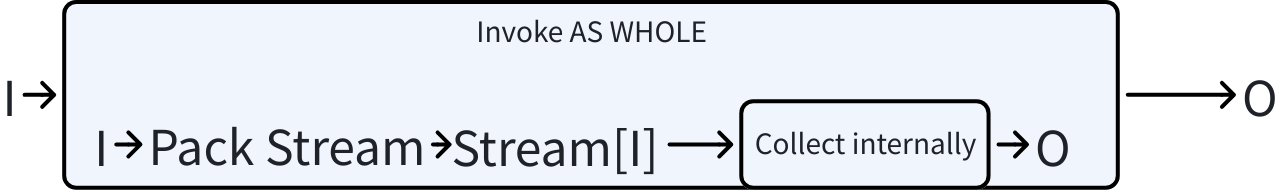

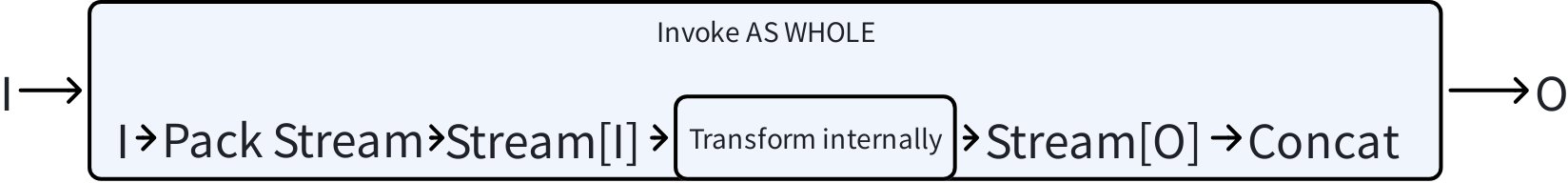

如果用户通过 Invoke 来调用 Graph,则 Graph 内部所有组件都以 Invoke 范式来调用。如果某个组件,没有实现 Invoke 范式,则 Eino 框架自动根据组件实现了的流式范式,封装出 Invoke 调用范式,优先顺位如下:

-

若组件实现了 Stream,则将 Stream 封装成 Invoke,即自动 concat 输出流。

-

否则,若组件实现了 Collect,则将 Collect 封装成 Invoke,即非流式入参转单帧流。

-

如果都没实现,则必须实现 Transform,将 Transform 封装成 Invoke,即入参转单帧流,出参 concat。

如果用户通过 Stream/Collect/Transform 来调用 Graph,则 Graph 内部所有组件都以 Transform 范式来调用。如果某个组件,没有实现 Transform 范式,则 Eino 框架自动根据组件实现了的流式范式,封装出 Transform 调用范式,优先顺位如下:

-

若组件实现了 Stream,则将 Stream 封装成 Transform,即自动 concat 输入流。

-

否则,若组件实现了 Collect,则将 Collect 封装成 Transform,即非流式出参转单帧流。

-

如果都没实现,则必须实现 Invoke,将 Invoke 封装成 Transform,即入参流 concat,出参转单帧流

结合上面穷举的各种案例,Eino 框架对 T 和 Stream[T] 的自动转换,可以总结为:

-

T -> Stream[T]: 将完整的 T 装箱为单帧的 Stream[T]。非流式变假流式。

-

Stream[T] -> T: 将 Stream[T] Concat 为完整的 T。当 Stream[T] 不是单帧流时,可能需要提供针对 T 的 Concat 方法。

看了上面的实现原理,可能会有疑问,为什么对 graph 的 Invoke,会要求所有内部组件都以 Invoke 调用?以及为什么对 graph 的 Stream/Collect/Transform,会要求所有内部组件都以 Transform 调用?毕竟,可以举出一些反例:

-

A, B 两个组件编排为一个 Chain,以 Invoke 调用。其中 A 的业务接口实现了 Stream,B 的业务接口实现了 Collect。这时 graph 内部组件的调用范式有两个选择:

-

A 以 stream 调用,B 以 collect 调用,整体的 Chain 依然是 Invoke 语义,同时保留了真流式的内部语义。即 A 的输出流不需要做 Concat,可以实时的输入到 B 中。

-

目前 Eino 的实现,A、B 都以 Invoke 调用,需要把 A 的输出流 Concat,并把 B 的输入做成假流式。失去了真流式的内部语义。

-

-

A,B 两个组件编排为一个 Chain,以 Collect 调用。其中 A 实现了 Transform 和 Collect,B 实现了 Invoke。两个选择:

-

A 以 Collect 调用,B 以 Invoke 调用:整体还是 Collect 的语义,不需要框架做任何的自动转化和装箱操作。

-

目前 Eino 的实现,A、B 都以 Transform 调用,由于 A 的业务接口里实现了 Transform,因此 A 的输出和 B 的输入都可能是真流式,而 B 的业务接口里只实现了 Invoke,根据上面的分析,B 的入参会需要由真流式 concat 成非流式。这时就需要用户额外提供 B 的入参的 concat 函数,这本可以避免。

-

上面两个例子,都可以找到一个明确的、与 Eino 的约定不同的,但却更优的流式调用路径。但是,当泛化到任意的编排场景时,很难找到一个明确定义的、与 Eino 的约定不同的、却总是更优的普适的规则。比如,A->B->C,以 Collect 语义调用,是 A->B 的时候 Collect,还是 B->C 的时候 Collect?潜在的因素有 A、B、C 具体实现的业务接口,可能还有“尽量多的使用真流式”的判断,也许还有哪个参数实现了 Concat,哪个没有实现。如果是更复杂的 Graph,需要考虑的因素会快速增加。在这种情况下,即使框架能定义出一套明确的、更优的普适规则,也很难解释清楚,理解和使用成本会很高,很可能已经超过了这个新规则实际带来的好处。

综上,我们可以说,Eino 编排产物内部各组件在运行时的范式,是 By Design 的,明确如下:

-

整体以 Invoke 调用,内部各组件均以 Invoke 调用,不存在任何流式的过程。

-

整体以 Stream/Collect/Transform 调用,内部各组件均以 Transform 调用,当出现 Stream[T] -> T 的 concat 过程时,可能需要额外提供 T 的 concat function。

callback&& calloption

callback治理

解决的问题

Component(包括 Lambda)、Graph 编排共同解决“把业务逻辑定义出来”的问题。而 logging, tracing, metrics, 上屏展示等横切面性质的功能,需要有机制把功能注入到 Component(包括 Lambda)、Graph 中。

另一方面,用户可能想拿到某个具体 Component 实现的执行过程中的中间信息,比如 VikingDBRetriever 额外给出查询的 DB Name,ArkChatModel 额外给出请求的 temperature 等参数。需要有机制把中间状态透出。

Callbacks 支持“横切面功能注入”和“中间状态透出”,具体是:用户提供、注册“function”(Callback Handler),Component 和 Graph 在固定的“时机”(或者说切面、位点)回调这些 function,给出对应的信息。

核心概念

核心概念串起来,就是:Eino 中的 Component 和 Graph 等实体,在固定的时机 (Callback Timing),回调用户提供的 function (Callback Handler),并把自己是谁 (RunInfo),以及当时发生了什么 (Callback Input & Output) 传出去。

触发实体

Component(包括官方定义的组件类型和 Lambda),Graph Node(以及 Chain/Workflow Node),Graph 自身(以及 Chain/Workflow)。这三类实体,都有横切面功能注入、中间状态透出的需求,因此都会触发 callback。具体见下面的“触发方式”一节。

触发时机

// CallbackTiming enumerates all the timing of callback aspects.

type CallbackTiming = callbacks.CallbackTiming

const (

TimingOnStart CallbackTiming = iota // 进入并开始执行

TimingOnEnd // 成功完成即将 return

TimingOnError // 失败并即将 return err

TimingOnStartWithStreamInput // OnStart,但是输入是 StreamReader

TimingOnEndWithStreamOutput // OnEnd,但是输出是 StreamReader

)

不同的触发实体,在不同场景下,是触发 OnStart 还是 OnStartWithStreamInput (OnEnd/OnEndWithStreamOutput 同理),具体的规则,详见下面的“触发方式”一节。

Callback Handler

type Handler interface {

OnStart(ctx context.Context, info *RunInfo, input CallbackInput) context.Context

OnEnd(ctx context.Context, info *RunInfo, output CallbackOutput) context.Context

OnError(ctx context.Context, info *RunInfo, err error) context.Context

OnStartWithStreamInput(ctx context.Context, info *RunInfo,

input *schema.StreamReader[CallbackInput]) context.Context

OnEndWithStreamOutput(ctx context.Context, info *RunInfo,

output *schema.StreamReader[CallbackOutput]) context.Context

}

一个 Handler 是一个实现了上面 5 个方法(对应 5 个触发时机)的结构体。每个方法都会接收三个信息:

-

Context: 用于接收同一个 Handler 的前序触发时机可能设置的定制信息。

-

RunInfo: 触发回调的实体元信息。

-

Input/Output/InputStream/OutputStream: 触发回调时的业务信息。

并都会返回新的 Context:用于同一个 Handler 的不同触发时机之间传递信息。

如果一个 Handler,不想关注所有的 5 个触发时机,只想关注一部分,比如只关注 OnStart,建议使用 NewHandlerBuilder().OnStartFn(...).Build()。如果不想关注所有的组件类型,只想关注特定组件,比如 ChatModel,建议使用 NewHandlerHelper().ChatModel(...).Handler(),可以只接收 ChatModel 的回调并拿到一个具体类型的 CallbackInput/CallbackOutput。具体见“Handler 实现方式”一节。

不同 Handler 之间,触发顺序没有保证。

RunInfo

描述了触发 Callback 的实体自身的元信息。

// RunInfo contains information about the running component that triggers callbacks.

type RunInfo struct {

Name string // the 'Name' with semantic meaning for the running component, specified by end-user

Type string // the specific implementation 'Type' of the component, e.g. 'OpenAI'

Component components.Component // the component abstract type, e.g. 'ChatModel'

}

-

Name:有业务含义的名称,需用户指定,不指定就是空字符串。对不同的触发实体:

-

Component:在 Graph 中时,用 Node Name。在 Graph 外单独的使用时,用户手动设置。详见“注入 RunInfo” 和 “单独使用 Component”

-

Graph Node:用 Node Name

func WithNodeName(n string) GraphAddNodeOpt -

Graph 自身:

-

顶层图用 Graph Name

func WithGraphName(graphName string) GraphCompileOption -

内部嵌套图,会用加入到上级图时添加的 Node Name

-

-

-

Type:组件具体实现来规定:

-

有接口的 Component:如果实现了 Typer 接口,用 GetType() 方法的结果。否则用反射获取 Struct/Func 名。

-

Lambda:如果用

func WithLambdaType(t string) LambdaOpt指定了 Type,用这个,否则是空字符串。 -

Graph Node:用内部 Component/Lambda/Graph 的值。

-

Graph 自身:空字符串。

-

-

Component:

-

有接口的 Component:是啥接口,就是啥

-

Lambda:固定值 Lambda

-

Graph Node: 用内部的 Component/Lambda/Graph 的值。

-

Graph 自身:固定值 Graph / Chain / Workflow. (之前曾有 StateGraph / StateChain ,现已整合到 Graph / Chain 中)

-

Callback Input & Output

本质是任意类型,因为不同的 Component 的输入输出、内部状态完全不同。

type CallbackInput any

type CallbackOutput any

具体到某个组件,有更具体的类型,比如 Chat Model

// CallbackInput is the input for the model callback.

type CallbackInput struct {

// Messages is the messages to be sent to the model.

Messages []*schema.Message

// Tools is the tools to be used in the model.

Tools []*schema.ToolInfo

// Config is the config for the model.

Config *Config

// Extra is the extra information for the callback.

Extra map[string]any

}

// CallbackOutput is the output for the model callback.

type CallbackOutput struct {

// Message is the message generated by the model.

Message *schema.Message

// Config is the config for the model.

Config *Config

// TokenUsage is the token usage of this request.

TokenUsage *TokenUsage

// Extra is the extra information for the callback.

Extra map[string]any

}

在 Chat Model 的具体实现,比如 OpenAI Chat Model 中,建议组件作者向 Callback Handler 中传入具体的 Input/Output 类型,而不是 Any。这样可以透出更具体的、定制化的中间状态信息。

如果是 Graph Node 来触发 Callback,因为 Node 拿不到组件内部中间状态信息,只能拿到组件接口中规定的输入和输出,所以给 Callback Handler 的只能是这些。对 Chat Model,就是 []*schema.Message 和 *schema.Message。

Graph 自身触发 Callback 时,输入输出就是 Graph 整体的输入和输出。

注入 Handler

Handler 需要注入到 Context 中才能被触发。

全局注入 Handler

通过 callbacks.AppendGlobalHandlers 注入全局的 Handler。注入后,所有的触发回调行为,都会自动触发这些全局的 Handler。典型的场景是 tracing,logging 等全局一致、业务场景无关的功能。

不是并发安全的。建议在服务初始化时注入一次。

向 Graph 中注入 Handler

通过 compose.WithCallbacks 在 graph 运行时注入 Handler,这些 Handler 会在 graph 的本次运行整体上生效,包括 Graph 内各 Node 和 Graph 自身(以及各内嵌的 graph)。

通过 compose.WithCallbacks(...).DesignateNode(...) 向顶层 Graph 的某个 Node 注入 Handler。当这个 Node 自身是个内嵌的 Graph 时,会注入到这个内嵌 Graph 自身和其内部的各 Node。

通过 compose.WithCallbacks(...).DesignateNodeWithPath(...) 向内部嵌套的 Graph 的某个 Node 注入 Handler。

在 Graph 外注入 Handler

不想使用 Graph,但却想使用 Callback,则:

通过 InitCallbacks(ctx context.Context, info *RunInfo, handlers ...Handler) 获取一个新的 Context 并注入 Handlers 以及 RunInfo。

Handler 继承

与子 Context 继承父 Context 中的所有 Values 相同,子 Context 也会继承父 Context 中的所有 Handlers。举个例子,Graph 运行时传入的 Context 中如果已经有了 Handler,则这些 Handlers 都会被整个 Graph 的这次运行继承和生效。

注入 RunInfo

RunInfo 也需要注入到 Context 中,才会在触发回调时给到 Handler。

Graph 托管 RunInfo

Graph 会为内部所有的 Node 自动注入 RunInfo。机制是每个 Node 的运行,都是一个新的子 Context,Graph 向这个新的 Context 中注入对应 Node 的 RunInfo。

在 Graph 外注入 RunInfo

不想使用 Graph,但却想使用 Callback,则:

通过 InitCallbacks(ctx context.Context, info *RunInfo, handlers ...Handler) 获取一个新的 Context 并注入 Handlers 以及 RunInfo。

通过 ReuseHandlers(ctx context.Context, info *RunInfo) 来获取一个新的 Context,复用之前 Context 中的 Handler,并设置新的 RunInfo。

触发方式

组件实现内部触发(Component Callback)

在组件实现的代码中,调用 callbacks 包中的 OnStart(), OnEnd(), OnError(), OnStartWithStreamInput(), ``OnEndWithStreamOutput``()。以 Ark 的 ChatModel 实现为例,在 Generate 方法中:

func (cm *ChatModel) Generate(ctx context.Context, in []*schema.Message, opts ...fmodel.Option) (

outMsg *schema.Message, err error) {

defer func() {

if err != nil {

_ = callbacks.OnError(ctx, err)

}

}()

// omit multiple lines... instantiate req conf

ctx = callbacks.OnStart(ctx, &fmodel.CallbackInput{

Messages: in,

Tools: append(cm.rawTools), // join tool info from call options

ToolChoice: nil, // not support in api

Config: reqConf,

})

// omit multiple lines... invoke Ark chat API and get the response

_ = callbacks.OnEnd(ctx, &fmodel.CallbackOutput{

Message: outMsg,

Config: reqConf,

TokenUsage: toModelCallbackUsage(outMsg.ResponseMeta),

})

return outMsg, nil

}

在 Stream 方法中:

func (cm *ChatModel) Stream(ctx context.Context, in []*schema.Message, opts ...fmodel.Option) ( // byted_s_too_many_lines_in_func

outStream *schema.StreamReader[*schema.Message], err error) {

defer func() {

if err != nil {

_ = callbacks.OnError(ctx, err)

}

}()

// omit multiple lines... instantiate req conf

ctx = callbacks.OnStart(ctx, &fmodel.CallbackInput{

Messages: in,

Tools: append(cm.rawTools), // join tool info from call options

ToolChoice: nil, // not support in api

Config: reqConf,

})

// omit multiple lines... make request to Ark API and convert response stream to StreamReader[model.*CallbackOutput]

_, sr = callbacks.OnEndWithStreamOutput(ctx, sr)

return schema.StreamReaderWithConvert(sr,

func(src *fmodel.CallbackOutput) (*schema.Message, error) {

if src.Message == nil {

return nil, schema.ErrNoValue

}

return src.Message, nil

},

), nil

}

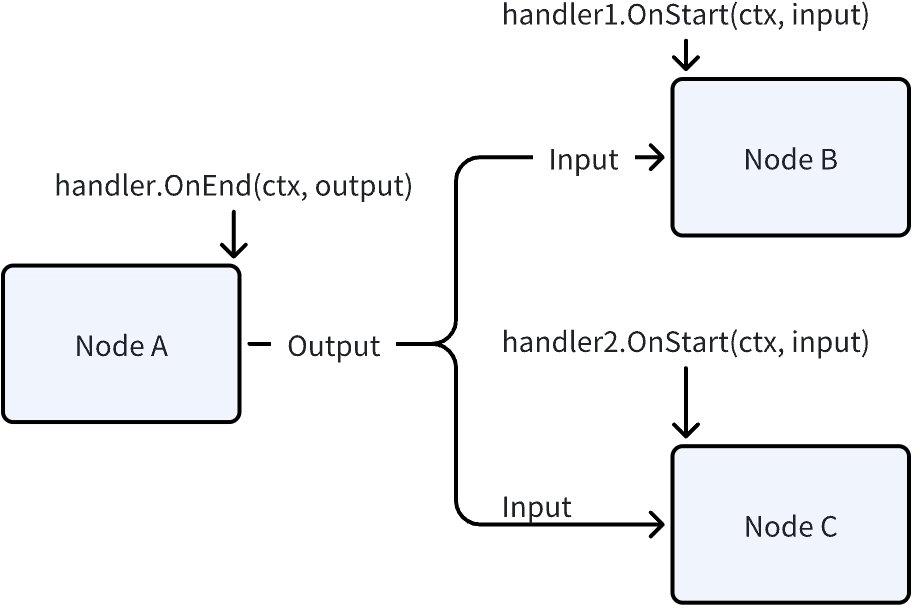

可以看到 Generate 调用时,触发的是 OnEnd,而 Stream 调用时,触发的是 OneEndWithStreamOutput:

组件实现内部触发 Callbacks 时:

-

当组件输入为 StreamReader 时,触发 OnStartWithStreamInput,否则触发 OnStart

-

当组件输出为 StreamReader 时,触发 OnEndWithStreamOutput,否则触发 OnEnd

内部实现了 callback 触发的组件,应当实现 Checker 接口,IsCallbacksEnabled 返回 true,向外部传达“我内部实现了 callback 触发”的信息:

// Checker tells callback aspect status of component's implementation

// When the Checker interface is implemented and returns true, the framework will not start the default aspect.

// Instead, the component will decide the callback execution location and the information to be injected.

type Checker interface {

IsCallbacksEnabled() bool

}

如果一个组件实现,没有实现 Checker 接口,或者 IsCallbacksEnabled 返回 false,可以认为该组件内部没有触发回调,需要 Graph Node 来负责注入和触发(在 Graph 内使用时)。

Graph Node 触发(Node Callback)

当一个 Component 被编排入 Graph 时,成为一个 Node。这时,如果 Component 自身会触发 callback,Node 就复用 Component 的 callback 处理。否则,Node 会在 Component 外面埋上 callback handler 触发点位。这些点位与 Component 自身的流式范式对应。比如一个 ChatModelNode,会在 Generate 方法外面埋上 OnStart/OnEnd/OnError,同时会在 Stream 方法外面埋上 OnStart/OnEndWithStreamOutput/OnError。

在 Graph 运行时,各组件会以 Invoke 或 Transform 范式运行,又会根据组件具体实现的业务流式范式,调用对应的组件方法。比如 Graph 以 Invoke 运行,Chat Model Node 会以 Invoke 运行,调用 Generate 方法。而当 Graph 以 Stream 运行,Chat Model Node 会以 Transform 运行,但 Chat Model 的业务流式范式中没有 Transform,会自动降级成调用 Stream 方法。因此:

Graph Node 具体触发哪个位点(OnStart 还是 OnStartWithStreamInput),取决于组件实现的业务流式范式和 Graph 运行方式两个因素。

关于 Eino 流式编程的详细介绍,参见 Eino 流式编程要点

Graph 自身触发(Graph Callback)

Graph 在自身的开始、结束、err 的时机触发 Callback Handler。如果 Graph 以 Invoke 形式调用,触发 OnStart/OnEnd/OnError。如果以 Stream/Collect/Transform 形式调用,触发 OnStartWithStreamInput/OnEndWithStreamOutput/OnError。这是因为 Graph 内部会始终以 Invoke 或 Transform 执行。参见 Eino 流式编程要点

值得注意的是:graph 也是 component 的一种,因此 graph callback 也是 component callback 的一种特殊形式。根据 Node Callback 的定义,当 Node 内部的 component 实现了对触发时机的感知和处理时,Node 会直接复用 Component 的实现,不会再实现 Node Callback。这意味着当一个 graph 通过 AddGraphNode 的方式加入到另外一个 Graph 中作为一个 Node 时,这个 Node 会复用内部 graph 的 graph callback。

解析 Callback Input & Output