从 0 到 1 构建你的第一个 AI Agent 项目——完整实战指南

【AI 开发】从 0 到 1 构建你的第一个 AI Agent 项目(2026 最新实战指南)

摘要

想做一个能写进简历的 AI Agent 项目,但不知道从哪开始?本文从项目选择、架构设计、技术选型到落地表达,给你一套完整的方法论。避开"纯 API 套壳"和"教程复刻"的坑,做出真正能体现能力的作品。适合 AI 开发者、求职者、技术爱好者阅读。

一、先回答一个问题:什么样的 Agent 项目值得做

很多人做 AI 项目有个误区:觉得功能越多越好、技术越新越好。但面试官关心的不是"你做了什么",而是"你为什么这样做"。

1.1 好项目的 5 个标准

标准一:能说明真实问题

好项目最好不是"为了做而做",而是有明确场景:

- 个人知识库问答:解决信息检索效率问题

- 团队文档检索:解决知识沉淀问题

- 代码审查辅助:解决 Code Review 成本问题

- 数据分析助手:解决重复性分析工作

💡 提示:面试时,能清晰说明"为什么要做这个项目"比"做了什么功能"更重要。

标准二:能体现关键能力

项目不一定要大,但要能映射能力:

| 项目类型 | 体现的能力 |

|---|---|

| RAG 项目 | 检索、分块、召回、答案引用 |

| Agent 项目 | 工具调用、流程设计、状态管理 |

| 工程化项目 | 部署、评估、监控、权限设计 |

标准三:能被讲清楚

面试里最常见的问题不是"你做过吗",而是:

- 为什么这样设计?

- 为什么不用别的方案?

- 遇到什么问题?

- 你怎么验证效果?

标准四:有取舍,不是功能乱堆

真正好的项目有清晰边界:

- 核心用户是谁

- 核心问题是什么

- 先解决哪一层问题

- 哪些功能是暂时不做的

标准五:能留下证据

项目最好能留下可验证的东西:

- GitHub 仓库

- README 文档

- 架构图

- 在线 Demo

- 截图/录屏

- 指标对比

1.2 哪些项目不太值得写进简历

❌ 纯 API 套壳项目:调一个模型 API 做聊天框,没有检索、没有流程、没有设计思考

❌ 完全照教程复刻的项目:和公开教程一模一样,讲不出自己做了什么改动

❌ 只能演示"能跑"的项目:没有设计理由,为什么用这个向量库?为什么这样切 chunk?为什么加 rerank?

二、AI Agent 的核心架构详解

理解 Agent 的本质,才能设计出有深度的项目。

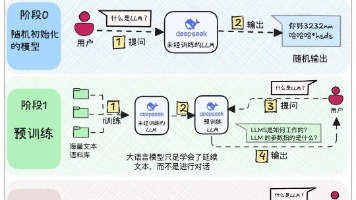

2.1 核心公式

Agent = LLM + 规划 + 记忆 + 工具使用

2.2 Agent 与传统 API 的区别

| 对比维度 | 传统 API | AI Agent |

|---|---|---|

| 输入输出 | 固定格式 | 灵活理解自然语言 |

| 执行逻辑 | 预定义 | 自主推理决策 |

| 功能范围 | 单一功能 | 多步骤任务编排 |

| 调用方式 | 被动调用 | 主动规划执行 |

2.3 三大核心组件

组件一:规划 (Planning)

任务分解示例:

目标:"分析某公司财务状况"

↓

步骤 1:搜索公司最新财报

步骤 2:提取关键财务指标

步骤 3:计算增长率、利润率

步骤 4:与同行业对比

步骤 5:生成分析报告

常见规划方法:

1. Chain of Thought (CoT)

- 适用场景:简单推理任务

- 格式:问题 → 思考步骤 1 → 思考步骤 2 → ... → 答案

2. Tree of Thoughts (ToT)

- 适用场景:复杂决策任务

- 格式:多思路并行探索,选择最优路径

3. ReAct (Reason + Act)

- 适用场景:工具调用场景

- 格式:推理与行动交替进行

组件二:记忆 (Memory)

记忆分类体系:

记忆

├── 短期记忆 (上下文窗口)

├── 长期记忆

│ ├── 程序性记忆 (技能)

│ └── 陈述性记忆 (事实)

│ ├── episodic (经历)

│ └── semantic (知识)

记忆实现方式:

方式 1:向量数据库

- 工具:Chroma、Pinecone、Milvus

- 用途:存储历史对话和知识

方式 2:摘要压缩

- 方法:定期将长对话压缩成摘要

- 好处:节省上下文空间

方式 3:知识图谱

- 方法:用结构化方式存储实体关系

- 用途:复杂推理场景

组件三:工具使用 (Tool Use)

Function Calling 示例代码:

tools = [

{

"type": "function",

"function": {

"name": "search_web",

"description": "搜索网络获取信息",

"parameters": {

"type": "object",

"properties": {

"query": {

"type": "string",

"description": "搜索关键词"

}

},

"required": ["query"]

}

}

}

]

三、实战案例:从 0 构建知识库问答 Agent

下面用一个具体案例,演示完整的项目构建流程。

3.1 项目定位

业务场景:团队内部文档太多,新人找不到资料,老人重复回答问题

项目目标:做一个能回答团队文档相关问题的 Agent

核心功能清单:

- 上传文档(PDF、Markdown、Word)

- 自动解析并建立索引

- 自然语言问答

- 答案带引用来源

3.2 技术选型对比

| 组件 | 推荐选型 | 选型理由 |

|---|---|---|

| LLM | Qwen/GLM | 中文能力强,成本低 |

| 向量库 | Chroma | 轻量、易部署、支持本地 |

| Embedding | bge-large-zh | 中文语义理解好 |

| 框架 | LangChain/LlamaIndex | 生态成熟,文档丰富 |

| 前端 | Streamlit/Gradio | 快速原型,适合 Demo |

3.3 核心代码结构

project/

├── app.py # 主应用入口

├── agent/

│ ├── __init__.py

│ ├── planner.py # 规划模块

│ ├── memory.py # 记忆模块

│ └── tools.py # 工具模块

├── rag/

│ ├── __init__.py

│ ├── loader.py # 文档加载

│ ├── splitter.py # 文本分块

│ ├── embedder.py # 向量化

│ └── retriever.py # 检索模块

├── config.py # 配置管理

└── requirements.txt

3.4 关键实现步骤

步骤 1:文档加载与分块

from langchain.text_splitter import RecursiveCharacterTextSplitter

def load_and_split(file_path):

# 根据文件类型选择加载器

if file_path.endswith('.pdf'):

loader = PyPDFLoader(file_path)

elif file_path.endswith('.md'):

loader = TextLoader(file_path, encoding='utf-8')

documents = loader.load()

# 递归分块,保持语义完整

splitter = RecursiveCharacterTextSplitter(

chunk_size=500,

chunk_overlap=50,

separators=["\n\n", "\n", "。", "!", "?", " ", ""]

)

chunks = splitter.split_documents(documents)

return chunks

💡 提示:为什么 chunk_size=500?

- 太小:语义不完整,检索质量差

- 太大:包含噪声多,影响答案精度

- 500 字左右是中文场景的经验值

步骤 2:向量化与存储

from langchain.vectorstores import Chroma

from langchain.embeddings import HuggingFaceEmbeddings

def create_vectorstore(chunks, persist_dir="./chroma"):

embeddings = HuggingFaceEmbeddings(

model_name="BAAI/bge-large-zh-v1.5",

model_kwargs={'device': 'cpu'},

encode_kwargs={'normalize_embeddings': True}

)

vectorstore = Chroma.from_documents(

documents=chunks,

embedding=embeddings,

persist_directory=persist_dir

)

return vectorstore

步骤 3:检索与答案生成

def answer_question(vectorstore, question, llm):

# 检索相关文档

docs = vectorstore.similarity_search(question, k=3)

# 构建带上下文的 prompt

context = "\n\n".join([d.page_content for d in docs])

prompt = f"""基于以下资料回答问题:

{context}

问题:{question}

要求:

1. 只根据资料回答,不知道就说不知道

2. 标注引用来源(如:[文档 1])

3. 答案简洁清晰

"""

# 调用 LLM 生成答案

response = llm.generate(prompt)

# 返回答案和引用

return {

"answer": response,

"sources": [d.metadata.get('source', '未知') for d in docs]

}

四、项目优化与评估方法

做出 Demo 只是第一步,如何证明你的项目是"好用"的?

4.1 评估指标体系

指标 1:答案准确率

- 方法:人工标注 50 个测试问题

- 计算:答案正确的比例

- 目标:>80%

指标 2:检索召回率

- 方法:检查检索到的文档是否包含答案所需信息

- 目标:>90%

指标 3:响应时间

- 方法:从提问到返回答案的总耗时

- 目标:<3 秒(不含 LLM 生成时间)

指标 4:用户满意度

- 方法:邀请 5-10 人试用,收集反馈

- 记录:"有用/无用"评价

4.2 常见问题与优化方案

问题 1:答案不准确

优化方案:

- 检查分块策略(chunk_size 是否合理)

- 尝试加 rerank 重排序

- 优化 prompt,增加约束条件

问题 2:检索不到相关内容

优化方案:

- 检查 Embedding 模型是否适合中文

- 增加检索数量(k 从 3 调到 5)

- 尝试混合检索(关键词 + 向量)

问题 3:响应太慢

优化方案:

- 向量库加索引

- 用更小的 Embedding 模型

- 缓存常见问题答案

五、面试时如何讲这个项目

项目做完了,怎么在面试里讲出价值?

5.1 推荐讲述结构

第一步:背景(30 秒)

"我们团队有 50+ 产品文档,新人入职找不到资料,老人每天重复回答类似问题。我做了一个知识库问答 Agent,自动回答文档相关问题。"

第二步:设计(1 分钟)

"核心是 RAG 架构:文档加载→分块→向量化→检索→答案生成。选型上用了 Chroma 向量库和 bge 中文 Embedding,因为..."

第三步:难点(1 分钟)

"最大的挑战是答案准确率。一开始只有 60%,后来做了三件事:调整分块策略、加 rerank 重排序、优化 prompt 约束,提升到 85%。"

第四步:结果(30 秒)

"现在团队 80% 的常见问题能自动回答,新人上手时间从 2 周缩短到 3 天。代码开源在 GitHub,有 50+ Star。"

5.2 准备这些问题的答案

面试前准备好以下问题的回答:

- 为什么选这个向量库?

- 分块大小怎么确定的?

- 如何评估效果?

- 如果重来一次,会做什么改进?

六、延伸:让项目更有竞争力

如果想让项目更出彩,可以考虑这些进阶方向:

方向 1:增加多轮对话能力

- 记录对话历史

- 支持追问和澄清

方向 2:增加工具调用

- 支持搜索最新信息

- 支持调用内部 API

方向 3:增加评估系统

- 自动化测试集

- 持续监控答案质量

方向 4:工程化部署

- Docker 容器化

- API 接口封装

- 权限控制

总结

做一个能写进简历的 AI Agent 项目,关键不是"用了多少技术",而是"解决了什么问题"和"怎么思考的"。

从真实场景出发,用清晰的设计解决问题,留下可验证的成果——这样的项目,面试时自然能讲出价值。

📂 开源项目地址:AgentInterview 持续更新 AI 面试与成长知识库,觉得有用请点个 Star ⭐ 支持一下!

🔍 关注公众号「开源情报局」,获取更多开源好项目,扫码进交流群

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)