爆肝整理|AI工程化全景指南:从实验室模型到工业级分层架构,新手也能落地

本文系统梳理AI工程化的核心理念、8层分层架构与落地实践,适合希望将AI能力引入生产系统的工程师和架构师参考。

一、什么是AI工程化?——打破"模型即系统"的认知误区

1.1 核心本质

当前业界存在一个普遍误区:认为接入一个强大的大语言模型(LLM)就等于拥有了具备商业价值的AI系统。这是绝大多数项目止步于Demo阶段的根本原因。

模型(Model)≠ 系统(System)

以汽车制造作类比:

- 模型是"发动机":提供核心动力,但发动机本身无法带你到达目的地。

- 工程化是"整车制造":底盘设计、制动系统、燃油供应(数据流)、仪表盘(监控)、安全气囊(容错与合规)——只有这些组件有机结合,才能构成一辆能在复杂路况下安全行驶的工业级车辆。

AI工程化是将AI研究成果转化为稳定、可维护、可扩展、可观测的生产系统的工程学科,核心工程维度包括:

| 维度 | 说明 |

|---|---|

| 可靠性 | 高可用、容错、优雅降级 |

| 可维护性 | 模块化、配置化、支持热更新 |

| 可扩展性 | 水平扩展、流量弹性 |

| 可观测性 | 全链路追踪、指标采集、实时告警 |

| 安全合规性 | 输入过滤、权限校验、数据脱敏 |

1.2 AI Engineering 与 ML Engineering 的区别

参考 Chip Huyen 在《AI Engineering》中的定义:

-

AI Engineering(AI工程):以现有基础模型(Foundation Models)为服务(MaaS),在其之上构建智能应用。关注点在于应用编排、工具集成、Prompt管理、RAG等上层能力。代表工具:LangChain、LlamaIndex、LangGraph、AutoGen。

-

ML Engineering(机器学习工程):关注模型本身的训练、微调、评估与部署。需要一定的算法和数学基础。代表工具:Hugging Face Transformers、vLLM、Axolotl。

两者并非对立,工业实践中往往需要协同:ML Engineering 产出并维护基础模型能力,AI Engineering 在此之上构建面向业务的应用系统。

二、核心演进:从"实验原型"到"工业级系统",差在哪?

从实验原型到工业级系统的跨越,本质是软件质量属性的全面升级。实验原型追求"跑通效果",工业级系统追求"长期稳健运行"。

| 维度 | 实验原型 | 工业级系统 |

|---|---|---|

| 调用方式 | 单次调用,手动触发 | 多轮交互 + 自动化流程编排,支持链式/并行调用 |

| Prompt管理 | 硬编码静态字符串 | 动态模板 + 上下文感知 + 版本管理 |

| 模型使用 | 独立模型,依赖自身参数记忆 | 工具集成 + RAG增强 + 多智能体协作 |

| 系统边界 | 模型即系统,逻辑单一无扩展 | 模型为组件,含编排、反馈与自愈回路 |

| 稳定性 | 偶尔失败可接受,依赖手动干预 | 高可用、容错、重试 + 优雅降级 |

| 可维护性 | 代码混乱、无文档、难回滚 | 模块化 + DSL配置化 + 支持热更新 |

| 可观测性 | 黑盒运行,无过程记录 | 全链路追踪 + 指标采集 + 实时告警 |

| 安全性 | 无防护,易受提示词注入攻击 | 输入过滤 + 敏感词检测 + 权限校验 |

| 性能 | 延迟高、吞吐低、资源利用率差 | 缓存 + 批处理优化(vLLM)+ 并发异步 |

三、AI工程化的核心:8层工业级分层架构

AI系统难以落地,核心原因之一是缺乏系统化的架构设计。参考类似OSI网络模型的分层思想,将AI系统划分为8个职责清晰的层次,实现松耦合——底层硬件或模型升级时,上层业务逻辑无需全量重构。

8层架构总览:

第1层:基础设施层(Infrastructure Layer)——算力的"地基"

系统的物理根基,决定性能上限,是一切上层能力的承载底座。

核心组件:

- 计算与调度:Kubernetes 负责容器化编排与弹性伸缩;vLLM / NVIDIA Triton 提供高性能并行推理。vLLM 的 PagedAttention 技术通过优化 KV Cache 的内存分配,可显著提升吞吐量,降低推理延迟。

- 存储:对象存储(AWS S3 / 阿里云 OSS)用于存储训练数据与模型文件;向量数据库(Pinecone / Weaviate / Qdrant / Milvus)存储 Embedding 索引,支撑 RAG 检索;关系型数据库存储结构化业务数据。

- 网络:多节点训练或推理场景下,RDMA 低延迟协议可减少节点间通信开销,避免网络成为性能瓶颈。

关键决策: 初期优先选择云服务托管方案(如 AWS SageMaker、阿里云 PAI-EAS),降低运维成本;规模扩大后再评估自建集群的必要性。

第2层:模型与通信层(Model & Communication Layer)——智能体的"连接纽带"

原文将此层命名为"代理互联网层",但该表述并非业界标准概念,且将向量存储(Embedding Stores)与 Agent 通信机制混为一谈。本文将其拆解为更准确的"模型与通信层",保留8层数量不变。

本层负责模型能力的统一接入与多智能体间的通信基础设施,是实现多 Agent 协同的连接基础。

核心组件:

- Embedding 服务:将文本、图像等非结构化数据转化为向量表示,存储于 Pinecone / Weaviate / Qdrant,为上层 RAG 检索提供基础索引能力。

- 模型路由与负载均衡:在多模型部署场景下,根据请求类型、成本、延迟要求,动态路由至最合适的模型实例(如 GPT-4o 处理复杂推理,轻量模型处理简单分类)。

- Agent 通信基础设施:多 Agent 场景下,需要支持 Agent 之间的身份识别、消息传递和状态同步。可基于消息队列(Kafka / RabbitMQ)或 RPC 框架实现,是编排层"Orchestrator-Workers"模式的底层支撑。

工具参考:LiteLLM(统一多模型 API 接口)、Kafka(高吞吐消息队列)、Redis(轻量状态同步)。

第3层:协议层(Protocol Layer)——标准化的"沟通语言"

确保不同系统、不同厂商的模型与工具能够协同工作,类比 HTTP 协议在 Web 中的作用——有了统一的语言,才能避免重复建设和厂商锁定。

核心协议:

- MCP(Model Context Protocol,模型上下文协议):由 Anthropic 于2024年底提出的开放标准协议,定位是规范"模型与外部工具/资源"之间的连接方式,类似 AI 领域的"USB 接口"。MCP 支持工具的标准化描述与动态发现,工具服务商只需实现一次 MCP Server,即可被所有支持 MCP 的模型调用。目前已有大量第三方工具完成 MCP 适配,生态快速扩展。

- A2A(Agent-to-Agent Protocol):由 Google 主导推进的 Agent 间通信协议,专注于规范不同 Agent 之间的任务委托、结果传递和状态同步,与 MCP 定位互补——MCP 解决模型与工具的连接,A2A 解决 Agent 与 Agent 的协作。

- OpenAI Function Calling 规范:目前已成为事实标准,绝大多数主流模型(GPT、Claude、Gemini、Llama)均兼容此格式,是工具调用的基础互操作层。

落地意义:在构建企业级 AI 平台时,优先选择遵循标准协议的工具链,可显著降低后期迁移和扩展成本。

第4层:工具与增强层(Tool & Augmentation Layer)——让模型从"聊天"变"行动"

突破模型自身的知识边界和行动能力边界,是实现业务价值落地的核心层。

4.1 RAG(检索增强生成)

解决模型知识时效性差、领域知识不足的问题。完整的 RAG 工程链路包含:

- 数据处理:文档解析(PDF、Word、HTML 等格式)→ 分块策略(Chunking,需权衡块大小与语义完整性)→ Embedding 生成 → 写入向量数据库

- 检索策略:向量相似度检索(Dense Retrieval)与关键词检索(BM25)的混合检索(Hybrid Search),通常优于单一方式;可进一步引入 **Reranker(交叉编码器重排序)**提升召回质量

- 后处理:引用溯源(确保输出可追溯到原始文档)、结果过滤、答案融合

推荐工具:LlamaIndex(RAG 场景更成熟)、LangChain。

4.2 Tool Calling 与 MCP 对比

工具调用赋予模型执行外部操作的能力(查询数据库、调用 API、执行代码等)。传统 Tool Calling 与 MCP 各有适用场景:

| 维度 | 传统 Tool Calling | MCP |

|---|---|---|

| 工具定义方式 | 开发者在代码中手动定义函数签名 | 标准协议,工具通过 MCP Server 自描述 |

| 工具发现 | 静态,需预先配置 | 动态发现,运行时查询可用工具 |

| 部署位置 | 本地或内网,完全可控 | 可部署于第三方服务器 |

| 数据安全 | 数据不出域,完全可信 | 需审慎评估第三方服务的数据处理策略 |

| 适用场景 | 内部系统、敏感数据场景 | 跨系统、跨厂商生态集成 |

| 生态现状 | 成熟,各主流模型均支持 | 快速发展,第三方工具生态持续扩大 |

选型建议:涉及内部敏感数据,优先使用传统 Tool Calling;需要接入丰富的第三方生态,可引入 MCP,但需建立对 MCP Server 的安全审计机制。

第5层:认知与推理层(Cognition & Reasoning Layer)——系统的"大脑中枢"

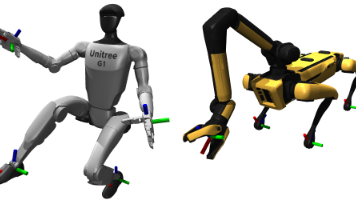

负责任务分解、路径规划与多步骤协同,是 Agentic 系统的核心,通过流程引擎实现6种主要编排模式:

| 编排模式 | 说明 | 典型场景 |

|---|---|---|

| Prompt Chaining(提示词链) | 顺序链式调用,上一步输出作为下一步输入 | 文案生成、代码开发、多步骤文档处理 |

| Routing(路由) | 根据输入分类,路由至不同模型或处理流程 | 用户意图分类、多领域客服分流 |

| Parallelization(并行化) | 并发调用多个模型或工具,汇聚结果 | 多维度数据分析、竞品对比报告生成 |

| Orchestrator-Workers(编排者-工作者) | 主控 Agent 拆解任务,分配给专属 Worker Agent 执行 | 多 Agent 协作的复杂业务流程 |

| Evaluator-Optimizer(评估器-优化器) | 生成-评估-优化闭环,迭代至满足质量阈值 | 文案优化、代码调试、方案评审 |

| Autonomous Agent(自主智能体) | 感知环境、自主决策、执行行动、反馈学习 | 自动化运维、智能巡检、科研任务 |

推荐框架:LangGraph(图结构编排,原生支持循环和条件分支,适合复杂 Agentic 流程)、AutoGen(对话式多 Agent 场景)、CrewAI(角色化多 Agent 协作)。

第6层:记忆与个性化层(Memory & Personalization Layer)——让AI"记住"用户

解决 LLM 无状态(Stateless)的天然局限,实现跨轮次、跨会话的上下文感知和个性化服务。

记忆类型体系:

- 工作记忆(Working Memory):当前会话的上下文窗口,确保单次对话的连贯性。注意 Token 限制,超长对话需通过摘要压缩(Summarization)管理上下文长度。

- 情节记忆(Episodic Memory):存储历史会话片段,可通过向量检索按需召回相关历史,实现跨会话的上下文感知。

- 语义记忆(Semantic Memory):存储用户偏好、领域知识等结构化信息,支持个性化响应。落地方案:向量数据库存储偏好向量 + 关系型数据库存储结构化用户档案。

- 程序性记忆(Procedural Memory):存储成功的任务执行路径和 Prompt 模板,用于复用和加速,减少重复的推理开销。

实现建议:短期工作记忆使用内存或 Redis;长期记忆使用向量数据库(Pinecone / Weaviate)结合关系型数据库的组合方案。

第7层:应用层(Application Layer)——价值落地的"最后一公里"

用户直接接触的界面和业务逻辑层,是工程化价值的最终体现。

典型应用场景:

- 企业知识库助手:RAG + 权限管控 + 引用溯源,解决内部文档检索效率问题

- 智能客服 Agent:意图识别 + 多轮对话管理 + 工单系统集成 + 人工介入兜底(Human-in-the-Loop)

- 代码助手:代码生成 + 静态分析工具集成 + 单元测试自动化

- 数据分析 Agent:自然语言转 SQL + 图表生成 + 报告输出

- 自动化流程 Agent:跨系统 API 调用 + 异常处理 + 审计日志(如 Slack/Discord 机器人、自动化运维)

- 搜索增强智能体:实时联网检索 + 信息综合归纳 + 来源引用

落地原则:从单一、高价值、边界清晰的场景切入,充分验证后再扩展。避免一开始就构建过于复杂的多 Agent 系统,复杂性应随业务需求逐步演进。

第8层:观测与治理层(Observability & Governance Layer)——系统的"保险丝"

贯穿全部8层的横切关注点,是系统从 Demo 走向 Production 最容易被忽视、也最不能忽视的一层。建议在系统搭建之初就同步部署,而非等到出现问题再补。

核心能力:

- 全链路追踪:记录每次推理的完整调用链,包括输入输出、耗时、Token 消耗、工具调用详情、中间推理步骤。工具:LangSmith、LangFuse(开源可自托管)、OpenTelemetry。

- 指标监控与告警:实时监测延迟(P50/P95/P99)、吞吐量、错误率、模型漂移指标;设置阈值告警,异常时自动触发通知。工具:Prometheus + Grafana。

- 成本管理:按场景、按用户、按模型追踪 API 调用成本,支持预算上限告警,避免成本失控。

- 质量评估 Pipeline:构建自动化评估体系(LLM-as-Judge + 黄金测试集 + 人工抽检),持续监测输出质量,驱动 Prompt 和模型的迭代优化。

- 安全与合规:

- 输入过滤:检测提示词注入(Prompt Injection)、敏感信息泄露风险

- 输出过滤:敏感词检测、PII(个人身份信息)脱敏

- 访问控制:基于角色的权限管理(RBAC)

- 审计日志:满足 GDPR、等保2.0等合规要求,所有 AI 决策过程留存可查

四、三大核心落地痛点与解决方案

痛点1:数据安全与隐私泄露

问题根源:调用云端模型 API 时,业务数据随 Prompt 传输至第三方;引入 MCP 等协议接入外部工具时,数据流向难以完全管控。

解决方案:

- 在调用链路前置安全网关,执行 PII 检测与脱敏,确保敏感数据不出域

- 涉及内部敏感数据的场景,优先选择私有化部署的开源模型(如 Llama 3、Qwen)

- 制定明确的数据分级策略:哪些数据可调用云端 API,哪些只能在内网处理

- 引入 MCP 工具时,审计其数据处理条款,优先选择支持零数据留存(Zero Data Retention)的服务商

痛点2:模型漂移与性能衰减

问题根源:生产环境的数据分布持续变化,模型未见过的模式增多,导致准确率逐渐下降(模型漂移)。

解决方案:

- 建立持续评估 Pipeline,定期在黄金测试集上评估模型表现,设置性能衰退阈值告警

- 利用 RAG 实时补充最新知识,减少对模型参数知识时效性的依赖

- 收集生产环境中的失败案例,定期触发增量微调(而非全量重训),成本更低、效果更精准

- 部署 A/B 测试框架,安全地验证模型版本或 Prompt 更新的实际效果

痛点3:黑盒决策,可解释性不足

问题根源:LLM 的推理过程本质上是概率过程,在金融风控、医疗辅助等高合规要求场景,"AI 说这样就这样"是不可接受的。

解决方案:

- 利用 LangSmith / LangFuse 可视化完整推理链路,使每个决策步骤可追溯

- 在 System Prompt 中显式要求模型输出推理过程(Chain-of-Thought),并与结果一同记录存档

- 对于高风险决策,设计人工审核节点(Human-in-the-Loop),AI 提供建议,人工最终确认

- 建立决策审计日志,满足监管机构对可解释性的要求

五、落地路径:渐进式搭建8层AI系统

关键原则:

- 可观测性优先:在系统搭建之初就接入追踪工具(LangFuse),而非等到出问题再补。

- 评估驱动:没有评估体系,就无法判断优化是否有效。先建立基准测试集,再谈优化。

- 渐进式复杂度:从单 Agent 到多 Agent,从单工具到多工具,逐步演进,避免一次性引入过多不确定性。

- 失败是常态:设计容错机制(重试、熔断、降级、兜底回复),而非假设模型每次都能给出完美输出。

六、工具链速查表

| 层次 | 场景 | 推荐工具 | 备注 |

|---|---|---|---|

| 第1层:基础设施 | 容器编排 | Kubernetes | 生产环境标配 |

| 第1层:基础设施 | 推理加速 | vLLM | PagedAttention 大幅提升吞吐 |

| 第1层:基础设施 | 本地推理(开发调试) | Ollama | 轻量易用,适合本地开发 |

| 第1层:基础设施 | 向量数据库 | Qdrant / Pinecone / Milvus | Qdrant 开源可自托管 |

| 第2层:模型通信 | 多模型统一接口 | LiteLLM | 屏蔽不同厂商 API 差异 |

| 第3层:协议 | 工具标准化连接 | MCP(Anthropic) | AI工具生态的统一接口规范 |

| 第4层:工具增强 | RAG 构建 | LlamaIndex | RAG 场景更成熟 |

| 第4层:工具增强 | 安全过滤 | Guardrails AI / NeMo Guardrails | 输入输出安全防护 |

| 第5层:认知编排 | 复杂流程编排 | LangGraph | 图结构,支持循环和条件分支 |

| 第5层:认知编排 | 多 Agent 协作 | AutoGen / CrewAI | AutoGen 适合对话式多 Agent |

| 第7层:应用 | 应用框架 | LangChain | 快速原型,生态丰富 |

| 第7层:应用 | 模型微调 | Axolotl / LLaMA-Factory | LoRA 微调首选 |

| 第8层:观测治理 | LLM 可观测性 | LangSmith / LangFuse | LangFuse 开源可自托管 |

| 第8层:观测治理 | 基础设施监控 | Prometheus + Grafana | 标准可观测性组合 |

总结

AI工程化的本质是:将算法的"不确定性",包裹在工程的"确定性"之中。

一个工业级 AI 系统的衡量标准,不是模型在 Benchmark 上的分数,而是:

- 它在生产环境中能否稳定运行?

- 当模型输出错误时,系统能否优雅降级?

- 当数据分布变化时,能否及时感知并响应?

- 当业务需求变更时,架构能否低成本演进?

从认知转变开始:停止只关注模型性能,开始关注系统健壮性。审视你的项目:是否有 RAG 数据管线?是否有编排熔断机制?是否有可观测性基础设施?对照8层架构,逐层搭建,逐步落地。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)