清华重磅开源 OpenMAIC:多智能体时代下的大模型课堂新范式

清华重磅开源 OpenMAIC:多智能体时代下的大模型课堂新范式

各位热爱 AI 和效率工具的同行们,大家应该都刷过各种慕课(MOOC)或者长篇的技术分享讲座吧?最大的痛点是什么?枯燥的单向输出。没人互动,不懂的地方只能暂停自己去搜,而且所有的进度都是老师定死的。

但现在,大模型和 Agent 的爆发,终于要把这块硬骨头啃下来了。最近,由清华大学(THU-MAIC)开源出品的 OpenMAIC 在 GitHub 上强势登榜。它不仅终结了“看视频学习”的无趣时代,更是通过**多智能体协作框架(LangGraph)**,彻底重塑了教与学的过程。这可以说是我近期看到把 Agent 应用落地得最惊艳的项目之一。

今天,我们就来深度扒一扒这个让课堂“活”起来的项目,看看它的底层源码是如何利用 LLM 和 Agent 架构完成降维打击的。

1. 什么是 OpenMAIC?不只是课件,而是整座“教室”

OpenMAIC 的全称是 Open Multi-Agent Interactive Classroom。只要你丢给它一个主题(或者是长文档/PDF),它能在几分钟内自动生成一整套包含以下内容的沉浸式课堂:

- 🎙️ AI 教师伴随着幻灯片实时语音讲解

- 🎨 AI 教师在共享白板上实时绘制流程图和推导公式

- 🙋 AI 同学随时向老师提问、辩论并引发课堂讨论

- 🧪 PBD(项目制学习)与 HTML 交互式沙盒模拟

也就是说,它把 LangChain、多模态 TTS(语音)、动态前端(React/Canvas 渲染)全部结合在了一起。更硬核的是,这个项目已经被真正落地验证过了,在清华校内跑了两年,服务了七百多名学生。

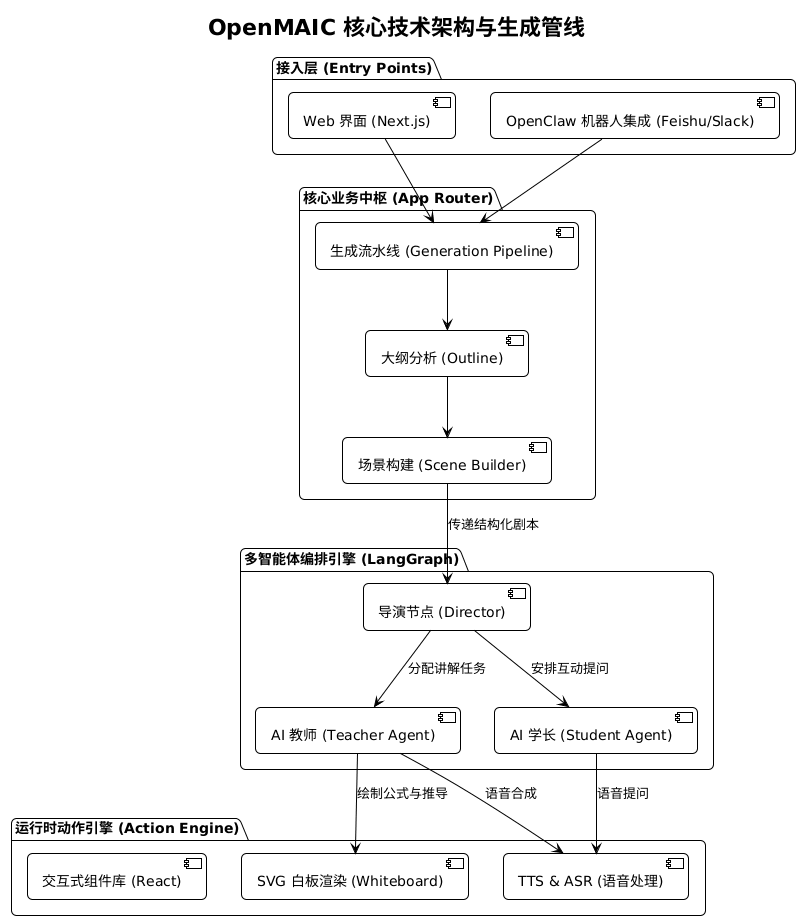

2. 核心源码架构:当 Next.js 遇上 LangGraph

如果你翻开它的源码仓库(采用了全栈 Next.js 16 + React 19),你会发现它的架构设计可以说是教科书级的 Agent 智能体系统设计:

2.1 两阶段生成流水线 (Generation Pipeline)

当我们输入指令后,/lib/generation 中的流水线开始了它的魔法:

- 大纲提炼:通过大语言模型先把几万字的文本抽取出结构化的大纲树。

- 场景剧本生成:将每一个大纲节点分配给独立的 Scene Builder,比如生成幻灯片脚本、测验题组件、甚至是用于动手模拟操作的交互式 HTML 沙盒。

2.2 LangGraph 状态机编排大脑

整个课堂中最令人拍案叫绝的,是它对多个智能体的调度方式——位于 /lib/orchestration 的机制完全是通过 LangGraph 状态机驱动的。

在这里存在一个 **Director(导演节点)**,它掌握着剧本走向。当 AI 教师说完一段幻灯片,Director 会判断是否有“AI 同学”需要在这个知识点进行提问补充(或者产生激辩),从而触发互动流。这种基于图结构的确定性与大模型自身的发散性达到了绝佳的平衡。

2.3 28+ 维度的运行时动作引擎 (Action Engine)

很多项目做到剧本生成就结束了。但 OpenMAIC 自己手搓了一个前端播放和动作引擎(Playback State Machine)。在它的前端(Web 画布),教师智能体的操作被抽象成了 28 余种底层指令。比如:

DrawShape/DrawMath:在白板上用 SVG 绘制;Speak:调用后端各种 TTS 服务;Spotlight:屏幕局部聚光灯效果。

所有的数据都通过 Zustand 管理并由 Web 画板精准渲染。这就好比用大模型写出了一场话剧,然后让浏览器当舞台把它演了出来。

3. 破圈杀手锏:打通 OpenClaw 的一键部署

这套复杂的平台是不是很难安装?OpenMAIC 对部署极度宽容。它的亮点之一就是内置支持了 **OpenClaw 集成**。

通过 OpenClaw,你可以直接在 Slack、飞书、Discord 甚至 Telegram 这样的聊天群里直接唤出课堂。

# 仅仅一行命令就能将技能安装到 Agent

clawhub install openmaic

你可以直接对飞书里的个人助理说:“教我一下量子物理”,后台的大模型就会调用 OpenMAIC 的 API 并在云端的托管环境为你生成一套完整的课堂连接扔回飞书中。这几乎把这套系统的触达成本降到了零。

当然,如果你为了安全需要私有化,它也提供了完整的 Docker Compose 和基于 Vercel 的一键部署,仅仅需要配置一个兼容 OpenAI 的 API KEY。这里团队也贴心地给出了高性价比指南:强烈推荐采用 Gemini 3 Flash 模型,极速且聪明。

4. 真实课堂演示:从大纲到多智能体激辩

光说不练假把式,我们直接来看看在一套真实的学习流程中,OpenMAIC 是如何发挥威力的。

场景 1:大纲生成与测试测验构建

仅仅需要输入你的教学意图,系统的第一流水线便会极速生成章节甚至相关测验。

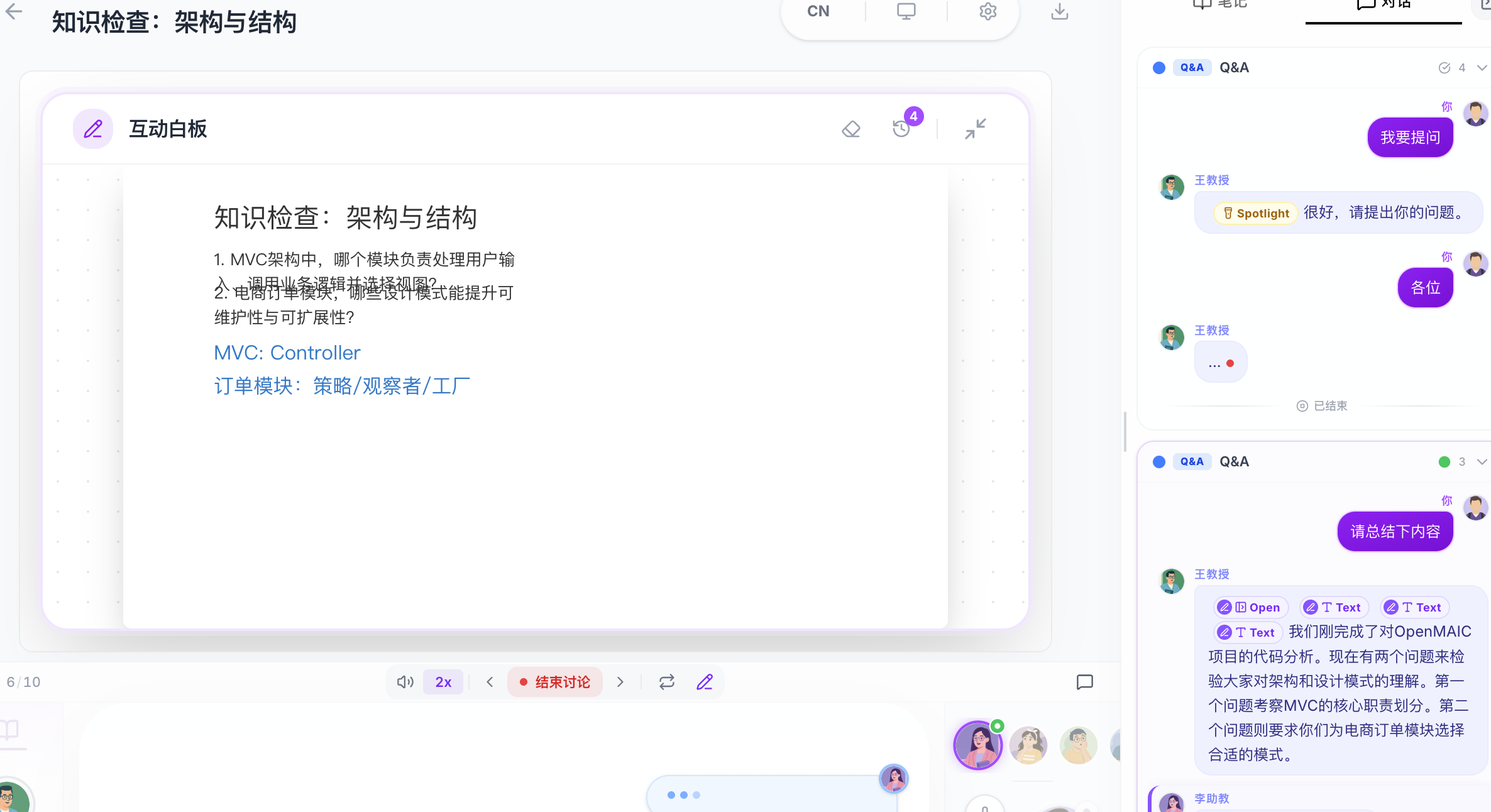

场景 2:基于 Canvas 的高清课件

在多智能体讲解时,中心的主舞台会呈现出结构化生成的高清板书和课件,而这一切都是可被底层动作引擎操作的。

场景 3:引爆灵感的 AI 讨论组

这绝对是它的灵魂所在。在界面的右侧,不再是枯燥的单选框,而是真实存在的“AI 同学虚拟课堂”。他们会针对老师的讲解进行提问、甚至相互激辩,极大地模拟了线下课堂的思想碰撞氛围。

5. 落地价值:我们能学到什么?

分析完 OpenMAIC,作为开发者我个人的直观感受是:

- Agent 的最终归宿是体验重塑:很多大模型产品只是加了一个侧边框对话机器人。而这套方案告诉我们,应该把前端交互界面完全留给 Agent 操作。从被动的视频点播,变成真正能够“随时打断并对战”的互动空间。

- 多模态正在成为标配:项目从底层的

lib/audioTTS/ASR 抽离到多模态图表解析,完全脱离了极客范畴,它是针对真实世界的视觉听觉输出。

6. 结语

从最早的黑板板书,到单向的在线网课,再到如今这个拥有无数个 AI 助教、能自我进化、自我辩论的 OpenMAIC 互动课堂。技术不仅只是让写代码变得多快好省,更根本的是扩大了优质教育资源的辐射面。

项目目前已经在 Github 上斩获了大量的 Star 并使用了极为开源友好的 AGPL-3.0 协议。感兴趣的极大推荐一定要通过阅读本文中我整理出的源码流向,克隆下来手敲一遍,感受下用 LangGraph 写大话剧的痛快感!

项目传送门

Github Repo:THU-MAIC/OpenMAIC

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)