Claw Code技术深度解析:Python+Rust混合架构的设计与实现

最近很多开发者都在讨论GitHub上的一个现象级项目:Claw Code。这个开源的AI编码Agent框架在短短72小时内获得了72K星标,创造了GitHub历史上最快的增长记录。本文将从工程实践的角度,深度解析Claw Code的技术架构、核心模块和实际应用。

技术背景与发展历程

Claw Code的出现与之前的Claude Code泄露事件直接相关。2025年底,Anthropic内部的Claude Code项目代码在GitHub上意外泄露,虽然原始代码很快被删除,但它展示了一种全新的终端AI编码工具设计思路。

Claw Code团队采取了"清洁室重新实现"的方法,在理解Claude Code核心设计思想的基础上,用Python和Rust重新构建了一个开源版本。这种方法既避免了版权问题,又保留了原项目的技术精髓。

从技术演进的角度看,Claw Code代表了终端AI编程工具的一个新阶段。早期工具如GitHub Copilot主要集成在IDE中,而Claude Code和Claw Code则将AI编码能力带到了终端。

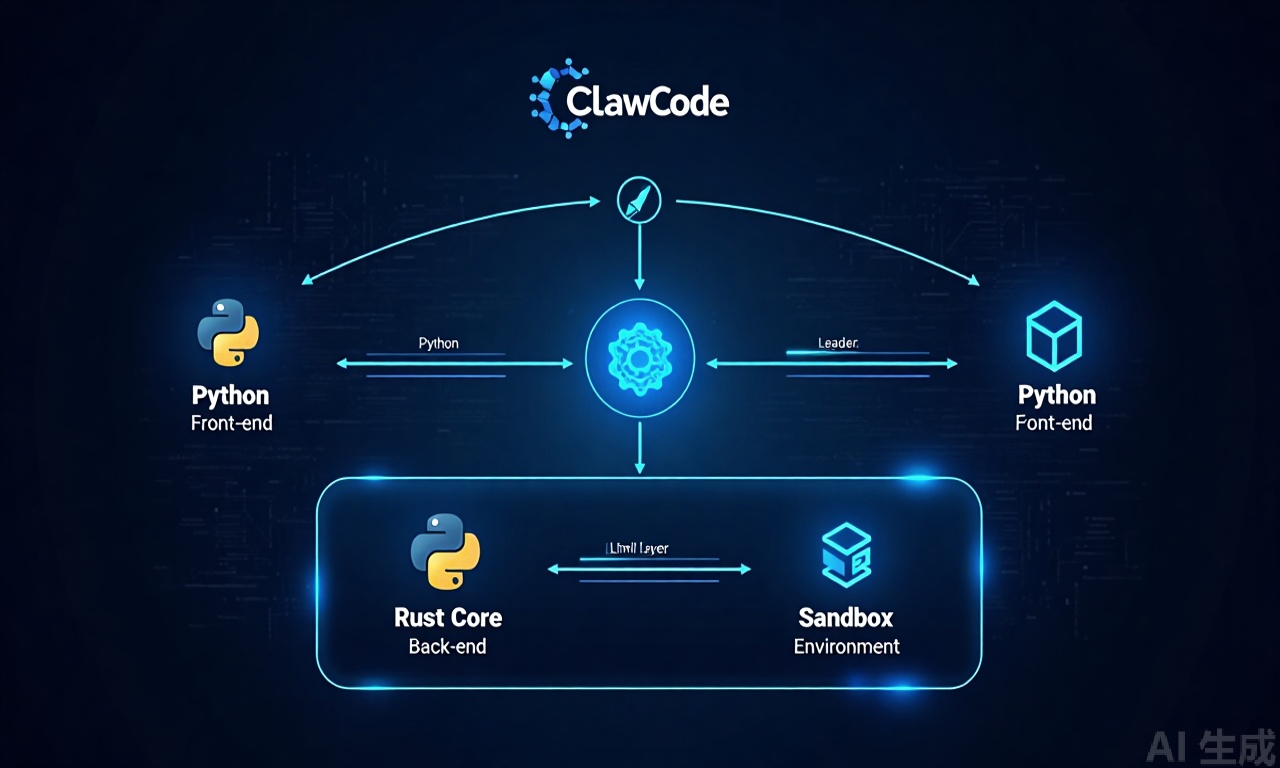

Python+Rust混合架构设计

架构分层设计

Claw Code的核心设计思想是利用不同语言的优势来处理不同的任务:

- Python层:负责CLI界面、配置文件解析、插件管理和与用户的交互

- Rust层:负责代码解析、计划生成、执行监控和性能优化

- 通信机制:通过Python的

subprocess模块或专门的IPC通道进行数据交换

实际执行流程

在实际使用中,当用户输入一个命令如claw-code refactor file.py时:

- Python层会解析参数并调用相应的插件

- 插件预处理后的请求被传递给Rust核心引擎

- Rust引擎负责生成具体的代码修改计划

- 最后再通过Python层展示结果并处理用户反馈

oh-my-codex核心引擎解析

oh-my-codex是Claw Code的核心引擎,这个名字显然是对流行的oh-my-zsh的致敬。

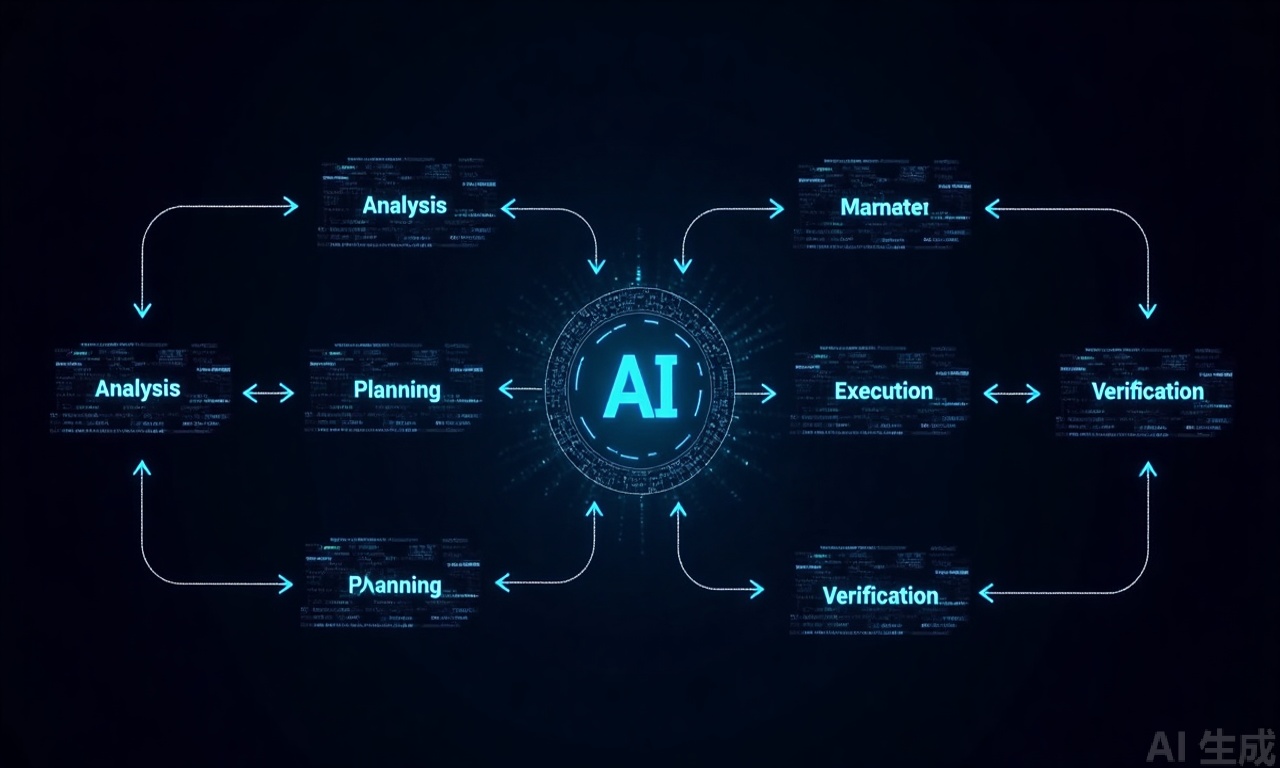

四阶段工作流程

这个引擎的工作流程可以分为四个主要阶段:

1. 解析阶段

- 分析用户意图,理解代码上下文

- 读取目标文件和相关依赖

- 提取代码结构、函数签名、类型信息

- 构建项目的上下文图

2. 计划阶段

- 将用户请求分解为可执行的子任务

- 确定每个任务的执行顺序和依赖关系

- 预估执行时间和资源需求

3. 执行阶段

- 根据配置选择合适的LLM后端

- 构建包含完整上下文的提示词

- 处理AI模型的响应并提取代码片段

4. 验证阶段

- 语法检查和类型检查

- 测试用例运行(如果可用)

- 代码风格一致性检查

多LLM后端支持机制

Claw Code设计了一个灵活的LLM后端适配系统,可以同时支持多种AI模型提供商。当前的实现包括对OpenAI API、Anthropic Claude API和Google Gemini API的集成。

后端适配器设计模式

后端适配器的设计采用了工厂模式,提供了统一的接口:

class LLMBackend:

def generate_code(self, prompt: str, context: CodeContext) -> str:

pass

class OpenAIBackend(LLMBackend):

def __init__(self, api_key: str, model: str = "gpt-4"):

self.client = OpenAI(api_key=api_key)

self.model = model

def generate_code(self, prompt: str, context: CodeContext) -> str:

# OpenAI-specific implementation

pass

配置示例

llm_backends:

openai:

enabled: true

api_key: ${OPENAI_API_KEY}

model: gpt-4-turbo-preview

claude:

enabled: false

api_key: ${ANTHROPIC_API_KEY}

model: claude-3-opus-20240229

沙箱执行环境与安全设计

AI生成的代码可能包含安全风险,Claw Code通过沙箱环境来解决这个问题。当生成的代码需要实际执行时,Claw Code会将其放入隔离的Docker容器中执行。

安全设计核心组件

- 权限限制:沙箱中的代码以非特权用户运行,无法访问宿主机文件系统

- 资源隔离:每个执行任务都有独立的网络命名空间和文件系统

- 超时控制:默认5分钟超时,防止无限循环或资源耗尽

- 资源配额:限制CPU、内存和磁盘使用量

安装与部署指南

多种安装方式

通过pip安装(最简单):

pip install claw-code

从源码编译安装(获得最新特性):

git clone https://github.com/instructkr/claw-code.git

cd claw-code

poetry install

cargo build --release

pip install -e .

使用Docker(隔离环境):

docker run -it --rm -v $(pwd):/app ghcr.io/instructkr/claw-code:latest

环境配置

配置完成后,你需要在环境中设置API密钥:

export OPENAI_API_KEY="your-api-key-here"

export ANTHROPIC_API_KEY="your-anthropic-key" # 可选

export GOOGLE_API_KEY="your-google-key" # 可选

插件开发与扩展

Claw Code的插件系统让开发者可以轻松扩展其功能。创建一个新的工具插件只需要实现几个核心接口:

from claw_code.plugin import Plugin, PluginContext

class MyCustomPlugin(Plugin):

def __init__(self, context: PluginContext):

self.context = context

def execute(self, command: str, args: list) -> str:

# 实现具体的工具逻辑

return "执行结果"

def get_help(self) -> str:

return "自定义插件的使用说明"

插件配置文件

plugins:

custom_tools:

- name: "my-custom-plugin"

module: "my_plugin_module.MyCustomPlugin"

enabled: true

实际工作流集成

代码审查助手

claw-code review --file=src/main.py --suggestions=5

自动化重构

claw-code refactor --pattern="old_api.*" --replacement="new_api."

文档生成

claw-code docstring --file=src/utils.py --functions=all

测试用例生成

claw-code generate-tests --file=src/models.py --coverage=80

性能优化建议

对于大型代码库,可以采取一些优化措施:

- 增量索引:只索引修改过的文件而不是整个项目

- 缓存机制:对重复的查询结果进行缓存

- 并行处理:将独立的任务分发给多个worker同时处理

- 选择性上下文:只将相关的代码文件作为上下文提供给AI模型

总结

架构设计三大特点

- 混合语言策略:Python+Rust的组合平衡了开发速度和运行性能

- 模块化扩展:插件化的设计让生态可以快速成长

- 安全优先:沙箱执行环境确保AI代码可以被安全测试

工程实践价值

Claw Code的案例告诉我们,当优秀的工程实践遇到真实的需求,就能创造出真正的价值。它不仅仅是一个工具,更是一个参考架构,展示了如何将先进的AI能力以开发者友好的方式集成到日常工作流中。

技术选型建议

如果你在考虑采用AI编码工具,可以从以下几个维度评估:

- 架构设计:是否易于集成到现有工作流?

- 安全性:如何处理AI生成代码的安全风险?

- 扩展性:能否添加自定义的工具和插件?

- 成本效益:API调用成本和效率提升是否平衡?

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献56条内容

已为社区贡献56条内容

所有评论(0)